Obraz Qwen jest generowaniem i edycją obrazu model fundamentu w rodzinie Qwen zaprojektowanej dla renderowanie tekstu o wysokiej wierności, precyzyjna edycjai ogólnego generowania tekstu na obraz. Jest przeznaczony do wykonywania generowanie uwzględniające tekst, renderowanie tekstu dwujęzycznego (szczególnie dobrze zna język chiński i angielski) i szczegółowa edycja kontekstowa. W wydaniu podkreślono połączenie zrozumieć + wygenerować filozofia projektowania (zadania związane ze zrozumieniem obrazu i zadania generatywne trenowane w zunifikowanym procesie).

Główne cechy

- Natywne / wysokiej jakości renderowanie tekstu wewnątrz obrazów — doskonale radzi sobie z generowaniem czytelnego, semantycznie poprawnego tekstu na generowanych obrazach (plakatach, opakowaniach, zrzutach ekranu) — co stanowiło problem dla wielu wcześniejszych modeli obrazów.

- Wysokiej jakości wyjście multimodalne — tworzy fotorealistyczne i stylizowane obrazy z dużą ilością szczegółów i układem uwzględniającym język.

- Przenoszenie stylu i poprawa szczegółów — można stosować spójne style artystyczne lub podkreślać lokalne detale, zachowując jednocześnie spójność sceny.

Szczegóły techniczne — jak działa Qwen-Image

Architektura i komponenty (słowa kluczowe: MMDiT, Qwen2.5-VL). Model wykorzystuje Oparte na MMDiT transformator dyfuzyjny do syntezy obrazu w połączeniu z koder języka wizualnego (Qwen2.5-VL) do interpretacji podpowiedzi i kontekstu wizualnego. To rozdzielenie pozwala modelowi traktować wskazówki semantyczne oraz wygląd pikseli Inaczej, poprawiając wierność tekstu i spójność edycji. Oficjalne repozytorium i raport techniczny wskazują na szkielet 20B parametrów dla głównego modelu T2I.

Proces szkoleniowy (słowa kluczowe: nauka zgodnie z programem nauczania, proces przetwarzania danych). Aby rozwiązać problem renderowania tekstu, Qwen-Image używa progresywny program nauczania: zaczyna od prostszych obrazów nietekstowych i stopniowo trenuje na bardziej złożonych przykładach z dużą ilością tekstu, aż do danych wejściowych na poziomie akapitu. Zespół opracował kompleksowy proces, który obejmuje gromadzenie danych na dużą skalę, staranne filtrowanie, syntetyczne wzbogacanie i równoważenie, aby zapewnić modelowi wiele realistycznych kompozycji tekstu/zdjęć podczas treningu. Ten strategiczny program nauczania jest kluczowym powodem, dla którego model doskonale radzi sobie z renderowaniem tekstu wielojęzycznego.

Mechanizm edycji (słowa kluczowe: podwójne kodowanie, koder VAE + VL). Do edycji system podaje oryginalny obraz dwa razy: raz do enkodera Qwen2.5-VL dla kontrola semantyczna i raz do kodera VAE dla informacje o wyglądzie rekonstrukcyjnymDzięki podwójnemu kodowaniu moduł edycji zachowuje tożsamość i wierność wizualną, a jednocześnie pozwala na modyfikacje semantyczne — na przykład zastąpienie obiektu lub zmianę zawartości tekstowej bez degradacji niezwiązanych z nim obszarów.

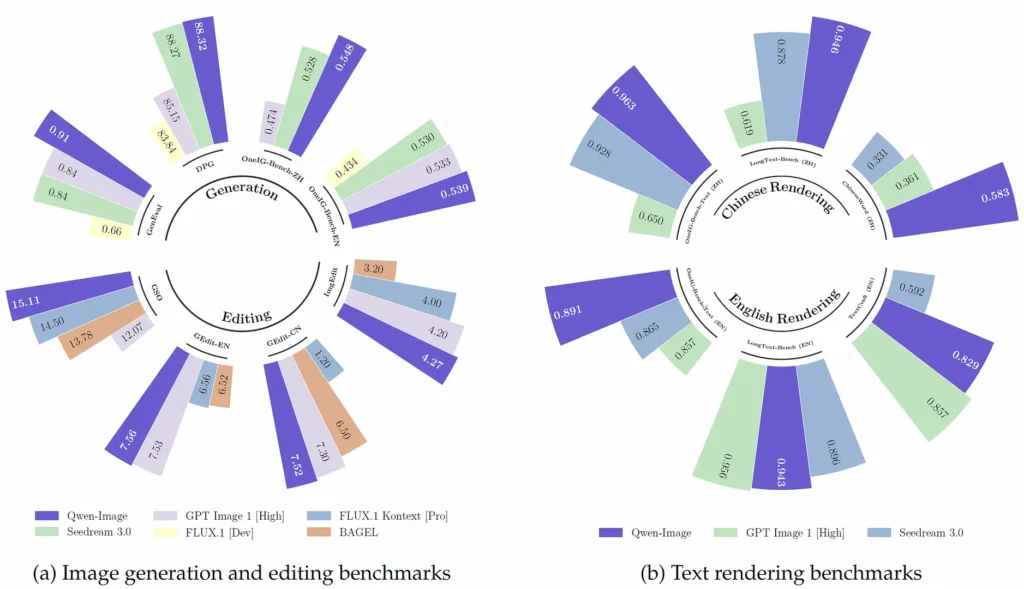

Wydajność wzorcowa

Oprogramowanie Qwen-Image osiąga wydajność SOTA lub zbliżoną do SOTA w wielu publicznych testach porównawczych dotyczących zarówno generowania, jak i edycji, uzyskując szczególnie dobre wyniki w zadaniach renderowania tekstu i testach kompozycji w warunkach rzeczywistych (np. T2I-CoreBench i specjalnie opracowane pakiety do edycji obrazów).

Porównanie Qwen-Image z innymi wiodącymi modelami

Względne mocne strony: renderowanie tekstu i wierność tekstu dwujęzycznego To wyróżniające zalety modelu w porównaniu z wieloma konkurencyjnymi systemami generatywnymi (np. DALL·E 3, SDXL, Midjourney), które często są silniejsze pod względem czysto artystycznej kompozycji lub różnorodności stylistycznej, ale słabsze w gęstym układzie tekstu wielowierszowego lub chińskiego. Wielokrotne porównania w środowiskach i tabele porównawcze autorów modelu potwierdzają tę charakterystykę.

Kompromisy względne: w porównaniu do zamkniętych, mocno dostrojonych systemów komercyjnych, Qwen-Image może wymagać przetwarzanie końcowe lub dostrajanie za pomocą szybkiego/adaptera w celu osiągnięcia identycznego realizmu w niektórych kontekstach (deformacja powierzchni zakrzywionych, fotorealistyczna kompozycja), zgodnie z niezależnymi testami. Dla użytkowników, którzy stawiają na pierwszym miejscu projekty szablonowe, makiety opakowań lub dwujęzyczne układy tekstowe, Qwen-Image jest zazwyczaj lepszy.

Typowe i wartościowe przypadki użycia

- Makiety opakowań i produktów: dokładny tekst i układ wielowierszowy dla etykiet i opakowań próbnych.

- Projekty reklamowe i projektowe: szybkie prototypowanie, gdzie ważna jest wierność tekstu (plakaty, banery).

- Udokumentowane generowanie obrazu: generowanie obrazów, które muszą zawierać czytelną treść (menu, znaki, interfejsy).

- Procesy edycji obrazu: celowe edycje (zamiana tekstu, dodawanie/usuwanie obiektów) z zachowaniem stylu i perspektywy.

Jak wywołać API qwen-image z CometAPI

qwen-image Ceny API w CometAPI, 20% zniżki od ceny oficjalnej:

Wymagane kroki

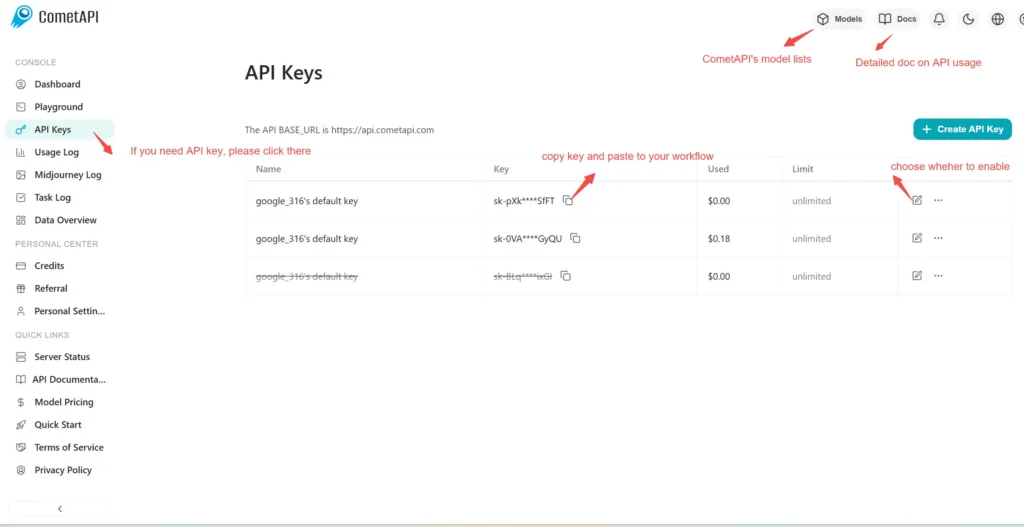

- Zaloguj się do pl.com. Jeżeli jeszcze nie jesteś naszym użytkownikiem, najpierw się zarejestruj.

- Zaloguj się na swoje Konsola CometAPI.

- Pobierz klucz API uwierzytelniania dostępu do interfejsu. Kliknij „Dodaj token” przy tokenie API w centrum osobistym, pobierz klucz tokena: sk-xxxxx i prześlij.

Użyj metody

- Wybierz punkt końcowy „qwen-image”, aby wysłać żądanie API i ustawić treść żądania. Metodę żądania i treść żądania można znaleźć w dokumentacji API naszej strony internetowej. Dla Państwa wygody nasza strona internetowa udostępnia również test Apifox.

- Zastępować za pomocą aktualnego klucza CometAPI ze swojego konta.

- Wpisz swoje pytanie lub prośbę w polu treści — model odpowie właśnie na tę wiadomość.

- . Przetwórz odpowiedź API, aby uzyskać wygenerowaną odpowiedź.

CometAPI zapewnia w pełni kompatybilne API REST, co umożliwia bezproblemową migrację. Kluczowe szczegóły generowanie obrazu:

- Adres URL bazowy: https://api.cometapi.com/v1/images/generations

- Nazwy modeli: obraz qwen

- Poświadczenie:

Bearer YOUR_CometAPI_API_KEYnagłówek - Typ zawartości:

application/json.

Model „qwen-image” nie wymaga parametru „n” i może wygenerować tylko jeden obraz.

Zobacz też Interfejs API obrazów Flash Gemini 2.5 (Nano-Banana)