Najnowszy postęp Alibaby w dziedzinie sztucznej inteligencji, Koder Qwen3, stanowi kamień milowy w dynamicznie rozwijającym się krajobrazie rozwoju oprogramowania opartego na sztucznej inteligencji. Zaprezentowany 23 lipca 2025 roku, Qwen3-Coder to agentowy model kodowania typu open source, zaprojektowany do autonomicznego wykonywania złożonych zadań programistycznych, od generowania kodu szablonowego po debugowanie całych baz kodu. Zbudowany w oparciu o najnowocześniejszą architekturę mieszanego zestawu ekspertów (MoE) i oferujący 480 miliardów parametrów z 35 miliardami aktywowanymi na token, model ten osiąga optymalną równowagę między wydajnością a efektywnością obliczeniową. W tym artykule badamy, co wyróżnia Qwen3-Coder, analizujemy jego wydajność w testach porównawczych, omawiamy jego innowacje techniczne, prowadzimy programistów przez proces optymalnego wykorzystania oraz rozważamy odbiór modelu i jego przyszłe perspektywy.

Czym jest Qwen3‑Coder?

Qwen3‑Coder to najnowszy model kodowania agentowego z rodziny Qwen, oficjalnie zaprezentowany 22 lipca 2025 roku. Zaprojektowany jako „najbardziej agentowy model kodu jak dotąd”, jego flagowy wariant, Qwen3‑Coder‑480B‑A35B‑Instruct, oferuje łącznie 480 miliardów parametrów, a architektura Mixture‑of‑Experts (MoE) aktywuje 35 miliardów parametrów na token. Natywnie obsługuje okna kontekstowe do 256 tys. tokenów i skaluje się do miliona tokenów dzięki technikom ekstrapolacji, zaspokajając zapotrzebowanie na zrozumienie i generowanie kodu na skalę repozytorium.

Oprogramowanie typu open source w ramach Apache 2.0

Zgodnie z zaangażowaniem Alibaby w rozwój oparty na społeczności, Qwen3‑Coder jest udostępniany na licencji Apache 2.0. Ta dostępność open-source zapewnia transparentność, sprzyja wkładowi stron trzecich i przyspiesza adopcję zarówno w środowisku akademickim, jak i w przemyśle. Naukowcy i inżynierowie mogą uzyskać dostęp do wstępnie wytrenowanych wag i dostroić model do specjalistycznych dziedzin, od technologii finansowych po obliczenia naukowe.

Ewolucja z Qwen2.5

Bazując na sukcesie Qwen2.5‑Coder, który oferował modele o parametrach od 0.5 do 32 miliardów i osiągał wyniki SOTA w testach generowania kodu, Qwen3‑Coder rozszerza możliwości swojego poprzednika poprzez większą skalę, ulepszone potoki danych i nowatorskie metody trenowania. Qwen2.5‑Coder został wytrenowany na ponad 5.5 biliona tokenów z wykorzystaniem skrupulatnego czyszczenia danych i generowania danych syntetycznych; Qwen3‑Coder rozwija to, przetwarzając 7.5 biliona tokenów z 70% współczynnikiem kodu, wykorzystując wcześniejsze modele do filtrowania i przepisywania zaszumionych danych wejściowych w celu uzyskania wyższej jakości danych.

Jakie są główne innowacje wyróżniające Qwen3-Coder?

Qwen3-Coder wyróżnia się kilkoma kluczowymi innowacjami:

- Koordynacja zadań agentowych: Zamiast tylko generować fragmenty kodu, Qwen3-Coder może autonomicznie łączyć ze sobą wiele operacji — odczytywanie dokumentacji, wywoływanie narzędzi i sprawdzanie wyników — bez ingerencji człowieka.

- Ulepszony budżet myślenia:Programiści mogą skonfigurować, ile mocy obliczeniowej jest poświęcane każdemu etapowi rozumowania, co pozwala na uzyskanie kompromisu między szybkością i dokładnością, co jest kluczowe w przypadku syntezy kodu na dużą skalę.

- Bezproblemowa integracja narzędzi:Interfejs wiersza poleceń Qwen3-Coder, „Qwen Code”, dostosowuje protokoły wywoływania funkcji i niestandardowe monity, aby zintegrować się z popularnymi narzędziami programistycznymi, co ułatwia osadzanie w istniejących procesach CI/CD i środowiskach IDE.

Jak Qwen3‑Coder wypada na tle konkurencji?

Pojedynki benchmarkowe

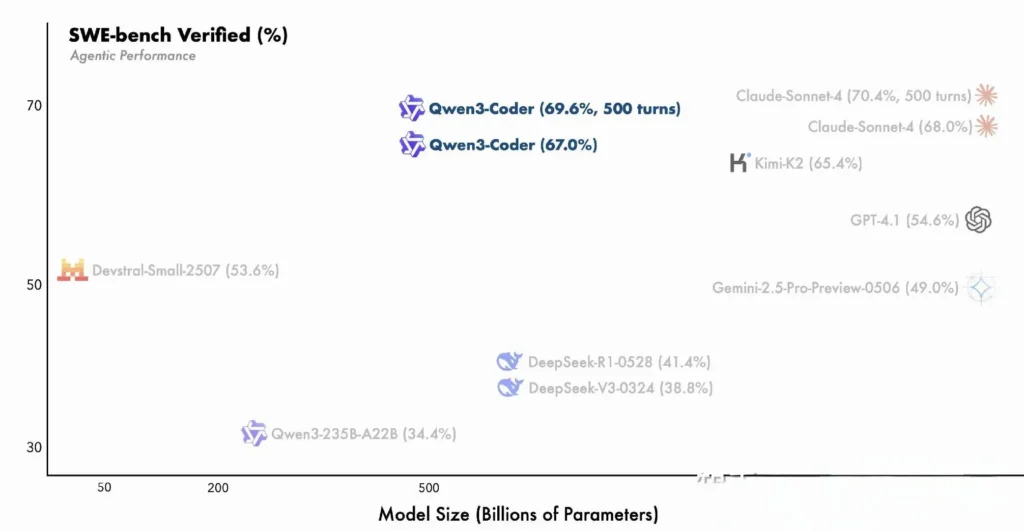

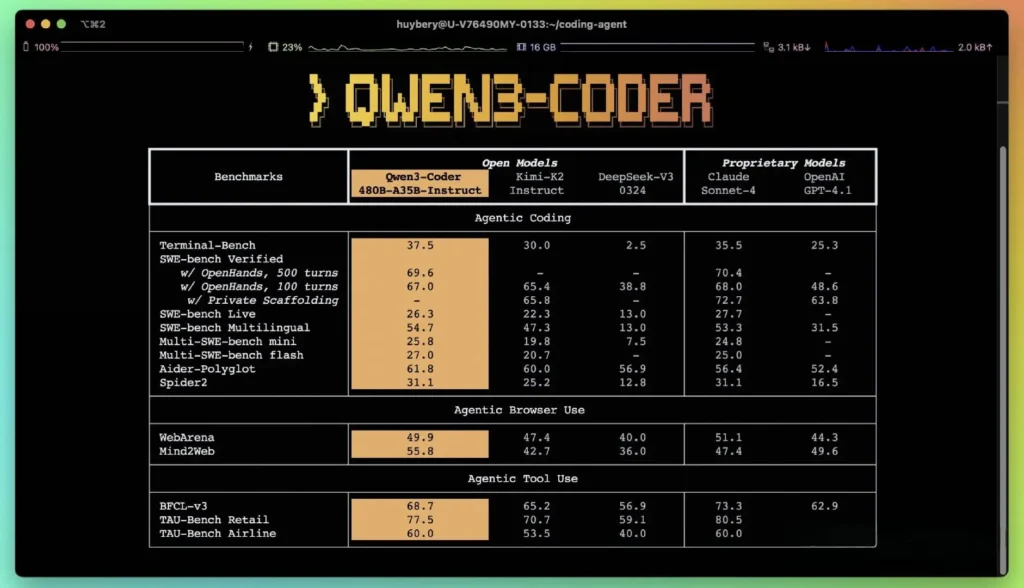

Według opublikowanych przez Alibabę wskaźników wydajności, Qwen3-Coder przewyższa wiodące krajowe alternatywy – takie jak modele oparte na kodeksie DeepSeek i K2 firmy Moonshot AI – i dorównuje, a nawet przewyższa możliwości kodowania czołowych amerykańskich rozwiązań w wielu testach porównawczych. W ocenach niezależnych firm:

- Pomocniczy poliglota:Qwen3-Coder-480B uzyskał wynik 61.8%, ilustrując silne generowanie i wnioskowanie kodu wielojęzycznego.

- MBPP i HumanEvalNiezależne testy wykazały, że Qwen3-Coder-480B-A35B przewyższa GPT-4.1 zarówno pod względem poprawności funkcjonalnej, jak i obsługi złożonych monitów, szczególnie w przypadku wyzwań kodowania wieloetapowego.

- Wariant z parametrami 480B osiągnął ponad 85% skuteczności wykonania Ławka SWE Zweryfikowany pakiet — przewyższający najlepszy model DeepSeek (78%) i K2 Moonshot (82%), a także blisko dorównujący Claude Sonnet 4 z wynikiem 86%.

Porównanie z modelami zastrzeżonymi

Alibaba twierdzi, że możliwości agentowe Qwen3‑Codera są zgodne z Claude firmy Anthropic i GPT‑4 firmy OpenAI w kompleksowych przepływach pracy kodowania, co jest niezwykłym osiągnięciem jak na model open source. Wcześni testerzy donoszą, że wieloetapowe planowanie, dynamiczne wywoływanie narzędzi i automatyczna korekcja błędów umożliwiają obsługę złożonych zadań – takich jak tworzenie pełnozakresowych aplikacji internetowych czy integracja procesów CI/CD – przy minimalnej liczbie podpowiedzi ze strony człowieka. Możliwości te są wspierane przez zdolność modelu do samowalidacji poprzez wykonywanie kodu, co jest cechą mniej widoczną w czysto generatywnych modelach LLM.

Jakie innowacje techniczne kryją się za Qwen3‑Coder?

Architektura Mixture‑of‑Experts (MoE)

Sercem Qwen3‑Coder jest najnowocześniejsza konstrukcja MoE. W przeciwieństwie do gęstych modeli, które aktywują wszystkie parametry dla każdego tokena, architektury MoE selektywnie angażują wyspecjalizowane podsieci (ekspertów) dostosowane do konkretnych typów tokenów lub zadań. W Qwen3‑Coder 480 miliardów parametrów jest rozdystrybuowanych pomiędzy wielu ekspertów, a na każdy token przypada tylko 35 miliardów aktywnych parametrów. Takie podejście obniża koszty wnioskowania o ponad 60% w porównaniu z podobnymi gęstymi modelami, zachowując jednocześnie wysoką dokładność syntezy kodu i debugowania.

Tryb myślenia i tryb niemyślenia

Korzystając z innowacji szerszej rodziny Qwen3, Qwen3‑Coder integruje wnioskowanie dwumodowe struktura:

- Tryb myślenia przydziela większy „budżet na myślenie” na złożone zadania wymagające rozumowania wieloetapowego, takie jak projektowanie algorytmów lub refaktoryzacja międzyplikowa.

- Tryb niemyślenia zapewnia szybkie, zależne od kontekstu odpowiedzi, odpowiednie do prostego uzupełniania kodu i fragmentów kodu API.

To ujednolicone przełączanie trybów eliminuje konieczność żonglowania oddzielnymi modelami dla zadań zoptymalizowanych pod kątem czatu i zoptymalizowanych pod kątem wnioskowania, co usprawnia przepływy pracy programistów.

Uczenie wzmacniające z automatyczną syntezą przypadków testowych

Wyjątkową innowacją jest natywne okno kontekstowe tokenów Qwen3‑Coder o pojemności 256 KB – dwukrotnie większej niż typowa pojemność wiodących modeli otwartych – oraz obsługa do miliona tokenów za pomocą metod ekstrapolacji (np. YaRN). Pozwala to modelowi przetwarzać całe repozytoria, zestawy dokumentacji lub projekty wieloplikowe w jednym przebiegu, zachowując zależności międzyplikowe i redukując liczbę powtarzających się komunikatów. Testy empiryczne pokazują, że rozszerzenie okna kontekstowego przynosi malejące, ale wciąż znaczące korzyści w wydajności zadań długoterminowych, szczególnie w scenariuszach uczenia się przez wzmacnianie sterowanego środowiskiem.

W jaki sposób programiści mogą uzyskać dostęp do Qwen3‑Coder i z niego korzystać?

Strategia wydania Qwen3-Coder kładzie nacisk na otwartość i łatwość wdrożenia:

- Wagi modeli Open Source:Wszystkie punkty kontrolne modelu są dostępne w serwisie GitHub w ramach Apache 2.0, co zapewnia pełną przejrzystość i usprawnienia wprowadzane przez społeczność.

- **Interfejs wiersza poleceń (kod Qwen)**Interfejs wiersza poleceń, będący rozwidleniem kodu Google Gemini Code, obsługuje niestandardowe monity, wywoływanie funkcji i architekturę wtyczek, co pozwala na bezproblemową integrację z istniejącymi systemami kompilacji i środowiskami IDE.

- Wdrożenia w chmurze i na miejscu:Wstępnie skonfigurowane obrazy Docker i wykresy Helm Kubernetes ułatwiają skalowalne wdrożenia w środowiskach chmurowych, podczas gdy lokalne receptury kwantyzacji (dynamiczna kwantyzacja 2–8 bitów) umożliwiają wydajne wnioskowanie lokalne, nawet na standardowych procesorach graficznych.

- Dostęp do API przez CometAPI:Deweloperzy mogą również wchodzić w interakcję z Qwen3-Coder za pośrednictwem hostowanych punktów końcowych na platformach takich jak Interfejs API Comet, które oferują oprogramowanie Open Source(

qwen3-coder-480b-a35b-instruct) i wersje komercyjne(qwen3-coder-plus; qwen3-coder-plus-2025-07-22)w tej samej cenie. Wersja komercyjna ma długość 1M. - Przytulanie Twarzy:Alibaba udostępniła wagi Qwen3‑Coder i towarzyszące im biblioteki bezpłatnie na Hugging Face i GitHub, w pakiecie z licencją Apache 2.0, która pozwala na wykorzystanie w celach akademickich i komercyjnych bez opłat licencyjnych.

Integracja API i SDK za pośrednictwem CometAPI

CometAPI to ujednolicona platforma API, która agreguje ponad 500 modeli AI od wiodących dostawców — takich jak seria GPT firmy OpenAI, Gemini firmy Google, Claude firmy Anthropic, Midjourney, Suno i innych — w jednym, przyjaznym dla programistów interfejsie. Oferując spójne uwierzytelnianie, formatowanie żądań i obsługę odpowiedzi, CometAPI radykalnie upraszcza integrację możliwości AI z aplikacjami. Niezależnie od tego, czy tworzysz chatboty, generatory obrazów, kompozytorów muzycznych czy oparte na danych potoki analityczne, CometAPI pozwala Ci szybciej iterować, kontrolować koszty i pozostać niezależnym od dostawcy — wszystko to przy jednoczesnym korzystaniu z najnowszych przełomów w ekosystemie AI.

Programiści mogą wchodzić w interakcje z Koder Qwen3 poprzez zgodny interfejs API w stylu OpenAI, dostępny za pośrednictwem CometAPI. Interfejs API Comet, które oferują oprogramowanie Open Source(qwen3-coder-480b-a35b-instruct) i wersje komercyjne(qwen3-coder-plus; qwen3-coder-plus-2025-07-22)w tej samej cenie. Wersja komercyjna ma długość 1 MB. Przykładowy kod dla Pythona (z wykorzystaniem klienta zgodnego z OpenAI) z najlepszymi praktykami zalecającymi ustawienia próbkowania: temperatura = 0.7, top_p = 0.8, top_k = 20 i kara za powtórzenie = 1.05. Długość danych wyjściowych może sięgać 65,536 XNUMX tokenów, co czyni ją odpowiednią do zadań generowania dużego kodu.

Na początek zapoznaj się z możliwościami modeli w Plac zabaw i zapoznaj się z Przewodnik po API aby uzyskać szczegółowe instrukcje. Przed uzyskaniem dostępu upewnij się, że zalogowałeś się do CometAPI i uzyskałeś klucz API.

Szybki start w Hugging Face i Alibaba Cloud

Deweloperzy chcący poeksperymentować z Qwen3‑Coder mogą znaleźć model Hugging Face w repozytorium Qwen/Qwen3‑Coder‑480B‑A35B‑InstructIntegracja jest usprawniona poprzez transformers biblioteka (wersja ≥ 4.51.0, aby uniknąć KeyError: 'qwen3_moe') i klientów Python zgodnych z OpenAI. Minimalny przykład:

from transformers import AutoModelForCausalLM, AutoTokenizer

model = AutoModelForCausalLM.from_pretrained("Qwen/Qwen3-480B-A35B-Instruct")

tokenizer = AutoTokenizer.from_pretrained("Qwen/Qwen3-480B-A35B-Instruct")

input_ids = tokenizer("def fibonacci(n):", return_tensors="pt").input_ids

output = model.generate(input_ids, max_length=200, temperature=0.7, top_p=0.8, top_k=20, repetition_penalty=1.05)

print(tokenizer.decode(output))

Definiowanie niestandardowych narzędzi i przepływów pracy agentów

Jedną z wyróżniających się cech Qwen3‑Coder jest dynamiczne wywoływanie narzędziProgramiści mogą rejestrować zewnętrzne narzędzia – lintery, formatery, programy uruchamiające testy – i pozwalać modelowi na autonomiczne ich wywoływanie podczas sesji kodowania. Ta funkcja przekształca Qwen3‑Coder z pasywnego asystenta kodu w aktywnego agenta kodującego, zdolnego do uruchamiania testów, dostosowywania stylu kodu, a nawet wdrażania mikrousług w oparciu o intencje konwersacyjne.

Jakie potencjalne zastosowania i przyszłe kierunki rozwoju umożliwia Qwen3‑Coder?

Łącząc swobodę open source z wydajnością klasy enterprise, Qwen3‑Coder toruje drogę dla nowej generacji narzędzi programistycznych opartych na sztucznej inteligencji. Od zautomatyzowanych audytów kodu i kontroli zgodności z przepisami bezpieczeństwa, po usługi ciągłej refaktoryzacji i asystentów programistów opartych na sztucznej inteligencji, wszechstronność tego modelu już teraz inspiruje zarówno startupy, jak i wewnętrzne zespoły ds. innowacji.

Przepływy pracy w zakresie rozwoju oprogramowania

Wcześni użytkownicy zgłaszają skrócenie czasu poświęcanego na kodowanie szablonowe, zarządzanie zależnościami i wstępne tworzenie szkieletów o 30–50%, co pozwala inżynierom skupić się na zadaniach projektowych i architektonicznych o wysokiej wartości. Pakiety ciągłej integracji mogą wykorzystywać Qwen3‑Coder do automatycznego generowania testów, wykrywania regresji, a nawet sugerowania optymalizacji wydajności na podstawie analizy kodu w czasie rzeczywistym.

Przedsiębiorstwa grają

W miarę jak firmy z branży finansowej, opieki zdrowotnej i e-commerce integrują Qwen3‑Coder z systemami o krytycznym znaczeniu, pętle sprzężenia zwrotnego między zespołami użytkowników a działem badawczo-rozwojowym Alibaby przyspieszą udoskonalenia – takie jak dostrajanie w zależności od domeny, ulepszone protokoły bezpieczeństwa i bardziej rygorystyczne wtyczki IDE. Co więcej, strategia open source Alibaby zachęca do wkładu społeczności globalnej, wspierając dynamiczny ekosystem rozszerzeń, testów porównawczych i bibliotek najlepszych praktyk.

Podsumowanie

Podsumowując, Qwen3‑Coder stanowi przełom w dziedzinie otwartej sztucznej inteligencji (SI) w inżynierii oprogramowania: to potężny, agentowy model, który nie tylko pisze kod, ale także koordynuje całe procesy programistyczne przy minimalnym nadzorze człowieka. Udostępniając tę technologię bezpłatnie i łatwo ją integrować, Alibaba demokratyzuje dostęp do zaawansowanych narzędzi SI i toruje drogę do ery, w której tworzenie oprogramowania staje się coraz bardziej zespołowe, wydajne i inteligentne.

FAQ

Co sprawia, że Qwen3‑Coder jest „agentem”?

Agentyczna sztuczna inteligencja odnosi się do modeli, które mogą autonomicznie planować i wykonywać wieloetapowe zadania. Zdolność Qwen3-Coder do wywoływania zewnętrznych narzędzi, uruchamiania testów i zarządzania bazami kodu bez ingerencji człowieka jest przykładem tego paradygmatu.

Czy Qwen3‑Coder nadaje się do użytku produkcyjnego?

Chociaż Qwen3‑Coder wykazuje wysoką wydajność w testach porównawczych i rzeczywistych, przedsiębiorstwa powinny przeprowadzić oceny specyficzne dla danej dziedziny i wdrożyć zabezpieczenia (np. procesy weryfikacji wyników) przed zintegrowaniem go z krytycznymi przepływami pracy produkcyjnymi.

Jakie korzyści przynosi deweloperom architektura Mixture‑of‑Experts?

MoE zmniejsza koszty wnioskowania, aktywując tylko istotne podsieci dla każdego tokena, co umożliwia szybsze generowanie i niższe koszty obliczeniowe. Ta wydajność jest kluczowa dla skalowania asystentów kodowania AI w środowiskach chmurowych.