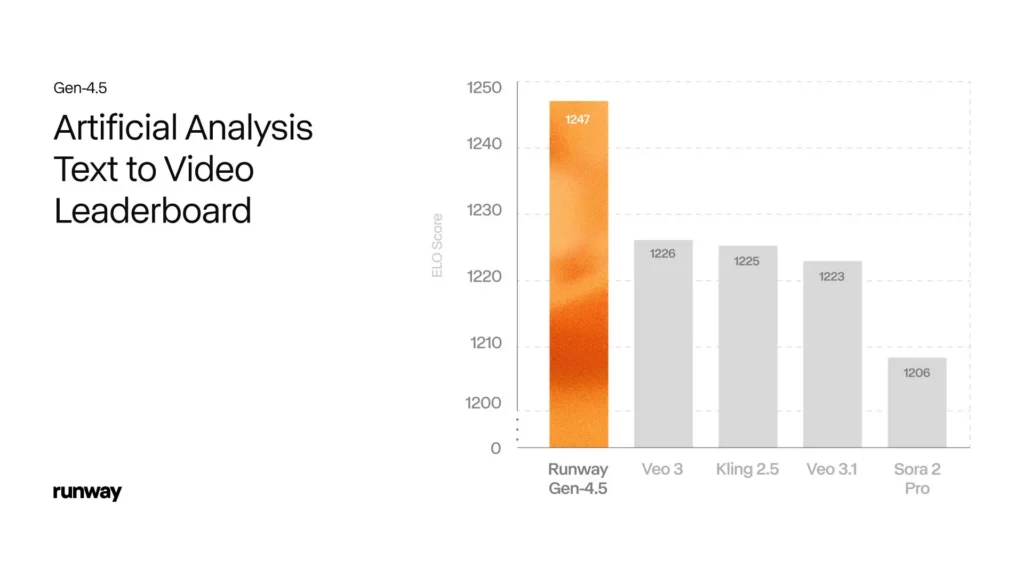

Runway Gen-4.5 to najnowszy flagowy model firmy do konwersji tekstu na wideo, zaprezentowany 1 grudnia 2025 roku. Jest on pozycjonowany jako stopniowa, ale znacząca ewolucja w stosunku do rodziny Gen-4, ze szczególnymi ulepszeniami w zakresie jakości ruchu, szybkości reakcji oraz realizmu czasowego/fizycznego – dokładnie tych obszarów, które historycznie oddzielały „dobre” wideo AI od „wiarygodnego” wideo AI. Runway Gen-4.5 prowadzi w rankingu najlepszych aplikacji do konwersji tekstu na wideo z wykorzystaniem sztucznej inteligencji (1,247 punktów ELO) i jest zoptymalizowany pod kątem kinowych, kontrolowanych wyników – jednocześnie obarczony typowymi ograniczeniami generatywnej sztucznej inteligencji, takimi jak drobne artefakty i sporadyczne błędy przyczynowe.

Poniżej znajduje się dogłębna, praktyczna i (jeśli to możliwe) poparta dowodami analiza tego, czym jest Gen-4.5, co nowego w porównaniu z Gen-4, jak wypada na tle konkurentów, takich jak Google Veo (3.1) i OpenAI Sora 2, rzeczywiste sygnały wydajności i wyniki testów porównawczych, a także szczera dyskusja na temat ograniczeń, ryzyka i najlepszych praktyk.

Czym jest Runway Gen-4.5?

Runway Gen-4.5 to najnowszy model generatora tekstu na wideo firmy Runway, wydany jako iteracyjna, ale istotna aktualizacja linii Gen-4 firmy. Runway pozycjonuje Gen-4.5 jako „nową granicę” w generowaniu wideo, kładąc nacisk na trzy główne ulepszenia w stosunku do poprzednich wersji: znacznie zwiększoną dokładność fizyczną (obiekty niosą realistyczną wagę i pęd), lepsze dopasowanie (to, czego oczekujesz, jest bardziej niezawodne) oraz wyższą wierność wizualną w ruchu i czasie (szczegóły takie jak włosy, splot materiału i połyskliwość powierzchni pozostają spójne w różnych klatkach). Gen-4.5 znajduje się obecnie na szczycie niezależnych rankingów, ocenianych przez użytkowników, wykorzystywanych do testów porównawczych konwersji tekstu na wideo.

Skąd wziął się Runway Gen-4.5 i dlaczego jest to ważne?

Modele wideo Runway szybko ewoluowały od Gen-1, przez Gen-3/Alpha, do Gen-4; Gen-4.5 jest prezentowany jako konsolidacja i optymalizacja ulepszeń architektonicznych, strategii danych pretrenowanych oraz technik posttrenowanych, mających na celu maksymalizację dynamiki, spójności czasowej i sterowalności. Dla twórców i zespołów produkcyjnych te ulepszenia mają na celu uczynienie klipów generowanych przez sztuczną inteligencję użytecznymi funkcjonalnie w prewizualizacji, tworzeniu treści reklamowych/marketingowych oraz produkcji krótkich narracji poprzez redukcję wrażenia „roboczego projektu”, które często występowało we wcześniejszych modelach przetwarzania tekstu na wideo.

4 najważniejsze funkcje Runway Gen-4.5

1) Poprawiony realizm fizyczny i dynamika ruchu

Runway Gen-4.5 kładzie nacisk na płynniejszy, bardziej fizycznie prawdopodobny ruch. Gen-4.5 koncentruje się na realistycznym ruchu obiektów – ciężarze, bezwładności, cieczach, tkaninach i fizycznie prawdopodobnych zderzeniach – tworząc sekwencje, w których interakcje wydają się mniej „płynne”, a bardziej realistyczne. W demonstracjach i moim teście model prezentuje ulepszone trajektorie obiektów, realizm ruchu kamery i mniej „płynnych” artefaktów, które były plagą wcześniejszych modeli wideo. To jedna z głównych ulepszeń w porównaniu z Gen-4.

2) Kontrola wierności obrazu i stylu

Runway Gen-4.5 rozszerza tryby sterowania Runway (tekst-wideo, obraz-wideo, wideo-wideo, klatki kluczowe) i poprawia fotorealistyczne renderowanie, stylizację i kompozycję filmową. Runway twierdzi, że Gen-4.5 może generować fotorealistyczne klipy, które trudno odróżnić od prawdziwego materiału filmowego w krótkich sekwencjach, zwłaszcza w połączeniu z dobrym obrazem referencyjnym lub klatkami kluczowymi.

3) Lepsze przestrzeganie zaleceń i świadomość składu.

Model ten charakteryzuje się zwiększoną wiernością, gdy polecenia obejmują wielu aktorów, wskazówki kamery lub ograniczenia ciągłości między scenami; w porównaniu z poprzednimi generacjami model ten stosuje się do poleceń niezawodniej. Większa dokładność w podążaniu za poleceniami opisowymi, co przekłada się na mniejszą liczbę halucynacji lub nieistotnych elementów w całym klipie.

4) Większa szczegółowość obrazu i stabilność czasowa.

Tekstura powierzchni, ciągłość włosów/włókna i spójne oświetlenie w różnych klatkach są zauważalnie ulepszone. Postacie i obiekty rzadziej zmieniają wygląd w trakcie klipu. Runway twierdzi, że te korzyści osiągnięto przy zachowaniu profilu opóźnień Gen-4. Jednym z bardziej zorientowanych na produkcję postępów jest lepsze przetwarzanie mimiki twarzy postaci i sugerowanych emocji w różnych ujęciach. Chociaż Runway Gen-4.5 nie zastępuje doświadczonych aktorów, lepiej zachowuje ciągłość emocjonalną (na przykład mimika postaci jest widoczna podczas ruchu kamery) i może generować wiarygodne wskazówki dotyczące gry, wykorzystując zwięzłe dyrektywne, takie jak „niespokojny uśmiech, odwrócenie wzroku, gwałtowny oddech”.

Jak Runway Gen-4.5 sprawdza się w testach porównawczych i rzeczywistych?

Runway podaje wynik ELO na poziomie 1,247 w rankingu „Artificial Analysis text-to-video leader” (w momencie ogłoszenia) – plasując Gen-4.5 na szczycie tego konkretnego benchmarku w momencie publikacji. Takie benchmarki wykorzystują parami ludzkie lub zautomatyzowane oceny preferencji w oparciu o wyniki wielu modeli;

Wydajność praktyczna (czego mogą oczekiwać użytkownicy)

- Długość klipów i rozdzielczość: Gen-4.5 jest obecnie zoptymalizowany pod kątem krótkich klipów filmowych (pojedyncze ujęcia, zazwyczaj trwające od 4 do 20 sekund w jakości HD/1080p). Runway położył nacisk na zapewnienie wyższej wierności obrazu bez zwiększania opóźnień w porównaniu z Gen-4.

- Czas i koszt renderowania: Runway twierdzi, że koszty/opóźnienia są porównywalne z Gen-4 we wszystkich poziomach subskrypcji; rzeczywiste czasy będą się różnić w zależności od wybranej rozdzielczości, ustawień jakości i obciążenia kolejki.

Czym Runway Gen-4.5 różni się od Gen-4?

Gen-4 ugruntował założenia produkcyjne Runway: spójne postacie, tryby sterowania obrazem do wideo (obraz→wideo, klatki kluczowe, wideo→wideo) oraz nacisk na przepływy pracy użytkownika. Gen-4.5 utrzymuje ten fundament, ale poszerza modelowanie świata (fizyka, ruch) i szybkie przestrzeganie dalej bez utraty przepustowości. W praktyce Gen-4 może nadal doskonale sprawdzać się w szybkich, wymagających stylu zadaniach i przy mniejszym budżecie; Gen-4.5 to ścieżka rozwoju, gdy potrzebujesz bardziej wiarygodnej dynamiki i precyzyjnej kontroli.

Co zmieniło się technicznie (wysoki poziom)

Runway Gen-4.5 jest przedstawiany jako ewolucja, a nie całkowita przebudowa architektury. Materiały Runway wskazują, że model korzysta z lepszej efektywności danych przedtreningowych oraz technik potreningowych (np. ukierunkowanego dostrajania i regularyzacji czasowej). W praktyce przekłada się to na lepsze modelowanie wagi/ruchu, bardziej spójne sceny wieloelementowe oraz lepsze zachowanie detali o wysokiej częstotliwości (włosy, splot materiału) w różnych klatkach.

Praktyczne różnice, które zauważą twórcy

- Lepsze zachowanie fizyczne: obiekty zachowują się zgodnie z postrzeganą masą, a ciecze zachowują się bardziej wiarygodnie.

- Mniej naruszeń tożsamości: postacie i obiekty rzadziej zmieniają wygląd w trakcie klipu.

- Ta sama prędkość, wyższa jakość: Wydajność (opóźnienie) według Runway jest porównywalna z Gen 4, a jakość rośnie. To sprawia, że Gen 4.5 jest atrakcyjny dla zespołów produkcyjnych, które nie mogą sobie pozwolić na duże opóźnienia renderowania.

Kiedy wybrać Gen-4, a kiedy Gen-4.5

- Zastosowanie styczeń-4 gdy potrzebujesz tańszego i szybszego dowodu koncepcji lub gdy istniejące procesy/elementy sterowania są już dostosowane do tego silnika.

- Zastosowanie styczeń-4.5 gdy potrzebny jest większy realizm, złożone interakcje wielu obiektów lub wynik na poziomie produkcyjnym, w którym liczy się fizyka ruchu i precyzja (np. wizualizacje produktów, wstępne wizualizacje efektów wizualnych, krótkometrażowe filmy skupiające się na postaciach).

Zgodność ze sterownikami Gen-4. Wszystkie tryby edytora obsługiwane przez Runway (obraz→wideo, klatki kluczowe, wideo→wideo, odniesienia do aktorów) są wprowadzane do wersji Gen-4.5, dzięki czemu twórcy mogą ponownie wykorzystywać znane elementy sterujące z lepszymi wynikami.

Jak Gen-4.5 wypada w porównaniu do Veo 3.1 i Sora 2?

Jak wypada w porównaniu z Google Veo 3.1?

Veo 3.1 to rodzina programów Google do konwersji tekstu na wideo o wysokiej wierności (aktualizacje Veo 3 → 3.1). Model ten jest chwalony za kinowe tekstury, wyraziste renderowanie stylu oraz precyzyjną kontrolę koloru i oświetlenia. Niezależne porównania wskazują, że Veo 3.1 doskonale radzi sobie z nastrojowymi i stylizowanymi scenami i jest powszechnie dostępny za pośrednictwem API Google, ale może mieć problemy z fizyką wielu obiektów i długodystansową spójnością czasową w porównaniu z najlepszymi, wyspecjalizowanymi konkurentami. Wczesne ślepe testy i recenzje użytkowników sugerują, że Runway Gen-4.5 wyprzedza konkurencję pod względem wiarygodności ruchu i szybkiego reagowania na polecenia oparte na fizyce, podczas gdy Veo często wygrywa w testach pojedynczych scen o charakterze stylizowanym, malarskim lub filmowym.

Gdzie Veo ma tendencję przewodzić: wierność dźwięku i strukturalna narracja (Flow/Veo Studio) oraz ścisła integracja z ekosystemem Google (Gemini API/Vertex AI).

Gdzie Gen-4.5 ma tendencję przewodzić: ślepe testy preferencji użytkownika pod kątem realizmu wizualnego, szybkiego reagowania i złożonego zachowania ruchu (według rankingów Video Arena cytowanych przez Runway). W kilku publicznych ślepych porównaniach Gen-4.5 ma niewielką przewagę w punktacji ELO nad wariantami Veo, choć różnica i znaczenie różnią się w zależności od rodzaju treści.

Jak wypada w porównaniu z Sora 2 od OpenAI?

Sora 2 (OpenAI) Kładzie nacisk na dokładność fizyczną, synchronizację dźwięku (w tym dialogów i efektów dźwiękowych) oraz sterowalność. Sora 2 często dobrze radzi sobie z tworzeniem spójnych scen animowanych z zaawansowanymi wskazówkami narracyjnymi oraz w procesach, w których dźwięk i dialogi stanowią ważne elementy procesu generacji.

Gdzie Sora 2 ma tendencję prowadzić:zintegrowane generowanie dźwięku i multimodalna synchronizacja w określonych ustawieniach; ma tendencję do produkowania klipów o bardzo nastrojowym charakterze i zorientowanych na narrację.

Gdzie Gen-4.5 ma tendencję przewodzić: według niezależnych, ślepych porównań, na które powołuje się Runway, postrzegany realizm wizualny, wierność odwzorowania i spójność ruchu. Ponownie, praktyczny wybór zależy od Twoich wartości: jeśli kluczowe są natywne generowanie dźwięku + zintegrowane narzędzia, Sora 2 lub Veo mogą być lepszym wyborem; jeśli priorytetem jest czysta wierność wizualna w przypadku złożonych scen, przewaga Gen-4.5 w ślepych testach jest znacząca.

Praktyczna tabela porównawcza (podsumowanie)

| Obszar | Pas startowy Gen-4.5 | Pas startowy Gen-4 (wcześniej) | Google Veo 3.1 | OpenAI Sora 2 |

|---|---|---|---|---|

| Wydanie / Pozycjonowanie | Grudzień 2025 r. — „Gen-4.5”: wzrost jakości i wierności; najwyższy wynik w benchmarku (1,247 ELO) | Wcześniejsza generacja 4: ważny krok w kierunku spójności i kontroli | Veo 3.1: generator wideo Google'a; natywny dźwięk i opcje szybkiej/szybkiej jakości | Sora 2: flagowy model wideo i dźwięku OpenAI, kładący nacisk na dokładność fizyczną i zsynchronizowany dźwięk |

| Główne mocne strony | Jakość ruchu, szybka wierność, kinowe efekty wizualne, integracja z API | Ciągłość postaci, spójność wielu strzałów, sterowalność | Szybkie wyjścia 8s, natywne generowanie dźwięku/dialogów, zoptymalizowane pod kątem szybkości/UX | Fizyka i realizm, zsynchronizowany dźwięk/dialog, sterowalność |

| Długość/formaty wyjściowe | Krótkie klipy filmowe; obsługuje obrazy→wideo, tekst→wideo, klatki kluczowe, itp. | Krótkie klipy; podobne tryby sterowania | 8-sekundowe filmy wysokiej jakości, opcja Veo 3.1 Fast | Wyjścia 720p/1080p z dźwiękiem, nacisk na wierność |

| Dźwięk natywny | Nie jest to główny nagłówek (skupienie się na wierności wizualnej), ale Runway obsługuje przepływy pracy z dźwiękiem za pomocą narzędzi | Ograniczone generowanie rodzimego dźwięku | Natywne generowanie dźwięku (efekty dźwiękowe, dialogi). Nacisk na jakość dźwięku. | Synchronizacja dźwięku i efektów dźwiękowych to charakterystyczne cechy tego produktu. |

| Typowe ograniczenia | Artefakty drobnych szczegółów (twarze/tłumy), sporadyczne błędy przyczynowo-skutkowe/czasowe | Wcześniejsze artefakty, większa niespójność ruchów niż 4.5 | Krótki czas trwania to kompromis w kwestii projektu: jakość kontra długość | Wąskie tryby awarii w złożonych scenach; wciąż ewoluujące |

- Realizm wizualny i ruch: Gen-4.5 > Veo 3.1 ≈ Sora 2 (różni się w zależności od sceny).

- Dźwięk i dźwięk natywny: Veo 3.1 ≥ Sora 2 > Runway (Runway ma narzędzia do edycji dźwięku w przepływie pracy, ale Veo i Sora włączają głębszą generację natywnego dźwięku w procesie produkcyjnym).

- Sterowanie i edycja:Runway (klatki kluczowe, obraz→wideo, ciągłość odniesienia) i Veo (Flow Studio) oferują solidną kontrolę; Sora koncentruje się na zsynchronizowanych kontrolach multimodalnych.

- Krótko mówiąc: Sora 2 jest mocna pod względem ciągłości narracji; Veo 3.1 jest mocne, jeśli chodzi o kinową fakturę; Gen-4.5 jest mocny, jeśli chodzi o realizm ruchu i sterowalność.

Jakie konkretne ograniczenia i ryzyka wiążą się z Gen-4.5?

Żaden model nie jest idealny, a Gen-4.5 ma znane ograniczenia i realne zagrożenia, które należy wziąć pod uwagę przed wdrożeniem.

Ograniczenia techniczne

- Fizyka przypadków brzegowych i błędy przyczynowe: Choć model został znacznie udoskonalony, nadal sporadycznie występują błędy w kolejności przyczynowej (na przykład skutek poprzedzający przyczynę) oraz subtelne błędy trwałości obiektów, gdy sceny stają się bardzo złożone. Są one rzadsze, ale nadal występują.

- Spójność formy długiej: Podobnie jak większość obecnych modeli konwersji tekstu na wideo, Gen-4.5 jest zoptymalizowany pod kątem krótkich klipów (kilkusekundowych). Generowanie dłuższych scen lub pełnych sekwencji nadal wymaga łączenia, interwencji redakcyjnych lub hybrydowych przepływów pracy.

- Tożsamość i spójność na dużą skalę: Produkcja setek ujęć z dokładnie tą samą postacią zachowującą się konsekwentnie wymaga dużego nakładu pracy. Gen-4.5 ułatwia to zadanie, ale nie eliminuje konieczności korzystania z referencyjnych systemów projektowych ani scentralizowanych procesów zarządzania zasobami.

Bezpieczeństwo, niewłaściwe użycie i ryzyko etyczne

- Ryzyko deepfake’u/podszywania się: Każdy generator wideo o wyższej wierności zwiększa ryzyko uzyskania realistycznych, ale wprowadzających w błąd materiałów. Organizacje powinny wdrożyć zabezpieczenia (znaki wodne, zasady dotyczące treści, procedury weryfikacji tożsamości) i monitorować ryzyko nadużyć.

- Prawa autorskie i pochodzenie zbioru danych: Pochodzenie danych szkoleniowych pozostaje kwestią budzącą szersze obawy w branży. Twórcy i właściciele praw powinni mieć świadomość, że wyniki mogą odzwierciedlać wzorce wyuczone z materiałów chronionych prawem autorskim, co rodzi wątpliwości prawne i etyczne dotyczące ponownego wykorzystania w kontekście komercyjnym.

- Uprzedzenia i szkody reprezentacyjne: Modele generatywne mogą odtwarzać błędy obecne w danych szkoleniowych (np. nadreprezentację/niedoreprezentację, stereotypowe przedstawienia). Nadal konieczne jest rygorystyczne testowanie i strategie łagodzenia tych błędów w procesie.

Wnioski — Gdzie Gen-4.5 wpisuje się w ewoluujący krajobraz wideo opartego na sztucznej inteligencji

Runway Gen-4.5 to znaczący krok naprzód w zakresie realizmu i sterowalności przetwarzania tekstu na wideo. Obecnie zajmuje wysokie pozycje w niezależnych rankingach preferencji użytkowników niewidomych, a komunikaty produktowe Runway i wczesne raportowanie pozycjonują go jako praktyczne ulepszenie dla twórców, którzy potrzebują bardziej przekonującego ruchu, lepszej wierności i spójności czasowej bez utraty szybkości generowania. Jednocześnie konkurencyjne systemy Google (Veo 3.1) i OpenAI (Sora 2) nadal rozwijają uzupełniające się mocne strony, takie jak zintegrowane audio, narzędzia do tworzenia historii/narracji w formie produktów oraz głębsza integracja z ekosystemem. Wybór odpowiedniej platformy nadal zależy od projektu: czy priorytetem jest realizm wizualny, natywny dźwięk, integracja platformy czy kontrola zarządzania.

Wersja Gen-4.5 będzie wdrażana w ramach planów o cenach porównywalnych do wersji Gen-4.

Deweloperzy mogą uzyskać dostęp Wersja 3.1 , Sora 2 oraz Pas startowy/gen4_aleph itp. poprzez CometAPI, najnowsza wersja modelu jest zawsze aktualizowany na oficjalnej stronie internetowej. Na początek zapoznaj się z możliwościami modelu w Plac zabaw i zapoznaj się z Przewodnik po API aby uzyskać szczegółowe instrukcje. Przed uzyskaniem dostępu upewnij się, że zalogowałeś się do CometAPI i uzyskałeś klucz API. Interfejs API Comet zaoferuj cenę znacznie niższą niż oficjalna, aby ułatwić Ci integrację.

Gotowy do drogi?→ Bezpłatna wersja próbna gen. 4.5 !

Jeśli chcesz poznać więcej wskazówek, poradników i nowości na temat sztucznej inteligencji, obserwuj nas na VK, X oraz Discord!