GPT-5.2 to wydanie punktowe OpenAI z grudnia 2025 roku w rodzinie GPT-5: flagowa rodzina modeli multimodalnych (tekst + wizja + narzędzia) dostrojona do profesjonalnej pracy z wiedzą, rozumowania w długim kontekście, agentowego użycia narzędzi oraz inżynierii oprogramowania. OpenAI pozycjonuje GPT-5.2 jako najpotężniejszy dotąd model z serii GPT-5 i podaje, że został opracowany z naciskiem na niezawodne wieloetapowe rozumowanie, obsługę bardzo dużych dokumentów oraz poprawę bezpieczeństwa/zgodności z zasadami; wydanie obejmuje trzy wersje skierowane do użytkowników — Instant, Thinking i Pro — i jest wdrażane najpierw dla płatnych subskrybentów ChatGPT oraz klientów API.

Czym jest GPT-5.2 i dlaczego ma znaczenie?

GPT-5.2 to najnowszy członek rodziny GPT-5 — nowej serii modeli „frontier” zaprojektowanej specjalnie po to, by zmniejszyć lukę między asystentami konwersacyjnymi działającymi w pojedynczych turach a systemami, które muszą niezawodnie rozumować na podstawie długich dokumentów, wywoływać narzędzia, interpretować obrazy i wykonywać wieloetapowe przepływy pracy. OpenAI pozycjonuje 5.2 jako swoje najsprawniejsze wydanie w zakresie profesjonalnej pracy z wiedzą: ustanawia nowe rekordy w wewnętrznych benchmarkach (w tym nowym benchmarku GDPval dla pracy z wiedzą), wykazuje silniejszą wydajność kodowania w benchmarkach inżynierii oprogramowania i oferuje znacząco ulepszone możliwości długiego kontekstu i wizji.

W praktyce GPT-5.2 to coś więcej niż „większy model czatu”. To rodzina trzech dostrojonych wariantów (Instant, Thinking, Pro), które równoważą opóźnienie, głębokość rozumowania i koszt — i które, wraz z API OpenAI i routowaniem w ChatGPT, mogą posłużyć do uruchamiania długich zadań badawczych, budowy agentów wywołujących narzędzia zewnętrzne, interpretowania złożonych obrazów i wykresów oraz generowania kodu produkcyjnej jakości z większą wiernością niż wcześniejsze wydania. Model obsługuje bardzo duże okna kontekstu (dokumentacja OpenAI wymienia okno 400 000 tokenów i limit maksymalnej odpowiedzi 128 000 tokenów dla flagowych modeli), nowe funkcje API dla jawnych poziomów nakładu rozumowania oraz „agentowe” zachowanie przy wywoływaniu narzędzi.

5 kluczowych obszarów usprawnionych w GPT-5.2

1) Czy GPT-5.2 lepiej radzi sobie z logiką wieloetapową i matematyką?

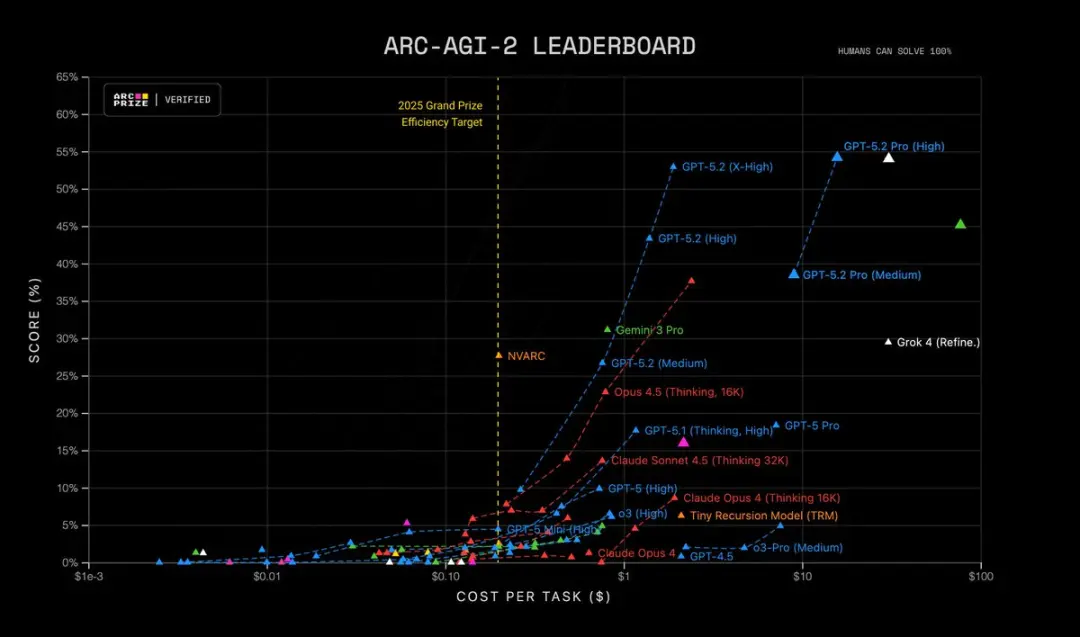

GPT-5.2 oferuje ostrzejsze wieloetapowe rozumowanie i zauważalnie lepsze wyniki w matematyce i uporządkowanym rozwiązywaniu problemów. OpenAI podaje, że dodano bardziej granularną kontrolę nad nakładem rozumowania (nowe poziomy, takie jak xhigh), zaimplementowano wsparcie „tokenów rozumowania” i dostrojono model tak, by utrzymywał łańcuch rozumowania przez dłuższe wewnętrzne ścieżki. Benchmarki takie jak FrontierMath i testy w stylu ARC-AGI pokazują znaczące zyski względem GPT-5.1; większe marginesy widać na dziedzinowych benchmarkach używanych w przepływach naukowych i finansowych. Krótko mówiąc: GPT-5.2 „myśli dłużej” na żądanie i potrafi wykonywać bardziej złożoną pracę symboliczną/matematyczną z lepszą spójnością.

| RC-AGI-1 (zweryfikowane) Rozumowanie abstrakcyjne | 86.2% | 72.8% |

|---|---|---|

| ARC-AGI-2 (zweryfikowane) Rozumowanie abstrakcyjne | 52.9% | 17.6% |

GPT-5.2 Thinking ustanawia rekordy w wielu zaawansowanych testach rozumowania naukowego i matematycznego:

- GPQA Diamond Science Quiz: 92.4% (wersja Pro 93.2%)

- ARC-AGI-1 Rozumowanie abstrakcyjne: 86.2% (pierwszy model, który przekroczył próg 90%)

- ARC-AGI-2 Rozumowanie wyższego rzędu: 52.9%, ustanawiając nowy rekord dla modelu Thinking Chain

- FrontierMath Advanced Mathematics Test: 40.3%, znacznie przewyższając poprzednika;

- HMMT Math Competition Problems: 99.4%

- AIME Math Test: 100% kompletnego rozwiązania

Co więcej, GPT-5.2 Pro (High) to stan sztuki na ARC-AGI-2, osiągając wynik 54.2% przy koszcie 15,72 USD za zadanie! Przewyższając wszystkie inne modele.

Dlaczego to ważne: wiele zadań w świecie rzeczywistym — modelowanie finansowe, projektowanie eksperymentów, synteza programów wymagająca formalnego rozumowania — jest ograniczonych zdolnością modelu do połączenia wielu poprawnych kroków. GPT-5.2 ogranicza „zhalucynowane kroki” i generuje bardziej stabilne pośrednie ścieżki rozumowania, gdy poprosisz o pokazanie toku myślenia.

2) Jak poprawiło się rozumienie długich tekstów i wnioskowanie między dokumentami?

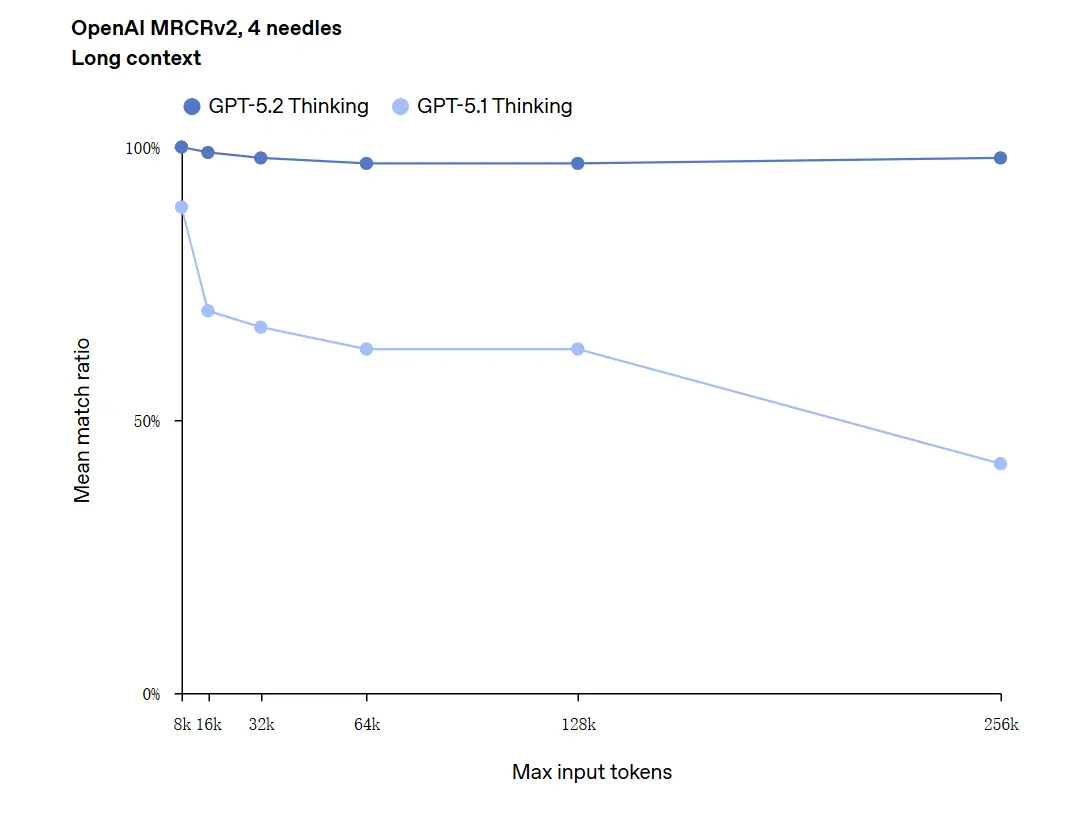

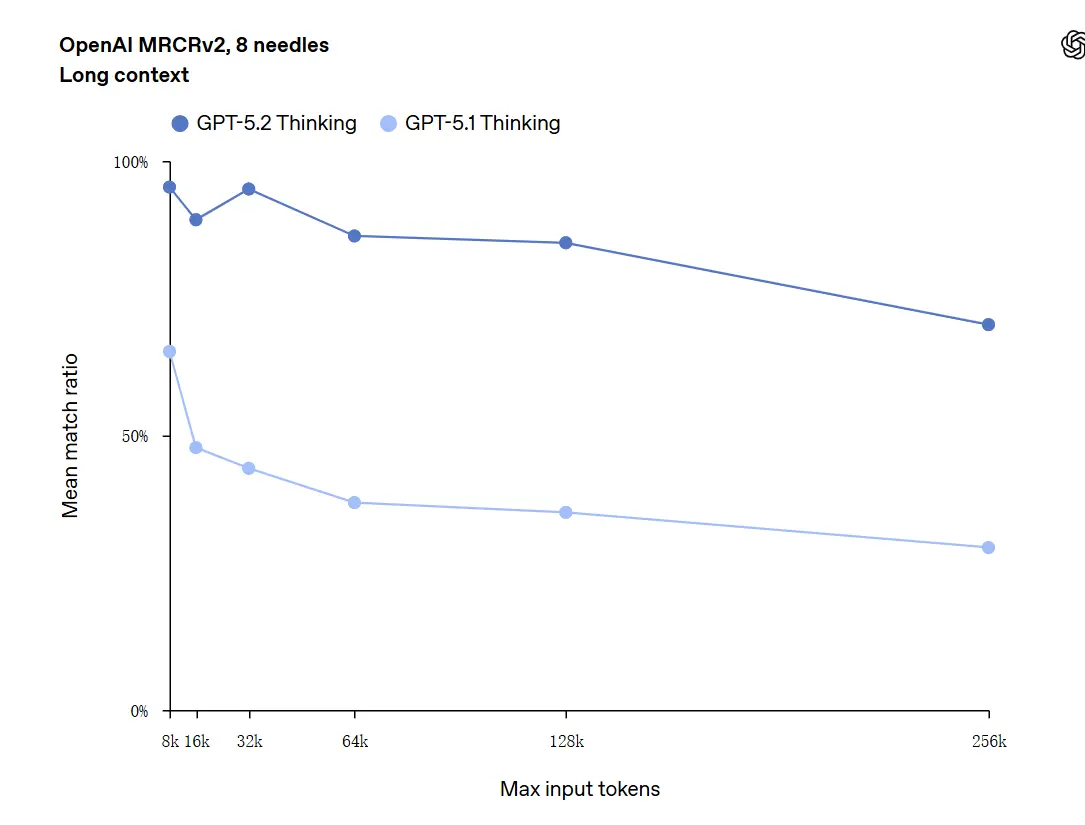

Zrozumienie w długim kontekście to jedno z flagowych ulepszeń. Bazowy model GPT-5.2 obsługuje okno kontekstu 400 tys. tokenów i — co istotne — utrzymuje wyższą dokładność, gdy istotne treści przesuwają się głęboko w tym kontekście. GDPval, zestaw zadań dla „dobrze określonej pracy z wiedzą” w 44 zawodach, w którym GPT-5.2 Thinking osiąga parytet lub lepsze wyniki niż eksperci-ludzcy sędziowie w dużej części zadań. Niezależne relacje potwierdzają, że model znacznie lepiej niż wcześniej utrzymuje i syntetyzuje informacje z wielu dokumentów. To realny, praktyczny krok naprzód w zadaniach takich jak due diligence, podsumowania prawne, przeglądy literatury i rozumienie baz kodu.

GPT-5.2 potrafi obsłużyć konteksty do 256 000 tokenów (około 200+ stron dokumentów). Ponadto w teście rozumienia długich tekstów „OpenAI MRCRv2” GPT-5.2 Thinking osiągnął dokładność bliską 100%.

Zastrzeżenie dotyczące „100% dokładności”: opisano ulepszenia jako „zbliżające się do 100%” dla wąskich mikrozadań; dane OpenAI lepiej opisywać jako „stan sztuki i w wielu przypadkach na poziomie lub powyżej poziomu ekspertów-ludzi w ocenianych zadaniach”, nie dosłownie bezbłędne we wszystkich zastosowaniach. Benchmarki pokazują duże zyski, ale nie powszechną perfekcję.

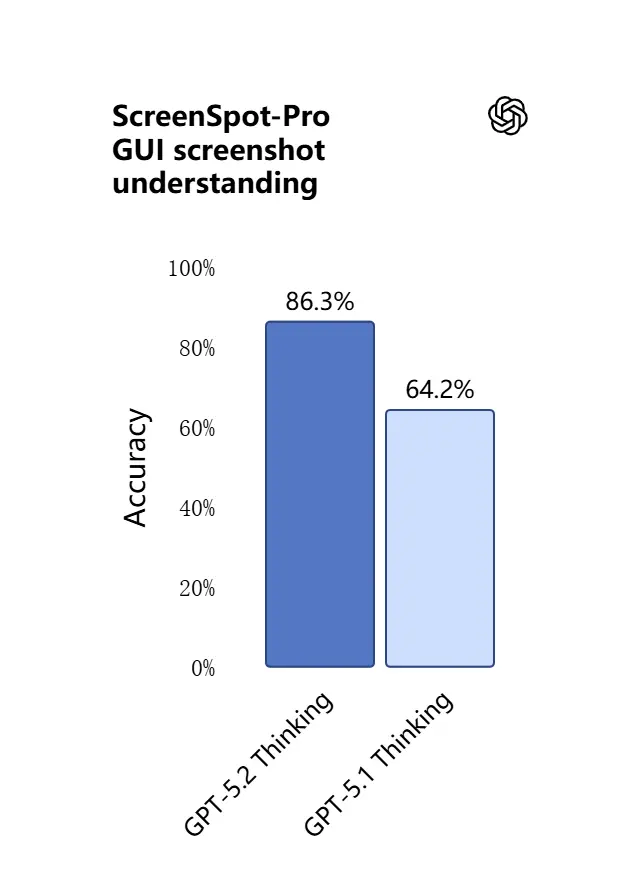

3) Co nowego w rozumieniu wizualnym i wnioskowaniu multimodalnym?

Możliwości wizyjne GPT-5.2 są ostrzejsze i bardziej praktyczne. Model lepiej interpretuje zrzuty ekranu, czyta wykresy i tabele, rozpoznaje elementy interfejsu i łączy dane wizualne z długim kontekstem tekstowym. To nie tylko opisywanie: GPT-5.2 potrafi wyodrębniać ustrukturyzowane dane z obrazów (np. tabele z PDF), wyjaśniać wykresy i rozumować o diagramach w sposób wspierający dalsze kroki z narzędziami (np. generowanie arkusza kalkulacyjnego na podstawie sfotografowanego raportu).

.webp)

Praktyczny efekt: zespoły mogą przekazywać modelowi całe prezentacje, skanowane raporty badawcze lub dokumenty bogate w obrazy i prosić o syntezy między dokumentami — co znacząco ogranicza ręczną ekstrakcję.

4) Jak zmieniło się wywoływanie narzędzi i wykonywanie zadań?

GPT-5.2 idzie dalej w kierunku zachowań agentowych: lepiej planuje wieloetapowe zadania, decyduje, kiedy wywołać narzędzia zewnętrzne, i wykonuje sekwencje wywołań API/narzędzi, by doprowadzić zadanie do końca. Usprawnienia w „agentowym wywoływaniu narzędzi” — model zaproponuje plan, wywoła narzędzia (bazy danych, obliczenia, systemy plików, przeglądarkę, uruchamiacze kodu) i zsyntetyzuje wyniki w finalny produkt bardziej niezawodnie niż wcześniejsze modele. API wprowadza routowanie i mechanizmy bezpieczeństwa (listy dozwolonych narzędzi, szkielet wywołań), a interfejs ChatGPT może automatycznie kierować żądania do odpowiedniego wariantu 5.2 (Instant vs Thinking).

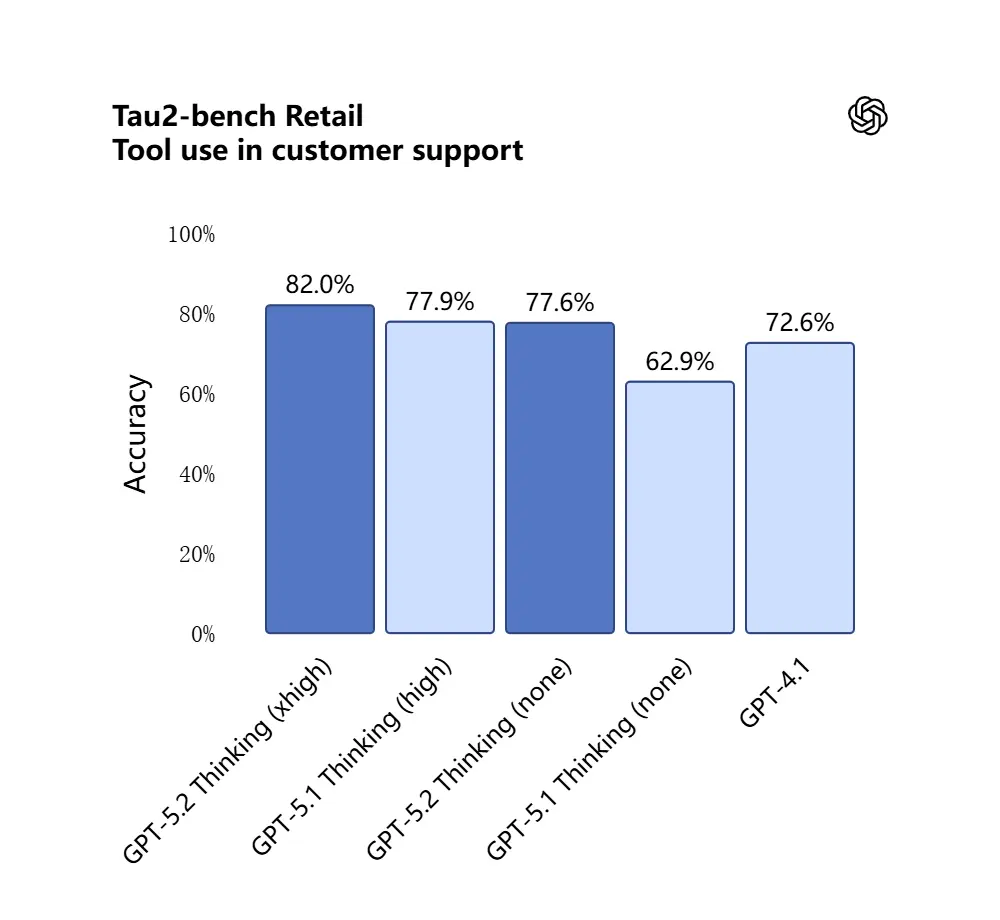

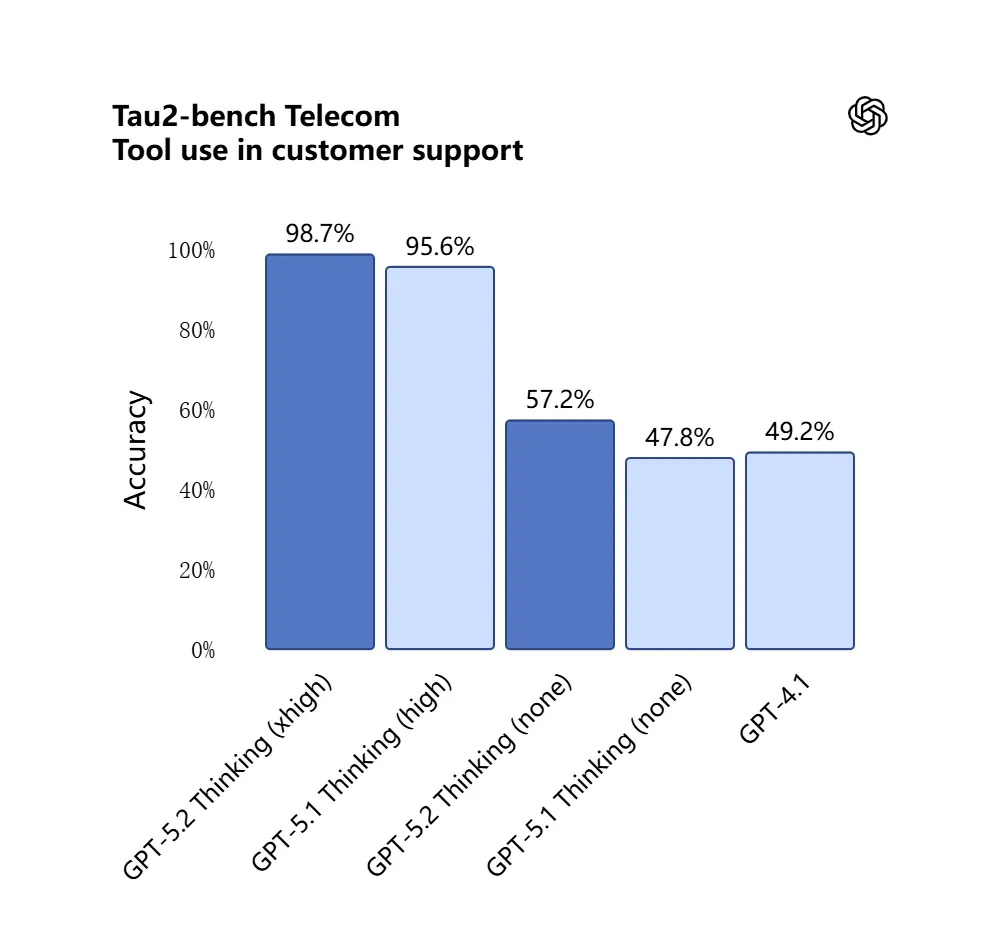

GPT-5.2 uzyskał 98.7% w benchmarku Tau2-Bench Telecom, demonstrując dojrzałe możliwości wywoływania narzędzi w złożonych zadaniach wieloturnowych.

Dlaczego to ważne: czyni to GPT-5.2 bardziej użytecznym jako autonomicznego asystenta w przepływach pracy typu „załaduj te umowy, wyodrębnij klauzule, zaktualizuj arkusz i napisz podsumowujący e-mail” — zadaniach, które wcześniej wymagały starannej orkiestracji.

5) Rozwinięte zdolności programistyczne

GPT-5.2 jest wyraźnie lepszy w zadaniach inżynierii oprogramowania: pisze bardziej kompletne moduły, wiarygodniej generuje i uruchamia testy, rozumie złożone grafy zależności projektów i rzadziej popada w „leniwe kodowanie” (pomijanie boilerplate lub niewiązanie modułów). Na branżowych benchmarkach kodowania (SWE-bench Pro itd.) GPT-5.2 ustanawia nowe rekordy. Dla zespołów używających LLM-ów jako paroprogramistów poprawa ta może ograniczyć ręczną weryfikację i prace korygujące po generowaniu.

W teście SWE-Bench Pro (realne, przemysłowe zadania inżynierii oprogramowania) wynik GPT-5.2 Thinking wzrósł do 55.6%, a w teście SWE-Bench Verified osiągnął nowy rekord 80%.

_Software%20engineering.webp)

W zastosowaniach praktycznych oznacza to:

- Automatyczne debugowanie kodu środowiska produkcyjnego przekłada się na większą stabilność;

- Wsparcie programowania wielojęzycznego (nie tylko Python);

- Zdolność do samodzielnego wykonywania zadań naprawczych end-to-end.

Czym GPT-5.2 różni się od GPT-5.1?

Krótka odpowiedź: GPT-5.2 to iteracyjne, ale istotne ulepszenie. Zachowuje architekturę rodziny GPT-5 i podstawy multimodalne, ale rozwija cztery praktyczne wymiary:

- Głębokość i spójność rozumowania. 5.2 wprowadza wyższe poziomy nakładu rozumowania i lepsze łańcuchowanie dla problemów wieloetapowych; 5.1 wcześniej poprawił rozumowanie, ale 5.2 podnosi sufit dla złożonej matematyki i logiki wieloetapowej.

- Niezawodność w długim kontekście. Obie wersje rozszerzyły kontekst, ale 5.2 jest dostrojony tak, by utrzymywać dokładność głęboko w bardzo długich wejściach (OpenAI deklaruje poprawioną retencję aż do setek tysięcy tokenów).

- Wierność wizji + multimodalności. 5.2 poprawia krzyżowe odwołania między obrazami a tekstem — np. odczytywanie wykresu i integrowanie tych danych w arkusz — pokazując wyższą dokładność na poziomie zadań.

- Agentowe zachowania przy narzędziach i funkcje API. 5.2 udostępnia nowe parametry nakładu rozumowania (

xhigh) i funkcje kompakcji kontekstu w API, a OpenAI dopracował logikę routowania w ChatGPT tak, aby interfejs mógł automatycznie wybrać najlepszy wariant. - Mniej błędów, większa stabilność: GPT-5.2 redukuje swój „illusion rate” (odsetek fałszywych odpowiedzi) o 38%. Odpowiada na pytania badawcze, pisarskie i analityczne bardziej niezawodnie, ograniczając przypadki „zmyślonych faktów”. W złożonych zadaniach jego strukturalne wyjścia są klarowniejsze, a logika bardziej stabilna. Jednocześnie bezpieczeństwo odpowiedzi modelu zostało znacząco poprawione w zadaniach związanych ze zdrowiem psychicznym. Działa bardziej robustowo w wrażliwych scenariuszach, takich jak zdrowie psychiczne, autoagresja, samobójstwo i zależność emocjonalna.

W ewaluacjach systemowych GPT-5.2 Instant uzyskał 0.995 (w skali do 1.0) w zadaniu „Wsparcie zdrowia psychicznego”, znacząco więcej niż GPT-5.1 (0.883).

Ilościowo, opublikowane przez OpenAI benchmarki pokazują mierzalne zyski w GDPval, benchmarkach matematycznych (FrontierMath) i ewaluacjach inżynierii oprogramowania. GPT-5.2 przewyższa GPT-5.1 w zadaniach typu junior investment-banking na arkuszach kalkulacyjnych o kilka punktów procentowych.

Czy GPT-5.2 jest darmowy — ile kosztuje?

Czy mogę korzystać z GPT-5.2 za darmo?

OpenAI wdrożył GPT-5.2, zaczynając od płatnych planów ChatGPT i dostępu przez API. Historycznie OpenAI utrzymywał najszybsze/najgłębsze modele za płatnymi progami, udostępniając później lżejsze warianty szerzej; w przypadku 5.2 firma zapowiedziała, że wdrożenie rozpocznie się na planach płatnych (Plus, Pro, Business, Enterprise) i że API jest dostępne dla deweloperów. To oznacza, że natychmiastowy darmowy dostęp jest ograniczony: darmowa warstwa może później otrzymać zdegradowany lub kierowany dostęp (np. do lżejszych subwariantów) w miarę skalowania wdrożenia przez OpenAI.

Dobra wiadomość jest taka, że CometAPI integruje się teraz z GPT-5.2, a obecnie trwa wyprzedaż świąteczna. Możesz korzystać z GPT-5.2 przez CometAPI; playground pozwala swobodnie wchodzić w interakcję z GPT-5.2, a deweloperzy mogą używać API GPT-5.2 (CometAPI wyceniony jest na 20% ceny OpenAI), aby budować przepływy pracy.

Ile kosztuje przez API (zastosowania deweloperskie/produkcyjne)?

Korzystanie z API jest rozliczane per token. Opublikowane przez OpenAI ceny platformy w momencie premiery pokazują (CometAPI jest wyceniony na 20% ceny OpenAI) :

- GPT-5.2 (standard chat) — 1,75 USD za 1M tokenów wejściowych i 14 USD za 1M tokenów wyjściowych (obowiązują zniżki na zbuforowane wejścia).

- GPT-5.2 Pro (flagship) — 21 USD za 1M tokenów wejściowych i 168 USD za 1M tokenów wyjściowych (znacząco droższy, ponieważ jest przeznaczony do obciążeń wymagających wysokiej dokładności i dużych zasobów obliczeniowych).

- Dla porównania, GPT-5.1 był tańszy (np. 1,25 USD za wejście / 10 USD za wyjście na 1M tokenów).

Interpretacja: Koszty API wzrosły względem poprzednich generacji; ceny sygnalizują, że premium rozumowania i wydajność w długim kontekście 5.2 są wycenione jako osobny poziom produktu. Dla systemów produkcyjnych koszty planu zależą silnie od liczby tokenów wejściowych/wyjściowych i od tego, jak często ponownie używasz zbuforowanych wejść (zbuforowane wejścia otrzymują duże zniżki).

Co to oznacza w praktyce

- Dla luźnego użytku przez interfejs ChatGPT główną ścieżką są miesięczne subskrypcje (Plus, Pro, Business, Enterprise). Ceny planów subskrypcyjnych ChatGPT nie zmieniły się wraz z wydaniem 5.2 (OpenAI utrzymuje stabilne ceny planów, nawet jeśli oferty modeli się zmieniają).

- Dla produkcji i deweloperów zaplanuj budżet na koszty tokenów. Jeśli Twoja aplikacja strumieniuje dużo długich odpowiedzi lub przetwarza długie dokumenty, koszty tokenów wyjściowych (14 USD / 1M tokenów dla Thinking) będą dominować, chyba że uważnie buforujesz wejścia i ponownie używasz wyjść.

GPT-5.2 Instant vs GPT-5.2 Thinking vs GPT-5.2 Pro

OpenAI uruchomił GPT-5.2 z trzema wariantami dopasowanymi do zastosowań: Instant, Thinking i Pro:

- GPT-5.2 Instant: Szybki, opłacalny, dostrojony do codziennej pracy — FAQ, instrukcje, tłumaczenia, szybkie szkice. Niższe opóźnienie; dobre pierwsze wersje i proste przepływy.

- GPT-5.2 Thinking: Głębsze, wyższej jakości odpowiedzi do pracy ciągłej — podsumowania długich dokumentów, planowanie wieloetapowe, szczegółowe code review. Zrównoważone opóźnienie i jakość; domyślny „koń pociągowy” do zadań profesjonalnych.

- GPT-5.2 Pro: Najwyższa jakość i wiarygodność. Wolniejszy i droższy; najlepszy do trudnych, wysokiej stawki zadań (złożona inżynieria, synteza prawna, decyzje wysokiej wartości) oraz tam, gdzie wymagany jest poziom nakładu rozumowania „xhigh”.

Tabela porównawcza

| Cecha / Metryka | GPT-5.2 Instant | GPT-5.2 Thinking | GPT-5.2 Pro |

|---|---|---|---|

| Zamierzone zastosowanie | Codzienne zadania, szybkie szkice | Głęboka analiza, długie dokumenty | Najwyższa jakość, złożone problemy |

| Opóźnienie | Najniższe | Umiarkowane | Najwyższe |

| Nakład rozumowania | Standardowy | Wysoki | xHigh dostępny |

| Najlepsze do | FAQ, tutoriale, tłumaczenia, krótkie prompty | Podsumowania, planowanie, arkusze, zadania program. | Złożona inżynieria, synteza prawna, badania |

| Przykładowe nazwy API | gpt-5.2-chat-latest | gpt-5.2 | gpt-5.2-pro |

| Cena tokena wejściowego (API) | 1,75 USD / 1M | 1,75 USD / 1M | 21 USD / 1M |

| Cena tokena wyjściowego (API) | 14 USD / 1M | 14 USD / 1M | 168 USD / 1M |

| Dostępność (ChatGPT) | Wdrażany; najpierw plany płatne, potem szerzej | Wdrażany do planów płatnych | Użytkownicy Pro / Enterprise (płatne) |

| Przykładowe zastosowanie | Redagowanie e-maila, drobne fragmenty kodu | Budowa wieloarkuszowego modelu finansowego, Q&A raportu | Audyt bazy kodu, generowanie projektu systemu klasy produkcyjnej |

Dla kogo jest GPT-5.2?

GPT-5.2 został zaprojektowany z myślą o szerokim zestawie użytkowników. Poniżej rekomendacje według ról:

Przedsiębiorstwa i zespoły produktowe

Jeśli tworzysz produkty do pracy z wiedzą (asystenci badawczy, przegląd umów, potoki analityczne lub narzędzia deweloperskie), możliwości długiego kontekstu i zachowania agentowe GPT-5.2 mogą znacząco zmniejszyć złożoność integracji. Przedsiębiorstwa potrzebujące solidnego rozumienia dokumentów, automatycznego raportowania lub inteligentnych copilotów docenią Thinking/Pro. Microsoft i inni partnerzy platformowi już integrują 5.2 w stosy produktywności (np. Microsoft 365 Copilot).

Deweloperzy i zespoły inżynierskie

Zespoły chcące używać LLM-ów jako paroprogramistów lub automatyzować generowanie/testowanie kodu skorzystają na poprawionej wierności programistycznej w 5.2. Dostęp przez API (z trybami thinking lub pro) umożliwia głębsze syntezy dużych baz kodu dzięki oknu kontekstu 400 tys. tokenów. Spodziewaj się wyższych kosztów API przy użyciu Pro, ale redukcja ręcznego debugowania i przeglądów może je uzasadnić w złożonych systemach.

Badacze i analitycy pracujący z danymi

Jeśli regularnie syntetyzujesz literaturę, analizujesz długie raporty techniczne lub chcesz projektować eksperymenty z pomocą modelu, ulepszenia w długim kontekście i matematyce GPT-5.2 przyspieszą pracę. Dla badań replikowalnych połącz model z ostrożnym prompt engineeringiem i krokami weryfikacji.

Małe firmy i zaawansowani użytkownicy

ChatGPT Plus (i Pro dla power userów) otrzyma trasowany dostęp do wariantów 5.2; to sprawia, że zaawansowana automatyzacja i wysokiej jakości wyniki są w zasięgu mniejszych zespołów bez integracji API. Dla nietechnicznych użytkowników, którzy potrzebują lepszego podsumowywania dokumentów lub tworzenia slajdów, GPT-5.2 przynosi zauważalną praktyczną wartość.

Praktyczne uwagi dla deweloperów i operatorów

Funkcje API warte uwagi

- Poziomy

reasoning.effort(np.medium,high,xhigh) pozwalają zadeklarować, ile mocy obliczeniowej model ma przeznaczyć na wewnętrzne rozumowanie; użyj ich, by per-zlecenie zamieniać opóźnienie na dokładność. - Kompakcja kontekstu: API zawiera narzędzia do kompresji i kompaktowania historii tak, aby faktycznie istotne treści były zachowane przy długich łańcuchach. To krytyczne, gdy trzeba utrzymać efektywne zużycie tokenów na rozsądnym poziomie.

- Szkielet narzędzi i listy dozwolonych narzędzi: systemy produkcyjne powinny jawnie whitelistić, co model może wywołać, i logować wywołania do audytu.

Wskazówki dotyczące kontroli kosztów

- Buforuj często używane osadzenia dokumentów i używaj zbuforowanych wejść (które otrzymują duże zniżki) do powtarzanych zapytań względem tego samego korpusu. Cennik platformy OpenAI obejmuje znaczące rabaty dla zbuforowanych wejść.

- Kieruj eksploracyjne/niskowartościowe zapytania do Instant, a Thinking/Pro zostaw na zadania wsadowe lub finalne przebiegi.

- Starannie oszacuj użycie tokenów (wejście + wyjście) przy projekcji kosztów API, ponieważ długie wyjścia multiplikują koszt.

Konkluzja — czy warto przejść na GPT-5.2?

Jeśli Twoja praca zależy od rozumowania na długich dokumentach, syntezy między dokumentami, interpretacji multimodalnej (obrazy + tekst) lub budowy agentów wywołujących narzędzia, GPT-5.2 to wyraźny upgrade: podnosi praktyczną dokładność i redukuje pracę integracyjną. Jeśli głównie prowadzisz chatboty o dużej przepustowości i niskim opóźnieniu lub masz ścisłe ograniczenia budżetowe, Instant (lub wcześniejsze modele) mogą nadal być rozsądnym wyborem.

GPT-5.2 reprezentuje świadome przesunięcie z „lepszego czatu” na „lepszego profesjonalnego asystenta”: więcej obliczeń, większe możliwości i wyższe progi cenowe — ale także realne zyski produktywności dla zespołów, które wykorzystają niezawodny długi kontekst, ulepszoną matematykę/rozumowanie, rozumienie obrazów i agentowe wykonywanie zadań.

Aby zacząć, poznaj możliwości modeli GPT-5.2(GPT-5.2;GPT-5.2 pro, GPT-5.2 chat ) w Playground i zapoznaj się ze szczegółową instrukcją w API guide. Przed dostępem upewnij się, że zalogowałeś(-aś) się do CometAPI i uzyskałeś(-aś) klucz API. CometAPI oferuje cenę znacznie niższą niż oficjalna, aby ułatwić integrację.

Gotowy do startu?→ Darmowa wersja próbna modeli gpt-5.2 !