Kimi K2 Thinking to nowa, „myśląca” odmiana rodziny Kimi K2 firmy Moonshot AI: model „mieszanki ekspertów” (MoE) o bilionach parametrów i niewielkiej liczbie elementów, który został zaprojektowany specjalnie w celu myśleć działając — tj. przeplatanie głębokiego rozumowania opartego na łańcuchu myślowym z niezawodnymi wywołaniami narzędzi, długoterminowym planowaniem i automatycznymi autotestami. Łączy w sobie rozbudowany, rzadki szkielet (≈1 biliard parametrów, ~32 miliardy aktywowanych na token), natywny potok kwantyzacji INT4 oraz skalowalną konstrukcję. czas wnioskowania rozumowanie (więcej „tokenów myślowych” i więcej rund wywoływania narzędzi), a nie tylko zwiększanie liczby statycznych parametrów.

Mówiąc wprost: K2 Thinking traktuje model jako rozwiązanie problemu agent zamiast jednorazowego generatora języka. To przejście – od „modelu języka” do „modelu myślenia” – sprawia, że ta wersja jest godna uwagi i dlatego wielu praktyków postrzega ją jako kamień milowy w rozwoju agentowej sztucznej inteligencji opartej na otwartym kodzie źródłowym.

Czym właściwie jest „Myślenie Kimi K2”?

Architektura i kluczowe specyfikacje

K2 Thinking jest zbudowany jako rozproszony model MoE (384 ekspertów, 8 ekspertów wybranych na token) z około 1 bilion parametrów w sumie oraz ~32B aktywowanych parametrów na podstawie wnioskowania. Wykorzystuje hybrydowe rozwiązania architektoniczne (uwaga MLA, aktywacje SwiGLU) i został wytrenowany za pomocą optymalizatora Muon/MuonClip firmy Moonshot przy dużych budżetach tokenów opisanych w raporcie technicznym. Wariant myślowy rozszerza model bazowy o kwantyzację po treningu (natywne wsparcie dla INT4), okno kontekstowe o rozmiarze 256 kB oraz inżynierię umożliwiającą ujawnienie i stabilizację wewnętrznego śladu wnioskowania modelu podczas rzeczywistego użytkowania.

Co w praktyce oznacza „myślenie”

„Myślenie” jest tutaj celem inżynieryjnym: umożliwienie modelowi (1) generowania długich, ustrukturyzowanych łańcuchów wewnętrznego rozumowania (tokenów łańcucha myśli), (2) wywoływania narzędzi zewnętrznych (wyszukiwarki, piaskownic Pythona, przeglądarek, baz danych) w ramach tego rozumowania, (3) oceniania i samoweryfikacji twierdzeń pośrednich oraz (4) iterowania w wielu takich cyklach bez utraty spójności. Dokumentacja i karta modelu Moonshot pokazują, że K2 Thinking jest jawnie wytrenowany i dostrojony do przeplatania rozumowania i wywołań funkcji oraz do zachowania stabilnego zachowania agenta w setkach kroków.

Jaki jest główny cel?

Ograniczenia tradycyjnych modeli na dużą skalę są następujące:

- Proces generowania jest krótkowzroczny i brakuje w nim logiki między krokami;

- Możliwości wykorzystania narzędzi są ograniczone (zwykle narzędzia zewnętrzne można wywołać raz lub dwa razy);

- Nie potrafią sami rozwiązać złożonych problemów.

Głównym celem projektowym K2 Thinking jest rozwiązanie tych trzech problemów. W praktyce K2 Thinking potrafi, bez ingerencji człowieka: wykonać 200–300 kolejnych wywołań narzędzi; utrzymać setki kroków logicznego, spójnego rozumowania; rozwiązywać złożone problemy poprzez kontekstową autoweryfikację.

Repozycjonowanie: model języka → model myślenia

Projekt K2 Thinking ilustruje szerszą strategiczną zmianę w tej dziedzinie: przejście od warunkowego generowania tekstu do rozwiązujący problemy agenciGłównym celem nie jest przede wszystkim poprawa perpleksywności lub przewidywania następnego tokena, ale stworzenie modeli, które mogą:

- Plan własne strategie wieloetapowe;

- Koordynować narzędzia i efektory zewnętrzne (wyszukiwanie, wykonywanie kodu, bazy wiedzy);

- zweryfikować wyniki pośrednie i korygowanie błędów;

- Podtrzymywać spójność w długich kontekstach i długich łańcuchach narzędzi.

To nowe ujęcie zmienia zarówno ocenę (punkty odniesienia podkreślają procesy i wyniki, a nie tylko jakość tekstu), jak i inżynierię (struktury kierowania narzędziami, liczenia kroków, samokrytyki itp.).

Metody pracy: jak działają modele myślowe

W praktyce K2 Thinking demonstruje kilka metod pracy, które są typowe dla podejścia „modelu myślowego”:

- Trwałe ślady wewnętrzne: Model ten generuje ustrukturyzowane kroki pośrednie (ślady rozumowania), które są przechowywane w kontekście i mogą być później ponownie wykorzystane lub zweryfikowane.

- Dynamiczne trasowanie narzędzi: Na podstawie każdego wewnętrznego kroku K2 decyduje, które narzędzie wywołać (wyszukiwarkę, interpreter kodu, przeglądarkę internetową) i kiedy je wywołać.

- Skalowanie w czasie testu: Podczas wnioskowania system może rozszerzyć swoją „głębokość myślenia” (więcej wewnętrznych tokenów rozumowania) i zwiększyć liczbę wywołań narzędzi, aby lepiej eksplorować rozwiązania.

- Samoweryfikacja i odzyskiwanie: Model ten wyraźnie sprawdza wyniki, uruchamia testy poprawności i dokonuje zmian w planach, gdy sprawdzenia zakończą się niepowodzeniem.

Metody te łączą architekturę modelu (MoE + długi kontekst) z inżynierią systemów (orkiestracja narzędzi, kontrole bezpieczeństwa).

Jakie innowacje technologiczne umożliwiają Kimi K2 Thinking?

Mechanizm rozumowania Kimi K2 Thinking obsługuje przeplatane myślenie i korzystanie z narzędzi. Pętla rozumowania K2 Thinking:

- Zrozumienie problemu (analiza i streszczenie)

- Generowanie wieloetapowego planu rozumowania (łańcucha planów)

- Korzystanie z narzędzi zewnętrznych (kod, przeglądarka, silnik matematyczny)

- Weryfikacja i rewizja wyników (weryfikacja i rewizja)

- Zakończ rozumowanie (zakończ rozumowanie)

Poniżej przedstawię trzy kluczowe techniki, które umożliwiają pętle rozumowania w xx.

1) Skalowanie w czasie testu

Co to jest: Tradycyjne „prawa skalowania” koncentrują się na zwiększaniu liczby parametrów lub danych podczas treningu. Innowacja K2 Thinking polega na: dynamicznym zwiększaniu liczby tokenów (tj. głębokości myśli) podczas „fazy rozumowania”; jednoczesnym zwiększaniu liczby wywołań narzędzi (tj. zakresu działania). Ta metoda nazywa się skalowaniem w czasie testu, a jej głównym założeniem jest: „Dłuższy łańcuch rozumowania + bardziej interaktywne narzędzia = jakościowy skok w rzeczywistej inteligencji”.

Dlaczego jest to ważne: K2 Thinking wyraźnie optymalizuje to pod kątem: Moonshot pokazuje, że rozszerzanie „tokenów myślowych” oraz liczba/głębokość wywołań narzędzi przynosi mierzalne ulepszenia w testach porównawczych agentów, dzięki czemu model ten przewyższa inne modele o podobnej lub większej wielkości w scenariuszach dopasowanych do FLOP-ów.

2) Rozumowanie wspomagane narzędziami

Co to jest: Rozwiązanie K2 Thinking zostało zaprojektowane tak, aby natywnie analizować schematy narzędzi, autonomicznie decydować o wywołaniu narzędzia i włączać wyniki z powrotem do bieżącego strumienia wnioskowania. Moonshot wytrenował i dostroił model, aby przeplatać łańcuch myślowy z wywołaniami funkcji, a następnie ustabilizował to zachowanie w setkach kolejnych kroków narzędzia.

Dlaczego jest to ważne: To połączenie — niezawodne przetwarzanie + stabilny stan wewnętrzny + narzędzia API — umożliwia modelowi przeglądanie stron internetowych, uruchamianie kodu i organizowanie wieloetapowych przepływów pracy w ramach jednej sesji.

W ramach swojej wewnętrznej architektury model tworzy trajektorię realizacji „wizualizowanego procesu myślowego”: monit → tokeny rozumowania → wywołanie narzędzia → obserwacja → następne rozumowanie → ostateczna odpowiedź

3) Spójność długoterminowa i samoweryfikacja

Co to jest: Spójność długoterminowa to zdolność modelu do utrzymania spójnego planu i stanu wewnętrznego w wielu krokach i w bardzo długich kontekstach. Samoweryfikacja oznacza, że model proaktywnie sprawdza swoje wyniki pośrednie i ponownie uruchamia lub koryguje kroki w przypadku niepowodzenia weryfikacji. Długie zadania często powodują dryfowanie modeli lub halucynacje. K2 Thinking radzi sobie z tym za pomocą wielu technik: bardzo długich okien kontekstowych (256 kB), strategii szkoleniowych, które zachowują stan w długich sekwencjach CoT, oraz jawnych modeli wierności/osądu na poziomie zdań, wykrywających nieuzasadnione twierdzenia.

Dlaczego jest to ważne: Mechanizm „Recurrent Reasoning Memory” utrzymuje trwałość stanu rozumowania, nadając mu cechy zbliżone do ludzkich: „stabilności myślenia” i „kontekstualnego samonadzoru”. Ponieważ zadania rozciągają się na wiele etapów (np. projekty badawcze, zadania kodowania wielu plików, długie procesy redakcyjne), utrzymanie spójnego wątku staje się niezbędne. Samoweryfikacja zmniejsza liczbę ukrytych błędów; zamiast zwracać wiarygodną, ale niepoprawną odpowiedź, model może wykrywać niespójności i ponownie korzystać z narzędzi lub zmieniać plan.

Możliwości:

- Spójność kontekstowa: zachowuje ciągłość semantyczną w obrębie ponad 10 tys. tokenów;

- Wykrywanie błędów i wycofywanie zmian: Identyfikuje i koryguje odchylenia logiczne we wczesnych procesach myślowych;

- Pętla samoweryfikacji: automatycznie weryfikuje racjonalność odpowiedzi po zakończeniu rozumowania;

- Łączenie wnioskowania wielościeżkowego: Wybiera optymalną ścieżkę spośród wielu łańcuchów logicznych.

Jakie są cztery podstawowe możliwości K2 Thinking?

Głębokie i ustrukturyzowane rozumowanie

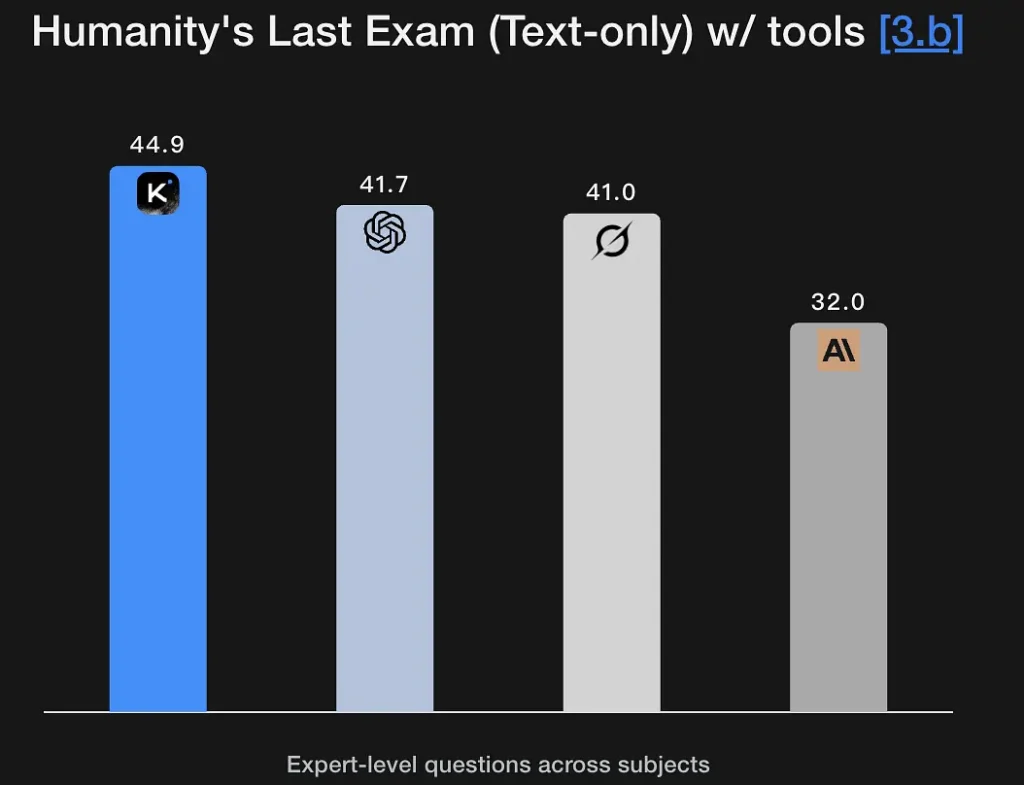

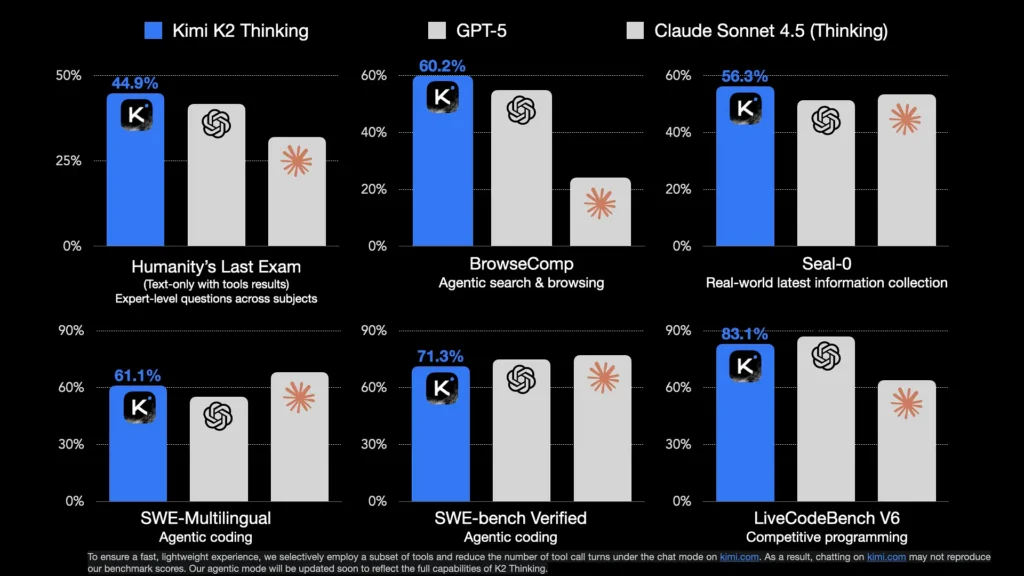

Model K2 Thinking został dostrojony do generowania jednoznacznych, wieloetapowych śladów rozumowania i wykorzystywania ich do wyciągania trafnych wniosków. Model osiąga wysokie wyniki w testach matematycznych i rygorystycznych testach rozumowania (GSM8K, AIME, w stylu IMO) oraz wykazuje zdolność do utrzymania nienaruszalności rozumowania w długich sekwencjach – co jest podstawowym wymogiem rozwiązywania problemów na poziomie badawczym. Jego doskonałe wyniki w teście Humanity's Last Exam (44.9%) świadczą o eksperckich zdolnościach analitycznych. Potrafi wyodrębniać struktury logiczne z rozmytych opisów semantycznych i generować grafy rozumowania.

Kluczowe cechy:

- Wspiera rozumowanie symboliczne: rozumie i operuje strukturami matematycznymi, logicznymi i programistycznymi.

- Posiada zdolność testowania hipotez: Potrafi spontanicznie wysuwać i weryfikować hipotezy.

- Potrafi dokonać wieloetapowego rozkładu problemu: dzieli złożone cele na wiele podzadań.

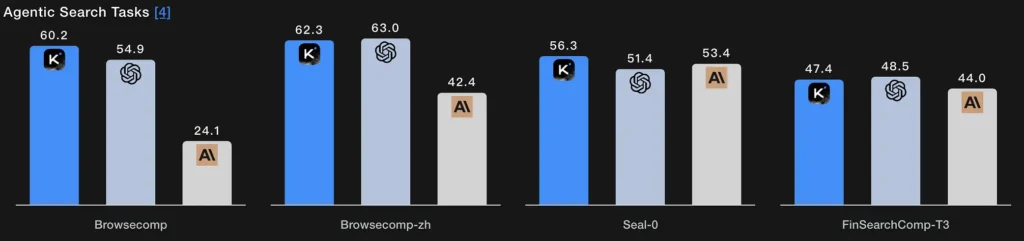

Wyszukiwanie agentów

Zamiast pojedynczego kroku wyszukiwania, wyszukiwanie agentowe pozwala modelowi zaplanować strategię wyszukiwania (czego szukać), wykonać ją za pomocą powtarzających się wywołań web/narzędzi, zsyntetyzować przychodzące wyniki i doprecyzować zapytanie. Wyniki uzyskane przez narzędzia BrowseComp i Seal-0 firmy K2 Thinking wskazują na wysoką wydajność w tym zakresie; model został specjalnie zaprojektowany do obsługi wieloetapowych wyszukiwań w internecie z planowaniem stanowym.

Istota techniczna:

- Moduł wyszukiwania i model języka tworzą zamkniętą pętlę: generowanie zapytań → pobieranie stron internetowych → filtrowanie semantyczne → łączenie rozumowań.

- Model może adaptacyjnie dostosowywać strategię wyszukiwania, np. najpierw wyszukując definicje, potem dane, a na końcu weryfikując hipotezy.

- W istocie jest to złożona inteligencja obejmująca „wyszukiwanie informacji + rozumienie + argumentację”.

Kodowanie agentowe

To jest zdolność do pisać, wykonywać, testować i iterować na kodzie jako części pętli wnioskowania. K2 Thinking publikuje konkurencyjne wyniki w testach kodowania na żywo i weryfikacji kodu, obsługuje łańcuchy narzędzi Pythona w swoich wywołaniach i może uruchamiać wieloetapowe pętle debugowania poprzez wywoływanie piaskownicy, odczytywanie błędów i naprawianie kodu w powtarzanych przejściach. Wyniki EvalPlus/LiveCodeBench odzwierciedlają te mocne strony. Uzyskanie wyniku 71.3% w teście SWE-Bench Verified oznacza, że K2 Thinking poprawnie wykonuje ponad 70% rzeczywistych zadań naprawy oprogramowania.

Wykazuje również stabilną wydajność w środowisku konkursowym LiveCodeBench V6, prezentując możliwości implementacji algorytmów i optymalizacji.

Istota techniczna:

- Przyjmuje proces „analizy semantycznej + refaktoryzacji na poziomie AST + automatycznej weryfikacji”;

- Wykonywanie kodu i testowanie odbywa się poprzez wywołania narzędzi na poziomie wykonawczym;

- Realizuje zamknięty cykl zautomatyzowanego rozwoju, od zrozumienia kodu → diagnozowania błędów → generowania poprawek → weryfikowania sukcesu.

Pisanie agentyczne

Poza kreatywną prozą, pisanie agentowe to ustrukturyzowane, ukierunkowane na cel tworzenie dokumentów, które może wymagać zewnętrznych badań, cytowania, generowania tabel i iteracyjnego udoskonalania (np. stworzenie szkicu → weryfikacja faktów → korekta). Długi kontekst i orkiestracja narzędzi K2 Thinking sprawiają, że doskonale nadaje się do wieloetapowych procesów pisania (streszczenia badań, podsumowania przepisów, treści wielorozdziałowe). Otwarte wskaźniki wygranych modelu w testach typu Arena oraz metryki pisania długich tekstów potwierdzają tę tezę.

Istota techniczna:

- Automatycznie generuje segmenty tekstu wykorzystując agentowe planowanie myśli;

- Wewnętrznie kontroluje logikę tekstu poprzez tokeny rozumowania;

- Można jednocześnie wywoływać narzędzia takie jak wyszukiwanie, obliczenia i generowanie wykresów, aby osiągnąć „pisanie multimodalne”.

W jaki sposób możesz wykorzystać K2 Thinking już dziś?

Sposoby dostępu

K2 Thinking jest dostępne jako wersja open source (wagi modeli i punkty kontrolne) oraz za pośrednictwem punktów końcowych platformy i centrów społecznościowych (Hugging Face, platforma Moonshot). Możesz hostować samodzielnie, jeśli dysponujesz wystarczającą mocą obliczeniową, lub skorzystać z… Interfejs API CometAPI/hostowany interfejs użytkownika umożliwiający szybsze wdrażanie. Zawiera również dokumentację reasoning_content pole, które po włączeniu wyświetla wewnętrzne tokeny myśli wywołującemu.

Praktyczne wskazówki dotyczące użytkowania

- Zacznij od bloków konstrukcyjnych agentów: Najpierw udostępnij niewielki zestaw narzędzi deterministycznych (wyszukiwarkę, piaskownicę Pythona i wiarygodną bazę danych faktów). Zapewnij jasne schematy narzędzi, aby model mógł analizować i weryfikować wywołania.

- Dostrój obliczenia w czasie testu: w przypadku rozwiązywania trudnych problemów, należy zapewnić dłuższe budżety na przemyślenia i więcej rund testowania narzędzi; mierzyć, jak jakość poprawia się w porównaniu z opóźnieniami/kosztami. Moonshot promuje skalowanie czasu testowania jako główną dźwignię.

- Użyj trybów INT4 w celu optymalizacji kosztów:K2 Thinking obsługuje kwantyzację INT4, która zapewnia znaczące przyspieszenie, ale sprawdź zachowanie skrajnych przypadków w swoich zadaniach.

- Dokładnie przeanalizuj treść rozumowania powierzchniowego:ujawnienie wewnętrznych łańcuchów może ułatwić debugowanie, ale zwiększa również ryzyko błędów w surowym modelu. Traktuj wewnętrzne rozumowanie jako diagnostyczny nie jest autorytatywny; połącz go z weryfikacją automatyczną.

Podsumowanie

Kimi K2 Thinking to celowo zaprojektowana odpowiedź na nową erę sztucznej inteligencji: nie tylko większe modele, ale agenci, którzy myślą, działają i weryfikująŁączy skalowanie MoE, strategie obliczeniowe w czasie testowania, natywne wnioskowanie o niskiej precyzji oraz jawną orkiestrację narzędzi, aby umożliwić zrównoważone, wieloetapowe rozwiązywanie problemów. Dla zespołów, które potrzebują wieloetapowego rozwiązywania problemów i dysponują inżynierską dyscypliną do integracji, testowania i monitorowania systemów agentowych, K2 Thinking to duży, praktyczny krok naprzód — i ważny test wytrzymałościowy dla tego, jak przemysł i społeczeństwo będą zarządzać coraz bardziej wydajną, zorientowaną na działanie sztuczną inteligencją.

Deweloperzy mogą uzyskać dostęp Kimi K2 Thinking API poprzez CometAPI, najnowsza wersja modelu jest zawsze aktualizowany na oficjalnej stronie internetowej. Na początek zapoznaj się z możliwościami modelu w Plac zabaw i zapoznaj się z Przewodnik po API aby uzyskać szczegółowe instrukcje. Przed uzyskaniem dostępu upewnij się, że zalogowałeś się do CometAPI i uzyskałeś klucz API. Interfejs API Comet zaoferuj cenę znacznie niższą niż oficjalna, aby ułatwić Ci integrację.

Gotowy do drogi?→ Zarejestruj się w CometAPI już dziś !

Jeśli chcesz poznać więcej wskazówek, poradników i nowości na temat sztucznej inteligencji, obserwuj nas na VK, X oraz Discord!