Seedance 2.0 to nowej generacji model generowania wideo AI od ByteDance, oficjalnie uruchomiony w marcu 2026 roku. Obsługuje wejścia tekstowe, obrazowe, audio i wideo, może używać maksymalnie 9 obrazów, 3 klipów wideo i 3 klipów audio jako materiałów referencyjnych, i został zaprojektowany z myślą o kontroli na poziomie reżyserskim, stabilności ruchu oraz wspólnym generowaniu audio i wideo. W aktualnych rankingach ślepych głosowań Artificial Analysis Seedance 2.0 prowadzi zarówno w kategorii text-to-video, jak i image-to-video bez audio, z wynikami Elo odpowiednio 1269 i 1351.

Czym jest Seedance 2.0?

Seedance 2.0 to nowej generacji model tworzenia wideo od ByteDance Seed. Oficjalnie jest zbudowany na zunifikowanej wielomodalnej architekturze wspólnego generowania audio i wideo, która akceptuje wejścia tekstowe, obrazowe, audio i wideo, i jest pozycjonowany jako narzędzie dla twórców o wyjątkowo szerokich możliwościach referencyjnych i edycyjnych. Seedance 2.0 został zaprojektowany z myślą o przemysłowych przepływach pracy nad treściami, oferując większą dokładność fizyczną, realizm, sterowalność i stabilność w złożonych scenach ruchu niż wcześniejsze wydanie 1.5. W przeciwieństwie do wcześniejszych modeli, które skupiały się głównie na text-to-video, Seedance 2.0 wprowadza w pełni zunifikowany wielomodalny pipeline generowania, umożliwiający:

- Generowanie text-to-video

- Animację image-to-video

- Edycję video-to-video

- Wyjście zsynchronizowane z audio

To czyni go jedną z najbardziej kompleksowych platform tworzenia wideo AI dostępnych w 2026 roku.

Dlaczego to ma znaczenie?

Większość generatorów wideo jest nadal zoptymalizowana pod stosunkowo wąski przepływ pracy: wpisujesz prompt, otrzymujesz klip. Seedance 2.0 idzie dalej, traktując generowanie wideo bardziej jak przestrzeń roboczą reżysera. Według ByteDance może jednocześnie korzystać z wielu typów materiałów referencyjnych, zachowywać spójność obiektu, wierniej wykonywać szczegółowe instrukcje, a nawet planować język kamery w bardziej „reżyserski” sposób. To połączenie ma znaczenie, ponieważ najtrudniejsze problemy w generowaniu wideo to nie tylko estetyka, ale także ciągłość, spójność ruchu i kontrola nad tym, co dzieje się w czasie.

Co nowego i jakie są kluczowe funkcje w Seedance 2.0?

Zunifikowane generowanie wielomodalne

Najważniejszą funkcją jest zdolność modelu do wspólnego wnioskowania na podstawie kilku modalności. Seedance 2.0 obsługuje do 9 obrazów, 3 wideo i 3 klipów audio jako materiałów referencyjnych, wraz z instrukcjami w języku naturalnym, i może generować wideo o długości do 15 sekund. W praktyce oznacza to, że możesz sterować nie tylko obiektem i sceną, ale także stylem ruchu, ruchem kamery, efektami specjalnymi i wskazówkami audio w jednym przebiegu generowania.

Kontrola na poziomie reżyserskim

Seedance 2.0 został również zbudowany wokół tego, co ByteDance określa jako kontrolę na poziomie reżyserskim. Twórcy mogą kształtować grę, oświetlenie, cienie i ruch kamery za pomocą obrazów referencyjnych, audio i wideo. Model potrafi zachować stabilną tożsamość obiektu, dokładnie odtwarzać złożone scenariusze i dobierać język kamery w sposób odzwierciedlający pewien rodzaj wbudowanej „logiki montażu”. Dla twórców to duży krok naprzód poza podstawowe text-to-video.

Edycja i rozszerzanie, nie tylko generowanie

Kolejnym istotnym ulepszeniem jest to, że Seedance 2.0 nie kończy się na generowaniu. Seedance 2.0 dodaje możliwości edycji wideo i rozszerzania wideo, umożliwiając ukierunkowane zmiany konkretnych scen, postaci, działań lub punktów fabularnych oraz tworzenie ciągłych kolejnych ujęć. Artykuł deweloperski wyjaśnia również, że model może być używany do „kontynuowania nagrania” poprzez wydłużenie klipu zamiast rozpoczynania od nowa. Ma to znaczenie dla wydajności pracy, ponieważ zmniejsza potrzebę regenerowania całej sceny tylko po to, aby poprawić jeden segment.

Lepsza obsługa złożonego ruchu

Seedance 2.0 jest znacząco silniejszy w scenach z wieloma obiektami, interakcjami i skomplikowanym ruchem. Jakość generowania znacznie wzrosła względem wersji 1.5, oferując lepszą dokładność fizyczną, realizm i sterowalność. Wewnętrzna ocena wskazuje, że wskaźnik użyteczności Seedance 2.0 w trudnych scenach ruchu osiąga branżowy poziom SOTA, przy jednoczesnym uznaniu, że nadal potrzebne są dalsze ulepszenia w zakresie stabilności drobnych detali, realizmu i wyrazistości.

Benchmark wydajności

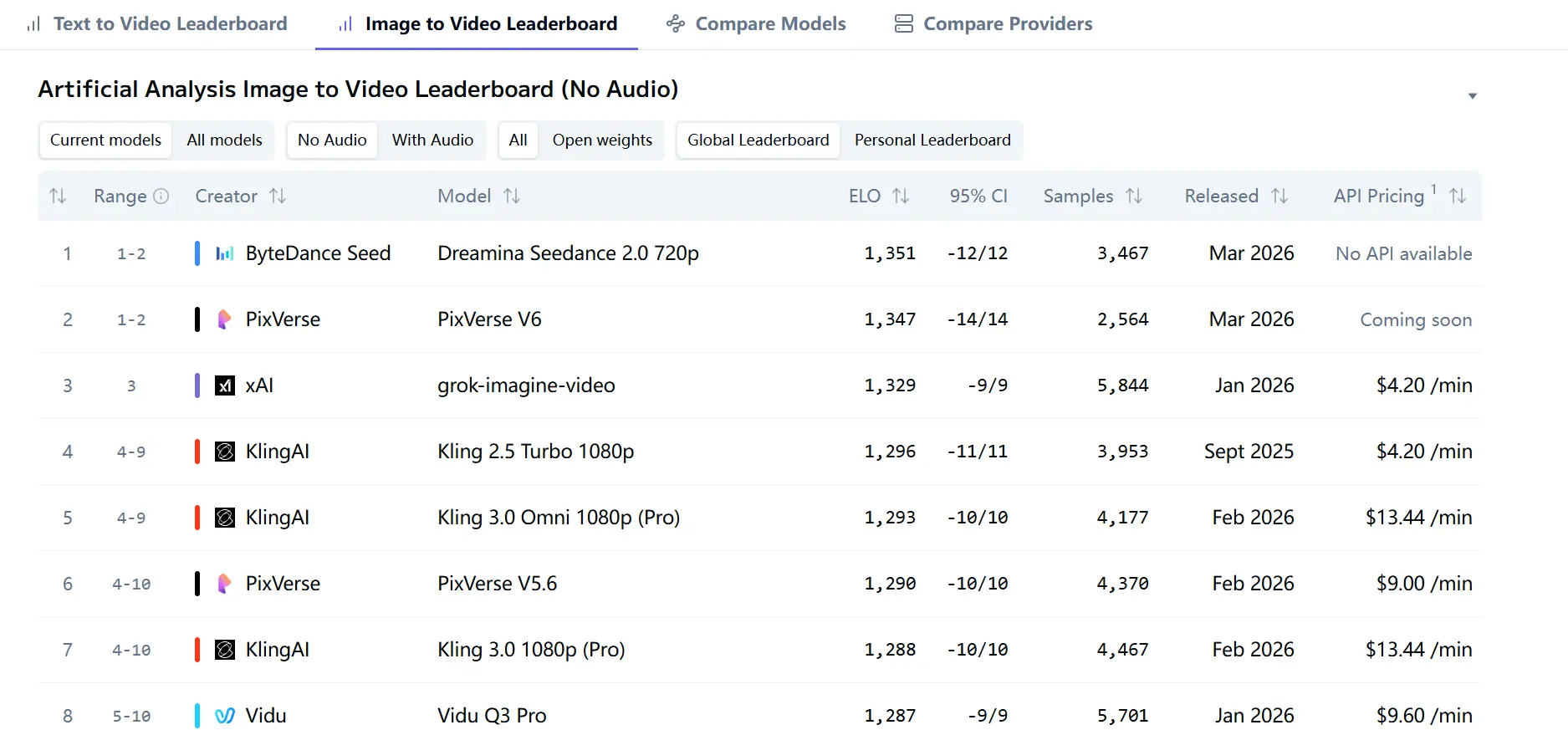

Najsilniejszym zewnętrznym sygnałem w przeanalizowanych źródłach jest Artificial Analysis Video Arena. Na aktualnych stronach rankingowych Dreamina Seedance 2.0 720p prowadzi w Image-to-Video Arena without audio z wynikiem Elo 1351 oraz w Text-to-Video Arena without audio z wynikiem Elo 1269. Strony rankingowe podają również, że rankingi pochodzą z ślepych głosów użytkowników, co jest istotne, ponieważ mierzy preferencje ludzi na dużą skalę, a nie tylko wewnętrzne metryki modelu.

To ma znaczenie, ponieważ oznacza, że Seedance 2.0 nie jest jedynie reklamowany jako zdolny; obecnie jest faktycznie preferowany przez użytkowników w testach bezpośrednich porównań na dwóch głównych arenach. W text-to-video bez audio wyprzedza Kling 3.0 1080p (Pro), SkyReels V4, PixVerse V6 i Kling 3.0 Omni 1080p (Pro). W image-to-video bez audio nieznacznie wyprzedza PixVerse V6 i grok-imagine-video.

Podsumowanie wydajności Seedance 2.0

| Metric | Seedance 2.0 |

|---|---|

| Image-to-Video Rank | Top 15 globally |

| ELO Score | ~1258 |

| Text-to-Video Rank | Top 25 |

| Cost | ~$1.56/min |

| Strength | Cost-performance balance |

👉 Interpretacja:

- Nie zawsze #1 pod względem surowej jakości

- Ale wyjątkowy stosunek wartości do wydajności

Jak dobry jest naprawdę Seedance 2.0?

Jego największe mocne strony

Największe mocne strony Seedance 2.0 są jasne: radzi sobie ze złożonym ruchem lepiej niż wiele modeli wideo, obsługuje wiele modalności referencyjnych, oferuje edycję i rozszerzanie, a obecnie prowadzi w najbardziej widocznych publicznych rankingach aren dla text-to-video i image-to-video bez audio. Widać też poprawę dokładności fizycznej, realizmu i sterowalności, czyli dokładnie tych cech, które mają znaczenie, gdy model przechodzi od demonstracji do profesjonalnych przepływów pracy.

Jego obecne ograniczenia

ByteDance nie przedstawia Seedance jako rozwiązania doskonałego. Nadal jest miejsce na poprawę stabilności detali, realizmu i dynamiki ruchu, a firma wskazuje także na pozostające wyzwania w zakresie spójności wielu obiektów, precyzji renderowania tekstu i złożonych efektów edycyjnych.

Moja ocena

Na podstawie przeanalizowanych źródeł Seedance 2.0 wygląda mniej jak marginalna aktualizacja, a bardziej jak poważny krok w stronę gotowego do produkcji systemu wideo. Jego najmocniejszym argumentem nie jest pojedyncze efektowne demo, lecz połączenie szerszego wielomodalnego stosu wejściowego, bezpośrednich narzędzi edycyjnych, rozszerzania klipów i wiarygodnego prowadzenia w publicznych rankingach. To czyni go jednym z najważniejszych modeli wideo obecnie dostępnych na rynku, szczególnie dla zespołów, którym zależy na sterowalności w równym stopniu co na czysto filmowej jakości.

Seedance 2.0 vs Sora 2 vs Veo 3.1

Tabela porównawcza (liderzy AI wideo 2026)

| Feature | Seedance 2.0 | Sora 2 | Veo 3.1 |

|---|---|---|---|

| Developer | ByteDance | OpenAI | |

| Input Types | Text, image, audio, video | Text | Text + image |

| Audio Generation | ✅ Native | ❌ Limited | ✅ |

| Max Video Length | 15–20 sec | ~25 sec | ~8 sec (extendable) |

| Editing Capability | ⭐ Advanced (reference-based) | Moderate | Moderate |

| ELO Ranking | Top 15–25 | High | High |

| Cost Efficiency | ⭐ High | Medium | Medium |

| Commercial Use | Yes | Limited (watermark) | Yes |

| Unique Strength | Multimodal editing | Long storytelling | Visual fidelity |

Kluczowe wnioski

- Seedance 2.0 = najlepsza edycja + wielomodalna elastyczność

- Sora 2 = najlepsza długość narracji

- Veo 3.1 = najlepsza jakość image-to-video

W aktualnych rankingach Artificial Analysis dla text-to-video Seedance 2.0 720p wyprzedza zarówno Veo 3.1, jak i Sora 2 Pro w kategorii bez audio. Nie rozstrzyga to każdej debaty o jakości, ponieważ modele różnią się przepływem pracy, ograniczeniami bezpieczeństwa i opakowaniem produktowym, ale pokazuje, że Seedance 2.0 wszedł do tej samej najwyższej ligi co najbardziej widoczne zachodnie rozwiązania.

Najbardziej oczywistą przewagą Seedance 2.0 jest szerokość obsługiwanych wejść. ByteDance twierdzi, że może wspólnie przetwarzać tekst, obraz, audio i wideo oraz używać jednocześnie nawet 9 obrazów, 3 wideo i 3 klipów audio. Dokumentacja OpenAI dla Sora 2 natomiast wymienia tekst i obraz jako wejścia oraz wideo i audio jako wyjścia, z dostępem przez aplikację Sora i sora.com; Sora 2 Pro jest również dostępny dla użytkowników ChatGPT Pro w przeglądarce. Google Veo 3.1 plasuje się gdzieś pośrodku: jest zbudowany wokół tworzenia sterowanego obrazem i generowania wideo bogatego w audio, z maksymalnie 3 obrazami referencyjnymi, rozszerzaniem scen oraz kontrolą pierwszej i ostatniej klatki.

Jak uzyskać dostęp i gdzie porównywać

Jeśli chcesz uzyskać dostęp do Sora 2, Veo 3.1 i xx jednocześnie na jednej platformie, polecam CometAPI. Playgoud od CometAPI zapewnia bezpośrednie generowanie wideo przy użyciu jedynie prostego polecenia lub kilku obrazów referencyjnych. Jeśli chcesz programistycznie skonfigurować własne API do generowania wideo, CometAPI jest jeszcze bardziej warte rozważenia. Udostępnia API dla Sora 2, Veo 3.1 itd., a obecnie oferowane jest z 20% zniżką.

Jak używać Seedance 2.0 z CometAPI

Generowanie text-to-video

Wpisz opis swojej sceny. Im bardziej szczegółowy, tym lepiej — uwzględnij ruch kamery, oświetlenie, nastrój i styl. Silne trzymanie się promptu przez Seedance 2.0 oznacza, że wynik ściśle odpowiada Twojej intencji, co czyni go niezawodnym w produkcji treści, a nie tylko w podejściu prób i błędów.

W CometAPI Playground możesz bezpośrednio wprowadzać prompty i generować wideo przy użyciu modelu Seedance 2.0. Jest to szczególnie przydatne w przypadku treści do mediów społecznościowych (Reels, TikTok, YouTube Shorts), filmów markowych i krótkich klipów narracyjnych.

Jak to działa:

- Otwórz CometAPI

- Wybierz model Seedance 2.0

- Wprowadź prompt

- Dostosuj parametry (czas trwania, rozdzielczość, proporcje obrazu)

- Uruchom zadanie generowania i poczekaj na wynik

Image-to-Video z CometAPI

Prześlij statyczny obraz — taki jak zdjęcie produktu, ilustracja koncepcyjna lub makieta projektu — i użyj możliwości image-to-video Seedance 2.0 za pośrednictwem CometAPI, aby go animować.

Rezultatem jest płynny, uwzględniający kontekst ruch wygenerowany na podstawie Twojego wejścia wizualnego. To idealne rozwiązanie dla zespołów, które mają już zasoby projektowe i chcą przekształcić je w wideo bez pełnego procesu produkcyjnego.

Jak to działa:

- Użyj

input_reference(lub równoważnego pola przesyłania plików w Playground) - Dodaj prompt skoncentrowany na ruchu, opisujący, jak scena powinna się poruszać

Przykładowy prompt:

„Kamera powoli zbliża się do produktu, miękkie studyjne oświetlenie, subtelne refleksy, premiumowy charakter reklamy”

Generowanie audio-wizualne w jednym przebiegu

Zamiast najpierw generować wideo, a potem osobno dodawać audio, CometAPI obsługuje natywny pipeline generowania audio-wizualnego Seedance 2.0.

Opisując zarówno obraz, jak i dźwięk w jednym prompcie, możesz wygenerować zsynchronizowane wideo i audio w jednym kroku. Daje to bardziej spójne i zamierzone rezultaty, a jednocześnie skraca czas edycji.

Przykładowy prompt:

„Spokojna plaża o wschodzie słońca, delikatnie falujące fale, ciepłe złote światło, łagodna muzyka ambient z odgłosami oceanu”

Wynik obejmuje:

- Wygenerowane wideo

- Zsynchronizowane audio w tle

- Naturalnie dopasowane tempo i nastrój

Dlaczego warto używać CometAPI dla Seedance 2.0

- Bezpośredni dostęp przez API lub Playground

- Łatwa kontrola parametrów (czas trwania, rozdzielczość, format)

- Obsługuje zarówno przepływy pracy text-to-video, jak i image-to-video

- Wbudowana obsługa zadań dla asynchronicznego generowania wideo

Podsumowanie

Seedance 2.0 wygląda na prawdziwy skok w generowaniu wideo AI: wielomodalny system łączący wejścia tekstowe, obrazowe, audio i wideo; lider rankingów zarówno w text-to-video, jak i image-to-video; oraz model zbudowany z myślą o kontroli w stylu reżyserskim, a nie o casualowym użyciu zabawkowym. Jeśli zależy Ci wyłącznie na surowo postrzeganej jakości, obecne dowody wskazują, że jest wyjątkowy.

Zacznij tworzyć z Seedance 2.0 na CometAPI już dziś.