O GPT-5 da OpenAI foi lançado no início de agosto de 2025 e rapidamente se tornou disponível por meio de vários canais de distribuição. Uma das maneiras mais rápidas para as equipes experimentarem o GPT-5 sem trocar de SDK de fornecedor é o CometAPI — um gateway multimodelo que expõe o GPT-5 juntamente com centenas de outros modelos. Este artigo contém documentação prática para explicar o que A CometAPI oferece, como para chamar o GPT-5 por meio dele, as compensações que você deve avaliar e a governança prática e os controles de custo a serem implementados antes de mover fluxos de trabalho críticos para o GPT-5.

O que é GPT-5 e o que o torna diferente dos modelos anteriores?

O GPT-5 é a próxima grande família de modelos de linguagem emblemática da OpenAI, lançada no início de agosto de 2025. É apresentado como um sistema de raciocínio unificado e multimodal que combina componentes rápidos sem raciocínio, uma variante de "raciocínio" mais profunda (frequentemente chamada de "pensamento GPT-5") e um roteador que decide qual submodelo usar com base na complexidade e nas ferramentas necessárias. O efeito líquido alegado pela OpenAI: melhor raciocínio, janelas de contexto maiores e suporte aprimorado para codificação e tarefas de agente.

Arquitetura e principais capacidades

- Sistema multicomponente: O GPT-5 é descrito como um sistema que encaminha solicitações para diferentes submodelos internos (raciocínio rápido vs. profundo), dependendo da necessidade; os desenvolvedores podem solicitar o modelo de raciocínio por meio da API para obter desempenho máximo.

- Contexto amplo: A família de modelos oferece suporte a contextos extremamente grandes (centenas de milhares de tokens), permitindo o processamento em uma única passagem de documentos longos, bases de código ou conversas com vários arquivos.

- Família de vários tamanhos: A OpenAI lançou o GPT-5 em vários tamanhos (regular

gpt-5,gpt-5-mini,gpt-5-nano) para que as equipes possam equilibrar latência, custo e poder de raciocínio.

O que é CometAPI e ela realmente oferece GPT-5?

Uma definição rápida

CometAPI é uma plataforma de agregação de APIs que anuncia acesso unificado a centenas de modelos de IA (famílias GPT da OpenAI, Anthropic Claude, xAI Grok, modelos de imagem e mais) por meio de uma única interface REST compatível com OpenAI. Isso significa que os desenvolvedores podem alternar os provedores de modelos alterando uma string de nome de modelo em vez de reescrever o código de rede. Em suas páginas de produtos, a CometAPI lista explicitamente GPT-5 e variantes relacionadas (por exemplo, gpt-5, gpt-5-chat-latest, gpt-5-mini) como pontos de extremidade disponíveis.

Por que as equipes usam gateways como o CometAPI

Serviços de gateway como o CometAPI são atraentes porque permitem que você:

- Trocar modelos rapidamente sem alterar grandes quantidades de código de integração.

- Compare os preços e encaminhar determinadas solicitações para variantes de modelos mais baratas ou mais rápidas.

- Faturamento e registro agregados em vários modelos e fornecedores.

A documentação do CometAPI fornece um caminho de migração simples e um cliente no estilo OpenAI (para que seu código OpenAI existente ou “compatível com OpenAI” geralmente precise apenas de pequenas alterações).

Como o CometAPI expõe o GPT-5 programaticamente?

CometAPI apresenta uma API REST compatível com OpenAI superfície: uma URL base, Authorization: Bearer <YOUR_KEY>, e solicitar corpos semelhantes aos endpoints de bate-papo/conclusões do OpenAI. Para GPT-5 a plataforma documenta nomes de modelos como gpt-5, gpt-5-mini e gpt-5-nano e os pontos finais mencionados incluem POST https://api.cometapi.com/v1/chat/completions para chamadas no estilo chat e /v1/responses para algumas variantes que não sejam de chat. Detalhes de configuração de exemplo (URL base, formato do cabeçalho e parâmetro do modelo) são publicados em Documentação do CometAPI e guias de início rápido.

Padrão típico de endpoint e autenticação

- URL base:

https://api.cometapi.com/v1(ou o documentado/v1/chat/completionspara bate-papo e/v1/responsespara algumas variantes que não sejam de bate-papo.). - Cabeçalho de autenticação:

Authorization: Bearer sk-xxxxxxxxxxxx(Problemas com o CometAPIsk-tokens de estilo no painel). - Tipo de conteúdo:

application/json. - Parâmetro do modelo: conjunto

modelparagpt-5, gpt-5-2025-08-07,gpt-5-chat-latest,gpt-5-miniou outros, consulte página do modelo.

Como começar a usar o CometAPI e solicitar o GPT-5? (passo a passo)

Abaixo está um fluxo de integração conciso e confiável que você pode seguir hoje.

Etapa 1: inscreva-se e obtenha uma chave CometAPI

- Acesse cometapi.com e crie uma conta.

- No seu painel, vá para Tokens API or Centro Pessoal → Adicionar Token. A CometAPI emite um token em

sk-...formato. Armazene-o com segurança (não incorpore chaves em repositórios públicos).

Etapa 2: Escolha a sequência do modelo

- Selecione o nome do modelo que corresponde às suas necessidades (por exemplo,

gpt-5,gpt-5-nano-2025-08-07). O CometAPI geralmente publica vários aliases para cada modelo para que você possa escolher entre precisão e custo.

Etapa 3: Faça sua primeira solicitação (curl)

Um mínimo curl exemplo que segue o padrão compatível com OpenAI:

curl -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer sk-YOUR_COMETAPI_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-5",

"messages": [{"role":"system","content":"You are a helpful assistant."},

{"role":"user","content":"Summarize the benefits of using a model aggregator."}],

"max_tokens": 500,

"temperature": 0.2

}'

Isso espelha a estrutura da API de bate-papo do OpenAI, mas aponta para a URL base do CometAPI e usa seu token Comet.

Etapa 4: Exemplo em Python (solicitações)

import requests, os

COMET_KEY = os.getenv("COMETAPI_KEY") # set this in your environment

url = "https://api.cometapi.com/v1/chat/completions"

headers = {

"Authorization": f"Bearer {COMET_KEY}",

"Content-Type": "application/json",

}

payload = {

"model": "gpt-5",

"messages": [

{"role":"system","content":"You are a helpful assistant."},

{"role":"user","content":"List three concrete steps to reduce model hallucination in production."}

],

"max_tokens": 400,

"temperature": 0.1

}

resp = requests.post(url, json=payload, headers=headers, timeout=60)

resp.raise_for_status()

print(resp.json())

Substituir model com gpt-5-nano ou o alias exato dos documentos CometAPI para variantes menores e mais baratas.

Preço no CometAPI

Quais são as melhores práticas e mitigações para uso em produção?

Abaixo estão padrões concretos para reduzir riscos e melhorar a confiabilidade quando você usa um intermediário como o CometAPI.

Comece com um pequeno piloto e execute testes lado a lado

Execute solicitações idênticas ao OpenAI (se tiver acesso direto) e ao CometAPI para comparar saídas, latência e custo. Isso revela quaisquer transformações implícitas, filtros de conteúdo ou incompatibilidades de alias de modelo.

Instrumento para observabilidade e garantia de qualidade

Registre prompts, tokens retornados (ofuscados para PII), latências e códigos de erro. Implemente testes automatizados para taxas de desvio de prompts e alucinações. Rastreie o uso de alias do modelo para que as migrações sejam auditáveis.

Proteja as chaves e gire-as regularmente

Trate os tokens CometAPI como qualquer segredo de API: armazene-os em gerenciadores de segredos, faça a rotação periodicamente e defina o escopo dos tokens para ambientes (dev/stage/prod).

Implementar segurança em camadas

Use uma combinação de:

- Engenharia imediata para reduzir alucinações (restrições explícitas, saída estruturada).

- Verificações de pós-processamento (verificação de fatos, listas de bloqueios, verificações de expressões regulares para PII).

- Humano no circuito para saídas de alto risco.

Elas são padrão para implantações GPT-5 que manipulam conteúdo crítico ou legal.

Quais são as armadilhas comuns e como solucionar problemas de acesso?

Armadilha: "modelo não existe / sem acesso". Alguns desenvolvedores relatam que o acesso ao modelo pode ser restringido por etapas de verificação do provedor ou da organização ao usar APIs de provedores diretos; restrições semelhantes podem aparecer quando agregadores usam proxy para modelos de provedores. Se você vir um erro de "modelo não existe" ou de permissão, verifique: (a) se sua chave CometAPI é válida e não expirou, (b) se o nome do modelo solicitado corresponde exatamente à lista de suporte da CometAPI e (c) se há etapas adicionais de verificação ou cobrança exigidas pelo provedor subjacente. Ou erros de acesso relacionados à verificação e anomalias de tempo limite/permissão — esteja preparado para fornecer detalhes à equipe de contato para resolução (e-mail: support@cometapi.com).

Armadilha: latência ou custo inesperado. Modos de raciocínio intenso e contextos amplos causam latência e gasto de tokens. Use max_tokens, Reduzir temperature quando apropriado, e preferir mini Variantes para cargas de trabalho de alto rendimento. Monitore com registro e alertas.

Nota final

A CometAPI oferece às equipes uma maneira rápida de experimentar variantes do GPT-5, centralizando o acesso ao modelo. No entanto, o uso em produção exige a mesma disciplina que você aplicaria a qualquer modelo poderoso: chaves seguras, engenharia rápida e cuidadosa, monitoramento de alucinações e revisão de políticas/legais para cargas de trabalho sensíveis. Comece com um pequeno piloto, use os painéis da CometAPI para medir o gasto e a latência dos tokens e avance para variantes de raciocínio mais complexo somente após validar a precisão e a segurança do seu domínio.

Os desenvolvedores podem acessar GPT-5 , GPT-5 Nano e GPT-5 Mini através do CometAPI (CometAPI recomenda /v1/responses), as versões mais recentes dos modelos listados são as da data de publicação do artigo. Para começar, explore os recursos do modelo no Playground e consulte o guia da API para obter instruções detalhadas. Antes de acessar, certifique-se de ter feito login na CometAPI e obtido a chave da API. CometAPI oferecem um preço muito mais baixo que o preço oficial para ajudar você a se integrar.

Veja também Como usar os novos parâmetros e ferramentas do GPT-5

Perguntas Frequentes

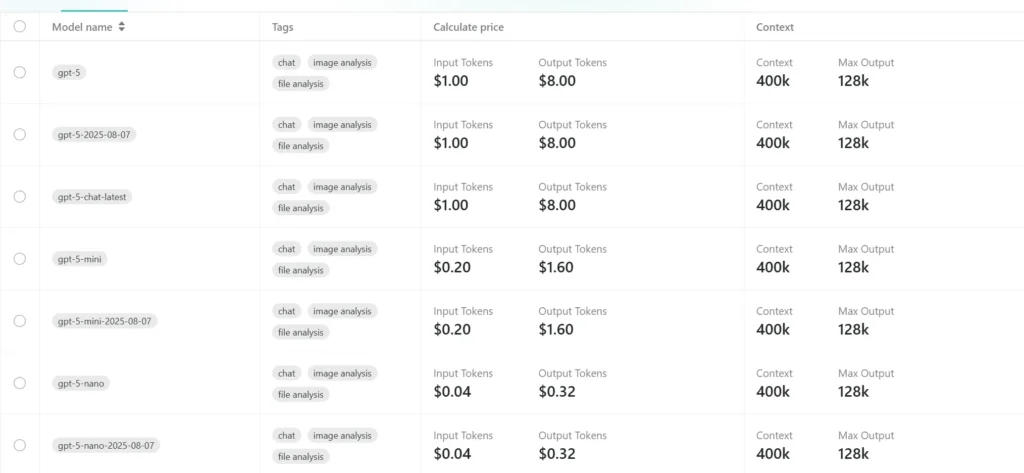

1. Qual variante do modelo GPT-5 você deve escolher e quanto aos tokens/preços?

CometAPI lista várias variantes do GPT-5 (padrão gpt-5, instantâneos de bate-papo como gpt-5-chat-latest, e versões menores, como gpt-5-mini/gpt-5-nano). Escolha de acordo com suas necessidades:

gpt-5/gpt-5-chat-latest— capacidade total para bate-papo geral, melhor em qualidade e raciocínio.gpt-5-mini/gpt-5-nano— menor custo e latência para tarefas de alto volume ou menor criticidade.

2. Como você deve arquitetar chamadas para grandes contextos e raciocínio de alta qualidade?

Contexto longo: O GPT-5 suporta janelas de contexto muito grandes. Ao enviar documentos grandes, divida a entrada em partes deliberadamente, use o aumento de recuperação (banco de dados vetorial + janela de contexto) e mantenha os max_tokens para saídas limitados para controlar o custo.

3. Quais medidas de segurança, privacidade e conformidade você deve aplicar?

Higiene da chave da API. Mantenha as chaves em variáveis de ambiente, rotacione-as regularmente e defina seu escopo sempre que possível. Não envie chaves para repositórios. (Melhores práticas são repetidas em guias de desenvolvedores.)

Residência e privacidade de dados. Leia a política de privacidade e os termos da CometAPI (e a política da OpenAI) antes de enviar dados pessoais, de saúde ou regulamentados confidenciais por meio de qualquer agregador terceirizado. Algumas empresas exigirão contratos diretos com fornecedores ou instâncias privadas.

Limites de taxas e proteções de cotas. Implemente disjuntores, backoff exponencial e verificações de cotas na produção para evitar custos descontrolados e falhas em cascata. Os painéis do CometAPI expõem o uso e as cotas — use-os para impor limites programáticos.