A divisão de IA da Alibaba Cloud foi lançada oficialmente Qwen‑VLo, a mais recente iteração da série de modelos multimodais Qwen, marcando um avanço significativo nos recursos unificados de visão e linguagem. Anunciado em 28 de junho de 2025, o Qwen-VLo oferece funcionalidades de compreensão e geração, indo muito além de seus antecessores e incluindo criação e edição de imagens em alta resolução, impulsionadas por comandos em linguagem natural e entradas visuais.

Com base em versões anteriores, como Qwen-VL e Qwen2.5-VL, o Qwen-VLo representa o que o Alibaba descreve como uma "atualização abrangente" em IA multimodal. Enquanto o Qwen-VL se concentrava principalmente na interpretação de informações visuais e o Qwen2.5-VL aprimorava a compreensão de contexto longo, o Qwen-VLo integra esses pontos fortes em uma única estrutura capaz de realizar tarefas bidirecionais de visão e linguagem. Ele acomoda instruções abertas, oferece suporte a vários idiomas — incluindo chinês e inglês — e refina seus resultados para rivalizar com os de artistas humanos.

Principais funcionalidades

Geração de imagem progressiva

O Qwen-VLo constrói imagens passo a passo — da esquerda para a direita e de cima para baixo — refinando iterativamente o conteúdo previsto para garantir consistência e harmonia visual. Esse mecanismo aumenta a eficiência da geração e o controle do usuário sobre o processo criativo.

Suporte de resolução dinâmica

Utilizando treinamento de resolução dinâmica, o modelo pode lidar com resoluções de entrada/saída e proporções de tela arbitrárias. Os usuários podem gerar conteúdo personalizado para diversos cenários — como banners para a web, capas para redes sociais ou pôsteres de alta resolução — sem a restrição de formatos fixos.

Edição de instruções abertas

Por meio de prompts em linguagem natural, o Qwen VLo pode realizar edições avançadas, como transferências de estilo ("Aplicar um estilo Van Gogh"), transformações compostas ("Adicionar um céu ensolarado") e modificações multifacetadas em uma única instrução. Ele também suporta a extração e a edição de sinais visuais tradicionais, como mapas de profundidade, máscaras de segmentação e contornos de arestas.

Interação multilíngue

O modelo aceita comandos em vários idiomas — atualmente com suporte para chinês e inglês — atendendo assim a uma base de usuários global e quebrando barreiras linguísticas em fluxos de trabalho criativos.

Disponibilidade e acesso

Qwen‑VLo está atualmente disponível em visualização através da plataforma Qwen Chat em bate-papo.qwen.aiO Alibaba Cloud observou que, como versão prévia, os usuários podem encontrar inconsistências ocasionais ou imprecisões factuais durante a geração. A equipe de desenvolvimento está iterando ativamente para corrigir essas limitações antes de uma implementação mais ampla.

Em segundo plano, os engenheiros de IA da Alibaba otimizaram o Qwen-VLo para implantação em ambientes de nuvem e edge. Aproveitando a quantização de precisão mista e novas técnicas de ajuste fino com eficiência de parâmetros, o modelo mantém alto desempenho em um espaço computacional compacto. A Alibaba também integrou pipelines de inferência adaptáveis para equilibrar latência e qualidade, garantindo que o Qwen-VLo possa atender a aplicativos sensíveis à latência — como ferramentas de design interativo — enquanto escala para cargas de trabalho de nível empresarial na Alibaba Cloud.

Comparado a Qwen-VL-Plus/Max

| Dimensão da função | Qwen-VL-Plus/Max | Qwen VLo |

|---|---|---|

| Compreensão da imagem | Classificação básica, descrição | Reconhecimento de estruturas multidimensionais, compreensão contextual aprimorada |

| Geração de Imagem | Suporte de estilo limitado | Alta precisão, geração progressiva, fortes capacidades de controle de estilo |

| Capacidade multitarefa | Requer entrada específica da tarefa | Multitarefa unificada, suporta instruções de linguagem complexas |

| Interação multilíngue | Suporte limitado | Suporte nativo para chinês e inglês, controle de linguagem natural mais suave |

| Capacidade de preservação de detalhes | Possível perda de detalhes na geração | Identificação e reconstrução precisas de estruturas e semânticas chave |

Começando a jornada

A CometAPI é uma plataforma de API unificada que agrega mais de 500 modelos de IA de provedores líderes — como a série GPT da OpenAI, a Gemini do Google, a Claude da Anthropic, a Midjourney e a Suno, entre outros — em uma interface única e amigável ao desenvolvedor. Ao oferecer autenticação, formatação de solicitações e tratamento de respostas consistentes, a CometAPI simplifica drasticamente a integração de recursos de IA em seus aplicativos. Seja para criar chatbots, geradores de imagens, compositores musicais ou pipelines de análise baseados em dados, a CometAPI permite iterar mais rapidamente, controlar custos e permanecer independente de fornecedores — tudo isso enquanto aproveita os avanços mais recentes em todo o ecossistema de IA.

Para começar, explore as capacidades dos modelos no Playground e consulte o Guia de API para obter instruções detalhadas. Antes de acessar, certifique-se de ter feito login no CometAPI e obtido a chave da API.

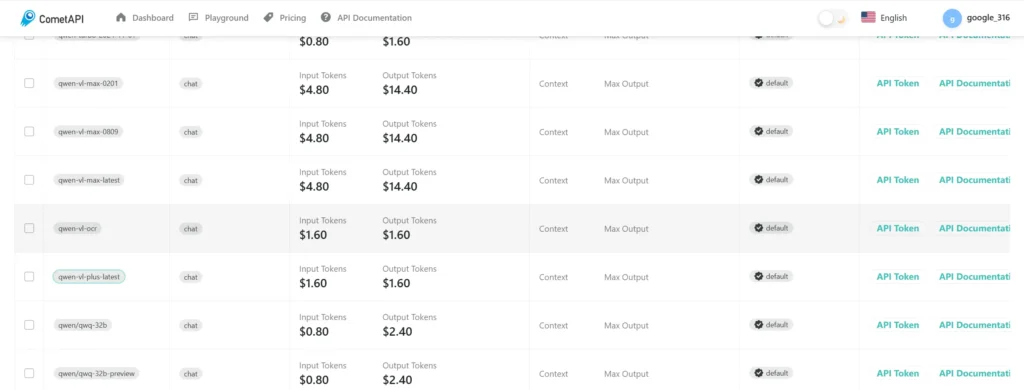

A mais recente integração Qwen-VLo API aparecerá em breve no CometAPI, então fique ligado! Enquanto finalizamos o upload do modelo Qwen-VLo, explore nossos outros modelos no Página de modelos ou experimentá-los no IA PlaygroundO modelo mais recente de Qwen no CometAPI é API Qwen 3(qwen3-235b-a22b;qwen3-30b-a3b;qwen3-8b) and qwen-vl-plus-latest.