O braço de pesquisa da ByteDance Seed lançou Seed3D 1.0, um modelo de base 3D de alta fidelidade e imagem única que produz malhas prontas para simulação, materiais PBR e texturas alinhadas — recursos projetados para serem conectados diretamente a mecanismos de física e simuladores de robótica. O lançamento visa preencher uma lacuna dolorosa: geração de conteúdo escalável (conteúdo visual diversificado) versus fidelidade à física exigida pela IA incorporada e treinamento em simulador.

O que é ByteDance Seed3D 1.0?

Seed3D 1.0 é um modelo de base 3D criado para converter uma única imagem RGB de um objeto ou ambiente em um pronto para simulação Pacote de ativos 3D — normalmente uma malha explícita e estanque, mapas de textura UV associados e parâmetros de material de renderização baseados em física (PBR). O modelo foi projetado não apenas para produzir geometria e texturas visualmente fiéis, mas também para gerar ativos que exigem pós-processamento mínimo antes de serem usados em simuladores como Isaac Sim, Unity ou Unreal Engine para robótica, treinamento ou geração de mundos virtuais.

Principais objetivos de design de alto nível:

- Entrada de imagem única: elimine a necessidade de hardware de captura ou digitalização multivisualização.

- Prontidão para simulação: garantir que a topologia, a escala e os materiais PBR sejam adequados para simulação física.

- Escalabilidade de cena: permite que objetos gerados sejam montados em cenas coerentes automaticamente.

- Integração: adaptação mínima aos mecanismos de física comuns e pipelines de tempo de execução.

Quais recursos o Seed3D 1.0 oferece?

Geometria de alta fidelidade (malhas estanques)

Seed3D produz geometria fechada e múltipla Projetado para tratamento preciso de colisões e física de contato confiável. O componente de geometria utiliza um VAE híbrido + transformador de difusão para produzir malhas que preservam o nível de detalhe e retêm detalhes estruturais finos, como saliências finas, furos e texto. O pipeline de extração de malha utiliza uma estratégia de cubos de marcha duplos/isosuperfícies hierárquicas para extrair superfícies de alta qualidade com eficiência. ()

Texturas fotorrealistas e materiais PBR

O pipeline de texturas produz mapas de albedo consistentes em múltiplas visualizações e texturas PBR completas (albedo, metálico, rugosidade), podendo produzir saídas de textura com resolução de até 4K. Esses mapas são projetados para que a iluminação se comporte fisicamente de forma plausível em mecanismos de renderização. Um módulo de pintura UV completa as regiões oclusas e garante coerência espacial em todo o atlas UV.

Simulação e prontidão do pipeline

As saídas são exportáveis para formatos comuns (OBJ/GLB). Os ativos gerados são intencionalmente pronto para simulação: eles se integram a simuladores de física onde malhas de colisão e parâmetros de atrito/rigidez podem ser derivados ou ajustados automaticamente, permitindo uso imediato em robótica ou motores de jogos. O Seed3D demonstra fluxos de trabalho que colocam ativos gerados no Isaac Sim para experimentos de manipulação.

Geração de cena e montagem fatorada

Além de objetos individuais, o Seed3D usa uma abordagem de geração de cena fatorada, na qual modelos de linguagem de visão inferem mapas de layout (posições, escalas, orientações) e o Seed3D sintetiza e posiciona objetos adequadamente, permitindo uma composição de cena coerente para interiores e layouts urbanos.

Resultado da avaliação de desempenho

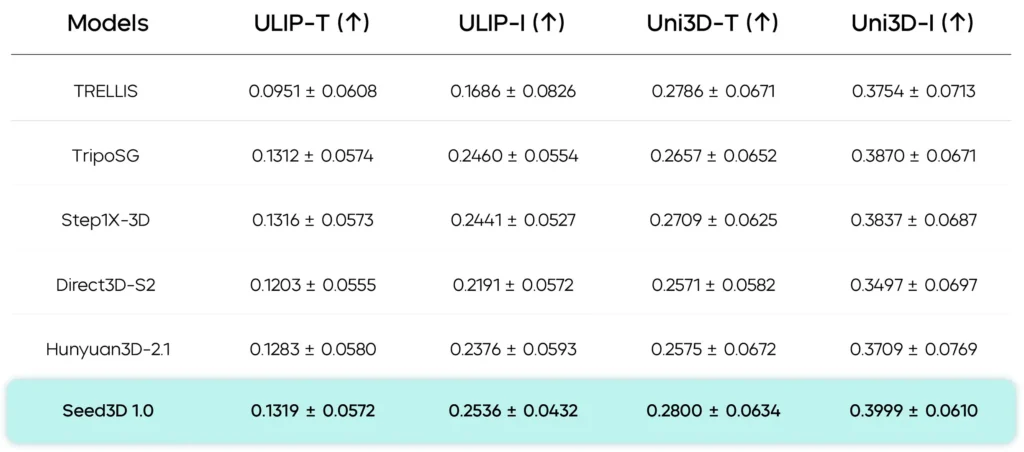

Geração de Geometria

Em benchmarks de geometria, o modelo geométrico de 1.5 bilhão de parâmetros do Seed3D 1.0 (Seed3D-DiT + VAE) alcança maior precisão estrutural e detalhes mais precisos em comparação com diversas linhas de base (TRELLIS, TripoSG, Step1X-3D, Direct3D-S2 e modelos grandes como Hunyuan3D-2.1). A arquitetura do Seed3D — difusão do espaço latente combinada com decodificação SDF cuidadosa e extração hierárquica de malhas — produz malhas com menos artefatos e melhor preservação da geometria de alta frequência (texto, pequenas saliências).

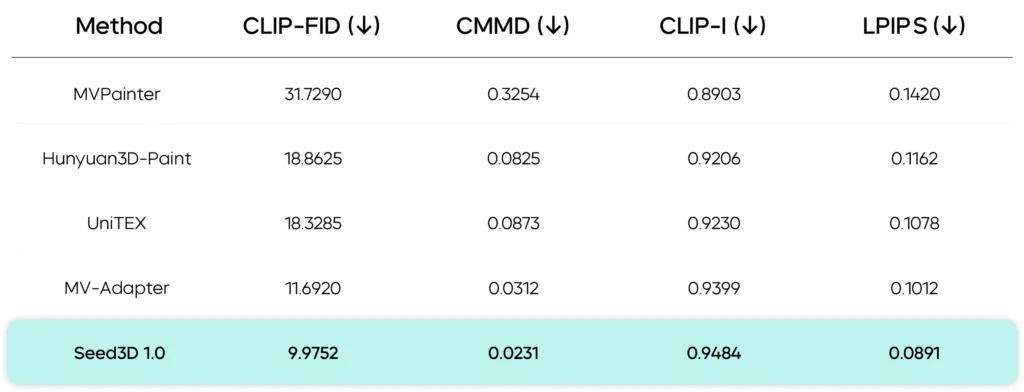

Geração de Textura

Para estimativas de textura e material, o Seed3D relata ganhos substanciais no alinhamento com imagens de referência e no realismo do material. A decomposição Seed3D-PBR e a pintura Seed3D-UV produzem atlas UV que preservam detalhes de textura de alta frequência e fornecem mapas PBR coerentes (albedo, metálico, rugosidade) adequados para renderização física.

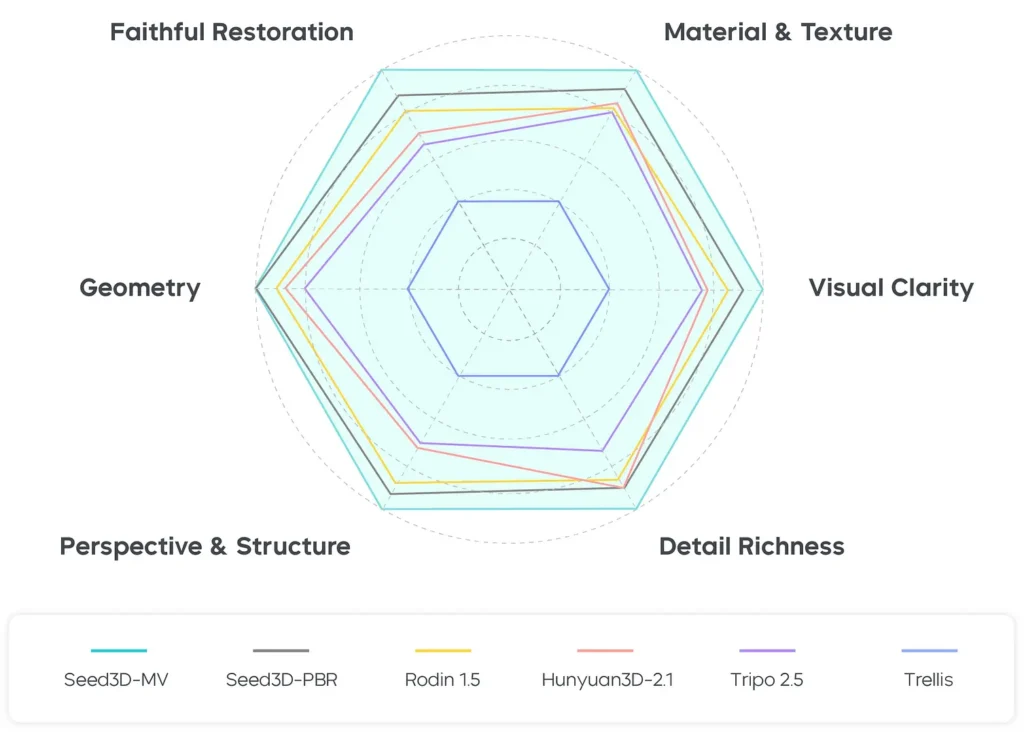

Avaliação Humana (Estudo do Usuário)

O artigo relata um estudo com 14 avaliadores humanos sobre um conjunto de testes de 43 imagens. Os avaliadores compararam diversos métodos em dimensões como clareza visual, restauração fiel, precisão geométrica, perspectiva e estrutura, realismo de material e textura e riqueza de detalhes. O Seed3D 1.0 recebeu avaliações subjetivas consistentemente mais altas nessas categorias, com as vantagens mais pronunciadas na geometria e na qualidade do material. O estudo humano corrobora os benchmarks quantitativos, mostrando que o realismo percebido e a adequação da simulação melhoraram em relação às linhas de base.

Como funciona o Seed3D 1.0 (arquitetura e pipeline)?

O Seed3D 1.0 é estruturado como um sistema multicomponente que combina representações de geometria latente aprendidas, redução de ruído baseada em transformadores em espaço latente e módulos de completação de textura e multivisualização. O design é intencionalmente modular, permitindo que cada componente seja otimizado e atualizado de forma independente.

Componentes principais

Seed3D-VAE (codificador/decodificador de geometria latente): Aprende uma representação latente compacta para geometria 3D (por exemplo, latente TSDF/malha). O VAE é treinado para reconstruir geometria estanque de alta resolução a partir de códigos latentes compactados. Isso fornece um gargalo eficiente para a etapa de geração.

Seed3D-DiT (transformador de difusão para geometria): Um transformador de fluxo retificado/redução de ruído (semelhante ao DiT) que opera no espaço latente da geometria aprendida. Condicionado à incorporação de uma imagem de referência, ele reduz iterativamente o ruído de tokens latentes em uma geometria latente que o VAE decodifica em uma malha explícita.

Seed3D-MV (síntese multivisualização) e Seed3D-UV (completamento de textura):Após a produção da geometria inicial, o sistema sintetiza múltiplas visualizações para reduzir a ambiguidade da oclusão e, em seguida, completa os mapas UV por meio de um módulo de pintura interna/aprimoramento UV para produzir texturas completas e coerentes.

Seed3D-PBR (decomposição de materiais): Decompõe texturas geradas em mapas PBR (metalicidade, rugosidade, mapas normais, etc.) para que respostas de sombreamento e contato fisicamente plausíveis sejam preservadas na simulação.

Modelo de Visão-Linguagem para fatoração de cena: Para a geração de cenas, o pipeline utiliza VLMs para detectar objetos, prever relações espaciais e produzir mapas de layout (posição, escala, orientação). Objetos individuais são gerados e então montados em uma cena de acordo com o mapa de layout. ()

Fluxo de inferência de alto nível

- Entrada: imagem RGB única → o codificador de imagem extrai a incorporação visual.

- Geração de geometria: Seed3D-DiT condicionado à incorporação reduz ruídos latentes de geometria → Seed3D-VAE decodifica a malha (à prova d'água).

- Síntese de múltiplas visualizações: gere visualizações sintéticas a partir do pipeline de malha + renderização para conclusão de textura.

- UV e textura: Seed3D-UV pinta oclusões e produz mapas UV completos → Seed3D-PBR decompõe texturas em mapas de materiais.

- Exportar: produzir .obj/.gltf com texturas e mapas de materiais, prontos para mecanismos de física (malhas de colisão, estimativa de escala por VLM).

Geração de Cena

O Seed3D não apenas gera objetos individuais, mas também gera automaticamente cenas completas.

Processo de geração:

- Entrada: Uma imagem contendo vários objetos;

- O modelo VLM identifica os objetos e as relações espaciais na imagem;

- O Seed3D gera a geometria e a textura para cada objeto;

- Por fim, o layout espacial é combinado para formar uma cena 3D completa.

Quais são as limitações e os desafios em aberto?

O Seed3D 1.0 é um passo importante, mas várias limitações permanecem — tanto intrínsecas à geração de imagens únicas quanto específicas aos contextos de simulação:

- Ambiguidade de visão única: inferir geometria oclusa e topologia exata a partir de uma visão é fundamentalmente mal formulado; antecedentes e estatísticas aprendidas ajudam, mas erros permanecem para regiões fortemente ocluídas.

- Correção física em escala: embora os ativos estejam “prontos para simulação” por muitas medidas práticas, a estimativa de massa/inércia de granulação fina e a dinâmica conjunta para sistemas articulados complexos ainda exigem ajuste específico de domínio.

- Materiais raros e microestrutura: materiais altamente especulares, translúcidos ou anisotrópicos (por exemplo, metais escovados, tecidos com dispersão subsuperficial) são mais difíceis de reproduzir com precisão a partir de uma única imagem.

- Vieses de dados: as fontes de dados de treinamento influenciam o que o modelo captura bem — objetos incomuns ou artefatos culturalmente específicos podem ser reproduzidos de maneira inadequada.

- Propriedade intelectual e ética: como acontece com todos os sistemas generativos, criadores e organizações devem considerar a propriedade intelectual e a procedência ao converter imagens protegidas por direitos autorais em ativos 3D.

Cenário de aplicação

Seed3D está explicitamente posicionado para IA incorporada e simulação casos de uso, mas as implicações abrangem vários setores:

- Treinamento em robótica e RL: geração rápida de conteúdo para benchmarks de manipulação, currículos de treinamento e conjuntos de dados randomizados por domínio para transferência de simulação para realidade. A prontidão física dos ativos reduz o atrito do pré-processamento.

- Desenvolvimento de jogos e XR: criação acelerada de ativos para protótipos, adereços de fundo ou cenas inteiras; os fluxos de trabalho PBR e texturas 4K são particularmente úteis para experiências de alta fidelidade.

- Produção e visualização virtual: geração rápida de adereços e elementos de ambiente para concepção ou pré-visualização.

- Pipelines de criação de conteúdo: os designers podem iterar de referências 2D (fotos, arte) para protótipos 3D muito mais rápido, permitindo fluxos de trabalho híbridos de humanos e IA, onde os artistas ajustam os resultados. ()

- Pesquisa: geração em larga escala de diversos dados de treinamento 3D para modelos de visão-linguagem-ação e outras pesquisas multimodais. O artigo enquadra explicitamente o Seed3D como uma ferramenta para o avanço da escala de simuladores mundiais e da pesquisa de inteligência incorporada.

O Seed3D pode converter uma única foto em um objeto 3D detalhado, adequado para simulação e uso interativo, o que amplia o acesso à criação de conteúdo 3D de alta qualidade.

Conclusão

O Seed3D 1.0 da ByteDance representa um passo significativo em direção geração 3D escalável e de nível de simulação a partir de entradas 2D simples. Ao combinar um pipeline de geometria focada (VAE + DiT), estimativa robusta de textura/PBR e complementação UV, o sistema produz ativos fotorrealistas e imediatamente úteis em simuladores de física — uma combinação que aborda um gargalo persistente para pesquisas com IA incorporada e muitos pipelines aplicados. O desempenho SOTA relatado do modelo (geometria e textura) e os resultados positivos da avaliação humana o tornam um forte concorrente no cenário generativo 3D em rápida evolução.

Começando a jornada

A CometAPI é uma plataforma de API unificada que agrega mais de 500 modelos de IA de provedores líderes — como a série GPT da OpenAI, a Gemini do Google, a Claude da Anthropic, a Midjourney e a Suno, entre outros — em uma interface única e amigável ao desenvolvedor. Ao oferecer autenticação, formatação de solicitações e tratamento de respostas consistentes, a CometAPI simplifica drasticamente a integração de recursos de IA em seus aplicativos. Seja para criar chatbots, geradores de imagens, compositores musicais ou pipelines de análise baseados em dados, a CometAPI permite iterar mais rapidamente, controlar custos e permanecer independente de fornecedores — tudo isso enquanto aproveita os avanços mais recentes em todo o ecossistema de IA.

Os desenvolvedores podem acessar o modelo 3D e outros modelos do ByteDance, como API do Seedream 4.0 através do CometAPI, a versão mais recente do modelo está sempre atualizado com o site oficial. Para começar, explore as capacidades do modelo no Playground e consulte o Guia de API para obter instruções detalhadas. Antes de acessar, certifique-se de ter feito login no CometAPI e obtido a chave da API. CometAPI oferecem um preço muito mais baixo que o preço oficial para ajudar você a se integrar.

Pronto para ir?→ Inscreva-se no CometAPI hoje mesmo !

Se você quiser saber mais dicas, guias e novidades sobre IA, siga-nos em VK, X e Discord!