A DeepSeek apresentou oficialmente o V4 como uma família de modelos open-source, e a manchete não é apenas “mais uma atualização de modelo”. A empresa posiciona o V4 como um sistema de longo contexto, amigável a agentes, construído para cargas de trabalho reais: análises intensivas de documentos, assistentes de código, agentes de busca e automação em múltiplas etapas. O lançamento está ativo na web, app e API, e a linha V4 introduz uma janela de contexto de 1M tokens de baixo custo em seus serviços oficiais.

O que torna este lançamento especialmente relevante é a combinação de escala e eficiência. A DeepSeek afirma que o V4-Pro possui 1.6T de parâmetros totais, com 49B ativos, enquanto o V4-Flash possui 284B de parâmetros totais, com 13B ativos. No relatório técnico, a DeepSeek também afirma que a arquitetura V4 usa atenção híbrida, roteamento MoE e pós-treinamento projetado para melhorar o comportamento de agente enquanto reduz a carga computacional de contexto ultra-longo.

O que é DeepSeek V4?

DeepSeek-V4 é a mais recente família flagship em prévia da empresa, e o lançamento inclui duas variantes públicas: V4-Pro e V4-Flash. A DeepSeek descreve o V4-Pro como o modelo mais forte para conhecimento de mundo, matemática, STEM, programação e codificação orientada a agentes, enquanto o V4-Flash é a opção mais responsiva e econômica que ainda mantém boa parte da qualidade de raciocínio e a capacidade de longo contexto. O V4-Pro lidera os modelos abertos atuais em codificação orientada a agentes e conhecimento de mundo, enquanto o V4-Flash é projetado para velocidade e implantação econômica.

O V4 utiliza uma arquitetura de atenção híbrida combinando Compressed Sparse Attention (CSA) e Heavily Compressed Attention (HCA), além de Manifold-Constrained Hyper-Connections e o otimizador Muon. A empresa também afirma que os modelos foram pré-treinados em mais de 32T tokens e que, em contexto de 1M, o V4-Pro precisa de apenas 27% dos FLOPs de inferência por token único e 10% do cache KV em comparação com o DeepSeek-V3.2. Essa história de eficiência é a verdadeira manchete por trás do lançamento.

DeepSeek-V4-Pro vs DeepSeek-V4-Flash

DeepSeek-V4-Pro

V4-Pro é o modelo flagship para usuários que priorizam a qualidade. DeepSeek-V4-Pro oferece desempenho mais forte em codificação orientada a agentes, conhecimento de mundo mais rico e raciocínio de classe mundial, liderando os modelos abertos atuais e ficando atrás apenas do Gemini-3.1-Pro em conhecimento de mundo, segundo a página de lançamento. No relatório técnico, V4-Pro é o maior modelo da família, e o DeepSeek-V4-Pro está disponível pelas mesmas interfaces compatíveis com OpenAI e Anthropic que o V4-Flash.

DeepSeek-V4-Flash

V4-Flash é o modelo voltado à eficiência; suas capacidades de raciocínio se aproximam de V4-Pro e ele atua de forma equivalente ao V4-Pro em tarefas simples de agentes, usando um número menor de parâmetros ativos e tempos de resposta mais rápidos. Oferece tanto os modos “thinking” quanto “non-thinking”, com o mesmo comprimento de contexto de 1M e os mesmos recursos principais do Pro, porém a custo muito menor.

Qual escolher?

Use V4-Pro quando a tarefa for crítica, pesada em conhecimento ou difícil de verificar: pesquisa corporativa, programação complexa, suporte a decisões em múltiplas etapas ou tarefas onde você quer a resposta mais forte possível. Use V4-Flash quando vazão, latência ou custo de tokens importarem mais do que extrair os últimos pontos de desempenho em benchmarks. Essa escolha é consistente com o posicionamento oficial e com as diferenças reportadas entre os dois modelos.

| Item | DeepSeek-V4-Flash | DeepSeek-V4-Pro |

|---|---|---|

| Total parameters | 284B | 1.6T |

| Active parameters | 13B | 49B |

| Context length | 1M | 1M |

| Reasoning modes | Non-think + think | Non-think + think |

| Best fit | Inferência rápida, apps de alta vazão, agentes sensíveis a custo | Raciocínio de maior capacidade, tarefas mais difíceis de código e conhecimento |

| Official API pricing | Acerto de cache $0.028 / falta de cache $0.14 / saída $0.28 por 1M tokens | Acerto de cache $0.145 / falta de cache $1.74 / saída $3.48 por 1M tokens |

| Max output | 384K | 384K |

CometAPI oferece acesso a Deepseek v4 Pro e V4 Flash, —20% mais barato que o oficial— além de troca contínua entre 500+ modelos (GPT-5.4, Gemini 3.1, etc.) por um único endpoint compatível com OpenAI ou Anthropic Messages.

Benchmark de desempenho

DeepSeek-V3.2 vs V4-Flash vs V4-Pro

Na tabela de comparação de modelos base, V4-Flash e V4-Pro superam DeepSeek-V3.2 em benchmarks centrais, com V4-Pro geralmente na frente. Por exemplo, o relatório lista as seguintes pontuações: AGIEval 82.6 / 83.1 vs 80.1 do V3.2; MMLU 88.7 / 90.1 vs 87.8; MMLU-Pro 68.3 / 73.5 vs 65.5; HumanEval 69.5 / 76.8 vs 62.8; e LongBench-V2 44.7 / 51.5 vs 40.2 para o V3.2, onde o número do meio é V4-Flash e o último é V4-Pro.

| Benchmark | DeepSeek-V3.2-Base | DeepSeek-V4-Flash-Base | DeepSeek-V4-Pro-Base |

|---|---|---|---|

| AGIEval (EM) | 80.1 | 82.6 | 83.1 |

| MMLU (EM) | 87.8 | 88.7 | 90.1 |

| MMLU-Pro (EM) | 65.5 | 68.3 | 73.5 |

| HumanEval (Pass@1) | 62.8 | 69.5 | 76.8 |

| LongBench-V2 (EM) | 40.2 | 44.7 | 51.5 |

Fonte: Relatório técnico de DeepSeek-V4, Tabela 1.

O padrão é claro: Flash reduz a distância em relação ao Pro, mas Pro ainda é o modelo geral mais forte. Isso torna o V4-Flash o padrão prático para muitos sistemas de produção, enquanto V4-Pro é o modelo para recorrer quando a qualidade da resposta importa mais do que custo ou latência.

Comparações com modelos ocidentais: onde V4 se encaixa

Em uma avaliação humana em tarefas de colarinho branco em chinês, o relatório diz que DeepSeek-V4-Pro-Max superou Claude Opus 4.6-Max, com 63% de taxa de não-perda. DeepSeek-V4-Pro “supera significativamente” Claude Sonnet 4.5 e se aproxima de Claude Opus 4.5 em um benchmark de codificação de P&D.

| Área de avaliação | Resultado DeepSeek | Comparação com modelos ocidentais | O que sugere |

|---|---|---|---|

| Tarefas de colarinho branco em chinês | V4-Pro-Max, 63% taxa de não-perda | vs Claude Opus 4.6-Max | Forte desempenho em tarefas práticas de negócios |

| Benchmark de codificação de P&D | V4-Pro-Max taxa de aprovação 67 | vs Claude Sonnet 4.5 em 47; Opus 4.5 em 70; Opus 4.6 Thinking em 80 | Competitivo com modelos de fronteira líderes, especialmente contra sistemas Sonnet |

Não é “número um em todos os aspectos”, mas já está em um nível que “deve ser seriamente avaliado”.

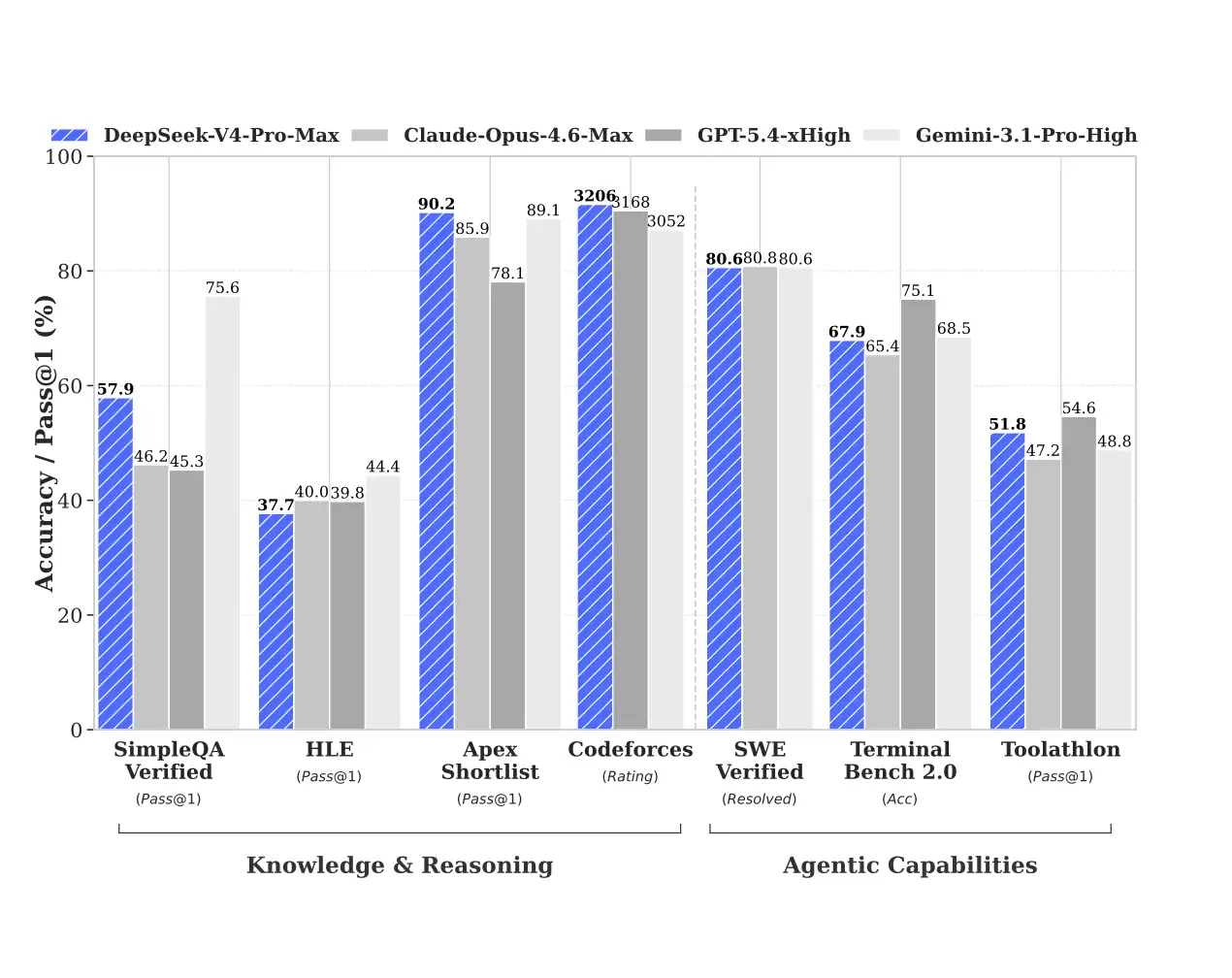

O relatório técnico da DeepSeek compara V4-Pro-Max com Claude Opus 4.6 Max, GPT-5.4 xHigh e Gemini 3.1 Pro High na mesma tabela. Os resultados não são simplistas: modelos ocidentais fechados ainda têm desempenho forte em alguns aspectos de conhecimento e inferência; no entanto, V4-Pro-Max tem presença muito forte em código, contextos longos e algumas tarefas de agentes. Em outras palavras, já não é uma narrativa unidimensional de “alternativas domésticas”, mas entrou na fase de “qual é mais adequado ao seu cenário”.

Em termos de conhecimento e capacidade de raciocínio, está no nível de Opus 4.6 Max, GPT-5.4 xHigh e Gemini 3.1 Pro High. No entanto, fica ligeiramente atrás em capacidades de agente, embora a diferença não seja significativa.

DeepSeek-V4-Pro-Max é altamente competitivo em cenários voltados a código e contexto longo, enquanto os modelos ocidentais ainda parecem extremamente fortes em vários benchmarks de raciocínio puro e conhecimento. Essa é a forma correta de ler o lançamento: DeepSeek V4 está firmemente na conversa de fronteira, mas a liderança em benchmarks continua dependente da tarefa.

Como acessar o DeepSeek V4

1) Use o site e o app oficiais

A DeepSeek afirma que V4 Preview está disponível agora na web, app e API. Para usuários comuns, o caminho mais simples ainda é a interface de chat oficial, onde o modelo pode ser acessado por Expert Mode ou Instant Mode.

2) Use a API

Eu recomendo fortemente o CometAPI para acessar o DeepSeek V4, porque oferece o melhor preço e vantagens de agregação.

Os nomes dos modelos são:

deepseek-v4-flashdeepseek-v4-pro

A DeepSeek também afirma que os nomes legados

deepseek-chatedeepseek-reasonerserão descontinuados e atualmente mapeiam para os modos non-thinking e thinking do V4-Flash até 2026-07-24. Isso é importante para o planejamento de migração se você já tiver integrações antigas em produção.

- Cadastre-se no CometAPI e obtenha sua chave de API.

- Use o SDK Python padrão do OpenAI (ou qualquer cliente compatível) com um base URL personalizado:

Aqui está um exemplo simples usando o formato compatível com OpenAI oficial:

import os

from openai import OpenAIclient = OpenAI(

api_key=os.environ["cometapi_API_KEY"],

base_url="https://api.cometapi.com"

)response = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{"role": "system", "content": "Você é um assistente prestativo."},

{"role": "user", "content": "Resuma os benefícios de um contexto de um milhão de tokens."}

],

extra_body={"thinking": {"type": "enabled"}},

reasoning_effort="high"

)print(response.choices[0].message.content)

Esse padrão de requisição segue as orientações de início rápido: defina o base URL, escolha deepseek-v4-pro ou deepseek-v4-flash, e habilite thinking quando precisar de raciocínio mais profundo.

Como usar o DeepSeek V4 de forma eficaz

Para fluxos com documentos longos, o padrão mais forte é manter o contexto limpo e estruturado. A janela de 1M tokens é uma grande vantagem, mas o modelo ainda tem melhor desempenho quando a entrada está organizada em seções, trechos de origem, instruções de tarefa e restrições explícitas de saída. Essa é a forma mais natural de explorar a capacidade de longo contexto que a DeepSeek está promovendo.

Para fluxos de código e agentes, comece com V4-Flash para iteração rápida, e depois escale para V4-Pro na execução final ou nos passos mais difíceis. Essa abordagem se encaixa no posicionamento oficial: Flash é a opção eficiente, Pro é o modelo mais forte, e ambos compartilham a mesma superfície de API e comprimento de contexto.

Considerações finais

DeepSeek-V4 é notável porque combina quatro coisas que o mercado tem pedido ao mesmo tempo: contexto longo, raciocínio forte, disponibilidade aberta e preços agressivos. A verdadeira história não é apenas que a DeepSeek lançou outro modelo. É que a empresa está tentando tornar a IA de fronteira economicamente utilizável em produção. Para equipes avaliando onde colocar sua próxima aposta em IA, isso é um sinal que vale a pena testar, não ignorar.

Para equipes que constroem com múltiplos provedores, este é exatamente o tipo de lançamento que vale a pena comparar dentro do seu próprio stack. CometAPI pode ser a camada prática para comparar DeepSeek-V4 ao lado de outros modelos de fronteira sem forçar sua equipe de produto a reconstruir a integração sempre que o mercado muda.