Gemini 3 Pro (Preview) é o mais novo modelo carro-chefe de raciocínio multimodal da família Gemini 3 da Google/DeepMind. Ele é apresentado como o “modelo mais inteligente até agora”, projetado para raciocínio profundo, fluxos de trabalho com agentes, codificação avançada e compreensão multimodal de longo contexto (texto, imagens, áudio, vídeo, código e integrações de ferramentas).

Principais recursos

- Modalidades: Texto, imagem, vídeo, áudio, PDFs (e saídas estruturadas de ferramentas).

- Agentes/ferramentas: Chamada de função integrada, pesquisa como ferramenta, execução de código, contexto de URL e suporte para orquestrar agentes de múltiplas etapas. O mecanismo de “assinatura de pensamento” preserva o raciocínio multietapas entre chamadas.

- Programação e “vibe coding”: Otimizado para geração de front-end, geração de interfaces interativas e programação com agentes (lidera os rankings relevantes relatados pela Google). É divulgado como seu modelo mais forte de “vibe coding” até agora.

- Novos controles para desenvolvedores:

thinking_level(low|high) para equilibrar custo/latência versus profundidade de raciocínio, emedia_resolutionpara controlar a fidelidade multimodal por imagem ou quadro de vídeo. Esses controles ajudam a equilibrar desempenho, latência e custo.

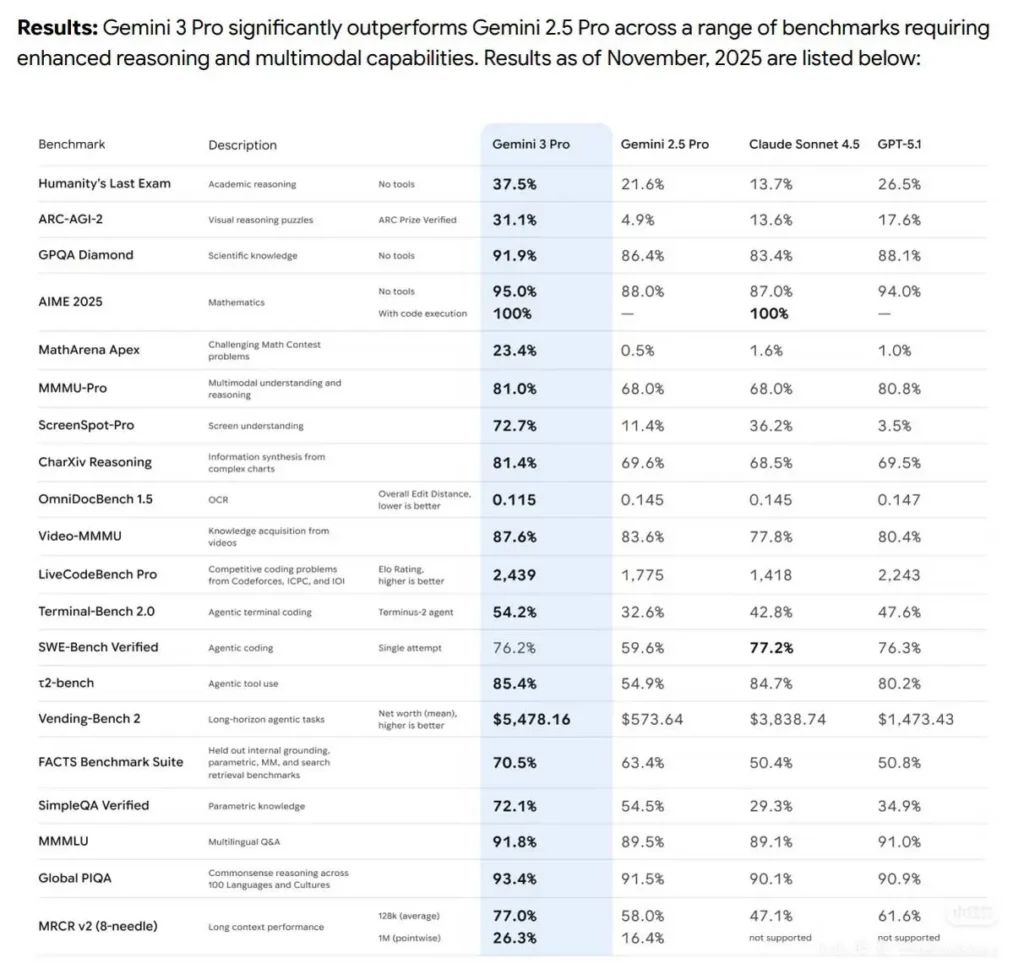

Desempenho em benchmarks

- O Gemini3Pro conquistou o primeiro lugar no LMARE com pontuação de 1501, superando os 1484 pontos do Grok-4.1-thinking e também liderando o Claude Sonnet 4.5 e o Opus 4.1.

- Também ficou em primeiro lugar na arena de programação WebDevArena com pontuação de 1487.

- Em Humanity’s Last Exam (raciocínio acadêmico), obteve 37.5% (sem ferramentas); em GPQA Diamond (ciências), 91.9%; e na competição de matemática MathArena Apex, 23.4%, estabelecendo um novo recorde.

- Em capacidades multimodais, obteve 81% no MMMU-Pro; e 87.6% no Video-MMMU (compreensão de vídeo).

Detalhes técnicos e arquitetura

- Parâmetro “thinking level”: O Gemini 3 expõe um controle

thinking_levelque permite aos desenvolvedores equilibrar a profundidade do raciocínio interno versus latência/custo. O modelo tratathinking_levelcomo uma permissão relativa para raciocínio interno multietapas, e não como uma garantia estrita de tokens. O padrão é geralmentehighpara o Pro. Este é um novo controle explícito para ajustar o planejamento multietapas e a profundidade da cadeia de pensamento. - Saídas estruturadas e ferramentas: O modelo suporta saídas JSON estruturadas e pode ser combinado com ferramentas integradas (Google Search com grounding, contexto de URL, execução de código, etc.). Alguns recursos de saídas estruturadas + ferramentas estão em preview apenas para

gemini-3-pro-preview. - Integrações multimodais e com agentes: O Gemini 3 Pro é construído explicitamente para fluxos de trabalho com agentes (ferramentas + múltiplos agentes em código/terminais/navegador).

- Aceita entradas de texto, imagem, vídeo, áudio e PDF; saída em texto.

Limitações e advertências conhecidas

- Factualidade não perfeita — alucinações ainda são possíveis. Apesar das melhorias alegadas pela Google, verificação fundamentada e revisão humana continuam necessárias em cenários críticos (jurídico, médico, financeiro).

- Desempenho em contextos longos varia conforme a tarefa. O suporte a uma janela de entrada de 1M é uma capacidade concreta, mas a efetividade empírica pode cair em alguns benchmarks em comprimentos extremos (observadas quedas pontuais em 1M em alguns testes de contexto longo).

- Compensações de custo e latência. Contextos grandes e configurações mais altas de

thinking_levelaumentam computação, latência e custo; preços por níveis se aplicam com base em volumes de tokens. Usethinking_levele estratégias de fragmentação para gerenciar custos. - Segurança e filtros de conteúdo. A Google continua aplicando políticas de segurança e camadas de moderação; certos conteúdos e ações permanecem restritos ou acionarão modos de recusa.

Como o Gemini 3 Pro Preview se compara a outros modelos de ponta

Comparação em alto nível (preview → qualitativa):

Em relação ao Gemini 2.5 Pro: Melhorias significativas em raciocínio, uso de ferramentas por agentes e integração multimodal; manuseio de contexto muito maior e melhor compreensão de textos longos. A DeepMind apresenta ganhos consistentes em raciocínio acadêmico, codificação e tarefas multimodais.

Em relação ao GPT-5.1 e ao Claude Sonnet 4.5 (conforme relatado): No conjunto de benchmarks da Google/DeepMind, o Gemini 3 Pro é apresentado como líder em várias métricas de agentes, multimodalidade e contexto longo (ver Terminal-Bench, MMMU-Pro, AIME). Os resultados comparativos variam por tarefa.

Casos de uso típicos e de alto valor

- Resumo e perguntas/respostas de documentos/livros grandes: o suporte a contextos longos o torna atraente para equipes jurídicas, de pesquisa e de conformidade.

- Compreensão e geração de código na escala de repositórios: integração com toolchains de programação e raciocínio aprimorado ajudam em refatorações de grandes bases de código e fluxos automatizados de revisão de código.

- Assistentes de produto multimodais: fluxos com imagem + texto + áudio (suporte ao cliente que ingere capturas de tela, trechos de chamadas e documentos).

- Geração e edição de mídia (foto → vídeo): recursos anteriores da família Gemini agora incluem capacidades estilo Veo/Flow de foto → vídeo; o preview sugere geração multimídia mais profunda para protótipos e fluxos de trabalho de mídia.

Como chamar a API gemini-3-pro-preview a partir da CometAPI

Preços do Gemini 3 Pro Preview na CometAPI, 20% de desconto em relação ao preço oficial:

| Tokens de entrada | $1.60 |

| Tokens de saída | $9.60 |

Etapas necessárias

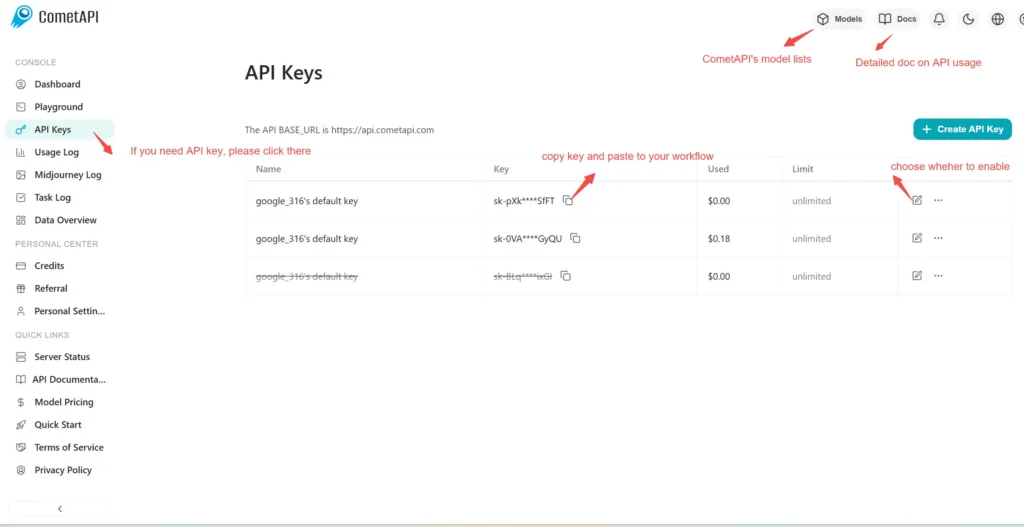

- Faça login em cometapi.com. Se ainda não for usuário, registre-se primeiro.

- Entre no seu CometAPI console.

- Obtenha a chave de API de credenciais de acesso da interface. Clique em “Add Token” na seção de API token no centro pessoal, obtenha a chave de token: sk-xxxxx e envie.

Método de uso

- Selecione o endpoint “

gemini-3-pro-preview” para enviar a solicitação de API e configure o corpo da requisição. O método e o corpo da requisição são obtidos na documentação da API em nosso site. Nosso site também oferece testes no Apifox para sua conveniência. - Substitua <YOUR_API_KEY> pela sua chave real da CometAPI da sua conta.

- Insira sua pergunta ou solicitação no campo content — é a isso que o modelo responderá.

- Processe a resposta da API para obter a resposta gerada.

A CometAPI fornece uma API REST totalmente compatível — para migração sem atritos. Detalhes-chave para Chat:

- Base URL: v1/chat/completions

- Nomes de modelos:

gemini-3-pro-preview - Autenticação: cabeçalho

Bearer YOUR_CometAPI_API_KEY - Content-Type:

application/json

Veja também GPT-5.1 API