A Google DeepMind lançou oficialmente o Gemma 4 em 2 de abril de 2026, marcando um marco importante na IA de código aberto. Esta família de modelos oferece inteligência de nível de fronteira por parâmetro, construída a partir da mesma pesquisa e tecnologia que alimentam o Gemini 3. Diferentemente das versões anteriores do Gemma com licenças personalizadas, o Gemma 4 é distribuído sob a licença Apache 2.0 totalmente permissiva, permitindo uso comercial irrestrito, modificação e redistribuição.

O Gemma 4 se destaca por suas capacidades multimodais (entradas de texto + imagem em todos os tamanhos, além de áudio nos modelos de borda), suporte nativo a raciocínio avançado e fluxos de trabalho agentivos, janelas de contexto longas de até 256K tokens e otimização para tudo, desde smartphones e Raspberry Pi até GPUs de alto desempenho. Ele oferece suporte a mais de 140 idiomas e enfatiza a eficiência, tornando uma IA poderosa acessível em hardware de consumo e de borda, sem dependência da nuvem.

CometAPI oferece excelentes APIs para modelos de código aberto e fechado.

O que é o Gemma 4?

O Gemma 4 é a mais recente família de modelos de linguagem grandes (LLMs) multimodais abertos da Google DeepMind, projetada para raciocínio avançado, fluxos de trabalho de IA agentiva e implantação eficiente no dispositivo. Ele maximiza a “inteligência por parâmetro” aproveitando insights da pesquisa proprietária do Gemini 3, mantendo-se totalmente de pesos abertos e código aberto.

Principais avanços em relação aos modelos Gemma anteriores incluem:

- Multimodalidade nativa: Compreensão de texto + imagem (todos os modelos), com suporte a áudio em variantes menores de borda.

- Modo de pensamento configurável: Raciocínio passo a passo com saída estruturada <|think|>.

- Chamada de funções e uso de ferramentas nativos: Ideal para agentes autônomos.

- Contexto estendido: Até 256K tokens nos modelos maiores.

- Arquitetura de atenção híbrida: Combina janela deslizante local e atenção global para eficiência e desempenho em contextos longos.

- Embeddings por Camada (PLE) nos modelos menores e cache KV compartilhado para economia de memória.

- Amplo suporte multilíngue: Pré-treinado com dados cobrindo 140+ idiomas, com consciência de nuances culturais.

Lançado sob Apache 2.0, o Gemma 4 remove restrições de licenciamento anteriores que limitavam a adoção empresarial. Desenvolvedores agora podem ajustar, implantar e comercializar sem fricção—posicionando-o como um concorrente direto de ecossistemas totalmente abertos como Llama e Qwen.

O Gemma 4 mira hardware diverso: dispositivos de borda (telefones, IoT, Raspberry Pi, Jetson Nano) para IA offline de baixa latência, e estações de trabalho/GPUs para servidores locais de alto desempenho. Esse design “local-first” prioriza privacidade, economia de custos e inferência com latência zero.

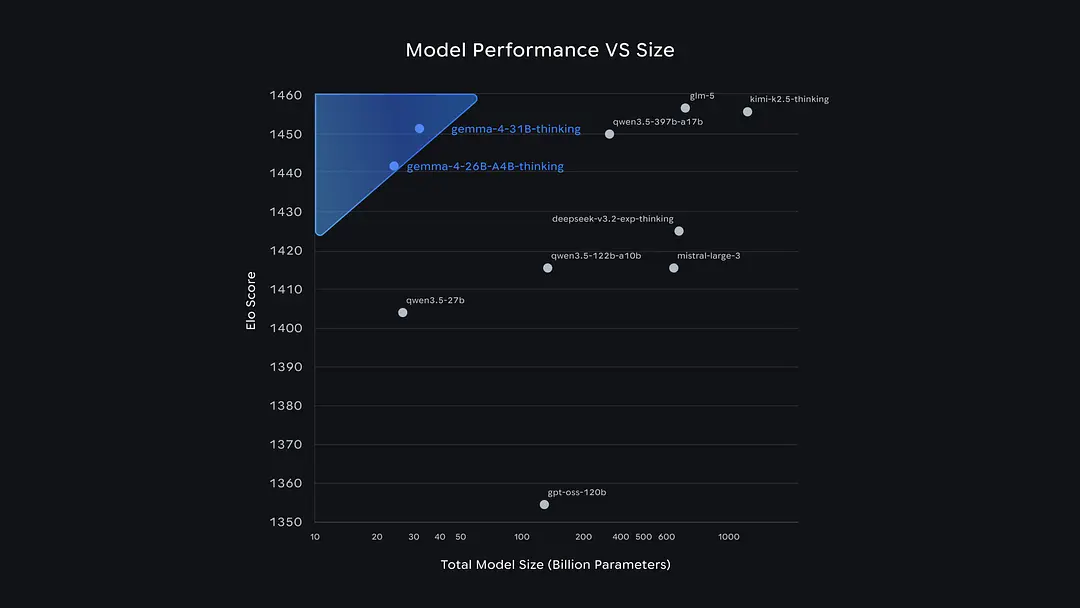

Os modelos de código aberto que o superam no ranking da Arena são principalmente de equipes chinesas. O Gemma 4 não é muito diferente do Qwen 3.5 e do GLM-5, mas é significativamente diferente do GPT-OSS-120B da OpenAI.

Os desenvolvedores agora podem encontrar GLM-5, Qwen 3.5, etc. na CometAPI.

As quatro versões do Gemma 4

A Google lançou o Gemma 4 em quatro tamanhos cuidadosamente otimizados, cada um equilibrando desempenho, eficiência e cenários de implantação. Dois usam arquiteturas densas com inovadores Embeddings por Camada (PLE) para eficiência na borda; um é um Mixture-of-Experts (MoE) para alto desempenho com baixo custo de parâmetros ativos; e um é um modelo denso de referência.

| Modelo | Arquitetura | Parâmetros totais | Parâmetros ativos (MoE) | Parâmetros efetivos | Comprimento de contexto | Modalidades | Hardware alvo |

|---|---|---|---|---|---|---|---|

| Gemma 4 E2B | Denso + PLE | ~5.1B (incl. embeddings) | N/A | 2.3B | 128K | Texto, Imagem, Áudio | Smartphones, Raspberry Pi, IoT de borda |

| Gemma 4 E4B | Denso + PLE | ~8B (incl. embeddings) | N/A | 4.5B | 128K | Texto, Imagem, Áudio | Dispositivos móveis, GPUs leves, Jetson |

| Gemma 4 26B A4B | MoE (8 ativas / 128 totais + 1 compartilhada) | 25.2B | 3.8B–4B | N/A | 256K | Texto, Imagem | Estações de trabalho, GPUs de consumo, servidores locais |

| Gemma 4 31B | Denso | 30.7B | N/A | N/A | 256K | Texto, Imagem | GPUs de alto desempenho (cabe em uma única H100/A100 em FP16) |

Gemma 4 E2B e E4B (otimizados para borda): Usam PLE para adicionar especialização por camada com sobrecarga mínima de parâmetros. Ideais para dispositivos alimentados por bateria ou com restrições de memória. O codificador de áudio (Conformer no estilo USM, ~300M parâmetros) habilita reconhecimento de fala e tradução fala-para-texto.

Gemma 4 26B A4B (MoE): Ativa apenas ~4B parâmetros durante a inferência, apesar de mais de 25B no total. Entrega desempenho próximo ao 31B a um custo computacional dramaticamente menor—perfeito para escalonamento econômico.

Gemma 4 31B (Denso): A referência para capacidade máxima. Cabe em uma única GPU de 80GB em precisão total e está entre os melhores modelos abertos nos rankings.

Todos os modelos incluem variantes ajustadas por instruções (“-it”) otimizadas para chat, raciocínio e uso de ferramentas, além de versões base pré-treinadas para fine-tuning. Os dois modelos grandes adotam abordagens diferentes: o modelo Denso 31B busca qualidade máxima e serve como a melhor base para fine-tuning; o modelo MoE 26B prioriza velocidade, ativando apenas 3.8 bilhões de parâmetros durante a inferência, resultando em geração de palavras muito mais rápida, mas com qualidade geral ligeiramente inferior.

Os dois modelos menores, E2B e E4B, são projetados especificamente para telefones celulares e dispositivos IoT: podem rodar completamente offline, economizando memória e energia. Além disso, esses modelos menores possuem uma capacidade que os maiores não têm: entrada de áudio nativa, permitindo reconhecimento de fala direto.

Capacidades centrais do Gemma 4

O Gemma 4 se destaca nas áreas que mais importam para aplicações reais de IA:

1. Raciocínio avançado e Modo de pensamento

Raciocínio passo a passo configurável via prompts de sistema ou enable_thinking=True. Produz tags estruturadas <|think|> seguidas de respostas finais. Melhora drasticamente o desempenho em tarefas complexas sem fine-tuning adicional.

2. Compreensão multimodal

- Visão: Detecção de objetos (caixas delimitadoras JSON), OCR (multilíngue), análise de documentos/PDF, compreensão de gráficos, compreensão de interfaces, reconhecimento de escrita manual e tratamento de imagens com resolução variável (orçamentos de tokens: 70–1120 tokens).

- Vídeo: Até 60 segundos (processamento de quadros a 1 fps).

- Áudio (apenas E2B/E4B): Reconhecimento automático de fala (ASR) e tradução fala-para-texto (máx. 30s).

- Entradas intercaladas: Misture texto, imagens e áudio em qualquer ordem.

3. Fluxos de trabalho agentivos e chamadas de função

Suporte nativo ao uso de ferramentas permite agentes autônomos para planejamento em múltiplas etapas, chamadas de API, navegação em apps e conclusão de tarefas. Forte no τ2-bench (uso agentivo de ferramentas).

4. Programação e ferramentas para desenvolvedores

Geração de código excepcional, autocompletação, depuração e compreensão em nível de repositório. Suporta saídas estruturadas em JSON para integração perfeita. Alcança 80.0% (31B) no LiveCodeBench v6, posicionando-se como um assistente de programação local-first adequado para cenários de desenvolvimento offline.

5. Contexto longo e multilíngue

Lida de forma confiável com 128K–256K tokens (testado no MRCR “agulha no palheiro”). Pré-treinado em dados diversos até o corte de janeiro de 2025, com forte desempenho entre idiomas. Não é apenas tradução multilíngue; é treinado de forma nativa e cobre mais de 140 idiomas.

Dados de benchmark: detalhamento do desempenho do Gemma 4

O Gemma 4 estabelece novos padrões para modelos abertos. As variantes 31B e 26B entregam pontuações antes reservadas a sistemas proprietários muito maiores, enquanto os modelos de borda superam o antecessor maior, o Gemma 3.

Resultados completos de benchmark (modelos ajustados por instruções)

| Benchmark | Categoria | Gemma 4 31B | Gemma 4 26B A4B | Gemma 4 E4B | Gemma 4 E2B | Gemma 3 27B (sem think) |

|---|---|---|---|---|---|---|

| MMLU Pro | Raciocínio e Conhecimento | 85.2% | 82.6% | 69.4% | 60.0% | 67.6% |

| AIME 2026 (sem ferramentas) | Matemática | 89.2% | 88.3% | 42.5% | 37.5% | 20.8% |

| GPQA Diamond | Ciências de pós-graduação | 84.3% | 82.3% | 58.6% | 43.4% | 42.4% |

| Tau2 (média) | Uso agentivo de ferramentas | 76.9% | 68.2% | 42.2% | 24.5% | 16.2% |

| LiveCodeBench v6 | Programação | 80.0% | 77.1% | 52.0% | 44.0% | 29.1% |

| Codeforces ELO | Programação competitiva | 2150 | 1718 | 940 | 633 | 110 |

| MMMU Pro | Raciocínio multimodal | 76.9% | 73.8% | 52.6% | 44.2% | 49.7% |

| MATH-Vision | Matemática + Visão | 85.6% | 82.4% | 59.5% | 52.4% | 46.0% |

| MRCR v2 (8-needle, 128K) | Contexto longo | 66.4% | 44.1% | 25.4% | 19.1% | 13.5% |

Principais insights:

- Salto enorme em relação ao Gemma 3: O modelo 31B melhora AIME (matemática) de 20.8% para 89.2% e o LiveCodeBench de 29.1% para 80.0%.

- Eficiência do MoE: O 26B A4B quase iguala o 31B usando muito menos computação durante a inferência.

- Domínio na borda: E4B e E2B superam o Gemma 3 27B em muitas métricas apesar de serem 6–10x menores.

- Rankings de leaderboard: O 31B marca ~1452 na Arena AI (texto); o 26B A4B ~1441. A variante 26B supostamente supera modelos muito maiores como o Qwen 3.5 397B em preferência do usuário e programação.

Os benchmarks de visão e áudio confirmam forte desempenho multimodal “pronto para uso” sem fine-tuning especializado.

Ecossistema e suporte a ferramentas

O Gemma 4 conta com integração ampla e imediata no ecossistema:

- Hugging Face: Suporte desde o primeiro dia com

transformers,pipeline("any-to-any"), GGUF, ONNX e processadores multimodais. - Runtimes locais: Ollama, Llama.cpp (LM Studio, Jan), MLX (Apple Silicon com TurboQuant), Mistral.rs (Rust), Transformers.js (inferência no navegador via WebGPU).

- Fine-tuning: TRL, Unsloth, PEFT, Vertex AI e suporte completo a datasets multimodais.

- Otimização de hardware: NVIDIA RTX/DGX Spark/Jetson (via TensorRT-LLM), Google AI Edge tools e implantação on-device em Android/iOS.

- Frameworks de agentes: OpenClaw, Hermes, Pi e testes de simulação CARLA.

- Nuvem/Studio: Google AI Studio para testes rápidos; Kaggle Models para download.

Esse ecossistema torna o Gemma 4 implantável em minutos em laptops, servidores ou dispositivos de borda.

Limitações e segurança:

- Corte de dados de treinamento: janeiro de 2025 (sem conhecimento em tempo real sem ferramentas).

- Áudio limitado a fala (não música); vídeo limitado a 60s.

- Risco de alucinação permanece—use o modo de pensamento e verificação.

- Segurança: Filtragem e avaliações rigorosas conforme os Princípios de IA da Google; desenvolvedores devem adicionar proteções específicas da aplicação.

Por que o Gemma 4 é importante em 2026

O Gemma 4 democratiza a IA de fronteira. Ao combinar inteligência multimodal, capacidades agentivas e liberdade Apache 2.0 com eficiência agnóstica a hardware, ele capacita desenvolvedores e empresas a construir soluções de IA seguras, privadas e econômicas em escala. O avanço de inteligência por parâmetro—especialmente evidente nos modelos de borda que superam os modelos abertos de ponta de ontem—sinaliza uma mudança rumo à IA verdadeiramente ubíqua.

Seja executando um modelo de 2B em um telefone ou um 31B poderoso localmente, o Gemma 4 prova que a IA de código aberto alcançou (e em muitos casos superou) alternativas fechadas em utilidade prática.