Claude Opus 4.5 é o mais novo modelo “classe Opus” da Anthropic (lançado no fim de novembro de 2025). Ele é posicionado como um modelo de ponta para engenharia de software profissional, fluxos de trabalho agentivos de longo horizonte e tarefas corporativas de alto risco, e a Anthropic o precificou intencionalmente para tornar alta capacidade mais acessível a usuários de produção. Abaixo detalho o que é a Claude Opus 4.5 API, como o modelo se sai em benchmarks reais de engenharia, exatamente como funciona sua precificação (API e assinatura), como isso se compara a modelos legados da Anthropic e concorrentes (OpenAI, Google Gemini) e práticas recomendadas para executar cargas de trabalho em produção com eficiência de custo. Também incluo código de suporte e um pequeno kit de benchmarking e cálculo de custos que você pode copiar e executar.

O que é a Claude Opus 4.5 API?

Claude Opus 4.5 é o mais novo modelo da classe Opus: um modelo multimodal de alta capacidade ajustado especificamente para engenharia de software profissional, uso agentivo de ferramentas (ou seja, chamar e compor ferramentas externas) e tarefas de uso de computador. Ele mantém capacidades de pensamento estendido (raciocínio interno passo a passo transparente que você pode transmitir) e adiciona controles de tempo de execução granulares (notavelmente o parâmetro effort). A Anthropic posiciona este modelo como adequado para agentes de produção, migração/refatoração de código e fluxos de trabalho corporativos que exigem robustez e menor número de iterações.

Capacidades centrais da API e experiência do desenvolvedor

Opus 4.5 oferece suporte a:

- Geração de texto padrão + seguimento de instruções com alta fidelidade.

- Modos de pensamento estendido/raciocínio em múltiplas etapas (úteis para programação e documentos longos).

- Uso de ferramentas (pesquisa na web, execução de código, ferramentas personalizadas), memória e cache de prompt.

- “Claude Code” e fluxos agentivos (automatizando tarefas em múltiplas etapas em bases de código).

Como o Claude Opus 4.5 se sai?

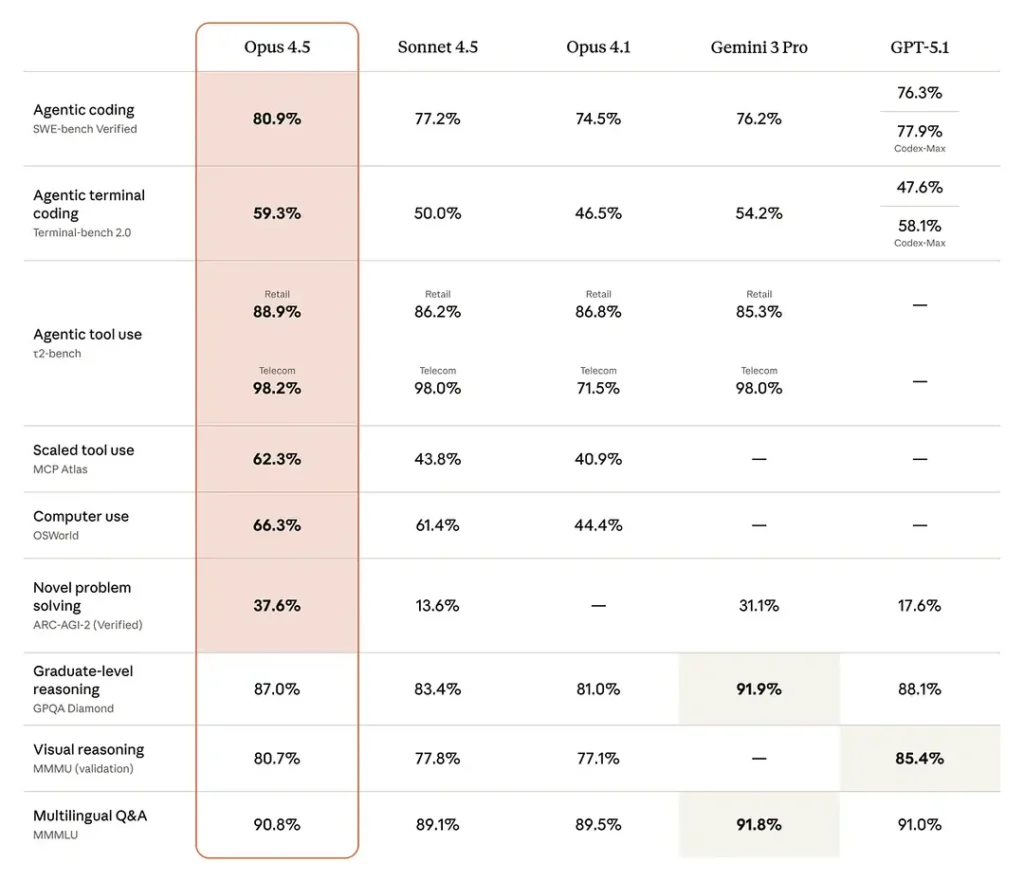

Opus 4.5 é estado da arte em benchmarks de engenharia de software — alegando ~80.9% no SWE-bench Verified, e pontuações fortes em benchmarks de “uso de computador” como OSWorld. Opus 4.5 pode igualar ou superar o desempenho do Sonnet 4.5 com menor uso de tokens (ou seja, mais eficiente em tokens).

Benchmarks de engenharia de software (SWE-bench / Terminal Bench / Aider Polyglot): a Anthropic reporta que o Opus 4.5 lidera no SWE-bench Verified, melhora o Terminal Bench em ~15% vs Sonnet 4.5, e apresenta um salto de 10.6% no Aider Polyglot vs Sonnet 4.5 (comparações internas deles).

Codificação autônoma de longa duração: segundo a Anthropic, o Opus 4.5 mantém desempenho estável em sessões autônomas de codificação de 30 minutos e mostra menos becos sem saída em fluxos de trabalho multi-etapas. Este é um achado interno recorrente nos testes de agentes.

Melhorias em tarefas do mundo real (Vending-Bench / BrowseComp-Plus etc.): a Anthropic cita +29% no Vending-Bench (tarefas de longo horizonte) vs Sonnet 4.5 e métricas de busca agentiva aprimoradas no BrowseComp-Plus.

Algumas conclusões concretas dos relatórios:

- Liderança em programação: o Opus 4.5 frequentemente supera variantes anteriores de Opus/Sonnet e muitos modelos concorrentes contemporâneos em agregadores de benchmarks de engenharia de software (SWE-bench Verified e variantes do Terminal-bench).

- Automação de escritório: avaliadores destacam melhor geração de planilhas e produção de PowerPoint — melhorias que reduzem o retrabalho para analistas e equipes de produto.

- Confiabilidade de agentes e ferramentas: o Opus 4.5 melhora em fluxos agentivos multi-etapas e tarefas de longa duração, reduzindo falhas em pipelines com múltiplas chamadas.

Quanto custa o Claude Opus 4.5?

Esta é a questão central que você levantou. Abaixo desmembro por estrutura de preços da API, níveis de assinatura, exemplos de cálculo de custo e o que isso significa na prática.

Estrutura de preços da API — o que a Anthropic publicou

A Anthropic definiu o preço da API do modelo para o Opus 4.5 em:

- Entrada (tokens): $5 por 1,000,000 tokens de entrada

- Saída (tokens): $25 por 1,000,000 tokens de saída

A Anthropic enquadrou explicitamente esse preço como uma redução deliberada para tornar o desempenho de classe Opus amplamente acessível. O identificador do modelo para desenvolvedores é a string claude-opus-4-5-20251101.

Na CometAPI, a Claude Opus 4.5 API custa $4 / 1M tokens de entrada e $20 / 1M tokens de saída para o Opus 4.5, cerca de 20% mais barato que o preço oficial do Google.

Tabela de preços (simplificada, USD por milhão de tokens)

| Modelo | Entrada ($ / MTok) | Saída ($ / MTok) | Notas |

|---|---|---|---|

| Claude Opus 4.5 (base) | $5.00 | $25.00 | Preço de tabela da Anthropic. |

| Claude Opus 4.1 | $15.00 | $75.00 | Versão Opus mais antiga — preços de tabela mais altos. |

| Claude Sonnet 4.5 | $3.00 | $15.00 | Família mais barata para muitas tarefas. |

Nota importante: estes são preços baseados em tokens (não por solicitação). Você é cobrado pelos tokens consumidos pelas suas solicitações — tanto de entrada (prompt + contexto) quanto de saída (tokens gerados pelo modelo).

Planos de assinatura e níveis do app (consumer/Pro/Team)

A API é adequada para soluções personalizadas, enquanto o plano de assinatura do Claude reúne o acesso ao Opus 4.5 com as ferramentas da interface, eliminando preocupações de uso por token em cenários interativos. O plano gratuito ($0) é limitado a chat básico e ao modelo Haiku/Sonnet e não inclui Opus.

O plano Pro ($20 por mês ou $17 por ano) e o plano Max ($100 por pessoa por mês, fornecendo de 5 a 20 vezes o uso do Pro) desbloqueiam Opus 4.5, Claude Code, execução de arquivos e projetos ilimitados.

Como otimizo o uso de tokens?

- Use

effortde forma apropriada: escolhalowpara respostas rotineiras ehighapenas quando necessário. - Prefira saídas estruturadas e esquemas para evitar idas e vindas verborrágicas.

- Use a Files API para evitar reenviar documentos grandes no prompt.

- Compacte ou resuma o contexto programaticamente antes de enviá-lo.

- Faça cache de respostas repetidas e reutilize-as quando as entradas do prompt forem idênticas ou semelhantes.

Regra prática: instrumente o uso desde cedo (acompanhe tokens por solicitação), rode testes de carga com prompts representativos e compute o custo por tarefa bem-sucedida (não custo por token) para que as otimizações visem ROI real.

Código de exemplo rápido: chamar o Claude Opus 4.5 + calcular custo

Abaixo estão exemplos prontos para copiar: (1) curl, (2) Python usando o SDK da Anthropic e (3) um pequeno auxiliar em Python que calcula custo a partir de tokens de entrada/saída medidos.

Importante: armazene sua chave de API com segurança em uma variável de ambiente. Os trechos presumem que

ANTHROPIC_API_KEYestá definida. O id do modelo exibido éclaude-opus-4-5-20251101(Anthropic).

1) Exemplo cURL (prompt simples)

curl https://api.anthropic.com/v1/complete \

-H "x-api-key: $ANTHROPIC_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"model":"claude-opus-4-5-20251101",

"prompt":"You are an assistant. Given the following requirements produce a minimal Python function that validates emails. Return only code.",

"max_tokens": 600,

"temperature": 0.0

}'

2) Python (SDK da Anthropic) — requisição básica

# pip install anthropic

import os

from anthropic import Anthropic, HUMAN_PROMPT, AI_PROMPT

client = Anthropic(api_key=os.getenv("ANTHROPIC_API_KEY"))

prompt = HUMAN_PROMPT + "Given the following requirements produce a minimal Python function that validates emails. Return only code.\n\nRequirements:\n- Python 3.10\n- Use regex\n" + AI_PROMPT

resp = client.completions.create(

model="claude-opus-4-5-20251101",

prompt=prompt,

max_tokens_to_sample=600,

temperature=0.0

)

print(resp.completion) # model output

Nota: nomes e assinaturas de chamada do SDK Python da Anthropic podem variar; o acima segue padrões comuns em seu SDK público e na documentação — verifique a documentação da versão instalada para os nomes exatos dos métodos. GitHub+1

3) Calculadora de custos (Python) — calcular custo a partir de tokens

def compute_claude_cost(input_tokens, output_tokens,

input_price_per_m=5.0, output_price_per_m=25.0):

"""

Compute USD cost for Anthropic Opus 4.5 given token counts.

input_price_per_m and output_price_per_m are dollars per 1,000,000 tokens.

"""

cost_input = (input_tokens / 1_000_000) * input_price_per_m

cost_output = (output_tokens / 1_000_000) * output_price_per_m

return cost_input + cost_output

# Example: 20k input tokens and 5k output tokens

print(compute_claude_cost(20000, 5000)) # => ~0.225 USD

Dica: meça tokens para solicitações reais usando logs do servidor/telemetria do provedor. Se precisar de contagens de token exatas localmente, use um tokenizador compatível com o esquema de tokenização do Claude ou confie nos contadores do provedor quando disponíveis.

Quando escolher o Opus 4.5 vs modelos mais baratos?

Use o Opus 4.5 quando:

- Você tiver cargas de trabalho de engenharia de missão crítica em que a correção na primeira passada seja materialmente valiosa (geração de código complexo, sugestões de arquitetura, execuções agentivas longas).

- Suas tarefas exigirem orquestração de ferramentas ou raciocínio profundo em múltiplas etapas dentro de um único fluxo de trabalho. Chamadas programáticas de ferramentas são um diferencial chave.

- Você estiver tentando reduzir ciclos de revisão humana — a maior precisão na primeira passada do modelo pode reduzir o tempo humano a jusante e, assim, o custo total.

Considere Sonnet / Haiku ou modelos concorrentes quando:

- Seu caso de uso for conversacional, de alto volume e baixo risco de sumarização, em que tokens mais baratos e maior throughput importam. Sonnet (equilibrado) ou Haiku (leve) podem ser mais econômicos.

- Você precisar do custo por token absolutamente mais baixo e estiver disposto a trocar um pouco de capacidade/precisão (por exemplo, sumarização simples, assistentes básicos).

Como devo projetar prompts para o Opus 4.5?

Quais papéis de mensagem e estratégias de pré-preenchimento funcionam melhor?

Use um padrão em três partes:

- Sistema (role: system): instruções globais — tom, limites, papel.

- Assistente (opcional): exemplos prontos ou conteúdo de preparação.

- Usuário (role: user): a solicitação imediata.

Pré-preencha a mensagem de sistema com restrições (formato, comprimento, política de segurança, esquema JSON se você quiser saída estruturada). Para agentes, inclua especificações de ferramentas e exemplos de uso para que o Opus 4.5 possa chamar essas ferramentas corretamente.

Como uso compactação de contexto e cache de prompt para economizar tokens?

- Compactação de contexto: comprima partes mais antigas de uma conversa em resumos concisos que o modelo ainda consiga usar. O Opus 4.5 oferece automação para compactar contexto sem perder blocos críticos de raciocínio.

- Cache de prompt: faça cache de respostas do modelo para prompts repetidos (a Anthropic fornece padrões de cache de prompt para reduzir latência/custo).

Ambos os recursos reduzem a pegada de tokens de interações longas e são recomendados para fluxos de trabalho agentivos de longa duração e assistentes em produção.

Melhores práticas: obter resultados de nível Opus controlando o custo

1) Otimize prompts e contexto

- Minimize contexto supérfluo — envie apenas o histórico necessário. Aparar e resumir conversas anteriores quando você espera longas trocas.

- Use recuperação/embedding + RAG para buscar apenas os documentos necessários para uma consulta específica (em vez de enviar corpora inteiros como tokens de prompt). A documentação da Anthropic recomenda RAG e cache de prompt para reduzir gasto com tokens.

2) Faça cache e reutilize respostas sempre que possível

Cache de prompt: se muitas solicitações tiverem prompts idênticos ou quase idênticos, faça cache das saídas e sirva versões em cache em vez de chamar o modelo toda vez. A Anthropic destaca especificamente o cache de prompt como otimização de custo.

3) Escolha o modelo certo para a tarefa

- Use Opus 4.5 para tarefas de alto valor e críticas ao negócio em que o retrabalho humano é caro.

- Use Sonnet 4.5 ou Haiku 4.5 para tarefas de alto volume e menor risco. Essa estratégia de modelos mistos oferece melhor preço/desempenho ao longo do stack.

4) Controle max tokens e streaming

Limite max_tokens_to_sample para saídas quando você não precisar de verbosidade total. Use streaming onde for suportado para interromper a geração cedo e economizar custos de tokens de saída.

Considerações finais: vale a pena adotar o Opus 4.5 agora?

Opus 4.5 é um avanço significativo para organizações que precisam de raciocínio de maior fidelidade, custos de token mais baixos para interações longas e comportamento de agente mais seguro e robusto. Se seu produto depende de raciocínio sustentado (tarefas complexas de código, agentes autônomos, síntese de pesquisa profunda ou automação pesada em Excel), o Opus 4.5 oferece controles adicionais (effort, pensamento estendido, manuseio de ferramentas aprimorado) para ajustar desempenho e custo no mundo real.

Os desenvolvedores podem acessar a Claude Opus 4.5 API via CometAPI. Para começar, explore as capacidades do modelo da CometAPI no Playground e consulte o guia da API para instruções detalhadas. Antes de acessar, certifique-se de ter feito login na CometAPI e obtido a chave de API. A CometAPI oferece um preço muito inferior ao oficial para ajudar na sua integração.

Pronto para começar? → Registre-se no CometAPI hoje!

Se quiser mais dicas, guias e notícias sobre IA, siga-nos no VK, X e Discord!