A IA está evoluindo rapidamente: novos modelos multimodais e APIs em tempo real aprimoradas estão facilitando a incorporação de IA poderosa em plataformas de automação, enquanto debates paralelos sobre segurança e observabilidade estão remodelando a forma como as equipes operam sistemas de produção. Para quem constrói automações locais, um padrão prático está surgindo: usar um gateway de modelo unificado (como CometAPI) para acessar muitos modelos e unir essas chamadas de modelo em um executor de automação auto-hospedado (como n8n) para que você mantenha o controle de dados, latência e custos. Este guia mostra, passo a passo, como começar a usar CometAPI + n8n (local), o que observar e como solucionar problemas quando as coisas não dão certo.

O que é n8n e por que ele é importante para a automação de IA?

O n8n é uma ferramenta de automação de fluxo de trabalho de código aberto com um editor visual e um amplo ecossistema de nós (conectores). Ele foi projetado para permitir o encadeamento de gatilhos, transformações e chamadas de API externas em fluxos de trabalho repetíveis (webhooks, tarefas agendadas, processamento de arquivos, chatbots, etc.). A auto-hospedagem local do n8n oferece controle total sobre a residência e a execução dos dados, o que é particularmente útil ao chamar modelos de IA de terceiros que processam entradas confidenciais.

Como o n8n funciona na prática?

- Tela visual com gatilhos (Webhook, Cron) e nós de ação (solicitação HTTP, nós de banco de dados, e-mail).

- Os nós da comunidade ampliam a capacidade — você pode instalar pacotes da comunidade e tratá-los como nós nativos.

A auto-hospedagem n8n oferece a você:

- Controle total dos dados — os fluxos de trabalho e os dados de execução permanecem na infraestrutura que você gerencia.

- Customização — adicione nós privados ou integrações locais sem esperar pelos recursos da nuvem.

- Previsibilidade de custos — sem surpresas de cobrança por tarefa na nuvem para automação interna pesada.

- Segurança e conformidade — mais fácil atender às necessidades regulatórias e de políticas internas.

O que é CometAPI e por que usá-lo como seu gateway de modelo?

CometAPI é um gateway de API unificado que expõe centenas de modelos de IA de terceiros (texto, embeddings, geração de imagens, etc.) por trás de uma única interface e modelo de faturamento compatíveis com OpenAI. Isso significa que, em vez de adicionar integrações personalizadas para cada LLM ou mecanismo de imagem que você deseja testar, você chama uma API e escolhe o modelo desejado na solicitação. Isso simplifica a experimentação, o controle de custos e a integração operacional.

benefícios:

- Escolha do modelo: Experimente vários fornecedores/modelos com o mesmo caminho de código.

- Pool de tokens / cotas gratuitas: Muitos gateways unificados oferecem créditos/níveis para experimentar.

- Infraestrutura mais simples: Um sistema de autenticação e uma URL base para gerenciar.

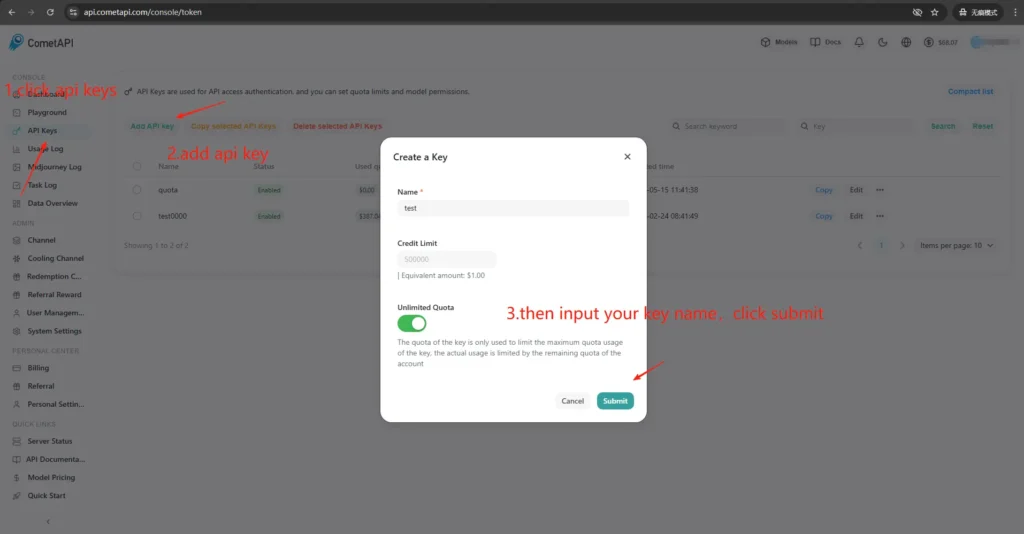

Como obtenho acesso e chaves do CometAPI?

- Inscreva-se no site da CometAPI (ou no painel do fornecedor). A maioria dos gateways oferece uma versão gratuita para testes.

- Obter uma chave de API do seu painel CometAPI — uma longa string secreta. Observe onde a documentação indica para colocá-la (o CometAPI usa autorização do portador contra

https://api.cometapi.com/v1). - Leia a documentação da API para o ponto final que você planeja usar (conclusões de bate-papo, imagens, incorporações). O CometAPI documenta pontos finais como

/v1/chat/completionse/v1/images/generations.

Por que a vinculação (integração) entre n8n e CometAPI é importante?

"Vinculação" aqui significa um caminho de integração confiável e seguro entre o seu executor de automação (n8n) e o seu gateway de modelo. Uma vinculação adequada é importante porque:

- Ele preserva contexto entre chamadas (histórico de conversas, incorporações).

- Ele centraliza Credenciais e segredos em um só lugar para uma rotação mais segura.

- Ele reduz a latência e a superfície de erro usando endpoints previsíveis e formatos de solicitação padrão.

- Habilita observabilidade e solução de problemas — saber qual modelo, prompt e resposta levaram a um resultado.

Resumindo: uma boa vinculação reduz o risco operacional e acelera a iteração.

Como implantar o n8n localmente (guia prático rápido)?

Você pode executar o n8n localmente com npm ou com o Docker; o Docker Compose é a abordagem recomendada para a maioria dos cenários auto-hospedados (é reproduzível e isola dependências). Abaixo, um exemplo mínimo do Docker Compose e notas essenciais.

Como posso hospedar o n8n com o Docker?

O Docker (e o Docker Compose) é a maneira mais robusta e repetível de executar o n8n em produção. Ele isola o aplicativo, simplifica as atualizações e combina bem com proxies reversos e orquestradores (Docker Swarm, Kubernetes). A documentação oficial do n8n inclui uma referência ao Docker Compose que seguirei e adaptarei aqui.

Para produção, você normalmente executará uma pilha composta por:

- Serviço n8n (imagem oficial:

docker.n8n.io/n8nio/n8norn8nio/n8ndependendo da etiqueta). - PostgreSQL (ou outro banco de dados compatível).

- Redis (se você planeja usar o modo de fila).

- Um proxy reverso (Traefik, Caddy ou nginx) para TLS, roteamento de host e regras de limite de taxa.

Essa arquitetura separa claramente as preocupações (persistência do banco de dados, enfileiramento, proxy web) e simplifica o escalonamento e os backups. A documentação oficial do n8n fornece padrões do Docker Compose e referências a variáveis de ambiente.

Este é um guia passo a passo:

- Crie uma pasta e uma

docker-compose.ymlcom o serviço n8n canônico. Abaixo está um exemplo prático de docker-compose que atende às necessidades típicas de produção: Postgres externo, Redis (para modo de fila/execuções), volumes persistentes e um proxy reverso Nginx que lida com TLS:

```yaml

version: "3.8"

services:

n8n:

image: n8nio/n8n:latest

restart: unless-stopped

environment:

- DB_TYPE=postgresdb

- DB_POSTGRESDB_HOST=postgres

- DB_POSTGRESDB_PORT=5432

- DB_POSTGRESDB_DATABASE=n8n

- DB_POSTGRESDB_USER=n8n

- DB_POSTGRESDB_PASSWORD=supersecretpassword

- N8N_BASIC_AUTH_ACTIVE=true

- N8N_BASIC_AUTH_USER=admin

- N8N_BASIC_AUTH_PASSWORD=anothersecret

- WEBHOOK_TUNNEL_URL=https://n8n.example.com

- EXECUTIONS_MODE=queue

- QUEUE_BULL_REDIS_HOST=redis

ports:

- "5678:5678"

volumes:

- n8n_data:/home/node/.n8n

depends_on:

- postgres

- redis

postgres:

image: postgres:15

environment:

POSTGRES_DB: n8n

POSTGRES_USER: n8n

POSTGRES_PASSWORD: supersecretpassword

volumes:

- pgdata:/var/lib/postgresql/data

redis:

image: redis:7

volumes:

- redisdata:/data

volumes:

n8n_data:

pgdata:

redisdata:

2. Início:

docker compose up -d

3. Visite `http://localhost:5678` e crie seu usuário administrador. Para produção, você precisará de Postgres, SSL e variáveis de ambiente adequadas — consulte a documentação oficial do Docker Compose.

**Notas e endurecimento:**

- Do **não** armazenar segredos em texto simples em `docker-compose.yml`; use arquivos de ambiente, segredos do Docker ou gerenciadores de segredos externos na produção.

- Substituir `WEBHOOK_URL` com sua URL pública real e configure o proxy reverso para rotear `n8n.example.com` para o contêiner n8n.

- Uso `EXECUTIONS_MODE=queue` para processamento robusto em segundo plano; requer trabalhadores de fila e Redis.

## Como faço para auto-hospedar o n8n com npm / Node.js?

A instalação via npm (ou pnpm) executa o n8n diretamente no host. É mais leve (sem camada de contêiner) e pode ser útil para instalações de baixa complexidade por um único usuário ou em máquinas de desenvolvedores. No entanto, coloca mais responsabilidade sobre o administrador em relação ao gerenciamento de dependências, isolamento e supervisão de serviços. A documentação oficial do n8n inclui um guia de instalação do npm e algumas ressalvas.

### Os pacotes do sistema operacional necessários e a versão do Node:

- Use um LTS Node.js estável (Node 18 ou Node 20+, atenda aos requisitos da versão n8n).

- Instale `build-essential`, `git`, e um gerenciador de processos (systemd é recomendado).

- Para produção, ainda use PostgreSQL e Redis como serviços externos (mesmo raciocínio do Docker).

### Como instalar e executar o n8n via npm (passo a passo)?

1. Instale o Node.js (recomendado: nvm)

Install nvm

curl -o- https://raw.githubusercontent.com/nvm-sh/nvm/v0.39.7/install.sh | bash

Reload your shell (adjust to your shell startup file if needed)

source ~/.bashrc # or ~/.zshrc

Install and use the latest LTS (usually 18 or 20)

nvm install --lts

nvm use --lts

Verify

node -v

npm -v

Se você vir “n8n: comando não encontrado” mais tarde, reinicie o terminal ou certifique-se de que o caminho bin global npm gerenciado pelo nvm esteja no seu PATH.

---

2. Instale e inicie o n8n (local)

npm install -g n8n

n8n -v # verify version

3. Comece no primeiro plano:

n8n start

URL padrão: <http://localhost:5678/> Se a porta estiver em uso:

export N8N_PORT=5679

n8n start

Opcional: mantenha-o em execução em segundo plano (ainda local):

npm install -g pm2

pm2 start "n8n" --name n8n

pm2 save

pm2 status

4. Primeiro acesso e login:

- Abra http://localhost:5678/ no seu navegador.

- Na primeira execução, siga o assistente para criar a conta do Proprietário (e-mail + senha) e faça login.

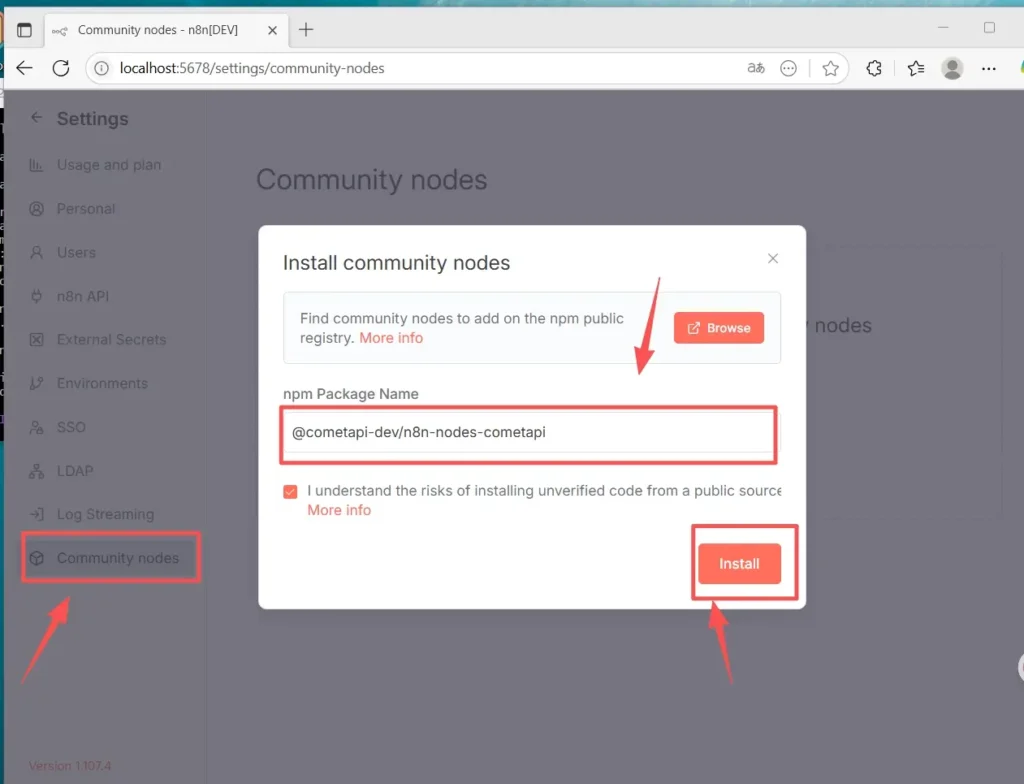

## Como instalo ou configuro um nó da comunidade CometAPI no n8n?

O n8n suporta nós de comunidade verificados (instalação por interface gráfica) e instalação manual a partir do npm quando você se hospeda. Há duas maneiras de integrar a CometAPI ao n8n:

### Opção A — Use o nó da comunidade CometAPI (se disponível no painel Nós)

1. No n8n abra o painel de nós (pressione `+` or `Tab`).

2. CometAPI é um nó de comunidade verificado, ele aparece em “Mais da comunidade”. Clique e instale.

3. Após a instalação, reinicie o n8n se solicitado. Crie um novo **Credencial** em Configurações → Credenciais (escolha o tipo de credencial CometAPI se o nó fornecer) e cole seu token CometAPI.

### Opção B — Instalação manual (quando a instalação da GUI não estiver disponível)

1. Conecte-se via SSH ao seu host/contêiner n8n.

2. Instale o pacote no n8n global `node_modules` ou sua pasta personalizada:

- Vá para Configurações (canto inferior esquerdo) > Nós da comunidadeClique em “

- Instalar um nó comunitário”

- Em “Nome do pacote npm”, digite: `@cometapi-dev/n8n-nodes-cometapi`Marque a caixa de reconhecimento de riscoClique em “

- Instalar”Após a instalação, você pode procurar por “CometAPI” no painel do nó.

3. Reinicie o n8n. Se a sua instância estiver sendo executada em modo de fila, você deverá seguir o procedimento de instalação manual descrito na documentação.

### Como verificar se o nó está instalado

- Após reiniciar, abra o painel de nós e procure por “CometAPI” ou “Comet”. O nó será marcado como um pacote da comunidade.

- Se você não conseguir visualizar o nó: verifique se a conta do proprietário da instância está sendo usada (somente proprietários da instância podem instalar) ou se o pacote do nó foi instalado sem erros nos logs do contêiner/imagem.

## Como criar um fluxo de trabalho e configurar a API

### 1. Crie um novo fluxo de trabalho

- Efetue login na sua instância n8n (auto-hospedada).

- Clique **“Adicionar fluxo de trabalho”** para iniciar uma nova tela de automação.

### 2. Adicionar nó

- Adicione um nó de gatilho: pesquise por “Gatilho manual” ou “Ao clicar em 'Executar fluxo de trabalho'”.

- Clique no “+” no lado direito da tela e procure por “CometAPI” para adicionar o nó.

- Você também pode pesquisar “CometAPI” na lista de nós à esquerda e arrastá-lo para a tela.

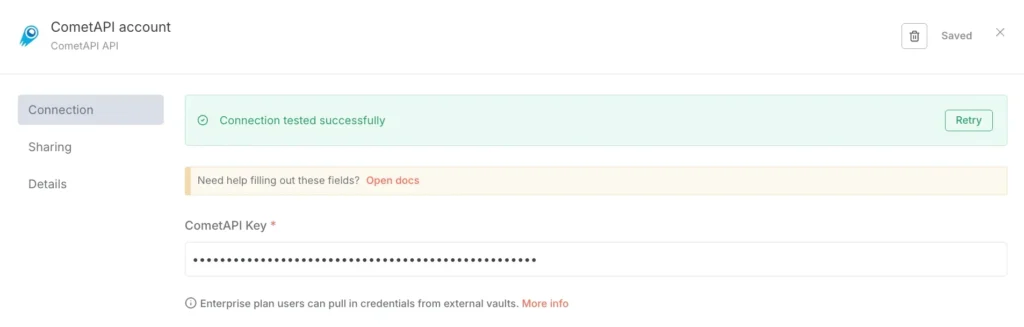

### 3. Configurar credenciais (somente na primeira vez):

- No nó CometAPI, em “Credencial para conectar”, escolha “Criar novo”.

- Cole o token que você criou no console CometAPI em “CometAPI Key”.

- Salvar. O URL base padrão é https://www.cometapi.com/console/ e normalmente não precisa de alterações.

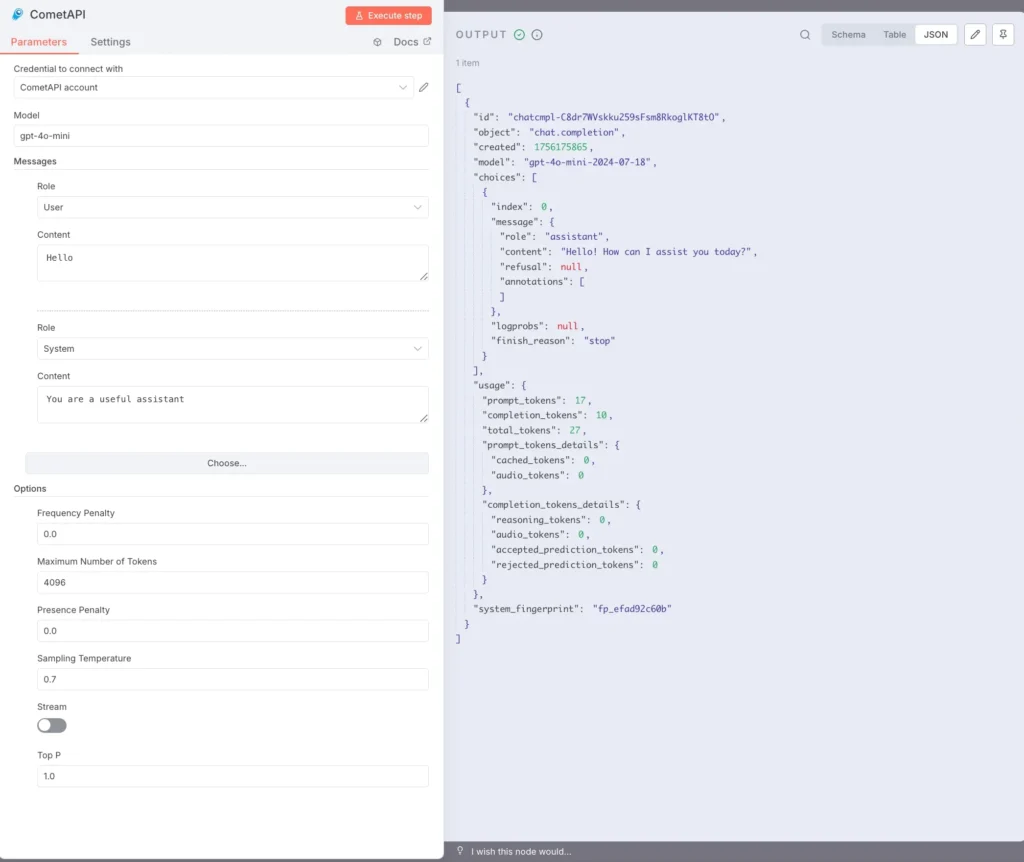

### 4. Configurar modelo e mensagens:

Modelo: insira um modelo suportado, por exemplo, `gpt-4o` or `gpt-4o-mini`.

Mensagens: Você precisa preencher a função e o contexto, e pode escolher usuário ou sistema para a função

Parâmetros opcionais (conforme necessário): Número máximo de tokens (ex.: 4096); Temperatura de amostragem (ex.: 0.7); PenaltyStream (ativar/desativar streaming). Para documentação e explicações específicas dos parâmetros, consulte o [Documentação do CometAPI](https://api.cometapi.com/doc).

### 5.Execução do texto:

Selecione o nó CometAPI e clique em “Executar etapa” ou clique em “Executar fluxo de trabalho” na parte inferior.

O painel OUTPUT à direita deve mostrar uma resposta JSON (incluindo opções, uso, etc.).

Agora você instalou o n8n(Recommend) localmente no Linux via npm, instalou e configurou o nó da comunidade CometAPI e pode executar fluxos de trabalho que chamam modelos como gpt-4o para receber respostas.

## Quais são os problemas comuns e como solucioná-los?

### 1) “401 Não Autorizado” ou “Chave de API Inválida”

- Confirme a sequência exata do token no seu painel CometAPI (pode haver tokens com nomes semelhantes). Copie → cole na credencial n8n e reinicie o nó, se necessário.

- Certifique-se de que o formato do cabeçalho de autorização seja `Bearer sk-xxxxx`.

### 2) O nó da comunidade não instala / “modo de fila”

- Se o seu n8n for executado em **modo de fila**A instalação da interface gráfica pode ser desabilitada; siga a documentação de instalação manual para instalar nós da comunidade via npm ou crie uma imagem personalizada que inclua o nó. Reinicie o n8n após a instalação.

### 3) Nó não encontrado na paleta após a instalação

- Reinicie o n8n.

- Certifique-se de que instalou o pacote no contexto correto (dentro da imagem do contêiner ou no `.n8n/custom` caminho se estiver usando esse padrão).

- Verifique os logs do contêiner em busca de erros de resolução de módulo.

### 4) Limites de taxas ou questões de cotas

- Verifique o painel do CometAPI para uso e cota.

- Implemente o recuo exponencial e o fallback para modelos mais baratos quando detectar avisos de limite ou HTTP 429s.

## Existem alternativas caso o nó da comunidade não esteja disponível ou você queira mais flexibilidade?

Sim — você sempre pode usar o **Solicitação HTTP** nó diretamente (controle total) ou um [Nó OpenAI com URL base](https://apidoc.cometapi.com/n8n-965890m0) redirecionamento (atalho prático). O uso de HTTP bruto também facilita a adoção de novos endpoints da CometAPI à medida que são lançados (por exemplo, endpoints de imagem/vídeo). Consulte [Guia](https://apidoc.cometapi.com/n8n-965890m0).

**Veja também** [Como usar o n8n com o CometAPI](https://www.cometapi.com/pt/how-to-use-n8n-with-cometapi/?utm_source=chatgpt.com)

## Conclusão:

O CometAPI oferece opções de modelos e simplicidade operacional; o n8n oferece orquestração visual e extensibilidade. Use o truque de credenciais do OpenAI para integração rápida de chat/conclusão e nós da comunidade onde eles existem e são confiáveis. Instrumente cada fluxo de trabalho para custo, latência e segurança; prefira alternativas humanas para decisões importantes; e mantenha sua seleção de modelos dinâmica para que você possa se adaptar às rápidas mudanças no cenário de fornecedores de IA. A combinação do n8n e do CometAPI é poderosa, mas, como todas as ferramentas poderosas, precisa de proteções — observar, testar e iterar.