A Anthropic lançou o Claude Opus 4.5 no fim de novembro de 2025 como um modelo de classe Opus mais capaz e mais eficiente, voltado para engenharia de software profissional, fluxos de trabalho agentic e tarefas de longo horizonte. Ele está disponível pela plataforma para desenvolvedores da Anthropic e via CometAPI, e introduz novos controles de API (notadamente o parâmetro effort), ferramentas aprimoradas de uso de computador, “extended thinking” e melhorias de eficiência de tokens importantes em produção.

A seguir está um guia prático e profissional: o que mudou, como obter acesso, como usar os novos controles (effort, extended thinking, tool use, arquivos/uso de computador), orientação de custo e otimização, considerações de segurança/governança e padrões de integração do mundo real.

O que exatamente é o Claude Opus 4.5 e por que ele importa?

O Claude Opus 4.5 é o mais novo membro da família de modelos de classe Opus da Anthropic (lançado em 24–25 de novembro de 2025) que foca no máximo de capacidade de raciocínio e codificação, ao mesmo tempo em que melhora a eficiência de tokens e oferece novos controles de API para equilibrar custo versus profundidade. A Anthropic posiciona o Opus 4.5 como “o modelo mais inteligente” que lançou, mirando tarefas complexas de engenharia de software, agentes de longa duração, automação de planilhas/Excel e tarefas que exigem raciocínio multietapas sustentado.

Quais são as principais novidades do Opus 4.5?

A Anthropic projetou o Opus 4.5 para melhorar a profundidade do raciocínio e o comportamento agentic, dando aos desenvolvedores melhor controle sobre os trade-offs de custo/latência. Os destaques do lançamento são:

- Parâmetro de esforço (beta): um controle de API de primeira classe que define quanto “orçamento de pensamento” o Claude gasta em uma solicitação (tipicamente

low,medium,high). Ele influencia o raciocínio, as chamadas de ferramenta e os tokens internos de “pensamento”, para que você ajuste velocidade vs. profundidade por chamada, em vez de alternar modelos. Este é um recurso emblemático do Opus 4.5. - Melhor orquestração de agentes e ferramentas: maior precisão na escolha de ferramentas, chamadas de ferramenta mais estruturadas e um fluxo mais robusto de resultados de ferramentas para construir agentes e pipelines multietapas. A Anthropic fornece documentação e orientações de SDK para o fluxo de “tool use”.

- Eficiência de tokens/custo — a Anthropic relata reduções de até ~50% no uso de tokens para alguns fluxos em comparação ao Sonnet 4.5, além de menos erros de chamadas de ferramenta e menos iterações em tarefas complexas de engenharia.

- Capacidades multimodais aprimoradas: melhorias abrangentes em desempenho visual, de raciocínio e matemático.

- Janela de contexto ampliada para 200K tokens, suportando conversas profundas e longas e análise de documentos complexos.

Quais capacidades práticas melhoraram?

Atualização de desempenho

- Melhor orquestração de agentes e ferramentas: maior precisão na escolha de ferramentas, chamadas de ferramenta mais estruturadas e um fluxo mais robusto de resultados de ferramentas para construir agentes e pipelines multietapas. A Anthropic fornece documentação e orientações de SDK para o fluxo de “tool use”. Melhor tratamento de contexto, auxiliares de compactação para execuções longas de agentes e SDKs de ferramentas de primeira classe para registrar e validar ferramentas significam que o Opus 4.5 é melhor para construir agentes que rodam sem supervisão por muitas etapas.

- Capacidades multimodais aprimoradas: melhorias abrangentes em desempenho visual, de raciocínio e matemático.

- Janela de contexto ampliada para 200K tokens, suportando conversas profundas e longas e análise de documentos complexos.

Codificação e trabalho de longo horizonte

O Opus 4.5 continua a ser orientado por benchmarks para tarefas de codificação; ele reduz o número de iterações e erros de chamadas de ferramenta durante tarefas longas (migração de código, refatoração, depuração multietapas). Relatos iniciais e o system card da Anthropic apontam melhora sustentada em benchmarks de engenharia e ganhos dramáticos de eficiência em pipelines orientados por ferramentas.

No SWE-bench, o Opus 4.5 relata pontuações líderes em benchmarks de engenharia de software (a Anthropic lista 80,9% no SWE-bench Verified no material de lançamento), e clientes reportam melhorias em depuração, edições em múltiplos arquivos e tarefas de código de longo horizonte.

Custo e Eficiência

A Anthropic projetou o Opus 4.5 para melhorar a profundidade do raciocínio e o comportamento agentic, dando aos desenvolvedores melhor controle sobre os trade-offs de custo/latência:

- Redução de preço em comparação com o Opus 4.1: $5 (entrada) / $25 (saída) por milhão de tokens.

- Melhoria no uso de tokens: redução média de 50–75% no consumo mantendo o desempenho.

- um controle de API de primeira classe que define quanto “orçamento de pensamento” o Claude gasta em uma solicitação (comumente

low,medium,high). Ele influencia o raciocínio, as chamadas de ferramenta e os tokens internos de “pensamento”, para que você ajuste velocidade vs. profundidade por chamada, em vez de alternar modelos. Este é um recurso emblemático do Opus 4.5 (Comparado ao Sonnet 4.5: Esforço Médio → 76% menos tokens, desempenho comparável; Esforço Alto → melhoria de 4,3% no desempenho, redução de 48% no uso de tokens).

Como acessar e usar a API do Claude Opus 4.5?

Como posso obter acesso e chaves?

- Crie uma conta de desenvolvedor Anthropic / Claude. Cadastre-se no portal de desenvolvedores da Claude/Anthropic e crie uma chave de API pelo Console (existem fluxos de organização/admin para equipes). A Messages API é o endpoint principal para interações no estilo chat/assistente.

- Parceiros de nuvem: o Opus 4.5 também está disponível por grandes marketplaces de nuvem Google Vertex AI, CometAPI(uma plataforma de agregação de APIs de IA, é necessário usar sua autenticação)), No CometAPI, você pode acessar a API do Claude opus 4.5 via formato Anthropic Messages e formato Chat.

Como devo autenticar minhas solicitações?

Use bearer tokens padrão: inclua um cabeçalho Authorization: Bearer $_API_KEY em toda chamada de API. As solicitações são JSON sobre HTTPS; a Messages API aceita uma lista de mensagens estruturadas (system + user + assistant).

Início rápido — Python (SDK oficial)

Instale o SDK:

pip install anthropic

Exemplo mínimo (síncrono):

import os

from anthropic import Anthropic

# espera ANTHROPIC_API_KEY no ambiente

client = Anthropic(api_key=os.environ)

resp = client.messages.create(

model="claude-opus-4-5-20251101",

messages=,

max_tokens=512,

)

print(resp.content.text) # o SDK retorna blocos de conteúdo estruturados

Esta chamada usa o identificador canônico do modelo Opus 4.5. Para endpoints gerenciados por provedores (Vertex, CometAPI, Foundry) siga a documentação do provedor para construir o cliente e fornecer a URL e a chave do provedor (por exemplo, https://api.cometapi.com/v1/messages para CometAPI).

Início rápido — Python (CometAPI)

Você precisa entrar no CometAPI e obter uma chave.

curl

--location

--request POST 'https://api.cometapi.com/v1/messages' \

--header 'Authorization: Bearer ' \

--header 'Content-Type: application/json' \

--data-raw '{ "model": "claude-opus-4-5-20251101", "max_tokens": 1000, "thinking": { "type": "enabled", "budget_tokens": 1000 }, "messages": }'

Como uso o novo parâmetro de esforço (effort) e o extended thinking?

O que é o parâmetro effort e como defini-lo?

O parâmetro effort é um controle de API de primeira classe introduzido no Opus 4.5 que ajusta quanto cálculo interno e orçamento de tokens o modelo gasta para produzir sua saída. Valores típicos são low, medium e high. Use-o para equilibrar latência e custo de tokens versus profundidade:

low— respostas rápidas e eficientes em tokens para automação de alto volume e tarefas rotineiras.medium— qualidade/custo equilibrados para uso em produção.high— análise profunda, raciocínio multietapas ou quando a precisão é mais importante.

A Anthropic introduziu o effort para o Opus 4.5 (beta). É preciso incluir um cabeçalho beta (por exemplo, effort-2025-11-24) e especificar output_config: { "effort": "low|medium|high" } (exemplo abaixo). high é o comportamento padrão. Reduzir o effort diminui o uso de tokens e a latência, mas pode reduzir modestamente a profundidade. Use-o para tarefas de alto throughput ou sensíveis à latência.

Exemplo:

# Exemplo usando a beta messages API mostrada na documentação da Anthropic

from anthropic import Anthropic

import os

client = Anthropic(api_key=os.getenv("ANTHROPIC_API_KEY"))

response = client.beta.messages.create(

model="claude-opus-4-5-20251101",

betas=, # cabeçalho beta obrigatório

messages=,

max_tokens=1500,

output_config={"effort": "medium"} # low | medium | high

)

print(response)

Quando usar qual: use low para pipelines automatizados (por exemplo, categorização de e-mails), medium para assistentes padrão e high para geração de código, pesquisas profundas ou tarefas sensíveis a risco. A Anthropic destaca este parâmetro como um controle-chave do Opus 4.5.

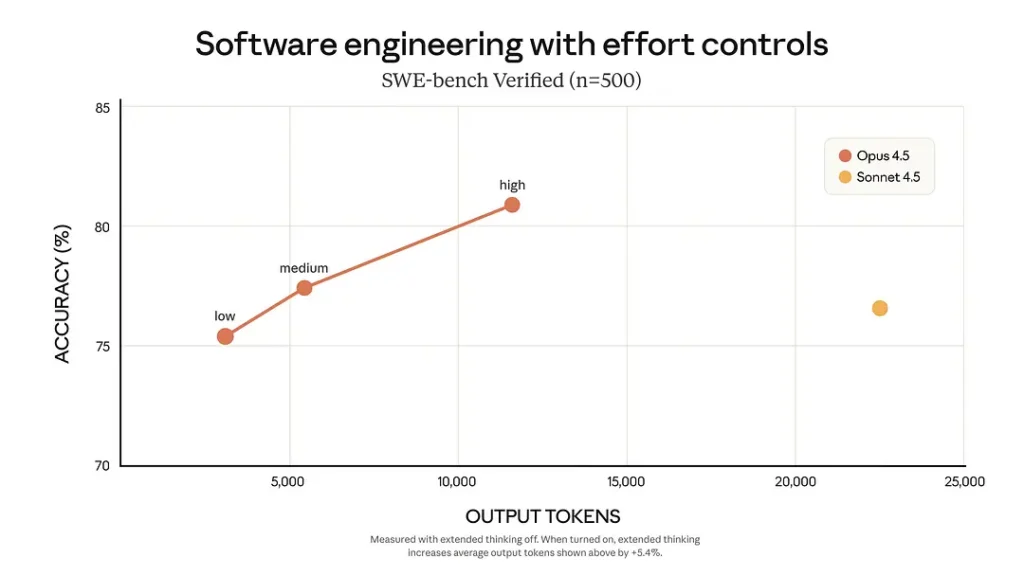

No teste SWE-bench:

- No modo Esforço Médio: o desempenho é comparável ao Sonnet 4.5, mas os tokens de saída são reduzidos em 76%;

- No modo Esforço Alto: o desempenho supera o Sonnet 4.5 em aproximadamente 4,3 pontos percentuais, e os tokens são reduzidos em 48%.

O que é Extended Thinking e como invocá-lo?

Extended Thinking (também chamado de “extended thinking” ou “thinking blocks”) permite que o modelo realize cadeias intermediárias de raciocínio ou etapas passo a passo, preservando ou resumindo opcionalmente os blocos internos de pensamento. A Messages API oferece suporte a esse comportamento e a Anthropic adicionou controles para preservar blocos de pensamento anteriores, de modo que agentes de múltiplas interações possam reutilizar raciocínios anteriores sem repetir o cálculo caro. Use extended thinking quando a tarefa exigir planejamento multietapas, resolução de problemas de longo horizonte ou orquestração de ferramentas.

Como integrar ferramentas e construir agentes com o Opus 4.5?

Uma das grandes forças do Opus 4.5 é o uso de ferramentas (tool use) aprimorado: defina ferramentas no seu cliente, deixe o Claude decidir quando chamá-las, execute a ferramenta e retorne o tool_result — o Claude usará esses resultados em sua resposta final. A Anthropic fornece Agent SDKs que permitem registrar funções de ferramenta tipadas (por exemplo, run_shell, call_api, search_docs) que o Claude pode descobrir e chamar durante o extended thinking. A plataforma converte definições de ferramentas em funções chamáveis que o modelo pode chamar e das quais pode receber resultados. É assim que você constrói fluxos agentic com segurança (com entradas/saídas controladas).

Abaixo está um padrão prático e um exemplo completo em Python.

Padrão de uso de ferramentas (conceitual)

- O cliente fornece metadados de

toolscom name, description e esquema JSON (input_schema). - O modelo retorna um bloco

tool_use(a instrução estruturada do modelo para chamar uma ferramenta específica com entradas específicas). Ostop_reasonda resposta da API pode sertool_use. - O cliente executa a ferramenta (seu código chama a API externa ou função local).

- O cliente envia uma mensagem de acompanhamento com

role:"user"e um bloco de conteúdotool_resultcontendo as saídas da ferramenta. - O modelo consome o resultado da ferramenta e retorna a resposta final ou novas chamadas de ferramenta.

Esse fluxo permite controle seguro no lado do cliente sobre o que o modelo executa (o modelo propõe chamadas de ferramenta; você controla a execução).

Exemplo ponta a ponta — Python (ferramenta simples de clima)

# 1) Defina os metadados das ferramentas e envie a solicitação inicial

from anthropic import Anthropic

import os, json

client = Anthropic(api_key=os.environ)

tools = [

{

"name": "get_weather",

"description": "Retorna o clima atual para uma cidade informada.",

"input_schema": {"type":"object","properties":{"city":{"type":"string"}},"required":}

}

]

resp = client.messages.create(

model="claude-opus-4-5-20251101",

messages=,

tools=tools,

max_tokens=800,

)

# 2) Verifique se o Claude deseja uma chamada de ferramenta

stop_reason = resp.stop_reason # campo do SDK

if stop_reason == "tool_use":

# Extraia a chamada de ferramenta (o formato varia por SDK; isto é esquemático)

tool_call = resp.tool_calls # ex.: {"name":"get_weather", "input":{"city":"Tokyo"}}

tool_name = tool_call

tool_input = tool_call

# 3) Execute a ferramenta no lado do cliente (aqui: stub)

def get_weather(city):

# Substitua este stub por uma chamada real de API de clima

return {"temp_c": 12, "condition": "Parcialmente nublado"}

tool_result = get_weather(tool_input)

# 4) Envie o tool_result de volta ao Claude

follow_up = client.messages.create(

model="claude-opus-4-5-20251101",

messages=[

{"role":"user", "content":[{"type":"tool_result",

"tool_use_id": resp.tool_use_id,

"content": json.dumps(tool_result)}]}

],

max_tokens=512,

)

print(follow_up.content.text)

else:

print(resp.content.text)

Como estruturar agentes para confiabilidade?

- Higienize entradas das ferramentas (evite injeção via prompts).

- Valide saídas das ferramentas antes de devolvê-las ao modelo (verificações de esquema).

- Limite o escopo das ferramentas (princípio do menor privilégio).

- Use auxiliares de compactação (dos SDKs da Anthropic) para manter o contexto gerenciável em execuções longas.

Como devo projetar prompts e estruturar mensagens para o Opus 4.5?

Quais papéis de mensagem e estratégias de prefill funcionam melhor?

Use um padrão em três partes:

- System (role: system): instruções globais — tom, limites, papel.

- Assistant (opcional): exemplos prontos ou conteúdo de preparação.

- User (role: user): a solicitação imediata.

Preencha a mensagem system com restrições (formato, comprimento, política de segurança, esquema JSON se você quiser saída estruturada). Para agentes, inclua especificações de ferramentas e exemplos de uso para que o Opus 4.5 possa chamá-las corretamente.

Como usar compactação de contexto e cache de prompts para economizar tokens?

- Compactação de contexto: comprima partes antigas de uma conversa em resumos concisos que o modelo ainda consiga usar. O Opus 4.5 oferece suporte à automação para compactar o contexto sem perder blocos críticos de raciocínio.

- Cache de prompts: armazene em cache respostas do modelo para prompts repetidos (a Anthropic fornece padrões de cache de prompts para reduzir latência/custo).

Ambos os recursos reduzem a pegada de tokens de interações longas e são recomendados para fluxos de agentes de longa duração e assistentes em produção.

Tratamento de erros e boas práticas

Abaixo estão recomendações pragmáticas de confiabilidade e segurança para integração em produção com o Opus 4.5.

Confiabilidade e tentativas

- Trate limites de taxa (HTTP 429) com backoff exponencial e jitter (comece em 500–1000ms).

- Idempotência: para chamadas de LLM não mutáveis você pode repetir com segurança, mas tenha cuidado em fluxos nos quais o modelo aciona efeitos colaterais externos (chamadas de ferramenta) — deduplique rastreando

tool_use_idou seus próprios IDs de solicitação. - Estabilidade de streaming: trate streams parciais e reconecte graciosamente; se ocorrer uma interrupção, prefira repetir a solicitação inteira ou retomar usando o estado da aplicação para evitar interações inconsistentes com ferramentas.

Segurança

- Injeção de prompt e segurança de ferramentas: nunca permita que o modelo execute diretamente comandos de shell ou código arbitrário sem validação. Sempre valide entradas de ferramentas e higienize saídas. O modelo propõe chamadas de ferramenta; seu código decide executá-las. O system card e a documentação da Anthropic descrevem restrições de alinhamento e níveis de segurança — siga-os para domínios de alto risco.

- Tratamento de dados e conformidade: trate prompts e entradas/saídas de ferramentas contendo PII ou dados regulados conforme sua política jurídica/de conformidade. Use controles corporativos de VPC/enterprise do provedor se você tiver requisitos rígidos de residência de dados ou auditoria (Bedrock / Vertex / Foundry oferecem opções corporativas).

Observabilidade e controle de custos

- Registre metadados de requisição/resposta (não o conteúdo sensível bruto, a menos que permitido) — contagens de tokens, nível de

effort, latência, ID do modelo e provedor. Essas métricas são essenciais para atribuição de custos e depuração. - Use effort para controlar o custo por chamada: prefira

lowpara sumarização rotineira ou endpoints de alta QPS; usehighpara depuração profunda ou investigações. Monitore qualidade vs. consumo de tokens para definir padrões para diferentes endpoints.

Conclusão — Quando (e como) você deve escolher o Opus 4.5?

O Claude Opus 4.5 é uma escolha natural quando seu produto precisa de:

- raciocínio profundo multietapas (cadeias longas de lógica, pesquisa ou depuração),

- orquestração robusta de agentes/ferramentas (fluxos complexos que invocam APIs externas), ou

- assistência de código em nível de produção em grandes bases de código.

Operacionalmente, use o effort para ajustar orçamentos por chamada; baseie-se no padrão de tool use para manter a segurança de execução e escolha um parceiro de nuvem (ou a API direta da Anthropic) com base em suas necessidades de conformidade. Faça benchmark com seu próprio corpus: números de fornecedor (SWE-bench etc.) são sinais úteis, mas sua tarefa e dados reais determinam o ROI. Para segurança, siga o system card do Opus 4.5 e coloque proteções em torno da execução de ferramentas e do tratamento de PII.

Developers can access Claude Opus 4.5 API through CometAPI. To begin, explore the model capabilities ofCometAPI in the Playground and consult the API guide for detailed instructions. Before accessing, please make sure you have logged in to CometAPI and obtained the API key. CometAPI offer a price far lower than the official price to help you integrate.

Ready to Go?→ Sign up for CometAPI today !

If you want to know more tips, guides and news on AI follow us on VK, X and Discord!