Em 5 de fevereiro de 2026, a Anthropic apresentou o Claude Opus 4.6, o mais novo carro-chefe da família Claude. O Opus 4.6 aprofunda o foco em trabalho de conhecimento de longo horizonte e fluxos de trabalho de software agentic: vem com uma janela de contexto beta de 1,000,000 token, coordenação multiagente refinada chamada Agent Teams e um sistema de raciocínio adaptativo (Adaptive Thinking) controlado por um parâmetro effort. O modelo está disponível por meio da Claude Developer Platform e de APIs agregadoras de terceiros (por exemplo, CometAPI) e é apresentado como uma atualização de substituição direta para muitos casos de uso do Claude.

O que é o Claude Opus 4.6

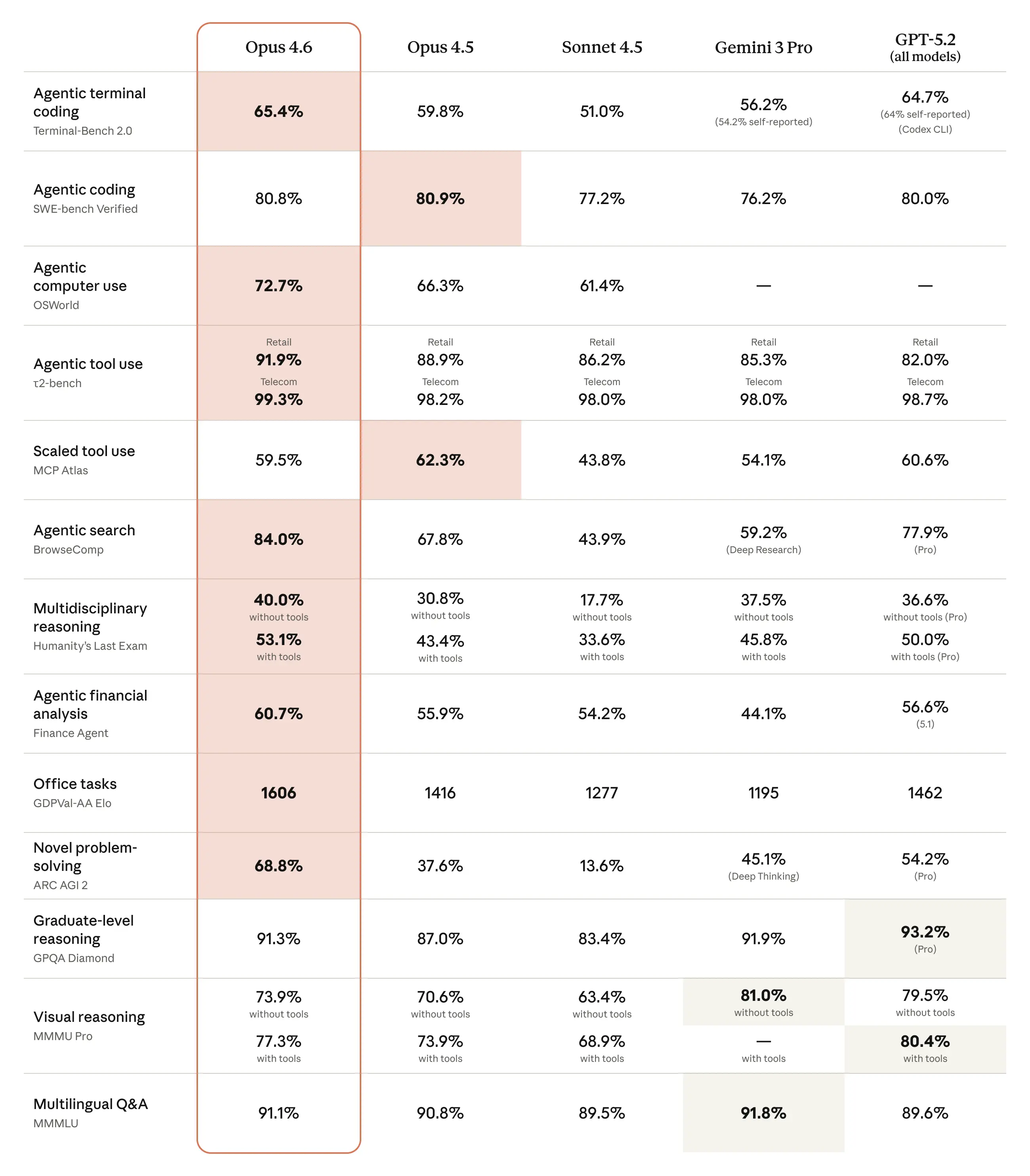

Claude Opus 4.6 é o mais recente modelo da classe Opus da Anthropic, posicionado como o seu modelo mais capaz até o momento para programação, fluxos de trabalho agentic e raciocínio com contexto longo. O lançamento prioriza tarefas “agentic” duradouras (pense em migrações de código em etapas, refatorações de múltiplos arquivos ou agentes de pesquisa coordenados), processamento pesado de documentos e integrações corporativas. A Anthropic descreve o Opus 4.6 como uma atualização quase de substituição direta em relação ao 4.5, mas com várias mudanças de comportamento e capacidade que são importantes para os implementadores.

Capacidades principais do Claude Opus 4.6 para saber de imediato

- Janela de contexto de 1M token (beta): o Opus 4.6 introduz uma janela de contexto muito grande (oferecida em beta pela Anthropic), permitindo que o modelo veja e raciocine sobre documentos extremamente extensos ou bases de código inteiras em uma única sessão. Isso torna tarefas como refatorações de repositórios inteiros, revisões jurídicas longas e sínteses de múltiplos documentos muito mais viáveis.

- Agent Teams: o Opus 4.6 amplia as capacidades de agentes ao permitir grupos coordenados de agentes (Agent Teams) — múltiplos agentes Claude trabalhando em paralelo em diferentes subtarefas e compartilhando estado. Isso foi projetado para permitir que sistemas decomponham problemas difíceis (por exemplo, um agente focado na criação de testes, outro na refatoração e um terceiro em QA) e coordenem seus resultados.

- Adaptive Thinking (níveis de esforço): em vez de uma alternância binária de “pensamento”, o Opus 4.6 expõe múltiplos níveis de esforço (por exemplo, low/medium/high/max) que equilibram latência e custo em troca de uma cadeia de raciocínio mais profunda e mais deliberação. A Anthropic também expõe mecanismos de controle como compactação de contexto para gerenciar conversas longas com eficiência.

- Orçamento de tokens de saída de 128K: o Opus 4.6 dobra o orçamento máximo de saída anterior (64K → 128K), de modo que o modelo possa fornecer saídas mais longas e sustentadas sem truncamento — útil para relatórios em várias partes ou geração de código que abrange muitos arquivos. Recomenda-se streaming para saídas tão grandes.

Outras melhorias práticas incluem melhores habilidades de programação e depuração e opções de modo/prioridade projetadas para fluxos de trabalho corporativos e integrados (a integração de Copilot já está sendo lançada em locais como o GitHub Copilot).

Por que esses recursos importam (visão rápida)

- A janela de 1M token reduz a necessidade de ciclos repetidos de recuperação ou de costurar muitos documentos em várias chamadas — você pode manter mais contexto em uma única chamada, o que simplifica a lógica de aplicação para muitos fluxos de trabalho intensivos em conhecimento.

- Agent Teams mudam a arquitetura: em vez de um único assistente monolítico, você projeta pequenos agentes especialistas que colaboram — paralelização mais fácil, responsabilidades mais claras e potencialmente melhor confiabilidade em tarefas complexas.

- Adaptive Thinking oferece controles previsíveis para equilibrar tempo versus qualidade. Isso é essencial para sistemas de produção em que latência, determinismo e custo são restrições.

Como chamar o Claude Opus 4.6 via CometAPI — passo a passo

Usando o CometAPI para chamar o Opus 4.6

Muitas equipes preferem um gateway unificado multi‑modelo (quando você quer normalizar o código do cliente entre fornecedores). O CometAPI é um desses provedores que expõe muitos modelos de fornecedores por meio de uma única superfície compatível com OpenAI; e o formato de mensagens da Anthropic também é fornecido (quando você precisa das capacidades de compactação específicas da API da Anthropic e quer usar o Claude Code via CometAPI). Os exemplos abaixo mostram padrões para uso em produção: autenticação, escolha de modelo, habilitação de recursos de contexto longo, streaming e controles de custo. (Ajuste nomes e cabeçalhos para corresponder ao registro de modelos do provedor caso o Comet altere identificadores de modelo.)

Primeiros passos (checklist do desenvolvedor)

- registre-se no CometAPI, obtenha uma

COMET_API_KEYe defina obase_urldo cliente comohttps://api.cometapi.com/v1(o Comet oferece clientes e exemplos compatíveis com OpenAI). O console do Comet lista os modelos disponíveis e quaisquer sinalizadores específicos do provedor que você pode repassar. - Decida as configurações de capacidade antecipadamente:

thinking: {type: "adaptive"}, nível deoutput_config.effort,max_tokens(orçamento de saída), streaming para saídas grandes e se a compactação de contexto é desejada.

Claude API (pseudoestilo Python):

import anthropic

import os

# Get your CometAPI key from https://api.cometapi.com/console/token, and paste it here

COMETAPI_KEY = os.environ.get("COMETAPI_KEY") or "<YOUR_COMETAPI_KEY>"

BASE_URL = "https://api.cometapi.com"

client = anthropic.Anthropic(

base_url=BASE_URL,

api_key=COMETAPI_KEY,

)

message = client.messages.create(

model="claude-opus-4-6",

max_tokens=1024,

messages=[{"role": "user", "content": "Hello, Claude"}],

)

print(message.content[0].text)

Via CometAPI (exemplo de shim compatível com OpenAI):

# Example using an OpenAI-like client pointed at CometAPI

from openai import OpenAI # or compatible client

client = OpenAI(api_key="COMET_KEY", base_url="https://api.cometapi.com/v1")

resp = client.responses.create(

model="claude-opus-4-6",

reasoning={"type":"adaptive"}, # if shim supports same param name

output_config={"effort":"medium"},

messages=[{"role":"user","content":"Generate a migration plan for this monorepo."}]

)

print(resp.output_text)

Observação: os nomes de parâmetros nos wrappers do CometAPI variam por SDK. O CometAPI documenta um modelo de integração simples e comumente dá suporte a

model="claude-opus-4-6"; verifique a documentação do CometAPI para o mapeamento exato de campos e quaisquer ajustes necessários no formato da requisição.

Melhores práticas e uso

Agent Teams: padrões de design e uma receita curta

Quando usar Agent Teams: refatorações de grandes bases de código, processamento de documentos em múltiplas etapas e fluxos que se mapeiam naturalmente para agentes especialistas separados (por exemplo, arquiteto, implementador, revisor).

Padrão simples de Agent Teams:

- Agente orquestrador recebe a tarefa geral e a divide em subtarefas.

- Agentes de trabalho (cada um uma instância do Claude) são iniciados com prompts focados e critérios explícitos de sucesso.

- Trabalho em paralelo: os agentes executam em paralelo usando contextos independentes; os resultados são retornados ao orquestrador.

- Mesclar e revisar: o orquestrador compacta as saídas, executa uma passada de síntese e uma verificação final de segurança/revisão (usando

effort=maxpara a passada final, se necessário).

Dicas práticas:

- Dê a cada subagente um prompt de sistema rigoroso e

max_tokenslimitado para evitar custos descontrolados. - Use o CometAPI ou um framework de orquestração para gerenciar chamadas paralelas e novas tentativas.

- Use compactação de contexto para o histórico do orquestrador para preservar decisões sem pagar pelo histórico literal completo.

Gestão de contexto: lidando com entradas grandes e a janela de 1M token

- Prefira ingestão estruturada: forneça documentos como peças segmentadas (metadados do documento + blocos de conteúdo). Mantenha pontos de ancoragem (títulos de documentos, índices) e peça ao modelo para citar fontes por índice. Isso é mais robusto do que colar arquivos brutos.

- Use compactação de contexto (quando disponível) para sessões interativas longas: permita que o modelo resuma interações antigas para não esgotar o orçamento de tokens, mantendo fatos relevantes. A Anthropic fornece compactação como um recurso beta.

- Se você precisar de recall determinístico, armazene artefatos canônicos no seu próprio banco de dados e faça referência a eles por ID em vez de reenviar arquivos inteiros a cada requisição. Use o modelo para resumir ou extrair apenas as partes necessárias para uma determinada etapa.

Trade-offs de custo, latência e qualidade — usando effort e outros ajustes

- Effort: o controle mais eficaz para equilibrar custo vs. capacidade. Comece com

mediumpara sistemas de produção que exigem eficiência; usehighoumaxpara auditorias críticas, revisões finais ou tarefas de síntese complexas.lowé útil para recuperação rotineira ou Q&A curtos. Muitas equipes relatam excelentes economias usandomediumcomo padrão e elevando oeffortapenas quando necessário. - Lote e cache: use cache de prompt para perguntas repetidas e processamento em lote para muitas tarefas pequenas semelhantes, a fim de reduzir custos de reins ingestão de tokens. A plataforma da Anthropic e provedores terceiros dão suporte a cache de prompt/modos em lote.

- Streaming e saídas em partes: ao solicitar saídas muito grandes (geração de código longa, rascunhos de livros), use streaming para reduzir pressão de memória e habilitar aceitação/aborto antecipados.

Considerações finais — onde o Opus 4.6 muda o cálculo do desenvolvedor

O Opus 4.6 é um passo claro rumo à construção de fluxos de trabalho agentic grandes e duráveis sem costurar muitas requisições curtas. A janela de 1M token e os Agent Teams destravam novas classes de aplicações (automação de grandes bases de código, longas revisões jurídicas/financeiras, assistentes de pesquisa de múltiplos documentos), mas também deslocam a ênfase de design de micro‑otimizações de prompt para o design de sistema: como você armazena artefatos, orquestra especialistas, mede e contém custos e monitora o comportamento dos agentes.

Desenvolvedores podem acessar Opus 4.6 via CometAPI agora. Para começar, explore as capacidades do modelo no Playground e consulte o guia da API para instruções detalhadas. Antes de acessar, verifique se você fez login no CometAPI e obteve a chave de API. CometAPI oferece um preço muito inferior ao oficial para ajudar você a integrar.

Pronto para começar?→ Inscreva-se no openclaw hoje !

Se você quiser saber mais dicas, guias e notícias sobre IA, siga-nos no VK, X e Discord!

.png&w=3840&q=75)