LobeChat e CometAPI são dois projetos em rápido desenvolvimento no ecossistema de IA aberta. Em setembro de 2025, o LobeChat uniu uma integração completa com o provedor CometAPI, simplificando a chamada dos endpoints unificados e compatíveis com OpenAI do CometAPI a partir do LobeChat. Este artigo explica o que são LobeChat e CometAPI, por que você deve integrá-los, integração e configuração passo a passo (incluindo uma configuração base do provedor TypeScript pronta para uso), exemplos de tempo de execução, casos de uso concretos e dicas de produção para custo, confiabilidade e observabilidade.

O que é o LobeChat e quais recursos ele oferece?

O LobeChat é um framework de chat moderno e de código aberto, projetado para hospedar aplicativos de chat LLM multiprovedores, com uma interface de usuário e ferramentas de implantação refinadas. Ele foi desenvolvido para suportar entradas multimodais (texto, imagens, áudio), fluxos de trabalho de base de conhecimento/RAG, conversas ramificadas e visualizações de "cadeia de pensamento", além de um sistema de provedor/plugin extensível para que você possa alternar entre diferentes backends de modelo sem precisar rearquitetar seu aplicativo. A documentação e o repositório do LobeChat o apresentam como um framework pronto para produção, tanto para implantações auto-hospedadas quanto na nuvem, com configuração orientada por ambiente e um marketplace para integrações de MCP (plano de controle do modelo) de terceiros.

Principais recursos do LobeChat em resumo

- Suporte a vários provedores (OpenAI, Anthropic, Google Gemini, Ollama, etc.).

- Upload de arquivos + base de conhecimento para fluxos de trabalho RAG (documentos, PDFs, áudio).

- Configuração amigável ao desenvolvedor por meio de variáveis de ambiente e importação de URL de configurações.

- Tempo de execução extensível: os provedores são configurados com pequenos tempos de execução do adaptador para que novos backends sejam conectáveis.

O que é CometAPI?

A CometAPI é uma camada de acesso unificada de IA que expõe mais de 500 modelos de diversos provedores subjacentes por meio de uma única superfície de API compatível com OpenAI. Ela permite que os desenvolvedores escolham endpoints de modelos com base em desempenho, custo ou capacidade sem dependência, além de centralizar o faturamento, o roteamento e o acesso. A CometAPI anuncia endpoints unificados para bate-papo/conclusões e uma API de lista de modelos para descobrir IDs de modelos disponíveis.

Por que o CometAPI é atraente para equipes

- Escolha do modelo e portabilidade: alterne entre muitos modelos de ponta sem alterar significativamente o código de integração.

- Pontos de extremidade compatíveis com OpenAI: muitas bibliotecas e estruturas de clientes que esperam endpoints HTTP no estilo OpenAI podem funcionar com o CometAPI alterando o URL base + autenticação. (Exemplos práticos mostram

https://api.cometapi.com/v1/como uma superfície compatível com OpenAI.) - Documentação e integrações do desenvolvedor: A CometAPI publica documentos e guias passo a passo para integração com ferramentas como LlamaIndex e outras plataformas de baixo código.

Por que você deve integrar o CometAPI ao LobeChat?

Resposta curta: flexibilidade, controle de custos e acesso rápido a novos modelosO LobeChat foi desenvolvido para ser independente de provedor; conectar a CometAPI permite que sua implantação do LobeChat chame diversos modelos diferentes pelo mesmo caminho de código — trocando modelos por taxa de transferência, latência, custo ou capacidade sem alterar sua interface de usuário ou fluxos de prompt. Além disso, a comunidade e os mantenedores adicionaram ativamente o suporte ao provedor CometAPI ao LobeChat, tornando a integração mais suave.

Benefícios comerciais e técnicos

- Diversidade de modelos sem rotatividade de código. Precisa avaliar Gemini, Claude ou um modelo de imagem de nicho? O CometAPI pode expor esses IDs de modelo por meio de uma única API. Isso reduz a quantidade de processamento por provedor no LobeChat.

- Otimização de custos. O CometAPI permite que você direcione para modelos mais baratos ou selecione provedores de menor custo dinamicamente, o que pode reduzir substancialmente os custos por conversa para implantações de alto volume.

- Gerenciamento de segredos mais simples. Uma chave de API para gerenciar nas configurações do LobeChat ou no ambiente Docker, em vez de várias chaves de provedor. A plataforma LobeChat já suporta a ativação de um provedor via

ENABLED_<PROVIDER>e um padrão de variável de ambiente de chave de provedor, para que a integração seja operacionalmente consistente. - Mantém a base de código do LobeChat mínima: a lógica do provedor é encapsulada e configurada com variáveis de ambiente.

Como configuro e integro o CometAPI no LobeChat?

Esta seção fornece uma receita passo a passo prática: obtenha chaves, defina variáveis de ambiente, adicione o provedor ao LobeChat (exemplo de configuração do provedor) e mostre o uso em tempo de execução (chamada de bate-papo). Os exemplos seguem os padrões de provedor do LobeChat e os endpoints compatíveis com o CometAPI OpenAI.

1) Obtenha uma conta CometAPI e uma chave de API

Cadastre-se na CometAPI e abra o console da API. Para criar uma conta na CometAPI, você precisará usar um endereço de e-mail ou fazer login diretamente com o Google One-Click.

Após concluir o registro, vá até o playground e clique em adicionar nova chave secreta para criar uma nova chave de API:

Obtenha uma chave de API.

2) Configurando o CometAPI no LobeChat

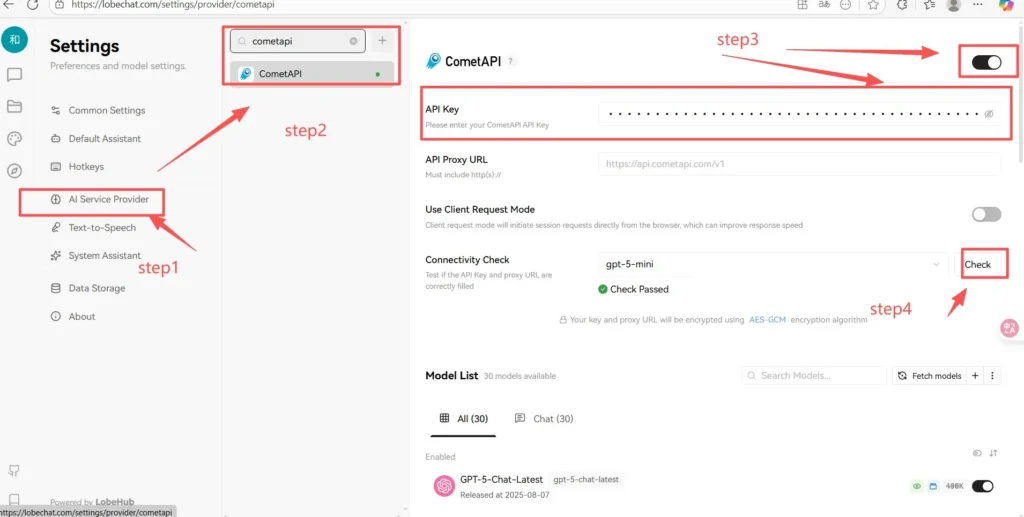

- Entre no menu de configurações do Lobe-Chat, clique no avatar e na opção de configurações do aplicativo.

- Selecione cometapi como o fornecedor do modelo.

- Cole o sk-xxxxx do cometapi na caixa de entrada da chave da API e ative o botão, selecione um modelo para verificar

3) Testando a chamada

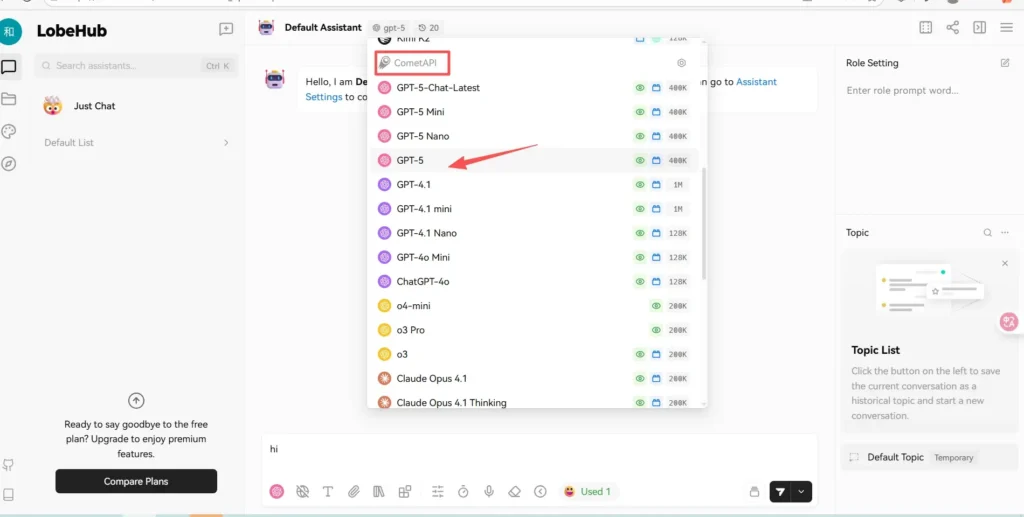

Selecione um modelo da CometAPI para verificar. Insira um comando de teste simples no Lobe-Chat. Se a chamada for bem-sucedida, você receberá uma resposta correspondente; se falhar, verifique se a configuração está correta ou entre em contato com o atendimento ao cliente online da Cometapi.

Atualmente, a cometapi fornece mais de 30 modelos mais recentes de grandes desenvolvedores (openAI, grok, Claude, Gemini) no lobechat.

Como você pode estender a integração (melhorias avançadas)?

Quer ir além do básico? Aqui estão os próximos passos concretos que levarão sua integração do nível funcional ao nível de produção.

Aprimoramento 1: Orquestração dinâmica de modelos (agentes multimodelo)

Crie uma lógica de agente no LobeChat que distribua subtarefas dinamicamente para diferentes modelos Comet (por exemplo, modelo de incorporação pequeno para recuperação, modelo médio para rascunho, modelo de alta capacidade para sumarização). Use o sistema de chamada de função/plugin do LobeChat para coordenar o fluxo de trabalho e agregar as respostas finais.

Aprimoramento 2: Armazenamento em cache de embeddings e respostas

Ao usar embeddings (para RAG), calcule os embeddings uma vez e armazene-os em cache para reduzir a sobrecarga. Se estiver chamando a CometAPI para embeddings, armazene as representações vetoriais no seu banco de dados de vetores e recompute somente quando houver alterações de conteúdo. Isso reduz tokens e custos.

Aprimoramento 3: configuração e cotas por locatário

Se você executar uma instância multilocatária do LobeChat, controle os limites por locatário (solicitações/hora, níveis de modelo) escrevendo um middleware que mapeia o ID do locatário → a lista de modelos permitidos (usando IDs de modelo da CometAPI). Isso habilita níveis premium com acesso a modelos melhores.

Aprimoramento 4: usar metadados do modelo e verificações de integridade

Implemente verificações de integridade do provedor que chamem um "ping de modelo" leve da CometAPI ou uma chamada de chat mínima para garantir que a latência esteja dentro dos SLAs; caso contrário, evite usar modelos de fallback. Mantenha um monitor de pulsação e apresente o status do provedor na interface de administração do LobeChat.

Quais armadilhas você deve ter cuidado?

- Exposição da chave da API: Nunca armazene chaves CometAPI no código do cliente. Sempre as mantenha no lado do servidor (camada de servidor do LobeChat).

- Desvio do nome do modelo: O CometAPI pode adicionar ou descontinuar IDs de modelo. Use um mapeamento de servidor e atualize

COMETAPI_MODEL_LISTquando você quer expor novos modelos. - Diferenças no formato de resposta:Embora o CometAPI tenha como objetivo a compatibilidade com o OpenAI, alguns modelos ou metacampos podem ser diferentes; sempre mapeie e higienize as respostas antes de mostrá-las aos usuários.

Começando a jornada

A CometAPI é uma plataforma de API unificada que agrega mais de 500 modelos de IA de provedores líderes — como a série GPT da OpenAI, a Gemini do Google, a Claude da Anthropic, a Midjourney e a Suno, entre outros — em uma interface única e amigável ao desenvolvedor. Ao oferecer autenticação, formatação de solicitações e tratamento de respostas consistentes, a CometAPI simplifica drasticamente a integração de recursos de IA em seus aplicativos. Seja para criar chatbots, geradores de imagens, compositores musicais ou pipelines de análise baseados em dados, a CometAPI permite iterar mais rapidamente, controlar custos e permanecer independente de fornecedores — tudo isso enquanto aproveita os avanços mais recentes em todo o ecossistema de IA.

Para começar, explore as capacidades do modelo no Playground e consulte o Guia de API para obter instruções detalhadas. Antes de acessar, certifique-se de ter feito login no CometAPI e obtido a chave da API. CometAPI oferecem um preço muito mais baixo que o preço oficial para ajudar você a se integrar.

Pronto para ir?→ Inscreva-se no CometAPI hoje mesmo !

Conclusão

Integrar o CometAPI ao LobeChat é uma maneira prática de obter diversidade de modelos, flexibilidade de custos e capacidade de experimentação rápida, mantendo os recursos refinados de UX e RAG que o LobeChat oferece. A comunidade do LobeChat já fez um esforço substancial para adicionar suporte ao CometAPI (placa de provedor, lista de modelos, adaptadores de tempo de execução, testes e documentação), que você pode aproveitar diretamente ou usar como inspiração para implementar um adaptador personalizado para necessidades específicas. Para obter as etapas de integração mais precisas e os exemplos mais recentes, consulte a documentação do CometAPI e o Documentação do provedor de modelo LobeChat e repositório — os links referenciados abaixo ajudarão você a continuar.