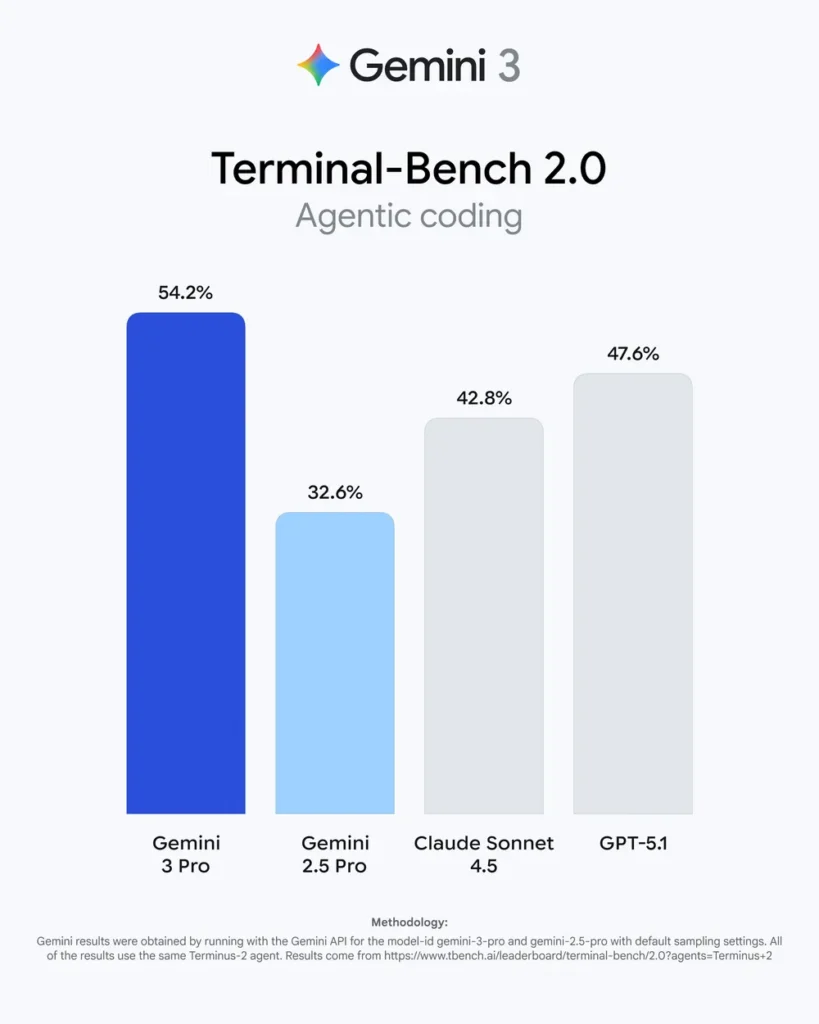

A Google acaba de inaugurar a era do Gemini 3 com o lançamento do Gemini 3 Pro em preview, e os sinais iniciais são inequívocos: trata-se de um grande avanço em raciocínio multimodal, agentes de codificação e compreensão de contexto longo. O modelo é posicionado como o mais capaz em raciocínio e multimodalidade da Google até agora, otimizado para fluxos de trabalho orientados a agentes, programação, tarefas de contexto longo e entendimento multimodal. Ele vem com um novo modo de raciocínio “Deep Think”, apresenta melhorias dramáticas em benchmarks de agentes/código (Terminal-Bench 2.0 citado em 54.2%) e está disponível imediatamente via Google AI Studio, API (integrações do Vertex AI) e ferramentas para desenvolvedores como o Google Antigravity.

O que é o Gemini 3 Pro Preview?

O Gemini 3 é apresentado pela Google como a próxima geração, o membro mais inteligente da família Gemini — focado em raciocínio mais profundo, compreensão multimodal mais rica (texto, imagens, vídeo, áudio, código) e melhor comportamento de agente (modelos que planejam e agem com ferramentas).

Principais recursos

- Compreensão multimodal nativa — criado para aceitar e raciocinar conjuntamente sobre texto, imagens, áudio e vídeo (incluindo entradas longas/de vídeo). Ótimo para combinar documentos, screenshots, transcrições e vídeo.

- Janela de contexto enorme (até ~1,000,000 tokens) — pode ingerir/manter em contexto documentos extremamente longos, grandes bases de código ou horas de transcrições em uma única sessão. Este é um ponto central para pesquisa profunda, revisão de código e síntese entre vários documentos.

- Capacidade de agente/uso de ferramentas — projetado para alimentar agentes autônomos que podem chamar ferramentas, operar terminais, gerenciar planos de tarefas e coordenar fluxos de trabalho de múltiplas etapas (usado no Google Antigravity e outras integrações com IDE). Isso o torna especialmente forte para codificação, orquestração e automação de múltiplas etapas.

- Raciocínio e programação mais fortes — a Google posiciona o Gemini 3 Pro como seu principal modelo “pensante” para raciocínio complexo, matemática e tarefas de código (benchmarks e desempenho em terminal/ferramentas aprimorados).

O que há de novo no Gemini 3 Pro em comparação com o Gemini 2.5 Pro e outros?

Quais capacidades melhoraram mais?

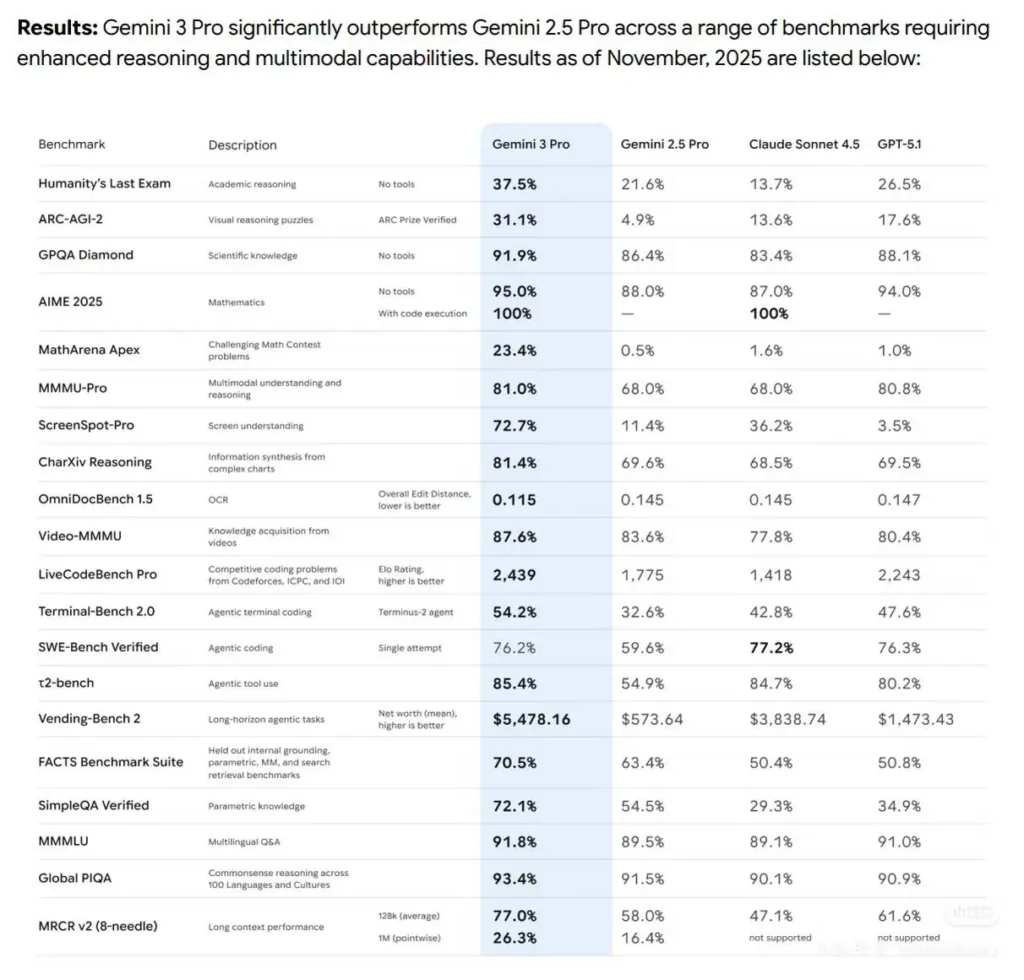

O Gemini 3 Pro é divulgado como um grande salto em raciocínio (matemático e científico), raciocínio espacial/visual multimodal e uso de ferramentas. A Google destaca ganhos claros sobre o Gemini 2.5 Pro em suítes de benchmarks e em tarefas agentivas do mundo real, como programação e automação de terminal. Métricas de destaque divulgadas pela equipe incluem:

| Benchmark / tarefa | Gemini 3 Pro (reportado) | Gemini 2.5 Pro (reportado) | Diferença absoluta (pp) |

|---|---|---|---|

| Humanity’s Last Exam (raciocínio acadêmico, sem ferramentas) | 37.5% | 21.6% | +15.9. |

| GPQA Diamond (QA científico/factual) | 91.9% | 86.4% | +5.5. |

| AIME 2025 (matemática, sem ferramentas) | 95.0% | 88.0% | +7.0. |

| AIME com execução de código | 100.0% | (2.5 Pro: — ) | — (3 Pro atinge pontuação perfeita com execução). |

| ARC-AGI-2 (quebra-cabeças de raciocínio visual) | 31.1% | 4.9% | +26.2 — ganho multimodal muito grande. |

| SimpleQA Verified (conhecimento paramétrico) | 72.1% | 54.5% | +17.6. |

Esses números indicam que o Gemini 3 Pro é otimizado para raciocínio em múltiplas etapas, uso complexo de ferramentas e tarefas multimodais integradas (por exemplo, combinando quadros de vídeo, raciocínio com gráficos e geração de código).

Ferramentas de desenvolvimento com foco em agentes: Antigravity

Para demonstrar fluxos de trabalho orientados a agentes, a Google lançou o Antigravity — um IDE “agent-first” que usa o Gemini 3 Pro como base para fluxos de trabalho de programação multiagente. O Antigravity permite que agentes interajam diretamente com um editor, terminal e navegador, e produzam “Artifacts” (listas de tarefas, screenshots, registros de navegação) que documentam as ações do agente — abordando rastreabilidade e reprodutibilidade no desenvolvimento com agentes. Isso torna o Gemini 3 Pro muito mais prático para fluxos de trabalho reais de desenvolvedores do que modelos que focam apenas na geração de texto.

Melhor uso de ferramentas e programação

A Google relata melhorias dramáticas em um benchmark centrado em terminal (Terminal-Bench 2.0) que mede a capacidade de um modelo de operar um computador via terminal: o Gemini 3 Pro marca 54.2% nesse teste — um grande salto em relação às versões anteriores do Gemini — indicando progresso real no uso autônomo de ferramentas e na geração de código.

… especialmente quando solicitado a executar scripts, orquestrar ferramentas ou gerenciar tarefas de desenvolvedor com múltiplas etapas. Na prática, isso significa menos alucinações ao executar comandos, melhor tratamento de erros e maior capacidade de se recuperar de etapas com falha.

Como o Gemini 3 Pro se sai em benchmarks

A Google publicou uma ampla suíte de comparações de benchmarks no post do Gemini 3 que abrangem raciocínio clássico de PLN, compreensão multimodal, geração de código e uso de ferramentas por agentes. Números-chave relatados diretamente pela Google incluem:

- LMArena: o Gemini 3 Pro marcou 1501 Elo, uma colocação de topo no ranking competitivo (medindo raciocínio geral/qualidade de resposta em confrontos pareados).

- MMMU-Pro (benchmark multimodal): 81% — um aumento considerável em relação a modelos anteriores.

- Video-MMMU: 87.6% em tarefas multimodais com percepção de vídeo.

- SimpleQA Verified: 72.1%, indicando melhorias em QA factual para entradas complexas.

- WebDev Arena: 1487 Elo (desenvolvimento web / raciocínio de código).

- Terminal-Bench 2.0 & SWE-bench Verified: grandes saltos em uso de ferramentas por agentes e desempenho de agentes de programação.

- Deep Think: ganhos adicionais nos testes de maior dificuldade (por exemplo, o Humanity’s Last Exam melhorou de 37.5% para 41.0% no Deep Think em algumas métricas relatadas).

Tudo isso indica um modelo ajustado para profundidade, e não apenas para geração superficial de texto.

Então: sim, o Gemini 3 Pro está consistentemente no nível superior em muitos testes hoje — mas “esmagar” depende da tarefa. Para geração de código pura, alguns concorrentes continuam lado a lado; para contexto longo, matemática e síntese multimodal, o Gemini 3 Pro é frequentemente apontado como o melhor da categoria nas execuções de início de novembro/novembro de 2025.

Como acessar o Gemini 3 Pro Preview?

Pontos de entrada oficiais

A Google disponibilizou o Gemini 3 Pro em preview em várias superfícies:

- App Gemini (consumidor / usuários Pro): O modelo está sendo lançado no app Gemini como parte da estreia da era “Gemini 3”.

- Google AI Studio / Gemini Developer API: Desenvolvedores podem experimentar via AI Studio e a Gemini Developer API. A API tem interfaces REST e SDK e oferece recursos avançados como chamadas de função e streaming.

- Vertex AI (Google Cloud): Empresas e equipes podem acessar o Gemini 3 Pro por meio do Vertex AI para fluxos de trabalho de produção e MLOps. O Vertex oferece exemplos em Python, Node, Java, Go e curl.

- Third-party integrations (CometAPI): A CometAPI fornece acesso à API do Gemini 3 Pro, com o nome de chamada sendo gemini-3-pro-preview. A CometAPI oferece um preço muito inferior ao oficial para ajudar você na integração.

Início rápido: exemplo em Python (padrão do SDK oficial)

Abaixo está um exemplo mínimo e prático, adaptado do quickstart do Gemini da Google, que demonstra a chamada à API do Gemini via cliente GenAI da Google. Substitua GEMINI_API_KEY pela sua chave de API obtida no Google AI Studio ou no seu projeto GCP.

# Exemplo: chamar o Gemini 3 Pro Preview usando o SDK Python do Google GenAI

# Requisitos: pip install google-generativeai

import os

from google import genai

# Defina a chave de API no ambiente:

# export GEMINI_API_KEY="YOUR_API_KEY"

client = genai.Client() # o cliente obtém GEMINI_API_KEY do ambiente

# Use o identificador do modelo em preview. O ID exato pode variar; use o ID listado na documentação da API.

model_id = "gemini-3-pro-preview" # ou "gemini-3-pro" dependendo da disponibilidade

prompt = """

Você é um assistente que escreve uma função Python curta para buscar JSON de uma URL,

tratar erros HTTP e retornar o JSON analisado ou None em caso de falha.

"""

resp = client.models.generate_content(model=model_id, contents=prompt)

print("RESPOSTA DO MODELO:\n", resp.text)

Se você optar pela CometAPI, substitua url por https://api.cometapi.com/v1/chat/completions e key pela chave obtida da CometAPI.

Como obter os melhores resultados — padrões de prompt e dicas

Use o modo “thinking” para problemas difíceis

Se você estiver resolvendo tarefas progressivas de raciocínio ou problemas complexos de matemática/código, ative a variante “thinking” do preview (se disponível) — ela aloca mais etapas internas de raciocínio e frequentemente produz soluções mais confiáveis em tarefas multietapas. Verifique nomes de modelos com o sufixo -thinking no console.

Chamadas de função e orquestração de ferramentas

Use funções declaradas (function calling do Vertex AI/GenAI) para saídas estruturadas e confiáveis e para reduzir alucinações. Deixe o modelo propor chamadas de função e execute-as de forma determinística no seu ambiente. A documentação de chamadas de função inclui exemplos de retorno de argumentos JSON tipados que você pode executar com segurança.

Grounding quando você precisa de fatos atualizados

Se o seu app depende de fatos atuais da web, use grounding na web, mas fique atento aos custos e limites de taxa de prompts com grounding. O grounding é poderoso — permite que o Gemini consulte o Search ou o Maps —, porém cada prompt com grounding pode alterar sua cobrança e latência.

Como o Gemini 3 Pro se posiciona em tarefas do mundo real (casos de uso)

Geração de código e produtividade do desenvolvedor

O Gemini 3 Pro melhora o raciocínio entre vários arquivos, o contexto de repositórios grandes e a síntese de testes/documentação junto com o código. Em conjunto com chamadas de função e um agente de terminal, ele pode estruturar e validar projetos de médio porte mais rápido do que modelos antigos. Testes da comunidade mostram pontuações elevadas em LiveCodeBench/Elo de codificação.

Pesquisas e fluxos de trabalho em STEM

A capacidade Deep Think do modelo e o orçamento de raciocínio maior o tornam adequado para tarefas de pesquisa que exigem derivações matemáticas multietapas, síntese de conjuntos de dados ou sumarização de artigos com múltiplos arquivos. Resultados iniciais de benchmarks o colocam no topo ou próximo ao topo em muitos conjuntos de dados de STEM.

Design de conteúdo e fluxos criativos multimodais

As saídas multimodais do Gemini 3 Pro e a integração com Veo/Whisk/Flow o tornam uma ótima escolha para fluxos que mesclam texto, imagens e vídeo — de roteiros de marketing a rascunhos automatizados de vídeo. A Google agrupa certas ferramentas de criação no AI Ultra para criadores que desejam os limites mais altos.

Conclusão: o Gemini 3 Pro supera outros modelos?

O Gemini 3 Pro Preview é um grande passo à frente. Em uma ampla gama de benchmarks e em testes iniciais do mundo real, ele frequentemente lidera ou empata com os melhores modelos disponíveis no fim de 2025, especialmente em:

- Raciocínio complexo (matemática / STEM)

- Compreensão e síntese multimodal

- Fluxos de trabalho orientados a agentes e chamadas de função

No entanto, a margem varia conforme a tarefa. Para algumas tarefas mais estreitas (certos estilos de escrita criativa ou conhecimento de domínio muito especializado), outros modelos ainda podem ser competitivos ou preferíveis dependendo de custo/latência e adequação ao ecossistema. Benchmarks e pontuações vazadas sugerem que o Gemini 3 Pro frequentemente ocupa o topo, mas “esmagar” depende da tarefa — para muitos casos de uso empresariais e de desenvolvedores, o Gemini 3 Pro agora é o primeiro modelo a ser avaliado.

Como começar com a CometAPI

A CometAPI é uma plataforma de API unificada que agrega mais de 500 modelos de IA de provedores líderes — como a série GPT da OpenAI, Gemini da Google, Claude da Anthropic, Midjourney, Suno e outros — em uma única interface amigável para desenvolvedores. Ao oferecer autenticação consistente, formatação de requisição e tratamento de resposta padronizados, a CometAPI simplifica drasticamente a integração de capacidades de IA aos seus aplicativos. Esteja você criando chatbots, geradores de imagens, compositores de música ou pipelines de análises orientadas a dados, a CometAPI permite iterar mais rápido, controlar custos e permanecer independente de fornecedor — enquanto acessa os avanços mais recentes em todo o ecossistema de IA.

Os desenvolvedores podem acessar a Gemini 3 Pro Preview API por meio da CometAPI. Para começar, explore os recursos de modelos da CometAPI no Playground e consulte o guia da API para instruções detalhadas. Antes de acessar, certifique-se de ter feito login na CometAPI e obtido a chave de API. A CometAPI oferece um preço muito inferior ao oficial para ajudar você a integrar.

Pronto para começar? → Cadastre-se na CometAPI hoje!

Se quiser saber mais dicas, guias e novidades sobre IA, siga-nos no VK, X e Discord!