A API Kimi K2 é um modelo de linguagem Mixture-of-Experts de código aberto, com trilhões de parâmetros e uma janela de contexto de 256 mil tokens, otimizado para codificação de alto desempenho, raciocínio agêntico e inferência eficiente.

Kimi K2-0905 é o mais recente modelo de IA lançado pela Darkside of the Moon Technology Co., Ltd. Ele possui poderosos recursos de assistência à programação, destacando-se na geração de código e no desenvolvimento front-end. Seu comprimento de contexto é estendido para 256 KB, suportando tarefas complexas. A alta velocidade de saída da API do modelo atinge 60 a 100 tokens/segundo, garantindo tempos de resposta rápidos.

O modelo é compatível com a API Anthropic, suporta a ferramenta WebSearch e oferece uma experiência aprimorada com o Claude Code. Ele também fornece cache de contexto automático para reduzir os custos para o usuário. Os usuários agora podem experimentá-lo por meio da CometAPI (kimi-k2-250905).

Informações básicas e recursos

- Nome do modelo: Kimi K2

- Arquitetura: Mistura de Especialistas (MoE)

- Parâmetros totais: 1 trilhão

- Parâmetros ativados: 32 bilhões por passe para frente

- Comprimento do contexto: 256 mil tokens

- Tamanho do vocabulário: 160 mil tokens

- Casos de uso primário: Codificação, integração de ferramentas, decomposição de tarefas complexas, raciocínio geral.

Arquitetura Técnica

Kimi K2 emprega um 384‑especialista do Ministério da Educação design, seleção 8 especialistas por token para equilibrar o desempenho com a eficiência da inferência. Inclui 61 camadas , incluindo 1 camada densa, e utiliza Atenção Multicamadas (MLA) ao lado do SwiGLU função de ativação. O treinamento alavancou a Otimizador de múons Acima de 15.5 trilhões de tokens, garantindo estabilidade e alto rendimento em diversos benchmarks.

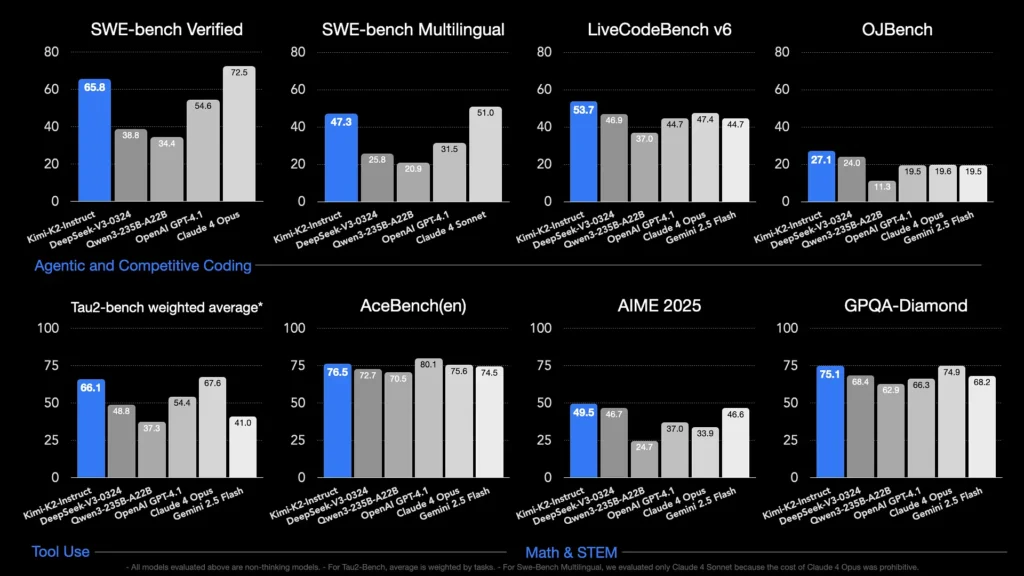

Desempenho de referência

- Verificado pelo SWE-bench: Precisão de 65.8% em uma única tentativa, superando os 4.1% do GPT‑54.6 e ficando atrás apenas do Claude Sonnet 4 entre os principais modelos.

- Banco SWE multilíngue: Precisão de 47.3%, liderando os concorrentes de código aberto.

- LiveCodeBench: 53.7%, o maior entre os modelos não proprietários.

- EvalPlus: 80.3, superando as séries DeepSeek‑V3 e Qwen 2.5.

Esses resultados ressaltam o Kimi K2 proficiência em codificação de última geração e capacidades de raciocínio robustas.

Como chamar a API do Kimi K2 a partir do CometAPI

Kimi K2 Preços da API no CometAPI, 20% de desconto sobre o preço oficial:

- Tokens de entrada: $0.11/ M tokens

- Tokens de saída: US$ 1.99/M tokens

Etapas Necessárias

- Faça o login no cometapi.com. Se você ainda não é nosso usuário, registre-se primeiro

- Obtenha a chave de API da credencial de acesso da interface. Clique em "Adicionar Token" no token da API no centro pessoal, obtenha a chave de token: sk-xxxxx e envie.

- Obtenha a URL deste site: https://api.cometapi.com/

Use o método

- Selecione a opção "

kimi-k2-0711-preview” endpoint para enviar a solicitação de API e definir o corpo da solicitação. O método e o corpo da solicitação são obtidos da documentação da API do nosso site. Nosso site também oferece o teste Apifox para sua conveniência. - Substituir com sua chave CometAPI real da sua conta.

- Insira sua pergunta ou solicitação no campo de conteúdo — é a isso que o modelo responderá.

- . Processe a resposta da API para obter a resposta gerada.

A CometAPI fornece uma API REST totalmente compatível — para uma migração perfeita. Detalhes importantes para Doc API:

- URL base: https://api.cometapi.com/v1/chat/completions

- Nomes de modelo: "

kimi-k2-250905" - Autenticação: Token portador via

Authorization: Bearer YOUR_CometAPI_API_KEYcabeçalho - Tipo de conteúdo:

application/json.

Integração de API e exemplos

Kimi K2 é acessível via CometAPI (compatível com OpenAI) e o API de IA do Moonshot. Abaixo está um trecho de Python para um Conclusão do bate-papo chamada através do CometAPI:

Trecho em Python para um Conclusão do bate-papo chamada através do CometAPI:

pythonimport openai

openai.api_key = "YOUR_CometAPI_API_KEY"

openai.api_base = "https://api.cometapi.com/v1/chat/completions"

messages = [

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Summarize Kimi K2's main features."}

]

response = openai.ChatCompletion.create(

model="kimi-k2-250905",

messages=messages,

temperature=0.7,

max_tokens=500

)

print(response.choices.message)