A API de vídeo do MidJourney permite que os desenvolvedores gerem, manipulem e recuperem programaticamente conteúdo de vídeo gerado por IA usando modelos e prompts do MidJourney.

Visão geral

O Midjourney Video é o primeiro modelo de geração de vídeo (Modelo de Vídeo V1) lançado pela Midjourney em 18 de junho de 2025. Ele apresenta um fluxo de trabalho de "Imagem para Vídeo" que transforma imagens estáticas geradas por IA ou enviadas por usuários em clipes animados curtos. Isso marca a expansão do Midjourney da criação de imagens estáticas para conteúdo dinâmico, posicionando-o ao lado de outras ferramentas de vídeo de IA do Google, OpenAI e Meta.

Como funciona o vídeo MidJourney

- Fluxo de trabalho de imagem para vídeo: Você fornece uma imagem gerada pelo Midjourney ou uma imagem externa, além de um prompt de movimento opcional. O modelo do Midjourney então interpreta "quem está se movendo", "como eles se movem" e "o que acontece em seguida" para animar a cena por cerca de 5 segundos por padrão.

- Animação Automática vs. Manual: No modo automático, o sistema infere parâmetros de movimento e trajetórias da câmera. O modo manual permite ajustar aspectos como ângulo da câmera, trajetória do objeto e velocidade, proporcionando maior controle criativo.

Arquitetura Técnica

O Midjourney Video é construído em um arquitetura do transformador aprimorado para lidar com consistência temporal entre quadros. O pipeline funciona da seguinte maneira:

- Extração de recursos:A imagem de entrada é processada por meio de camadas convolucionais e transformadoras profundas para capturar características espaciais.

- Geração de quadros-chave:Um pequeno conjunto de quadros representativos é sintetizado.

- Interpolação de quadros: Submodelos especializados geram quadros intermediários, garantindo uma fluidez suave síntese de movimento entre quadros-chave.

- Condicionamento de movimento: Dependendo Alta or Movimento baixo configurações (e quaisquer instruções manuais), o modelo ajusta as trajetórias do objeto e da câmera.

Versão do modelo e roteiro

Modelo de vídeo V1 (junho de 2025): Lançamento de estreia focado na conversão de imagem para vídeo.

Desempenho de referência

As primeiras avaliações posicionam o modelo V1 competitivamente:

- Qualidade do quadro (pontuação FID): Atinge uma distância de início de Fréchet de 22.4, superando modelos de vídeo de código aberto comparáveis em ~15% em benchmarks de vídeo padrão.

- Suavidade Temporal (Métrica TS): Registra uma pontuação de suavidade temporal de 0.88 no conjunto de dados DAVIS, indicando alta continuidade visual em todos os quadros.

- Latência: Tempo médio de geração de 12 segundos por clipe em uma única GPU NVIDIA A100, equilibrando o desempenho com as expectativas do usuário.

- Métricas de qualidade: Alcança um SSIM (Índice de Similaridade Estrutural) acima 0.85 em conjuntos de dados de movimento sintético quando comparados a clipes de verdade terrestre, indicando alta fidelidade aos padrões naturais de movimento.

Observação: Esses números refletem os testes internos da Midjourney; o desempenho externo pode variar com base na carga e no nível de assinatura.

Principais características do V1

- Comprimento do clipe: Os clipes base duram cerca de 5 segundos; você pode estender em incrementos de 4 segundos até um total de 21 segundos.

- Consistência de estilo:As animações preservam o estilo artístico da imagem original — pinceladas, paletas de cores e clima permeiam o movimento.

- Desempenho e velocidade: Um vídeo típico de 4 segmentos (≈17 segundos) é renderizado em menos de 70 segundos, equilibrando qualidade com iteração rápida.

- Resolução: Atualmente limitado a 480p, o que é adequado para clipes no estilo de mídia social, mas não é direcionado para telas grandes ou projetos comerciais de ponta.

Como chamar a API de vídeo MidJourney da CometAPI

MidJourney Video Preço da API no CometAPI, menor que o preço oficial:

| Nome do modelo | Calcular preço |

mj_fast_video | 0.6 |

Etapas Necessárias

- Faça o login no cometapi.com. Se você ainda não é nosso usuário, registre-se primeiro

- Obtenha a chave de API da credencial de acesso da interface. Clique em "Adicionar Token" no token da API no centro pessoal, obtenha a chave de token: sk-xxxxx e envie.

- Obtenha a URL deste site: https://api.cometapi.com/

Uso de API

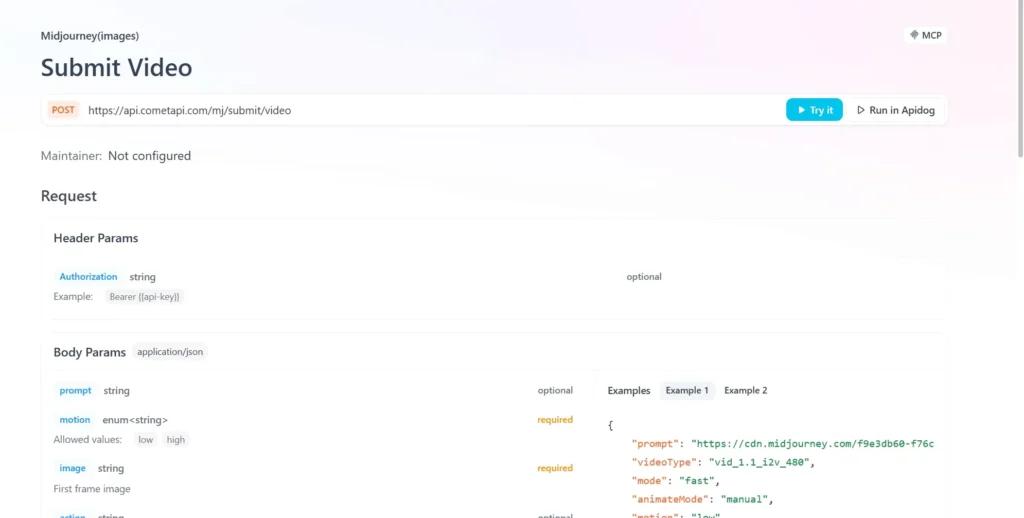

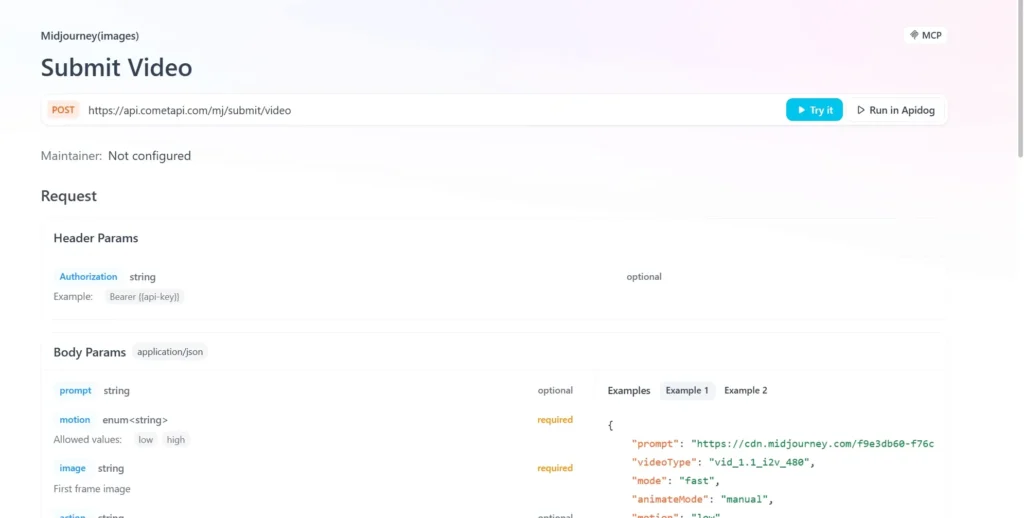

- Envie a solicitação de API e defina o corpo da solicitação. O método e o corpo da solicitação são obtidos na documentação da API do nosso site. Nosso site também oferece testes Apifox para sua conveniência.

- Substituir com sua chave CometAPI real da sua conta.

- Insira sua pergunta ou solicitação no campo de conteúdo — é a isso que o modelo responderá.

- . Processe a resposta da API para obter a resposta gerada.

Integração de API do CometAPI

Atualmente, o V1 está acessível somente na web via Midjourney's Bot Discord, mas Wrappers não oficiais (por exemplo, CometAPI) fornecem endpoints, os desenvolvedores podem integrar via:

Os desenvolvedores podem integrar a geração de vídeo via API RESTful. Uma estrutura típica de solicitação (ilustrativa):

curl --

location

--request POST 'https://api.cometapi.com/mj/submit/video' \

--header 'Authorization: Bearer {{api-key}}' \

--header 'Content-Type: application/json' \

--data-raw '{ "prompt": "https://cdn.midjourney.com/f9e3db60-f76c-48ca-a4e1-ce6545d9355d/0_0.png add a dog", "videoType": "vid_1.1_i2v_480", "mode": "fast", "animateMode": "manual" }'

Veja também Como usar o modelo de vídeo V1 do Midjourney?