O que é a API GPT-5.2

A API GPT-5.2 é a mesma que o GPT-5.2 Thinking no ChatGPT. GPT-5.2 Thinking é a variante intermediária da família GPT-5.2 da OpenAI, projetada para trabalho mais aprofundado: raciocínio em múltiplas etapas, sumarização de documentos longos, geração de código de qualidade e trabalho profissional baseado em conhecimento, onde precisão e estrutura utilizável importam mais do que a vazão bruta. Na API, ela é exposta como o modelo gpt-5.2 (Responses API / Chat Completions), e situa-se entre a variante Instant de baixa latência e a variante Pro de maior qualidade, porém mais cara.

Principais recursos

- Contexto muito longo e compactação: janela efetiva de 400K e ferramentas de compactação para gerenciar relevância em conversas e documentos longos.

- Esforço de raciocínio configurável:

none | medium | high | xhigh(xhigh habilita o máximo de computação interna para raciocínios difíceis).xhighestá disponível nas variantes Thinking/Pro. - Suporte mais robusto a ferramentas e funções: chamadas de ferramentas de primeira classe, gramáticas (CFG/Lark) para restringir saídas estruturadas e comportamentos agênticos aprimorados que simplificam automações complexas em múltiplas etapas.

- Compreensão multimodal: compreensão mais rica de imagem + texto e integração em tarefas de múltiplas etapas.

- Segurança aprimorada / tratamento de conteúdo sensível: intervenções direcionadas para reduzir respostas indesejáveis em áreas como autolesão e outros contextos sensíveis.

Capacidades técnicas e especificações (visão do desenvolvedor)

- Endpoints de API e IDs de modelo:

gpt-5.2para Thinking (Responses API),gpt-5.2-chat-latestpara fluxos de chat/instantâneos, egpt-5.2-propara o nível Pro; disponíveis via Responses API e Chat Completions quando indicado. - Tokens de raciocínio e gestão de esforço: a API suporta parâmetros explícitos para alocar computação (esforço de raciocínio) por requisição; maior esforço aumenta a latência e o custo, mas melhora a qualidade de saída em tarefas complexas.

- Ferramentas de saída estruturada: suporte a gramáticas (Lark / CFG) para restringir a saída do modelo a uma DSL ou sintaxe exata (útil para SQL, JSON e geração de DSL).

- Chamadas paralelas de ferramentas e coordenação agêntica: paralelismo aprimorado e orquestração de ferramentas mais limpa reduzem a necessidade de prompts de sistema elaborados e de andaimes multiagente.

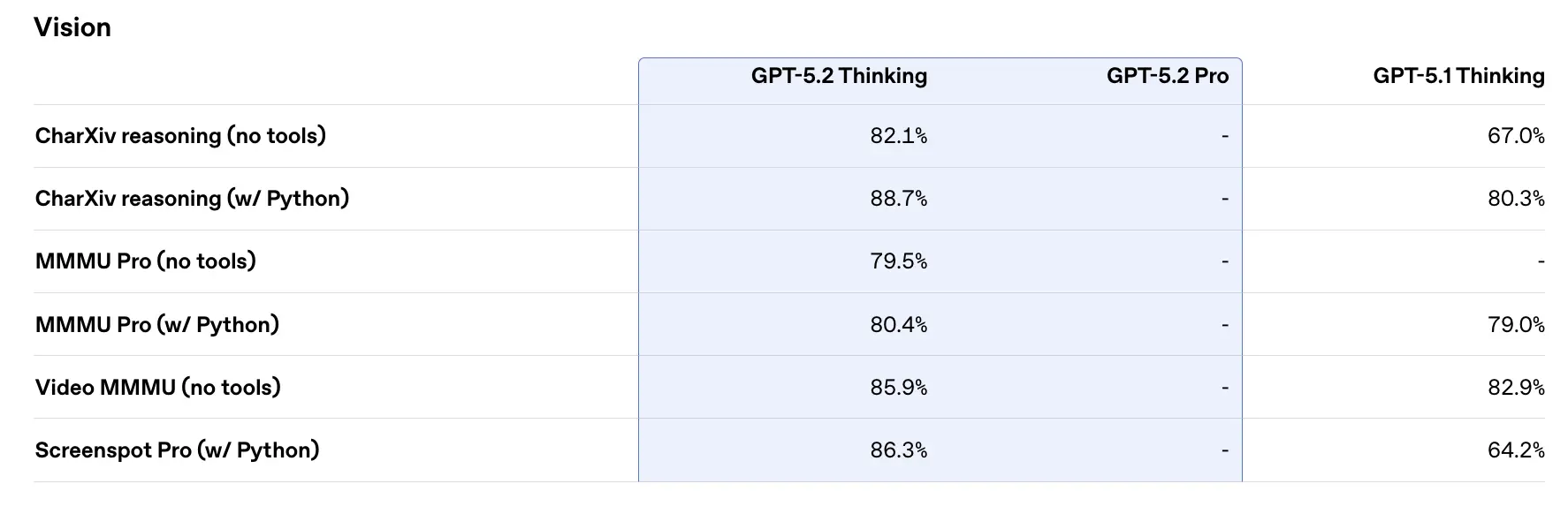

Desempenho em benchmarks e dados de suporte

A OpenAI publicou uma variedade de resultados de benchmarks internos e externos para o GPT-5.2. Destaques selecionados (números reportados pela OpenAI):

- GDPval (44 ocupações, trabalho do conhecimento) — GPT-5.2 Thinking “supera ou empata com os melhores profissionais do setor em 70.9% das comparações”; a OpenAI relata que as saídas foram produzidas a >11× a velocidade e <1% do custo de profissionais especialistas em suas tarefas do GDPval (estimativas de velocidade e custo baseadas em dados históricos). Essas tarefas incluem modelos de planilhas, apresentações e vídeos curtos.

- SWE-Bench Pro (codificação) — GPT-5.2 Thinking alcança ≈55.6% no SWE-Bench Pro e ~80% no SWE-Bench Verified (apenas Python), segundo a OpenAI, estabelecendo um novo estado da arte para avaliação de geração de código/engenharia em seus testes. Isso se traduz em depuração mais confiável e correções ponta a ponta na prática, de acordo com os exemplos da OpenAI.

- GPQA Diamond (perguntas e respostas em nível de pós-graduação em ciências) — GPT-5.2 Pro: 93.2%, GPT-5.2 Thinking: 92.4% no GPQA Diamond (sem ferramentas, raciocínio máximo).

- Série ARC-AGI — No ARC-AGI-2 (um benchmark mais difícil de raciocínio fluido), o GPT-5.2 Thinking obteve 52.9% e o GPT-5.2 Pro 54.2% (a OpenAI afirma que estes são novos recordes do estado da arte para modelos com estilo de chain-of-thought).

- Long-context (OpenAI MRCRv2) — O GPT-5.2 Thinking mostra precisão próxima de 100% na variante MRCR de 4 agulhas até 256k tokens e pontuações substancialmente melhores vs GPT-5.1 em cenários de contexto longo. (A OpenAI publicou gráficos e tabelas do MRCRv2.)

Comparação com contemporâneos

- vs Google Gemini 3 (Gemini 3 Pro / Deep Think): O Gemini 3 Pro foi divulgado com uma janela de contexto de ~1,048,576 (≈1M) tokens e entradas multimodais amplas (texto, imagem, áudio, vídeo, PDFs) e fortes integrações agênticas via Vertex AI / AI Studio. No papel, a janela de contexto maior do Gemini 3 é um diferencial para cargas de trabalho de sessão única extremamente grandes; as compensações incluem a superfície de ferramentas e o ajuste ao ecossistema.

- vs Anthropic Claude Opus 4.5: O Opus 4.5 da Anthropic enfatiza fluxos de trabalho corporativos de codificação/agentes e relata fortes resultados no SWE-bench e robustez para longas sessões agênticas; a Anthropic posiciona o Opus para automação e geração de código com uma janela de contexto de 200k e integrações especializadas de agente/Excel. O Opus 4.5 é um forte competidor em automação empresarial e tarefas de código.

Conclusão prática: O GPT-5.2 mira um conjunto equilibrado de melhorias (contexto de 400K, saídas de tokens altas, raciocínio/codificação aprimorados). O Gemini 3 mira os maiores contextos de sessão única (≈1M), enquanto o Claude Opus foca em engenharia empresarial e robustez agêntica. Escolha combinando tamanho de contexto, necessidades de modalidade, adequação de recursos/ferramentas e trade-offs de custo/latência.

Como acessar e usar a API GPT-5.2

Etapa 1: Cadastre-se para obter a chave de API

Faça login em cometapi.com. Se você ainda não é nosso usuário, registre-se primeiro. Entre no seu console CometAPI. Obtenha a chave de API de credenciais de acesso da interface. Clique em “Add Token” no token da API no centro pessoal, obtenha a chave do token: sk-xxxxx e envie.

Etapa 2: Envie solicitações para a API GPT-5.2

Selecione o endpoint “gpt-5.2” para enviar a solicitação à API e defina o corpo da solicitação. O método e o corpo da solicitação são obtidos na documentação da API em nosso site. Nosso site também fornece teste no Apifox para sua conveniência. Substitua <YOUR_API_KEY> pela sua chave CometAPI real da sua conta. Os desenvolvedores chamam isso via a Responses API / Chat endpoints.

Insira sua pergunta ou solicitação no campo de conteúdo — é isso que o modelo responderá. Processe a resposta da API para obter a resposta gerada.

Etapa 3: Recupere e verifique os resultados

Processe a resposta da API para obter a resposta gerada. Após o processamento, a API responde com o status da tarefa e os dados de saída.

Veja também Gemini 3 Pro Preview API