Integrar o CometAPI ao n8n permite potencializar suas automações com os modelos de IA mais avançados do mundo em apenas três etapas. Usando uma única credencial compatível com OpenAI, você obtém acesso instantâneo a mais de 500 modelos, incluindo GPT 5.5, Claude Opus 4.7 e DeepSeek V4 Pro. Essa configuração é idêntica tanto para instâncias n8n em nuvem quanto auto-hospedadas, oferecendo uma base estável e de alta disponibilidade para sua automação de workflows de IA no n8n.

O que é o n8n e por que isso importa

n8n é uma ferramenta de automação de workflows de código aberto. Ela permite conectar diferentes apps, serviços e APIs para automatizar tarefas—sem precisar escrever muito código.

O que ele faz

Pense no n8n como uma forma visual de construir automações:

- Você cria workflows usando um editor de arrastar e soltar

- Cada etapa (chamada de nó) executa uma ação

- Os dados fluem automaticamente de uma etapa para a seguinte

Principais recursos

- Código aberto (você pode auto-hospedá-lo)

- Suporta centenas de integrações (APIs, apps, bancos de dados)

- Permite lógica JavaScript personalizada dentro dos workflows

- Pode rodar no seu próprio servidor ou via o serviço em nuvem no site oficial do n8n

Por que conectar o n8n ao CometAPI

Usar o CometAPI como seu gateway central no n8n traz vantagens operacionais significativas. Ao substituir chaves separadas para OpenAI, Anthropic e Google por uma única credencial, sua equipe elimina a sobrecarga de gerenciar múltiplas contas de fornecedores e ciclos de faturamento complexos. Essa arquitetura garante zero lock-in de fornecedor; você pode alternar entre os modelos mais recentes de diferentes provedores apenas atualizando o nome do modelo nas configurações do nó, mantendo seus workflows ágeis conforme o cenário de IA evolui.

O CometAPI funciona como uma API REST unificada, agregando 500+ modelos para chat, imagem, vídeo, áudio (TTS/STT) e embeddings. Principais benefícios incluem:

- Endpoint compatível com OpenAI (

https://api.cometapi.com/v1): compatibilidade plug-and-play com nós do OpenAI ou HTTP Request. - Preços 20–40% mais baixos do que fornecedores diretos, com pagamento conforme o uso, sem mensalidades para o básico e faturamento unificado.

- Sem lock-in de fornecedor: troque de modelo alterando um único parâmetro.

- Recursos empresariais: roteamento com failover, analytics, controles de privacidade (sem coleta de prompts, conforme afirmado em algumas discussões) e acesso confiável.

Últimos desenvolvimentos (em maio de 2026): o CometAPI mantém uma integração verificada/parceira no n8n.io, com um nó comunitário dedicado (n8n-nodes-cometapi) disponível via npm para instâncias locais/auto-hospedadas. Usuários relatam compatibilidade fluida com nós OpenAI e adoção crescente para workflows multimodelos. Atualizações recentes do n8n aprimoram tool-calling e nós HTTP, tornando as integrações mais robustas.

Primeiros passos: Pré-requisitos e configuração da conta

Crie uma conta no CometAPI

Visite cometapi.com, crie uma conta gratuita e gere uma chave de API no dashboard. Novos usuários geralmente recebem créditos de teste. Explore a lista de modelos e a página de preços.

Configure o n8n

- Cloud: n8n.cloud (gerenciado, escalonamento simples).

- Auto-hospedado: Docker, npm ou Kubernetes. Recomendado para privacidade de dados e execuções ilimitadas. Guias recentes cobrem a execução dos nós CometAPI localmente.

Atualize para a versão mais recente (por exemplo, 2.20+ em maio de 2026) para melhorias de IA e estabilidade.

Instalar o nó CometAPI (opcional, mas recomendado para auto-hospedado)

Use o nó da comunidade:

npm install n8n-nodes-cometapi

Reinicie o n8n. Ele aparecerá no painel de nós para uma experiência similar à nativa.

Guia de configuração passo a passo

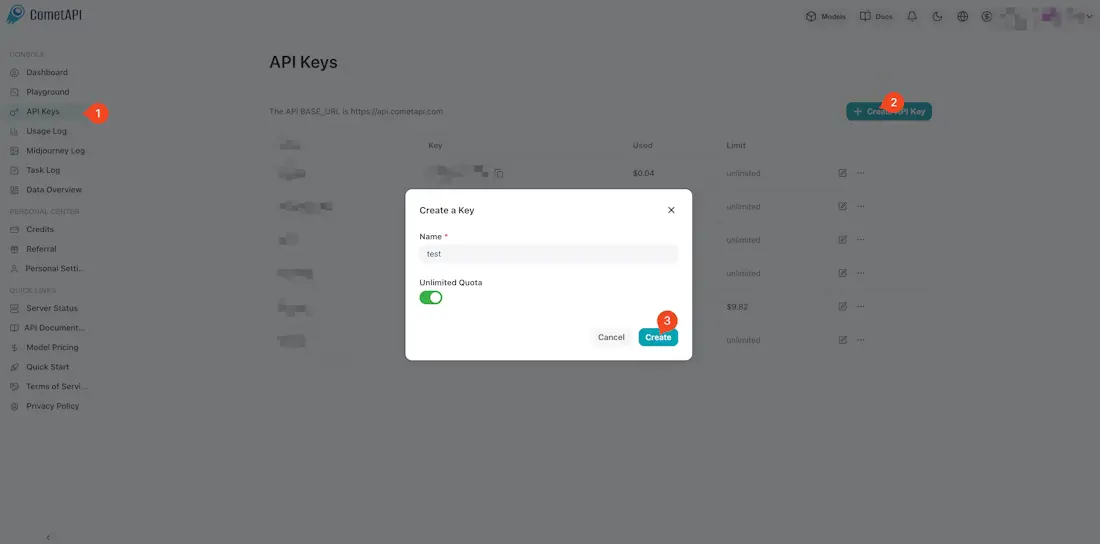

Etapa 1: Obtenha sua chave de API do CometAPI

Faça login no dashboard do CometAPI e navegue até a seção API Token. Clique em Add API Key para gerar sua credencial exclusiva.

Copie sua chave (normalmente no formato sk-xxxx) e mantenha a Base URL à mão: https://api.cometapi.com/v1.

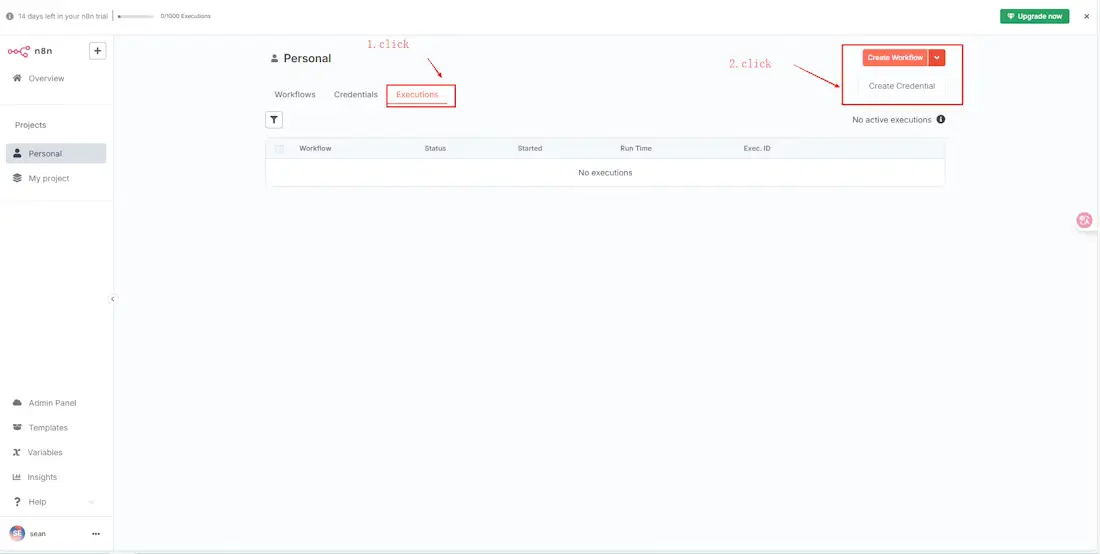

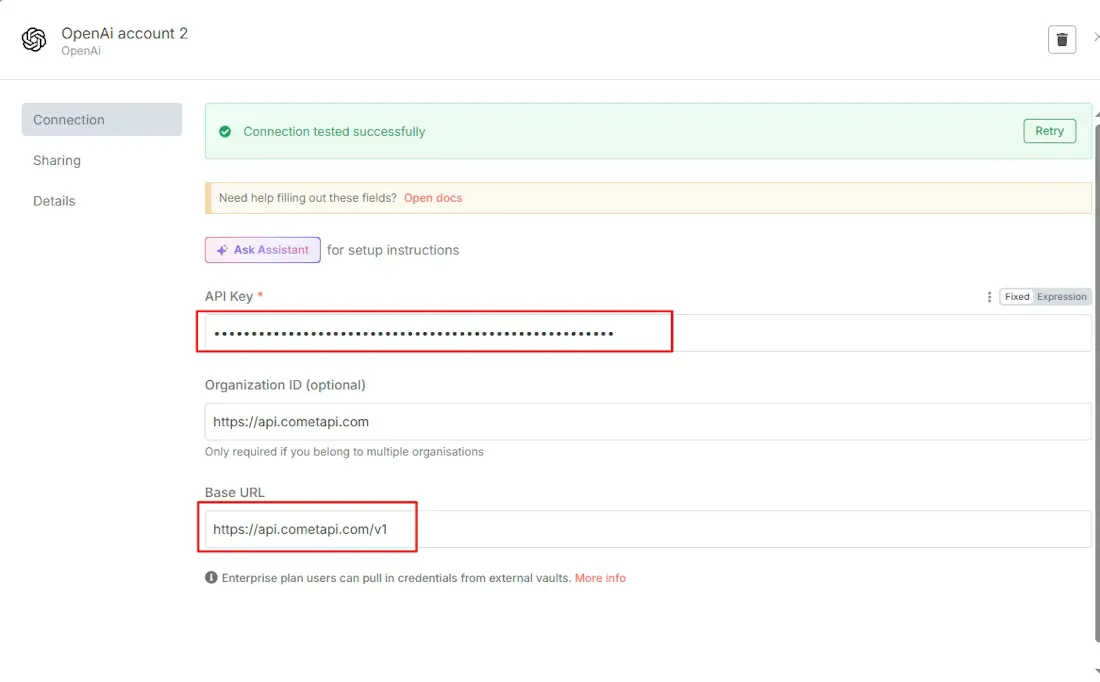

Etapa 2: Crie a credencial OpenAI no n8n

Abra sua instância do n8n e navegue até Credentials → Create Credential. Pesquise e selecione o tipo de credencial OpenAI API.

- API Key: cole aqui seu token do CometAPI.

- Base URL: insira

https://api.cometapi.com/v1.

Clique em Save para finalizar a configuração.

Etapa 3: Teste sua conexão

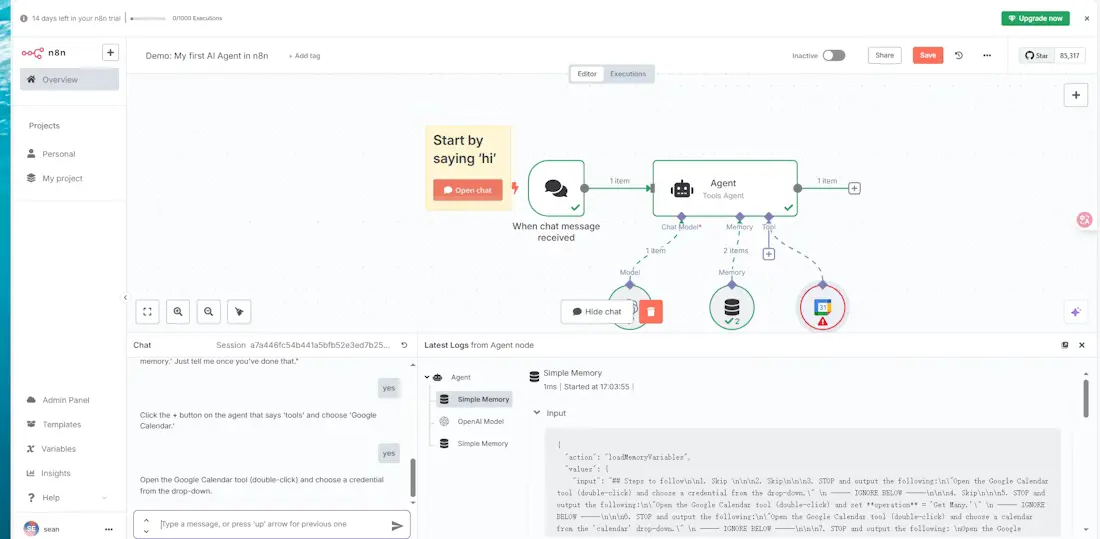

Crie um novo workflow e adicione um OpenAI node (como o Chat Model ou o AI Agent node). Selecione a credencial do CometAPI que você acabou de criar. No campo do modelo, agora você pode inserir qualquer ID de modelo compatível, como gpt-5.5 ou claude-opus-4-7. Execute o nó; uma resposta bem-sucedida verifica que sua ponte de API compatível com OpenAI no n8n está corretamente configurada.

Solução de problemas comuns

Se a integração não funcionar de imediato, verifique estas três áreas comuns:

A API retorna um erro 401 Unauthorized

Esse erro normalmente significa que o n8n não consegue autenticar com o gateway. Primeiro, verifique se sua chave de API foi copiada corretamente, sem espaços no início ou no fim. Em segundo lugar, certifique-se de que sua Base URL inclui o sufixo /v1. Sem o caminho de versão, o endpoint pode rejeitar a solicitação.

Nome do modelo não reconhecido

O CometAPI hospeda mais de 500 modelos, e cada um tem um identificador específico. Se o n8n retornar um erro "Model not found", garanta que você está usando o ID exato do modelo conforme a documentação do CometAPI. Por exemplo, use gpt-5.5-pro em vez de apenas gpt-5-pro se esse for o identificador no catálogo atual.

A velocidade de resposta está lenta

Para aplicações em tempo real em que a latência é crítica, certos modelos com raciocínio pesado podem levar mais tempo para processar. Se seu workflow exigir respostas quase instantâneas, tente alternar para um modelo de alto throughput como Gemini 3.1 Flash-Lite ou DeepSeek V4 Flash, otimizados para velocidade.

Quais modelos você pode usar no n8n via CometAPI

| Categoria de modelo | Exemplos | Melhor para |

|---|---|---|

| Texto/Chat | GPT 5.5, Claude Opus 4.7, Gemini 3.1 Pro | Raciocínio profissional e lógica complexa |

| Código | DeepSeek V4 Pro, GPT 5.3 Codex | Programação agentic e refatorações em escala de repositório |

| Imagem | GPT Image 2, Flux 2 Max | Conteúdo visual de alta fidelidade e design |

| Vídeo | Sora 2, Doubao-Seedance 2.0 | Automação cinematográfica e clipes para redes sociais |

Modelos de workflow n8n prontos para uso

A implementação do CometAPI no n8n permite lógica sofisticada com múltiplos modelos. Aqui estão três modelos que você pode criar hoje.

Modelo 1: Automação de suporte ao cliente

- Gatilho: um nó Webhook recebe um ticket de suporte do seu site.

- Processamento: um nó CometAPI (OpenAI) usa Claude Opus 4.7 para analisar o texto do ticket.

- Lógica: um nó Switch avalia a "gravidade" ou "complexidade" gerada pela IA.

- Ramificação: solicitações simples (ex.: "Onde está meu pedido?") são roteadas para um nó de resposta automatizada. Problemas técnicos complexos são roteados para um nó Slack ou nó Zendesk para intervenção humana.

- Configuração do nó: defina o nó Claude com

thinking: {type: "adaptive"}para garantir que ele dedique mais tempo a análises de sentimento difíceis.

Modelo 2: Pipeline de conteúdo automatizado

- Gatilho: um nó RSS Feed detecta um novo artigo da sua indústria.

- Processamento 1: use GPT 5.5 para ler o artigo e gerar um resumo executivo de 200 palavras para seu boletim interno.

- Processamento 2: passe esse resumo para DeepSeek V3 gerar cinco tags e palavras-chave otimizadas para SEO.

- Saída: o resumo e as tags são publicados em um banco de dados do Notion ou em um nó WordPress.

- Por que este Swarm?: usando o GPT 5.5 para o resumo de alta qualidade e o DeepSeek V3 mais barato para a marcação simples, você mantém qualidade elevada enquanto reduz significativamente seu custo total de tokens.

Modelo 3: Workflow de geração de imagens

- Gatilho: um nó Google Sheets detecta uma nova linha contendo um nome e descrição de produto.

- Processamento: a descrição é enviada a um nó CometAPI (OpenAI) usando o endpoint

/v1/images/generationscom o modelo Flux 2 Max. - Armazenamento: a URL da imagem gerada é passada para um nó Google Drive para upload e salvamento do arquivo.

- Configuração do nó: defina o parâmetro

ncomo 1 e escolha uma resolução como1024x1024para mockups de produto de alta qualidade.

Dicas de otimização de custos para n8n + CometAPI

Para maximizar seu desconto de 20–40%, siga estas estratégias de arquitetura.

Use modelos baratos para classificação e roteamento

Não use GPT 5.5 Pro para decisões simples de "Sim/Não" ou "Categoria A/B". Use DeepSeek V4 Flash ou GPT 5.4 nano para essas tarefas. Esses modelos custam uma fração dos modelos flagship e geralmente são mais rápidos, o que significa que seu workflow no n8n é executado com mais eficiência.

Defina seleção condicional de modelo no n8n

Use um nó Switch ou nó If para escolher um modelo com base no comprimento da entrada ou na prioridade. Por exemplo, se um documento tiver menos de 1.000 palavras, direcione para um modelo padrão. Se for um repositório massivo de 500.000 tokens, direcione para um modelo de longo contexto como Grok 4.20 ou Claude Opus 4.7.

Processamento em lote vs. em tempo real

Se seu workflow no n8n não exigir respostas imediatas (por exemplo, um relatório de fim do dia), use um nó Wait ou um nó Schedule para agrupar entradas e processá-las em um único lote. O CometAPI suporta alta concorrência, mas reduzir a frequência de chamadas pequenas e separadas pode ajudar você a permanecer dentro de limites de taxa mais baixos e simplificar seus logs de uso.

Tabela de comparação: n8n + CometAPI vs. alternativas

| Recurso | n8n + CometAPI | Zapier + Múltiplas AIs | Make.com + APIs diretas | Código customizado (Python/Node) |

|---|---|---|---|---|

| Custo | Baixo (economia de 20–40% + n8n grátis/auto-hospedado) | Alto (por tarefa + por API) | Médio | Variável (tempo de dev) |

| Facilidade de uso | Visual, low-code | Muito fácil | Visual | Exige muita codificação |

| Flexibilidade | Ilimitada (HTTP + 400+ nós) | Modelos limitados | Boa | Máxima |

| Acesso a modelos | 500+ unificados | Fragmentado | Depende | Manual |

| Auto-hospedagem/Privacidade de dados | Excelente | Limitada | Foco em nuvem | Controle total |

| Escalabilidade | Alta (queue modes, workers) | Limites por preço baseado em uso | Boa | Depende da infraestrutura |

| Manutenção | Baixa (uma integração) | Alta (múltiplas conexões) | Média | Alta |

| Suporte a agentes de IA | Nativo + ferramentas | Básico | Crescente | Customizado |

Veredito: n8n + CometAPI vence para equipes que precisam de poder, controle e eficiência de custos.

Perspectivas futuras e dicas de otimização

À medida que os modelos de IA proliferam em 2026, plataformas unificadas como o CometAPI, combinadas com orquestradores flexíveis como o n8n, tornam-se essenciais. Espere nós nativos mais profundos, melhores integrações MCP/servidor e recursos avançados de agentes.

Otimização no Cometapi.com:

- Acompanhe o uso de tokens em todos os workflows para análise de ROI.

- Aproveite o analytics do CometAPI + dados de execuções do n8n.

- Experimente modelos mais novos (por exemplo, DeepSeek-V4) para tarefas especializadas a menor custo.

- Combine com outras ferramentas do CometAPI para soluções de IA de ponta a ponta.

Guia rápido: construa hoje um workflow simples de sumarização. Escale para operações completas de IA amanhã.

Pronto para começar? Acesse o CometAPI para obter sua chave de API gratuita e créditos. Auto-hospedado ou em nuvem, conecte o n8n seguindo as etapas acima e transforme suas automações. Para workflows personalizados ou consultoria empresarial, explore as opções no Cometapi.com.

Essa integração não é apenas técnica—é um multiplicador estratégico de produtividade e inovação na era da IA.

FAQ

P: Preciso de uma credencial separada para cada modelo de IA?

R: Não. Uma única credencial do CometAPI oferece acesso a todos os 500+ modelos no n8n, de GPT e Claude a DeepSeek e Kimi.

P: O CometAPI é mais barato do que usar o OpenAI diretamente no n8n?

R: Sim. Os preços do CometAPI são definidos 20% a 40% abaixo das tarifas oficiais de varejo para os mesmos modelos.

P: Isso funciona com n8n auto-hospedado?

R: Sim. O processo de configuração é idêntico tanto no n8n Cloud quanto nas versões Docker auto-hospedadas.

P: Quais nós do n8n funcionam com o CometAPI?

R: Qualquer nó que aceite credenciais OpenAI funciona, incluindo os nós AI Agent, Chat Model e os nós padrão de completion.

P: Posso trocar de modelo sem reconfigurar o n8n?

R: Sim. Basta atualizar a string do nome do modelo nas configurações do nó (por exemplo, mudar de gpt-5.5 para claude-opus-4-7); a credencial subjacente permanece válida para todos os provedores.