Em 28 de abril de 2025, a Alibaba Cloud revelou o Qwen 3, a mais recente iteração de sua família de modelos de linguagem de grande porte (LLMs). Este lançamento representa um marco significativo na evolução da IA de código aberto, oferecendo um conjunto de modelos que atendem a diversas aplicações e necessidades dos usuários. Seja você um desenvolvedor, pesquisador ou empresa, entender como acessar e utilizar o Qwen 3 pode abrir novas possibilidades no processamento de linguagem natural e além.

O que é Qwen 3?

O Qwen 3 é a terceira geração de LLMs de código aberto do Alibaba Cloud, com base nos fundamentos estabelecidos por seus antecessores. Lançado em 28 de abril de 2025, o Qwen 3 apresenta uma gama de modelos com diferentes tamanhos de parâmetros, incluindo arquiteturas densas e esparsas. Esses modelos foram treinados em um extenso conjunto de dados de 36 trilhões de tokens em 119 idiomas e dialetos, posicionando o Qwen 3 como uma ferramenta versátil para aplicações globais.

Principais recursos do Qwen 3

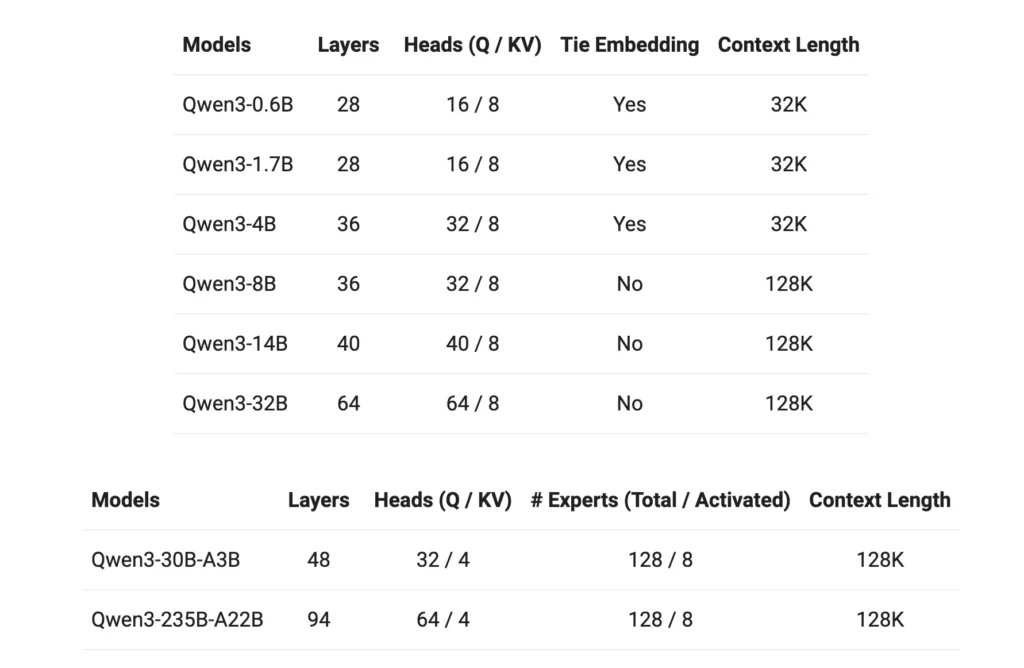

- Variantes do modelo: O Qwen 3 oferece modelos densos com parâmetros 0.6B, 1.7B, 4B, 8B, 14B e 32B, bem como modelos esparsos com 30B (parâmetros ativados 3B) e 235B (parâmetros ativados 22B).

- Janela de contexto estendida: A maioria dos modelos oferece suporte a uma janela de contexto de token de 128K, facilitando o processamento de conteúdo longo.

- Capacidades de raciocínio: Funções de raciocínio aprimoradas podem ser alternadas por meio do tokenizador, permitindo desempenho adaptável com base em tarefas específicas.

- Proficiência Multilíngue: Com dados de treinamento abrangendo 119 idiomas e dialetos, o Qwen 3 está equipado para diversas aplicações linguísticas.

- Licenciamento: Todos os modelos são lançados sob a licença Apache 2.0, promovendo colaboração e inovação de código aberto.

Como você pode acessar o Qwen3?

O acesso ao Qwen 3, o mais recente conjunto de modelos de linguagem de grande porte (LLMs) da Alibaba Cloud, é simples e versátil. Seja você um desenvolvedor que busca integrar recursos avançados de IA às suas aplicações ou um pesquisador que explora modelos de ponta, o Qwen 3 oferece múltiplos pontos de acesso para atender a diversas necessidades.

1. Via interface web QwenChat

Para interação imediata sem qualquer configuração, o QwenChat fornece uma interface web amigável:

- Visite o QwenChat: Navegue até o Plataforma QwenChat.

- Selecione um modelo: Escolha entre os modelos disponíveis, como Qwen3-8B, Qwen3-14B ou Qwen3-32B, de acordo com suas necessidades.

- Começar a conversar: Interaja com o modelo diretamente por meio da interface de bate-papo para tarefas como perguntas e respostas, geração de conteúdo ou assistência de codificação.

2. Acesso à API através do Alibaba Cloud

Integre o Qwen 3 aos seus aplicativos usando os serviços de API do Alibaba Cloud:

Obtenha credenciais de API: Cadastre-se no Alibaba Cloud e adquira sua chave de API.

Escolha o método de acesso:

- API compatível com OpenAI: Utilize o ponto de extremidade compatível com OpenAI para uma integração perfeita.

bashPOST https://dashscope-intl.aliyuncs.com/compatible-mode/v1/chat/completions

- DashScope SDK: Como alternativa, utilize o DashScope SDK para interações mais personalizadas.

- Configurar ambiente: Configure seu ambiente de desenvolvimento definindo a chave de API como uma variável de ambiente e instalando os SDKs necessários.

3. Acesso via Hugging Face e ModelScope

Para desenvolvedores que preferem plataformas de código aberto:

- Abraçando o rosto: Acesse os modelos Qwen 3 por meio da organização Qwen no Hugging Face.

pythonfrom transformers import AutoTokenizer, AutoModelForCausalLM tokenizer = AutoTokenizer.from_pretrained("Qwen/Qwen3-14B") model = AutoModelForCausalLM.from_pretrained("Qwen/Qwen3-14B")

- ModelScope: Explore modelos no ModelScope, que oferece uma variedade de variantes do Qwen 3.

4. Opções de implantação local

Implante modelos Qwen 3 localmente para maior controle e personalização:

Ollama: Uma plataforma que simplifica o gerenciamento de modelos locais.

- Instalação: Baixe e instale o Ollama de ollama. com.

- Implementação do modelo: Use a CLI do Ollama para executar modelos Qwen 3 localmente.

bashollama run qwen3-14b

vLLM: Otimizado para serviços de alto rendimento e baixa latência.

- Instalação: Instale o vLLM usando pip.

bashpip install -U vllm

- Servindo modelo: Atender 3 modelos Qwen com capacidades de raciocínio.

bashvllm serve Qwen/Qwen3-30B-A3B \ --enable-reasoning \ --reasoning-parser deepseek_r1

Interação: Acesse o modelo por meio do servidor de API padrão em http://localhost:8000.

5. Plataformas de terceiros: CometAPI

Utilize Qwen 3 através CometAPI oferecendo acesso gratuito:

- CometAPI: Registre-se para obter uma chave de API gratuita e selecione entre modelos como Qwen3-8B, Qwen3-30B ou Qwen3-235B para integração em seus projetos.

Como começar a usar o Qwen 3

Para começar a usar o Qwen 3:

- Determine seu caso de uso: Identifique se você precisa de uma interface web, integração de API ou implantação local.

- Selecione o modelo apropriado: Escolha uma variante de modelo que esteja alinhada aos seus recursos computacionais e à complexidade da tarefa.

- Configure o ambiente: Siga as etapas de instalação e configuração com base no método de acesso escolhido.

- Integrar e testar: Incorpore o Qwen 3 em seus aplicativos e realize testes para garantir o desempenho ideal.

Seguindo essas etapas, você pode aproveitar efetivamente os recursos do Qwen 3 para aprimorar seus projetos e esforços de pesquisa.

Implementando Qwen 3: Considerações Práticas

Requerimentos do sistema

A implantação de modelos Qwen 3, especialmente as variantes maiores, exige recursos computacionais substanciais. Os usuários devem garantir que tenham acesso a recursos de GPU e memória adequados para acomodar os tamanhos dos modelos e as demandas de processamento.

Integração e Customização

A natureza de código aberto do Qwen 3 permite ampla personalização. Os desenvolvedores podem refinar os modelos com base em dados específicos de cada domínio, ajustar parâmetros para otimizar o desempenho e integrar os modelos a sistemas existentes para aprimorar a funcionalidade.

Comunidade e Suporte

O envolvimento com a comunidade Qwen 3 por meio de fóruns, discussões no GitHub e outras plataformas colaborativas pode fornecer insights e suporte valiosos. Compartilhar experiências e soluções contribui para o avanço coletivo da tecnologia.

Conclusão

O Qwen 3 representa um avanço significativo no campo de modelos de linguagem de código aberto. Com sua diversidade de modelos, amplo suporte a linguagens e plataformas acessíveis, ele fornece um conjunto de ferramentas robusto para uma ampla gama de aplicações. Ao entender como acessar e implementar o Qwen 3, os usuários podem aproveitar seus recursos para impulsionar inovação e eficiência em seus respectivos domínios.

Começando a jornada

Os desenvolvedores podem acessar Qwen 3 API através de CometAPI. Para começar, explore as capacidades do modelo no Playground e consulte o Guia de API para obter instruções detalhadas. Observe que alguns desenvolvedores podem precisar verificar sua organização antes de usar o modelo.