O Veo 3.1 está chegando: Eu vejo é a família de modelos de geração de vídeo de IA do Google (Veo 3 / Veo 3 Fast são os atuais). O Google lançou recentemente grandes melhorias no Veo 3 (vertical 9:16, 1080p, Veo 3 Fast, preços mais baixos) e há rumores / postagens sociais que. Veo 3.1 é iminente — mas o Google tem não Ainda não publiquei um boletim oficial de lançamento do Veo 3.1. Listarei fatos confirmados, mudanças prováveis/esperadas e uma comparação direta com o OpenAI. Sora 2.

O Quê Eu vejo is

Eu vejo é a linha de modelos de vídeo generativos do Google (família DeepMind / Google Cloud / Gemini) que transformam texto ou imagens em vídeos curtos — e (no Veo 3) geram áudio nativamente (efeitos sonoros, áudio ambiente e diálogos). É oferecido no Google Cloud (Vertex AI / Gemini API) para desenvolvedores e empresas e inclui marcas d'água de proveniência/SynthID integradas nas saídas.

O Quê Veo 3 já trouxe

- Texto → vídeo e imagem → vídeo recursos (incluindo visualização de imagem para vídeo).

- Geração de áudio nativo (música, sons ambientes, diálogos) — O Veo 3 introduziu áudio de primeira classe.

- Duas variantes: Veo 3 de alta qualidade e Eu vejo 3 rápidos (otimizado para velocidade/iteração).

- Disponibilidade da plataforma: disponibilizado no Vertex AI / Gemini API (visualização paga → atualizações de disponibilidade geral em meados de 2025).

- Segurança/procedência: Marca d'água SynthID e alguns controles/aprovações de uso de geração para geração de pessoa/criança.

Então — o que é Veo 3.1 esperado trazer?

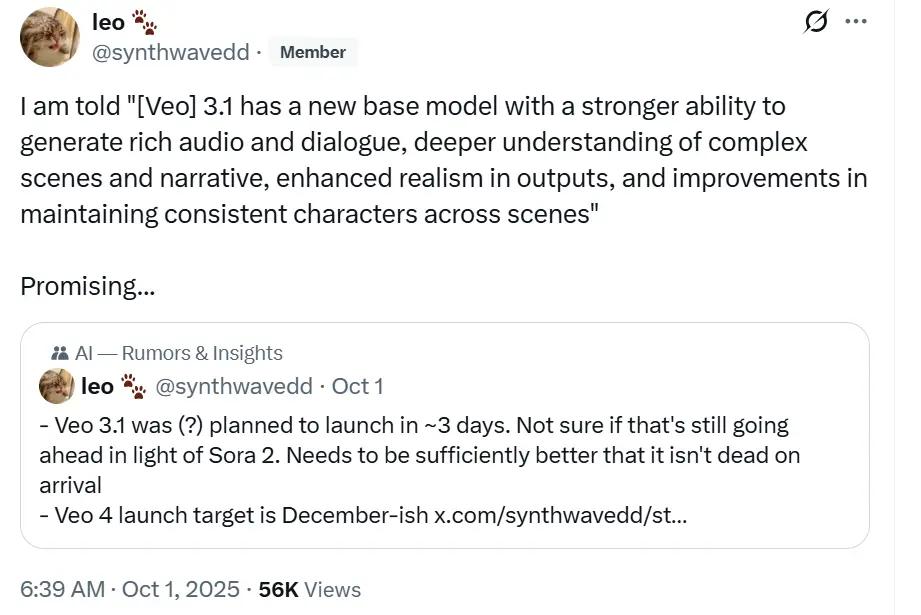

Estado: Até o momento, não há uma página oficial do produto Veo 3.1 do Google descrevendo notas de lançamento completas. No entanto, várias postagens de desenvolvedores/comunidades do Google e tweets indicam uma atualização incremental de curto prazo (chamada "Veo 3.1") que deve se concentrar em melhorias iterativas no suporte de áudio, qualidade e formato, em vez de uma reescrita completa de nova geração.

Aqui estão algumas inferências que fiz com base na postagem de x e nas características do Veo3:

- Áudio nativo aprimorado (diálogo, sincronização labial multivoz) —diálogos mais limpos, melhor mixagem de efeitos sonoros e espacialização). O Veo 3 já gera áudio nativamente; o Veo 3.1 pode melhorar o realismo dos diálogos e o suporte a idiomas para corresponder às melhorias recentes que os concorrentes estão lançando.

- Caminhos mais rápidos/baratos para algumas saídas comuns (mais paridade e otimizações do Veo 3 Fast).

- Melhor fidelidade de imagem→vídeo e melhor consistência de personagem/pose em clipes multiquadro.

- Proporções de aspecto expandidas / controles de resolução (mais flexível 9:16/16:9 e 1080p em todas as configurações). O Google já adicionou vertical + 1080p; o Veo 3.1 pode expandir esses controles.

- Clipes mais longos / limite relaxado de 8 segundos — a demanda da comunidade e o roteiro anterior do Google sugerem que o aumento da duração é uma meta provável (o Veo 3 hoje é otimizado para clipes de 8 segundos).

- Melhor fidelidade de imagem→vídeo e suporte estendido de imagem para vídeo (melhorias no realismo, continuidade de movimento), com base na visualização de imagem→vídeo no Veo 3.

Compare Veo 3 / (esperado) Veo 3.1 → OpenAI Sora 2

Foco primário

- Veo 3 (Google): vídeos curtos de 8 segundos, de alta fidelidade, a partir de prompts de texto/imagem; áudio nativo; integrado ao Gemini/Gemini API e Vertex AI; otimizado para uso em produção e integração com API de desenvolvedor.

- Sora 2 (OpenAI): O principal modelo de vídeo+áudio da OpenAI enfatizando realismo físico, movimento coerente, diálogo e som sincronizados, e um aplicativo social que o acompanha (Sora) com um sistema de participação especial/consentimento para integrar imagens de usuários e foca fortemente em realismo e controles de segurança.

Pontos fortes

- Veo (agora): forte integração desenvolvedor/empresa (Vertex AI, Gemini API), opções de preços de produção, caminho claro para clientes de nuvem, vertical/1080p + variante rápida. Ideal para empresas que estão construindo pipelines.

- Sora 2: precisão física notável e sincronização multimodal (diálogo + visuais), além de um aplicativo voltado para o consumidor integrado a fluxos de trabalho sociais (recurso de participação especial, moderação). Ótimo para criadores que buscam cenas narrativas realistas e um ecossistema de aplicativos.

Como acessar o Veo agora — e como se preparar para o Veo 3.1

- Experimente em Gêmeos (consumidor / web / celular): A geração do Veo é exibida nos aplicativos Gemini (toque na opção "vídeo" na barra de prompts). O nível de acesso (Pro / Ultra) afeta quais variantes do Veo você pode usar.

- Programaticamente / empresarial: usar API in CometAPI (IDs do modelo Veo disponíveis na documentação do modelo). A CometAPI fornece veo3-pro, veo3-fast e veo3. Para mais detalhes, consulte Veo 3 's doca.

Dica prática (desenvolvedor): para solicitar saída vertical, defina o aspectRatio parâmetro (por exemplo "9:16") e verifique a configuração do modelo (Veo 3 vs Veo 3 Fast) e seu plano para limites de resolução (720p vs 1080p).

Como acessar Sora 2 (hoje)

Aplicativo Sora: O Sora 2 foi lançado com um aplicativo Sora (lançamento limitado por convite nos EUA e Canadá no lançamento). A OpenAI indicou acesso mais amplo e expansão da API posteriormente. Se você quiser experimentar o Sora 2 agora, confira as CpmetAPIs. Sora 2 página. O CometAPI já oferece suporte à API sora 2 e gera clipes sociais de aproximadamente 10 segundos, com ênfase no realismo de movimento para as pessoas.

Começando a jornada

A CometAPI é uma plataforma de API unificada que agrega mais de 500 modelos de IA de provedores líderes — como a série GPT da OpenAI, a Gemini do Google, a Claude da Anthropic, a Midjourney e a Suno, entre outros — em uma interface única e amigável ao desenvolvedor. Ao oferecer autenticação, formatação de solicitações e tratamento de respostas consistentes, a CometAPI simplifica drasticamente a integração de recursos de IA em seus aplicativos. Seja para criar chatbots, geradores de imagens, compositores musicais ou pipelines de análise baseados em dados, a CometAPI permite iterar mais rapidamente, controlar custos e permanecer independente de fornecedores — tudo isso enquanto aproveita os avanços mais recentes em todo o ecossistema de IA.

Os desenvolvedores podem acessar API do Veo 3.1 através do CometAPI, a versão mais recente do modelo está sempre atualizado com o site oficial. Para começar, explore as capacidades do modelo no Playground e consulte o Guia de API para obter instruções detalhadas. Antes de acessar, certifique-se de ter feito login no CometAPI e obtido a chave da API. CometAPI oferecem um preço muito mais baixo que o preço oficial para ajudar você a se integrar.

Pronto para ir?→ Inscreva-se no CometAPI hoje mesmo !