A DeepSeek lançou o DeepSeek V3.2 como sucessor de sua linha V3.x e uma variante complementar, DeepSeek-V3.2-Speciale, que a empresa posiciona como uma edição de alto desempenho, com prioridade no raciocínio, para uso por agentes/ferramentas. O V3.2 baseia-se em trabalhos experimentais (V3.2-Exp) e introduz maior capacidade de raciocínio, uma edição Speciale otimizada para desempenho “nível ouro” em matemática/programação competitiva e aquilo que a DeepSeek descreve como um sistema de “pensar + ferramenta” em modo duplo, inédito, que integra estreitamente o raciocínio interno passo a passo com a invocação de ferramentas externas e fluxos de trabalho de agentes.

O que é o DeepSeek V3.2 — e como o V3.2-Speciale difere?

O DeepSeek-V3.2 é o sucessor oficial do ramo experimental V3.2-Exp da DeepSeek. Ele é descrito pela DeepSeek como uma família de modelos “prioritariamente orientada ao raciocínio” criada para agentes, isto é, modelos ajustados não apenas para qualidade de conversação natural, mas especificamente para inferência em múltiplas etapas, invocação de ferramentas e um estilo confiável de raciocínio por cadeia de pensamento ao operar em ambientes que incluem ferramentas externas (APIs, execução de código, conectores de dados).

O que é o DeepSeek-V3.2 (base)

- Posicionado como o sucessor de produção mainstream da linha experimental V3.2-Exp; destinado a ampla disponibilidade via app/web/API da DeepSeek.

- Mantém um equilíbrio entre eficiência computacional e raciocínio robusto para tarefas agentivas.

O que é o DeepSeek-V3.2-Speciale

O DeepSeek-V3.2-Speciale é uma variante que a DeepSeek promove como uma “Edição Especial” de maior capacidade, ajustada para raciocínio em nível de competições, matemática avançada e desempenho de agentes. É apresentado como uma variante de capacidade superior que “expande os limites das capacidades de raciocínio”. Atualmente, a DeepSeek expõe o Speciale apenas como um modelo via API com roteamento de acesso temporário; benchmarks iniciais sugerem que ele está posicionado para competir com modelos fechados de alto nível em benchmarks de raciocínio e codificação.

Qual a linhagem e as escolhas de engenharia que levaram ao V3.2?

O V3.2 herda uma linhagem de engenharia iterativa que a DeepSeek divulgou ao longo de 2025: V3 → V3.1 (Terminus) → V3.2-Exp (uma etapa experimental) → V3.2 → V3.2-Speciale. O V3.2-Exp experimental introduziu o DeepSeek Sparse Attention (DSA) — um mecanismo de atenção esparsa de granulação fina voltado a reduzir custos de memória e computação para contextos muito longos, preservando a qualidade de saída. Essa pesquisa sobre DSA e o trabalho de redução de custos serviram como um degrau técnico para a família oficial V3.2.

O que há de novo no DeepSeek 3.2 oficial?

1) Capacidade de raciocínio aprimorada — como o raciocínio foi melhorado?

A DeepSeek apresenta o V3.2 como “prioritariamente orientado ao raciocínio.” Isso significa que a arquitetura e o fine-tuning focam em realizar de modo confiável inferência em múltiplas etapas, manter cadeias de pensamento internas e apoiar os tipos de deliberação estruturada de que os agentes precisam para usar ferramentas externas corretamente.

Concretamente, as melhorias incluem:

- Treinamento e RLHF (ou procedimentos de alinhamento similares) ajustados para incentivar a resolução de problemas em etapas explícitas e estados intermediários estáveis (úteis para raciocínio matemático, geração de código em múltiplas etapas e tarefas de lógica).

- Escolhas arquiteturais e de função de perda que preservam janelas de contexto maiores e permitem que o modelo referencie etapas de raciocínio anteriores com fidelidade.

- Modos práticos (ver “modo duplo” abaixo) que permitem ao mesmo modelo operar em um modo “chat” mais rápido ou em um modo deliberativo de “pensamento”, no qual ele trabalha intencionalmente por etapas intermediárias antes de agir.

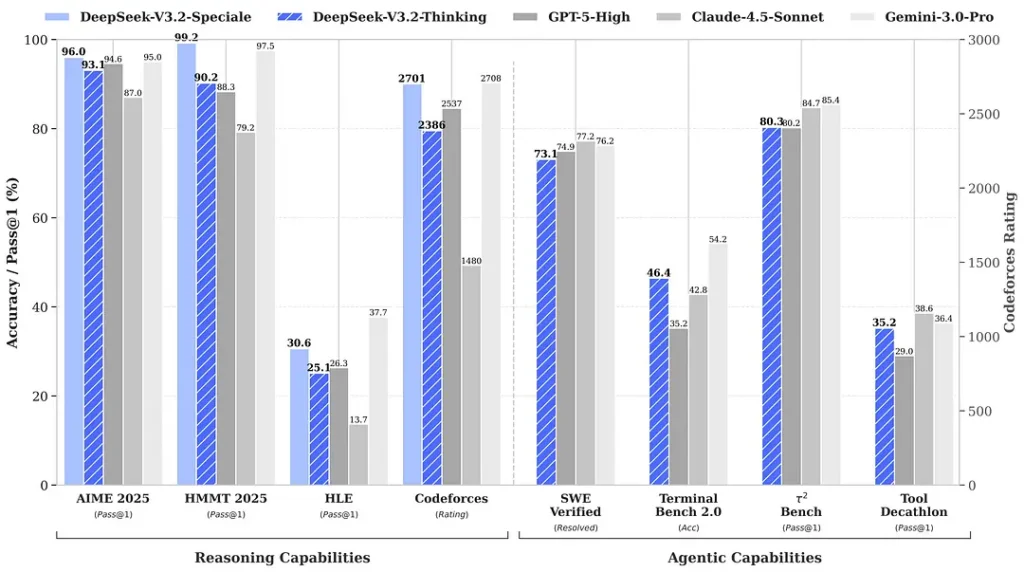

Benchmarks citados no lançamento afirmam ganhos notáveis em suítes de matemática e raciocínio; benchmarks comunitários independentes e iniciais também relatam pontuações impressionantes em conjuntos de avaliação competitivos:

2) Desempenho revolucionário na Edição Especial — quão melhor?

O DeepSeek-V3.2-Speciale é apontado como um salto em precisão de raciocínio e orquestração de agentes em comparação ao V3.2 padrão. O provedor enquadra o Speciale como um nível de desempenho voltado a cargas de trabalho pesadas de raciocínio e tarefas desafiadoras de agentes; atualmente é apenas via API e oferecido como um endpoint temporário de maior capacidade (a DeepSeek indicou que a disponibilidade do Speciale será inicialmente limitada). A versão Speciale integra o modelo matemático anterior DeepSeek-Math-V2; consegue provar teoremas matemáticos e verificar o raciocínio lógico de forma autônoma; alcançou resultados notáveis em várias competições de classe mundial:

- 🥇 IMO (International Mathematical Olympiad) Medalha de Ouro

- 🥇 CMO (Chinese Mathematical Olympiad) Medalha de Ouro

- 🥈 ICPC (International Computer Programming Contest) Segundo Lugar (Competição Humana)

- 🥉 IOI (International Olympiad in Informatics) Décimo Lugar (Competição Humana)

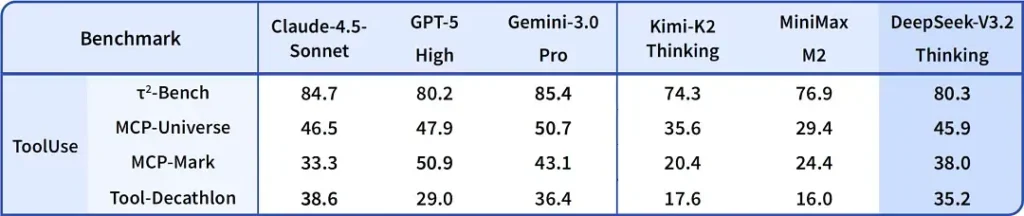

| Benchmark | GPT-5 High | Gemini-3.0 Pro | Kimi-K2 Thinking | DeepSeek-V3.2 Thinking | DeepSeek-V3.2 Speciale |

|---|---|---|---|---|---|

| AIME 2025 | 94.6 (13k) | 95.0 (15k) | 94.5 (24k) | 93.1 (16k) | 96.0 (23k) |

| HMMT Feb 2025 | 88.3 (16k) | 97.5 (16k) | 89.4 (31k) | 92.5 (19k) | 99.2 (27k) |

| HMMT Nov 2025 | 89.2 (20k) | 93.3 (15k) | 89.2 (29k) | 90.2 (18k) | 94.4 (25k) |

| IMOAnswerBench | 76.0 (31k) | 83.3 (18k) | 78.6 (37k) | 78.3 (27k) | 84.5 (45k) |

| LiveCodeBench | 84.5 (13k) | 90.7 (13k) | 82.6 (29k) | 83.3 (16k) | 88.7 (27k) |

| CodeForces | 2537 (29k) | 2708 (22k) | — | 2386 (42k) | 2701 (77k) |

| GPQA Diamond | 85.7 (8k) | 91.9 (8k) | 84.5 (12k) | 82.4 (7k) | 85.7 (16k) |

| HLE | 26.3 (15k) | 37.7 (15k) | 23.9 (24k) | 25.1 (21k) | 30.6 (35k) |

3) Primeira implementação de um sistema de dois modos “pensar + ferramenta”

Uma das alegações mais interessantes, do ponto de vista prático, no V3.2 é um fluxo de trabalho em modo duplo que separa (e permite escolher entre) operação conversacional rápida e um modo deliberativo de “pensamento” mais lento que se integra de forma estreita ao uso de ferramentas.

- Modo “Chat / rápido”: Projetado para chat com baixa latência, voltado ao usuário, com respostas concisas e menos traços de raciocínio interno — bom para ajuda casual, perguntas e respostas curtas e aplicativos sensíveis à velocidade.

- Modo “Pensamento / raciocinador”: Otimizado para cadeia de pensamento rigorosa, planejamento por etapas e orquestração de ferramentas externas (APIs, consultas a banco de dados, execução de código). Ao operar no modo de pensamento, o modelo produz etapas intermediárias mais explícitas, que podem ser inspecionadas ou usadas para conduzir chamadas de ferramentas seguras e corretas em sistemas agentivos.

Esse padrão (um design de dois modos) estava presente em ramos experimentais anteriores, e a DeepSeek o integrou mais profundamente no V3.2 e no Speciale — o Speciale atualmente oferece suporte exclusivamente ao modo de pensamento (daí a limitação via API). A capacidade de alternar entre velocidade e deliberação é valiosa para engenharia porque permite aos desenvolvedores escolher o equilíbrio certo entre latência e confiabilidade ao construir agentes que precisam interagir com sistemas do mundo real.

Por que é notável: Muitos sistemas modernos oferecem ou um modelo com forte cadeia de pensamento (para explicar o raciocínio) ou uma camada separada de orquestração de agentes/ferramentas. A abordagem da DeepSeek sugere um acoplamento mais estreito — o modelo pode “pensar” e então chamar ferramentas de forma determinística, usando as respostas das ferramentas para informar o pensamento subsequente — o que é mais fluido para desenvolvedores que constroem agentes autônomos.

Onde obter o DeepSeek v3.2

Resposta curta — você pode obter o DeepSeek v3.2 de várias formas, dependendo do que precisa:

- Web/app oficial (uso online) — experimente a interface web ou o app móvel da DeepSeek para usar o V3.2 interativamente.

- Acesso via API — a DeepSeek expõe o V3.2 por meio de sua API (a documentação inclui nomes de modelos / base_url e preços). Cadastre-se para obter uma chave de API e chame o endpoint v3.2.

- Pesos baixáveis/abertos (Hugging Face) — o modelo (variantes V3.2 / V3.2-Exp) está publicado no Hugging Face e pode ser baixado (open-weight). Use

huggingface-huboutransformerspara obter os arquivos. - CometAPI — Uma plataforma de agregação de APIs de IA fornece endpoints hospedados V3.2-Exp. O preço é mais barato do que o preço oficial.

Algumas notas práticas:

- Se você quer pesos para rodar localmente, vá para a página do modelo no Hugging Face (aceite quaisquer licenças/condições de acesso) e use

huggingface-clioutransformerspara baixar; o repositório do GitHub normalmente mostra os comandos exatos. - Se você quer uso em produção via API, siga a plataforma desejada, como a documentação da API do cometapi, para nomes de endpoints e o

base_urlcorreto para a variante V3.2.

DeepSeek-V3.2-Speciale:* Open for research use only, supports “Thinking Mode” dialogue, but does not support tool calls.

- Maximum output can reach 128K tokens (ultra-long Thinking Chain).

- Currently free to test until December 15, 2025.

Considerações finais

O DeepSeek-V3.2 representa um passo significativo na maturidade de modelos centrados em raciocínio. Sua combinação de raciocínio multiestágio aprimorado, edições especializadas de alto desempenho (Speciale) e uma integração de “pensar + ferramenta” pronta para produção é digna de nota para quem constrói agentes avançados, assistentes de codificação ou fluxos de trabalho de pesquisa que precisam intercalar deliberação com ações externas.

Os desenvolvedores podem acessar o DeepSeek V3.2 por meio do CometAPI. Para começar, explore as capacidades do modelo do CometAPI no Playground e consulte o guia da API para instruções detalhadas. Antes de acessar, certifique-se de que fez login no CometAPI e obteve a chave de API. O CometAPI oferece um preço muito inferior ao oficial para ajudar na integração.

Pronto para começar? → Inscreva-se no CometAPI hoje!

Se quiser saber mais dicas, guias e novidades sobre IA, siga-nos no VK, no X e no Discord!