GLM-5.1 representa uma mudança decisiva no cenário de IA. À medida que empresas chinesas de IA aceleram a comercialização enquanto abrem o código de capacidades de fronteira, este modelo reduz a distância em relação a líderes proprietários como o GPT-5.4 da OpenAI, o Claude Opus 4.6 da Anthropic e o Gemini 3.1 Pro do Google — especialmente em engenharia de software do mundo real. Treinado na mesma arquitetura MoE de 744B parâmetros do GLM-5, mas fortemente otimizado para fluxos de trabalho “agentes”, ele se destaca onde a maioria dos LLMs tropeça: tarefas longas, ambíguas e iterativas que exigem planejamento, experimentação, depuração e autocorreção ao longo de milhares de chamadas de ferramentas.

Agora, a CometAPI integra o GLM-5.1 e o GLM-5, e desenvolvedores também podem ver outros modelos líderes do Ocidente e acessá-los com um preço de API muito baixo (o que também é uma vantagem da CometAPI em comparação a outros concorrentes).

O que é o GLM-5.1?

GLM-5.1 é o mais novo modelo de linguagem carro-chefe da Z.ai e o mais recente avanço da empresa em trabalho de software de longo horizonte e estilo “agente”. Nas palavras da própria Z.ai, ele é projetado para tarefas que precisam de execução contínua em vez de respostas “one-shot”, e é posicionado como um modelo que pode planejar, executar, refinar e entregar em uma única corrida estendida. As notas de lançamento da Z.ai dizem que o GLM-5.1 é construído com ajuste fino supervisionado multi-turn, aprendizado por reforço e um framework de avaliação da qualidade do processo, e que melhora estabilidade, consistência e uso de ferramentas em tarefas prolongadas.

Esse posicionamento importa porque o GLM-5.1 não está sendo vendido apenas como “mais um modelo de chat”. Ele mira fluxos de trabalho de engenharia em que os modelos precisam manter um objetivo em mente, lidar com etapas intermediárias e se recuperar de erros sem perder o fio da meada — como um modelo para planejamento autônomo, execução sustentada, correção de bugs e iteração de estratégia, o que é uma proposta de produto bem diferente de um assistente casual ou um copiloto de código de contexto curto.

Um detalhe prático útil: o GLM-5.1 é apenas de texto, é suportado no GLM Coding Plan e pode ser usado em agentes de codificação populares como Claude Code e OpenClaw, o que o torna especialmente relevante para equipes que querem um modelo inserido no fluxo de trabalho de desenvolvimento existente, em vez de substituí-lo.

Especificações técnicas centrais (herdadas e refinadas a partir do GLM-5):

- Arquitetura: Mixture-of-Experts (MoE) com 744 bilhões de parâmetros totais e aproximadamente 40 bilhões de parâmetros ativos por inferência.

- Janela de contexto: 203K–204,8K tokens (com suporte para até 131K tokens de saída).

- Principais melhorias: DeepSeek Sparse Attention (DSA) para lidar com contexto longo de forma eficiente e reduzir custos de implantação; infraestrutura avançada de aprendizado por reforço assíncrono (via framework “slime” da Z.ai) para um pós-treinamento mais eficaz.

- Disponibilidade: Pesos abertos (licença MIT no Hugging Face via zai-org/GLM-5.1), acesso por API pela plataforma da Z.ai e agregadores como a CometAPI, e integração nas ferramentas do GLM Coding Plan (compatível com Claude Code / OpenClaw).

Diferente de modelos GLM anteriores focados em inteligência geral ou “vibe coding” curto, o GLM-5.1 mira agentes autônomos em nível de produção. Ele consegue planejar, executar, aferir, depurar e iterar em projetos de engenharia complexos de forma independente por horas sem intervenção humana — capacidades que o posicionam como concorrente direto de agentes de codificação especializados da Anthropic e da OpenAI.

O lançamento coincidiu com um aumento de preço de API de ~10% (tokens de entrada ~US$0,54/M, saída ~US$4,40/M), mas ainda assim permanece dramaticamente mais barato do que equivalentes como o Opus 4.6 da Anthropic (250–470% mais caro).

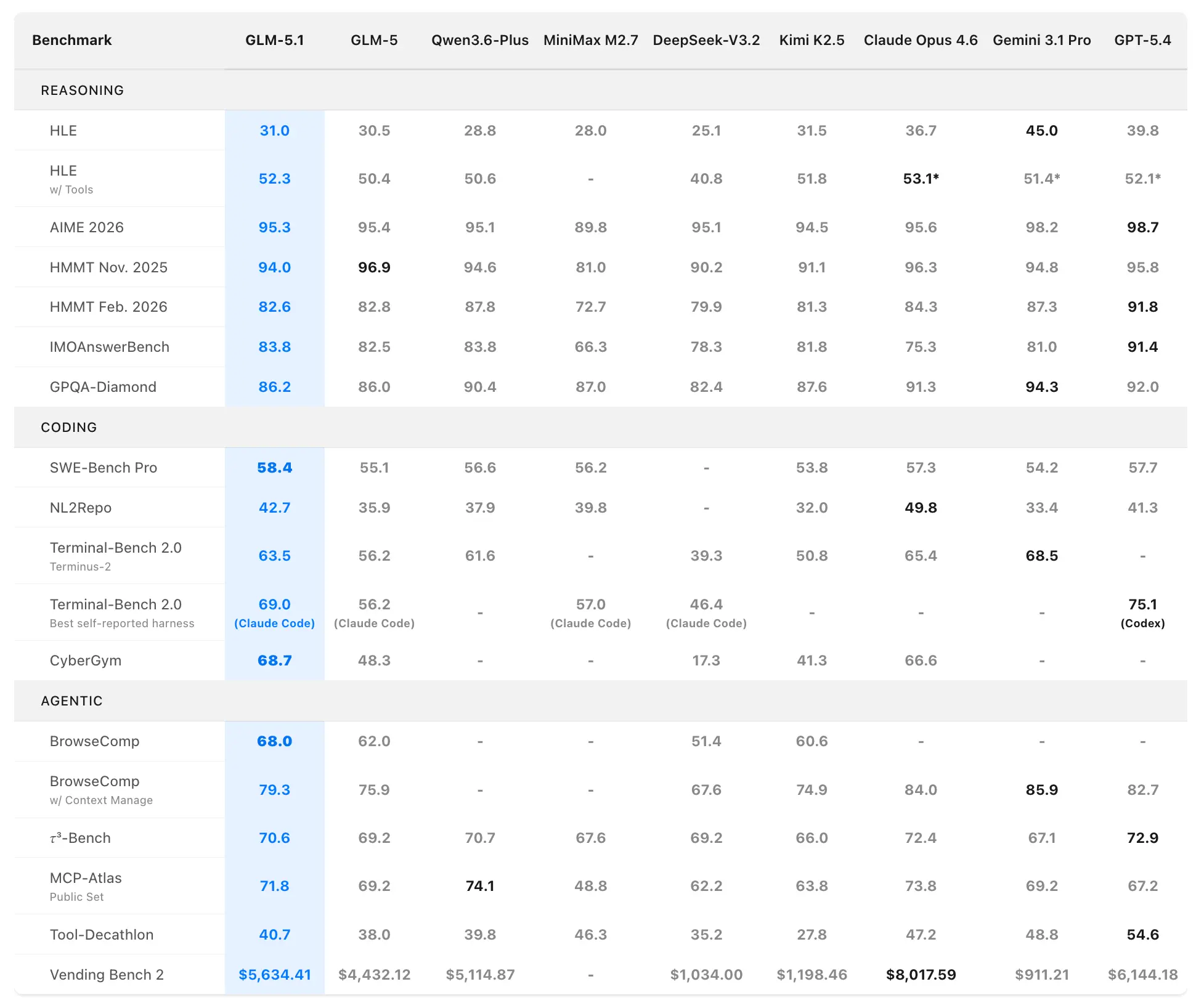

Desempenho em benchmarks do GLM-5.1

A Z.ai posiciona o GLM-5.1 como o modelo de código aberto mais forte do mundo e um top 3 global em codificação baseada em agentes. Os dados de desempenho vêm de avaliações oficiais no SWE-Bench Pro, NL2Repo, Terminal-Bench 2.0 e cenários personalizados de longo horizonte.

Benchmarks de programação e agentes

SWE-Bench Pro (tarefas realistas de engenharia de software exigindo navegação em repositório, edição de código e verificação funcional):

- GLM-5.1: 58,4 (novo estado da arte)

- GLM-5: 55,1

- GPT-5.4: 57,7

- Claude Opus 4.6: 57,3

- Gemini 3.1 Pro: 54,2

O GLM-5.1 é o primeiro modelo doméstico (chinês) e de código aberto a reivindicar o topo neste benchmark rigoroso, que espelha de perto os fluxos de trabalho de desenvolvedores profissionais.

NL2Repo (linguagem natural para geração de repositório completo):

- GLM-5.1: 42,7 (ampla vantagem sobre os 35,9 do GLM-5)

- Modelos concorrentes variam de 32,0–49,8 (os líderes específicos variam por harness).

Terminal-Bench 2.0 (tarefas reais de terminal e sistemas):

- Harness Terminus-2: GLM-5.1 63,5 (vs. GLM-5 56,2)

- Melhor autodeclarado (Claude Code): até 69,0.

Em uma avaliação separada de harness de codificação (estilo Claude Code), o GLM-5.1 marcou 45,3 — alcançando 94,6% dos 47,9 do Claude Opus 4.6 e uma melhora de 28% sobre os 35,4 do GLM-5.

Ranking composto: nº 1 em código aberto, nº 1 modelo chinês, nº 3 globalmente em SWE-Bench Pro + NL2Repo + Terminal-Bench.

Desempenho em tarefas de longo horizonte: o verdadeiro diferencial

Benchmarks padrão medem desempenho “one-shot” ou em sessões curtas. O GLM-5.1 brilha em execuções autônomas estendidas:

- VectorDBBench Optimization (600+ iterações, 6.000+ chamadas de ferramentas): Partindo de um esqueleto em Rust, o GLM-5.1 redesenhou iterativamente indexação, compressão, roteamento e poda, alcançando 21,5k QPS (6× o melhor anterior em 50 turnos de 3.547 QPS do Claude Opus 4.6) mantendo ≥95% de revocação no SIFT-1M. Ele exibiu progresso em “degraus”, com avanços estruturais a cada 100–200 iterações.

- KernelBench Level 3 (otimização completa de modelo de ML, 1.000+ turnos): Aceleração da média geométrica de 3,6× em 50 problemas complexos (superando o 1,49× do max-autotune do torch.compile). O GLM-5.1 continuou melhorando muito depois de o GLM-5 ter estagnado; apenas o Claude Opus 4.6 o superou com 4,2×.

- Linux Desktop Web App Build (8+ horas, aberto): Dado apenas um prompt em linguagem natural e nenhum código inicial, o GLM-5.1 construiu de forma autônoma um ambiente de desktop estilo Linux funcional — completo com barra de tarefas, janelas, interações e polimento — onde modelos anteriores produziram apenas esqueletos básicos.

Esses resultados demonstram a capacidade do GLM-5.1 de manter coerência, autoavaliar-se, revisar estratégias e escapar de ótimos locais em horizontes extremamente longos — capacidades que a Z.ai explicitamente engenhou para sistemas agentes do mundo real.

Em que o GLM-5.1 é diferente do GLM-5?

GLM-5 e GLM-5.1 são estreitamente relacionados, mas não são posicionados da mesma forma. O GLM-5 é o modelo fundamental anterior da Z.AI para Engenharia baseada em agentes. Ele é projetado para engenharia de sistemas complexos e tarefas de longo alcance com agentes, com capacidade SOTA de codificação e agentes com pesos abertos, e desempenho de codificação que se aproxima do Claude Opus 4.5 em cenários reais de programação. Ele marca 77,8 no SWE-bench Verified e 56,2 no Terminal Bench 2.0.

O GLM-5.1, em contraste, é enquadrado como o próximo passo rumo a tarefas de longo horizonte e execução sustentada mais confiável, melhora estabilidade, consistência e uso de ferramentas em tarefas prolongadas, e está melhor alinhado com o Claude Opus 4.6 no geral. Em outras palavras, o GLM-5 é o modelo fundamental anterior, centrado em engenharia, enquanto o GLM-5.1 é o carro-chefe mais orientado à resistência em tarefas.

Há também diferenças de arquitetura e treinamento na geração GLM-5 que ajudam a explicar o salto. O GLM-5 expandiu de 355B parâmetros (32B ativados) para 744B parâmetros (40B ativados), aumentou os dados de pré-treinamento de 23T para 28,5T, adicionou um framework de aprendizado por reforço assíncrono e integrou DeepSeek Sparse Attention para preservar a qualidade em textos longos enquanto melhora a eficiência. Esses detalhes estão atrelados ao GLM-5, mas formam a base sobre a qual o GLM-5.1 parece se apoiar.

GLM-5.1 vs outros modelos de fronteira

O GLM-5.1 se destaca como o concorrente de código aberto mais forte, oferecendo uma relação preço/desempenho convincente.

Tabela de comparação: Principais benchmarks de programação e agentes (abril de 2026)

| Modelo | SWE-Bench Pro | NL2Repo | Terminal-Bench 2.0 (Terminus-2) | Pontuação no harness de codificação | Execuções longas sustentadas? | Código aberto? | Preço aprox. da API (Entrada/Saída por M tokens) |

|---|---|---|---|---|---|---|---|

| GLM-5.1 | 58,4 (SOTA) | 42,7 | 63,5 | 45,3 (94,6% do Opus) | Sim (600+ iterações, 8 h) | Sim | US$0,54 / US$4,40 |

| GLM-5 | 55,1 | 35,9 | 56,2 | 35,4 | Limitado | Sim | Menor (antes do aumento) |

| GPT-5.4 | 57,7 | — | — | — | Forte | Não | Maior |

| Claude Opus 4.6 | 57,3 | — | — | 47,9 | O mais forte | Não | ~250–470% mais caro |

| Gemini 3.1 Pro | 54,2 | — | — | — | Bom | Não | Maior |

Veredito: o GLM-5.1 vence em acessibilidade de código aberto, custo e métricas específicas de codificação de longo horizonte. Ele disputa de igual para igual com líderes de código fechado em cenários de agentes enquanto democratiza capacidades de fronteira.

Cenários de aplicação do GLM-5.1

1) Engenharia de software autônoma

O GLM-5.1 é mais convincente quando a tarefa se assemelha a um sprint real de engenharia: ler o codebase, planejar a mudança, implementá-la, testá-la, corrigir regressões e continuar iterando até o resultado ficar estável. As notas de lançamento da Z.ai enfatizam explicitamente planejamento autônomo, execução sustentada, correção de bugs e iteração de estratégia, o que faz o modelo parecer feito sob medida para agentes de codificação e pipelines de entrega de software.

2) Fluxos de trabalho de agentes de longa duração

Se seu caso de uso envolve muitas chamadas de ferramentas, fluxos de trabalho longos em múltiplas etapas ou autocorreção repetida, o design do GLM-5.1 é um forte encaixe. A documentação destaca invocação de ferramentas, saída estruturada, integração MCP e suporte a streaming de ferramentas, todos úteis quando um modelo não está apenas respondendo, mas operando dentro de um sistema maior.

3) Trabalho de conhecimento corporativo e geração de relatórios

O GLM-5.1 também é posicionado para tarefas de produtividade de escritório, como fluxos de trabalho com PowerPoint, Word, PDF e Excel. A Z.ai afirma que ele melhora a organização de conteúdo complexo, o design de layout, a saída estruturada e o acabamento visual, o que o torna um ajuste plausível para geração de relatórios, materiais didáticos, resumos de pesquisa e outros trabalhos intensivos em documentos.

4) Prototipagem de front-end e artefatos

A Z.ai diz que o GLM-5.1 é adequado para geração de sites, páginas interativas e prototipagem de front-end, com menos estrutura baseada em templates e melhor qualidade de conclusão de tarefas. Isso sugere um bom ajuste para equipes de produto que precisam de uma ponte rápida do briefing ao protótipo, especialmente quando o protótipo precisa ser utilizável e não apenas bonito.

5) Conversas complexas e seguimento de instruções

Embora a manchete seja codificação, o GLM-5.1 também é descrito como mais forte em perguntas e respostas abertas, instruções complexas e interação multi-turn. Isso o torna útil para fluxos de trabalho no estilo assistente, em que o modelo deve manter o controle das restrições, revisar saídas e preservar o contexto ao longo de conversas mais longas.

Conclusão: por que o GLM-5.1 é importante em 2026

O GLM-5.1 não é apenas mais um lançamento incremental — ele sinaliza a chegada de IA agente de código aberto realmente capaz. Ao se destacar nos benchmarks mais difíceis de engenharia do mundo real enquanto permanece acessível e aberto, a Z.ai elevou o nível para todo o setor. Seja você um desenvolvedor solo, uma equipe corporativa ou um pesquisador, o GLM-5.1 oferece autonomia incomparável para tarefas de codificação de longo horizonte a uma fração dos custos proprietários.

Pronto para experimentar? Confira o modelo GLM-5.1 na CometAPI, o repositório no Hugging Face ou o GLM Coding Plan para acesso imediato.

.webp&w=3840&q=75)