GPT-5.2 é a atualização de dezembro de 2025 da família GPT-5 da OpenAI: uma família multimodal de ponta (texto + visão + ferramentas) ajustada para trabalho profissional do conhecimento, raciocínio com contexto longo, uso agente de ferramentas e engenharia de software. A OpenAI posiciona o GPT-5.2 como o modelo mais capaz da série GPT-5 até o momento e afirma que ele foi desenvolvido com ênfase em raciocínio confiável em múltiplas etapas, manuseio de documentos muito grandes e segurança/conformidade de políticas aprimoradas; o lançamento inclui três variantes voltadas ao usuário — Instant, Thinking e Pro — e está sendo disponibilizado primeiro para assinantes pagos do ChatGPT e clientes da API.

O que é o GPT-5.2 e por que isso importa?

O GPT-5.2 é o membro mais recente da família GPT-5 — uma nova série de modelos “de fronteira” projetada especificamente para reduzir a lacuna entre assistentes de conversação de uma única rodada e sistemas que precisam raciocinar sobre longos documentos, chamar ferramentas, interpretar imagens e executar fluxos de trabalho multi-etapas de forma confiável. A OpenAI posiciona o 5.2 como seu lançamento mais capaz para trabalho profissional do conhecimento: ele estabelece novos resultados de estado da arte em benchmarks internos (notavelmente um novo benchmark GDPval para trabalho do conhecimento), demonstra desempenho de codificação mais forte em benchmarks de engenharia de software e oferece capacidades de contexto longo e visão significativamente aprimoradas.

Em termos práticos, o GPT-5.2 é mais do que apenas “um chat maior”. É uma família de três variantes ajustadas (Instant, Thinking, Pro) que equilibram latência, profundidade de raciocínio e custo — e que, junto com a API da OpenAI e o roteamento do ChatGPT, podem ser usadas para executar longos trabalhos de pesquisa, construir agentes que chamam ferramentas externas, interpretar imagens e gráficos complexos e gerar código de nível de produção com maior fidelidade do que versões anteriores. O modelo suporta janelas de contexto muito grandes (os documentos da OpenAI listam uma janela de contexto de 400,000 tokens e um limite máximo de saída de 128,000 para os modelos principais), novos recursos de API para níveis explícitos de esforço de raciocínio e comportamento “agente” de invocação de ferramentas.

5 capacidades centrais aprimoradas no GPT-5.2

1) O GPT-5.2 é melhor em lógica multi-etapas e matemática?

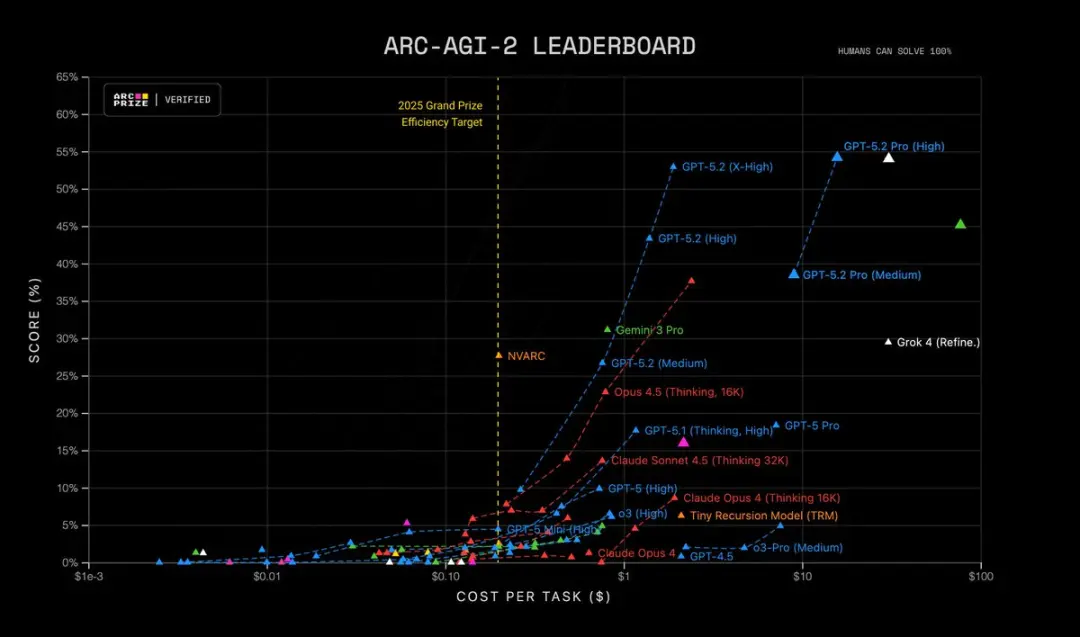

O GPT-5.2 traz um raciocínio multi-etapas mais afiado e um desempenho visivelmente mais forte em matemática e resolução estruturada de problemas. A OpenAI diz que adicionou controle mais granular sobre o esforço de raciocínio (novos níveis como xhigh), desenvolveu suporte a “tokens de raciocínio” e ajustou o modelo para manter a cadeia de pensamento por rastros de raciocínio interno mais longos. Benchmarks como FrontierMath e testes no estilo ARC-AGI mostram ganhos substanciais em relação ao GPT-5.1; margens maiores em benchmarks específicos de domínio usados em fluxos de trabalho científicos e financeiros. Em suma: o GPT-5.2 “pensa por mais tempo” quando solicitado e pode realizar trabalhos simbólicos/matemáticos mais complicados com melhor consistência.

| RC-AGI-1 (Verified) Raciocínio abstrato | 86.2% | 72.8% |

|---|---|---|

| ARC-AGI-2 (Verified) Raciocínio abstrato | 52.9% | 17.6% |

O GPT-5.2 Thinking estabelece recordes em múltiplos testes avançados de ciência e raciocínio matemático:

- GPQA Diamond Science Quiz: 92.4% (versão Pro 93.2%)

- ARC-AGI-1 Abstract Reasoning: 86.2% (primeiro modelo a romper o patamar de 90%)

- ARC-AGI-2 Higher Order Reasoning: 52.9%, estabelecendo um novo recorde para o modelo Thinking Chain

- FrontierMath Advanced Mathematics Test: 40.3%, superando em muito seu predecessor;

- HMMT Math Competition Problems: 99.4%

- AIME Math Test: 100% Complete Solution

Além disso, o GPT-5.2 Pro (High) é o estado da arte no ARC-AGI-2, alcançando uma pontuação de 54.2% a um custo de $15.72 por tarefa! Superando todos os outros modelos.

Por que isso importa: muitas tarefas do mundo real — modelagem financeira, desenho de experimentos, síntese de programas que exigem raciocínio formal — são limitadas pela capacidade do modelo de encadear muitos passos corretos. O GPT-5.2 reduz “passos alucinados” e produz rastros intermediários de raciocínio mais estáveis quando você pede para mostrar o processo.

2) Como melhoraram a compreensão de texto longo e o raciocínio entre documentos?

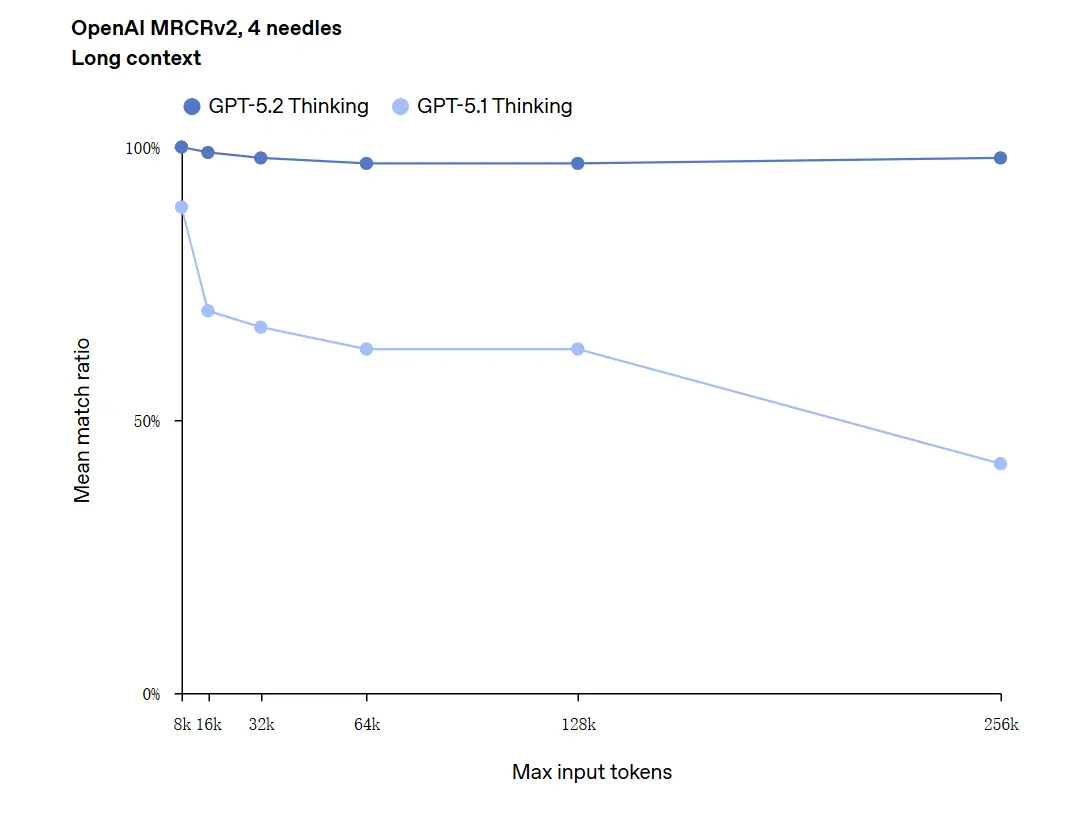

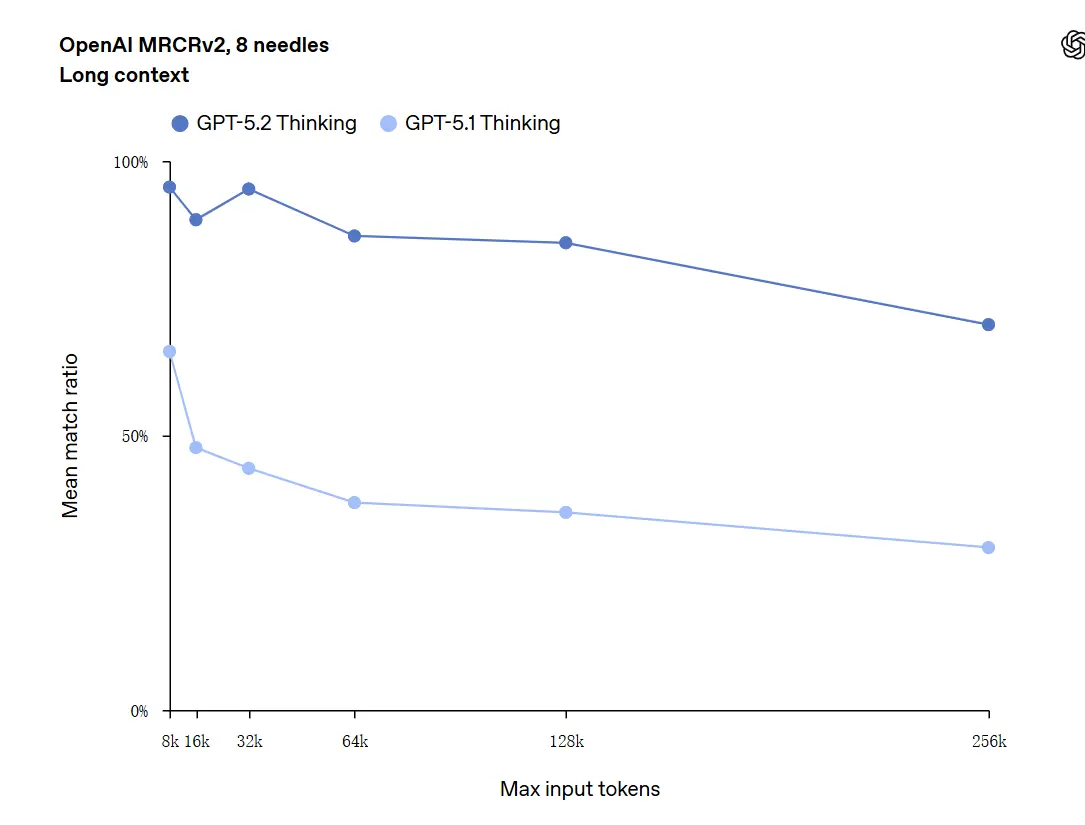

O entendimento de contexto longo é uma das melhorias de destaque. O modelo subjacente do GPT-5.2 suporta uma janela de contexto de 400k tokens e — o que é importante — mantém maior precisão à medida que o conteúdo relevante se desloca profundamente nesse contexto. O GDPval, um conjunto de tarefas para “trabalho do conhecimento bem especificado” em 44 ocupações, onde o GPT-5.2 Thinking atinge paridade ou supera juízes humanos especialistas em uma grande parcela das tarefas. Relatos independentes confirmam que o modelo retém e sintetiza informações entre muitos documentos muito melhor do que modelos anteriores. Este é um avanço genuinamente prático para tarefas como due diligence, sumarização jurídica, revisões de literatura e compreensão de bases de código.

O GPT-5.2 pode lidar com contextos de até 256,000 tokens (aproximadamente 200+ páginas de documentos). Além disso, no teste de compreensão de texto longo "OpenAI MRCRv2", o GPT-5.2 Thinking alcançou uma taxa de acerto próxima de 100%.

Advertência sobre “100% de precisão”: as melhorias foram descritas como “aproximando-se de 100%” para microtarefas estreitas; os dados da OpenAI são melhor descritos como “estado da arte e, em muitos casos, em níveis iguais ou superiores aos de especialistas humanos nas tarefas avaliadas”, não literalmente perfeitos em todos os usos. Os benchmarks mostram grandes ganhos, mas não perfeição universal.

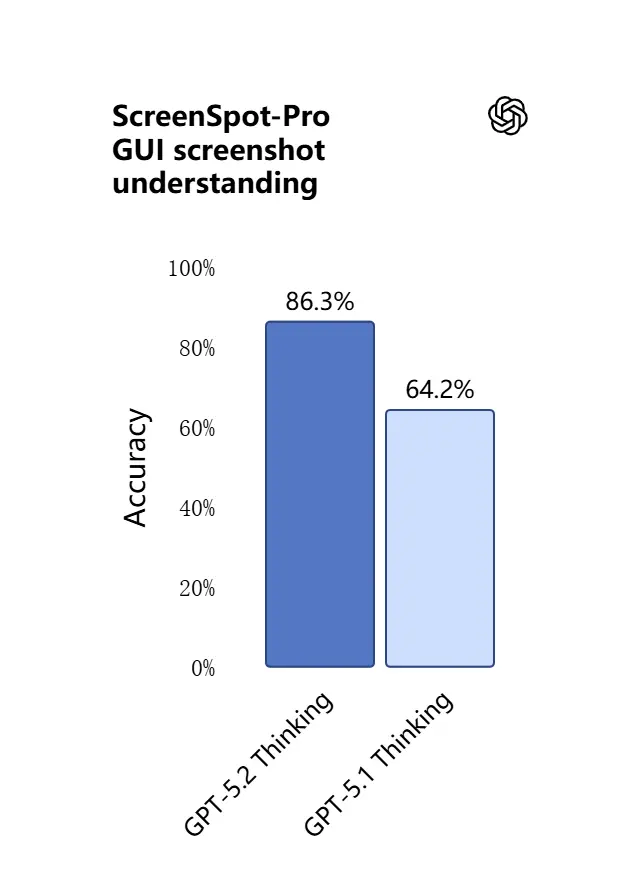

3) O que há de novo em entendimento visual e raciocínio multimodal?

As capacidades de visão no GPT-5.2 são mais nítidas e práticas. O modelo está melhor em interpretar capturas de tela, ler gráficos e tabelas, reconhecer elementos de interface e combinar entradas visuais com contexto textual longo. Isso não é apenas legendagem: o GPT-5.2 pode extrair dados estruturados de imagens (por exemplo, tabelas em um PDF), explicar gráficos e raciocinar sobre diagramas de modo a apoiar ações de ferramentas downstream (por exemplo, gerar uma planilha a partir de um relatório fotografado).

.webp)

Efeito prático: equipes podem enviar apresentações completas, relatórios de pesquisa digitalizados ou documentos com muitas imagens diretamente para o modelo e pedir sínteses entre documentos — reduzindo muito o trabalho manual de extração.

4) Como mudou a invocação de ferramentas e a execução de tarefas?

O GPT-5.2 avança ainda mais no comportamento agente: ele está melhor em planejar tarefas multi-etapas, decidir quando chamar ferramentas externas e executar sequências de chamadas de API/ferramentas para concluir um trabalho de ponta a ponta. Melhorias de “chamadas de ferramentas agentes” — o modelo propõe um plano, chama ferramentas (bancos de dados, computação, sistemas de arquivos, navegador, executores de código) e sintetiza resultados em um entregável final de forma mais confiável do que versões anteriores. A API introduz roteamento e controles de segurança (listas de ferramentas permitidas, scaffolding de ferramentas) e a interface do ChatGPT pode rotear automaticamente as solicitações para a variante 5.2 apropriada (Instant vs Thinking).

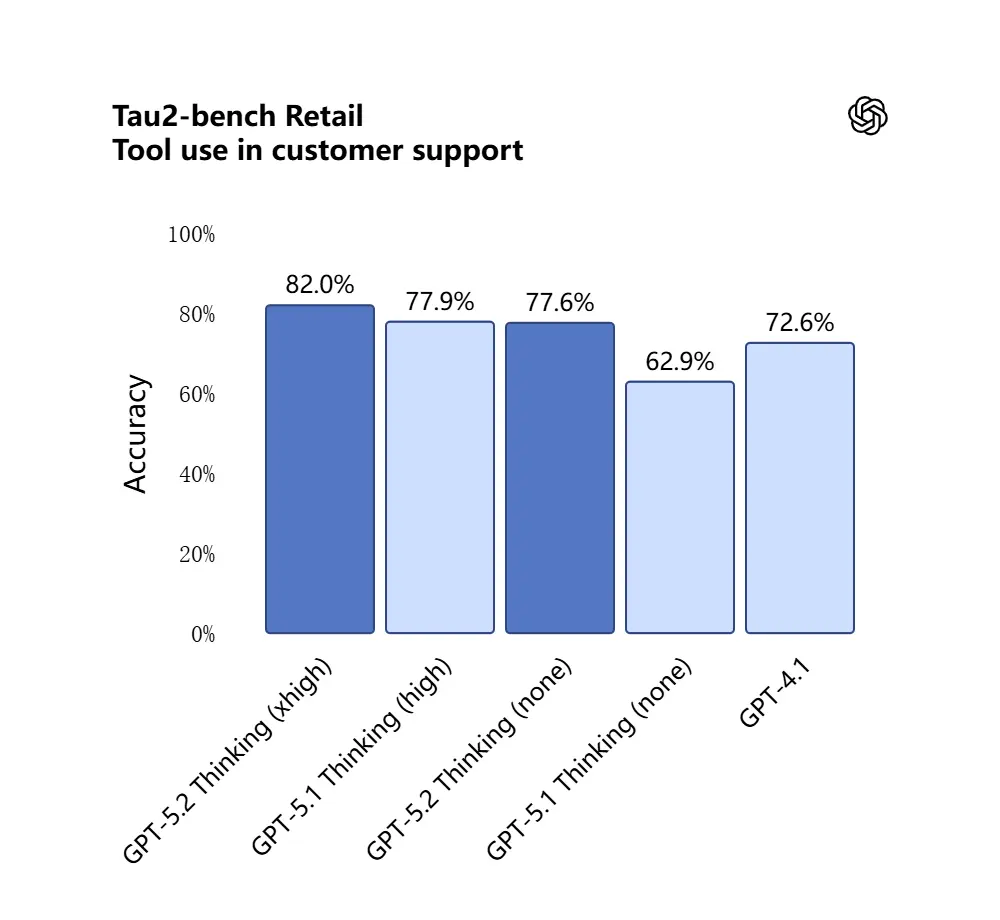

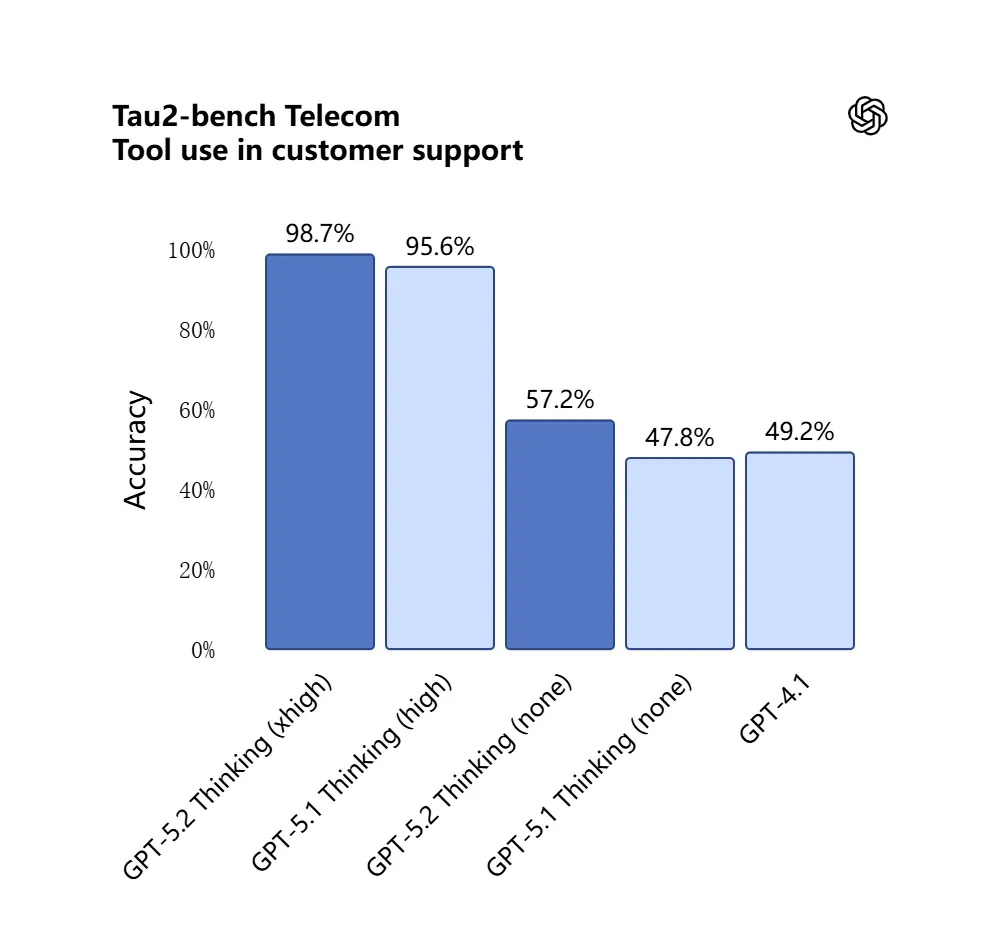

O GPT-5.2 obteve 98.7% no benchmark Tau2-Bench Telecom, demonstrando suas capacidades maduras de chamada de ferramentas em tarefas complexas de múltiplas interações.

Por que isso importa: isso torna o GPT-5.2 mais útil como um assistente autônomo para fluxos de trabalho como “ingira estes contratos, extraia cláusulas, atualize uma planilha e escreva um e-mail de resumo” — tarefas que anteriormente exigiam orquestração cuidadosa.

5) Capacidade de programação evoluída

O GPT-5.2 é significativamente melhor em tarefas de engenharia de software: escreve módulos mais completos, gera e executa testes com mais confiabilidade, entende gráficos de dependência de projetos complexos e é menos propenso a “codificação preguiçosa” (pular boilerplate ou deixar de conectar módulos). Em benchmarks de codificação de nível industrial (SWE-bench Pro, etc.), o GPT-5.2 estabelece novos recordes. Para equipes que usam LLMs como pares-programadores, essa melhoria pode reduzir a verificação manual e retrabalho necessários após a geração.

No teste SWE-Bench Pro (tarefa real de engenharia de software industrial), a pontuação do GPT-5.2 Thinking melhorou para 55.6%, enquanto também atingiu um novo recorde de 80% no teste SWE-Bench Verified.

_Software%20engineering.webp)

Em aplicações práticas, isso significa:

- Depuração automática de código em ambiente de produção, levando a maior estabilidade;

- Suporte a programação multilíngue (não limitada a Python);

- Capacidade de concluir de forma independente tarefas de reparo de ponta a ponta.

Quais são as diferenças entre GPT-5.2 e GPT-5.1?

Resposta curta: o GPT-5.2 é uma melhoria iterativa, porém substancial. Ele mantém a arquitetura e as bases multimodais da família GPT-5, mas avança em quatro dimensões práticas:

- Profundidade e consistência do raciocínio. O 5.2 introduz níveis mais altos de esforço de raciocínio e um encadeamento melhor para problemas de múltiplas etapas; o 5.1 melhorou o raciocínio anteriormente, mas o 5.2 eleva o teto para matemática complexa e lógica multi-estágios.

- Confiabilidade em contexto longo. Ambas as versões ampliaram o contexto, mas o 5.2 foi ajustado para manter a precisão profundamente em entradas muito longas (a OpenAI afirma retenção aprimorada até centenas de milhares de tokens).

- Fidelidade de visão + multimodal. O 5.2 melhora a referência cruzada entre imagens e texto — por exemplo, ler um gráfico e integrar esses dados em uma planilha — mostrando maior precisão em nível de tarefa.

- Comportamento agente de ferramentas e recursos da API. O 5.2 expõe novos parâmetros de esforço de raciocínio (

xhigh) e recursos de compactação de contexto na API, e a OpenAI refinou a lógica de roteamento no ChatGPT para que a interface escolha automaticamente a melhor variante. - Menos erros, maior estabilidade: o GPT-5.2 reduz sua “taxa de ilusão” (taxa de respostas falsas) em 38%. Ele responde a perguntas de pesquisa, redação e análise com mais confiabilidade, reduzindo instâncias de “fatos fabricados”. Em tarefas complexas, sua saída estruturada é mais clara e sua lógica mais estável. Enquanto isso, a segurança das respostas do modelo é significativamente melhorada em tarefas relacionadas à saúde mental. Ele tem desempenho mais robusto em cenários sensíveis como saúde mental, autoagressão, suicídio e dependência emocional.

Em avaliações de sistema, o GPT-5.2 Instant obteve 0.995 (de 1.0) na tarefa de “Apoio à Saúde Mental”, significativamente maior que o GPT-5.1 (0.883).

Quantitativamente, os benchmarks publicados pela OpenAI mostram ganhos mensuráveis no GDPval, em benchmarks de matemática (FrontierMath) e em avaliações de engenharia de software. O GPT-5.2 supera o GPT-5.1 em tarefas de planilhas de banco de investimento júnior por alguns pontos percentuais.

O GPT-5.2 é gratuito — quanto custa?

Posso usar o GPT-5.2 gratuitamente?

A OpenAI iniciou a disponibilização do GPT-5.2 começando por planos pagos do ChatGPT e acesso via API. Historicamente, a OpenAI mantém os modelos mais rápidos/profundos atrás de camadas pagas enquanto variantes mais leves são disponibilizadas mais amplamente depois; com o 5.2 a empresa disse que a distribuição começaria em planos pagos (Plus, Pro, Business, Enterprise) e que a API está disponível para desenvolvedores. Isso significa que o acesso gratuito imediato é limitado: a camada gratuita pode receber acesso degradado ou roteado (por exemplo, para subvariantes mais leves) posteriormente à medida que a OpenAI escala a disponibilização.

A boa notícia é que a CometAPI agora integra com o GPT-5.2, e está atualmente em promoção de Natal. Você já pode usar o GPT-5.2 por meio da CometAPI; o playground permite interagir livremente com o GPT-5.2, e desenvolvedores podem usar a API do GPT-5.2 (a CometAPI tem preço de 20% do da OpenAI) para construir fluxos de trabalho.

Quanto custa via API (uso por desenvolvedores/produção)?

O uso da API é cobrado por token. A precificação publicada pela plataforma da OpenAI no lançamento mostra (a CometAPI tem preço de 20% do da OpenAI):

- GPT-5.2 (chat padrão) — $1.75 por 1M tokens de entrada e $14 por 1M tokens de saída (descontos para entradas em cache se aplicam).

- GPT-5.2 Pro (flagship) — $21 por 1M tokens de entrada e $168 por 1M tokens de saída (significativamente mais caro porque é destinado a cargas de trabalho de alta precisão e alto consumo de computação).

- Em comparação, o GPT-5.1 era mais barato (por exemplo, $1.25 in / $10 out por 1M tokens).

Interpretação: os custos da API aumentaram em relação às gerações anteriores; o preço sinaliza que o desempenho premium de raciocínio e contexto longo do 5.2 é precificado como um nível de produto distinto. Para sistemas de produção, os custos do plano dependem fortemente de quantos tokens você insere/gera e com que frequência você reutiliza entradas em cache (entradas em cache recebem grandes descontos).

O que isso significa na prática

- Para uso casual via interface do ChatGPT, os planos de assinatura mensal (Plus, Pro, Business, Enterprise) são o caminho principal. A precificação das camadas de assinatura do ChatGPT não mudou com o lançamento do 5.2 (a OpenAI mantém os preços dos planos estáveis mesmo se as ofertas de modelos mudarem).

- Para uso em produção & desenvolvedores, preveja o custo por token. Se seu app transmite muitas respostas longas ou processa documentos extensos, o preço dos tokens de saída ($14 / 1M tokens para Thinking) dominará os custos, a menos que você faça cache cuidadosamente das entradas e reutilize saídas.

GPT-5.2 Instant vs GPT-5.2 Thinking vs GPT-5.2 Pro

A OpenAI lançou o GPT-5.2 com três variantes com propósito definido para combinar com casos de uso: Instant, Thinking e Pro:

- GPT-5.2 Instant: Rápido, econômico, ajustado para o trabalho do dia a dia — FAQs, tutoriais, traduções, rascunhos rápidos. Menor latência; bons primeiros rascunhos e fluxos simples.

- GPT-5.2 Thinking: Respostas mais profundas e de maior qualidade para trabalho contínuo — sumarização de documentos longos, planejamento multi-etapas, revisões detalhadas de código. Latência e qualidade balanceadas; o ‘cavalo de batalha’ padrão para tarefas profissionais.

- GPT-5.2 Pro: Máxima qualidade e confiabilidade. Mais lento e caro; melhor para tarefas difíceis e de alto risco (engenharia complexa, síntese jurídica, decisões de alto valor) e onde é necessário um esforço de raciocínio ‘xhigh’.

Tabela de comparação

| Recurso / Métrica | GPT-5.2 Instant | GPT-5.2 Thinking | GPT-5.2 Pro |

|---|---|---|---|

| Uso pretendido | Tarefas cotidianas, rascunhos rápidos | Análise profunda, documentos longos | Máxima qualidade, problemas complexos |

| Latência | A mais baixa | Moderada | A mais alta |

| Esforço de raciocínio | Padrão | Alto | xHigh disponível |

| Melhor para | FAQ, tutoriais, traduções, prompts curtos | Resumos, planejamento, planilhas, tarefas de código | Engenharia complexa, síntese jurídica, pesquisa |

| Exemplos de nome na API | gpt-5.2-chat-latest | gpt-5.2 | gpt-5.2-pro |

| Preço por token de entrada (API) | $1.75 / 1M | $1.75 / 1M | $21 / 1M |

| Preço por token de saída (API) | $14 / 1M | $14 / 1M | $168 / 1M |

| Disponibilidade (ChatGPT) | Em distribuição; planos pagos e depois mais amplo | Em distribuição para planos pagos | Usuários Pro / Enterprise (pago) |

| Exemplo típico de uso | Redigir e-mail, trechos menores de código | Construir modelo financeiro multi-aba, perguntas e respostas de relatório longo | Auditar base de código, gerar design de sistema de nível de produção |

Quem é adequado para usar o GPT-5.2?

O GPT-5.2 foi projetado com um amplo conjunto de usuários-alvo em mente. Abaixo estão recomendações por perfil:

Empresas & times de produto

Se você constrói produtos de trabalho do conhecimento (assistentes de pesquisa, revisão de contratos, pipelines de analytics ou ferramentas de desenvolvedor), as capacidades de contexto longo e agente do GPT-5.2 podem reduzir significativamente a complexidade de integração. Empresas que precisam de compreensão robusta de documentos, relatórios automatizados ou copilotos inteligentes acharão o Thinking/Pro útil. A Microsoft e outros parceiros de plataforma já estão integrando o 5.2 em pilhas de produtividade (por exemplo, Microsoft 365 Copilot).

Desenvolvedores e equipes de engenharia

Equipes que desejam usar LLMs como pares-programadores ou para automatizar geração/teste de código se beneficiarão da fidelidade de programação aprimorada no 5.2. O acesso à API (com modos thinking ou pro) permite sínteses mais profundas de grandes bases de código graças à janela de contexto de 400k tokens. Espere pagar mais na API ao usar o Pro, mas a redução na depuração e revisão manuais pode justificar o custo para sistemas complexos.

Pesquisadores e analistas com muitos dados

Se você sintetiza literatura regularmente, analisa relatórios técnicos longos ou deseja desenho de experimentos assistido por modelo, o contexto longo e as melhorias em matemática do GPT-5.2 ajudam a acelerar fluxos de trabalho. Para pesquisa reprodutível, combine o modelo com engenharia de prompt cuidadosa e etapas de verificação.

Pequenas empresas e usuários avançados

O ChatGPT Plus (e Pro para usuários avançados) terá acesso roteado às variantes 5.2; isso torna automação avançada e resultados de alta qualidade acessíveis para equipes menores sem precisar construir uma integração de API. Para usuários não técnicos que precisam de melhor sumarização de documentos ou criação de slides, o GPT-5.2 entrega valor prático perceptível.

Notas práticas para desenvolvedores e operadores

Recursos de API a observar

- Níveis de

reasoning.effort(por exemplo,medium,high,xhigh) permitem dizer ao modelo quanto computar gastar em raciocínio interno; use isso para trocar latência por precisão por solicitação. - Compactação de contexto: a API inclui ferramentas para comprimir e compactar o histórico de modo que o conteúdo realmente relevante seja preservado em cadeias longas. Isso é crítico quando você precisa manter o uso efetivo de tokens gerenciável.

- Scaffolding de ferramentas & controles de ferramentas permitidas: sistemas de produção devem listar explicitamente o que o modelo pode invocar e registrar chamadas de ferramentas para auditoria.

Dicas de controle de custos

- Faça cache de embeddings de documentos usados com frequência e use entradas em cache (que recebem descontos acentuados) para consultas repetidas ao mesmo corpus. A precificação da plataforma da OpenAI inclui descontos significativos para entradas em cache.

- Roteie consultas exploratórias/de baixo valor para o Instant e mantenha o Thinking/Pro para lotes ou passagens finais.

- Estime cuidadosamente o uso de tokens (entrada + saída) ao projetar custos da API, pois saídas longas multiplicam o custo.

Conclusão — você deve migrar para o GPT-5.2?

Se seu trabalho depende de raciocínio sobre documentos longos, síntese entre documentos, interpretação multimodal (imagens + texto) ou construção de agentes que chamam ferramentas, o GPT-5.2 é uma atualização clara: aumenta a precisão prática e reduz o trabalho manual de integração. Se você roda principalmente chatbots de alto volume e baixa latência ou aplicações com orçamento estrito, o Instant (ou modelos anteriores) ainda pode ser uma escolha razoável.

O GPT-5.2 representa uma mudança deliberada de “melhor chat” para “melhor assistente profissional”: mais computação, mais capacidade e camadas de custo mais altas — mas também ganhos reais de produtividade para equipes que podem aproveitar o contexto longo confiável, a matemática/raciocínio aprimorados, o entendimento de imagens e a execução agente de ferramentas.

Para começar, explore as capacidades dos modelos GPT-5.2 (GPT-5.2;GPT-5.2 pro, GPT-5.2 chat) no Playground e consulte o guia da API para instruções detalhadas. Antes de acessar, certifique-se de ter feito login na CometAPI e obtido a chave de API. A CometAPI oferece um preço muito inferior ao oficial para ajudar na sua integração.

Pronto para começar?→ Teste gratuito dos modelos gpt-5.2 !