Seedance 2.0 é o modelo de geração de vídeo por IA de nova geração da ByteDance, lançado oficialmente em março de 2026. Ele oferece suporte a entradas de texto, imagem, áudio e vídeo, pode usar até 9 imagens, 3 clipes de vídeo e 3 clipes de áudio como referências, e foi projetado para controle em nível de diretor, estabilidade de movimento e geração conjunta de áudio e vídeo. Nos atuais rankings de votação às cegas da Artificial Analysis, o Seedance 2.0 lidera tanto a categoria de texto para vídeo quanto a de imagem para vídeo sem áudio, com pontuações Elo de 1269 e 1351, respectivamente.

O que é o Seedance 2.0?

O Seedance 2.0 é o modelo de criação de vídeo de nova geração da ByteDance Seed. Oficialmente, ele é construído sobre uma arquitetura unificada multimodal de geração conjunta de áudio e vídeo que aceita entradas de texto, imagem, áudio e vídeo, e é posicionado como uma ferramenta para criadores com capacidades de referência e edição excepcionalmente amplas. O Seedance 2.0 foi projetado para fluxos de trabalho de conteúdo em escala industrial, com maior precisão física, realismo, controlabilidade e estabilidade em cenas de movimento complexo do que a versão 1.5 anterior. Ao contrário dos modelos anteriores, que se concentravam principalmente em texto para vídeo, o Seedance 2.0 introduz um pipeline de geração multimodal totalmente unificado, permitindo:

- Geração de texto para vídeo

- Animação de imagem para vídeo

- Edição de vídeo para vídeo

- Saída sincronizada com áudio

Isso o torna uma das plataformas de criação de vídeo com IA mais abrangentes disponíveis em 2026.

Por que isso importa?

A maioria dos geradores de vídeo ainda é otimizada para um fluxo de trabalho relativamente estreito: entra um prompt, sai um clipe. O Seedance 2.0 vai além ao tratar a geração de vídeo mais como um espaço de trabalho de diretor. Segundo a ByteDance, ele pode usar vários tipos de referência ao mesmo tempo, preservar a consistência do assunto, seguir instruções detalhadas com mais fidelidade e até planejar a linguagem de câmera de uma forma mais “direcional”. Essa combinação importa porque os problemas mais difíceis na geração de vídeo não são apenas estéticos, mas também continuidade, coerência de movimento e controle sobre o que acontece ao longo do tempo.

O que há de novo e quais são os principais recursos do Seedance 2.0?

Geração multimodal unificada

O recurso mais importante é a capacidade do modelo de raciocinar conjuntamente sobre várias modalidades. O Seedance 2.0 suporta até 9 imagens, 3 vídeos e 3 clipes de áudio como referências, juntamente com instruções em linguagem natural, e pode gerar vídeos de até 15 segundos de duração. Em termos práticos, isso significa que você pode orientar não apenas o assunto e a cena, mas também o estilo de movimento, o movimento de câmera, os efeitos especiais e os sinais de áudio em uma única etapa de geração.

Controle em nível de diretor

O Seedance 2.0 também foi desenvolvido em torno do que a ByteDance descreve como controle em nível de diretor. Os criadores podem moldar performance, iluminação, sombra e movimento de câmera usando imagens, áudio e vídeo de referência. O modelo pode preservar uma identidade estável do sujeito, reproduzir roteiros complexos com precisão e escolher a linguagem de câmera de uma forma que reflita um tipo de “lógica de edição” integrada. Para os criadores, isso representa um grande avanço além do básico de texto para vídeo.

Edição e extensão, não apenas geração

Outro upgrade notável é que o Seedance 2.0 não para na geração. O Seedance 2.0 adiciona capacidades de edição e extensão de vídeo, permitindo mudanças direcionadas em cenas, personagens, ações ou pontos da trama específicos, além de possibilitar tomadas contínuas subsequentes. O artigo do desenvolvedor também explica que o modelo pode ser usado para “continuar filmando” ao estender um clipe em vez de começar de novo. Isso é importante para a eficiência do fluxo de trabalho, porque reduz a necessidade de regenerar uma cena inteira apenas para corrigir um segmento.

Melhor tratamento de movimentos complexos

O Seedance 2.0 é significativamente mais forte em cenas com múltiplos sujeitos, interações e movimento complicado. A qualidade de geração melhorou substancialmente em relação à versão 1.5, com melhor precisão física, realismo e controlabilidade. A taxa de usabilidade do Seedance 2.0 em cenas difíceis de movimento atinge um nível SOTA do setor em sua estrutura interna de avaliação, ao mesmo tempo em que reconhece que ainda são necessários mais avanços na estabilidade de detalhes finos, no realismo e na vivacidade.

Benchmark de desempenho

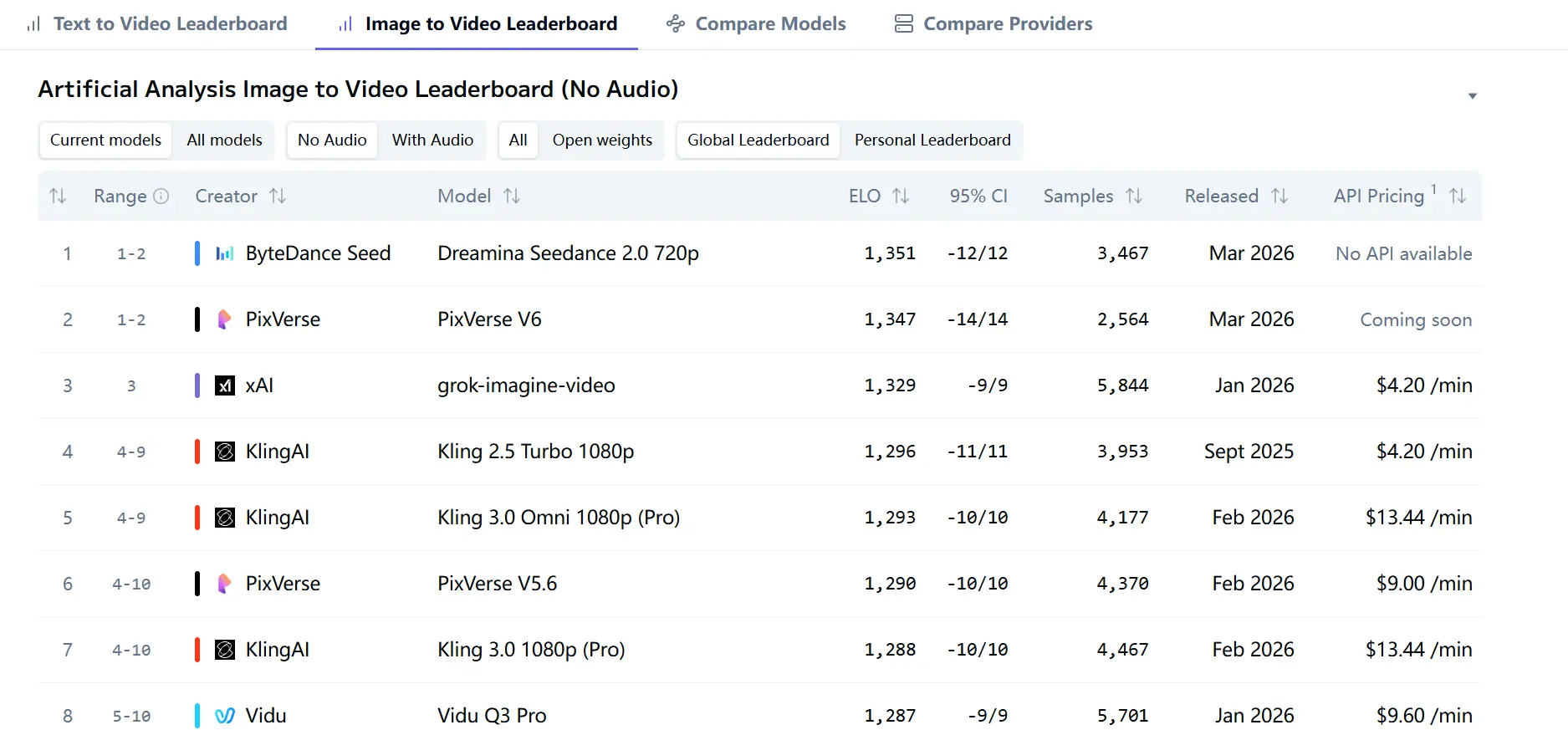

O sinal de terceiros mais forte nas fontes analisadas é a Video Arena da Artificial Analysis. Nas páginas atuais do ranking, Dreamina Seedance 2.0 720p lidera a Image-to-Video Arena without audio com Elo 1351, e a Text-to-Video Arena without audio com Elo 1269. As páginas do ranking também afirmam que as classificações vêm de votos cegos de usuários, o que é importante porque mede a preferência humana em escala, e não apenas métricas internas do modelo.

Isso importa porque significa que o Seedance 2.0 não está sendo apenas comercializado como capaz; ele está atualmente sendo preferido pelos usuários em testes comparativos diretos em duas arenas principais. Em texto para vídeo sem áudio, ele lidera o Kling 3.0 1080p (Pro), SkyReels V4, PixVerse V6 e Kling 3.0 Omni 1080p (Pro). Em imagem para vídeo sem áudio, ele supera por pouco o PixVerse V6 e o grok-imagine-video.

Resumo de desempenho do Seedance 2.0

| Metric | Seedance 2.0 |

|---|---|

| Image-to-Video Rank | Top 15 globally |

| ELO Score | ~1258 |

| Text-to-Video Rank | Top 25 |

| Cost | ~$1.56/min |

| Strength | Cost-performance balance |

👉 Interpretação:

- Nem sempre é o nº 1 em qualidade bruta

- Mas tem uma relação valor-desempenho excepcional

Quão bom é o Seedance 2.0, de fato?

Seus maiores pontos fortes

Os maiores pontos fortes do Seedance 2.0 são claros: ele lida com movimentos complexos melhor do que muitos modelos de vídeo, suporta múltiplas modalidades de referência, oferece edição e extensão, e atualmente lidera os rankings públicos mais visíveis em texto para vídeo e imagem para vídeo sem áudio. Há melhorias em precisão física, realismo e controlabilidade, que são exatamente os atributos que importam quando um modelo passa de demos experimentais para fluxos de trabalho profissionais.

Suas limitações atuais

A ByteDance não apresenta o Seedance como perfeito. Ainda há espaço para melhorar a estabilidade de detalhes, o realismo e a vivacidade do movimento, e ela aponta desafios remanescentes na consistência entre múltiplos sujeitos, na precisão da renderização de texto e em efeitos complexos de edição.

Minha avaliação

Com base nas fontes analisadas, o Seedance 2.0 parece menos uma atualização marginal e mais um passo sério em direção a um sistema de vídeo pronto para produção. Seu maior argumento não é uma única demo chamativa, mas a combinação de uma pilha de entradas multimodais mais ampla, controles diretos de edição, extensão de clipes e liderança confiável em rankings públicos. Isso o torna um dos modelos de vídeo mais importantes atualmente no mercado, especialmente para equipes que se importam tanto com controlabilidade quanto com qualidade cinematográfica bruta.

Seedance 2.0 vs Sora 2 vs Veo 3.1

Tabela comparativa (líderes de vídeo por IA em 2026)

| Feature | Seedance 2.0 | Sora 2 | Veo 3.1 |

|---|---|---|---|

| Developer | ByteDance | OpenAI | |

| Input Types | Text, image, audio, video | Text | Text + image |

| Audio Generation | ✅ Native | ❌ Limited | ✅ |

| Max Video Length | 15–20 sec | ~25 sec | ~8 sec (extendable) |

| Editing Capability | ⭐ Advanced (reference-based) | Moderate | Moderate |

| ELO Ranking | Top 15–25 | High | High |

| Cost Efficiency | ⭐ High | Medium | Medium |

| Commercial Use | Yes | Limited (watermark) | Yes |

| Unique Strength | Multimodal editing | Long storytelling | Visual fidelity |

Principais conclusões

- Seedance 2.0 = melhor edição + flexibilidade multimodal

- Sora 2 = melhor duração narrativa

- Veo 3.1 = melhor fidelidade de imagem para vídeo

Nos rankings atuais de texto para vídeo da Artificial Analysis, o Seedance 2.0 720p está à frente tanto do Veo 3.1 quanto do Sora 2 Pro na categoria sem áudio. Isso não encerra todos os debates sobre qualidade, porque os modelos diferem em fluxo de trabalho, restrições de segurança e empacotamento do produto, mas mostra que o Seedance 2.0 entrou no mesmo nível de elite das ofertas ocidentais mais visíveis.

A vantagem mais óbvia do Seedance 2.0 é a amplitude de entradas. A ByteDance diz que ele pode processar conjuntamente texto, imagem, áudio e vídeo, e pode usar até 9 imagens, 3 vídeos e 3 clipes de áudio ao mesmo tempo. A documentação do Sora 2 da OpenAI, em contraste, lista texto e imagem como entradas e vídeo mais áudio como saídas, com acesso pelo aplicativo Sora e por sora.com; o Sora 2 Pro também está disponível para usuários do ChatGPT Pro na web. O Veo 3.1 do Google fica em algum ponto intermediário: ele é centrado em criação guiada por imagem e geração de vídeo rica em áudio, com até 3 imagens de referência, extensão de cena e controle do primeiro e do último quadro.

Como acessar e onde comparar

Se você quiser acessar Sora 2, Veo 3.1 e xx simultaneamente em uma única plataforma, recomendo a CometAPI. O Playgoud da CometAPI oferece geração direta de vídeo usando apenas um comando simples ou algumas imagens de referência. Se você quiser configurar programaticamente sua própria API de geração de vídeo, então a CometAPI vale ainda mais a pena considerar. Ela fornece APIs para Sora 2, Veo 3.1 etc., e atualmente está com 20% de desconto.

Como usar o Seedance 2.0 com a CometAPI

Geração de texto para vídeo

Digite uma descrição da sua cena. Quanto mais específica, melhor — inclua movimento de câmera, iluminação, clima e estilo. A forte aderência a prompts do Seedance 2.0 significa que a saída corresponde de perto à sua intenção, tornando-o confiável para produção de conteúdo em vez de tentativa e erro.

No CometAPI Playground, você pode inserir prompts diretamente e gerar vídeos usando o modelo Seedance 2.0. Isso é especialmente útil para conteúdo de redes sociais (Reels, TikTok, YouTube Shorts), vídeos de marca e clipes narrativos curtos.

Como funciona:

- Abra a CometAPI

- Selecione o modelo Seedance 2.0

- Insira seu prompt

- Ajuste os parâmetros (duração, resolução, proporção)

- Execute o trabalho de geração e aguarde a saída

Imagem para vídeo com a CometAPI

Envie uma imagem estática — como uma foto de produto, ilustração conceitual ou mockup de design — e use os recursos de imagem para vídeo do Seedance 2.0 por meio da CometAPI para animá-la.

O resultado é um movimento suave e sensível ao contexto gerado a partir da sua entrada visual. Isso é ideal para equipes que já possuem ativos de design e querem convertê-los em vídeo sem um fluxo de produção completo.

Como funciona:

- Use

input_reference(ou o campo equivalente de upload de arquivo no Playground) - Adicione um prompt focado em movimento descrevendo como a cena deve se mover

Exemplo de prompt:

“A câmera avança lentamente em direção ao produto, iluminação suave de estúdio, reflexos sutis, sensação comercial premium”

Geração audiovisual em uma única etapa

Em vez de gerar primeiro o vídeo e depois adicionar o áudio separadamente, a CometAPI oferece suporte ao pipeline nativo de geração audiovisual do Seedance 2.0.

Ao descrever tanto os elementos visuais quanto o som em um único prompt, você pode gerar vídeo e áudio sincronizados em uma única etapa. Isso produz resultados mais coesos e intencionais, além de reduzir o tempo de edição.

Exemplo de prompt:

“Uma praia tranquila ao nascer do sol, ondas suaves quebrando, luz dourada quente, música ambiente suave com sons do oceano”

A saída inclui:

- Vídeo gerado

- Áudio de fundo sincronizado

- Tempo e atmosfera naturalmente alinhados

Por que usar a CometAPI para o Seedance 2.0

- Acesso direto via API ou Playground

- Controle fácil de parâmetros (duração, resolução, formato)

- Suporta fluxos de trabalho de texto para vídeo e imagem para vídeo

- Manipulação de tarefas integrada para geração assíncrona de vídeo

Conclusão

O Seedance 2.0 parece um salto genuíno na geração de vídeo por IA: um sistema multimodal que combina entradas de texto, imagem, áudio e vídeo; um líder de ranking em texto para vídeo e imagem para vídeo; e um modelo construído para controle em estilo de direção, em vez de uso casual e experimental. Se você se importa apenas com a qualidade percebida bruta, as evidências atuais dizem que ele é excepcional.

Comece a criar com o Seedance 2.0 na CometAPI hoje mesmo.