Vidu Q3 entrou em cena no início de 2026 como um dos sinais mais claros de que a geração de vídeo impulsionada por IA está passando de clipes curtos e de novidade para narrativas genuínas com múltiplas tomadas. Nos meses desde seu amplo lançamento, o Vidu Q3 tornou-se um elemento básico em fluxos de trabalho de criadores, pilotos de pesquisa e pilotos comerciais — e por bons motivos: ele leva a duração, a integração audiovisual e a coerência multi‑tomada mais longe do que a maioria dos modelos anteriores, além de oferecer uma API voltada para desenvolvedores para uso programático.

O que é o Vidu Q3?

Vidu Q3 é a mais recente iteração flagship da arquitetura de Large Video Model (LVM) da ShengShu Technology. Ao contrário de seus predecessores (Vidu 1.0 e 1.5), que exigiam fluxos separados para geração visual e pós‑produção de áudio, o Vidu Q3 é um mecanismo generativo “all‑in‑one”.

A principal inovação do Vidu Q3 é sua capacidade de gerar simultaneamente visuais em alta definição e áudio de alta fidelidade.[ Ao compreender conjuntamente a física do som e da luz, o modelo elimina o “vale da estranheza” de áudio dessincronizado frequentemente visto em modelos concorrentes. Ele suporta até 16 segundos de geração contínua em resolução nativa 1080p, posicionando‑o como uma ferramenta pronta para produção de curtas, comerciais e narrativas.]

Como o Vidu Q3 funciona por baixo do capô?

Embora os detalhes da arquitetura central sejam proprietários, o Vidu se baseia em U‑ViT, fusão de modelos de difusão e Transformers — um design conhecido por equilibrar coerência, continuidade temporal e expressividade na geração de vídeo.

Essa arquitetura híbrida permite que o modelo raciocine sobre movimento, som e contexto narrativo ao longo de sequências estendidas.

6 recursos de destaque do Vidu Q3

1. Geração de duração estendida — até onde pode ir?

Um dos recursos de destaque do Vidu Q3 é a maior duração por geração única. Muitos modelos anteriores focavam em micro‑clipes; o Q3 estende intencionalmente o comprimento do clipe para permitir arcos de história simples e sequências com múltiplas tomadas sem obrigar criadores a juntar vários clipes minúsculos. Documentação de plataforma e portais de parceiros divulgam até ~16 segundos de geração nativa em uma passada (as opções de formato e qualidade podem variar por provedor e plano de API). Isso importa porque sair de 4–8 segundos para 16 segundos muda como os criadores planejam cenas, escrevem beats e marcam cues de áudio.

2. Fidelidade visual e coerência temporal

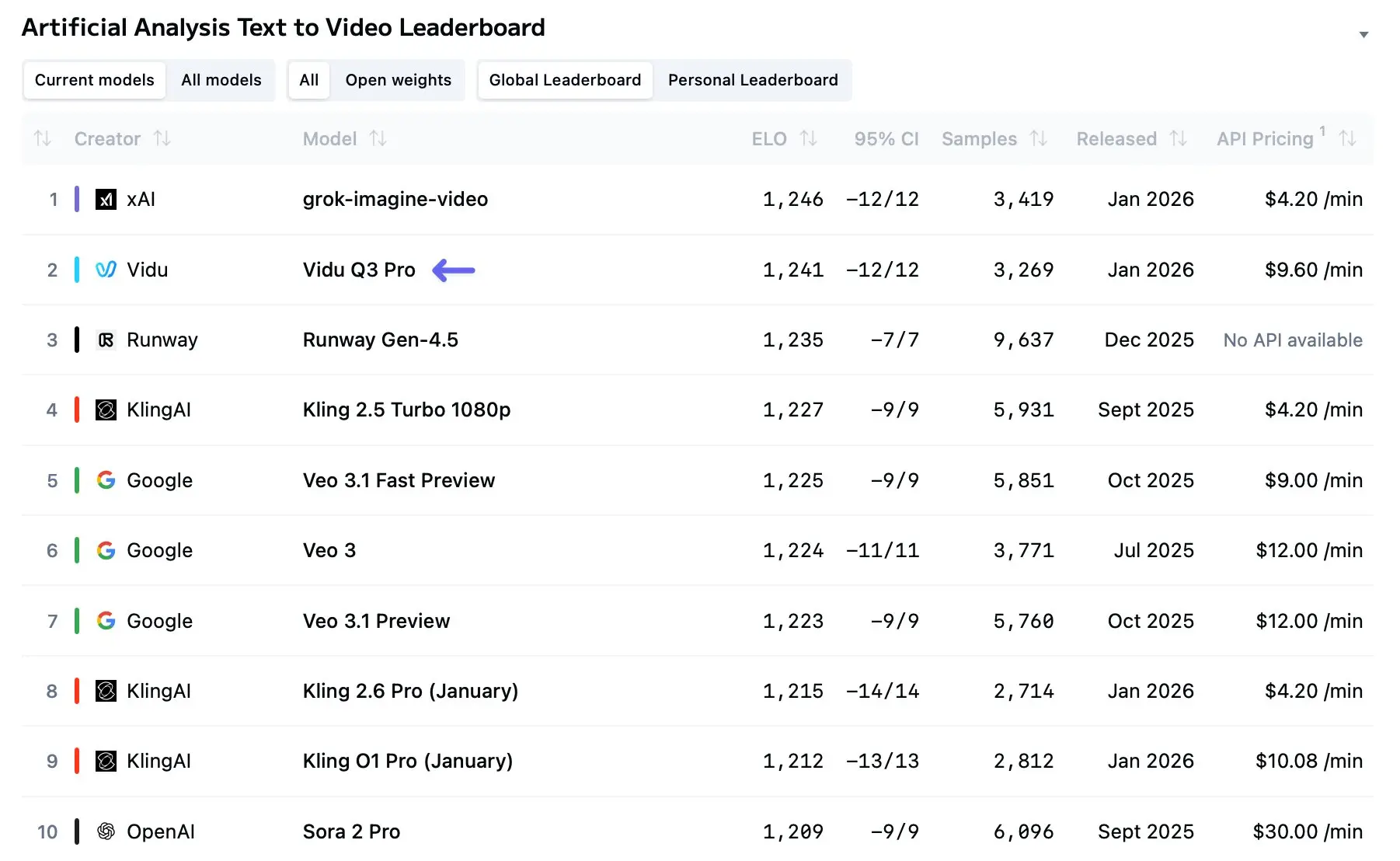

Avaliações independentes e benchmarks iniciais mostram que o Vidu Q3 produz imagens mais nítidas e menos distorções em nível de quadro do que modelos de consumo anteriores. Melhorias na arquitetura e na augmentação de dados parecem reduzir flicker e melhorar a continuidade do movimento em clipes de 10–16 segundos. No entanto, o modelo ainda pode ter dificuldade em cenas densas com múltiplos sujeitos (multidões, interações físicas complicadas), onde oclusão e movimento fino exigem raciocínio físico robusto. Sites de ranking comparativo e leaderboards de modelos já colocaram o Vidu Q3 em posições altas em listas T2V (texto‑para‑vídeo), embora os rankings variem por benchmark e dataset.

3. Geração nativa de áudio + vídeo

Ao contrário de sistemas que produzem visuais silenciosos e deixam o áudio para a pós‑produção, o Vidu Q3 integra a geração de áudio dentro do modelo. O resultado é diálogo com lip‑sync, SFX cronometrados e música de fundo opcional produzidos junto aos quadros. Integrar som no nível do modelo reduz erros de alinhamento (drift de lip sync, cues fora do tempo) e encurta o ciclo de produção para demos, prévias e muitos curtas em formato final.

4. Controle inteligente de câmera e narrativas com múltiplas tomadas

Os recursos de “câmera inteligente” do Q3 interpretam prompts para movimentos de câmera (pan, dolly, tracking) e sequências com múltiplas tomadas. Em vez de produzir um único ponto de vista estático, o modelo pode gerar cortes e transições planejados para que o clipe resultante leia como uma cena dirigida. Para criadores, isso muda a saída de “uma única imagem composta que se move” para “uma cena curta com múltiplas tomadas”. Isso melhora a assistibilidade e permite uma narrativa visual mais rica em uma única geração.

5. Consistência multi‑referência e fidelidade de personagens

O Vidu (como plataforma) investiu em sistemas de “referência para vídeo” e consistência multi‑referência que permitem aos criadores enviar várias imagens de referência para fixar a identidade do personagem ao longo dos quadros. O Q3 expande essas ideias para manter a aparência de personagens e props consistente em múltiplos ângulos de câmera e cortes — um requisito básico, porém essencial, para saídas narrativas coerentes. Isso é especialmente útil para anime ou projetos estilizados, onde manter arte de personagem consistente é crítico.

6. Prontidão para desenvolvedores: APIs e fluxo de trabalho

A suíte de modelos do Vidu — incluindo o Q3 — está disponível por UIs web e uma API REST programática. Desenvolvedores podem enviar jobs de texto‑para‑vídeo ou de imagem+texto para um endpoint de inferência, receber um ID de tarefa e fazer polling pelos resultados (padrão típico de tarefa assíncrona). A API oferece parâmetros como resolução, proporção, duração, amplitude de movimento e um toggle para geração de áudio. Isso torna o Q3 acessível para automação, fluxos em lote e integração com pipelines editoriais.

Como o Vidu Q3 se compara ao Sora 2 e ao Veo 3.1?

Resposta curta: Vidu Q3 compete fortemente em saídas narrativas mais longas e áudio/vídeo integrados para cenas de 10–20 s; Sora 2 se destaca em realismo de tomada única fisicamente plausível e integração social; e Veo 3.1 lidera em polimento em nível de pixel, ferramentas de continuidade multi‑quadro e integração de API empresarial. Abaixo detalhamos as diferenças em eixos práticos.

Qual modelo é mais forte em realismo e física: Sora 2 ou Vidu Q3?

Sora 2 (OpenAI) foi explicitamente treinado para plausibilidade física e simulação de mundo — suas notas públicas destacam comportamento físico avançado, interações precisas de objetos e trajetórias de movimento altamente realistas. Sora 2 também fornece áudio sincronizado e integrações com aplicativos sociais (incluindo participações especiais e um app móvel), tornando‑o excepcionalmente forte para cenas vívidas e fisicamente coerentes. Se o seu briefing exigir colisões precisas, dinâmica realista ou movimento humano fotorrealista em tomadas curtas e autocontidas, Sora 2 costuma ser superior.

Vidu Q3, por sua vez, é posicionado mais como um motor de narrativa: clipes mais longos, sequenciamento de múltiplas tomadas e controle de câmera no estilo de direção. Isso não significa que o Vidu sacrifique o realismo, mas seus principais ganhos são continuidade narrativa e saída audiovisual combinada em vez de simulação física bruta. Para storytelling cinematográfico curto (por exemplo, um demo de produto de 16 s com cortes e VO), o fluxo do Q3 é frequentemente mais rápido e simples.

Qual modelo é melhor para acabamento cinematográfico e alta fidelidade: Veo 3.1 vs Vidu Q3?

Veo 3.1 (Google / DeepMind / Gemini) tem sido divulgado como uma opção de alta fidelidade, nível empresarial, com controles robustos de continuidade, geração nativa de áudio e suporte dentro dos stacks de nuvem/Vertex/Gemini do Google. Veo 3.1 introduziu recursos avançados de “ingredientes para vídeo”, suporte nativo vertical (9:16) e upscaling para altas resoluções (incluindo capacidades 4K em alguns fluxos). Para projetos que exigem a mais alta qualidade de pixel, harmonia de cores precisa e APIs empresariais rigorosas, o Veo 3.1 costuma ser a escolha.

Vidu Q3 se mantém firme ao focar em duração estendida + coerência de história multi‑tomada e uma produtização centrada no criador (playgrounds web rápidos, orquestração multi‑referência). Se sua prioridade é produzir uma cena curta dirigida por humanos com vários movimentos de câmera e cues de áudio integrados (e você valoriza comprimento acima do polimento absoluto de pixel), o Vidu Q3 é convincente. Para fidelidade fotorreal bruta, Veo 3.1 normalmente tem vantagem.

No início de 2026, o triunvirato de vídeo com IA consiste em Sora 2 da OpenAI, Veo 3.1 do Google e Vidu Q3. Veja como eles se comparam diretamente:

| Recurso | Vidu Q3 | Sora 2 | Veo 3.1 |

|---|---|---|---|

| Duração Máxima por Clipe | ~16 s | Até ~25 s (Pro) | 8 s (com recursos de encadeamento narrativo) |

| Geração de Áudio Nativa | Sim (integrado) | Sim (experimental) | Sim (avançado) |

| Controle Cinematográfico de Câmera | Sim (sensível a tomadas) | Predefinições limitadas | Sim (consistência multi‑tomada) |

| Narrativa com Múltiplas Tomadas | Sim | Sim | Sim |

| Renderização de Texto nos Quadros | Sim | Varia | Varia |

| Resolução | 1080p | 1080p | 1080p / 4K em casos especiais |

| Caso de Uso Principal | Narrativa, Animação | Conceito/Filme de alto orçamento | YouTube Shorts / TikTok |

Análise:

- Vs. Sora 2: Sora 2 permanece o peso pesado para fidelidade visual pura e imaginação surreal (“qualidade de Hollywood”). Contudo, o Vidu Q3 o supera em eficiência de fluxo devido ao limite de 16 segundos e à integração superior de áudio. Para criadores que precisam de um clipe “feito em uma passada”, o Q3 é mais rápido.

- Vs. Veo 3.1: O Veo 3.1 do Google se destaca em velocidade para clipes mais curtos, focados em redes sociais (4–8 s), e integra profundamente com o YouTube. O Vidu Q3 mira mais alto na cadeia de valor, visando animadores profissionais e cineastas que precisam de cortes mais longos e contínuos que o Veo tem dificuldade em manter de forma consistente.

Quais aplicações práticas o Vidu Q3 possibilita?

Publicidade e marketing de formato curto

Marcas podem prototipar conceitos de anúncio de ponta a ponta muito mais rápido: escrever um script, gerar um visual de 16 segundos com VO e SFX sincronizados, iterar na redação e na composição de tomadas e produzir dublagens em vários idiomas com prompts em variantes de idioma. Para A/B testing de criativos sociais, a redução do tempo de entrega é um ganho claro de negócio. Estudos de caso divulgados por plataformas mostram marketers usando o Vidu Q3 para micro‑anúncios e teasers de produto.

Storyboard e pré‑visualização para cinema e TV

Diretores e editores estão usando clipes curtos de IA como pré‑visualizações (previz) para bloquear cenas, testar movimentos de câmera e apresentar tratamentos. Os recursos de sequenciamento multi‑tomada e controle inteligente de câmera do Vidu Q3 são particularmente úteis aqui: equipes criativas podem iterar em bloqueio e diálogo sem o custo de filmagens em locação. Embora a previz de IA não substitua a direção no set, ela encurta os ciclos de decisão das fases iniciais.

E‑learning e vídeos explicativos

Departamentos de educação e aprendizagem corporativa podem gerar segmentos explicativos animados concisos com narração sincronizada e SFX anotados. Para conteúdo padronizado (treinamento de produto, onboarding), isso reduz a dependência de produtoras caras e acelera versões localizadas. A velocidade de publicação e as capacidades nativas de áudio tornam o Vidu Q3 atraente para esses usos.

Games, concept art e produção indie

Desenvolvedores independentes e equipes de jogos usam clipes cinematográficos curtos de IA para trailers, mockups de diálogo de NPCs ou exploração de estilo. O suporte do Vidu Q3 a imagens de referência e consistência de personagens ajuda a manter a identidade visual de um IP de jogo coerente em trailers de protótipo. O modelo também é usado em materiais de pitch para garantir financiamento ou interesse de publishers.

Acessibilidade e localização rápida

Como o áudio é gerado de forma nativa, o Vidu Q3 simplifica versões multilíngues: gere a mesma tomada com prompts em diferentes idiomas ou peça timbres de voz variados. Isso permite a rápida localização de conteúdo de marketing ou ativos de treinamento enquanto mantém aproximações de sincronização labial boas o suficiente para muitos contextos de formato curto (embora a sincronização labial de nível de transmissão ainda possa exigir ajuste humano).

O Vidu Q3 é o melhor modelo de vídeo com IA em 2026?

Declarar um único “melhor” modelo perde nuances: o vencedor depende do caso de uso.

- Para saída fotorrealista, fisicamente fundamentada e tratamento de segurança conservador, o Sora 2 da OpenAI é frequentemente visto como a melhor escolha. Ele enfatiza realismo e moderação robusta, tornando‑o atraente para produção de alto nível e empresas avessas a risco.

- Para conteúdo integrado à plataforma e otimizado para formatos de curto prazo, o suporte nativo vertical do Veo 3.1 e as integrações de apps do Google (YouTube Shorts, Google Photos) o tornam singularmente conveniente.

- Para prototipagem rápida de áudio‑vídeo, controle narrativo multi‑tomada e um forte equilíbrio de recursos de storytelling, o Vidu Q3 se destaca — especialmente quando a velocidade de iteração e o áudio integrado importam mais do que o fotorrealismo absoluto. Benchmarks iniciais e relatórios de fornecedores colocam o Vidu Q3 em posições altas nos rankings T2V, e seus recursos o tornam uma escolha prática para marketers, criadores independentes e estúdios que estão prototipando novas ideias.

Limitações e considerações?

Embora o Vidu Q3 marque um avanço, há trade‑offs:

- A duração do clipe ainda é limitada (~16 s), então narrativas mais longas exigem costura ou múltiplos prompts.

- O custo de recursos pode escalar com geração em HD e áudio complexo.

- Ferramentas de IA ainda exigem julgamento editorial para refinar e editar saídas em produtos finalizados.

Portanto: o Vidu Q3 é um concorrente de alto nível em 2026, particularmente para criadores que priorizam fluxos nativos de áudio e storytelling multi‑tomada. Se ele é o melhor depende do briefing de produção, das restrições regulatórias e do pipeline de distribuição do usuário.

Conclusão

Vidu Q3 se destaca em 2026 como um modelo de vídeo líder capaz de produzir clipes de áudio‑vídeo prontos para narrativa que unem criatividade e demandas de produção. Em comparação com a forte coesão narrativa do Sora 2 e o realismo cinematográfico do Veo 3.1, o Vidu Q3 oferece um conjunto equilibrado de ferramentas ideal para contadores de histórias, criadores de conteúdo e fluxos de trabalho comerciais.

À medida que benchmarks mostram seu alto desempenho e recursos integrados, o Vidu Q3 representa um ponto de virada na IA generativa de vídeo — tornando a produção audiovisual complexa mais acessível e eficiente.

Desenvolvedores podem acessar Vidu Q3, Veo 3.1 e Sora 2 via CometAPI, os modelos mais recentes listados são os da data de publicação do artigo. Para começar, explore as capacidades do modelo no Playground e consulte o guia da API para instruções detalhadas. Antes de acessar, certifique‑se de ter feito login no CometAPI e obtido a chave de API. CometAPI oferece um preço muito inferior ao oficial para ajudar na integração.

Pronto para começar?→ Inscreva‑se para geração de vídeo hoje !

Se quiser mais dicas, guias e notícias sobre IA, siga‑nos no VK, X e Discord!