DeepSeek официально представила превью линейки V4 с открытым исходным кодом, и это не просто очередное обновление модели. Компания позиционирует V4 как систему с длинным контекстом, ориентированную на агентов и реальные нагрузки: анализ документов, помощники по программированию, поисковые агенты и многошаговая автоматизация. Релиз доступен в вебе, приложении и через API, а линейка V4 вводит экономичное контекстное окно на 1M токенов во всех официальных сервисах.

Особенно примечательна в этом запуске комбинация масштаба и эффективности. DeepSeek говорит, что V4-Pro имеет 1.6T общих параметров при 49B активных, а V4-Flash — 284B общих параметров при 13B активных. В техническом отчёте DeepSeek также утверждает, что архитектура V4 использует гибридное внимание, маршрутизацию MoE и постобучение, призванные улучшить агентное поведение и одновременно снизить вычислительную нагрузку сверхдлинного контекста.

What is DeepSeek V4?

DeepSeek-V4 — это последняя флагманская предпросмотровая линейка компании, и релиз включает две публичные версии: V4-Pro и V4-Flash. DeepSeek описывает V4-Pro как более сильную модель для знаний о мире, математики, STEM, программирования и агентного программирования, в то время как V4-Flash — более отзывчивый и экономичный вариант, который сохраняет значительную часть качества рассуждений и способность к длинному контексту. V4-Pro лидирует среди текущих открытых моделей в агентном программировании и знаниях о мире, тогда как V4-Flash создавался для скорости и экономичного развёртывания.

V4 использует гибридную архитектуру внимания, совмещающую Compressed Sparse Attention (CSA) и Heavily Compressed Attention (HCA), а также Manifold-Constrained Hyper-Connections и оптимизатор Muon. Компания также сообщает, что модели были предобучены на более чем 32T токенов и что, при контексте 1M, V4-Pro требуется лишь 27% FLOPs инференса на токен и 10% KV-кэша по сравнению с DeepSeek-V3.2. Именно эта эффективность — главный заголовок релиза.

DeepSeek-V4-Pro vs DeepSeek-V4-Flash

DeepSeek-V4-Pro

V4-Pro — флагманская модель для пользователей, для которых важнее всего качество. DeepSeek-V4-Pro обеспечивает более сильную агентную производительность в кодинге, более глубокие знания о мире и мирового уровня рассуждения, и по заявлению на странице запуска она лидирует среди текущих открытых моделей, уступая лишь Gemini-3.1-Pro в знаниях о мире. В техническом отчёте V4-Pro определяется как более крупная модель в линейке, а DeepSeek-V4-Pro доступна через те же OpenAI-совместимые и Anthropic-совместимые интерфейсы, что и V4-Flash.

DeepSeek-V4-Flash

V4-Flash — модель с приоритетом эффективности; её способности к рассуждениям близки к V4-Pro, и на простых агентных задачах она показывает сопоставимые результаты, при этом используя меньший параметрический бюджет и обеспечивая более быстрые ответы. Она поддерживает режимы с рассуждением и без, имеет ту же длину контекста 1M и те же базовые возможности, что и Pro, но по значительно более низкой цене.

Which one should you choose?

Используйте V4-Pro, когда задача высокорисковая, требующая значительных знаний или сложная для верификации: корпоративные исследования, сложное программирование, многошаговая поддержка принятия решений или задачи, где вам нужен максимально сильный ответ. Используйте V4-Flash, когда важнее пропускная способность, задержка или стоимость токенов, чем «выжимание» последних пунктов в бенчмарках. Этот выбор соответствует официальному позиционированию и отражает заявленные разрывы на бенчмарках между двумя моделями.

| Item | DeepSeek-V4-Flash | DeepSeek-V4-Pro |

|---|---|---|

| Total parameters | 284B | 1.6T |

| Active parameters | 13B | 49B |

| Context length | 1M | 1M |

| Reasoning modes | Без рассуждения + с рассуждением | Без рассуждения + с рассуждением |

| Best fit | Быстрый инференс, высоконагруженные приложения, бюджетные агенты | Максимальные возможности рассуждений, сложные задачи кода и знаний |

| Official API pricing | Cache hit $0.028 / cache miss $0.14 / output $0.28 per 1M tokens | Cache hit $0.145 / cache miss $1.74 / output $3.48 per 1M tokens |

| Max output | 384K | 384K |

CometAPI предоставляет доступ к Deepseek v4 Pro и V4 Flash — на 20% дешевле официальных — плюс бесшовное переключение между 500+ моделями (GPT-5.4, Gemini 3.1 и др.) через единый OpenAI-совместимый или Anthropic Messages endpoint.

Performance benchmark

DeepSeek-V3.2 vs V4-Flash vs V4-Pro

В сравнительной таблице базовых моделей V4-Flash и V4-Pro превосходят DeepSeek-V3.2 по ключевым бенчмаркам, при этом V4-Pro обычно лидирует. Например, в отчёте указаны следующие результаты: AGIEval 82.6 / 83.1 против 80.1 у V3.2; MMLU 88.7 / 90.1 против 87.8; MMLU-Pro 68.3 / 73.5 против 65.5; HumanEval 69.5 / 76.8 против 62.8; и LongBench-V2 44.7 / 51.5 против 40.2 у V3.2, где среднее число — V4-Flash, а последнее — V4-Pro.

| Benchmark | DeepSeek-V3.2-Base | DeepSeek-V4-Flash-Base | DeepSeek-V4-Pro-Base |

|---|---|---|---|

| AGIEval (EM) | 80.1 | 82.6 | 83.1 |

| MMLU (EM) | 87.8 | 88.7 | 90.1 |

| MMLU-Pro (EM) | 65.5 | 68.3 | 73.5 |

| HumanEval (Pass@1) | 62.8 | 69.5 | 76.8 |

| LongBench-V2 (EM) | 40.2 | 44.7 | 51.5 |

Источник: технический отчёт DeepSeek-V4, Таблица 1.

Паттерн очевиден: Flash сокращает отставание от Pro, но Pro всё ещё более сильная универсальная модель. Это делает V4-Flash практичным выбором по умолчанию для многих продакшен-систем, в то время как V4-Pro — модель, к которой стоит обращаться, когда качество ответа важнее стоимости или задержки.

Western model comparisons: where V4 fits

В одной из человеческих оценок на китайских «офисных» задачах отчёт утверждает, что DeepSeek-V4-Pro-Max превзошла Claude Opus 4.6-Max с уровнем непроигрыша 63%. DeepSeek-V4-Pro «значительно превосходит» Claude Sonnet 4.5 и приближается к Claude Opus 4.5 на бенчмарке программирования для НИОКР.

| Evaluation area | DeepSeek result | Western model comparison | What it suggests |

|---|---|---|---|

| Chinese white-collar tasks | V4-Pro-Max, 63% non-loss rate | vs Claude Opus 4.6-Max | Сильный результат в практических задачах бизнес-стиля |

| R&D coding benchmark | V4-Pro-Max pass rate 67 | vs Claude Sonnet 4.5 at 47; Opus 4.5 at 70; Opus 4.6 Thinking at 80 | Конкурентоспособность с ведущими передовыми моделями, особенно на уровне Sonnet |

Это не «номер один во всём», но уже уровень, который «нужно серьёзно оценивать».

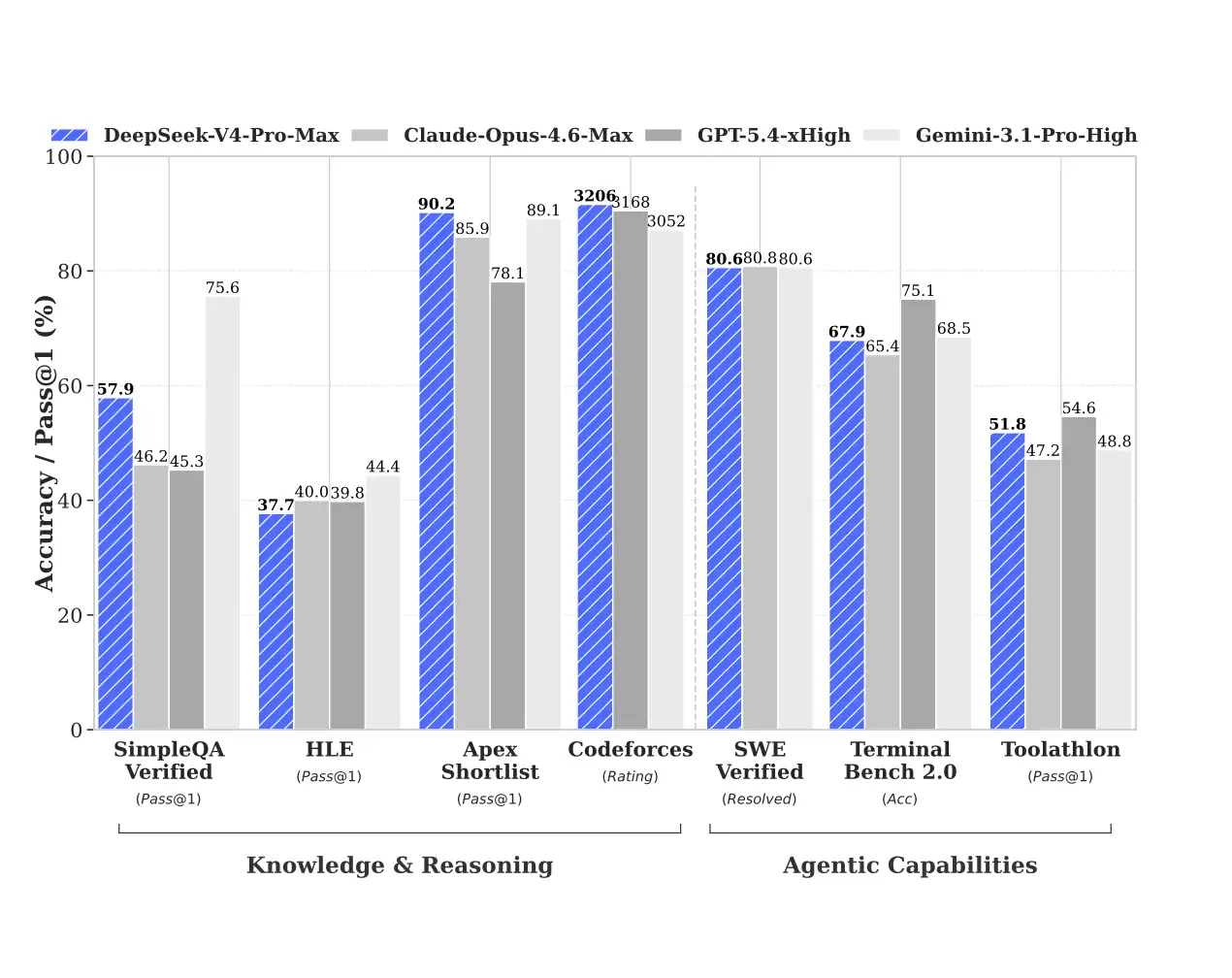

Технический отчёт DeepSeek сравнивает V4-Pro-Max с Claude Opus 4.6 Max, GPT-5.4 xHigh и Gemini 3.1 Pro High в одной таблице. Результаты не сводятся к простым выводам: западные закрытые модели по-прежнему сильны в ряде аспектов знаний и вывода; однако V4-Pro-Max очень сильна в коде, длинных контекстах и некоторых агентных задачах. Иными словами, это уже не «низкоразмерный» нарратив «отечественные альтернативы», а этап «что больше подходит для вашего сценария».

С точки зрения знаний и способности к рассуждениям она сопоставима с Opus 4.6 Max, GPT-5.4 xHigh и Gemini 3.1 ProHigh. Однако по агентным возможностям немного отстаёт, хотя разница несущественна.

DeepSeek-V4-Pro-Max крайне конкурентоспособна в задачах, ориентированных на код и длинный контекст, тогда как западные модели по-прежнему выглядят очень сильными в ряде чистых бенчмарков на рассуждение и знания. Так и нужно читать релиз: DeepSeek V4 прочно вошла в число передовых систем, но лидерство в бенчмарках зависит от конкретной задачи.

How to access DeepSeek V4

1) Use the official web and app

DeepSeek сообщает, что V4 Preview доступна уже сейчас в вебе, приложении и через API. Для обычных пользователей самый простой путь — официальный интерфейс чата, где модель доступна через Expert Mode или Instant Mode.

2) Use the API

Я настоятельно рекомендую CometAPI для доступа к deepseek V4, потому что он предлагает лучшую цену и преимущества агрегирования.

Названия моделей:

deepseek-v4-flashdeepseek-v4-pro

DeepSeek также сообщает, что устаревшие названия

deepseek-chatиdeepseek-reasonerбудут выведены из обращения и в данный момент сопоставляются с режимами без рассуждений и с рассуждениями V4-Flash до 2026-07-24. Это важно для планирования миграции, если у вас уже есть старые интеграции в продакшене.

- Зарегистрируйтесь на CometAPI и получите ключ API.

- Используйте стандартный OpenAI Python SDK (или любой совместимый клиент) с пользовательским базовым URL:

Ниже — простой пример с использованием официального OpenAI-совместимого формата:

import os

from openai import OpenAIclient = OpenAI(

api_key=os.environ["cometapi_API_KEY"],

base_url="https://api.cometapi.com"

)response = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Summarize the benefits of million-token context."}

],

extra_body={"thinking": {"type": "enabled"}},

reasoning_effort="high"

)print(response.choices[0].message.content)

Этот шаблон запроса следует руководству быстрого старта: задайте base URL, выберите deepseek-v4-pro или deepseek-v4-flash и включайте «thinking», когда требуется более глубокое рассуждение.

How to use DeepSeek V4 effectively

Для рабочих процессов с длинными документами самый сильный паттерн — держать контекст чистым и структурированным. Контекстное окно V4 на 1M токенов — большой плюс, но модель всё равно показывает лучшие результаты, когда вход организован по разделам: выдержки из источников, инструкции по задаче и явные ограничения на выход. Это самый естественный способ использовать заявленную способность к длинному контексту.

Для рабочих процессов с кодом и агентами начните с V4-Flash для быстрой итерации, затем переходите к V4-Pro для финального прогона или самых сложных шагов. Такой подход соответствует официальному позиционированию: Flash — эффективный вариант, Pro — более сильная модель, и у обеих одинаковый API и длина контекста.

Final word

DeepSeek-V4 примечательна тем, что одновременно сочетает четыре вещи, которых давно просил рынок: длинный контекст, сильные рассуждения, открытую доступность и агрессивное ценообразование. Суть не в том, что DeepSeek выпустила ещё одну модель, а в том, что компания пытается сделать передовой ИИ экономически применимым в продакшене. Для команд, решающих, куда сделать следующую ставку на ИИ, это сигнал, который стоит тестировать, а не игнорировать.

Для команд, работающих сразу с несколькими провайдерами, это как раз тот релиз, который стоит прогнать в собственном стеке. CometAPI может быть практичным слоем, чтобы сравнить DeepSeek-V4 с другими передовыми моделями, не заставляя продуктовую команду перестраивать интеграцию каждый раз, когда рынок меняется.