Google DeepMind официально представила Gemma 4 2 апреля 2026 года, что стало важной вехой в области ИИ с открытым исходным кодом. Это семейство моделей обеспечивает передовой уровень «интеллекта на параметр», создано на основе тех же исследований и технологий, что лежат в основе Gemini 3. В отличие от ранних версий Gemma с пользовательскими лицензиями, Gemma 4 поставляется под полностью разрешительной лицензией Apache 2.0, позволяющей неограниченное коммерческое использование, модификацию и распространение.

Gemma 4 выделяется мультимодальными возможностями (текст + изображение во всех размерах, плюс аудио в edge-моделях), встроенной поддержкой продвинутого рассуждения и агентных рабочих процессов, длинными окнами контекста до 256K токенов и оптимизацией для всего — от смартфонов и Raspberry Pi до высокопроизводительных GPU. Она поддерживает более 140 языков и делает акцент на эффективности, делая мощный ИИ доступным на потребительском и периферийном железе без зависимости от облака.

CometAPI предоставляет отличные API для моделей с открытым и закрытым исходным кодом.

Что такое Gemma 4?

Gemma 4 — это последнее семейство открытых мультимодальных больших языковых моделей (LLM) от Google DeepMind, созданное специально для продвинутого рассуждения, агентных AI-процессов и эффективного развертывания на устройстве. Оно максимизирует «интеллект на параметр», используя наработки из проприетарных исследований Gemini 3, при этом оставаясь полностью открытым по весам и исходникам.

Ключевые усовершенствования по сравнению с предыдущими моделями Gemma:

- Нативная мультимодальность: понимание текста и изображений (во всех моделях), поддержка аудио в малых edge-вариантах.

- Настраиваемый режим размышления: пошаговое рассуждение с структурированным выводом <|think|>.

- Нативный вызов функций и использование инструментов: идеально для автономных агентов.

- Расширенный контекст: до 256K токенов в больших моделях.

- Гибридная архитектура внимания: сочетает локальное скользящее окно и глобальное внимание для эффективности и работы с длинным контекстом.

- Per-Layer Embeddings (PLE) в меньших моделях и общий KV-кэш для экономии памяти.

- Широкая мультиязычная поддержка: предобучение на данных по 140+ языкам с учетом культурных нюансов.

Выпущенная под Apache 2.0, Gemma 4 снимает прежние лицензионные ограничения, мешавшие корпоративному принятию. Разработчики теперь могут свободно дообучать, развертывать и коммерциализировать — позиционируя её как прямого конкурента полностью открытым экосистемам вроде Llama и Qwen.

Gemma 4 нацелена на разнообразное оборудование: периферийные устройства (телефоны, IoT, Raspberry Pi, Jetson Nano) для низкой задержки офлайн-ИИ и рабочие станции/GPU для высокопроизводительных локальных серверов. Такой «local-first» подход ставит во главу угла приватность, экономию средств и нулевую задержку вывода.

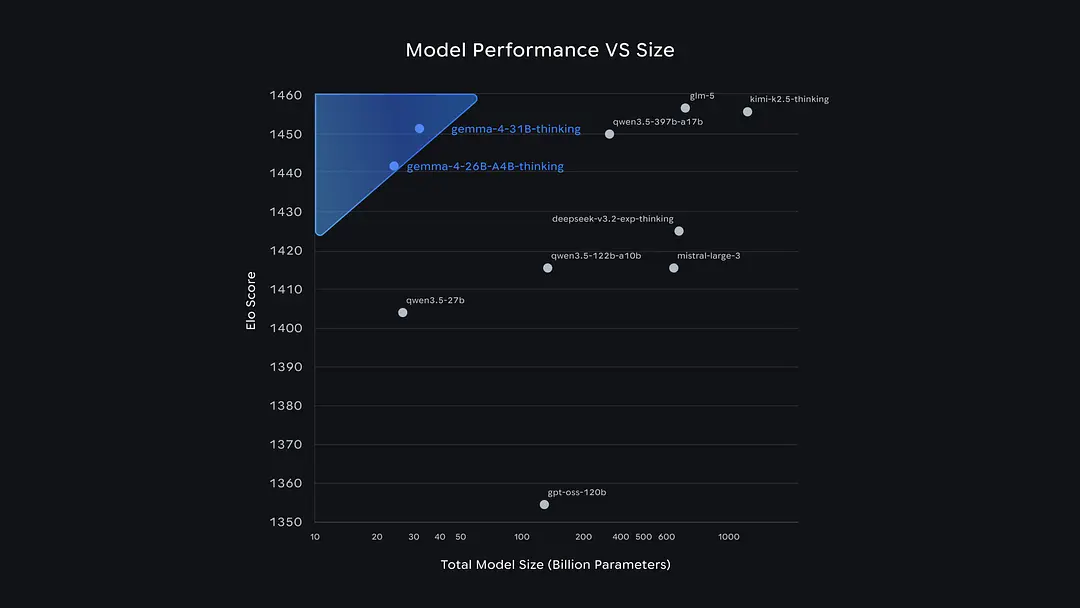

Открытые модели, опережающие её в рейтинге Arena, в основном от китайских команд. Gemma 4 мало отличается от Qwen 3.5 и GLM-5, но существенно отличается от GPT-OSS-120B от OpenAI.

Разработчики уже могут найти GLM-5, Qwen 3.5 и другие на CometAPI.

Четыре версии Gemma 4

Google выпустила Gemma 4 в четырех тщательно оптимизированных размерах, каждый из которых балансирует производительность, эффективность и сценарии развертывания. Две используют плотные архитектуры с инновационными Per-Layer Embeddings (PLE) для эффективности на периферии; одна — это Mixture-of-Experts (MoE) для высокой производительности при низком количестве активных параметров; и одна — плотный флагман.

| Model | Architecture | Total Params | Active Params (MoE) | Effective Params | Context Length | Modalities | Target Hardware |

|---|---|---|---|---|---|---|---|

| Gemma 4 E2B | Плотная + PLE | ~5.1B (вкл. эмбеддинги) | Н/Д | 2.3B | 128K | текст, изображение, аудио | Смартфоны, Raspberry Pi, периферийные IoT |

| Gemma 4 E4B | Плотная + PLE | ~8B (вкл. эмбеддинги) | Н/Д | 4.5B | 128K | текст, изображение, аудио | Мобильные устройства, легкие GPU, Jetson |

| Gemma 4 26B A4B | MoE (8 active / 128 total + 1 shared) | 25.2B | 3.8B–4B | Н/Д | 256K | текст, изображение | Рабочие станции, потребительские GPU, локальные серверы |

| Gemma 4 31B | Плотная | 30.7B | Н/Д | Н/Д | 256K | текст, изображение | Топовые GPU (помещается на одном H100/A100 в FP16) |

Gemma 4 E2B и E4B (оптимизированы для периферии): используют PLE для послойной специализации с минимальными накладными параметрами. Идеальны для устройств с батарейным питанием или ограниченной памятью. Аудио-энкодер (Conformer в стиле USM, ~300M параметров) обеспечивает распознавание речи и перевод речи в текст.

Gemma 4 26B A4B (MoE): активирует всего ~4B параметров во время инференса при общем размере 25B+. Обеспечивает производительность, близкую к 31B, при существенно меньшей вычислительной стоимости — идеально для экономичного масштабирования.

Gemma 4 31B (плотная): флагман для максимальных возможностей. Размещается на одном 80GB GPU в полном прецизионном режиме и входит в число лучших открытых моделей в рейтингах.

Все модели включают варианты, дообученные на инструкциях (“-it”), оптимизированные для чата, рассуждения и использования инструментов, а также предобученные базовые версии для последующего дообучения. Две большие модели идут разными путями: плотная 31B стремится к наивысшему качеству и служит лучшей основой для дообучения; 26B MoE делает ставку на скорость, активируя лишь 3.8 миллиарда параметров на инференсе, что приводит к гораздо более быстрой генерации слов при слегка более низком общем качестве.

Две меньшие модели, E2B и E4B, специально разработаны для мобильных телефонов и IoT-устройств: они могут работать полностью офлайн, экономя память и энергию. Более того, эти меньшие модели обладают возможностью, которой нет у больших: нативный аудио-вход, позволяющий напрямую распознавать речь.

Ключевые возможности Gemma 4

Gemma 4 превосходит в областях, наиболее важных для практических AI-приложений:

1. Продвинутое рассуждение и режим размышления

Настраиваемое пошаговое рассуждение через системные подсказки или enable_thinking=True. Выводит структурированные теги <|think|> с последующими финальными ответами. Существенно улучшает результаты на сложных задачах без дополнительного дообучения.

2. Мультимодальное понимание

- Зрение: обнаружение объектов (границы в JSON), OCR (многоязычный), парсинг документов/PDF, понимание графиков, понимание UI, распознавание рукописного текста и обработка изображений с переменным разрешением (бюджеты токенов: 70–1120 токенов).

- Видео: до 60 секунд (обработка кадров 1 fps).

- Аудио (только E2B/E4B): автоматическое распознавание речи (ASR) и перевод речи в текст (макс. 30 с).

- Перемежаемый ввод: смешивайте текст, изображения и аудио в любом порядке.

3. Агентные рабочие процессы и вызов функций

Нативная поддержка инструментов позволяет автономным агентам выполнять многошаговое планирование, API-вызовы, навигацию по приложениям и завершение задач. Сильные результаты на τ2-bench (agentic tool use).

4. Программирование и инструменты для разработчиков

Отличная генерация кода, автодополнение, отладка и понимание на уровне репозитория. Поддерживает JSON-структурированные ответы для бесшовной интеграции. Набирает 80.0% (31B) на LiveCodeBench v6, позиционируя себя как ориентированный на локальную работу помощник по программированию, пригодный для офлайн-разработки.

5. Длинный контекст и мультиязычность

Надежно обрабатывает 128K–256K токенов (протестировано на MRCR needle-in-haystack). Предобучена на разнообразных данных до января 2025 года, демонстрируя высокую межъязыковую эффективность. Это не просто перевод: модель нативно обучалась и охватывает более 140 языков.

Данные бенчмарков: разбор производительности Gemma 4

Gemma 4 задает новые стандарты для открытых моделей. Варианты 31B и 26B показывают результаты, ранее характерные для гораздо более крупных проприетарных систем, тогда как edge-модели превосходят более крупную предшественницу Gemma 3.

Полные результаты бенчмарков (модели, дообученные на инструкциях)

| Benchmark | Category | Gemma 4 31B | Gemma 4 26B A4B | Gemma 4 E4B | Gemma 4 E2B | Gemma 3 27B (no think) |

|---|---|---|---|---|---|---|

| MMLU Pro | Рассуждение и знания | 85.2% | 82.6% | 69.4% | 60.0% | 67.6% |

| AIME 2026 (no tools) | Математика | 89.2% | 88.3% | 42.5% | 37.5% | 20.8% |

| GPQA Diamond | Научные задачи уровня магистратуры | 84.3% | 82.3% | 58.6% | 43.4% | 42.4% |

| Tau2 (avg) | Агентное использование инструментов | 76.9% | 68.2% | 42.2% | 24.5% | 16.2% |

| LiveCodeBench v6 | Программирование | 80.0% | 77.1% | 52.0% | 44.0% | 29.1% |

| Codeforces ELO | Соревновательное программирование | 2150 | 1718 | 940 | 633 | 110 |

| MMMU Pro | Мультимодальные рассуждения | 76.9% | 73.8% | 52.6% | 44.2% | 49.7% |

| MATH-Vision | Математика + компьютерное зрение | 85.6% | 82.4% | 59.5% | 52.4% | 46.0% |

| MRCR v2 (8-needle, 128K) | Длинный контекст | 66.4% | 44.1% | 25.4% | 19.1% | 13.5% |

Ключевые выводы:

- Огромный скачок относительно Gemma 3: модель 31B улучшила AIME по математике с 20.8% до 89.2% и LiveCodeBench с 29.1% до 80.0%.

- Эффективность MoE: 26B A4B почти догоняет 31B, используя существенно меньше вычислений на инференсе.

- Доминирование на периферии: E4B и E2B превосходят Gemma 3 27B по многим метрикам, будучи меньше в 6–10 раз.

- Рейтинги: 31B набирает ~1452 в Arena AI (text); 26B A4B ~1441. По сообщениям, вариант 26B превосходит гораздо более крупные модели, такие как Qwen 3.5 397B, с точки зрения пользовательских предпочтений и кодирования.

Бенчмарки по зрению и аудио подтверждают сильную мультимодальную производительность «из коробки» без специализированного дообучения.

Экосистема и поддержка инструментов

Gemma 4 получила широкую поддержку экосистемы с первого дня:

- Hugging Face: поддержка в первый день с

transformers,pipeline("any-to-any"), GGUF, ONNX и мультимодальными процессорами. - Локальные рантаймы: Ollama, Llama.cpp (LM Studio, Jan), MLX (Apple Silicon с TurboQuant), Mistral.rs (Rust), Transformers.js (инференс в браузере на WebGPU).

- Дообучение: TRL, Unsloth, PEFT, Vertex AI и полная поддержка мультимодальных датасетов.

- Оптимизация под железо: NVIDIA RTX/DGX Spark/Jetson (через TensorRT-LLM), инструменты Google AI Edge и развертывание на устройстве для Android/iOS.

- Агентные фреймворки: OpenClaw, Hermes, Pi и тестирование в симуляции CARLA.

- Облако/студия: Google AI Studio для быстрого тестирования; Kaggle Models для загрузки.

Эта экосистема позволяет развернуть Gemma 4 за считанные минуты на ноутбуках, серверах или периферийных устройствах.

Ограничения и безопасность:

- Отсечка тренировочных данных: январь 2025 (без актуальных знаний в реальном времени без инструментов).

- Аудио ограничено речью (не музыка); видео ограничено 60 секундами.

- Риск галлюцинаций сохраняется — используйте режим размышления и проверку.

- Безопасность: строгая фильтрация и оценки в соответствии с Google AI Principles; разработчикам следует добавлять защиты, специфичные для их приложения.

Почему Gemma 4 важна в 2026 году

Gemma 4 демократизирует передовой ИИ. Сочетая мультимодальный интеллект, агентные возможности и свободу Apache 2.0 с аппаратно-агностичной эффективностью, она дает разработчикам и предприятиям возможность создавать безопасные, приватные и экономичные AI-решения в масштабе. Прорыв в «интеллекте на параметр» — особенно заметный в edge-моделях, которые превосходят вчерашние флагманские открытые модели — сигнализирует о переходе к по-настоящему повсеместному ИИ.

Запуская 2B-модель на телефоне или локально используя мощную 31B, Gemma 4 доказывает, что открытый ИИ догнал (а во многих случаях и превзошел) закрытые альтернативы по практической полезности.