В 2025–2026 годах ландшафт инструментов ИИ продолжил консолидироваться: шлюзовые API (например, CometAPI) расширились и предоставляют доступ к сотням моделей в формате, совместимом со стилем OpenAI, а пользовательские приложения на базе LLM (например, AnythingLLM) улучшили своего провайдера «Generic OpenAI», позволяя настольным и локальным приложениям вызывать любой OpenAI-совместимый эндпоинт. Это делает простым маршрутизацию трафика AnythingLLM через CometAPI и получение преимуществ в виде выбора моделей, маршрутизации по стоимости и единого биллинга — при сохранении локального интерфейса и функций RAG/агентов в AnythingLLM.

Что такое AnythingLLM и зачем подключать его к CometAPI?

Что такое AnythingLLM?

AnythingLLM — это открытое, комплексное приложение ИИ и локальный/облачный клиент для создания чат-ассистентов, рабочих процессов retrieval-augmented generation (RAG) и агентов на базе LLM. Он предоставляет удобный интерфейс, API для разработчиков, возможности рабочих пространств/агентов и поддержку локальных и облачных LLM — по умолчанию ориентирован на приватность и расширяем через плагины. AnythingLLM предоставляет провайдера Generic OpenAI, который позволяет ему взаимодействовать с совместимыми с OpenAI API LLM.

Что такое CometAPI?

CometAPI — коммерческая платформа-агрегатор API, предоставляющая доступ к 500+ моделям ИИ через единый REST-интерфейс в стиле OpenAI и единый биллинг. На практике это позволяет вызывать модели от разных вендоров (OpenAI, Anthropic, Google/варианты Gemini, модели для изображений/аудио и т. д.) через те же эндпоинты https://api.cometapi.com/v1 и с одним ключом API (формат sk-xxxxx). CometAPI поддерживает стандартные эндпоинты в стиле OpenAI, такие как /v1/chat/completions, /v1/embeddings и т. п., что упрощает адаптацию инструментов, уже поддерживающих OpenAI-совместимые API.

Зачем интегрировать AnythingLLM с CometAPI?

Три практические причины:

- Выбор моделей и гибкость вендоров: AnythingLLM может использовать «любой OpenAI-совместимый» LLM через свой обертчик Generic OpenAI. Указав CometAPI в качестве базы, вы сразу получаете доступ к сотням моделей без изменения интерфейса и процессов в AnythingLLM.

- Оптимизация стоимости и операций: Использование CometAPI позволяет централизованно переключать модели (или переходить на более дешевые) для контроля затрат и вести единый биллинг вместо управления несколькими ключами провайдеров.

- Быстрые эксперименты: Вы можете проводить A/B-тесты разных моделей (например,

gpt-4o,gpt-4.5, варианты Claude или открытые мультимодальные модели) через тот же интерфейс AnythingLLM — полезно для агентов, RAG-ответов, суммаризации и мультимодальных задач.

Какие условия и окружение нужно подготовить перед интеграцией

Системные и программные требования (в целом)

- ПК или сервер с AnythingLLM (Windows, macOS, Linux) — десктопная установка или саморазвёртывание. Убедитесь, что у вас актуальная сборка с доступом к настройкам LLM Preferences / AI Providers.

- Аккаунт CometAPI и ключ API (секрет вида

sk-xxxxx). Вы будете использовать этот секрет в Generic OpenAI-провайдере AnythingLLM. - Сетевое соединение с вашего устройства к

https://api.cometapi.com(без блокировок исходящего HTTPS файрволом). - Необязательно, но рекомендуется: современная среда Python или Node для тестов (Python 3.10+ или Node 18+), curl и HTTP-клиент (Postman / HTTPie) для проверки CometAPI перед подключением к AnythingLLM.

Особенности AnythingLLM

Провайдер Generic OpenAI — рекомендуемый путь для эндпоинтов, имитирующих поверхность API OpenAI. В документации AnythingLLM отмечено, что этот провайдер ориентирован на разработчиков и вам нужно понимать, какие входные данные вы передаете. Если вы используете стриминг или ваш эндпоинт не поддерживает стриминг, в AnythingLLM есть настройка отключения стриминга для Generic OpenAI.

Чек-лист безопасности и эксплуатации

- Относитесь к ключу CometAPI как к любому секрету — не коммитьте его в репозитории; по возможности храните в системных хранилищах ключей или переменных окружения.

- Если планируете использовать чувствительные документы в RAG, убедитесь, что гарантии приватности эндпоинтов соответствуют вашим требованиям по комплаенсу (см. документацию/условия CometAPI).

- Определите лимиты максимального числа токенов и окна контекста, чтобы избежать неконтролируемых расходов.

Как настроить AnythingLLM для использования CometAPI (пошагово)?

Ниже — конкретная последовательность шагов, а затем примеры переменных окружения и код для тестирования соединения перед сохранением настроек в интерфейсе AnythingLLM.

Шаг 1 — Получите ключ CometAPI

- Зарегистрируйтесь или войдите в CometAPI.

- Перейдите в «API Keys» и сгенерируйте ключ — вы получите строку вида

sk-xxxxx. Храните её в секрете.

Шаг 2 — Проверьте CometAPI быстрым запросом

Используйте curl или Python, чтобы вызвать простой эндпоинт chat completion и подтвердить доступность.

Пример с curl

curl -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer sk-xxxxx" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-4o",

"messages": ,

"max_tokens": 50

}'

Если вы получаете 200 и JSON-ответ с массивом choices, ваш ключ и сеть работают. (Документация CometAPI демонстрирует поверхность и эндпоинты в стиле OpenAI).

Пример на Python (requests)

import requests

url = "https://api.cometapi.com/v1/chat/completions"

headers = {"Authorization": "Bearer sk-xxxxx", "Content-Type": "application/json"}

payload = {

"model": "gpt-4o",

"messages": ,

"max_tokens": 64

}

r = requests.post(url, json=payload, headers=headers, timeout=15)

print(r.status_code, r.json())

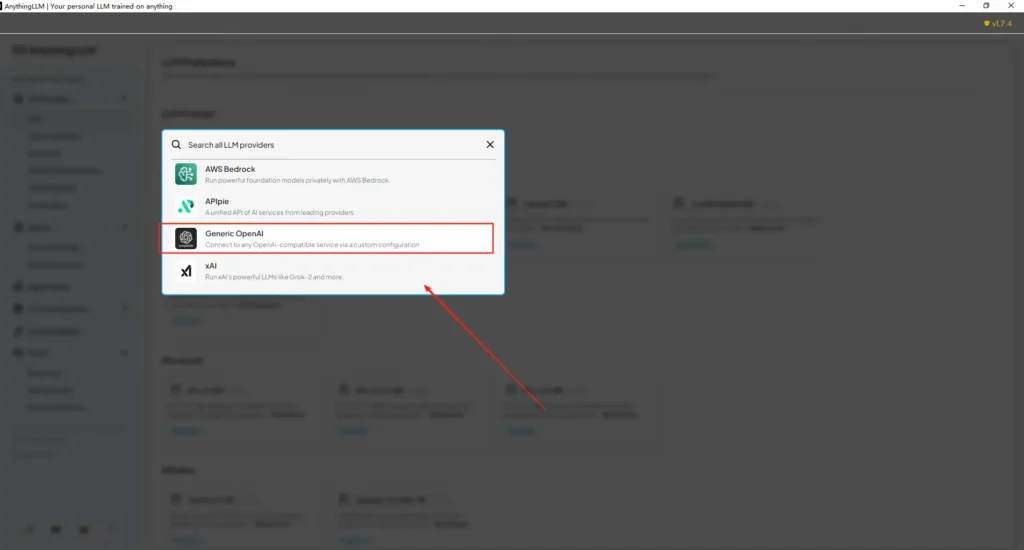

Шаг 3 — Настройте AnythingLLM (UI)

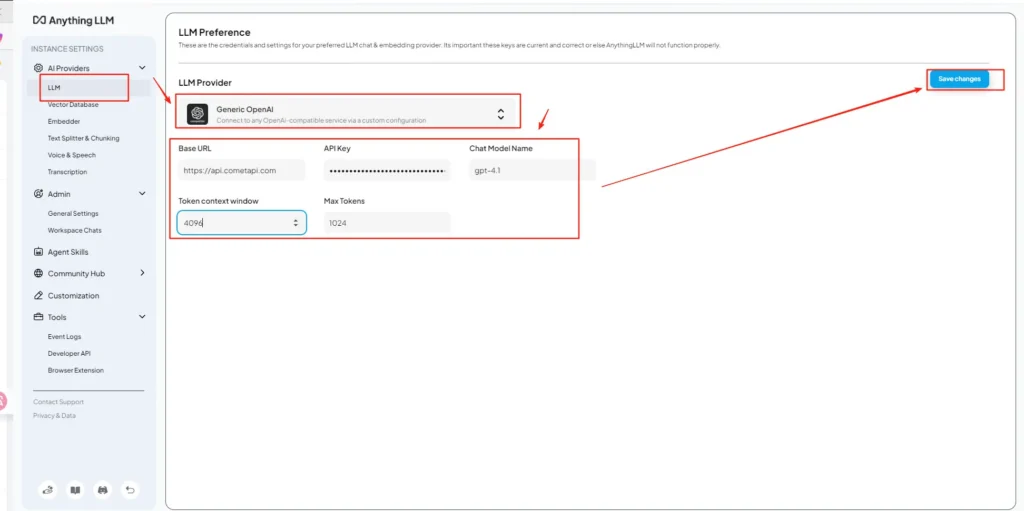

Откройте AnythingLLM → Settings → AI Providers → LLM Preferences (или аналогичный путь в вашей версии). Используйте провайдера Generic OpenAI и заполните поля так:

API Configuration (example)

• Перейдите в меню настроек AnythingLLM, найдите LLM Preferences в разделе AI Providers.

• Выберите Generic OpenAI как поставщика модели, введитеhttps://api.cometapi.com/v1в поле URL.

• Вставьтеsk-xxxxxиз CometAPI в поле ключа API. Заполните Token context window и Max Tokens в соответствии с выбранной моделью. Также можно настроить названия моделей на этой странице, например добавить модельgpt-4o.

Это соответствует руководству AnythingLLM по «Generic OpenAI» (обертка для разработчиков) и подходу CometAPI с базовым URL, совместимым со стилем OpenAI.

Шаг 4 — Установите названия моделей и лимиты токенов

На том же экране настройте или добавьте названия моделей в точном соответствии с теми, что публикует CometAPI (например, gpt-4o, minimax-m2, kimi-k2-thinking), чтобы интерфейс AnythingLLM мог показывать эти модели пользователям. CometAPI публикует строковые идентификаторы моделей для каждого поставщика.

Шаг 5 — Протестируйте в AnythingLLM

Начните новый чат или используйте существующее рабочее пространство, выберите провайдера Generic OpenAI (если у вас несколько провайдеров), укажите одно из названий моделей CometAPI, которые вы добавили, и выполните простой запрос. Если вы получаете осмысленные ответы, интеграция выполнена.

Как AnythingLLM использует эти настройки внутри

Обертка Generic OpenAI в AnythingLLM формирует запросы в стиле OpenAI (/v1/chat/completions, /v1/embeddings), поэтому после указания базового URL и ключа CometAPI AnythingLLM будет прозрачно направлять чаты, вызовы агентов и запросы на эмбеддинги через CometAPI. Если вы используете агентов AnythingLLM (потоки @agent), они унаследуют того же провайдера.

Каковы лучшие практики и возможные подводные камни?

Лучшие практики

- Используйте настройки контекста, соответствующие модели: Сопоставьте Token Context Window и Max Tokens в AnythingLLM с выбранной моделью в CometAPI. Несоответствие приведет к неожиданным усечением или ошибкам.

- Защитите ключи API: Храните ключи CometAPI в переменных окружения и/или менеджере секретов (Kubernetes и т. п.); никогда не отправляйте их в git. Если вы вводите ключи через UI AnythingLLM, они хранятся локально — относитесь к хранилищу хоста как к чувствительному.

- Начинайте с более дешевых/меньших моделей для экспериментов: Используйте CometAPI, чтобы опробовать более дешевые модели при разработке, а премиальные — для продакшена. CometAPI явно поддерживает переключение по стоимости и единый биллинг.

- Мониторьте использование и настраивайте оповещения: В CometAPI есть панели мониторинга — задайте бюджеты/алерты, чтобы избежать неожиданных счетов.

- Тестируйте агентов и инструменты изолированно: Агенты AnythingLLM могут запускать действия; протестируйте их безопасными промптами и на стендовых инстансах.

Частые проблемы

- Конфликты между UI и

.env: При саморазвертывании настройки UI могут перезаписывать изменения в.env(и наоборот). Проверьте сгенерированный/app/server/.env, если параметры «откатываются» после перезапуска. Сообщество сообщает о сбросахLLM_PROVIDER. - Несоответствие названий моделей: Использование названия модели, отсутствующей в CometAPI, приведет к 400/404 от шлюза. Всегда сверяйтесь со списком моделей CometAPI.

- Лимиты токенов и стриминг: Если нужен стриминг ответов, убедитесь, что модель в CometAPI его поддерживает (и версия UI AnythingLLM тоже). У некоторых провайдеров различаются семантики стриминга.

Какие реальные сценарии открывает эта интеграция?

Retrieval-Augmented Generation (RAG)

Используйте загрузчики документов AnythingLLM + векторную БД с LLM из CometAPI для контекстно-осведомленных ответов. Можно экспериментировать с дешёвыми моделями эмбеддингов + дорогими моделями чата или держать всё в CometAPI для единого биллинга. RAG — один из ключевых встроенных сценариев AnythingLLM.

Автоматизация через агентов

AnythingLLM поддерживает рабочие процессы @agent (просмотр страниц, вызов инструментов, автоматизации). Маршрутизация вызовов LLM агентов через CometAPI дает вам выбор моделей для этапов управления/интерпретации без модификации кода агентов.

A/B-тестирование и оптимизация стоимости с несколькими моделями

Переключайте модели по рабочему пространству или функции (например, gpt-4o для продакшн-ответов, gpt-4o-mini для разработки). CometAPI упрощает замену моделей и централизует расходы.

Мультимодальные конвейеры

CometAPI предоставляет модели для изображений, аудио и специализированные модели. Мультимодальная поддержка AnythingLLM (через провайдеров) плюс модели CometAPI позволяют реализовать подписи к изображениям, мультимодальную суммаризацию или транскрибацию аудио через тот же интерфейс.

Заключение

CometAPI продолжает позиционировать себя как мульти-модельный шлюз (500+ моделей, API в стиле OpenAI), что делает его естественным партнёром для приложений вроде AnythingLLM, уже поддерживающих провайдера Generic OpenAI. В свою очередь, Generic-провайдер AnythingLLM и недавние опции конфигурации делают подключение к таким шлюзам простым. Эта конвергенция упрощает эксперименты и миграцию в продакшн в конце 2025 года.

С чего начать работу с Comet API

CometAPI — это унифицированная платформа API, агрегирующая более 500 моделей ИИ от ведущих поставщиков — таких как серия GPT от OpenAI, Gemini от Google, Claude от Anthropic, Midjourney, Suno и другие — в единый, удобный для разработчиков интерфейс. Предлагая единообразную аутентификацию, форматирование запросов и обработку ответов, CometAPI существенно упрощает интеграцию возможностей ИИ в ваши приложения. Независимо от того, создаете ли вы чат-ботов, генераторы изображений, музыкальные композиторы или аналитические пайплайны, CometAPI позволяет быстрее итеративно развиваться, контролировать расходы и оставаться независимыми от поставщиков — при этом используя новейшие достижения экосистемы ИИ.

Для начала изучите возможности моделей CometAPI в Playground и обратитесь к руководству по API для подробных инструкций. Перед доступом убедитесь, что вы вошли в CometAPI и получили ключ API. CometAPI предлагает цену значительно ниже официальной, чтобы упростить вам интеграцию.

Готовы начать? → Зарегистрируйтесь в CometAPI сегодня!

Хотите больше советов, гайдов и новостей об ИИ — следите за нами в VK, X и Discord!