MiniMax-M2.5 — это новая, ориентированная на продуктивность большая языковая модель от MiniMax, оптимизированная для кодирования, агентного использования инструментов и офисных рабочих процессов. Вы можете вызывать её через нативную платформу MiniMax или через агрегаторы API, такие как CometAPI. Для использования API вам нужно лишь получить API-ключ CometAPI, поскольку Minimax-M2.5 также поддерживает формат чата.

Что такое MiniMax-M2.5?

MiniMax-M2.5 — это последний крупный релиз модели от MiniMax: эволюция семейства M2, которую компания позиционирует как универсальную модель с поддержкой агентных сценариев и особенно сильными результатами в генерации кода, использовании инструментов и многошаговом рассуждении. Семейство M2.5 было анонсировано как релиз февраля 2026 года и включает стандартную M2.5 и вариант “highspeed”, оптимизированный для более низкой задержки при сохранении тех же базовых возможностей. Семейство M2.5 улучшило результаты на бенчмарках по инженерии ПО и поведение при взаимодействии с внешними инструментами (поиск, агенты и т. п.).

Поставщик позиционирует M2.5 как шаг вперёд по сравнению с ранними релизами M2.x — с более сильным рассуждением, лучшей генерацией кода и повышенной надёжностью вызовов инструментов. В публичных заметках MiniMax за начало февраля 2026 M2.5 отмечена как веха: улучшенная настройка на инструкции, более глубокое понимание кода и измеримые приросты на нескольких код-ориентированных бенчмарках. Релиз включает:

- Стандартную модель M2.5 (с акцентом на точность и рассуждение).

- Вариант M2.5-highspeed с меньшей задержкой для интерактивных рабочих процессов разработчика.

- Явные рекомендации и варианты биллинга для “Coding Plan”, нацеленного на интенсивную генерацию кода.

Ключевые технические особенности

- Архитектура: MoE (большое общее число параметров с гораздо меньшим активным набором на инференсе), что обеспечивает баланс стоимости/производительности для тяжёлых задач.

- Сильные стороны: передовая производительность в кодинге, многоходовое рассуждение, работа с длинным контекстом и интеграции с агентами/инструментами.

- Варианты: MiniMax публикует разновидности (например,

MiniMax-M2.5иM2.5-highspeed), настроенные под пропускную способность или задержку.

Почему это важно сегодня: многим командам, создающим инструменты для разработчиков, помощников по программированию и агентные автоматизации, нужна модель, способная рассуждать в нескольких итерациях, безопасно вызывать инструменты и генерировать качественный код. M2.5 — благодаря архитектуре и обучению — явно продвигается под эти сценарии.

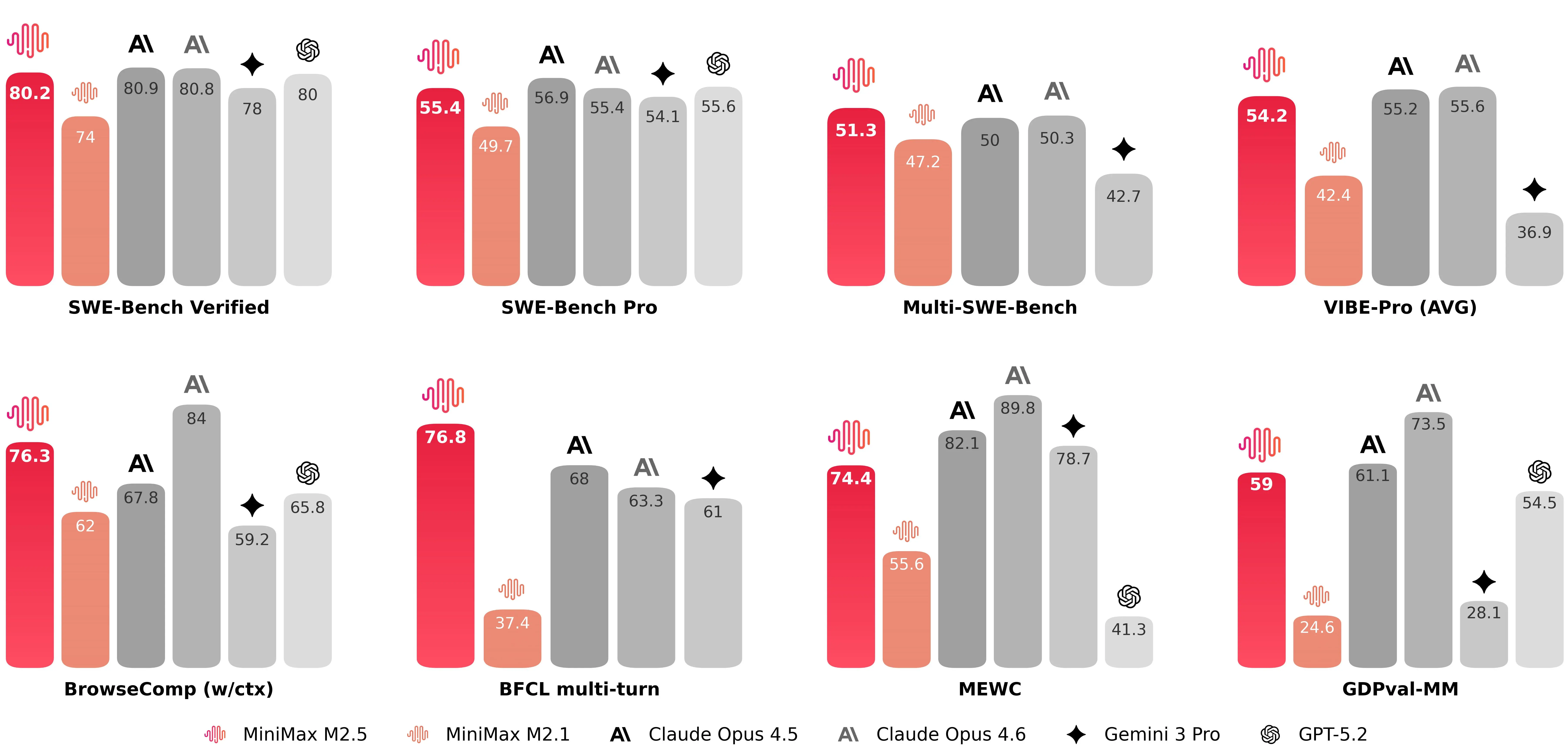

Тестирование производительности MiniMax-M2.5

Позиционирование M2.5 на специализированных бенчмарках по программированию

MiniMax-M2.5 набирает 80.2% на SWE-Bench Verified, а также демонстрирует сильные результаты на мультитасковых кодовых и расширенных браузингом бенчмарках (значимые цифры, опубликованные компанией: 51.3% на Multi-SWE-Bench и 76.3% на BrowseComp при включённом управлении контекстом). Эти показатели выводят M2.5 среди самых сильных публично доступных моделей для генерации кода и решения задач на момент запуска. Запуск MiniMax-M2.5 подтверждает, что M2.5 конкурирует с топовым уровнем кодовых моделей.

Для разработчиков выгоды двоякие:

- Более высокий успех с первой попытки: меньше итераций исправлений, меньше ручной отладки и меньше “нянькинга” для автономных кодогенераторов.

- Лучшее покрытие full‑stack: M2.5 описывается как поддерживающая full‑stack рабочие процессы для десктопных приложений, мобильных и кроссплатформенных цепочек инструментов, то есть она нацелена генерировать не только фрагменты, но и согласованные многофайловые решения и скрипты сборки.

Создан для агентных рабочих процессов

M2.5 описывается как «изначально спроектированная для Agent‑сценариев». Практически это означает, что архитектура и программа обучения приоритизируют:

- Точность вызовов инструментов: формирование API-вызовов или выполнение shell/SQL-команд с корректным синтаксисом и параметрами.

- Переключение контекста и память: продолжение прерванной многошаговой операции без потери ранее вычислённого состояния.

- Манипуляции с файлами: генерация и редактирование распространённых офисных форматов программно (например, создание PowerPoint и последующее внесение правок по запросу).

Усиление за счёт поиска и браузинга

В паре с механизмами браузинга или извлечения данных M2.5 показывает заметно улучшенные результаты на бенчмарках с браузингом, что отражает более сильные способности интегрировать внешнюю информацию и цитаты в ответы. Это делает M2.5 подходящей для инструментов, которым нужно получать актуальный контент, перепроверять результаты API или дополнять генерацию кода данными из реального мира (например, подтягивать последние SDK‑доки и корректно использовать их при кодогенерации). Эти возможности важны для команд, создающих «агентные» функции вроде автоматизированного QA, CI‑цепочек или ассистентов, работающих с документами.

Как использовать API MiniMax-2.5 (через CometAPI)?

CometAPI — это платформа-агрегатор API, которая предоставляет доступ к сотням моделей через единый REST‑интерфейс, совместимый с OpenAI. Поскольку интерфейс CometAPI повторяет эндпоинты OpenAI chat/completions, вы часто можете переиспользовать существующие клиенты в стиле OpenAI, просто переключив api_base и ключ API. Если вы предпочитаете не интегрироваться напрямую с платформой MiniMax (например, ради единого биллинга, A/B‑тестирования нескольких моделей или абстракции от поставщика), вы можете вызывать MiniMax-M2.5 через “chat”‑интерфейс CometAPI. Платформа CometAPI предоставляет согласованный формат запросов, SDK и веб‑песочницу, а также публикует имена и параметры для каждой модели (выбираете точную строку провайдера/модели при вызове).

Ниже — краткое практическое руководство по вызову MiniMax-M2.5 через CometAPI с примерами на curl и Python.

Как начать: базовые шаги

- Зарегистрируйтесь в CometAPI и получите ключ API. (CometAPI предоставляет песочницу и SDK для тестирования моделей.)

- Проверьте список моделей CometAPI или песочницу CometAPI, чтобы найти точное имя модели для MiniMax-M2.5.

- Выполните аутентифицированный POST‑запрос с параметром

model, установленным на выбранную модель MiniMax, и телом запроса, соответствующим схеме chat/completion CometAPI. - Настройте параметры (temperature, max_tokens, системные сообщения, потоковая выдача) под свой процесс.

Аутентификация и основы работы с эндпоинтами

- Базовый URL:

https://api.cometapi.com/v1(поддерживаются OpenAI‑стиль пути, такие как/chat/completions). - Заголовок:

Authorization: Bearer YOUR_COMETAPI_KEY - Content-Type:

application/json - Поле модели: используйте точную строку модели из каталога CometAPI (например:

"minimax-m2.5"

Пример 1 — Быстрый curl (REST, в стиле OpenAI)

// Replace $COMETAPI_KEY with your CometAPI key

curl -s -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer $COMETAPI_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "minimax-m2.5",

"messages": [

{"role":"system","content":"You are a concise, safety-conscious coding assistant."},

{"role":"user","content":"Refactor this synchronous Python function to async and add basic error handling:\n\n```\ndef fetch(user_id):\n resp = http_get(f\"https://api.example.com/users/{user_id}\")\n return resp.json()\n```"}

],

"max_tokens": 800,

"temperature": 0.0,

"stream": false

}'

Примечания:

- Используйте строку модели ровно так, как показано в каталоге CometAPI; s.

- Поддерживается

stream: trueдля потоковой выдачи (обрабатывайте server‑sent events или порционные ответы, если вам нужны частичные токены).

Пример 2 — Python (requests) для chat completion

import os, requests

COMET_KEY = os.environ.get("COMETAPI_KEY") # recommended

URL = "https://api.cometapi.com/v1/chat/completions"

headers = {

"Authorization": f"Bearer {COMET_KEY}",

"Content-Type": "application/json",

}

payload = {

"model": "minimax-m2.5", # or "minimax/minimax-m2.5" — verify Comet's model page

"messages": [

{"role": "system", "content": "You are a helpful engineer who returns clear, tested code."},

{"role": "user", "content": "Write a pytest for the following function that asserts edge cases..."}

],

"temperature": 0.1,

"max_tokens": 1000,

}

r = requests.post(URL, json=payload, headers=headers, timeout=120)

r.raise_for_status()

out = r.json()

print(out["choices"][0]["message"]["content"])

Пример 3 — Использование litellm / интеграции CometAPI (удобный слой для Python)

CometAPI поддерживается несколькими SDK сообщества и адаптерами. Документация liteLLM показывает компактный сценарий, где вы задаёте COMETAPI_KEY и вызываете модель по имени. Это удобно для прототипирования:

import os

from litellm import completion

os.environ["COMETAPI_KEY"] = "your_cometapi_key_here"

messages = [{"role":"user", "content":"Explain async/await in Python in 3 bullets."}]

resp = completion(model="minimax-m2.5", messages=messages)

print(resp.choices[0].message.content)

Интеграции Litellm / Comet предоставляют полезные утилиты (стриминг, async, явный параметр api_key), которые повторяют многие паттерны существующих OpenAI SDK.

Как проектировать подсказки и системные сообщения для M2.5

Чётко задавайте роль и ограничения

Дайте M2.5 ясную системную роль при запросе кода. Пример:

{"role": "system","content": "You are MiniMax M2.5, an assistant specialized in robust, readable, and well-documented code. Use Python 3.11 conventions, include type hints, and provide brief unit tests."}

Для сложных задач используйте разбиение на шаги

При запросе реализации сложных возможностей примените короткое разбиение:

- Попросите набросок дизайна.

- Запросите сигнатуры интерфейсов.

- Попросите реализацию и тесты.

Это снижает риск галлюцинаций и приводит к модульным, пригодным для ревью результатам.

Температура, max_tokens и безопасность

- Для детерминированного кода: ставьте

temperatureблизко к 0.0. - Для исследовательского дизайна:

temperatureв диапазоне 0.2–0.5 может предложить креативные подходы. - Держите

max_tokensдостаточно большим для крупных рефакторингов или длинных тестовых наборов.

Запрашивайте модульные тесты и объяснение

При запросе кода также просите модульные тесты и краткое объяснение алгоритма. Это помогает выявлять тонкие ошибки и получать запускаемые артефакты с первой попытки.

Длительный инференс и отслеживание состояния

Модель M2.5 обладает отличным механизмом отслеживания состояния, эффективно обеспечивая непрерывность и направленность мысли на длинных временных отрезках, сосредотачиваясь каждый раз на ограниченном числе целей, а не обрабатывая всё параллельно. M2.5 оснащена функциональностью, учитывающей контекст, что позволяет эффективно выполнять задачи и оптимизировать управление контекстом.

Практические советы по использованию M2.5 в продакшене

MiniMax-M2.5 настроена для многошаговых пайплайнов и кода. Ниже приведены практические, основанные на опыте рекомендации для достижения наилучших результатов в продакшене.

Инжиниринг подсказок и системные сообщения

- Используйте явные системные сообщения с ролью и ограничениями. Для задач по коду указывайте требуемое окружение/фреймворки тестов (например, «Вернуть тесты pytest, совместимые с Python 3.11»).

- Давайте контекст: для агентных или многошаговых задач включайте метаданные шагов и описания инструментов в виде структурированного JSON или маркированных списков. M2.5 хорошо реагирует на структурированный ввод, так как оптимизирована под использование инструментов.

Вызов функций/инструментов

- Если вы используете CometAPI как шлюз для вызова инструментов, убедитесь, что ваши дополнительные поля (например,

function_callв стиле OpenAI) соответствуют ожиданиям CometAPI/модели. Подтвердите поддержку на странице модели Comet, поскольку семантика инструментов может отличаться у разных провайдеров. - Для надёжной оркестрации дробите большие задачи на более мелкие вызовы и фиксируйте детерминированные контрольные точки. M2.5 хорошо выполняет многошаговые инструкции, но наиболее надёжное поведение достигается валидацией после каждого шага.

Температура, max_tokens и контроль стоимости

- Для генерации или рефакторинга кода держите

temperatureнизкой (0.0–0.2) и подбирайтеmax_tokensпод ожидаемый размер ответа. - Для исследовательских подсказок повышайте

temperature, но следите за ростом расхода токенов. При маршрутизации через CometAPI сравнивайте цены у провайдеров и правила фолбэка — CometAPI публикует цену за токены для каждой модели в каталоге.

Контекстное окно и длинные документы

- Варианты M2.5 часто поддерживают длинный контекст (проверьте спецификацию модели на максимальную длину контекста). Для очень длинных документов делите на части и суммируйте — затем подавайте суммы и релевантные фрагменты, вместо отправки всех файлов целиком.

Безопасность, токсичный контент и снижение галлюцинаций

- Применяйте ограждения: системные сообщения, внешние валидаторы и тестовые наборы (например, модульные тесты для сгенерированного кода) снижают риски.

- Проверяйте внешние ссылки: если модель приводит факты или код из интернета, верифицируйте это программно, прежде чем доверять или выкатывать результаты.

Типичные ошибки и как их избежать

Ошибка: Чрезмерное доверие единственному ответу модели

Рекомендация: Запускайте тесты, статические проверки и, для критичной логики, запрашивайте несколько независимых ответов и сравнивайте их. CometAPI позволяет переключаться между несколькими моделями, и вы можете менять их в любой момент, используя формат чата OpenAI.

Ошибка: Использование высокой температуры для продакшен-кода

Рекомендация: Держите temperature низкой; если нужны креативные альтернативы, запросите несколько низкотемпературных вариаций или попросите модель объяснить различия.

Ошибка: Игнорирование версионности модели

Рекомендация: Отслеживайте имена моделей и строки провайдера в манифестах деплоя. При переходе с MiniMax-M2.5 на MiniMax-M2.5-highspeed или на другого провайдера относитесь к этому как к релизному изменению и запускайте регрессионные тесты.

Итоговые рекомендации и реалистичные ожидания

MiniMax-M2.5 — заметный шаг вперёд среди ориентированных на код и агенты LLM: она обещает сильную генерацию кода, многоходовое рассуждение и безопасное взаимодействие с инструментами. Если ваши приоритеты — создание надёжных инструментов для разработчиков, агентных фреймворков или код‑ассистентов, M2.5 стоит включить в матрицу сравнения. Использование CometAPI как унифицированного шлюза ускорит эксперименты и позволит переключаться между провайдерами или A/B‑моделями без переработки всей интеграции.

Несколько прагматичных выводов:

- Быстро прототипируйте в песочнице CometAPI, затем зафиксируйте идентификаторы моделей в коде.

- Держите низкую температуру, запрашивайте тесты и объяснения и всегда запускайте автоматическую валидацию.

- Относитесь к модели как к сильному содевелоперу — но не безошибочному: применяйте ручной ревью, CI‑пайплайны и телеметрию.

Разработчики уже могут получить доступ к MInimax-M2.5 через CometAPI. Чтобы начать, изучите возможности модели в Песочнице и ознакомьтесь с руководством по API для подробных инструкций. Перед доступом убедитесь, что вы вошли в CometAPI и получили ключ API. CometAPI предлагает цену значительно ниже официальной, чтобы упростить вам интеграцию.

Готовы начать? → Зарегистрируйтесь в M2.5 уже сегодня!

Если хотите узнавать больше советов, гайдов и новостей об ИИ, подписывайтесь на нас в VK, X и Discord!