Что такое GPT-5.2 API

GPT-5.2 API совпадает с GPT-5.2 Thinking в ChatGPT. GPT-5.2 Thinking — это средний уровень в семействе GPT-5.2 от OpenAI, предназначенный для более глубокой работы: многошагового рассуждения, суммирования длинных документов, качественной генерации кода и профессиональных задач, где точность и пригодная для использования структура важнее, чем чистая пропускная способность. В API он представлен как модель gpt-5.2 (Responses API / Chat Completions) и занимает место между низколатентным вариантом Instant и более качественным, но более дорогим вариантом Pro.

Основные возможности

- Очень длинный контекст и сжатие: эффективное окно 400K и инструменты сжатия для управления релевантностью в длинных диалогах и документах.

- Настраиваемая интенсивность рассуждения:

none | medium | high | xhigh(xhigh включает максимальные внутренние вычисления для сложных рассуждений).xhighдоступен в вариантах Thinking/Pro. - Усиленная поддержка инструментов и функций: первоклассный вызов инструментов, грамматики (CFG/Lark) для ограничения структурированных выходов и улучшенные агентные поведения, упрощающие сложную многошаговую автоматизацию.

- Мультимодальное понимание: более глубокое понимание изображений и текста и интеграция в многошаговые задачи.

- Улучшенная безопасность/обработка чувствительного контента: целевые меры для снижения нежелательных ответов в областях, связанных с самоповреждением и другими чувствительными контекстами.

Технические возможности и спецификации (для разработчиков)

- Конечные точки API и идентификаторы моделей:

gpt-5.2для Thinking (Responses API),gpt-5.2-chat-latestдля chat/instant рабочих процессов иgpt-5.2-proдля уровня Pro; доступны через Responses API и Chat Completions там, где указано. - Токены рассуждения и управление усилием: API поддерживает явные параметры для распределения вычислительных ресурсов (reasoning effort) на запрос; более высокий уровень усилия повышает задержку и стоимость, но улучшает качество вывода для сложных задач.

- Инструменты структурированного вывода: поддержка грамматик (Lark / CFG) для ограничения вывода модели DSL или точным синтаксисом (полезно для SQL, JSON, генерации DSL).

- Параллельные вызовы инструментов и агентная координация: улучшенный параллелизм и более чистая оркестрация инструментов уменьшают потребность в сложных системных подсказках и многоагентных каркасах.

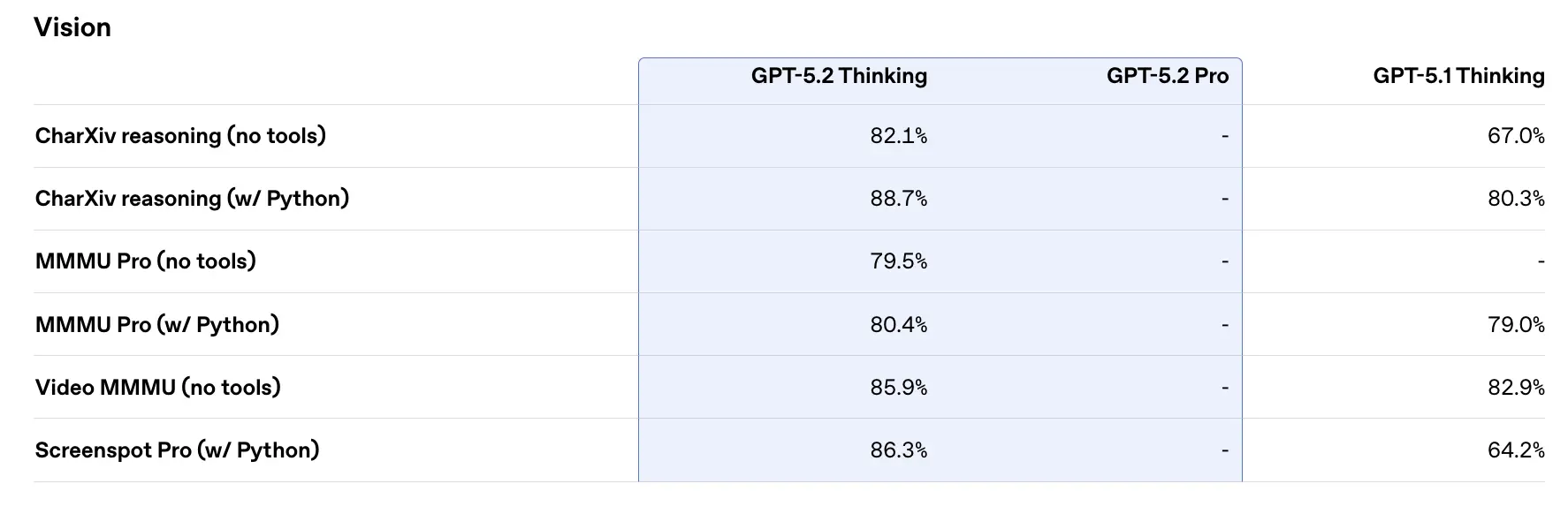

Производительность в бенчмарках и подтверждающие данные

OpenAI опубликовала ряд внутренних и внешних результатов бенчмарков для GPT-5.2. Избранные моменты (по данным OpenAI):

- GDPval (44 профессии, интеллектуальный труд) — GPT-5.2 Thinking «опережает или сравним с ведущими отраслевыми профессионалами в 70,9% сравнений»; по данным OpenAI, результаты были получены со >11× скоростью и при <1% стоимости по сравнению с экспертами-профессионалами на их задачах GDPval (оценки по скорости и стоимости основаны на исторических данных). Эти задачи включают модели в электронных таблицах, презентации и короткие видео.

- SWE-Bench Pro (coding) — GPT-5.2 Thinking достигает ≈55,6% на SWE-Bench Pro и ~80% на SWE-Bench Verified (только Python) по данным OpenAI, устанавливая новый уровень передовых результатов для оценки генерации кода/инжиниринга в их тестах. Это приводит к более надежной отладке и сквозным исправлениям на практике, согласно примерам OpenAI.

- GPQA Diamond (graduate-level science Q&A) — GPT-5.2 Pro: 93,2%, GPT-5.2 Thinking: 92,4% на GPQA Diamond (без инструментов, максимальное рассуждение).

- ARC-AGI series — На ARC-AGI-2 (более сложный бенчмарк для гибкого рассуждения) GPT-5.2 Thinking набрал 52,9%, а GPT-5.2 Pro — 54,2% (OpenAI заявляет, что это новые передовые показатели для моделей с рассуждениями в стиле chain-of-thought).

- Long-context (OpenAI MRCRv2) — GPT-5.2 Thinking демонстрирует почти 100% точность на варианте 4-needle MRCR вплоть до 256k токенов и существенно улучшенные результаты по сравнению с GPT-5.1 в сценариях длинного контекста. (OpenAI опубликовала графики и таблицы MRCRv2.)

Сравнение с современными аналогами

- по сравнению с Google Gemini 3 (Gemini 3 Pro / Deep Think): Gemini 3 Pro был представлен с ~1,048,576 (≈1M) токенов окном контекста и широкими мультимодальными входами (текст, изображение, аудио, видео, PDF) и сильными агентными интеграциями через Vertex AI / AI Studio. На бумаге более крупное окно контекста Gemini 3 — это отличительное преимущество для чрезвычайно больших односессионных нагрузок; компромиссы включают поверхность инструментов и соответствие экосистеме.

- по сравнению с Anthropic Claude Opus 4.5: Anthropic Opus 4.5 делает упор на корпоративные сценарии кодирования/агентные рабочие процессы и сообщает о сильных результатах SWE-bench и устойчивости для длинных агентных сессий; Anthropic позиционирует Opus для автоматизации и генерации кода с окном контекста 200k и специализированными интеграциями с агентами и Excel. Opus 4.5 — сильный конкурент в корпоративной автоматизации и задачах по коду.

Практический вывод: GPT-5.2 нацелен на сбалансированный набор улучшений (контекст 400k, высокий объем вывода токенов, улучшенные рассуждения/кодинг). Gemini 3 ориентирован на максимально большой контекст одной сессии (≈1M), а Claude Opus — на корпоративную инженерию и агентную устойчивость. Выбирайте, сопоставляя размер контекста, потребности в модальностях, соответствие по функциям/инструментам и компромиссы по стоимости/задержке.

Как получить доступ и использовать GPT-5.2 API

Шаг 1: Получите ключ API

Войдите на cometapi.com. Если вы еще не являетесь нашим пользователем, сначала зарегистрируйтесь. Войдите в CometAPI console. Получите ключ API для доступа к интерфейсу. Нажмите «Add Token» в разделе API token в личном кабинете, получите ключ токена: sk-xxxxx и отправьте.

Шаг 2: Отправляйте запросы в GPT-5.2 API

Выберите конечную точку «gpt-5.2» для отправки запроса к API и задайте тело запроса. Метод и тело запроса берите из документации API на нашем сайте. На нашем сайте также доступен тест в Apifox для вашего удобства. Замените <YOUR_API_KEY> на ваш фактический ключ CometAPI из учетной записи. Разработчики вызывают это через Responses API / Chat конечные точки.

Вставьте свой вопрос или запрос в поле content — именно на него модель ответит. Обработайте ответ API, чтобы получить сгенерированный результат.

Шаг 3: Получите и проверьте результаты

Обработайте ответ API, чтобы получить сгенерированный результат. После обработки API возвращает статус задачи и выходные данные.

См. также Gemini 3 Pro Preview API