DeepSeek ได้เปิดตัวพรีวิว V4 อย่างเป็นทางการในฐานะตระกูลโมเดลโอเพนซอร์ส และประเด็นสำคัญไม่ใช่แค่ “อัปเดตโมเดลอีกตัว” เท่านั้น บริษัทวางตำแหน่ง V4 เป็นระบบที่รองรับบริบทยาวและเป็นมิตรต่อเอเจนต์ ออกแบบมาสำหรับงานจริง: การวิเคราะห์ที่เน้นเอกสาร ผู้ช่วยเขียนโค้ด เอเจนต์ค้นหา และระบบอัตโนมัติหลายขั้นตอน การปล่อยใช้งานเปิดให้ใช้แล้วบนเว็บ แอป และ API โดยไลน์ V4 นำเสนอหน้าต่างบริบทขนาด 1M โทเค็นที่คุ้มค่าในบริการทางการทั้งหมด

สิ่งที่ทำให้การเปิดตัวครั้งนี้น่าสนใจเป็นพิเศษคือการผสาน “ขนาด” เข้ากับ “ประสิทธิภาพ” DeepSeek ระบุว่า V4‑Pro มีพารามิเตอร์รวม 1.6T โดยใช้งานอยู่ 49B ขณะที่ V4‑Flash มีพารามิเตอร์รวม 284B โดยใช้งานอยู่ 13B ในรายงานทางเทคนิค DeepSeek ยังอ้างว่าสถาปัตยกรรม V4 ใช้ hybrid attention, MoE routing และ post‑training ที่ออกแบบมาเพื่อปรับปรุงพฤติกรรมเชิงเอเจนต์ พร้อมลดภาระคำนวณของบริบทที่ยาวเป็นพิเศษ

DeepSeek V4 คืออะไร?

DeepSeek‑V4 คือครอบครัวเรือธงรุ่นพรีวิวล่าสุดของบริษัท การปล่อยครั้งนี้มี 2 รุ่นสาธารณะ: V4‑Pro และ V4‑Flash DeepSeek อธิบายว่า V4‑Pro แข็งแกร่งกว่าในด้านความรู้เกี่ยวกับโลก คณิตศาสตร์ STEM การเขียนโค้ด และการโค้ดเชิงเอเจนต์ ในขณะที่ V4‑Flash ตอบสนองไวและคุ้มค่ากว่าแต่ยังคงคุณภาพการให้เหตุผลและความสามารถบริบทยาวไว้ได้มาก V4‑Pro นำหน้าบรรดาโมเดลเปิดในปัจจุบันด้านการโค้ดเชิงเอเจนต์และความรู้เกี่ยวกับโลก ส่วน V4‑Flash ถูกออกแบบเพื่อความเร็วและการใช้งานที่ประหยัด

V4 ใช้สถาปัตยกรรม hybrid attention ผสาน Compressed Sparse Attention (CSA) และ Heavily Compressed Attention (HCA) ร่วมกับ Manifold‑Constrained Hyper‑Connections และตัวปรับเหมาะ Muon optimizer นอกจากนี้บริษัทยังระบุว่าโมเดลถูกพรีเทรนบนข้อมูลมากกว่า 32T tokens และที่บริบท 1M V4‑Pro ใช้เพียง 27% ของ FLOPs การอนุมานต่อหนึ่งโทเค็น และ 10% ของ KV cache เมื่อเทียบกับ DeepSeek‑V3.2 เรื่องประสิทธิภาพนี่แหละคือหัวใจของการเปิดตัว

DeepSeek‑V4‑Pro เทียบกับ DeepSeek‑V4‑Flash

DeepSeek‑V4‑Pro

V4‑Pro คือโมเดลเรือธงสำหรับผู้ใช้ที่ให้ความสำคัญกับคุณภาพมากที่สุด DeepSeek‑V4‑Pro มอบความสามารถด้านการโค้ดเชิงเอเจนต์ที่แข็งแรงขึ้น ความรู้เกี่ยวกับโลกที่ลึกกว่า และการให้เหตุผลระดับโลก และขึ้นนำโมเดลเปิดปัจจุบัน ขณะที่ตามหลังเพียง Gemini‑3.1‑Pro ในด้านความรู้เกี่ยวกับโลกตามหน้าเปิดตัว รายงานทางเทคนิคระบุว่า V4‑Pro เป็นโมเดลขนาดใหญ่กว่าในตระกูล และ DeepSeek‑V4‑Pro พร้อมให้ใช้ผ่านอินเทอร์เฟซที่เข้ากันได้กับ OpenAI และ Anthropic เช่นเดียวกับ V4‑Flash

DeepSeek‑V4‑Flash

V4‑Flash เป็นโมเดลที่ให้ความสำคัญกับประสิทธิภาพเป็นอันดับแรก ความสามารถในการให้เหตุผลเข้าใกล้ V4‑Pro อย่างมาก และทำผลงานทัดเทียม V4‑Pro ในงานเอเจนต์ที่ง่าย โดยใช้จำนวนพารามิเตอร์ที่เล็กกว่าและเวลาตอบสนองที่เร็วกว่า รองรับทั้งโหมดคิดและไม่คิด มีความยาวบริบท 1M และฟีเจอร์หลักเหมือนรุ่น Pro แต่มีค่าใช้จ่ายต่ำกว่ามาก

ควรเลือกตัวไหน?

ใช้ V4‑Pro เมื่อภารกิจมีความเสี่ยงสูง พึ่งพาความรู้มาก หรือยากต่อการยืนยันผล: งานวิจัยระดับองค์กร โค้ดที่ซับซ้อน การตัดสินใจหลายขั้นตอน หรือภารกิจที่ต้องการคำตอบที่แข็งแกร่งที่สุด ใช้ V4‑Flash เมื่ออัตราการประมวลผล แล็ตเทนซี หรือค่าโทเค็นสำคัญกว่าการไล่คะแนนเบนช์มาร์กในช่วงท้ายให้ถึงที่สุด ตัวเลือกนี้สอดคล้องกับการวางตำแหน่งอย่างเป็นทางการและช่องว่างเบนช์มาร์กที่รายงานระหว่างทั้งสองโมเดล

| Item | DeepSeek-V4-Flash | DeepSeek-V4-Pro |

|---|---|---|

| Total parameters | 284B | 1.6T |

| Active parameters | 13B | 49B |

| Context length | 1M | 1M |

| Reasoning modes | Non-think + think | Non-think + think |

| Best fit | การอนุมานเร็ว แอปที่ต้องการปริมาณงานสูง เอเจนต์ที่ไวต่อค่าใช้จ่าย | ความสามารถให้เหตุผลสูงสุด งานโค้ดและงานความรู้ที่ยากกว่า |

| Official API pricing | Cache hit $0.028 / cache miss $0.14 / output $0.28 per 1M tokens | Cache hit $0.145 / cache miss $1.74 / output $3.48 per 1M tokens |

| Max output | 384K | 384K |

CometAPI ให้การเข้าถึง Deepseek v4 Pro และ V4 Flash —ถูกกว่าทางการ 20%— พร้อมการสลับใช้งานระหว่างโมเดลกว่า 500 ตัว (GPT‑5.4, Gemini 3.1 ฯลฯ) ผ่านปลายทางแบบ OpenAI‑compatible หรือ Anthropic Messages เพียงจุดเดียว

ผลการทดสอบประสิทธิภาพ

DeepSeek‑V3.2 เทียบกับ V4‑Flash และ V4‑Pro

ในตารางเปรียบเทียบโมเดลฐาน V4‑Flash และ V4‑Pro ทำคะแนนเหนือ DeepSeek‑V3.2 ในเบนช์มาร์กหลัก โดย V4‑Pro มักนำหน้า ตัวอย่างเช่น รายงานระบุคะแนนดังนี้: AGIEval 82.6 / 83.1 เทียบกับของ V3.2 ที่ 80.1; MMLU 88.7 / 90.1 เทียบกับ 87.8; MMLU‑Pro 68.3 / 73.5 เทียบกับ 65.5; HumanEval 69.5 / 76.8 เทียบกับ 62.8; และ LongBench‑V2 44.7 / 51.5 เทียบกับ 40.2 สำหรับ V3.2 โดยตัวเลขกลางคือ V4‑Flash และตัวสุดท้ายคือ V4‑Pro

| Benchmark | DeepSeek-V3.2-Base | DeepSeek-V4-Flash-Base | DeepSeek-V4-Pro-Base |

|---|---|---|---|

| AGIEval (EM) | 80.1 | 82.6 | 83.1 |

| MMLU (EM) | 87.8 | 88.7 | 90.1 |

| MMLU-Pro (EM) | 65.5 | 68.3 | 73.5 |

| HumanEval (Pass@1) | 62.8 | 69.5 | 76.8 |

| LongBench-V2 (EM) | 40.2 | 44.7 | 51.5 |

ที่มา: รายงานทางเทคนิค DeepSeek‑V4, ตารางที่ 1

รูปแบบชัดเจน: Flash ลดช่องว่างกับ Pro แต่ Pro ยังเป็นโมเดลทั่วไปที่แข็งแกร่งกว่า นั่นทำให้ V4‑Flash เป็นค่าเริ่มต้นที่ใช้งานได้จริงสำหรับระบบโปรดักชันจำนวนมาก ในขณะที่ V4‑Pro คือโมเดลที่ควรเลือกเมื่อคุณภาพคำตอบสำคัญกว่าค่าใช้จ่ายหรือแล็ตเทนซี

การเปรียบเทียบกับโมเดลตะวันตก: V4 อยู่ตรงไหน

ในการประเมินโดยมนุษย์บนงานออฟฟิศภาษาจีน รายงานระบุว่า DeepSeek‑V4‑Pro‑Max ทำผลงานเหนือ Claude Opus 4.6‑Max ด้วย อัตราไม่แพ้ 63% DeepSeek‑V4‑Pro “ทำผลงานเหนือกว่าอย่างมีนัยสำคัญ” Claude Sonnet 4.5 และเข้าใกล้ Claude Opus 4.5 บนเบนช์มาร์กการโค้ดเพื่อวิจัยและพัฒนา

| Evaluation area | DeepSeek result | Western model comparison | What it suggests |

|---|---|---|---|

| Chinese white-collar tasks | V4‑Pro‑Max, 63% non-loss rate | vs Claude Opus 4.6‑Max | ผลงานแข็งแกร่งในงานธุรกิจเชิงปฏิบัติ |

| R&D coding benchmark | V4‑Pro‑Max pass rate 67 | vs Claude Sonnet 4.5 ที่ 47; Opus 4.5 ที่ 70; Opus 4.6 Thinking ที่ 80 | แข่งขันกับโมเดลแนวหน้าชั้นนำได้ดี โดยเฉพาะเมื่อเทียบกับกลุ่ม Sonnet |

มันไม่ได้ “อันดับหนึ่งในทุกด้าน” แต่ถึงระดับที่ “ต้องพิจารณาอย่างจริงจัง” แล้ว

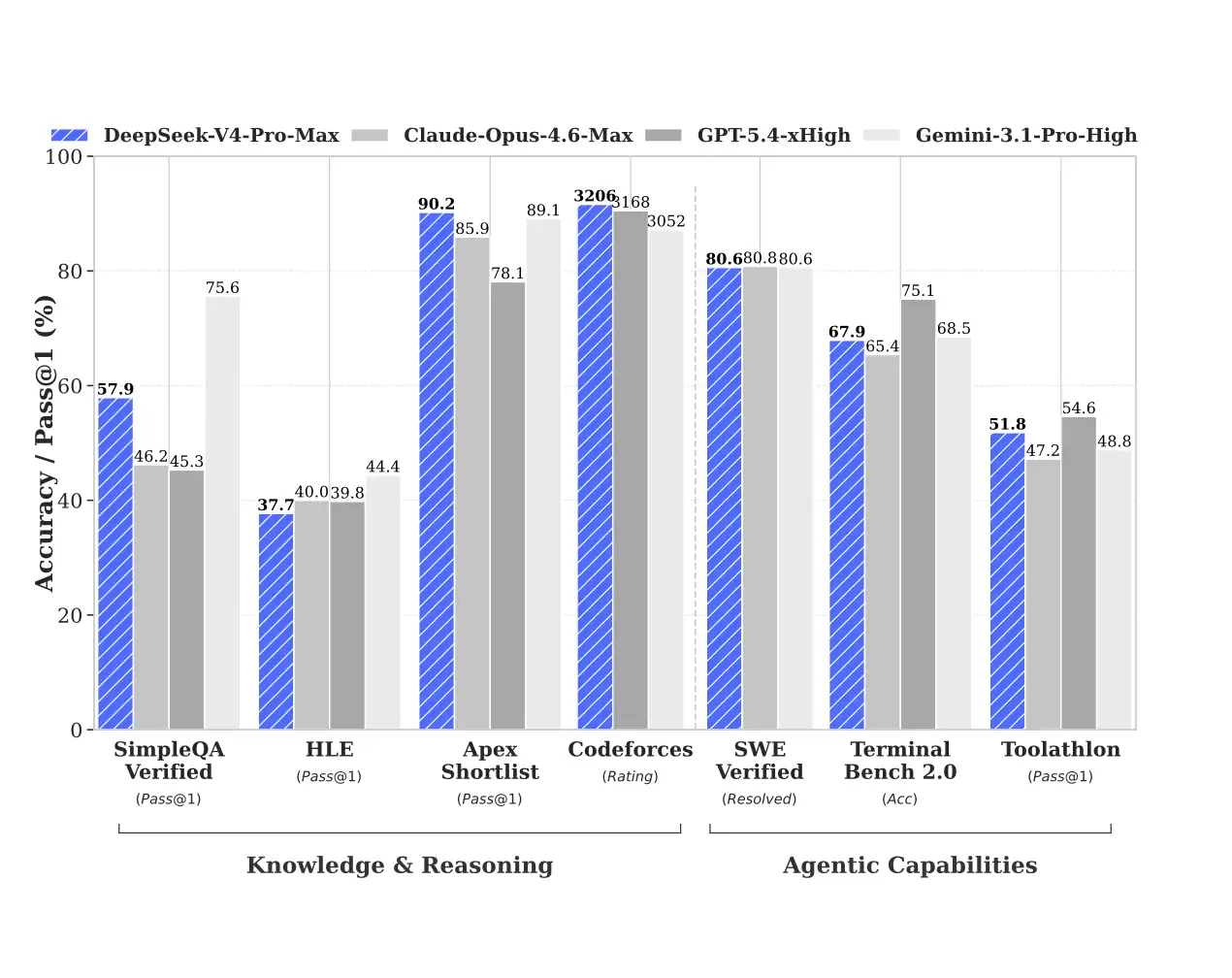

รายงานทางเทคนิคของ DeepSeek เปรียบเทียบ V4‑Pro‑Max กับ Claude Opus 4.6 Max, GPT‑5.4 xHigh และ Gemini 3.1 Pro High ในตารางเดียวกัน ผลลัพธ์ไม่ได้เรียบง่าย: โมเดลปิดของตะวันตกยังแข็งแกร่งในบางมิติของความรู้และการให้เหตุผล อย่างไรก็ตาม V4‑Pro‑Max โดดเด่นมากในโค้ด บริบทยาว และงานเอเจนต์บางประเภท กล่าวอีกนัยหนึ่ง มันไม่ใช่เรื่องเล่ามิติเดียวแบบ “ทางเลือกในประเทศ” อีกต่อไป แต่เข้าสู่ช่วง “ตัวไหนเหมาะกับสถานการณ์ของคุณมากกว่า”

ในด้านความรู้และความสามารถในการให้เหตุผล มันอยู่ระดับใกล้เคียงกับ Opus 4.6 Max, GPT‑5.4 xHigh และ Gemini 3.1 Pro High อย่างไรก็ตามยังตามหลังเล็กน้อยในความสามารถเชิงเอเจนต์ แต่ความต่างไม่ได้มากนัก

DeepSeek‑V4‑Pro‑Max แข่งขันได้อย่างมากในงานที่เน้นโค้ดและบริบทยาว ขณะที่โมเดลตะวันตกยังแข็งแกร่งมากในหลายเบนช์มาร์กที่เป็นการให้เหตุผลและความรู้ล้วน ๆ วิธีอ่านผลลัพธ์ที่ถูกต้องคือ: DeepSeek V4 อยู่ในระดับแนวหน้าอย่างมั่นคง แต่ผู้นำเบนช์มาร์กขึ้นกับงาน

วิธีเข้าถึง DeepSeek V4

1) ใช้งานผ่านเว็บและแอปทางการ

DeepSeek ระบุว่า V4 Preview พร้อมใช้งานแล้วบน เว็บ แอป และ API สำหรับผู้ใช้ทั่วไป เส้นทางที่ง่ายที่สุดยังคงเป็นอินเทอร์เฟซแชททางการ ซึ่งเข้าถึงโมเดลได้ผ่าน Expert Mode หรือ Instant Mode

2) ใช้ API

ฉันแนะนำ CometAPI อย่างยิ่งสำหรับการเข้าถึง deepseek V4 เพราะให้ราคาดีที่สุดและมีข้อได้เปรียบด้านการรวม

ชื่อโมเดลคือ:

deepseek-v4-flashdeepseek-v4-pro

DeepSeek ยังระบุว่าชื่อเดิม

deepseek-chatและdeepseek-reasonerจะถูกยกเลิก และปัจจุบันแมปกับโหมดไม่คิดและโหมดคิดของ V4‑Flash จนถึงวันที่ 2026-07-24 ซึ่งสำคัญต่อการวางแผนย้ายระบบหากคุณมีอินทิเกรชันรุ่นเก่าอยู่ในโปรดักชัน

- ลงทะเบียนที่ CometAPI และรับ API key ของคุณ

- ใช้ OpenAI Python SDK มาตรฐาน (หรือไคลเอนต์ที่เข้ากันได้ใด ๆ) พร้อม base URL แบบกำหนดเอง:

ตัวอย่างสะอาด ๆ โดยใช้รูปแบบที่เข้ากันได้กับ OpenAI อย่างเป็นทางการ:

import os

from openai import OpenAIclient = OpenAI(

api_key=os.environ["cometapi_API_KEY"],

base_url="https://api.cometapi.com"

)response = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Summarize the benefits of million-token context."}

],

extra_body={"thinking": {"type": "enabled"}},

reasoning_effort="high"

)print(response.choices[0].message.content)

รูปแบบคำขอนี้สอดคล้องกับคู่มือเริ่มต้นอย่างรวดเร็ว: ตั้งค่า base URL เลือก deepseek-v4-pro หรือ deepseek-v4-flash และเปิดใช้งาน thinking เมื่อคุณต้องการการให้เหตุผลที่ลึกขึ้น

วิธีใช้ DeepSeek V4 ให้มีประสิทธิภาพ

สำหรับเวิร์กโฟลว์เอกสารยาว รูปแบบที่แข็งแกร่งที่สุดคือรักษาบริบทให้สะอาดและมีโครงสร้าง หน้าต่างบริบท 1M โทเค็นของ V4 คือข้อได้เปรียบใหญ่ แต่โมเดลยังทำงานได้ดีที่สุดเมื่ออินพุตจัดเป็นส่วน ๆ มีแหล่งอ้างอิง คำสั่งงาน และข้อกำหนดเอาต์พุตที่ชัดเจน นั่นคือวิธีธรรมชาติที่สุดในการใช้ประโยชน์จากความสามารถบริบทยาวที่ DeepSeek โฆษณา

สำหรับเวิร์กโฟลว์โค้ดและเอเจนต์ เริ่มที่ V4‑Flash เพื่อวนซ้ำเร็ว จากนั้นยกระดับเป็น V4‑Pro สำหรับรันสุดท้ายหรือขั้นที่ยากที่สุด แนวทางนี้สอดคล้องกับการวางตำแหน่งอย่างเป็นทางการ: Flash คือทางเลือกที่มีประสิทธิภาพ Pro คือโมเดลที่แข็งแกร่งกว่า และทั้งคู่ใช้ API และความยาวบริบทเดียวกัน

สรุปท้าย

DeepSeek‑V4 โดดเด่นเพราะผสาน 4 สิ่งที่ตลาดต้องการเข้าด้วยกันในเวลาเดียวกัน: บริบทยาว การให้เหตุผลที่แข็งแกร่ง การเข้าถึงแบบเปิด และการตั้งราคาที่ดุดัน เรื่องจริงไม่ใช่แค่ DeepSeek ออกโมเดลใหม่ แต่คือบริษัทกำลังพยายามทำให้ AI ระดับแนวหน้าสามารถใช้งานได้จริงในโปรดักชันในเชิงต้นทุน สำหรับทีมที่กำลังประเมินว่าจะวางเดิมพันกับ AI ที่ไหน นี่คือสัญญาณที่ควรทดสอบ ไม่ใช่เมินเฉย

สำหรับทีมที่สร้างระบบข้ามผู้ให้บริการ นี่คือการปล่อยที่ควรนำมาเบนช์มาร์กในสแตกของคุณเอง CometAPI สามารถเป็นชั้นเชิงปฏิบัติในการเปรียบเทียบ DeepSeek‑V4 เคียงข้างโมเดลแนวหน้าอื่น ๆ ได้โดยไม่ต้องบังคับให้ทีมผลิตภัณฑ์ของคุณสร้างอินทิเกรชันใหม่ทุกครั้งที่ตลาดเปลี่ยนแปลง