The Gemini 3.1 Pro พร้อมใช้งานแล้วบน CometAPI และคุณสามารถเริ่มใช้งานผ่านบริการของ CometAPI ได้—ในราคาเปิดตัวที่ประหยัดกว่าราคาทางการ CometAPI เปิดให้ใช้ตระกูล Gemini 3 แล้วและมีเส้นทางการผสานที่เข้ากันได้กับ OpenAI เพื่อเรียกโมเดลเหล่านั้นผ่านเกตเวย์แบบรวมศูนย์เดียว; ทำให้ทดลองกับโมเดล Gemini ได้อย่างรวดเร็วด้วย SDK ของ OpenAI ที่มีอยู่

Gemini 3.1 Pro คืออะไร? (ทำไมจึงสำคัญ?)

Gemini 3.1 Pro หมายถึงรุ่นย่อย/รุ่นพรีวิวในตระกูล Gemini-3 — ตระกูลโมเดลเรือธงเดียวกันจาก Google ที่ขับเคลื่อน Gemini 3 Pro และรุ่น “Flash” ที่เกี่ยวข้อง ซีรีส์ Gemini 3.x มุ่งเน้นไปที่การให้เหตุผลแบบมัลติโหมดที่ลึกขึ้น (ข้อความ + รูปภาพ + วิดีโอ), หน้าต่างบริบท/โทเค็นที่ยาวขึ้น, การสร้างโค้ดที่ดีขึ้น (“vibe coding” และเวิร์กโฟลว์ของเอเจนต์) และการปรับปรุงประสิทธิภาพ/ประสิทธิผลแบบค่อยเป็นค่อยไปจากรุ่น Gemini 3 Pro แรกเริ่ม ตระกูล Gemini 3 ขณะนี้มีให้ใช้อย่างแพร่หลายผ่าน API และบริการคลาวด์ของ Google

ไฮไลต์ด้านเทคนิคหลัก (สิ่งที่โมเดลมอบให้)

- อินพุตมัลติโหมด: ข้อความ + รูปภาพ + (ในบางรุ่น) วิดีโอ/เสียง

- หน้าต่างบริบทที่ยาวมาก (การโต้ตอบระดับเอกสารและโค้ดได้ถึง ~1M โทเค็นในรุ่นที่รองรับ)

- เครื่องมือเชิงเอเจนต์และการเขียนโค้ดที่ดีขึ้น — ออกแบบมาสำหรับเอเจนต์อัตโนมัติ การผสานกับ IDE และงานโค้ดที่ซับซ้อน

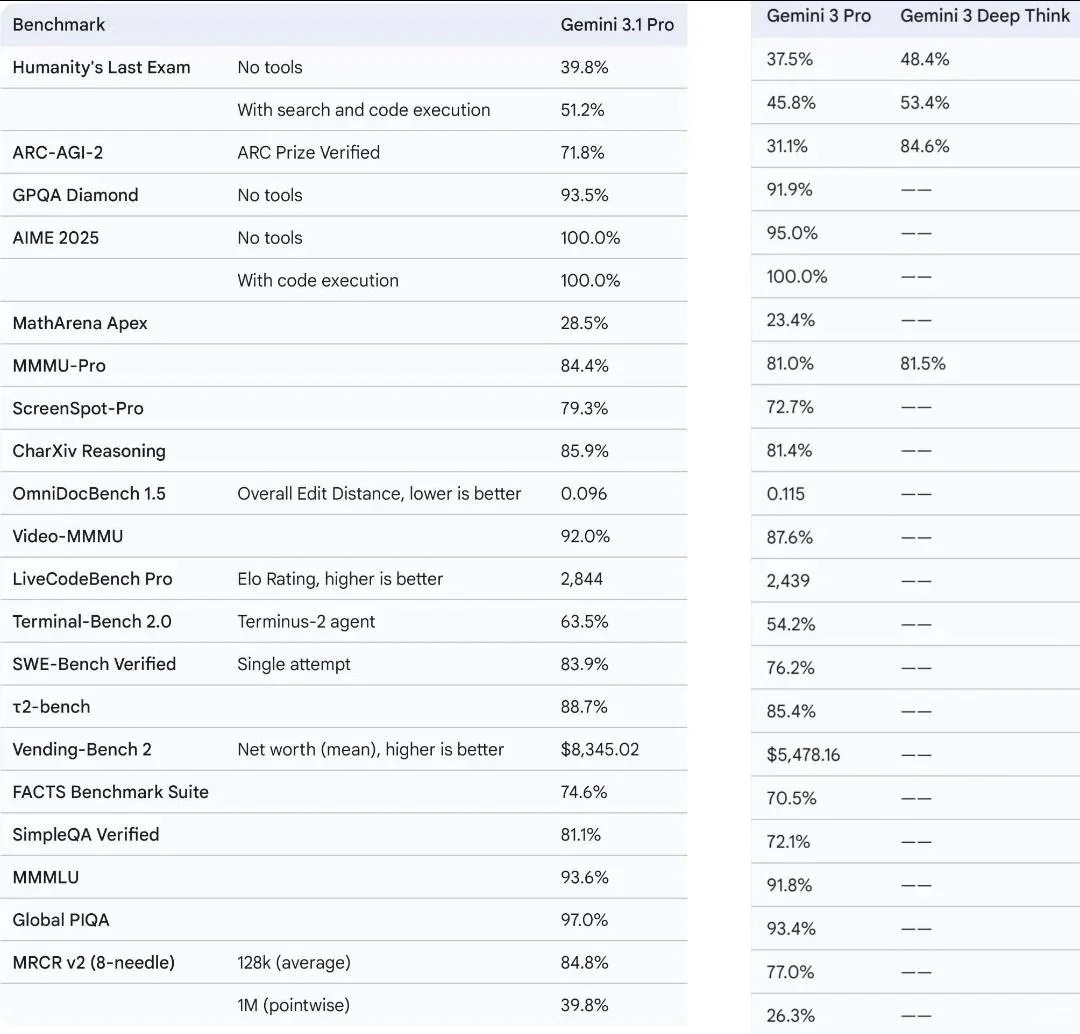

ผลทดสอบมาตรฐานของ Gemini 3.1 Pro

ผลเบนช์มาร์กของ Gemini 3.1 Pro มีดังนี้: AIME 2025: 100% (including code execution); SWE-Bench Verified: 83.9%; ARC-AGI-2: 71.8%; LiveCodeBench Pro: 2844; Elo Terminal-Bench 2.0: 63.5%; MMMLU: 93.6% สำหรับการอ้างอิง Gemini 3 Pro ทำได้ 76.2% บน SWE-Bench นี่จะเป็นก้าวกระโดดครั้งใหญ่ 84% บน SWE ถือว่าสูงมาก

เทียบกับ Gemini 3.0 pro:

จาก 23 เบนช์มาร์กที่ให้มา Gemini 3.1 Pro แสดงการปรับปรุงโดยเฉลี่ยประมาณ 17.5%

อย่างไรก็ตาม ตามที่ภาพหน้าจอแสดงไว้ “ความแตกต่าง” ที่แท้จริงอยู่ในด้านต่อไปนี้:

การปรับปรุงที่สำคัญที่สุดไม่ได้อยู่ที่ “fact-taking” แต่เป็นการให้เหตุผลที่ซับซ้อนและความเชื่อถือได้ในบริบทยาว: ARC-AGI-2 (+130.9%): นี่คือการปรับปรุงที่โดดเด่นที่สุด ARC วัดความสามารถของโมเดลในการเรียนรู้ทักษะใหม่ (fluid intelligence) ได้อย่างฉับพลัน แทนที่จะพึ่งข้อมูลที่ใช้ฝึก การเพิ่มจาก 31.1% เป็น 71.8% บ่งชี้ถึงการเปลี่ยนแปลงด้านสถาปัตยกรรมครั้งใหญ่ในวิธีที่โมเดล “คิด”

Vending-Bench 2 (+52.3%): เบนช์มาร์กนี้ติดตาม “มูลค่าสุทธิ” ของเอเจนต์ในสภาพแวดล้อม การก้าวกระโดดครั้งนี้แสดงให้เห็นว่าเวอร์ชัน 3.1 ทำได้ดีกว่ารุ่นอื่นอย่างมากในการวางแผน ดำเนินงานที่มีหลายขั้นตอน และบริหาร “เครื่องมือ” อย่างมีประสิทธิภาพ

บริบทยาว (MRCR v2 1 million points): แม้ว่าบริบทมาตรฐาน (128,000 โทเค็น) จะให้การเพิ่มประสิทธิภาพประมาณ 10% แต่การพุ่งขึ้นสูงสุดถึง 51.3% ที่ 1 ล้านโทเค็นแสดงให้เห็นว่าเวอร์ชัน 3.1 มีความเสถียรและแม่นยำยิ่งขึ้นเมื่อจัดการข้อมูลจำนวนมหาศาล

CometAPI มี Gemini 3 / 3 Pro / 3.1 ให้ใช้หรือไม่?

มี — CometAPI แสดงรายการตระกูล Gemini 3 (รายการ Gemini 3.1 Pro และสตริงชื่อโมเดลที่เกี่ยวข้อง) ในแคตตาล็อกโมเดลและข้อความการตลาดของตนอย่างเป็นสาธารณะ และแสดงเส้นทางการผสานที่เข้ากันได้กับ OpenAI (single API key + base_url) สำหรับการเรียกโมเดล CometAPI แสดงตัวอย่างที่ใช้ไคลเอนต์ OpenAI ที่ชี้ไปยัง https://api.cometapi.com/v1 และใช้ชื่อโมเดลในฟิลด์ model นั่นหมายความว่าคุณมักจะเรียกโมเดลตระกูล Google Gemini ผ่าน CometAPI ได้ด้วยโค้ดไคลเอนต์สไตล์ OpenAI ที่คุ้นเคย Gemini 3.1 pro เปิดให้ใช้แล้วผ่านมาร์เก็ตเพลสโมเดลแบบรวมศูนย์และ playground ของ CometAPI

ทีละขั้น: เช็กลิสต์เริ่มต้นอย่างรวดเร็ว

- สร้างบัญชี CometAPI และรับคีย์ API (หลายกรณี CometAPI มีคีย์ฟรี/ทดลองใช้)

- จากคอนโซลหรือแคตตาล็อกโมเดลของ CometAPI ยืนยันชื่อโมเดลที่ถูกต้อง (gemini-3.1-pro-preview)

- ใช้ endpoint ของ CometAPI ที่เข้ากันได้กับ OpenAI (

base_url) และตั้งค่าพารามิเตอร์modelเป็น alias ของโมเดลจากแคตตาล็อก - เริ่มจากพรอมต์ทดสอบ ตรวจสอบ latency/ค่าใช้จ่าย จากนั้นสเกลระบบพร้อมขีดจำกัดอัตราและการควบคุมด้านวิศวกรรม (timeouts, retry logic, streaming ฯลฯ)

ก่อนการเข้าถึง โปรดตรวจสอบว่าคุณได้เข้าสู่ระบบ CometAPI และได้รับคีย์ API แล้ว CometAPI เสนอราคาที่ต่ำกว่าราคาทางการมากเพื่อช่วยให้คุณผสานได้สะดวกขึ้น

พร้อมเริ่มหรือยัง?→ สมัครใช้ Gemini 3.1 pro วันนี้เลย !

หากต้องการเคล็ดลับ คู่มือ และข่าวสารเกี่ยวกับ AI เพิ่มเติม ติดตามเราได้บน VK, X และ Discord!