Google DeepMind เปิดตัวอย่างเป็นทางการ Gemma 4 เมื่อวันที่ 2 เมษายน 2026 ถือเป็นหมุดหมายสำคัญของวงการ AI แบบโอเพ่นซอร์ส ตระกูลโมเดลนี้มอบสติปัญญาระดับแนวหน้าเมื่อเทียบต่อจำนวนพารามิเตอร์ โดยต่อยอดจากงานวิจัยและเทคโนโลยีเดียวกับ Gemini 3 ที่ขับเคลื่อนอยู่ แตกต่างจาก Gemma รุ่นก่อนที่ใช้ไลเซนส์แบบกำหนดเอง Gemma 4 มาพร้อมไลเซนส์แบบเปิดกว้างอย่างเต็มรูปแบบ Apache 2.0 เปิดทางให้ใช้งานเชิงพาณิชย์ ปรับแก้ และเผยแพร่ต่อได้อย่างไร้ข้อจำกัด

Gemma 4 โดดเด่นด้านความสามารถมัลติโมดัล (อินพุตข้อความ + รูปภาพในทุกรุ่น และเสียงในรุ่นเอดจ์), รองรับการให้เหตุผลและเวิร์กโฟลว์เชิงเอเจนต์แบบเนทีฟ, หน้าต่างบริบทยาวสูงสุด 256K โทเคน และปรับแต่งเพื่อให้ทำงานได้ตั้งแต่สมาร์ทโฟนและ Raspberry Pi ไปจนถึง GPU ระดับไฮเอนด์ รองรับกว่า 140 ภาษาและเน้นประสิทธิภาพ ทำให้ AI ทรงพลังเข้าถึงได้บนฮาร์ดแวร์ผู้ใช้และอุปกรณ์เอดจ์โดยไม่ต้องพึ่งพาคลาวด์

CometAPI มี API สำหรับโมเดลโอเพ่นซอร์สและแบบปิดคุณภาพเยี่ยม

What Is Gemma 4?

Gemma 4 คือครอบครัวล่าสุดของโมเดลภาษาขนาดใหญ่แบบมัลติโมดัลแบบเปิดจาก Google DeepMind ออกแบบมาเพื่อการให้เหตุผลขั้นสูง เวิร์กโฟลว์ AI เชิงเอเจนต์ และการปรับใช้บนอุปกรณ์อย่างมีประสิทธิภาพ ใช้ทรัพยากรให้เกิด “ความฉลาดต่อพารามิเตอร์” สูงสุด โดยอาศัยองค์ความรู้จากงานวิจัย Gemini 3 ที่เป็นกรรมสิทธิ์ ขณะเดียวกันยังคงเป็นโอเพ่นเวทและโอเพ่นซอร์สอย่างเต็มรูปแบบ

ความก้าวหน้าสำคัญเหนือ Gemma รุ่นก่อนประกอบด้วย:

- มัลติโมดัลแบบเนทีฟ: เข้าใจข้อความ + รูปภาพ (ทุกรุ่น) พร้อมรองรับเสียงในรุ่นเอดจ์ขนาดเล็ก

- โหมดการคิดที่ปรับตั้งได้: ให้เหตุผลทีละขั้น พร้อมเอาต์พุตแบบมีโครงสร้าง <|think|>

- การเรียกใช้ฟังก์ชันและการใช้เครื่องมือแบบเนทีฟ: เหมาะอย่างยิ่งสำหรับเอเจนต์อัตโนมัติ

- บริบทขยาย: สูงสุด 256K โทเคนในรุ่นขนาดใหญ่

- สถาปัตยกรรม attention แบบไฮบริด: ผสาน local sliding-window และ global attention เพื่อประสิทธิภาพและสมรรถนะบริบทยาว

- Per-Layer Embeddings (PLE) ในรุ่นเล็ก และ KV cache แบบแชร์ร่วมเพื่อลดหน่วยความจำ

- รองรับหลายภาษากว้างขวาง: พรีเทรนบนข้อมูลมากกว่า 140 ภาษา พร้อมความตระหนักเชิงวัฒนธรรม

การปล่อยภายใต้ Apache 2.0 ช่วยขจัดข้อจำกัดด้านไลเซนส์ก่อนหน้า ที่เคยเป็นอุปสรรคต่อการใช้งานในองค์กร นักพัฒนาสามารถปรับจูน ติดตั้ง และทำเชิงพาณิชย์ได้อย่างไร้แรงเสียดทาน—ส่งให้เป็นคู่แข่งโดยตรงกับระบบเปิดเต็มรูปแบบอย่าง Llama และ Qwen

Gemma 4 มุ่งเป้าฮาร์ดแวร์ที่หลากหลาย: อุปกรณ์เอดจ์ (โทรศัพท์, IoT, Raspberry Pi, Jetson Nano) เพื่อ AI ออฟไลน์แบบหน่วงต่ำ และเวิร์กสเตชัน/GPU เพื่อเซิร์ฟเวอร์โลคัลสมรรถนะสูง แนวคิดแบบ “local-first” ให้ความสำคัญกับความเป็นส่วนตัว ต้นทุน และการอนุมานหน่วงเวลาเป็นศูนย์

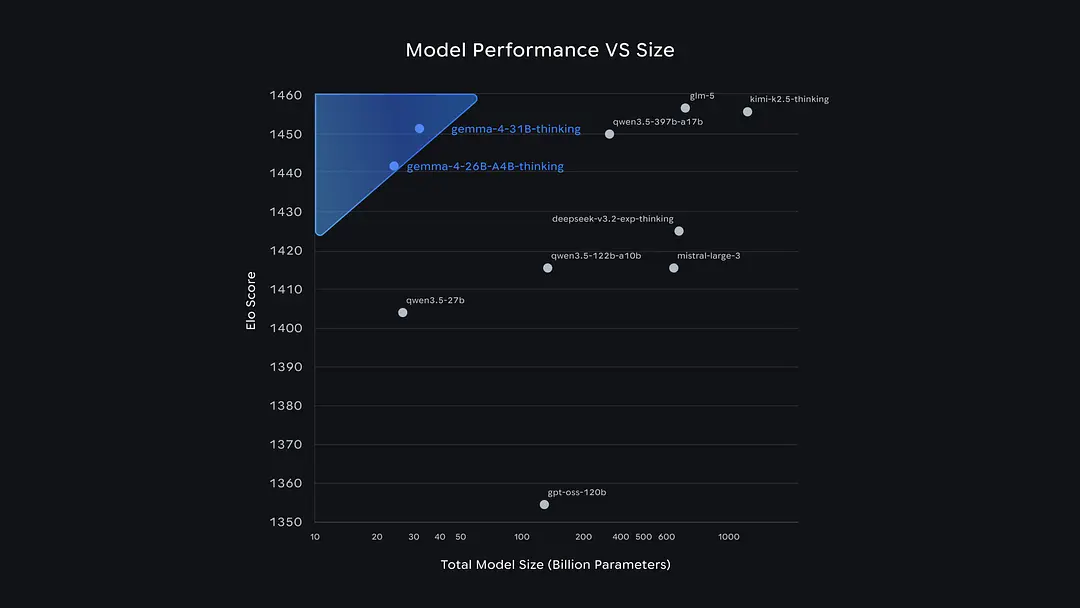

โมเดลโอเพ่นซอร์สที่ได้อันดับเหนือกว่าในกระดาน Arena ส่วนใหญ่เป็นทีมจากจีน Gemma 4 ไม่ต่างจาก Qwen 3.5 และ GLM-5 มากนัก แต่แตกต่างอย่างมีนัยสำคัญจาก GPT-OSS-120B ของ OpenAI

ตอนนี้นักพัฒนาสามารถค้นหา GLM-5, Qwen 3.5 เป็นต้น ได้บน CometAPI

The Four Versions of Gemma 4

Google เปิดตัว Gemma 4 สี่ขนาดที่ปรับแต่งมาอย่างพิถีพิถัน โดยสมดุลระหว่างสมรรถนะ ประสิทธิภาพ และสถานการณ์ใช้งาน สองรุ่นใช้สถาปัตยกรรม dense พร้อม Per-Layer Embeddings (PLE) เชิงนวัตกรรมเพื่อประสิทธิภาพบนเอดจ์; อีกรุ่นเป็น Mixture-of-Experts (MoE) เพื่อสมรรถนะสูงที่ต้นทุนพารามิเตอร์ทำงานต่ำ; และอีกรุ่นเป็นธงระดับสูงแบบ dense

| Model | Architecture | Total Params | Active Params (MoE) | Effective Params | Context Length | Modalities | Target Hardware |

|---|---|---|---|---|---|---|---|

| Gemma 4 E2B | Dense + PLE | ~5.1B (incl. embeddings) | N/A | 2.3B | 128K | Text, Image, Audio | Smartphones, Raspberry Pi, edge IoT |

| Gemma 4 E4B | Dense + PLE | ~8B (incl. embeddings) | N/A | 4.5B | 128K | Text, Image, Audio | Mobile devices, lightweight GPUs, Jetson |

| Gemma 4 26B A4B | MoE (8 active / 128 total + 1 shared) | 25.2B | 3.8B–4B | N/A | 256K | Text, Image | Workstations, consumer GPUs, local servers |

| Gemma 4 31B | Dense | 30.7B | N/A | N/A | 256K | Text, Image | High-end GPUs (fits on single H100/A100 in FP16) |

Gemma 4 E2B และ E4B (ปรับแต่งเพื่อเอดจ์): ใช้ PLE เพื่อเพิ่มความเชี่ยวชาญรายเลเยอร์โดยแทบไม่เพิ่มพารามิเตอร์ เหมาะสำหรับอุปกรณ์ที่ใช้แบตเตอรี่หรือหน่วยความจำจำกัด ตัวเข้ารหัสเสียง (USM-style Conformer, ~300M params) รองรับการถอดเสียงและการแปลคำพูดเป็นข้อความ

Gemma 4 26B A4B (MoE): เปิดใช้งานเพียง ~4B พารามิเตอร์ระหว่างอนุมาน แม้มียอดรวมกว่า 25B ให้สมรรถนะใกล้เคียง 31B ที่ต้นทุนคอมพิวต์ต่ำกว่ามาก—เหมาะกับการสเกลแบบคุ้มค่า

Gemma 4 31B (Dense): รุ่นธงเพื่อขีดความสามารถสูงสุด รันได้บน GPU 80GB ตัวเดียวในความละเอียดเต็ม และติดอันดับท็อปในหมู่โมเดลเปิดบนลีดเดอร์บอร์ด

ทุกรุ่นมีเวอร์ชันปรับจูนด้วยคำสั่ง (“-it”) ที่เหมาะกับแชต การให้เหตุผล และการใช้เครื่องมือ รวมถึงรุ่นฐานที่พรีเทรนสำหรับการปรับจูนต่อ รุ่นใหญ่สองรุ่นเดินคนละแนวทาง: รุ่น 31B แบบ Dense มุ่งคุณภาพสูงสุด เหมาะเป็นฐานสำหรับการปรับจูน ส่วนรุ่น 26B แบบ MoE ให้ความเร็วเป็นหลัก เปิดใช้งานเพียง 3.8 พันล้านพารามิเตอร์ระหว่างอนุมาน ทำให้สร้างคำได้เร็วกว่ามาก แต่คุณภาพโดยรวมต่ำกว่僅เล็กน้อย

สองรุ่นเล็ก E2B และ E4B ออกแบบเฉพาะสำหรับโทรศัพท์และอุปกรณ์ IoT: สามารถทำงานออฟไลน์ได้เต็มรูปแบบ ประหยัดหน่วยความจำและพลังงาน นอกจากนี้ยังมีความสามารถที่รุ่นใหญ่ไม่มี: อินพุตเสียงแบบเนทีฟ รองรับการรู้จำคำพูดโดยตรง

Core Capabilities of Gemma 4

Gemma 4 โดดเด่นในด้านที่สำคัญต่อการใช้งาน AI ในโลกจริง:

1. Advanced Reasoning & Thinking Mode

การให้เหตุผลทีละขั้นที่ปรับตั้งได้ผ่าน system prompt หรือ enable_thinking=True ให้เอาต์พุตแท็กแบบมีโครงสร้าง <|think|> ตามด้วยคำตอบสุดท้าย ช่วยยกระดับสมรรถนะงานซับซ้อนได้อย่างมากโดยไม่ต้องปรับจูนเพิ่ม

2. Multimodal Understanding

- วิสัยทัศน์: การตรวจจับวัตถุ (กรอบกำหนดเขตแบบ JSON), OCR (หลายภาษา), การแยกวิเคราะห์เอกสาร/PDF, ความเข้าใจชาร์ต, ความเข้าใจ UI, การรู้จำลายมือ และการจัดการภาพหลายความละเอียด (งบประมาณโทเคน: 70–1120 โทเคน)

- วิดีโอ: สูงสุด 60 วินาที (ประมวลผลเฟรม 1 fps)

- เสียง (เฉพาะ E2B/E4B): การรู้จำคำพูดอัตโนมัติ (ASR) และการแปลคำพูดเป็นข้อความ (สูงสุด 30 วินาที)

- อินพุตสลับสื่อ: ผสมข้อความ รูปภาพ และเสียงในลำดับใดก็ได้

3. Agentic Workflows & Function Calling

การรองรับเครื่องมือแบบเนทีฟ ช่วยสร้างเอเจนต์อัตโนมัติสำหรับการวางแผนหลายขั้น การเรียก API การนำทางแอป และการทำงานให้เสร็จสิ้น แข็งแกร่งบน τ2-bench (การใช้เครื่องมือเชิงเอเจนต์)

4. Coding & Developer Tools

โดดเด่นด้านการสร้างโค้ด เติมโค้ด ดีบัก และความเข้าใจในระดับรีโพซิทอรี รองรับเอาต์พุตแบบ JSON เพื่อการเชื่อมต่อที่ไร้รอยต่อ ทำคะแนน 80.0% (31B) บน LiveCodeBench v6 เหมาะเป็นผู้ช่วยเขียนโปรแกรมแบบ local-first สำหรับสถานการณ์พัฒนาแบบออฟไลน์

5. Long-Context & Multilingual

จัดการบริบท 128K–256K โทเคนได้อย่างเชื่อถือได้ (ทดสอบบน MRCR needle-in-haystack) พรีเทรนบนข้อมูลหลากหลายจนถึงเส้นตัดมกราคม 2025 พร้อมสมรรถนะข้ามภาษาที่แข็งแกร่ง ไม่ใช่แค่การแปลหลายภาษา แต่ได้รับการฝึกแบบเนทีฟครอบคลุมกว่า 140 ภาษา

Benchmark Data: Gemma 4 Performance Breakdown

Gemma 4 ยกระดับมาตรฐานใหม่สำหรับโมเดลเปิด รุ่น 31B และ 26B ทำคะแนนในระดับที่เคยเป็นของระบบปิดขนาดใหญ่มาก ขณะที่รุ่นเอดจ์ทำผลงานเหนือ Gemma 3 รุ่นใหญ่ก่อนหน้า

ผลลัพธ์เบนช์มาร์กเต็ม (โมเดลปรับจูนคำสั่ง)

| Benchmark | Category | Gemma 4 31B | Gemma 4 26B A4B | Gemma 4 E4B | Gemma 4 E2B | Gemma 3 27B (ไม่ใช้โหมด think) |

|---|---|---|---|---|---|---|

| MMLU Pro | Reasoning & Knowledge | 85.2% | 82.6% | 69.4% | 60.0% | 67.6% |

| AIME 2026 (no tools) | Math | 89.2% | 88.3% | 42.5% | 37.5% | 20.8% |

| GPQA Diamond | Graduate-level Science | 84.3% | 82.3% | 58.6% | 43.4% | 42.4% |

| Tau2 (avg) | Agentic Tool Use | 76.9% | 68.2% | 42.2% | 24.5% | 16.2% |

| LiveCodeBench v6 | Coding | 80.0% | 77.1% | 52.0% | 44.0% | 29.1% |

| Codeforces ELO | Competitive Coding | 2150 | 1718 | 940 | 633 | 110 |

| MMMU Pro | Multimodal Reasoning | 76.9% | 73.8% | 52.6% | 44.2% | 49.7% |

| MATH-Vision | Math + Vision | 85.6% | 82.4% | 59.5% | 52.4% | 46.0% |

| MRCR v2 (8-needle, 128K) | Long Context | 66.4% | 44.1% | 25.4% | 19.1% | 13.5% |

ประเด็นสำคัญ:

- ก้าวกระโดดจาก Gemma 3: รุ่น 31B เพิ่มคะแนน AIME คณิตจาก 20.8% เป็น 89.2% และ LiveCodeBench จาก 29.1% เป็น 80.0%

- ประสิทธิภาพ MoE: รุ่น 26B A4B ใกล้เคียง 31B ในขณะที่ใช้คอมพิวต์ระหว่างอนุมานน้อยกว่ามาก

- เหนือชั้นบนเอดจ์: E4B และ E2B แซง Gemma 3 27B ในหลายมิเตอร์ แม้เล็กกว่าถึง 6–10 เท่า

- อันดับบนลีดเดอร์บอร์ด: 31B ได้ประมาณ ~1452 บน Arena AI (ข้อความ); 26B A4B ~1441 รุ่น 26B มีรายงานว่าทำได้ดีกว่าโมเดลขนาดใหญ่มากอย่าง Qwen 3.5 397B ในความชอบผู้ใช้และการเขียนโค้ด

เบนช์มาร์กด้านวิสัยทัศน์และเสียงยืนยันสมรรถนะมัลติโมดัลที่แข็งแกร่งตั้งแต่แกะกล่อง โดยไม่ต้องปรับจูนเฉพาะทาง

Ecosystem and Tool Support

Gemma 4 ได้รับการผนวกรวมเข้าระบบนิเวศอย่างกว้างขวางทันที:

- Hugging Face: รองรับวันแรกด้วย

transformers,pipeline("any-to-any"), GGUF, ONNX และตัวประมวลผลมัลติโมดัล - รันไทม์โลคัล: Ollama, Llama.cpp (LM Studio, Jan), MLX (Apple Silicon พร้อม TurboQuant), Mistral.rs (Rust), Transformers.js (อนุมานในเบราว์เซอร์ผ่าน WebGPU)

- การปรับจูน: TRL, Unsloth, PEFT, Vertex AI และรองรับชุดข้อมูลมัลติโมดัลเต็มรูปแบบ

- การปรับแต่งสำหรับฮาร์ดแวร์: NVIDIA RTX/DGX, Spark/Jetson (ผ่าน TensorRT-LLM), Google AI Edge tools และการปรับใช้บนอุปกรณ์ Android/iOS

- เฟรมเวิร์กเอเจนต์: OpenClaw, Hermes, Pi และการทดสอบในจำลอง CARLA

- คลาวด์/สตูดิโอ: Google AI Studio สำหรับทดสอบอย่างรวดเร็ว; Kaggle Models สำหรับดาวน์โหลด

ระบบนิเวศนี้ทำให้ Gemma 4 พร้อมใช้งานในไม่กี่นาทีบนแล็ปท็อป เซิร์ฟเวอร์ หรืออุปกรณ์เอดจ์

ข้อจำกัดและความปลอดภัย:

- เส้นตัดข้อมูลฝึก: มกราคม 2025 (ไม่มีความรู้เรียลไทม์หากไม่ใช้เครื่องมือ)

- เสียงจำกัดเฉพาะคำพูด (ไม่รวมดนตรี); วิดีโอจำกัดที่ 60 วินาที

- ยังมีความเสี่ยงเรื่องหลอนข้อมูล—ใช้โหมดคิดและการยืนยันผล

- ความปลอดภัย: คัดกรองและประเมินอย่างเข้มตาม Google AI Principles; นักพัฒนาควรเพิ่มกลไกป้องกันตามแอปพลิเคชัน

Why Gemma 4 Matters in 2026

Gemma 4 ทำให้ AI ระดับแนวหน้ากลายเป็นของสาธารณะจริง ๆ ด้วยการผสานสติปัญญาแบบมัลติโมดัล ความสามารถเชิงเอเจนต์ และอิสระตาม Apache 2.0 เข้ากับประสิทธิภาพที่ไม่ยึดติดฮาร์ดแวร์ ทำให้นักพัฒนาและองค์กรสร้างโซลูชัน AI ที่ปลอดภัย เป็นส่วนตัว และคุ้มค่าได้ในสเกลใหญ่ ความก้าวหน้าเรื่อง “ความฉลาดต่อพารามิเตอร์”—เด่นชัดในรุ่นเอดจ์ที่ทำได้ดีกว่ารุ่นธงแบบเปิดของเมื่อวาน—คือสัญญาณว่า AI กำลังก้าวสู่ความแพร่หลายอย่างแท้จริง

ไม่ว่าจะรันโมเดลขนาด 2B บนโทรศัพท์ หรือรุ่น 31B ที่ทรงพลังในเครื่องโลคัล Gemma 4 พิสูจน์ว่า AI แบบโอเพ่นซอร์สทัดเทียม (และในหลายกรณีเหนือกว่า) ทางเลือกแบบปิดในแง่การใช้งานจริง