ณวันที่ 15 ธันวาคม 2025 ข้อเท็จจริงสาธารณะชี้ว่า Google’s Gemini 3 Pro (preview) และ OpenAI’s GPT-5.2 ต่างยกระดับแนวหน้าด้านการให้เหตุผล มัลติโหมด และงานบริบทยาว — แต่ใช้แนวทางวิศวกรรมต่างกัน (Gemini → sparse MoE + บริบทขนาดมหึมา; GPT-5.2 → ดีไซน์แบบ dense/“routing”, compaction และโหมดให้เหตุผลระดับ x-high) จึงมีการแลกเปลี่ยนระหว่างการชนะชุดทดสอบสูงสุด กับความคาดการณ์ได้ด้านวิศวกรรม เครื่องมือ และระบบนิเวศ ว่าอะไร “ดีกว่า” ขึ้นอยู่กับความต้องการหลักของคุณ: แอปพลิเคชันเชิงเอเจนต์ที่ต้องการบริบทสุดขั้วและมัลติโหมด เอนเอียงไปทาง Gemini 3 Pro; เครื่องมือสำหรับนักพัฒนาองค์กรที่เสถียร ต้นทุนคาดการณ์ได้ และความพร้อมใช้งาน API ทันที เหมาะกับ GPT-5.2

GPT-5.2 คืออะไร และคุณสมบัติหลักคืออะไร?

GPT-5.2 คือรุ่นวันที่ 11 ธันวาคม 2025 ในตระกูล GPT-5 (มีรุ่น: Instant, Thinking, Pro) ถูกวางตำแหน่งให้เป็นโมเดลที่ทรงพลังที่สุดของบริษัทสำหรับ “งานความรู้ระดับมืออาชีพ” — เพิ่มประสิทธิภาพสำหรับสเปรดชีต งานพรีเซนเทชัน การให้เหตุผลกับบริบทยาว การเรียกใช้เครื่องมือ การสร้างโค้ด และงานด้านภาพ OpenAI ทำให้ GPT-5.2 พร้อมใช้งานสำหรับผู้ใช้ ChatGPT แบบชำระเงินและผ่าน OpenAI API (Responses API / Chat Completions) ภายใต้ชื่อโมเดลเช่น gpt-5.2, gpt-5.2-chat-latest และ gpt-5.2-pro

รุ่นของโมเดลและการใช้งานที่ตั้งใจไว้

- gpt-5.2 / GPT-5.2 (Thinking) — เหมาะที่สุดสำหรับการให้เหตุผลที่ซับซ้อนหลายขั้น (ตัวเลือกเริ่มต้นของตระกูล “Thinking” ที่ใช้ใน Responses API)

- gpt-5.2-chat-latest / Instant — ผู้ช่วยและแชตประจำวันแบบหน่วงต่ำ

- gpt-5.2-pro / Pro — ความเที่ยงตรง/ความน่าเชื่อถือสูงสุดสำหรับปัญหาที่ยากที่สุด (ใช้คอมพิวต์เพิ่ม รองรับ

reasoning_effort: "xhigh")

คุณสมบัติทางเทคนิคสำคัญ (เชิงผู้ใช้)

- การมองเห็น & มัลติโหมดที่พัฒนาขึ้น — การให้เหตุผลเชิงพื้นที่บนภาพดีขึ้นและความเข้าใจวิดีโอที่ดีขึ้นเมื่อจับคู่กับเครื่องมือโค้ด (Python tool) รวมถึงการรองรับเครื่องมือสไตล์ code-interpreter สำหรับรันโค้ดสั้นๆ

- ปรับระดับความพยายามในการให้เหตุผลได้ (

reasoning_effort: none|minimal|low|medium|high|xhigh) เพื่อแลกหน่วง/ต้นทุนกับความลึกxhighเป็นของใหม่ใน GPT-5.2 (และรองรับบน Pro) - การจัดการบริบทยาวที่พัฒนาขึ้น และคุณสมบัติ compaction เพื่อให้เหตุผลข้ามข้อความหลายแสนโทเค็น (OpenAI รายงานผลลัพธ์ MRCRv2/เมตริกบริบทยาวที่แข็งแกร่ง)

- การเรียกใช้เครื่องมือขั้นสูง & เวิร์กโฟลว์เชิงเอเจนต์ — การประสานงานหลายเทิร์นที่แข็งแกร่งขึ้น การออร์เคสเตรตเครื่องมือในสถาปัตยกรรมแบบ “mega-agent เดียว” (OpenAI เน้นผล Tau2-bench ของการใช้เครื่องมือ)

Gemini 3 Pro Preview คืออะไร?

Gemini 3 Pro Preview คือโมเดล AI สร้างสรรค์ที่ล้ำหน้าที่สุดของ Google เปิดตัวเป็นส่วนหนึ่งของตระกูล Gemini 3 ในเดือนพฤศจิกายน 2025 โมเดลเน้น ความเข้าใจแบบมัลติโหมด — สามารถทำความเข้าใจและสังเคราะห์ข้อความ รูปภาพ วิดีโอ และเสียง — และมีหน้าต่างบริบทขนาดใหญ่ (~1 ล้านโทเค็น) เพื่อจัดการเอกสารหรือโค้ดเบสขนาดใหญ่

Google วางตำแหน่ง Gemini 3 Pro ว่าเป็นสุดยอดใน ความลึกและความละเอียดอ่อนของการให้เหตุผล และเป็นแกนกลางให้กับเครื่องมือสำหรับนักพัฒนาและองค์กรหลายตัว รวมถึง Google AI Studio, Vertex AI และแพลตฟอร์มพัฒนาเชิงเอเจนต์ อย่าง Google Antigravity

ขณะนี้ Gemini 3 Pro อยู่ใน preview — หมายถึงฟังก์ชันและการเข้าถึงยังขยายต่อเนื่อง แต่โมเดลก็ทำคะแนนสูงในด้านตรรกะ ความเข้าใจมัลติโหมด และเวิร์กโฟลว์เชิงเอเจนต์แล้ว

คุณสมบัติทางเทคนิค & ผลิตภัณฑ์หลัก

- Context window: Gemini 3 Pro Preview รองรับ อินพุต 1,000,000 โทเค็น (และเอาต์พุตสูงสุด 64k โทเค็น) ซึ่งเป็นข้อได้เปรียบสำคัญเชิงปฏิบัติสำหรับการป้อนเอกสารขนาดใหญ่มาก หนังสือ หรือทรานสคริปต์วิดีโอในการเรียกครั้งเดียว

- คุณสมบัติ API: พารามิเตอร์

thinking_level(low/high) เพื่อแลกหน่วงกับความลึกในการให้เหตุผล; การตั้งค่าmedia_resolutionเพื่อควบคุมความละเอียดมัลติโหมดและการใช้โทเค็น; รองรับการยึดโยงด้วยการค้นหา (search grounding), บริบทไฟล์/URL, การรันโค้ด และการเรียกฟังก์ชัน Thought signatures และ context caching ช่วยคงสถานะข้ามหลายคอลล์ - โหมด Deep Think / การให้เหตุผลที่สูงกว่า: ตัวเลือก “Deep Think” เพิ่มรอบการให้เหตุผลเพื่อดันคะแนนในโจทย์ยาก Google เผยแพร่ Deep Think เป็นเส้นทางประสิทธิภาพสูงแยกต่างหากสำหรับปัญหาซับซ้อน

- การรองรับมัลติโหมดแบบ native: อินพุตข้อความ รูปภาพ เสียง และวิดีโอ พร้อมการยึดโยงกับการค้นหาและผลิตภัณฑ์ของ Google (เน้นคะแนน Video-MMMU และบัลลังก์มัลติโหมดอื่นๆ)

พรีวิวด่วน — GPT-5.2 vs Gemini 3 Pro

ตารางเปรียบเทียบกะทัดรัดพร้อมข้อเท็จจริงสำคัญ (มีอ้างอิงแหล่งที่มา)

| Aspect | GPT-5.2 (OpenAI) | Gemini 3 Pro (Google / DeepMind) |

|---|---|---|

| Vendor / positioning | OpenAI — รุ่นเรือธง GPT-5.x ที่โฟกัสงานความรู้ระดับมืออาชีพ การโค้ด และเวิร์กโฟลว์เชิงเอเจนต์ | Google DeepMind / Google AI — รุ่นเรือธงในตระกูล Gemini ที่โฟกัสการให้เหตุผลมัลติโหมดและบริบทยาวพิเศษ พร้อมการผสานเครื่องมือ |

| Main model flavors | Instant, Thinking, Pro (และสลับ Auto ระหว่างรุ่นเหล่านี้) Pro เพิ่มระดับการให้เหตุผลที่สูงกว่า | ตระกูล Gemini 3 รวม Gemini 3 Pro และโหมด Deep-Think; เน้นมัลติโหมด/เชิงเอเจนต์ |

| Context window (input / output) | ความจุอินพุตรวม ~400,000 โทเค็น; เอาต์พุต/โทเค็นให้เหตุผลได้สูงสุด 128,000 (ออกแบบมาสำหรับเอกสาร & โค้ดเบสยาวมาก) | อินพุตสูงสุด ~1,000,000 โทเค็น (1M) พร้อมเอาต์พุตสูงสุด 64K โทเค็น |

| Key strengths / focus | การให้เหตุผลกับบริบทยาว การเรียกใช้เครื่องมือเชิงเอเจนต์ การโค้ด งานโครงสร้างในที่ทำงาน (สเปรดชีต พรีเซนต์); อัปเดตด้านความปลอดภัย/ระบบการ์ดเน้นความเชื่อถือได้ | ความเข้าใจมัลติโหมดที่สเกลใหญ่ การให้เหตุผล + การคอมโพสภาพ บริบทขนาดใหญ่มาก + โหมด “Deep Think” การให้เหตุผลสูง การผสานเครื่องมือ/เอเจนต์แน่นกับระบบนิเวศ Google |

| Multimodal & image capabilities | การมองเห็นและการยึดโยงมัลติโหมดที่พัฒนาขึ้น; ปรับจูนเพื่อการใช้เครื่องมือและวิเคราะห์เอกสาร | การสร้างภาพความละเอียดสูง + การคอมโพสที่เสริมการให้เหตุผล การแก้ไขภาพแบบอ้างอิงหลายภาพ และการแสดงตัวอักษรที่อ่านชัดเจน |

| Latency / interactivity | ผู้ให้บริการเน้นการตอบสนองอนุมานและพรอมป์ตที่เร็วขึ้น (หน่วงต่ำกว่า GPT-5.x รุ่นก่อน); หลายชั้นบริการ (Instant / Thinking / Pro) | Google เน้นการเสิร์ฟแบบ “Flash”/การให้บริการที่เหมาะสม และความเร็วเชิงโต้ตอบที่ใกล้เคียงสำหรับหลายโฟลว์; โหมด Deep Think แลกหน่วงเพิ่มกับการให้เหตุผลลึก |

| Notable features / differentiators | ระดับความพยายามในการให้เหตุผล (medium/high/xhigh) การเรียกใช้เครื่องมือที่พัฒนาขึ้น การสร้างโค้ดคุณภาพสูง ประสิทธิภาพโทเค็นสูงสำหรับเวิร์กโฟลว์องค์กร | บริบทยาว 1M โทเค็น การรับมัลติโหมดแบบ native (วิดีโอ/เสียง) โหมดการให้เหตุผล “Deep Think” การผสานครอบจักรวาลผลิตภัณฑ์ Google (Docs/Drive/NotebookLM) |

| Typical best uses (short) | วิเคราะห์เอกสารยาว เวิร์กโฟลว์เชิงเอเจนต์ โปรเจกต์โค้ดซับซ้อน ระบบอัตโนมัติในองค์กร (สเปรดชีต/รายงาน) | โปรเจกต์มัลติโหมดขนาดใหญ่มาก เวิร์กโฟลว์เชิงเอเจนต์ระยะยาวที่ต้องการบริบท 1M โทเค็น ไปป์ไลน์ภาพ + การให้เหตุผลขั้นสูง |

GPT-5.2 และ Gemini 3 Pro เปรียบเทียบกันอย่างไรในเชิงสถาปัตยกรรม?

แกนสถาปัตยกรรม

- บัลลังก์/การประเมินงานจริง: GPT-5.2 Thinking ชนะ/เสมอ 70.9% บน GDPval (การประเมินงานความรู้ 44 อาชีพ) และพุ่งขึ้นมากบนบัลลังก์วิศวกรรมและคณิตเทียบกับ GPT-5 รุ่นก่อน ดีขึ้นมากในการโค้ด (SWE-Bench Pro) และคำถามวิทยาศาสตร์เชิงโดเมน (GPQA Diamond)

- เครื่องมือ & เอเจนต์: มีการรองรับการเรียกใช้เครื่องมือ การรัน Python และเวิร์กโฟลว์เชิงเอเจนต์ (ค้นหาเอกสาร วิเคราะห์ไฟล์ เอเจนต์ด้านข้อมูล) ที่แข็งแกร่งขึ้น 11 เท่าเร็วขึ้น / <1% ของต้นทุนเมื่อเทียบผู้เชี่ยวชาญมนุษย์สำหรับบางงานใน GDPval (ตัวชี้วัดคุณค่าทางเศรษฐกิจที่อาจเกิดขึ้น, 70.9% เทียบกับเดิม ~38.8%) และมีพัฒนาการเชิงรูปธรรมในงานสร้างแบบจำลองสเปรดชีต (เช่น +9.3% ในงาน investment banking ระดับ junior เทียบ GPT-5.1)

- Gemini 3 Pro: Transformer แบบ Sparse Mixture-of-Experts (MoE) โมเดลเปิดใช้งานผู้เชี่ยวชาญเพียงบางส่วนต่อโทเค็น ทำให้มีความจุพารามิเตอร์รวมที่ใหญ่มากด้วยคอมพิวต์ต่อโทเค็นที่เติบโตไม่เป็นเส้นตรง Google เผยใน model card ว่า Sparse MoE เป็นตัวขับเคลื่อนหลักของโปรไฟล์ประสิทธิภาพแบบใหม่ สถาปัตยกรรมนี้ทำให้ดันความจุโมเดลสูงขึ้นได้โดยไม่เพิ่มต้นทุนอนุมานแบบเชิงเส้น

- GPT-5.2 (OpenAI): OpenAI ยังคงใช้สถาปัตยกรรม Transformer พร้อมกลยุทธ์ routing/compaction ในตระกูล GPT-5 (มี “router” กระตุ้นโหมดต่างๆ — Instant vs Thinking — และบริษัทอธิบายเทคนิค compaction และจัดการโทเค็นสำหรับบริบทยาว) GPT-5.2 เน้นการฝึกและประเมินเพื่อ “คิดก่อนตอบ” และ compaction สำหรับงานระยะยาว มากกว่าการประกาศใช้ sparse-MoE แบบดั้งเดิมในสเกลใหญ่

นัยสำคัญจากสถาปัตยกรรม

- การแลกหน่วง & ต้นทุน: โมเดล MoE อย่าง Gemini 3 Pro อาจให้ ศักยภาพต่อโทเค็นสูงกว่า ขณะคงต้นทุนอนุมานให้ต่ำได้ในหลายงาน เพราะรันผู้เชี่ยวชาญเพียงบางส่วน อย่างไรก็ดีอาจเพิ่มความซับซ้อนของการให้บริการและการจัดสรร (การบาลานซ์ผู้เชี่ยวชาญ, IO) แนวทางของ GPT-5.2 (dense/ราวต์พร้อม compaction) ให้หน่วงที่คาดการณ์ได้และเหมาะกับประสบการณ์นักพัฒนา โดยเฉพาะเมื่อรวมกับเครื่องมือ OpenAI อย่าง Responses, Realtime, Assistants และ batch APIs

- การสเกลบริบทยาว: ความสามารถอินพุต 1M โทเค็นของ Gemini ช่วยให้ป้อนเอกสารและสตรีมมัลติโหมดที่ยาวมากๆ ได้แบบ native ความจุรวมของ GPT-5.2 (~400k อินพุต+เอาต์พุต) ก็ใหญ่มากและครอบคลุมความต้องการขององค์กรส่วนใหญ่ แต่เล็กกว่า 1M ของ Gemini สำหรับคลังข้อมูลมหาศาลหรือทรานสคริปต์วิดีโอหลายชั่วโมง สเปคของ Gemini ให้ข้อได้เปรียบชัดเจน

เครื่องมือ เอเจนต์ และโครงสร้างมัลติโหมด

- OpenAI: ผสานลึกสำหรับการเรียกใช้เครื่องมือ การรัน Python โหมดให้เหตุผลระดับ “Pro” และระบบนิเวศเอเจนต์แบบชำระเงิน (ChatGPT Agents / การผสานเครื่องมือองค์กร) โฟกัสหนักที่เวิร์กโฟลว์ที่เน้นโค้ดและการสร้างสเปรดชีต/สไลด์เป็นเอาต์พุตชั้นหนึ่ง

- Google / Gemini: มีการยึดโยงกับ Google Search (ฟีเจอร์คิดค่าใช้จ่ายแบบเลือกใช้), การรันโค้ด, บริบท URL และไฟล์ พร้อมตัวเลือกความละเอียดสื่อเพื่อแลกโทเค็นกับความคมชัด API มี

thinking_levelและปุ่มปรับอื่นๆ เพื่อจูนหน่วง/ต้นทุน/คุณภาพ

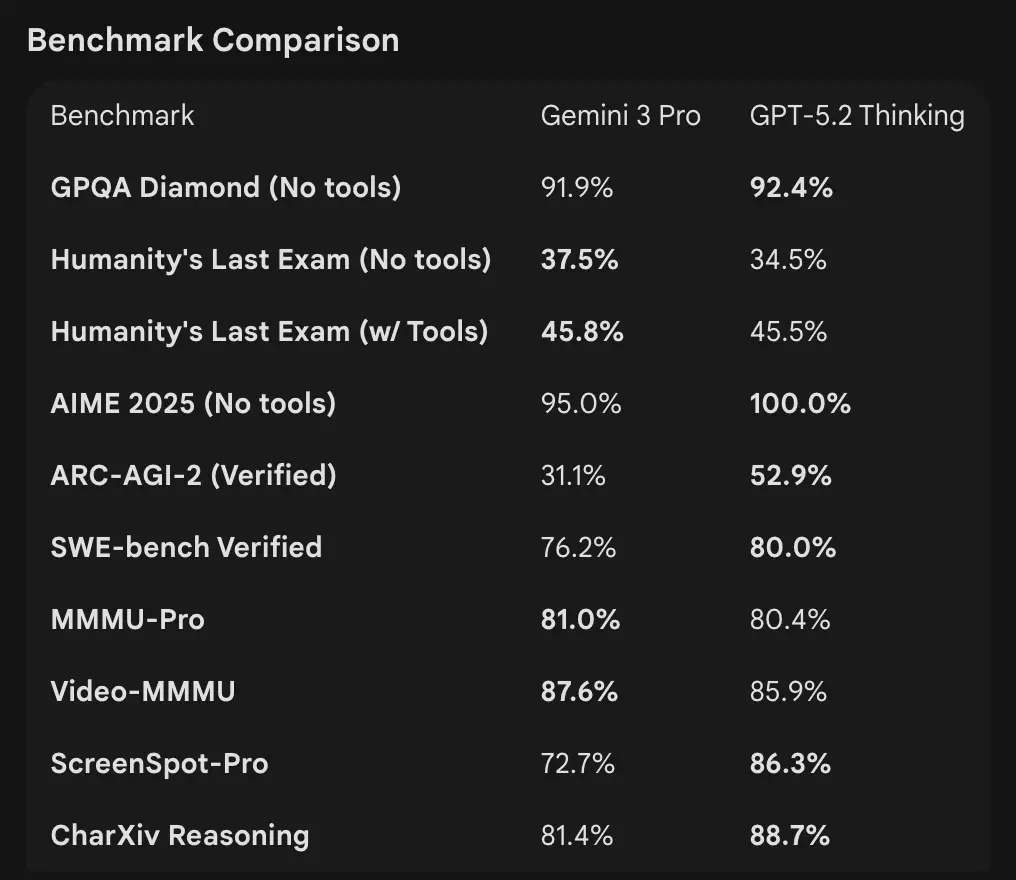

ตัวเลขบัลลังก์เทียบกันอย่างไร

หน้าต่างบริบทและการจัดการโทเค็น

- Gemini 3 Pro Preview: อินพุต 1,000,000 โทเค็น / เอาต์พุต 64k โทเค็น (จาก model card รุ่น Preview) ขอบเขตความรู้: มกราคม 2025 (Google)

- GPT-5.2: OpenAI แสดงประสิทธิภาพบริบทยาวที่แข็งแกร่ง (คะแนน MRCRv2 ข้ามงานเข็มใน 4k–256k ด้วยช่วง >85–95% หลายเซต) และใช้คุณสมบัติ compaction; ตัวอย่างบริบทสาธารณะของ OpenAI ชี้ว่าทำงานได้ robust แม้บริบทใหญ่มาก แต่จะระบุหน้าต่างรายรุ่น (และเน้น compaction มากกว่าการประกาศตัวเลข 1M เดียว) สำหรับการใช้ API ชื่อโมเดลได้แก่

gpt-5.2,gpt-5.2-chat-latest,gpt-5.2-pro

การให้เหตุผลและบัลลังก์เชิงเอเจนต์

- OpenAI (บางส่วน): Tau2-bench Telecom 98.7% (GPT-5.2 Thinking) มีกำไรเด่นในงานใช้เครื่องมือหลายขั้นและงานเชิงเอเจนต์ (OpenAI เน้นการยุบระบบหลายเอเจนต์เป็น “mega-agent” เดียว) GPQA Diamond และ ARC-AGI ดีขึ้นเป็นขั้นเทียบ GPT-5.1

- Google (บางส่วน): Gemini 3 Pro: LMArena 1501 Elo, MMMU-Pro 81%, Video-MMMU 87.6%, คะแนน GPQA สูงและ Humanity’s Last Exam; Google เดโมการวางแผนระยะยาวในตัวอย่างเชิงเอเจนต์ที่แข็งแกร่ง

เครื่องมือ & เอเจนต์:

GPT-5.2: รองรับอย่างแข็งแกร่งสำหรับการเรียกใช้เครื่องมือ การรัน Python และเวิร์กโฟลว์เชิงเอเจนต์ (ค้นหาเอกสาร วิเคราะห์ไฟล์ เอเจนต์ด้านวิทยาการข้อมูล) 11 เท่าเร็วขึ้น / <1% ต้นทุนเทียบมนุษย์สำหรับบางงานใน GDPval (ตัววัดคุณค่าทางเศรษฐกิจที่อาจเกิดขึ้น , 70.9% เทียบเดิม ~38.8%) และเห็นพัฒนาการเชิงรูปธรรมในแบบจำลองสเปรดชีต (เช่น +9.3% ในงาน investment banking ระดับ junior เทียบ GPT-5.1)

คำตีความ: บัลลังก์เสริมกัน — OpenAI เน้นบัลลังก์ งานความรู้ในโลกจริง (GDPval) ที่แสดงว่า GPT-5.2 เด่นในงานผลิตจริง เช่น สเปรดชีต สไลด์ และลำดับเอเจนต์ยาว ขณะที่ Google เน้น ลีดเดอร์บอร์ดการให้เหตุผลดิบ และหน้าต่างบริบทแบบคำขอเดียวที่ใหญ่มาก อะไรสำคัญกว่าขึ้นกับงานของคุณ: ไปป์ไลน์เอกสารยาวเชิงเอเจนต์ในองค์กรโน้มเอียงสู่ประสิทธิภาพ GDPval ของ GPT-5.2; การป้อนบริบทดิบขนาดมหึมา (เช่น คลังวิดีโอทั้งก้อน/หนังสือเต็มเล่มในครั้งเดียว) โน้มเอียงสู่หน้าต่างอินพุต 1M ของ Gemini

ความสามารถมัลติโหมดเทียบกันอย่างไร?

อินพุต & เอาต์พุต

- Gemini 3 Pro Preview: รองรับอินพุต ข้อความ รูปภาพ วิดีโอ เสียง PDF และเอาต์พุตข้อความ; Google ให้ปุ่มปรับ

media_resolutionแบบละเอียดและพารามิเตอร์thinking_levelเพื่อจูนต้นทุนเทียบความคมชัดมัลติโหมด ขีดจำกัดเอาต์พุต 64k; อินพุตถึง 1M โทเค็น - GPT-5.2: รองรับเวิร์กโฟลว์วิชวลและมัลติโหมดที่หลากหลาย; OpenAI เน้นการให้เหตุผลเชิงพื้นที่ที่ดีขึ้น (การประมาณขอบเขตองค์ประกอบในภาพ), ความเข้าใจวิดีโอ (คะแนน Video MMMU) และวิสัยทัศน์ที่เสริมด้วยเครื่องมือ (การใช้ Python กับงานวิชั่นช่วยให้คะแนนดีขึ้น) GPT-5.2 เน้นว่างานวิชั่นที่ซับซ้อน + โค้ด ได้ประโยชน์มากเมื่อเปิดการรันโค้ดในลูป

ความแตกต่างเชิงปฏิบัติ

ความละเอียดเชิงปรับแต่ง vs. ความครอบคลุม: Gemini ให้ปุ่มปรับมัลติโหมด (media_resolution, thinking_level) เพื่อให้ผู้พัฒนาจูนการแลกเปลี่ยนต่อชนิดสื่อ ส่วน GPT-5.2 เน้นการใช้เครื่องมือแบบบูรณาการ (รัน Python ในลูป) เพื่อรวมวิชั่น โค้ด และงานแปลงข้อมูล หากกรณีใช้งานของคุณเน้นวิดีโอ + ภาพหนักๆ พร้อมบริบทใหญ่พิเศษ สเปค 1M บริบทของ Gemini ชวนเชื่อถือ; หากเวิร์กโฟลว์ต้องรันโค้ดในลูป (แปลงข้อมูล สร้างสเปรดชีต) เครื่องมือโค้ดและมิตรภาพต่อเอเจนต์ของ GPT-5.2 อาจสะดวกกว่า

การเข้าถึง API, SDK และการตั้งราคาเป็นอย่างไร?

OpenAI GPT-5.2 (API & ราคา)

- API:

gpt-5.2,gpt-5.2-chat-latest,gpt-5.2-proผ่าน Responses API / Chat Completions มี SDK ที่สุกงอม (Python/JS), คู่มือ cookbook และระบบนิเวศที่成熟 - ราคา (สาธารณะ): $1.75 / 1M โทเค็นอินพุต และ $14 / 1M โทเค็นเอาต์พุต; ส่วนลดแคช (90% สำหรับอินพุตที่แคช) ลดต้นทุนจริงสำหรับข้อมูลซ้ำ OpenAI เน้นประสิทธิภาพต่อโทเค็น (ราคาต่อโทเค็นสูงกว่า แต่โทเค็นที่ใช้ถึงเกณฑ์คุณภาพน้อยกว่า)

Gemini 3 Pro Preview (API & ราคา)

- API:

gemini-3-pro-previewผ่าน Google GenAI SDK และ Vertex AI/GenerativeLanguage endpoints มีพารามิเตอร์ใหม่ (thinking_level,media_resolution) และการผสานกับการยึดโยงการค้นหาและเครื่องมือของ Google - ราคา (public preview): ประมาณ $2 / 1M โทเค็นอินพุต และ $12 / 1M โทเค็นเอาต์พุต สำหรับระดับ preview ใต้ 200k โทเค็น; อาจมีค่าบริการเพิ่มสำหรับ Search grounding, Maps หรือบริการอื่นของ Google (Billing สำหรับ Search grounding เริ่ม 5 ม.ค. 2026)

ใช้ GPT-5.2 และ Gemini 3 ผ่าน CometAPI

CometAPI คือเกตเวย์/ตัวรวม API: จุดปลาย REST สไตล์ OpenAI เดียวที่ให้เข้าถึง โมเดลนับร้อย จากหลากหลายผู้ให้บริการ (LLM, โมเดลภาพ/วิดีโอ, โมเดลฝัง ฯลฯ) แทนที่จะต้องผนวก SDK ของหลายผู้ขาย CometAPI ช่วยให้คุณเรียกปลายทางรูปแบบคุ้นเคย (chat/completions/embeddings/images) แล้วสลับโมเดลหรือผู้ขายใต้ฝากระโปรง

นักพัฒนาสามารถใช้โมเดลเรือธงจากสองบริษัทได้พร้อมกันผ่าน CometAPI โดยไม่ต้องสลับผู้ขาย และราคา API ถูกกว่า มักลดราว 20%

ตัวอย่าง: โค้ด API สั้นๆ (คัดลอก-วางเพื่อทดลอง)

ด้านล่างเป็นตัวอย่างขั้นต่ำที่รันได้ สอดคล้องกับ quickstart ของผู้ขาย (OpenAI Responses API + Google GenAI client) แทนที่ $OPENAI_API_KEY / $GEMINI_API_KEY ด้วยคีย์ของคุณ

GPT-5.2 — Python (OpenAI Responses API, ตั้ง reasoning เป็น xhigh สำหรับโจทย์ลึก)

# Python (ต้องมี openai SDK ที่รองรับ responses API)from openai import OpenAIclient = OpenAI(api_key="YOUR_OPENAI_API_KEY")resp = client.responses.create( model="gpt-5.2-pro", # gpt-5.2 หรือ gpt-5.2-pro input="สรุปรายงานบริษัทขนาด 50k โทเค็น และสร้างเค้าโครงพรีเซนเทชัน 10 สไลด์พร้อมบันทึกผู้บรรยาย", reasoning={"effort": "xhigh"}, # การให้เหตุผลลึกขึ้น max_output_tokens=4000)print(resp.output_text) # หรือสำรวจ resp เพื่อดูเอาต์พุตแบบมีโครงสร้าง / โทเค็น

หมายเหตุ: reasoning.effort ให้คุณแลกต้นทุนกับความลึก ใช้ gpt-5.2-chat-latest สำหรับสไตล์แชตแบบ Instant เอกสาร OpenAI แสดงตัวอย่าง responses.create

GPT-5.2 — curl (ง่าย)

curl https://api.openai.com/v1/responses \ -H "Authorization: Bearer $OPENAI_API_KEY" \ -H "Content-Type: application/json" \ -d '{ "model": "gpt-5.2", "input": "เขียนฟังก์ชัน Python ที่แปลง PDF ที่มีตารางให้เป็น CSV แบบ normalized พร้อมกำหนดชนิดข้อมูลของแต่ละคอลัมน์", "reasoning": {"effort":"high"} }'

(ตรวจดู JSON เพื่ออ่าน output_text หรือเอาต์พุตแบบมีโครงสร้าง)

Gemini 3 Pro Preview — Python (Google GenAI client)

# Python (google genai client) — ตัวอย่างจากเอกสาร Googlefrom google import genaiclient = genai.Client(api_key="YOUR_GEMINI_API_KEY")response = client.models.generate_content( model="gemini-3-pro-preview", contents="หาจุด race condition ในโค้ด C++ แบบ multi-threaded นี้: <paste code here>", config={ "thinkingConfig": {"thinking_level": "high"} })print(response.text)

หมายเหตุ: thinking_level ควบคุมการไตร่ตรองภายในของโมเดล; media_resolution ตั้งได้สำหรับภาพ/วิดีโอ REST และ JS มีตัวอย่างในคู่มือ Gemini สำหรับนักพัฒนา

Gemini 3 Pro — curl (REST)

curl "https://generativelanguage.googleapis.com/v1beta/models/gemini-3-pro-preview:generateContent" \ -H "x-goog-api-key: $GEMINI_API_KEY" \ -H "Content-Type: application/json" \ -X POST \ -d '{ "contents": [{ "parts": [{"text": "อธิบาย race condition ในโค้ด C++ นี้: ..."}] }], "generationConfig": {"thinkingConfig": {"thinkingLevel": "high"}} }'

เอกสารของ Google มีตัวอย่างมัลติโหมด (ภาพแบบ inline data, media_resolution)

โมเดลไหน “ดีกว่า” — คำแนะนำเชิงปฏิบัติ

ไม่มี “ผู้ชนะ” ที่ใช้ได้กับทุกกรณี; ให้เลือกตาม กรณีใช้งาน และ ข้อจำกัด ด้านล่างคือเมทริกซ์ตัดสินใจแบบย่อ

เลือกใช้ GPT-5.2 หาก:

- คุณต้องการ การผสานอย่างแน่นกับเครื่องมือรันโค้ด (ระบบ interpreter/tool ของ OpenAI) สำหรับไปป์ไลน์ข้อมูลแบบเป็นโปรแกรม การสร้างสเปรดชีต หรือเวิร์กโฟลว์โค้ดเชิงเอเจนต์ OpenAI เน้นการปรับปรุง Python tool และการใช้ mega-agent

- คุณให้ความสำคัญกับ ประสิทธิภาพโทเค็น ตามที่ผู้ขายระบุ และต้องการราคาต่อโทเค็นของ OpenAI ที่คาดการณ์ได้ พร้อมส่วนลดก้อนใหญ่สำหรับอินพุตที่แคช (ช่วยงาน batch/โปรดักชัน)

- คุณต้องการระบบนิเวศของ OpenAI (ผสานผลิตภัณฑ์ ChatGPT พันธมิตร Azure/Microsoft และเครื่องมือรอบ Responses API และ Codex)

เลือกใช้ Gemini 3 Pro หาก:

- คุณต้องการ อินพุตมัลติโหมดระดับสุดขั้ว (วิดีโอ + รูปภาพ + เสียง + pdfs) และอยากให้โมเดลเดียวรองรับอินพุตเหล่านี้แบบ native พร้อมหน้าต่างอินพุต 1,000,000 โทเค็น Google ทำการตลาดชัดเจนสำหรับวิดีโอยาว ไปป์ไลน์เอกสาร+วิดีโอขนาดใหญ่ และกรณี Search/AI Mode แบบโต้ตอบ

- คุณสร้างบน Google Cloud / Vertex AI และต้องการการผสานแน่นกับการยึดโยงการค้นหา การจัดสรรผ่าน Vertex และ GenAI client APIs คุณจะได้ประโยชน์จากการผสานผลิตภัณฑ์ Google (Search AI Mode, AI Studio, Antigravity)

บทสรุป: อะไรดีกว่าในปี 2026?

ในศึก GPT-5.2 vs. Gemini 3 Pro Preview คำตอบคือ ขึ้นกับบริบท:

- GPT-5.2 นำในงานความรู้ระดับมืออาชีพ ความลึกเชิงวิเคราะห์ และเวิร์กโฟลว์แบบมีโครงสร้าง

- Gemini 3 Pro Preview เด่นในความเข้าใจมัลติโหมด ระบบนิเวศที่ผนึกแน่น และงานบริบทยาว

ไม่มีโมเดลใด “ดีกว่า” อย่างสากล — จุดแข็งของทั้งคู่ตอบโจทย์ความต้องการจริงต่างประเภท ผู้ใช้ที่ชาญฉลาดควรจับคู่การเลือกโมเดลกับกรณีใช้งานเฉพาะ ข้อจำกัดงบประมาณ และความสอดคล้องกับระบบนิเวศ

สิ่งที่ชัดเจนในปี 2026 คือ พรมแดน AI ก้าวหน้าอย่างมาก และทั้ง GPT-5.2 และ Gemini 3 Pro กำลังผลักดันขีดความสามารถของระบบอัจฉริยะในโลกองค์กรและไกลกว่านั้น

หากอยากลองทันที สำรวจความสามารถของ GPT-5.2 และ Gemini 3 Pro ผ่าน CometAPI ใน Playground และดูคู่มือ API เพื่อคำแนะนำละเอียด ก่อนเข้าใช้งาน โปรดล็อกอิน CometAPI และขอรับคีย์ API CometAPI เสนอราคาต่ำกว่าราคาทางการอย่างมากเพื่อช่วยให้คุณอินทิเกรตได้

พร้อมเริ่มหรือยัง?→ ทดลองใช้ GPT-5.2 และ Gemini 3 Pro ฟรี !

หากคุณต้องการ