ในช่วงปี 2025–2026 ภูมิทัศน์ของเครื่องมือ AI ยังคงรวมศูนย์มากขึ้น: Gateway API (เช่น CometAPI) ขยายเพื่อให้เข้าถึงโมเดลนับร้อยในรูปแบบเดียวกับ OpenAI ขณะที่แอป LLM สำหรับผู้ใช้งานปลายทาง (เช่น AnythingLLM) ก็ยังคงพัฒนาผู้ให้บริการ “Generic OpenAI” ของตนเพื่อให้แอปเดสก์ท็อปและแอปที่เน้นทำงานภายในเครื่องสามารถเรียกใช้งานเอ็นด์พอยต์ที่เข้ากันได้กับ OpenAI ได้ทุกตัว สิ่งนี้ทำให้ทุกวันนี้สามารถกำหนดเส้นทางทราฟฟิกของ AnythingLLM ผ่าน CometAPI ได้อย่างตรงไปตรงมา และได้รับประโยชน์จากการเลือกโมเดล การกำหนดเส้นทางตามต้นทุน และการเรียกเก็บเงินแบบรวมศูนย์ — ในขณะที่ยังคงใช้ UI ภายในเครื่องและฟีเจอร์ RAG/เอเจนต์ของ AnythingLLM ได้เช่นเดิม

AnythingLLM คืออะไร และทำไมคุณจึงอยากเชื่อมต่อกับ CometAPI?

AnythingLLM คืออะไร?

AnythingLLM เป็นแอป AI แบบโอเพ่นซอร์สครบวงจรและไคลเอนต์สำหรับเครื่องท้องถิ่น/คลาวด์ เพื่อสร้างผู้ช่วยแชต เวิร์กโฟลว์การสร้างแบบเพิ่มพูนด้วยการสืบค้น (RAG) และเอเจนต์ที่ขับเคลื่อนด้วย LLM มี UI ที่ลื่นไหล, API สำหรับนักพัฒนา, ฟีเจอร์เวิร์กสเปซ/เอเจนต์ และรองรับ LLM ทั้งแบบโลคัลและบนคลาวด์ — ออกแบบมาให้เน้นความเป็นส่วนตัวเป็นค่าเริ่มต้นและขยายได้ผ่านปลั๊กอิน AnythingLLM มีผู้ให้บริการ Generic OpenAI ที่ทำให้สามารถสื่อสารกับ LLM API ที่เข้ากันได้กับ OpenAI

CometAPI คืออะไร?

CometAPI เป็นแพลตฟอร์มเชิงพาณิชย์สำหรับรวม API ที่เปิดให้ใช้งานโมเดล AI มากกว่า 500 รายการผ่านส่วนติดต่อ REST รูปแบบ OpenAI พร้อมการเรียกเก็บเงินแบบรวมศูนย์ ในการใช้งานจริง คุณสามารถเรียกใช้โมเดลจากผู้ให้บริการหลายราย (OpenAI, Anthropic, Google/Gemini หลากหลายรุ่น, โมเดลภาพ/เสียง ฯลฯ) ผ่านเอ็นด์พอยต์เดียวกันที่ https://api.cometapi.com/v1 และใช้คีย์ API เดียว (รูปแบบ sk-xxxxx) CometAPI รองรับเอ็นด์พอยต์มาตรฐานในรูปแบบ OpenAI เช่น /v1/chat/completions, /v1/embeddings เป็นต้น ทำให้ง่ายต่อการปรับใช้กับเครื่องมือที่รองรับ API ที่เข้ากันได้กับ OpenAI อยู่แล้ว

ทำไมต้องผสาน AnythingLLM เข้ากับ CometAPI?

สามเหตุผลเชิงปฏิบัติ:

- การเลือกโมเดลและความยืดหยุ่นด้านผู้ให้บริการ: AnythingLLM สามารถใช้ LLM ที่ “เข้ากันได้กับ OpenAI” ใดๆ ผ่านตัวห่อ Generic OpenAI การชี้ตัวห่อดังกล่าวไปยัง CometAPI ทำให้เข้าถึงโมเดลนับร้อยได้ทันทีโดยไม่ต้องเปลี่ยน UI หรือโฟลว์ของ AnythingLLM

- เพิ่มประสิทธิภาพด้านต้นทุน/ปฏิบัติการ: การใช้ CometAPI ช่วยให้คุณสลับโมเดล (หรือปรับลงเป็นตัวที่ถูกกว่า) ได้จากศูนย์กลางเพื่อควบคุมค่าใช้จ่าย และคงการเรียกเก็บเงินแบบรวมศูนย์ แทนการต้องจัดการคีย์จากหลายผู้ให้บริการ

- ทดลองได้เร็วขึ้น: คุณสามารถทำ A/B กับโมเดลต่างๆ (เช่น

gpt-4o,gpt-4.5, ตระกูล Claude หรือโมเดลแบบมัลติโหมดที่เป็นโอเพ่นซอร์ส) ผ่าน UI เดิมของ AnythingLLM — มีประโยชน์กับเอเจนต์ การตอบแบบ RAG การสรุป และงานมัลติโหมด

สภาพแวดล้อมและเงื่อนไขที่ควรเตรียมก่อนการผสานใช้งาน

ข้อกำหนดระบบและซอฟต์แวร์ (ภาพรวม)

- เดสก์ท็อปหรือเซิร์ฟเวอร์ที่รัน AnythingLLM (Windows, macOS, Linux) — ติดตั้งแบบเดสก์ท็อปหรือโฮสต์เอง ตรวจสอบให้แน่ใจว่าใช้รุ่นล่าสุดที่มีเมนูการตั้งค่า LLM Preferences / AI Providers

- บัญชี CometAPI และคีย์ API (

sk-xxxxx) คุณจะใช้คีย์นี้ในผู้ให้บริการ Generic OpenAI ของ AnythingLLM - การเชื่อมต่อเครือข่ายจากเครื่องของคุณไปยัง

https://api.cometapi.com(ไม่มีไฟร์วอลล์บล็อก HTTPS ขาออก) - ไม่บังคับแต่แนะนำ: สภาพแวดล้อม Python หรือ Node รุ่นใหม่เพื่อทดสอบ (Python 3.10+ หรือ Node 18+), curl และไคลเอนต์ HTTP (Postman / HTTPie) สำหรับทดสอบความพร้อมของ CometAPI ก่อนเชื่อมกับ AnythingLLM

เงื่อนไขเฉพาะของ AnythingLLM

ผู้ให้บริการ LLM แบบ Generic OpenAI เป็นเส้นทางที่แนะนำสำหรับเอ็นด์พอยต์ที่เลียนแบบพื้นผิว API ของ OpenAI เอกสารของ AnythingLLM ระบุว่าผู้ให้บริการนี้มุ่งเน้นนักพัฒนาและคุณควรเข้าใจอินพุตที่คุณส่ง หากคุณใช้การสตรีม หรือเอ็นด์พอยต์ของคุณไม่รองรับการสตรีม AnythingLLM มีการตั้งค่าเพื่อปิดการสตรีมสำหรับ Generic OpenAI

รายการตรวจสอบด้านความปลอดภัยและการปฏิบัติการ

- ปฏิบัติกับคีย์ CometAPI เหมือนความลับอื่นๆ — อย่าคอมมิตลงรีโป; เก็บไว้ใน Keychain ของ OS หรือเป็นตัวแปรสภาพแวดล้อมเมื่อเป็นไปได้

- หากคุณวางแผนใช้เอกสารที่มีความอ่อนไหวใน RAG ให้ตรวจสอบการรับประกันด้านความเป็นส่วนตัวของเอ็นด์พอยต์ให้สอดคล้องกับข้อกำหนดของคุณ (ดูเอกสาร/เงื่อนไขของ CometAPI)

- กำหนดจำนวนโทเค็นสูงสุดและขนาดหน้าต่างบริบทเพื่อป้องกันค่าใช้จ่ายบานปลาย

จะกำหนดค่า AnythingLLM ให้ใช้ CometAPI อย่างไร (ทีละขั้นตอน)?

ด้านล่างเป็นลำดับขั้นตอนที่ชัดเจน ตามด้วยตัวอย่างตัวแปรสภาพแวดล้อมและโค้ดสั้นๆ สำหรับทดสอบการเชื่อมต่อก่อนบันทึกการตั้งค่าใน UI ของ AnythingLLM

ขั้นตอนที่ 1 — รับคีย์ CometAPI ของคุณ

- ลงทะเบียนหรือเข้าสู่ระบบที่ CometAPI

- ไปที่ “API Keys” และสร้างคีย์ — คุณจะได้สตริงที่มีลักษณะ

sk-xxxxxเก็บไว้เป็นความลับ

ขั้นตอนที่ 2 — ตรวจสอบว่า CometAPI ใช้งานได้ด้วยคำขอแบบรวดเร็ว

ใช้ curl หรือ Python เรียกเอ็นด์พอยต์ chat completion อย่างง่ายเพื่อยืนยันการเชื่อมต่อ

ตัวอย่าง Curl

curl -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer sk-xxxxx" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-4o",

"messages": ,

"max_tokens": 50

}'

หากได้สถานะ 200 และ JSON ที่มีอาร์เรย์ choices แปลว่าคีย์และเครือข่ายของคุณทำงานปกติ (เอกสารของ CometAPI แสดงพื้นผิวและเอ็นด์พอยต์ในรูปแบบเดียวกับ OpenAI)

ตัวอย่าง Python (requests)

import requests

url = "https://api.cometapi.com/v1/chat/completions"

headers = {"Authorization": "Bearer sk-xxxxx", "Content-Type": "application/json"}

payload = {

"model": "gpt-4o",

"messages": ,

"max_tokens": 64

}

r = requests.post(url, json=payload, headers=headers, timeout=15)

print(r.status_code, r.json())

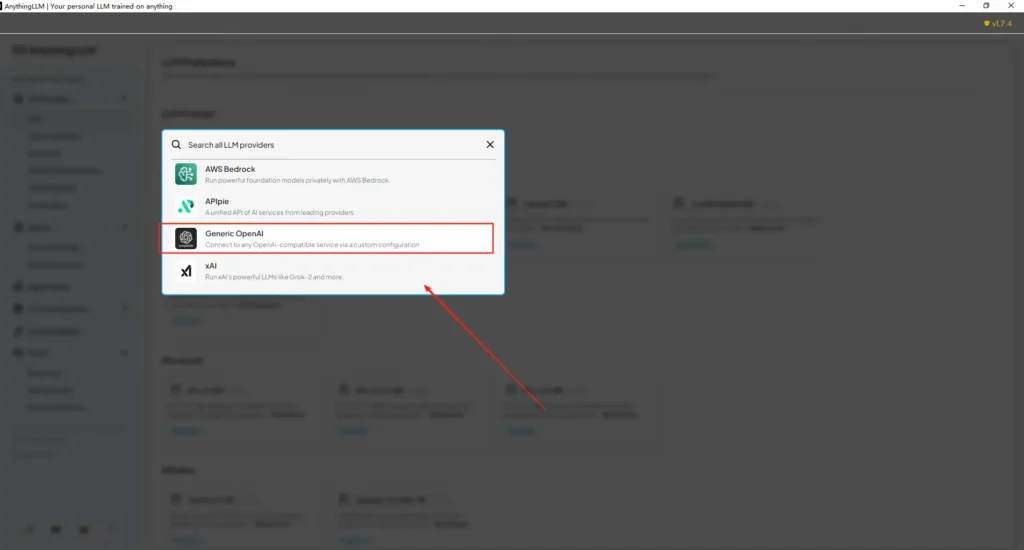

ขั้นตอนที่ 3 — กำหนดค่า AnythingLLM (ผ่าน UI)

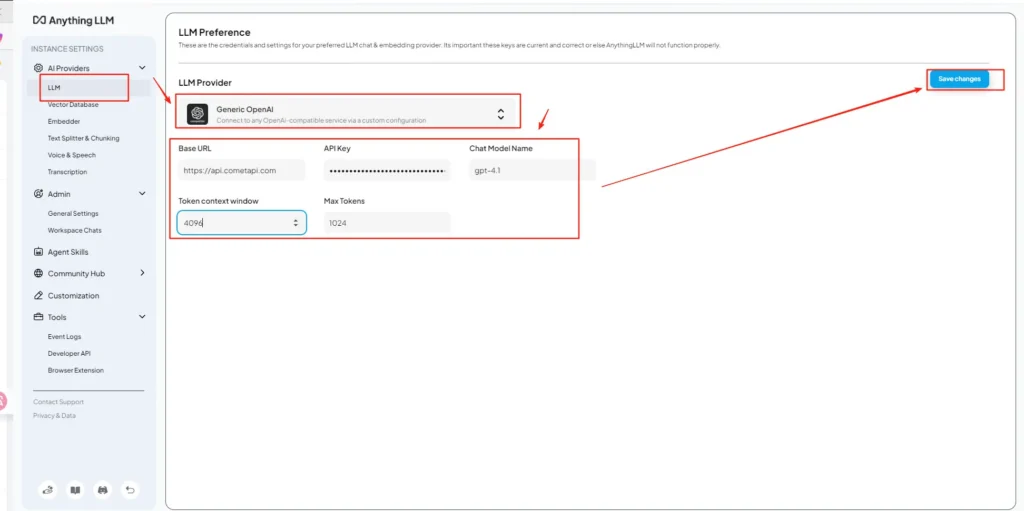

เปิด AnythingLLM → Settings → AI Providers → LLM Preferences (หรือเส้นทางใกล้เคียงในเวอร์ชันของคุณ) ใช้ผู้ให้บริการ Generic OpenAI และกรอกช่องดังนี้:

API Configuration (example)

• เข้าสู่เมนูการตั้งค่า AnythingLLM ค้นหา LLM Preferences ใต้ AI Providers

• เลือก Generic OpenAI เป็นผู้ให้บริการโมเดล ระบุhttps://api.cometapi.com/v1ในช่อง URL

• วางsk-xxxxxจาก CometAPI ลงในช่อง API key ระบุ Token context window และ Max Tokens ตามโมเดลจริง คุณยังสามารถเพิ่มชื่อโมเดลบนหน้านี้ เช่น เพิ่มโมเดลgpt-4o

สิ่งนี้สอดคล้องกับคำแนะนำ “Generic OpenAI” (ตัวห่อสำหรับนักพัฒนา) ของ AnythingLLM และแนวทาง Base URL แบบเข้ากันได้กับ OpenAI ของ CometAPI

ขั้นตอนที่ 4 — ตั้งชื่อโมเดลและขีดจำกัดโทเค็น

ในหน้าการตั้งค่าเดียวกัน ให้เพิ่มหรือปรับแต่งชื่อโมเดลให้ตรงตามที่ CometAPI เผยแพร่ (เช่น gpt-4o, minimax-m2, kimi-k2-thinking) เพื่อให้ UI ของ AnythingLLM แสดงโมเดลเหล่านั้นแก่ผู้ใช้ CometAPI เผยแพร่ชื่อโมเดลสำหรับแต่ละผู้ให้บริการ

ขั้นตอนที่ 5 — ทดสอบใน AnythingLLM

เริ่มแชตใหม่หรือใช้เวิร์กสเปซที่มีอยู่ เลือกผู้ให้บริการ Generic OpenAI (หากมีหลายผู้ให้บริการ) เลือกหนึ่งในชื่อโมเดลจาก CometAPI ที่คุณเพิ่ม แล้วลองพรอมป์ตแบบง่ายๆ หากได้คำตอบที่สมเหตุสมผล แสดงว่าผสานสำเร็จ

AnythingLLM ใช้การตั้งค่าเหล่านั้นภายในอย่างไร

ตัวห่อ Generic OpenAI ของ AnythingLLM จะสร้างคำขอในรูปแบบ OpenAI (/v1/chat/completions, /v1/embeddings) ดังนั้นเมื่อคุณกำหนดค่า Base URL และใส่คีย์ CometAPI แล้ว AnythingLLM จะส่งผ่านการสนทนา การเรียกเอเจนต์ และคำขอฝังเวกเตอร์ผ่าน CometAPI โดยโปร่งใส หากคุณใช้เอเจนต์ของ AnythingLLM (โฟลว์ @agent) ก็จะใช้ผู้ให้บริการเดียวกัน

แนวทางปฏิบัติที่ดีและหลุมพรางที่เป็นไปได้มีอะไรบ้าง?

แนวทางปฏิบัติที่ดี

- ตั้งค่าบริบทให้เหมาะกับโมเดล: จับคู่ค่า Token Context Window และ Max Tokens ใน AnythingLLM ให้ตรงกับโมเดลที่คุณเลือกใน CometAPI หากไม่ตรง อาจทำให้ตัดข้อความหรือเรียกไม่สำเร็จ

- ปกป้องคีย์ API ของคุณ: เก็บคีย์ CometAPI เป็นตัวแปรสภาพแวดล้อมและ/หรือในตัวจัดการความลับ (เช่น Kubernetes/secret manager); อย่าเช็กอินลง git หากใส่ผ่าน UI ของ AnythingLLM คีย์จะถูกเก็บในที่จัดเก็บของเครื่องโฮสต์ ถือว่าเป็นข้อมูลสำคัญ

- เริ่มจากโมเดลที่เล็ก/ราคาถูกสำหรับการทดลอง: ใช้ CometAPI เพื่อทดสอบโมเดลต้นทุนต่ำสำหรับการพัฒนา และสำรองโมเดลระดับพรีเมียมไว้สำหรับโปรดักชัน CometAPI ชูจุดเด่นเรื่องการสลับตามต้นทุนและการเรียกเก็บเงินรวม

- ติดตามการใช้งานและตั้งแจ้งเตือน: CometAPI มีแดชบอร์ดการใช้งาน — ตั้งงบประมาณ/การเตือนเพื่อหลีกเลี่ยงค่าใช้จ่ายไม่คาดคิด

- ทดสอบเอเจนต์และเครื่องมือแบบแยกสภาพแวดล้อม: เอเจนต์ของ AnythingLLM อาจเรียกใช้การกระทำต่างๆ ให้ทดสอบด้วยพรอมป์ตที่ปลอดภัยและในสภาพแวดล้อมสเตจจิงก่อน

ข้อผิดพลาดที่พบบ่อย

- ความขัดแย้งระหว่าง UI กับ

.env: เมื่อโฮสต์เอง การตั้งค่าใน UI อาจเขียนทับการเปลี่ยนแปลงใน.env(และกลับกัน) ตรวจสอบไฟล์ที่สร้าง/app/server/.envหากค่ากลับเป็นค่าเดิมหลังรีสตาร์ต ชุมชนรายงานว่ามีการรีเซ็ตLLM_PROVIDER - ชื่อโมเดลไม่ตรง: การใช้ชื่อโมเดลที่ไม่มีใน CometAPI จะทำให้เกตเวย์ส่ง 400/404 ตรวจสอบรายชื่อโมเดลที่ CometAPI เผยแพร่เสมอ

- ขีดจำกัดโทเค็นและการสตรีม: หากต้องการสตรีม ให้ยืนยันว่าโมเดลใน CometAPI รองรับการสตรีม (และเวอร์ชัน UI ของ AnythingLLM รองรับ) ผู้ให้บริการบางรายอาจมีรูปแบบการสตรีมต่างกัน

กรณีใช้งานจริงใดบ้างที่การผสานนี้เปิดโอกาสให้ทำได้?

การสร้างแบบเพิ่มพูนด้วยการสืบค้น (RAG)

ใช้ตัวโหลดเอกสารของ AnythingLLM ร่วมกับฐานข้อมูลเวกเตอร์และโมเดล LLM จาก CometAPI เพื่อสร้างคำตอบที่รับรู้บริบท คุณสามารถทดลองใช้โมเดลฝังเวกเตอร์ราคาถูก + โมเดลแชตราคาแพง หรือคงทุกอย่างไว้บน CometAPI เพื่อการเรียกเก็บเงินรวม เวิร์กโฟลว์ RAG เป็นฟีเจอร์หลักที่มีมาในตัวของ AnythingLLM

ระบบอัตโนมัติด้วยเอเจนต์

AnythingLLM รองรับเวิร์กโฟลว์ @agent (ท่องเว็บ เรียกใช้เครื่องมือ ดำเนินออโตเมชัน) การส่งคำเรียกของเอเจนต์ผ่าน CometAPI ทำให้คุณเลือกโมเดลสำหรับขั้นควบคุม/ทำความเข้าใจได้โดยไม่ต้องแก้โค้ดเอเจนต์

การทดสอบ A/B ข้ามโมเดลและการเพิ่มประสิทธิภาพต้นทุน

สลับโมเดลต่อเวิร์กสเปซหรือฟีเจอร์ (เช่น gpt-4o สำหรับคำตอบโปรดักชัน, gpt-4o-mini สำหรับงานพัฒนา) CometAPI ทำให้การสลับโมเดลเป็นเรื่องง่ายและรวมค่าใช้จ่ายไว้ที่เดียว

ไปป์ไลน์แบบมัลติโหมด

CometAPI มีโมเดลภาพ เสียง และโมเดลเฉพาะทาง AnythingLLM รองรับมัลติโหมด (ผ่านผู้ให้บริการ) บวกกับโมเดลของ CometAPI ทำให้สร้างงานอย่างคำบรรยายภาพ การสรุปมัลติโหมด หรือถอดเสียง ผ่านอินเทอร์เฟซเดียวกันได้

สรุป

CometAPI ยังคงวางตัวเป็นเกตเวย์หลายโมเดล (มากกว่า 500 โมเดล, API รูปแบบ OpenAI) ซึ่งทำให้เป็นพันธมิตรธรรมชาติกับแอปอย่าง AnythingLLM ที่รองรับผู้ให้บริการ Generic OpenAI อยู่แล้ว ในทำนองเดียวกัน ผู้ให้บริการ Generic ของ AnythingLLM และตัวเลือกการกำหนดค่าล่าสุดทำให้การเชื่อมต่อกับเกตเวย์ลักษณะนี้ทำได้ไม่ยุ่งยาก การบรรจบกันของทั้งสองฝั่งช่วยทำให้การทดลองและการย้ายสู่โปรดักชันในช่วงปลายปี 2025 ง่ายขึ้น

วิธีเริ่มต้นกับ Comet API

CometAPI เป็นแพลตฟอร์ม API แบบรวมศูนย์ที่รวบรวมโมเดล AI กว่า 500 โมเดลจากผู้ให้บริการชั้นนำ—เช่น OpenAI’s GPT series, Google’s Gemini, Anthropic’s Claude, Midjourney, Suno และอื่นๆ—ไว้ในอินเทอร์เฟซเดียวที่เป็นมิตรกับนักพัฒนา ด้วยการมอบกลไกยืนยันตัวตน รูปแบบคำขอ และการจัดการผลลัพธ์ที่สอดคล้องกัน CometAPI ทำให้การผสานความสามารถ AI เข้ากับแอปของคุณง่ายขึ้นอย่างมาก ไม่ว่าคุณจะสร้างแชตบอท เครื่องสร้างภาพ ตัวสร้างเพลง หรือไปป์ไลน์วิเคราะห์ที่ขับเคลื่อนด้วยข้อมูล CometAPI ช่วยให้คุณพัฒนาและทดลองได้เร็วขึ้น ควบคุมค่าใช้จ่าย และไม่ยึดติดผู้ให้บริการ—พร้อมเข้าถึงนวัตกรรมล่าสุดทั่วระบบนิเวศ AI

เริ่มต้นด้วยการสำรวจความสามารถของโมเดลบน CometAPI ใน Playground และดูคู่มือ API สำหรับคำแนะนำโดยละเอียด ก่อนใช้งาน โปรดตรวจสอบว่าคุณได้เข้าสู่ระบบ CometAPI และรับคีย์ API แล้ว CometAPI มีราคาที่ต่ำกว่าราคาทางการอย่างมากเพื่อช่วยให้คุณผสานรวม

พร้อมเริ่มหรือยัง?→ สมัคร CometAPI วันนี้ !

หากต้องการเคล็ดลับ แนวทาง และข่าวสารด้าน AI เพิ่มเติม ติดตามเราได้ที่ VK, X และ Discord!