DeepSeek เปิดตัวแล้ว Deep Seek V3.2 และตัวแปรที่มีการประมวลผลสูง DeepSeek-V3.2-พิเศษด้วยกลไกแบบ Sparse-Attention (DSA) ใหม่ พฤติกรรมของตัวแทน/เครื่องมือที่ได้รับการปรับปรุง และโหมด "การคิด" (ห่วงโซ่แห่งความคิด) ที่เผยให้เห็นการใช้เหตุผลภายใน ทั้งสองโมเดลพร้อมใช้งานผ่าน API ของ DeepSeek (จุดสิ้นสุดที่เข้ากันได้กับ OpenAI) และสิ่งประดิษฐ์ของโมเดล/รายงานทางเทคนิคได้รับการเผยแพร่สู่สาธารณะ

DeepSeek V3.2 คืออะไร?

DeepSeek V3.2 เป็นตัวสืบทอดการผลิตในตระกูล DeepSeek V3 ซึ่งเป็นตระกูลโมเดลสร้างบริบทระยะยาวขนาดใหญ่ที่ออกแบบมาโดยเฉพาะสำหรับ การใช้เหตุผลก่อน เวิร์กโฟลว์และการใช้งานตัวแทน V3.2 ได้รวบรวมการปรับปรุงจากการทดลองก่อนหน้า (V3.2-Exp) เข้ากับโมเดลหลักที่เปิดเผยผ่านแอป, UI เว็บ และ API ของ DeepSeek รองรับทั้งเอาต์พุตแบบสนทนาที่รวดเร็วและแบบเฉพาะ คิด โหมด (ห่วงโซ่แห่งความคิด) เหมาะสำหรับงานการใช้เหตุผลหลายขั้นตอน เช่น คณิตศาสตร์ การแก้จุดบกพร่อง และการวางแผน

เหตุใด V3.2 จึงมีความสำคัญ (บริบทด่วน)

DeepSeek V3.2 มีความโดดเด่นด้วยเหตุผลเชิงปฏิบัติสามประการ:

- บริบทยาว: หน้าต่างบริบทโทเค็นสูงสุด 128 โทเค็น ซึ่งเหมาะสำหรับเอกสารยาว สัญญาทางกฎหมาย หรือการค้นคว้าเอกสารหลายฉบับ

- การออกแบบที่เน้นการใช้เหตุผลเป็นอันดับแรก: โมเดลนี้ผสานรวมห่วงโซ่แห่งความคิด (“การคิด”) เข้ากับเวิร์กโฟลว์และการใช้เครื่องมือ — การเปลี่ยนแปลงไปสู่แอปเชิงตัวแทนที่ต้องมีขั้นตอนการให้เหตุผลระดับกลาง

- ต้นทุนและประสิทธิภาพ: การนำ DSA (ความสนใจแบบเบาบาง) มาใช้จะช่วยลดการคำนวณสำหรับลำดับยาวๆ ส่งผลให้สามารถอนุมานบริบทขนาดใหญ่ได้ถูกกว่ามาก

DeepSeek-V3.2-Speciale คืออะไร และแตกต่างจากเวอร์ชันพื้นฐาน v3.2 อย่างไร

อะไรที่ทำให้รุ่น “Speciale” พิเศษ?

DeepSeek V3.2-Speciale เป็น การคำนวณสูง, การใช้เหตุผลสูง เวอร์ชัน 3.2 ของตระกูล เมื่อเทียบกับเวอร์ชัน 3.2 ที่สมดุลแล้ว Speciale ได้รับการปรับแต่ง (และผ่านการฝึกอบรมหลังการฝึก) โดยเฉพาะสำหรับการใช้เหตุผลแบบหลายขั้นตอน คณิตศาสตร์ และงานเชิงตัวแทน โดยใช้การเรียนรู้แบบเสริมแรงเพิ่มเติมจากฟีดแบ็กของมนุษย์ (RLHF) และขยายห่วงโซ่ความคิดภายในระหว่างการฝึก จุดสิ้นสุดชั่วคราวดังกล่าวและการเข้าถึง API ของ Speciale ได้รับการประกาศให้มีขอบเขตเวลา (อ้างอิงวันหมดอายุจุดสิ้นสุดสำหรับเส้นทาง Speciale ในวันที่ 15 ธันวาคม 2025)

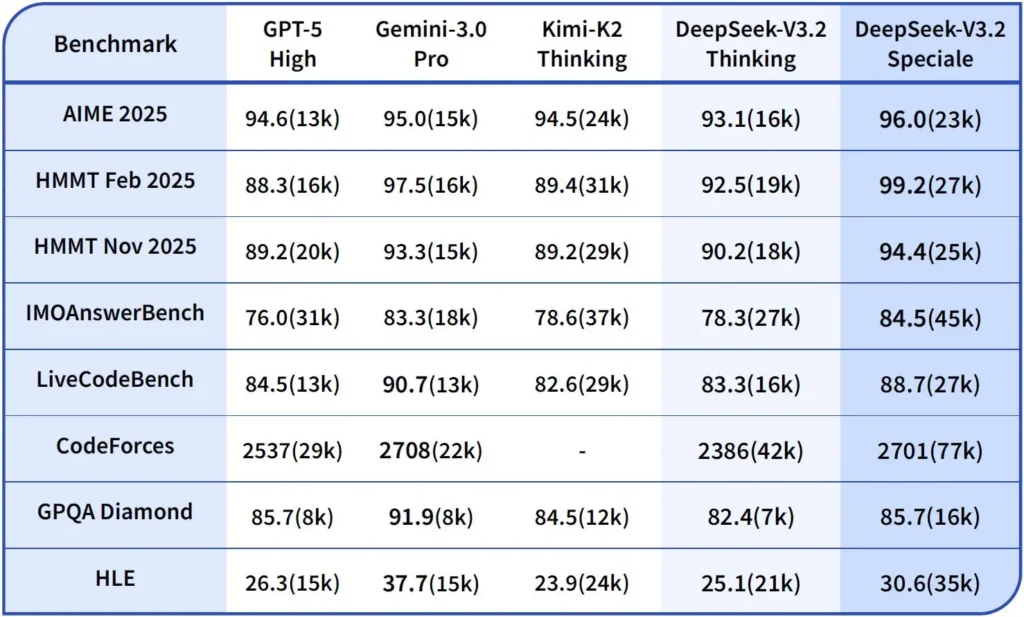

ประสิทธิภาพและเกณฑ์มาตรฐาน

DeepSeek-V3.2-Speciale คือเวอร์ชัน V3.2 ที่มีการประมวลผลสูงและปรับแต่งการใช้เหตุผล เวอร์ชัน Speciale ได้ผสานรวมแบบจำลองทางคณิตศาสตร์ DeepSeek-Math-V2 เวอร์ชันก่อนหน้าเข้าด้วยกัน จึงถูกจัดวางให้เป็นแบบจำลองที่จะใช้เมื่อเวิร์กโหลดต้องการ ห่วงโซ่ความคิดที่ลึกที่สุดเท่าที่จะเป็นไปได้ การแก้ปัญหาหลายขั้นตอน การใช้เหตุผลแบบแข่งขัน (เช่น รูปแบบโอลิมปิกทางคณิตศาสตร์) และการประสานงานตัวแทนที่ซับซ้อน.

สามารถพิสูจน์ทฤษฎีบททางคณิตศาสตร์และยืนยันการใช้เหตุผลเชิงตรรกะได้ด้วยตัวเอง และประสบความสำเร็จอย่างโดดเด่นในการแข่งขันระดับโลกหลายรายการ:

- เหรียญทอง IMO (โอลิมปิกคณิตศาสตร์นานาชาติ)

- เหรียญทอง CMO (โอลิมปิกคณิตศาสตร์จีน)

- รางวัลรองชนะเลิศอันดับที่ 2 จากการแข่งขันการเขียนโปรแกรมคอมพิวเตอร์นานาชาติ (ICPC) (Human Contest)

- IOI (โอลิมปิกนานาชาติด้านวิทยาการคอมพิวเตอร์) อันดับที่ 10 (การแข่งขันด้านมนุษย์)

Reasoning Mode ใน DeepSeek v3.2 คืออะไร?

DeepSeek เปิดเผยข้อมูลที่ชัดเจน โหมดการคิด / การใช้เหตุผล ซึ่งทำให้แบบจำลองสร้าง ห่วงโซ่แห่งความคิด (CoT) เป็นส่วนที่แยกจากกันของผลลัพธ์ ก่อน คำตอบสุดท้าย API จะแสดง CoT นี้เพื่อให้แอปพลิเคชันไคลเอนต์สามารถตรวจสอบ แสดง หรือวิเคราะห์ได้

กลไก — สิ่งที่ API ให้บริการ

reasoning_contentสนาม: เมื่อเปิดใช้งานโหมดการคิด โครงสร้างการตอบสนองจะรวมถึงreasoning_contentสนาม (CoT) ในระดับเดียวกับสนามสุดท้ายcontentซึ่งจะทำให้ไคลเอนต์สามารถเข้าถึงขั้นตอนภายในผ่านโปรแกรมได้- การเรียกเครื่องมือระหว่างการคิด:V3.2 อ้างว่ารองรับการเรียกใช้เครื่องมือ ภายใน เส้นทางการคิด: โมเดลสามารถสลับขั้นตอนการคิดและการเรียกใช้เครื่องมือได้ ซึ่งจะช่วยปรับปรุงประสิทธิภาพการทำงานของงานที่ซับซ้อน

API DeepSeek v3.2 นำการใช้เหตุผลไปใช้อย่างไร

เวอร์ชัน 3.2 แนะนำกลไก API ของการใช้เหตุผลแบบมาตรฐานเพื่อรักษาตรรกะการใช้เหตุผลที่สอดคล้องกันในบทสนทนาหลายรอบ:

- การร้องขอเหตุผลแต่ละข้อมี

reasoning_contentเขตข้อมูลภายในโมเดล; - หากผู้ใช้ต้องการให้โมเดลดำเนินการใช้เหตุผลต่อไป ฟิลด์นี้จะต้องถูกส่งกลับไปยังเทิร์นถัดไป

- เมื่อคำถามใหม่เริ่มต้นคำถามเก่า

reasoning_contentจะต้องได้รับการเคลียร์เพื่อป้องกันการปนเปื้อนเชิงตรรกะ - โมเดลสามารถดำเนินการวนซ้ำ “การใช้เหตุผล → การเรียกใช้เครื่องมือ → การใช้เหตุผลซ้ำ” ได้หลายครั้งในโหมดการใช้เหตุผล

ฉันจะเข้าถึงและใช้ DeepSeek v3.2 API ได้อย่างไร

ระยะสั้น: CometAPI เป็นเกตเวย์สไตล์ OpenAI ที่เปิดเผยโมเดลต่างๆ มากมาย (รวมถึงตระกูล DeepSeek) ผ่านทาง https://api.cometapi.com/v1 เพื่อให้คุณสามารถสลับรุ่นได้โดยการเปลี่ยน model สตริงในคำขอ ลงทะเบียนที่ CometAPI และรับรหัส API ของคุณก่อน

เหตุใดจึงควรใช้ CometAPI แทน DeepSeek โดยตรง?

- CometAPI ช่วยรวบรวมการเรียกเก็บเงิน ขีดจำกัดอัตรา และการเลือกโมเดล (มีประโยชน์หากคุณวางแผนจะเปลี่ยนผู้ให้บริการโดยไม่เปลี่ยนโค้ด)

- จุดสิ้นสุด DeepSeek โดยตรง (เช่น

https://api.deepseek.com/v1) ยังคงมีอยู่และบางครั้งอาจเปิดเผยฟีเจอร์เฉพาะของผู้ให้บริการ เลือกใช้ CometAPI เพื่อความสะดวก หรือเลือกใช้จุดสิ้นสุดของผู้จำหน่ายโดยตรงสำหรับการควบคุมแบบเนทีฟของผู้ให้บริการ ตรวจสอบว่าฟีเจอร์ใดบ้าง (เช่น Speciale จุดสิ้นสุดการทดลอง) ที่พร้อมใช้งานผ่าน CometAPI ก่อนที่จะใช้งาน

ขั้นตอน A — สร้างบัญชี CometAPI และรับรหัส API

- ไปที่ CometAPI (สมัคร/คอนโซล) และสร้างคีย์ API (แดชบอร์ดโดยทั่วไปจะแสดง

sk-...).เก็บเป็นความลับ. โคเมทเอพีไอ

ขั้นตอนที่ B — ยืนยันชื่อรุ่นที่แน่นอนที่มีอยู่

- สอบถามรายการโมเดลเพื่อยืนยันสตริงโมเดลที่ CometAPI เปิดเผย (ชื่อโมเดลสามารถมีคำต่อท้ายตัวแปรได้) ใช้จุดสิ้นสุดโมเดลก่อนชื่อฮาร์ดโค้ด:

curl -s -H "Authorization: Bearer $COMET_KEY" \

https://api.cometapi.com/v1/models | jq .

ค้นหารายการ DeepSeek (เช่น deepseek-v3.2 or deepseek-v3.2-exp) และจดบันทึกรหัสที่แน่นอน CometAPI เปิดเผย /v1/models รายการ.

ขั้นตอน C — โทรสนทนาพื้นฐาน (curl)

แทนที่ <COMET_KEY> และ deepseek-v3.2 ด้วยรหัสรุ่นที่คุณยืนยัน:

curl https://api.cometapi.com/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer <COMET_KEY>" \

-d '{

"model": "deepseek-v3.2",

"messages": [

{"role":"system","content":"You are a helpful assistant."},

{"role":"user","content":"Summarize DeepSeek v3.2 in two sentences."}

],

"max_tokens":300

}'

นี่คือรูปแบบการโทรสไตล์ OpenAI เดียวกัน — CometAPI ส่งต่อไปยังผู้ให้บริการที่เลือก

ความเข้ากันได้และข้อควรระวัง

- รองรับการเปิดใช้งาน Think Mode ในสภาพแวดล้อม Claude Code

- ในบรรทัดคำสั่ง (CLI) เพียงป้อนชื่อโมเดล deepseek-reasoner

- อย่างไรก็ตาม อาจไม่สามารถใช้งานร่วมกับเครื่องมือที่ไม่ได้มาตรฐาน เช่น Cline และ RooCode ได้ในขณะนี้

- ขอแนะนำให้ใช้โหมดที่ไม่ใช่ Think สำหรับงานทั่วไป และใช้โหมด Think สำหรับการใช้เหตุผลเชิงตรรกะที่ซับซ้อน

รูปแบบการนำไปใช้จริง: สถาปัตยกรรมตัวอย่างบางส่วน

1 — ตัวแทนช่วยเหลือสำหรับเวิร์กโฟลว์ของนักพัฒนา

- โหมด: โหมดพิเศษ (โหมดการคิด) เรียกใช้งานเพื่อสร้างโค้ดที่ซับซ้อนและการสร้างการทดสอบ โหมดแชทด่วนสำหรับผู้ช่วยอินไลน์

- ความปลอดภัย: ใช้การตรวจสอบไปป์ไลน์ CI และการดำเนินการทดสอบแบบแซนด์บ็อกซ์สำหรับโค้ดที่สร้างขึ้น

- โฮสติ้ง: API หรือโฮสต์ด้วยตนเองบน vLLM + คลัสเตอร์หลาย GPU สำหรับบริบทขนาดใหญ่

2 — การวิเคราะห์เอกสารสำหรับทีมกฎหมาย/การเงิน

- โหมด: V3.2 พร้อมการเพิ่มประสิทธิภาพบริบทยาวของ DSA เพื่อประมวลผลสัญญาระยะยาวและสร้างสรุปแบบมีโครงสร้างและรายการการดำเนินการ

- ความปลอดภัย: การลงนามของทนายความมนุษย์สำหรับการตัดสินใจในขั้นตอนต่อไป การแก้ไขข้อมูลส่วนบุคคลก่อนส่งไปยังจุดปลายทางที่โฮสต์

3 — ตัวประสานงานท่อข้อมูลอัตโนมัติ

- โหมด: โหมดการคิดในการวางแผนงาน ETL หลายขั้นตอน เรียกเครื่องมือเพื่อค้นหาฐานข้อมูลและเรียกการทดสอบการตรวจสอบ

- ความปลอดภัย: ดำเนินการยืนยันการดำเนินการและการตรวจสอบที่สามารถตรวจสอบได้ก่อนการดำเนินการที่ไม่สามารถย้อนกลับได้ (เช่น การเขียน DB แบบทำลายล้าง)

รูปแบบข้างต้นแต่ละรูปแบบสามารถใช้งานได้จริงด้วยโมเดลตระกูล V3.2 ในปัจจุบัน แต่คุณจะต้องจับคู่โมเดลกับเครื่องมือตรวจสอบและการกำกับดูแลแบบอนุรักษ์นิยม

ฉันจะเพิ่มประสิทธิภาพต้นทุนและประสิทธิภาพด้วย v3.2 ได้อย่างไร

ใช้โหมดคู่โดยเจตนา

- โหมดรวดเร็วสำหรับการโต้ตอบแบบไมโคร: ใช้โหมดเครื่องมือที่ไม่ต้องใช้ความคิดสำหรับการดึงข้อมูลระยะสั้น การแปลงรูปแบบ หรือการเรียก API โดยตรงในกรณีที่ความล่าช้ามีความสำคัญ

- โหมดการคิดสำหรับการวางแผนและการตรวจสอบ: กำหนดเส้นทางงานที่ซับซ้อน ตัวแทนหลายขั้นตอน หรือการตัดสินใจที่คำนึงถึงความปลอดภัยไปยังโหมดการคิด บันทึกขั้นตอนกลางและดำเนินการผ่านการตรวจสอบ (อัตโนมัติหรือโดยมนุษย์) ก่อนดำเนินการขั้นตอนสำคัญ

ฉันควรเลือกรุ่นไหน?

- deepseek-v3.2 — โมเดลการผลิตที่สมดุลสำหรับงานตัวแทนทั่วไป

- deepseek-v3.2-Speciale — ตัวแปรการใช้เหตุผลหนักเฉพาะทาง อาจเป็น API เท่านั้นในตอนแรกและใช้เมื่อคุณต้องการประสิทธิภาพการใช้เหตุผล/การเปรียบเทียบที่ดีที่สุดเท่าที่จะเป็นไปได้ (และยอมรับต้นทุนที่สูงกว่า)

การควบคุมต้นทุนในทางปฏิบัติและเคล็ดลับ

- วิศวกรรมแบบเร่งด่วน: จัดทำคำสั่งระบบให้กระชับ หลีกเลี่ยงการส่งบริบทที่ซ้ำซ้อน คำสั่งระบบที่ชัดเจน: ใช้คำสั่งระบบที่ประกาศเจตนาของโหมด เช่น "คุณอยู่ในโหมดคิด - แสดงรายการแผนของคุณก่อนเรียกใช้เครื่องมือ" สำหรับโหมดเครื่องมือ ให้เพิ่มข้อจำกัด เช่น "เมื่อโต้ตอบกับ API ของเครื่องคิดเลข ให้ส่งออกเฉพาะ JSON ที่มีฟิลด์ต่อไปนี้เท่านั้น"

- การแบ่งกลุ่ม + การเพิ่มการดึงข้อมูล: ใช้ตัวดึงข้อมูลภายนอกเพื่อส่งเฉพาะส่วนที่เกี่ยวข้องที่สุดสำหรับคำถามของผู้ใช้แต่ละราย

- อุณหภูมิและการสุ่มตัวอย่าง: ลดอุณหภูมิลงสำหรับการโต้ตอบของเครื่องมือเพื่อเพิ่มการกำหนดล่วงหน้า เพิ่มอุณหภูมิในงานสำรวจหรือการสร้างแนวคิด

เกณฑ์มาตรฐานและการวัดผล

- ถือว่าผลลัพธ์ไม่น่าเชื่อถือจนกว่าจะได้รับการตรวจสอบ: แม้แต่ผลลัพธ์ที่ใช้เหตุผลก็อาจไม่ถูกต้องได้ เพิ่มการตรวจสอบแบบกำหนด (การทดสอบยูนิต การตรวจสอบประเภท) ก่อนดำเนินการที่ไม่สามารถย้อนกลับได้

- รันการทดสอบ A/B บนเวิร์กโหลดตัวอย่าง (ความหน่วง การใช้โทเค็น ความถูกต้อง) ก่อนที่จะยืนยันตัวแปร v3.2 รายงานการเพิ่มขึ้นอย่างมากในเกณฑ์มาตรฐานการใช้เหตุผล แต่พฤติกรรมแอปจริงขึ้นอยู่กับการออกแบบพร้อมท์และการกระจายอินพุต

คำถามที่พบบ่อย

ถาม: วิธีที่แนะนำในการรับ CoT จากโมเดลคืออะไร?

A: ใช้ deepseek-reasoner แบบจำลองหรือชุด thinking/thinking.type = enabled ในคำขอของคุณ คำตอบรวมถึง reasoning_content (CoT) และรอบสุดท้าย content.

ถาม: โมเดลสามารถเรียกเครื่องมือภายนอกขณะอยู่ในโหมดการคิดได้หรือไม่

ตอบ: ใช่ — V3.2 ได้นำเสนอความสามารถในการใช้เครื่องมือทั้งในโหมดคิดและโหมดไม่ใช้คิด โมเดลสามารถส่งสัญญาณการเรียกใช้เครื่องมือแบบมีโครงสร้างระหว่างการใช้เหตุผลภายในได้ ใช้ strict โหมดและล้างรูปแบบ JSON เพื่อหลีกเลี่ยงการเรียกที่ไม่ถูกต้อง

ถาม: การใช้โหมดการคิดจะทำให้ต้นทุนเพิ่มขึ้นหรือไม่?

ตอบ: ใช่ — โหมดการคิดจะส่งออกโทเค็น CoT ระดับกลาง ซึ่งจะเพิ่มการใช้งานโทเค็นและส่งผลให้ต้นทุนเพิ่มขึ้น ออกแบบระบบของคุณให้สามารถคิดได้เฉพาะเมื่อจำเป็นเท่านั้น

ถาม: ฉันควรใช้จุดสิ้นสุดและ URL ฐานใด

A: CometAPI มีจุดสิ้นสุดที่เข้ากันได้กับ OpenAI URL ฐานเริ่มต้นคือ https://api.cometapi.com และจุดสิ้นสุดการสนทนาหลักคือ /v1/chat/completions (หรือ /chat/completions ขึ้นอยู่กับ URL ฐานที่คุณเลือก)

ถาม: จำเป็นต้องมีเครื่องมือพิเศษเพื่อใช้การเรียกเครื่องมือหรือไม่

ตอบ: ไม่ — API รองรับการประกาศฟังก์ชันแบบมีโครงสร้างในรูปแบบ JSON คุณต้องระบุ tools พารามิเตอร์ โครงร่างเครื่องมือ และจัดการวงจรชีวิตฟังก์ชัน JSON ในแอปพลิเคชันของคุณ: รับการเรียกใช้ฟังก์ชัน JSON ดำเนินการฟังก์ชัน จากนั้นส่งผลลัพธ์กลับไปยังโมเดลเพื่อดำเนินการต่อหรือปิดการทำงาน โหมดการคิดจะเพิ่มข้อกำหนดในการส่งกลับ reasoning_content ควบคู่ไปกับผลลัพธ์ของเครื่องมือ

สรุป

DeepSeek V3.2 และ DeepSeek-V3.2-Speciale แสดงถึงการผลักดันที่ชัดเจนต่อ เปิดกว้าง เน้นการใช้เหตุผล หลักสูตร LLM ที่ทำให้ลำดับความคิดชัดเจนและรองรับเวิร์กโฟลว์เครื่องมือแบบเอเจนต์ หลักสูตรนี้นำเสนอพื้นฐานใหม่ที่ทรงพลัง (DSA, โหมดการคิด, การฝึกอบรมการใช้งานเครื่องมือ) ที่สามารถทำให้การสร้างเอเจนต์ที่เชื่อถือได้ง่ายขึ้น โดยต้องคำนึงถึงต้นทุนโทเค็น การจัดการสถานะอย่างรอบคอบ และการควบคุมการปฏิบัติงาน

นักพัฒนาสามารถเข้าถึงได้ API Deepseek v3.2 ฯลฯ ผ่าน CometAPI รุ่นใหม่ล่าสุด ได้รับการอัปเดตอยู่เสมอจากเว็บไซต์อย่างเป็นทางการ เริ่มต้นด้วยการสำรวจความสามารถของโมเดลใน สนามเด็กเล่น และปรึกษา คู่มือ API สำหรับคำแนะนำโดยละเอียด ก่อนเข้าใช้งาน โปรดตรวจสอบให้แน่ใจว่าคุณได้เข้าสู่ระบบ CometAPI และได้รับรหัส API แล้ว โคเมทเอพีไอ เสนอราคาที่ต่ำกว่าราคาอย่างเป็นทางการมากเพื่อช่วยคุณบูรณาการ

พร้อมไปหรือยัง?→ ทดลองใช้งาน deepseek v3.2 ฟรี !

หากคุณต้องการทราบเคล็ดลับ คำแนะนำ และข่าวสารเกี่ยวกับ AI เพิ่มเติม โปรดติดตามเราที่ VK, X และ ไม่ลงรอยกัน!