MiniMax-M2.5 เป็นโมเดลภาษาขนาดใหญ่รุ่นใหม่จาก MiniMax ที่มุ่งเน้นการเพิ่มประสิทธิภาพการทำงาน ปรับแต่งเพื่อการเขียนโค้ด การใช้เครื่องมือเชิงเอเจนต์ และเวิร์กโฟลว์สำนักงาน คุณสามารถเรียกใช้งานผ่านแพลตฟอร์ม MiniMax โดยตรง หรือผ่านผู้รวม API อย่าง CometAPI คุณเพียงต้องขอรับคีย์ CometAPI เพื่อใช้ API เนื่องจาก Minimax-M2.5 ยังรองรับรูปแบบแชตด้วย

What is MiniMax-M2.5?

MiniMax-M2.5 คือรุ่นหลักล่าสุดจาก MiniMax: การพัฒนาต่อจากตระกูล M2 ที่บริษัทวางตำแหน่งให้เป็นโมเดลอเนกประสงค์ที่รองรับเอเจนต์ โดยโดดเด่นเป็นพิเศษด้านการสร้างโค้ด การใช้เครื่องมือ และการให้เหตุผลแบบหลายขั้นตอน ตระกูล M2.5 ถูกประกาศเปิดตัวในกุมภาพันธ์ 2026 และมีทั้งรุ่นมาตรฐาน M2.5 และรุ่น “highspeed” ที่ปรับเพื่อความหน่วงต่ำในขณะยังคงความสามารถหลักเหมือนเดิม ตระกูล M2.5 ได้คะแนนเบนช์มาร์กที่ดีขึ้นในการประเมินด้านวิศวกรรมซอฟต์แวร์ และมีพฤติกรรมที่ดีขึ้นเมื่อโต้ตอบกับเครื่องมือภายนอก (เช่น การค้นหา เอเจนต์ ฯลฯ)

ผู้ให้บริการวางตำแหน่ง M2.5 ให้ก้าวขึ้นจากรุ่น M2.x ก่อนหน้า ด้วยความสามารถให้เหตุผลที่แข็งแกร่งขึ้น การสร้างโค้ดที่ดีขึ้น และความน่าเชื่อถือในการเรียกใช้เครื่องมือที่เพิ่มขึ้น บันทึกเผยแพร่สาธารณะของ MiniMax เมื่อต้นกุมภาพันธ์ 2026 ระบุว่า M2.5 เป็นหมุดหมายสำคัญ: ปรับจูนคำสั่งที่ละเอียดขึ้น ความเข้าใจโค้ดที่แข็งแรงขึ้น และมีผลวัดได้ในหลายชุดทดสอบที่เน้นโค้ด การเผยแพร่ครั้งนี้ประกอบด้วย:

- โมเดล M2.5 มาตรฐาน (เน้นความแม่นยำและการให้เหตุผล)

- รุ่น M2.5-highspeed ที่มีความหน่วงต่ำสำหรับเวิร์กโฟลว์แบบโต้ตอบของนักพัฒนา

- แนวทางใช้งานและตัวเลือกการคิดค่าบริการที่ชัดเจนสำหรับ “Coding Plan” ที่มุ่งใช้สร้างโค้ดจำนวนมาก

จุดเด่นทางเทคนิคหลัก

- สถาปัตยกรรม: MoE (จำนวนพารามิเตอร์รวมขนาดใหญ่ แต่เปิดใช้งานเพียงส่วนเล็กระหว่างอนุมาน) ทำให้คุ้มค่าทั้งต้นทุน/ประสิทธิภาพสำหรับงานหนัก

- จุดแข็ง: ประสิทธิภาพการเขียนโค้ดระดับแถวหน้า การให้เหตุผลแบบหลายเทิร์น การจัดการบริบทยาว และการบูรณาการเอเจนต์/เครื่องมือ

- รสชาติ: MiniMax เผยแพร่รุ่นย่อย (เช่น

MiniMax-M2.5และM2.5-highspeed) ที่ปรับแต่งเพื่อปริมาณงานเทียบกับความหน่วง

เหตุใดสิ่งนี้จึงสำคัญในวันนี้: หลายทีมที่สร้างเครื่องมือสำหรับนักพัฒนา ผู้ช่วยการเขียนโปรแกรม และระบบอัตโนมัติแบบเอเจนต์ให้คุณค่ากับโมเดลที่สามารถให้เหตุผลข้ามหลายเทิร์น เรียกใช้เครื่องมือได้อย่างปลอดภัย และสร้างโค้ดคุณภาพสูง M2.5 — ด้วยสถาปัตยกรรมและการฝึกที่เลือกใช้ — ถูกทำการตลาดอย่างชัดเจนสำหรับสถานการณ์เหล่านี้

Benchmarking of MiniMax-M2.5

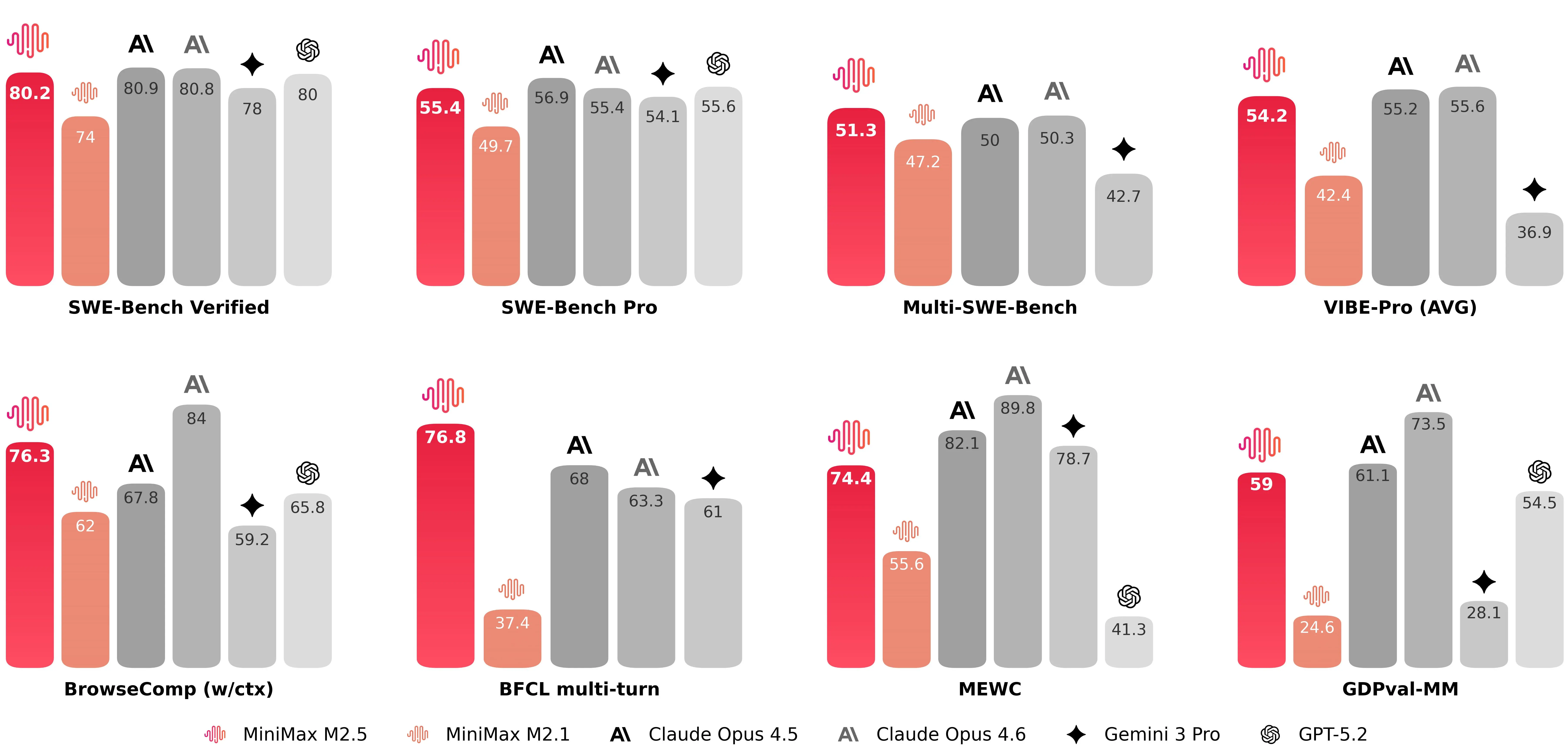

ตำแหน่งของ M2.5 บนเบนช์มาร์กเฉพาะด้านโค้ด

MiniMax-M2.5 ทำคะแนนได้ 80.2% บน SWE-Bench Verified พร้อมทั้งได้คะแนนสูงในชุดทดสอบโค้ดแบบหลายงานและที่เสริมด้วยการท่องเว็บ (ตัวเลขเด่นที่บริษัทเผย ได้แก่ 51.3% บน Multi-SWE-Bench และ 76.3% บน BrowseComp เมื่อเปิดใช้การจัดการบริบท) ตัวเลขเหล่านี้ทำให้ M2.5 อยู่ในกลุ่มโมเดลที่มีประสิทธิภาพสูงสุดที่เปิดให้ใช้งานสาธารณะสำหรับการสร้างโค้ดและแก้ปัญหาเมื่อเปิดตัว การเปิดตัวของ MiniMax-M2.5 ยืนยันว่า M2.5 กำลังแข่งขันกับโมเดลระดับท็อปด้านการเขียนโค้ด

สำหรับนักพัฒนา ประโยชน์มีสองด้าน:

- อัตราความสำเร็จครั้งแรกสูงขึ้น: ต้องแก้น้อยลง ลดการดีบักด้วยมนุษย์ และลดภาระ “ประกบดูแล” สำหรับเอเจนต์เขียนโค้ดอัตโนมัติ

- ครอบคลุมฟูลสแต็กได้ดีขึ้น: M2.5 ถูกอธิบายว่าสนับสนุนเวิร์กโฟลว์ฟูลสแต็กทั้งแอปเดสก์ท็อป โมบายล์ และชุดเครื่องมือข้ามแพลตฟอร์ม หมายความว่ามุ่งสร้างไม่เพียงสแนิปเพ็ต แต่เป็นทางออกหลายไฟล์และสคริปต์บิลด์ที่สอดคล้องกัน

สร้างเพื่อเวิร์กโฟลว์เชิงเอเจนต์

M2.5 ถูกอธิบายว่า “ออกแบบมาโดยเนื้อแท้สำหรับสถานการณ์ Agent” ในทางปฏิบัติ หมายความว่าสถาปัตยกรรมและระบอบการฝึกให้ความสำคัญกับ:

- ความถูกต้องแม่นยำในการเรียกใช้เครื่องมือ: ออกคำสั่ง API หรือรันคำสั่ง shell/SQL ด้วยไวยากรณ์และพารามิเตอร์ที่ถูกต้อง

- การสลับบริบทและหน่วยความจำ: ดำเนินการแบบหลายขั้นตอนที่ถูกขัดจังหวะต่อได้โดยไม่สูญเสียสถานะที่คำนวณไว้ก่อนหน้า

- การจัดการไฟล์: สร้างและแก้ไขรูปแบบไฟล์สำนักงานทั่วไปแบบโปรแกรมมิง (เช่น สร้าง Powerpoint แล้วแก้ไขตามคำขอถัดไป)

การค้นหาและเสริมด้วยการท่องเว็บ

เมื่อจับคู่ M2.5 กับชั้นการท่องเว็บหรือการเรียกคืนข้อมูล MiniMax รายงานว่าคะแนนดีขึ้นอย่างมากบนชุดทดสอบที่เกี่ยวกับการท่องเว็บ สะท้อนประสิทธิภาพที่แข็งแกร่งขึ้นในการผสานข้อมูลภายนอกและการอ้างอิงเข้าในผลลัพธ์ นั่นทำให้ M2.5 เหมาะกับเครื่องมือที่ต้องดึงข้อมูลล่าสุด ตรวจสอบผลลัพธ์ API หรือเสริมการสร้างโค้ดด้วยข้อมูลโลกจริง (เช่น ดึงเอกสาร SDK ล่าสุดและใช้ให้ถูกต้องระหว่างสร้างโค้ด) ความสามารถเหล่านี้สำคัญสำหรับทีมที่สร้างคุณลักษณะ “เชิงเอเจนต์” เช่น QA อัตโนมัติ โซ่เครื่องมือ CI หรือผู้ช่วยที่ขับเคลื่อนด้วยเอกสาร

How can I use MiniMax-2.5 API (via CometAPI)?

CometAPI คือแพลตฟอร์มรวม API ที่เปิดเผยโมเดลนับร้อยผ่านผิว REST ที่เข้ากันได้กับ OpenAI เนื่องจากอินเทอร์เฟซของ CometAPI สะท้อนเอ็นด์พอยต์ chat/completions แบบ OpenAI คุณจึงมักนำไคลเอนต์สไตล์ OpenAI ที่มีอยู่กลับมาใช้ใหม่ได้ด้วยการสลับ api_base และคีย์ API หากคุณไม่ต้องการเชื่อมต่อโดยตรงกับแพลตฟอร์มของ MiniMax (เช่น เหตุผลด้านบิลลิงแบบรวม การทดสอบ A/B หลายโมเดล หรือการแยกผู้ให้บริการ) คุณสามารถเรียก MiniMax-M2.5 ผ่านผิว “chat” ของ CometAPI แพลตฟอร์ม CometAPI จัดให้มีรูปแบบคำขอที่สม่ำเสมอ SDK และเว็บ playground — และเปิดเผยชื่อโมเดลต่อรายและพารามิเตอร์ (ให้คุณเลือกสตริงผู้ให้บริการ/โมเดลที่ต้องการเมื่อเรียก)

ด้านล่างคือคู่มือสั้น กระชับในการเรียก MiniMax-M2.5 ผ่าน CometAPI พร้อมตัวอย่างใน curl และ Python

ขั้นตอนพื้นฐานในการเริ่มต้นมีอะไรบ้าง?

- สมัครบัญชี CometAPI และขอรับคีย์ API (CometAPI มี playground และ SDK สำหรับทดสอบโมเดล)

- ตรวจสอบรายการโมเดลของ CometAPI หรือ CometAPI playground เพื่อหาชื่อโมเดลที่ถูกต้องสำหรับ MiniMax-M2.5

- สร้างคำขอ POST ที่ผ่านการรับรองความถูกต้อง โดยกำหนดพารามิเตอร์

modelเป็นโมเดล MiniMax ที่เลือก และ payload ที่เป็นไปตามสคีมาของ chat/completion ของ CometAPI - ปรับพารามิเตอร์ (temperature, max_tokens, system messages, streaming) ให้เหมาะกับเวิร์กโฟลว์ของคุณ

การรับรองตัวตนและพื้นฐานเอ็นด์พอยต์

- Base URL:

https://api.cometapi.com/v1(รองรับเส้นทางสไตล์ OpenAI เช่น/chat/completions) - Header:

Authorization: Bearer YOUR_COMETAPI_KEY - Content-Type:

application/json - Model field: ใช้สตริงโมเดลตามที่ระบุไว้ในแคตตาล็อกของ CometAPI (ตัวอย่าง:

"minimax-m2.5"

Example 1 — Quick curl (REST, OpenAI-style)

# Replace $COMETAPI_KEY with your CometAPI key

curl -s -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer $COMETAPI_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "minimax-m2.5",

"messages": [

{"role":"system","content":"You are a concise, safety-conscious coding assistant."},

{"role":"user","content":"Refactor this synchronous Python function to async and add basic error handling:\n\n```\ndef fetch(user_id):\n resp = http_get(f\"https://api.example.com/users/{user_id}\")\n return resp.json()\n```"}

],

"max_tokens": 800,

"temperature": 0.0,

"stream": false

}'

หมายเหตุ:

- ใช้สตริงโมเดลให้ตรงตามที่ปรากฏในแคตตาล็อกของ CometAPI; s.

- รองรับ

stream: trueสำหรับการสตรีมผลลัพธ์ (จัดการ server-sent events หรือการตอบกลับแบบ chunk หากต้องการรับโทเคนบางส่วน)

Example 2 — Python (requests) สำหรับ chat completion

import os, requests

COMET_KEY = os.environ.get("COMETAPI_KEY") # recommended

URL = "https://api.cometapi.com/v1/chat/completions"

headers = {

"Authorization": f"Bearer {COMET_KEY}",

"Content-Type": "application/json",

}

payload = {

"model": "minimax-m2.5", # or "minimax/minimax-m2.5" — verify Comet's model page

"messages": [

{"role": "system", "content": "You are a helpful engineer who returns clear, tested code."},

{"role": "user", "content": "Write a pytest for the following function that asserts edge cases..."}

],

"temperature": 0.1,

"max_tokens": 1000,

}

r = requests.post(URL, json=payload, headers=headers, timeout=120)

r.raise_for_status()

out = r.json()

print(out["choices"][0]["message"]["content"])

Example 3 — ใช้ litellm / การผสาน CometAPI (เลเยอร์อำนวยความสะดวกใน Python)

CometAPI ได้รับการสนับสนุนจาก SDK และตัวปรับต่อของคอมมูนิตีหลายตัว เอกสารของ liteLLM แสดงโฟลว์กระชับที่คุณกำหนด COMETAPI_KEY แล้วเรียกโมเดลตามชื่อ เหมาะสำหรับการสร้างต้นแบบอย่างรวดเร็ว:

import os

from litellm import completion

os.environ["COMETAPI_KEY"] = "your_cometapi_key_here"

messages = [{"role":"user", "content":"Explain async/await in Python in 3 bullets."}]

resp = completion(model="minimax-m2.5", messages=messages)

print(resp.choices[0].message.content)

การผสาน Litellm / Comet มีสิ่งอำนวยความสะดวกที่เป็นประโยชน์ (สตรีมมิง แอซิงโครนัส พารามิเตอร์ api_key ชัดเจน) ที่สะท้อนแพตเทิร์นของ OpenAI SDK ที่มีอยู่มากมาย

How should you design prompts and system messages for M2.5

ระบุบทบาทและข้อจำกัดให้ชัดเจน

ให้บทบาทระบบของ M2.5 ชัดเจนเมื่อขอให้เขียนโค้ด ตัวอย่าง:

{"role": "system","content": "You are MiniMax M2.5, an assistant specialized in robust, readable, and well-documented code. Use Python 3.11 conventions, include type hints, and provide brief unit tests."}

ใช้การแตกปัญหาเป็นขั้นตอนสำหรับโจทย์ซับซ้อน

เมื่อขอให้ M2.5 สร้างฟีเจอร์ที่ซับซ้อน ใช้วิธีแยกสั้นๆ:

- ขอเค้าโครงการออกแบบ

- ขอซิกเนเจอร์อินเทอร์เฟซ

- ขออิมพลีเมนเตชันและเทสต์

วิธีนี้ลดความเสี่ยงการมโนและให้ผลลัพธ์ที่เป็นโมดูล เข้าตรวจรีวิวได้

Temperature, max_tokens และความปลอดภัย

- สำหรับโค้ดแบบกำหนดแน่นอน: ตั้งค่า

temperatureใกล้ 0.0 - สำหรับการออกแบบเชิงสำรวจ:

temperatureที่ 0.2–0.5 อาจเปิดแนวทางสร้างสรรค์ - ตั้ง

max_tokensให้กว้างพอสำหรับรีแฟกเตอร์ใหญ่หรือชุดทดสอบยาว

ขอยูนิตเทสต์และคำอธิบายเหตุผล

เมื่อขอโค้ด ให้ขอทั้งยูนิตเทสต์และคำอธิบายอัลกอริทึมสั้นๆ เพื่อช่วยตรวจจับบั๊กละเอียดและได้สิ่งที่รันได้ตั้งแต่ครั้งแรก

การอนุมานงานยาวและการติดตามสถานะ

โมเดล M2.5 มีระบบติดตามสถานะที่ยอดเยี่ยม ทำให้ความคิดต่อเนื่องและมีทิศทางในลำดับเวลาที่ยาว โดยมุ่งเน้นวัตถุประสงค์จำนวนจำกัดในแต่ละครั้งแทนที่จะประมวลผลทุกอย่างแบบขนาน M2.5 มีฟังก์ชันที่ตระหนักบริบท ช่วยให้ปฏิบัติงานได้อย่างมีประสิทธิภาพและบริหารจัดการบริบทได้เหมาะสม

เคล็ดลับการใช้ M2.5 ในงานโปรดักชัน

MiniMax-M2.5 ถูกปรับจูนเพื่อเวิร์กโฟลว์หลายขั้นตอนและโค้ด ด้านล่างคือเคล็ดลับเชิงปฏิบัติที่ได้จากประสบการณ์เพื่อให้ผลลัพธ์ดีที่สุดในโปรดักชัน

การออกแบบพรอมต์และ system messages

- ใช้ system messages ที่ระบุบทบาทและข้อจำกัดอย่างชัดเจน สำหรับงานโค้ด ให้รวม runtime/เฟรมเวิร์กทดสอบที่ต้องการ (เช่น “ส่งคืน pytest ที่เข้ากันกับ Python 3.11”)

- ส่งมอบบริบท: สำหรับงานเชิงเอเจนต์หรือหลายขั้นตอน ให้รวมเมทาดาทาของขั้นและคำอธิบายเครื่องมือเป็น JSON โครงสร้างหรือรายการหัวข้อ M2.5 ตอบสนองต่ออินพุตที่มีโครงสร้างได้ดีเพราะถูกปรับให้เหมาะกับการใช้เครื่องมือ

การเรียกใช้ฟังก์ชัน/เครื่องมือ

- หากใช้ CometAPI เป็นเกตเวย์สำหรับการเรียกใช้เครื่องมือ ตรวจสอบให้แน่ใจว่า field เพิ่มเติมของคุณ (เช่น

function_callแบบ OpenAI) ตรงกับความคาดหมายของ CometAPI/โมเดล ยืนยันการรองรับโมเดลในหน้ารายละเอียดโมเดลของ Comet เพราะความหมายเชิงเครื่องมืออาจต่างกันไปตามผู้ให้บริการ - เพื่อการจัดงานที่แข็งแรง แบ่งงานใหญ่เป็นการเรียกหลายครั้งย่อยและคงจุดตรวจแบบกำหนดแน่นอน M2.5 แข็งแรงในการทำตามคำสั่งหลายขั้นตอน แต่คุณจะได้พฤติกรรมที่น่าเชื่อถือที่สุดด้วยการตรวจสอบหลังแต่ละขั้น

Temperature, max_tokens และการควบคุมต้นทุน

- สำหรับการสร้างหรือรีแฟกเตอร์โค้ด ตั้ง

temperatureต่ำ (0.0–0.2) และใช้max_tokensให้เหมาะกับขนาดผลลัพธ์ที่คาด - สำหรับพรอมต์เชิงสำรวจ เพิ่ม

temperatureแต่เฝ้าดูการใช้โทเคนที่เพิ่มขึ้น เมื่อส่งผ่าน CometAPI เปรียบเทียบราคาและกฎสำรองของผู้ให้บริการ — CometAPI แสดงราคาต่อโทเคนของแต่ละอินสแตนซ์โมเดลในแคตตาล็อก

หน้าต่างบริบทและเอกสารยาว

- รุ่นย่อยของ M2.5 มักรองรับบริบทยาว (ตรวจสเปกโมเดลสำหรับความยาวบริบท) สำหรับเอกสารยาวมาก ให้ตัดแบ่งและสรุป — แล้วป้อนสรุปพร้อมชิ้นส่วนที่เกี่ยวข้อง แทนการส่งไฟล์ทั้งฉบับในคำขอเดียว

ความปลอดภัย เนื้อหาที่เป็นพิษ และการลดอาการหลอน

- ใช้ราวกั้น: system messages ตัวตรวจจากภายนอก และชุดทดสอบ (เช่น ยูนิตเทสต์สำหรับโค้ดที่สร้าง) ช่วยลดความเสี่ยง

- ตรวจสอบข้อมูลภายนอก: หากโมเดลอ้างอิงข้อเท็จจริงหรือโค้ดจากเว็บ ให้ยืนยันแบบโปรแกรมมิงก่อนเชื่อถือหรือส่งมอบ

ข้อผิดพลาดที่พบบ่อยและวิธีหลีกเลี่ยง

ข้อผิดพลาด: เชื่อถือผลลัพธ์โมเดลครั้งเดียวเกินไป

แนวทางบรรเทา: รันทดสอบ เช็กแบบสแตติก และสำหรับตรรกะวิกฤติ ขอผลลัพธ์หลายชุดที่เป็นอิสระและเปรียบเทียบ CometAPI อนุญาตให้สลับระหว่างหลายโมเดลได้ และคุณสามารถสลับได้ตลอดเวลาโดยใช้รูปแบบแชตของ OpenAI

ข้อผิดพลาด: ใช้ temperature สูงสำหรับโค้ดโปรดักชัน

แนวทางบรรเทา: คง temperature ให้ต่ำ หากต้องการทางเลือกเชิงสร้างสรรค์ ให้ขอหลายเวอร์ชันที่ค่า temperature ต่ำ หรือขอให้โมเดลอธิบายความแตกต่าง

ข้อผิดพลาด: ละเลยการจัดเวอร์ชันโมเดล

แนวทางบรรเทา: ติดตามชื่อโมเดลและสตริงผู้ให้บริการในไฟล์กำหนดการดีพลอย เมื่อสลับจาก MiniMax-M2.5 ไป MiniMax-M2.5-highspeed หรือไปผู้ให้บริการอื่น ให้ถือว่าเป็นการเปลี่ยนรุ่นและรันรีเกรสชันทดสอบ

ข้อแนะนำสุดท้ายและความคาดหวังที่สมจริง

MiniMax-M2.5 เป็นอีกก้าวสำคัญของ LLM ที่เน้นโค้ดและเอเจนต์ — ให้คำมั่นเรื่องการสร้างโค้ดที่แข็งแกร่ง การให้เหตุผลหลายเทิร์น และพฤติกรรมการใช้เครื่องมืออย่างปลอดภัย หากความสำคัญของทีมคุณคือการสร้างเครื่องมือสำหรับนักพัฒนา เฟรมเวิร์กเอเจนต์ หรือผู้ช่วยด้านโค้ด M2.5 สมควรอยู่ในเมทริกซ์เปรียบเทียบของคุณ การใช้ CometAPI เป็นเกตเวย์รวมช่วยเร่งการทดลอง และให้คุณสลับผู้ให้บริการหรือทดสอบ A/B ระหว่างโมเดลได้โดยไม่ต้องรื้อการผสานรวมทั้งระบบ

ข้อคิดเชิงปฏิบัติไม่กี่ข้อ:

- สร้างต้นแบบอย่างรวดเร็วด้วย playground ของ CometAPI จากนั้นล็อกไอดีโมเดลไว้ในโค้ด

- ใช้ค่า temperature ต่ำ ขอเทสต์และคำอธิบาย และรันการตรวจอัตโนมัติเสมอ

- มองโมเดลเป็นผู้พัฒนาร่วมที่ทรงพลัง — ไม่ใช่ผู้ไม่ผิดพลาด: ใช้การทบทวนโดยมนุษย์ สาย CI และเทเลเมทรี

นักพัฒนาสามารถเข้าถึง MInimax-M2.5 ผ่าน CometAPI ได้แล้วตอนนี้ เริ่มต้นด้วยการสำรวจความสามารถของโมเดลใน Playground และดู API guide เพื่อคำแนะนำโดยละเอียด ก่อนเข้าถึง กรุณาเข้าสู่ระบบ CometAPI และขอรับคีย์ API ให้เรียบร้อย CometAPI ให้ราคาต่ำกว่าราคาทางการมากเพื่อช่วยให้คุณผสานรวมได้

พร้อมเริ่มหรือยัง?→ Sign up fo M2.5 today!

หากต้องการเคล็ดลับ คู่มือ และข่าวสารด้าน AI เพิ่มเติม โปรดติดตามเราบน VK, X และ Discord!