Llama 4 API เป็นอินเทอร์เฟซอันทรงพลังที่ช่วยให้นักพัฒนาสามารถบูรณาการ Metaโมเดลภาษาขนาดใหญ่มัลติโหมดรุ่นล่าสุดช่วยให้สามารถประมวลผลข้อความ ภาพ และวิดีโอขั้นสูงได้ในแอปพลิเคชันต่างๆ

ภาพรวมของซีรีย์ Llama 4

ซีรีส์ Llama 4 ของ Meta นำเสนอโมเดล AI ล้ำสมัยที่ออกแบบมาเพื่อประมวลผลและแปลรูปแบบข้อมูลต่างๆ รวมถึงข้อความ วิดีโอ รูปภาพ และเสียง จึงช่วยเพิ่มความคล่องตัวในการใช้งานต่างๆ ซีรีส์นี้ประกอบด้วย:

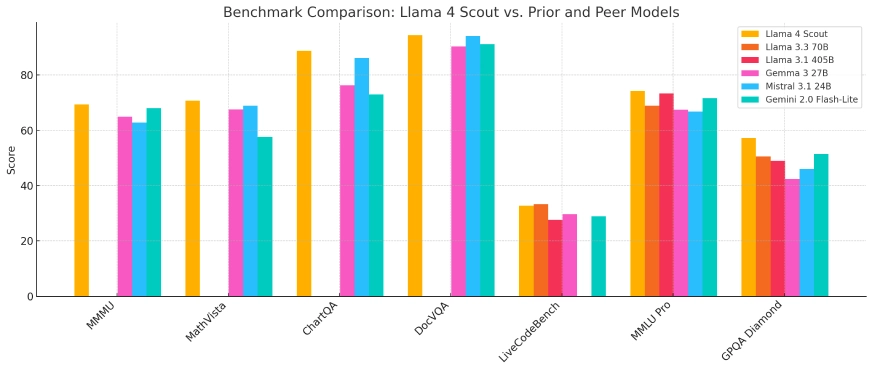

- ลามะ 4 ลูกเสือ:โมเดลขนาดกะทัดรัดที่ปรับให้เหมาะสมสำหรับการใช้งานบน GPU Nvidia H100 ตัวเดียว โดยมีหน้าต่างบริบท 10 ล้านโทเค็น โมเดลนี้มีประสิทธิภาพเหนือกว่าคู่แข่ง เช่น Gemma 3 และ Mistral 3.1 ของ Google ในเกณฑ์มาตรฐานต่างๆ

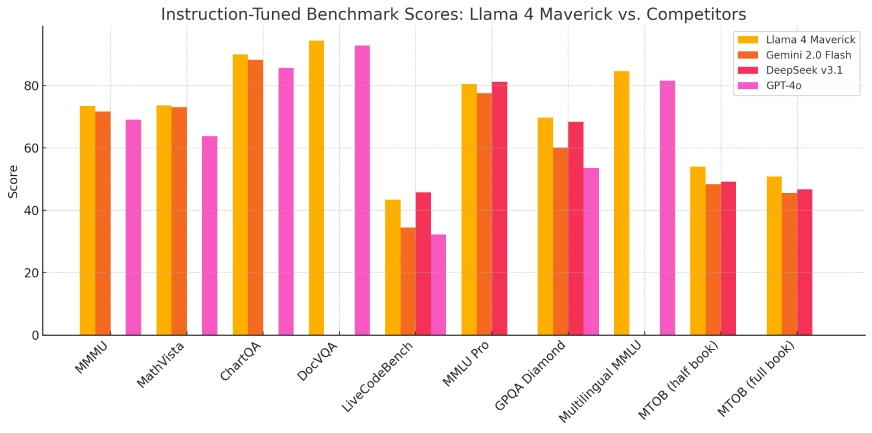

- ลามะ 4 มาเวอริค:โมเดลขนาดใหญ่ที่มีประสิทธิภาพเทียบเคียงได้กับ GPT-4o และ DeepSeek-V3 ของ OpenAI ในงานการเข้ารหัสและการใช้เหตุผล ในขณะที่ใช้พารามิเตอร์ที่ทำงานอยู่น้อยลง

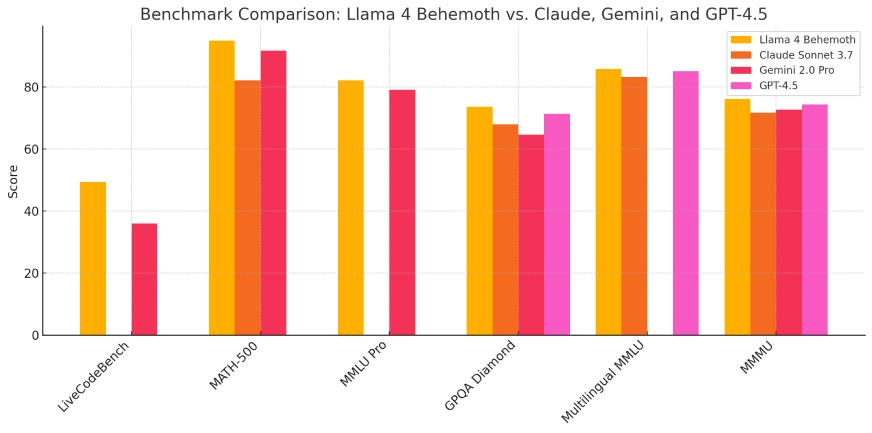

- ลามะ 4 เบเฮมอธ:ขณะนี้อยู่ระหว่างการพัฒนา โดยโมเดลนี้มีพารามิเตอร์ที่ใช้งานอยู่ 288 พันล้านรายการ และมีทั้งหมด 2 ล้านล้านรายการ โดยมีเป้าหมายที่จะแซงหน้าโมเดลเช่น GPT-4.5 และ Claude Sonnet 3.7 ในเกณฑ์มาตรฐาน STEM

โมเดลเหล่านี้ถูกรวมเข้ากับผู้ช่วย AI ของ Meta บนแพลตฟอร์มต่างๆ เช่น WhatsApp, Messenger, Instagram และเว็บไซต์ เพื่อปรับปรุงการโต้ตอบของผู้ใช้ด้วยความสามารถ AI ขั้นสูง

| รุ่น | พารามิเตอร์ทั้งหมด | พารามิเตอร์ที่ใช้งาน | ผู้เชี่ยวชาญ | ความยาวบริบท | วิ่งบน | การเข้าถึงสาธารณะ | เหมาะสำหรับ |

|---|---|---|---|---|---|---|---|

| แมวมอง | 109B | 17B | 16 | โทเค็น 10 ล้าน | Nvidia H100 ตัวเดียว | ✅ใช่ | งาน AI น้ำหนักเบา แอปที่มีบริบทยาว |

| นอกรีต | 400B | 17B | 128 | ไม่ได้ระบุ | GPU ตัวเดียวหรือหลายตัว | ✅ใช่ | การวิจัย แอปพลิเคชันสำหรับองค์กร การเขียนโค้ด |

| behemoth | ~2ต. | 288B | 16 | ไม่ได้ระบุ | เมตาอินเทอร์นัลอินฟรา | ❌ไม่ | การฝึกอบรมและการเปรียบเทียบแบบจำลองภายใน |

สถาปัตยกรรมทางเทคนิคและนวัตกรรม

ซีรีส์ Llama 4 ใช้สถาปัตยกรรม "การผสมผสานผู้เชี่ยวชาญ" (MoE) ซึ่งเป็นแนวทางใหม่ที่ช่วยเพิ่มประสิทธิภาพการใช้ทรัพยากรโดยเปิดใช้งานเฉพาะชุดย่อยที่เกี่ยวข้องของพารามิเตอร์ของโมเดลระหว่างงานเฉพาะ การออกแบบนี้ช่วยเพิ่มประสิทธิภาพและประสิทธิผลในการคำนวณ ทำให้โมเดลสามารถจัดการงานที่ซับซ้อนได้อย่างมีประสิทธิภาพมากขึ้น

การฝึกโมเดลเหล่านี้ต้องใช้ทรัพยากรการคำนวณจำนวนมาก Meta ใช้คลัสเตอร์ GPU ที่ประกอบด้วยชิป Nvidia H100,000 มากกว่า 100 ตัว ซึ่งถือเป็นโครงสร้างพื้นฐานการฝึก AI ที่ใหญ่ที่สุดแห่งหนึ่งในปัจจุบัน พลังการคำนวณที่ครอบคลุมนี้ช่วยให้พัฒนาโมเดลที่มีความสามารถและตัวชี้วัดประสิทธิภาพที่เพิ่มขึ้นได้

วิวัฒนาการจากรุ่นก่อนหน้า

ซีรีส์ Llama 4 สร้างขึ้นบนรากฐานที่วางไว้ในรุ่นก่อนหน้า ถือเป็นวิวัฒนาการครั้งสำคัญในการพัฒนาโมเดล AI ของ Meta การผสานความสามารถในการประมวลผลแบบหลายโหมดและการนำสถาปัตยกรรม MoE มาใช้แก้ไขข้อจำกัดที่พบในรุ่นก่อนหน้า เช่น ความท้าทายในการใช้เหตุผลและงานทางคณิตศาสตร์ ความก้าวหน้าเหล่านี้ทำให้ Llama 4 เป็นคู่แข่งที่น่าเกรงขามในภูมิทัศน์ AI

เกณฑ์มาตรฐานประสิทธิภาพและตัวบ่งชี้ทางเทคนิค

ในการประเมินประสิทธิภาพ Llama 4 Scout แสดงให้เห็นถึงประสิทธิภาพที่เหนือกว่าโมเดลต่างๆ เช่น Gemma 3 และ Mistral 3.1 ของ Google โดยเฉพาะอย่างยิ่งในงานที่ต้องใช้การประมวลผลบริบทอย่างครอบคลุม Llama 4 Maverick แสดงให้เห็นถึงความสามารถที่ทัดเทียมกับโมเดลชั้นนำ เช่น GPT-4o ของ OpenAI โดยเฉพาะอย่างยิ่งในงานการเข้ารหัสและการใช้เหตุผล ในขณะที่ยังคงรักษาการใช้พารามิเตอร์ที่มีประสิทธิภาพมากขึ้น ผลลัพธ์เหล่านี้เน้นย้ำถึงประสิทธิภาพของสถาปัตยกรรม MoE และระเบียบการฝึกอบรมที่ครอบคลุมที่ใช้

ลามะ 4 ลูกเสือ

ลามะ 4 มาเวอริค

ลามะ 4 เบเฮมอธ:

สถานการณ์แอ็พพลิเคชัน

ความคล่องตัวของซีรีย์ Llama 4 ช่วยให้สามารถนำไปใช้กับโดเมนต่างๆ ได้:

- การบูรณาการสื่อสังคม:การปรับปรุงการโต้ตอบของผู้ใช้บนแพลตฟอร์มต่างๆ เช่น WhatsApp, Messenger และ Instagram ผ่านคุณลักษณะขั้นสูงที่ขับเคลื่อนด้วย AI รวมถึงคำแนะนำเนื้อหาที่ได้รับการปรับปรุงและตัวแทนสนทนา

- การสร้างเนื้อหา:ช่วยให้ผู้สร้างสรรค์สร้างเนื้อหาคุณภาพสูงหลายโหมดโดยการประมวลผลและสังเคราะห์ข้อความ รูปภาพ และวิดีโอ จึงทำให้กระบวนการสร้างสรรค์มีประสิทธิภาพมากขึ้น

- เครื่องมือการศึกษา:อำนวยความสะดวกในการพัฒนาระบบสอนพิเศษอัจฉริยะ ที่สามารถตีความและตอบสนองรูปแบบข้อมูลต่างๆ ได้ มอบประสบการณ์การเรียนรู้ที่สมจริงยิ่งขึ้น

- การวิเคราะห์ธุรกิจ:ช่วยให้องค์กรสามารถวิเคราะห์และตีความชุดข้อมูลที่ซับซ้อน รวมถึงข้อมูลข้อความและภาพ เพื่อให้ได้ข้อมูลเชิงลึกที่สามารถดำเนินการได้ และแจ้งข้อมูลสำหรับกระบวนการตัดสินใจ

การผสานรวมโมเดล Llama 4 เข้ากับแพลตฟอร์มของ Meta แสดงให้เห็นถึงประโยชน์ใช้สอยเชิงปฏิบัติและศักยภาพในการปรับปรุงประสบการณ์ของผู้ใช้ในแอปพลิเคชันที่หลากหลาย

การพิจารณาทางจริยธรรมและกลยุทธ์โอเพนซอร์ส

แม้ว่า Meta จะส่งเสริมซีรีส์ Llama 4 ให้เป็นโอเพ่นซอร์ส แต่เงื่อนไขการอนุญาตสิทธิ์ก็มีข้อจำกัดสำหรับนิติบุคคลเชิงพาณิชย์ที่มีผู้ใช้มากกว่า 700 ล้านคน แนวทางนี้ทำให้เกิดการวิพากษ์วิจารณ์จาก Open Source Initiative ซึ่งเน้นถึงการถกเถียงอย่างต่อเนื่องเกี่ยวกับความสมดุลระหว่างการเข้าถึงแบบโอเพ่นซอร์สและผลประโยชน์เชิงพาณิชย์ในการพัฒนา AI

การลงทุนครั้งใหญ่ของ Meta ที่รายงานว่าสูงถึง 65 ล้านดอลลาร์ในโครงสร้างพื้นฐาน AI เน้นย้ำถึงความมุ่งมั่นของบริษัทในการพัฒนาขีดความสามารถของ AI และรักษาความได้เปรียบทางการแข่งขันในภูมิทัศน์ AI ที่เปลี่ยนแปลงอย่างรวดเร็ว

สรุป

การเปิดตัวซีรีส์ Llama 4 ของ Meta ถือเป็นความก้าวหน้าครั้งสำคัญในด้านปัญญาประดิษฐ์ ซึ่งแสดงให้เห็นถึงการปรับปรุงที่สำคัญในด้านการประมวลผลแบบหลายโหมด ประสิทธิภาพ และประสิทธิภาพการทำงาน ผ่านการออกแบบสถาปัตยกรรมที่สร้างสรรค์และการลงทุนด้านการคำนวณจำนวนมาก โมเดลเหล่านี้จึงสร้างมาตรฐานใหม่ในด้านความสามารถของ AI ในขณะที่ Meta ยังคงบูรณาการโมเดลเหล่านี้ในแพลตฟอร์มต่างๆ และสำรวจการพัฒนาเพิ่มเติม ซีรีส์ Llama 4 ก็พร้อมที่จะมีบทบาทสำคัญในการกำหนดทิศทางในอนาคตของแอปพลิเคชันและบริการ AI

วิธีการเรียกใช้ Llama 4 API จาก CometAPI

1.ล็อกอิน ไปยัง โคเมตาปิดอทคอม. หากคุณยังไม่ได้เป็นผู้ใช้ของเรา กรุณาลงทะเบียนก่อน

2.รับรหัส API ของข้อมูลรับรองการเข้าถึง ของอินเทอร์เฟซ คลิก "เพิ่มโทเค็น" ที่โทเค็น API ในศูนย์ส่วนบุคคล รับคีย์โทเค็น: sk-xxxxx และส่ง

-

รับ URL ของเว็บไซต์นี้: https://api.cometapi.com/

-

เลือก Llama 4 (ชื่อรุ่น: ลามะ-4-ผู้ไม่ฝักใฝ่ฝ่ายใด; ลามะ-4-ลูกเสือ) จุดสิ้นสุดในการส่งคำขอ API และกำหนดเนื้อหาคำขอ วิธีการคำขอและเนื้อหาคำขอจะได้รับจาก เอกสาร API ของเว็บไซต์ของเราเว็บไซต์ของเรายังให้บริการทดสอบ Apifox เพื่อความสะดวกของคุณอีกด้วย

- สำหรับข้อมูลการเปิดตัวโมเดลใน Comet API โปรดดู https://api.cometapi.com/new-model.

- สำหรับข้อมูลราคาโมเดลใน Comet API โปรดดู https://api.cometapi.com/pricing

| Category | ลามะ-4-ผู้ไม่ฝักใฝ่ฝ่ายใด | ลามะ-4-ลูกเสือ |

| ราคา API | อินพุตโทเค็น: $0.48 / M โทเค็น | อินพุตโทเค็น: $0.216 / M โทเค็น |

| โทเค็นเอาต์พุต: $1.44/ M โทเค็น | โทเค็นเอาต์พุต: $1.152/ M โทเค็น |

- ประมวลผลการตอบสนองของ API เพื่อรับคำตอบที่สร้างขึ้น หลังจากส่งคำขอ API แล้ว คุณจะได้รับอ็อบเจ็กต์ JSON ที่มีคำตอบที่สร้างขึ้น