มินิแม็กซ์ เอ็มทู เป็น โอเพ่นซอร์ส, เอเจนต์เนทีฟ แบบจำลองภาษาขนาดใหญ่ (LLM) ที่เผยแพร่โดย MiniMax บน 27 ตุลาคม 2025. ได้รับการออกแบบมาโดยเฉพาะสำหรับ การเข้ารหัส และ เวิร์กโฟลว์ของตัวแทน (การเรียกเครื่องมือ, การทำงานอัตโนมัติหลายขั้นตอน), การจัดลำดับความสำคัญ เวลาแฝงต่ำ และ ค่าใช้จ่ายที่มีประสิทธิภาพ การให้บริการพร้อมส่งมอบความสามารถในการใช้เหตุผลและเครื่องมือที่แข็งแกร่ง

หัวข้อสำคัญ

ไฮไลท์ — ความเชี่ยวชาญด้านการเขียนโค้ด, เวิร์กโฟลว์ของตัวแทน, รอยเท้าพารามิเตอร์ที่ใช้งานต่ำ, การสนับสนุนบริบทยาว, API ที่เข้ากันได้กับ OpenAI. ตำแหน่งมินิแม็กซ์ มินิแม็กซ์ เอ็มทู เป็น โมเดล MoE ที่รวดเร็วและใช้งานง่าย มีไว้สำหรับตัวแทนหลายขั้นตอน การสร้างและซ่อมแซมโค้ด เวิร์กโฟลว์เทอร์มินัล/IDE และการเรียกใช้เครื่องมือ

หัวข้อสำคัญ (ด่วน):

- สถาปัตยกรรม: ส่วนผสมของผู้เชี่ยวชาญ (MoE) ที่มีจำนวนพารามิเตอร์รวมที่มากและมีขนาดเล็ก เปิดใช้งาน ชุดพารามิเตอร์ต่อการส่งต่อ

- รอยเท้าการเปิดใช้งาน: ~พารามิเตอร์ที่ใช้งาน 10 พันล้านรายการ (ต่อโทเค็น)

- พารามิเตอร์รวม (รายงาน): รายงานระหว่าง ~200บ. – 230บ. ขึ้นอยู่กับแหล่งที่มา/หน่วยเมตริก (ดู รายละเอียดทางเทคนิค).

- หน้าต่างบริบท: บริบทยาวในระดับองค์กร โทเค็น 204,800 บริบทสูงสุด

- วิธีการหลัก: ข้อความ (รองรับการเรียกใช้เครื่องมือ / การเรียกใช้ฟังก์ชัน)

- ตัวแทนพื้นเมือง: ออกแบบมาสำหรับการเรียกเครื่องมือหลายขั้นตอน (เชลล์, เบราว์เซอร์, อินเทอร์พรีเตอร์ Python, เครื่องมือ MCP)

- การมุ่งเน้นการเขียนโค้ด:ปรับให้เหมาะสมสำหรับการแก้ไขไฟล์หลายไฟล์ ลูปการแก้ไขแบบรัน-แก้ไข และงาน CI/IDE

รายละเอียดทางเทคนิค (สถาปัตยกรรมและข้อมูลจำเพาะ)

สถาปัตยกรรม - ส่วนผสมของผู้เชี่ยวชาญ (MoE): มินิแม็กซ์ เอ็มทู API ใช้กลยุทธ์ MoE เพื่อให้โมเดลสามารถมีได้ จำนวนพารามิเตอร์รวมที่ใหญ่มาก ในขณะที่เปิดใช้งานเพียงเศษส่วนต่อขั้นตอนการอนุมาน วิธีนี้ทำให้ได้ผลลัพธ์ที่ดีขึ้น ประสิทธิภาพการคำนวณ, ปริมาณงานและ ต้นทุนต่อโทเค็น สำหรับตัวแทนแบบโต้ตอบและลูปการเข้ารหัส

ความแม่นยำและการวัดปริมาณ — ไฟล์โมเดลและรายชื่อสแต็กของผู้ให้บริการรูปแบบ FP32/BF16 และ FP8 และการสร้างเชิงปริมาณหลายรายการ (เซฟเทนเซอร์ FP8/E4M3 เป็นต้น) ช่วยให้สามารถปรับใช้ในพื้นที่และแลกเปลี่ยนประสิทธิภาพได้

บริบทและ I/O — ผู้ให้บริการที่ปรับใช้เผยแพร่ โทเค็น 204,800 การรองรับบริบทและการตั้งค่าเอาต์พุตสูงสุดขนาดใหญ่ M2 คือ ข้อความเท่านั้น ในตอนนี้ (รุ่นเปิดน้ำหนักจำนวนมากจากจีนเน้นความสามารถของข้อความ/ตัวแทนในขณะที่มัลติโหมดยังคงเป็นโดเมนของรุ่นอื่นๆ)

คำแนะนำการรันไทม์ / คำแนะนำพิเศษ — มินิแม็กซ์ เอ็มทู API ใช้ “การคิดแบบสลับกัน” รูปแบบเอาท์พุตที่ห่อหุ้มเหตุผลภายในของโมเดลใน <think>...</think> บล็อก คำขอของ MiniMax ให้รักษาเนื้อหาการคิดนั้นไว้และส่งกลับไปยังบริบททางประวัติศาสตร์เพื่อรักษาประสิทธิภาพสำหรับเวิร์กโฟลว์ของตัวแทนหลายรอบ

ประสิทธิภาพมาตรฐาน

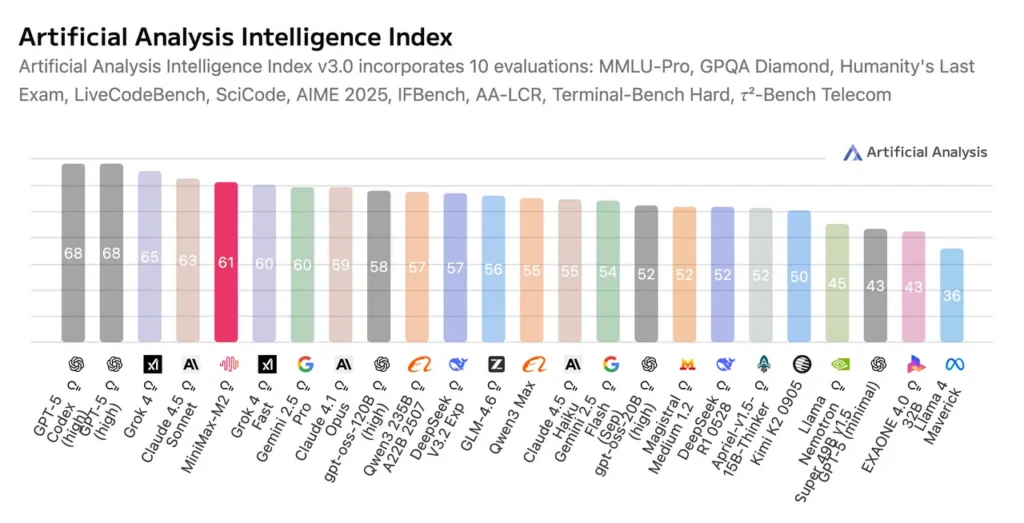

การเปรียบเทียบประสิทธิภาพข่าวกรองและตัวแทนแบบผสม — การเปรียบเทียบประสิทธิภาพอิสระโดยการวิเคราะห์เชิงเทียมรายงานว่า MiniMax-M2 บรรลุดัชนีสติปัญญาที่ดีที่สุดในระดับเดียวกันในบรรดารุ่นน้ำหนักเปิดและอยู่ในอันดับ โมเดลโอเพนซอร์สชั้นนำ เกี่ยวกับเมตริกข่าวกรองเชิงผสม โดยเฉพาะอย่างยิ่งใน การใช้เครื่องมือ การปฏิบัติตามคำแนะนำ และงานของตัวแทนการวิเคราะห์เชิงประดิษฐ์เน้นย้ำถึงโมเดล อย่างมีประสิทธิภาพ (มีพารามิเตอร์ที่ใช้งานอยู่เพียงไม่กี่ตัว) เป็นตัวขับเคลื่อนหลักในการจัดอันดับ

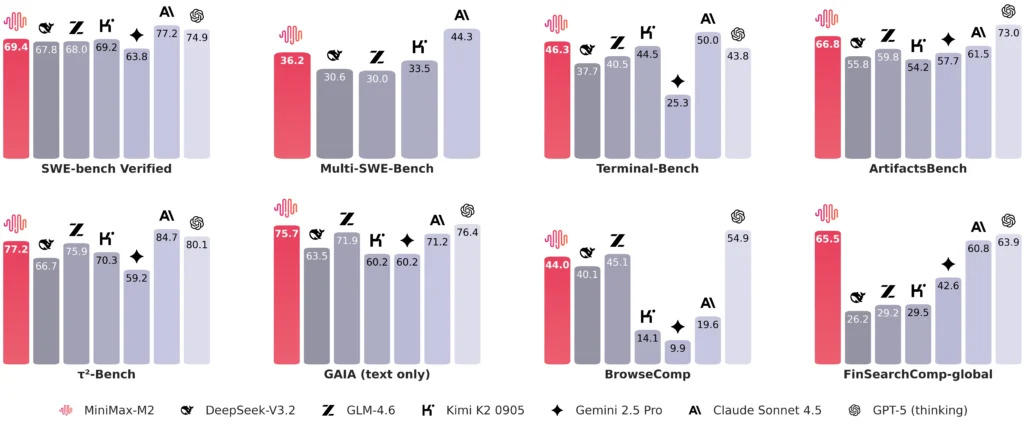

มินิแม็กซ์ เอ็มทู แสดงให้เห็นว่า ผลลัพธ์ที่แข็งแกร่งในชุดการเข้ารหัสและตัวแทน (งานประเภท Terminal-Bench, SWE-Bench, BrowseComp, LiveCodeBench) โดยที่สถาปัตยกรรมและงบประมาณการเปิดใช้งานเอื้อต่อการวางแผน → การดำเนินการ → การตรวจสอบวงจร (รอบการรวบรวม/การรัน/การทดสอบ การแก้ไขไฟล์หลายไฟล์ และชุดเครื่องมือ)

การเปรียบเทียบ: MiniMax M2 กับรุ่นอื่นๆ ในปัจจุบัน

เมื่อเทียบกับคู่แข่งที่มีน้ำหนักเปิด (DeepSeek, Qwen3, Kimi ฯลฯ) — มินิแม็กซ์ เอ็มทู ถูกนำเสนอเป็น มีประสิทธิภาพโดยเฉพาะ ในงบพารามิเตอร์ที่ใช้งานอยู่ (≈10B) ทำให้มีอัตราส่วนความฉลาดต่อพารามิเตอร์ที่ใช้งานอยู่ที่แข็งแกร่ง โมเดลเปิดอื่นๆ อาจมีจำนวนพารามิเตอร์ที่ใช้งานอยู่ที่สูงกว่า แต่พารามิเตอร์รวมที่ใกล้เคียงกันหรือสูงกว่า

ต่อต้านโมเดลชายแดนเชิงพาณิชย์ (OpenAI / Anthropic / Google / xAI) — สถานที่รายงาน M2 ต่ำกว่ารุ่นเชิงพาณิชย์ชั้นนำ ตามเกณฑ์ทั่วไปบางประการแต่ การแข่งขันหรือก้าวหน้า ในเกณฑ์มาตรฐานด้านเอเจนต์และการเข้ารหัสมากมายสำหรับจุดราคา

การแลกเปลี่ยนระหว่างต้นทุนและความเร็ว — ต้นทุนต่อโทเค็นนั้นมีเพียง 8% ของ Anthropic Claude Sonnet และความเร็วก็เร็วกว่าประมาณสองเท่า

ข้อจำกัดและความเสี่ยง

ข้อจำกัด — ความเยิ่นเย้อ (การใช้โทเค็นสูง), รูปแบบข้อความอย่างเดียว, จุดอ่อนเฉพาะงานและความเสี่ยงทั่วไปของ LLM (ภาพหลอน ความมั่นใจมากเกินไป อคติจากชุดข้อมูล) ทั้งการวิเคราะห์เชิงประดิษฐ์และ MiniMax ชี้ให้เห็นว่า M2 อาจมีประสิทธิภาพต่ำกว่าแบบจำลองทั่วไปขนาดใหญ่บางแบบในงานปลายเปิดบางประเภท แม้ว่าจะโดดเด่นในเวิร์กโฟลว์เชิงเอเจนต์และการเขียนโค้ดก็ตาม เนื่องจากเป็นแบบ MoE ข้อควรพิจารณาในการปรับใช้ (กรอบการทำงานด้านการกำหนดเส้นทางของผู้เชี่ยวชาญ การวัดปริมาณ และการอนุมาน) มีความสำคัญ

ข้อควรระวังในการปฏิบัติงาน — มินิแม็กซ์ เอ็มทู 's การคิดแบบสลับกัน รูปแบบต้องมีการเก็บรักษาพิเศษ <think>...</think> โทเค็นตลอดประวัติศาสตร์เพื่อประสิทธิภาพที่ดีที่สุด การลบเนื้อหานั้นออกไปอาจทำให้พฤติกรรมของตัวแทนแย่ลง นอกจากนี้ เนื่องจาก มินิแม็กซ์ เอ็มทู คือรายละเอียด ต้นทุนต่องานเป็นฟังก์ชันของทั้งสอง ราคาต่อโทเค็น และ จำนวนโทเค็นทั้งหมดที่สร้างขึ้น.

กรณีการใช้งานหลัก

- การประสานงานของตัวแทนและเวิร์กโฟลว์ที่ยาวนาน — โซ่เครื่องมือหลายขั้นตอน, เรียกดู→ดึงข้อมูล→ดำเนินการตามรอบ, การกู้คืนข้อผิดพลาดและ การตรวจสอบหลักฐาน ตัวแทนกำลังทำงาน

- ผู้ช่วยด้านผลผลิตและการเขียนโค้ดของนักพัฒนา — ลูปคอมไพล์-รัน-ทดสอบ, การแก้ไขหลายไฟล์, การซ่อมแซมที่ผ่านการตรวจสอบการทดสอบและ การรวม IDE (มีตัวอย่าง Claude Code, Cursor, Codex, Grok CLI)

- ตัวแทนกลุ่มปริมาณงานสูง / บอทการผลิต — ที่ไหน ต้นทุนต่อการอนุมาน และ ภาวะพร้อมกัน เรื่องของขนาดพารามิเตอร์ที่เปิดใช้งานต่ำของ M2 จะช่วยลดต้นทุนโครงสร้างพื้นฐานได้

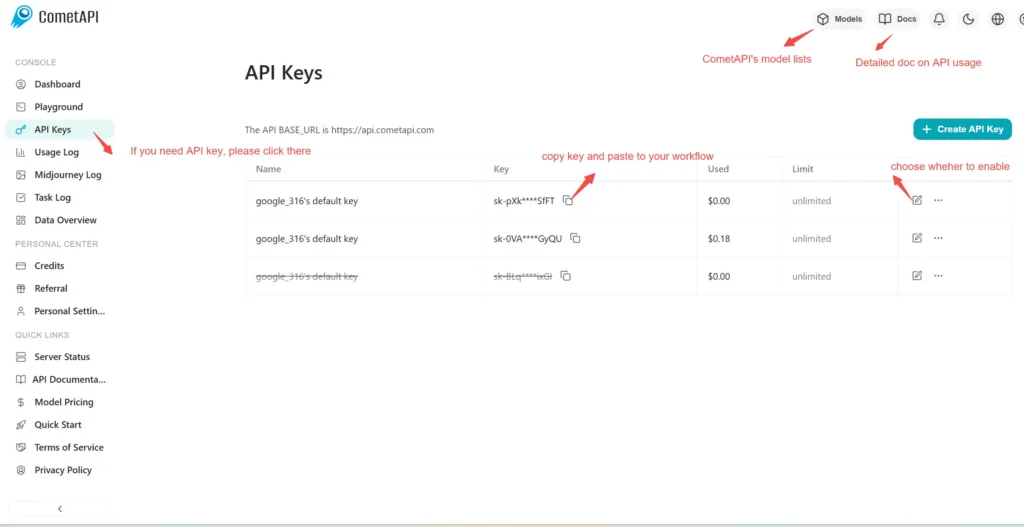

วิธีการโทร มินิแม็กซ์ เอ็มทู API จาก CometAPI

minimax-m2 ราคา API ใน CometAPI ลด 20% จากราคาอย่างเป็นทางการ:

- โทเค็นอินพุต: โทเค็น $0.24 ล้าน

- โทเค็นเอาต์พุต: $0.96/ M โทเค็น

ขั้นตอนที่ต้องดำเนินการ

- เข้าสู่ระบบเพื่อ โคเมตาปิดอทคอม. หากคุณยังไม่ได้เป็นผู้ใช้ของเรา กรุณาลงทะเบียนก่อน

- ลงชื่อเข้าใช้ของคุณ คอนโซล CometAPI.

- รับรหัส API ของข้อมูลรับรองการเข้าถึงของอินเทอร์เฟซ คลิก "เพิ่มโทเค็น" ที่โทเค็น API ในศูนย์ส่วนบุคคล รับรหัสโทเค็น: sk-xxxxx และส่ง

ใช้วิธีการ

- เลือกปลายทาง “minimax-m2” เพื่อส่งคำขอ API และตั้งค่าเนื้อหาคำขอ วิธีการและเนื้อหาคำขอสามารถดูได้จากเอกสาร API ของเว็บไซต์ของเรา เว็บไซต์ของเรายังมีบริการทดสอบ Apifox เพื่อความสะดวกของคุณอีกด้วย

- แทนที่ ด้วยคีย์ CometAPI จริงจากบัญชีของคุณ

- แทรกคำถามหรือคำขอของคุณลงในช่องเนื้อหา—นี่คือสิ่งที่โมเดลจะตอบสนอง

- ประมวลผลการตอบสนองของ API เพื่อรับคำตอบที่สร้างขึ้น

CometAPI มอบ REST API ที่เข้ากันได้อย่างสมบูรณ์ เพื่อการย้ายข้อมูลที่ราบรื่น รายละเอียดสำคัญ เอกสาร API:

- URL ฐาน: https://api.cometapi.com/v1/chat/completions

- ชื่อรุ่น: "

minimax-m2" - รับรองความถูกต้อง:

Bearer YOUR_CometAPI_API_KEYส่วนหัว - ชนิดของเนื้อหา:

application/json.

การรวม API และตัวอย่าง

ด้านล่างคือ หลาม ตัวอย่างที่สาธิตวิธีเรียกใช้ GLM‑4.6 ผ่าน API ของ CometAPI แทนที่ <API_KEY> และ <PROMPT> ตามนั้น:

import requests

API_URL = "https://api.cometapi.com/v1/chat/completions"

headers = {

"Authorization": "Bearer <API_KEY>",

"Content-Type": "application/json"

}

payload = {

"model": "minimax-m2",

"messages": [

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "<PROMPT>"}

],

"max_tokens": 512,

"temperature": 0.7

}

response = requests.post(API_URL, json=payload, headers=headers)

print(response.json())

ดูสิ่งนี้ด้วย คล็อด ไฮกุ 4.5 API