GPT-5.2 API คืออะไร

GPT-5.2 API เหมือนกับ GPT-5.2 Thinking ใน ChatGPT. GPT-5.2 Thinking เป็นรุ่นระดับกลางของตระกูล GPT-5.2 ของ OpenAI ที่ออกแบบมาสำหรับงานที่ ลึกและซับซ้อน: การให้เหตุผลหลายขั้นตอน การสรุปเอกสารยาว การสร้างโค้ดคุณภาพ และงานความรู้เชิงวิชาชีพที่ความแม่นยำและโครงสร้างที่ใช้งานได้สำคัญกว่าปริมาณงานดิบ ใน API รุ่นนี้ถูกเปิดให้ใช้เป็นโมเดล gpt-5.2 (Responses API / Chat Completions) และอยู่กึ่งกลางระหว่างรุ่น Instant ที่หน่วงต่ำ กับรุ่น Pro ที่คุณภาพสูงกว่าแต่มีค่าใช้จ่ายมากกว่า

คุณสมบัติหลัก

- บริบทยาวมากและการบีบอัด: หน้าต่างใช้งานจริง 400K และเครื่องมือบีบอัดเพื่อจัดการความเกี่ยวข้องตลอดบทสนทนาและเอกสารที่ยาว.

- กำหนดความพยายามในการให้เหตุผลได้:

none | medium | high | xhigh(xhigh เปิดใช้การคำนวณภายในสูงสุดสำหรับงานให้เหตุผลที่ยาก)xhighมีให้ใช้ในรุ่น Thinking/Pro. - รองรับเครื่องมือและฟังก์ชันที่แข็งแรงขึ้น: การเรียกใช้เครื่องมือแบบ first-class, ไวยากรณ์ (CFG/Lark) เพื่อจำกัดผลลัพธ์เชิงโครงสร้าง และพฤติกรรมเชิงเอเจนต์ที่ปรับปรุงขึ้นซึ่งช่วยให้ระบบอัตโนมัติหลายขั้นตอนที่ซับซ้อนง่ายขึ้น.

- ความเข้าใจแบบมัลติโหมด: การทำความเข้าใจภาพและข้อความที่ลึกขึ้นและการผสานเข้ากับงานหลายขั้นตอน.

- ความปลอดภัย/การจัดการเนื้อหาที่อ่อนไหวที่ดีขึ้น: การแทรกแซงแบบมุ่งเป้าเพื่อลดการตอบสนองที่ไม่พึงประสงค์ในบริบทอย่างเช่นการทำร้ายตนเองและบริบทอ่อนไหวอื่น ๆ.

ความสามารถและสเปคทางเทคนิค (มุมมองนักพัฒนา)

- API endpoints และรหัสโมเดล:

gpt-5.2สำหรับ Thinking (Responses API),gpt-5.2-chat-latestสำหรับเวิร์กโฟลว์แบบแชต/instant และgpt-5.2-proสำหรับระดับ Pro; ใช้ได้ผ่าน Responses API และ Chat Completions ตามที่ระบุ. - Reasoning tokens และการจัดการความพยายาม: API รองรับพารามิเตอร์แบบชัดเจนเพื่อจัดสรรการคำนวณ (reasoning effort) ต่อคำขอ; ระดับความพยายามที่สูงขึ้นจะเพิ่มเวลาแฝงและค่าใช้จ่าย แต่ช่วยปรับปรุงคุณภาพผลลัพธ์สำหรับงานที่ซับซ้อน.

- เครื่องมือผลลัพธ์เชิงโครงสร้าง: รองรับไวยากรณ์ (Lark / CFG) เพื่อจำกัดผลลัพธ์ของโมเดลให้เป็น DSL หรือไวยากรณ์ที่แม่นยำ (มีประโยชน์สำหรับ SQL, JSON, การสร้าง DSL).

- การเรียกใช้เครื่องมือแบบขนานและการประสานเชิงเอเจนต์: ความขนานที่ดีขึ้นและการจัดการเครื่องมือที่เป็นระเบียบช่วยลดความจำเป็นของพรอมต์ระบบที่ซับซ้อนและโครงร่างหลายเอเจนต์.

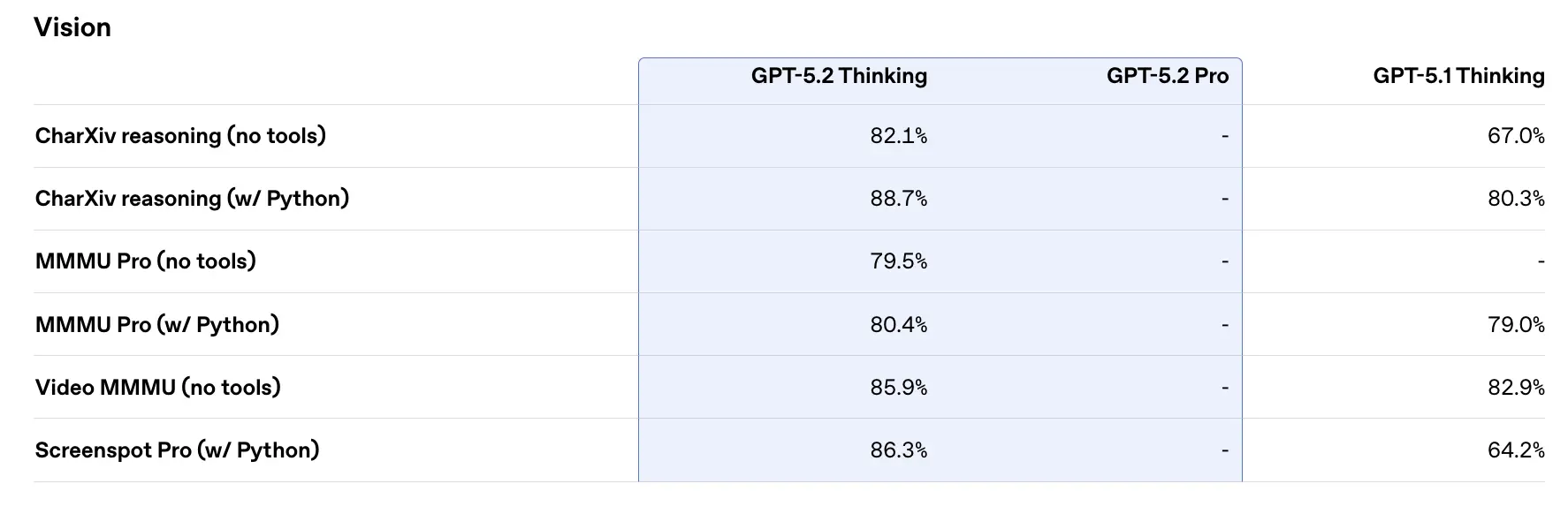

ประสิทธิภาพตามเกณฑ์วัดและข้อมูลประกอบ

OpenAI เผยแพร่ผลการทดสอบภายในและภายนอกหลากหลายสำหรับ GPT-5.2 ไฮไลต์ที่เลือก (ตัวเลขที่รายงานโดย OpenAI):

- GDPval (44 สาขาอาชีพ, งานความรู้) — GPT-5.2 Thinking “beats or ties top industry professionals on 70.9% of comparisons”; OpenAI ระบุว่าผลลัพธ์ถูกสร้างได้ด้วยความเร็ว >11× และต้นทุน <1% เมื่อเทียบกับผู้เชี่ยวชาญในงาน GDPval ของพวกเขา (ประมาณการความเร็วและต้นทุนอิงข้อมูลย้อนหลัง) งานเหล่านี้รวมถึงแบบจำลองสเปรดชีต งานนำเสนอ และวิดีโอสั้น.

- SWE-Bench Pro (การเขียนโค้ด) — GPT-5.2 Thinking ทำได้ ≈55.6% บน SWE-Bench Pro และ ~80% บน SWE-Bench Verified (เฉพาะ Python) ตามที่ OpenAI รายงาน สร้างมาตรฐานใหม่สำหรับการสร้างโค้ด/การประเมินด้านวิศวกรรมในการทดสอบของพวกเขา ซึ่งแปลไปสู่การดีบักที่เชื่อถือได้มากขึ้นและการแก้ไขแบบ end-to-end ในทางปฏิบัติตามตัวอย่างของ OpenAI.

- GPQA Diamond (คำถาม-คำตอบระดับบัณฑิตศึกษาด้านวิทยาศาสตร์) — GPT-5.2 Pro: 93.2%, GPT-5.2 Thinking: 92.4% บน GPQA Diamond (ไม่มีเครื่องมือ, ใช้เหตุผลสูงสุด).

- ARC-AGI series — บน ARC-AGI-2 (เกณฑ์วัดการให้เหตุผลแบบไหลที่ยากกว่า) GPT-5.2 Thinking ได้คะแนน 52.9% และ GPT-5.2 Pro 54.2% (OpenAI ระบุว่านี่เป็นสถิติใหม่สำหรับโมเดลสไตล์ chain-of-thought).

- Long-context (OpenAI MRCRv2) — GPT-5.2 Thinking แสดงความแม่นยำเกือบ 100% บนตัวแปร MRCR แบบ 4-needle จนถึง 256k โทเคน และได้คะแนนที่ดีขึ้นอย่างมากเมื่อเทียบกับ GPT-5.1 ในการตั้งค่าบริบทยาว (OpenAI เผยแพร่กราฟและตาราง MRCRv2).

การเปรียบเทียบกับผลิตภัณฑ์ร่วมสมัย

- เทียบกับ Google Gemini 3 (Gemini 3 Pro / Deep Think): Gemini 3 Pro ได้มีการประชาสัมพันธ์ว่ามีหน้าต่างบริบท ~1,048,576 (≈1M) โทเคน และอินพุตมัลติโหมดที่กว้าง (ข้อความ ภาพ เสียง วิดีโอ PDF) พร้อมการผสานงานเชิงเอเจนต์ที่แข็งแกร่งผ่าน Vertex AI / AI Studio บนกระดาษ หน้าต่างบริบทที่ใหญ่กว่าของ Gemini 3 เป็นจุดเด่นสำหรับงานภาระงานแบบเซสชันเดียวที่ใหญ่มาก; ข้อแลกเปลี่ยนรวมถึงพื้นผิวเครื่องมือและความเหมาะสมกับระบบนิเวศ.

- เทียบกับ Anthropic Claude Opus 4.5: Opus 4.5 ของ Anthropic เน้นเวิร์กโฟลว์ด้านโค้ด/เอเจนต์สำหรับองค์กร และรายงานผล SWE-bench ที่แข็งแกร่งพร้อมความทนทานสำหรับเซสชันเอเจนต์ยาว Anthropic วางตำแหน่ง Opus สำหรับระบบอัตโนมัติและการสร้างโค้ด ด้วยหน้าต่างบริบท 200k และการผสานเฉพาะเอเจนต์/Excel Opus 4.5 เป็นคู่แข่งที่แข็งแรงในงานระบบอัตโนมัติระดับองค์กรและงานโค้ด.

ข้อสรุปเชิงปฏิบัติ: GPT-5.2 มุ่งเป้าไปที่ชุดการปรับปรุงที่สมดุล (บริบท 400k เอาต์พุตโทเคนสูง การให้เหตุผล/การเขียนโค้ดที่ดีขึ้น) ส่วน Gemini 3 มุ่งเน้นบริบทแบบเซสชันเดี่ยวที่ใหญ่ที่สุด (≈1M) ขณะที่ Claude Opus เน้นความทนทานเชิงเอเจนต์และวิศวกรรมสำหรับองค์กร เลือกให้ตรงกับขนาดบริบท ความต้องการมัลติโหมด ความเหมาะสมของฟีเจอร์/เครื่องมือ และข้อแลกเปลี่ยนด้านต้นทุน/เวลาแฝง.

วิธีเข้าถึงและใช้งาน GPT-5.2 API

ขั้นตอนที่ 1: สมัครเพื่อรับ API Key

เข้าสู่ระบบที่ cometapi.com หากยังไม่เป็นผู้ใช้ของเรา โปรดลงทะเบียนก่อน เข้าสู่ CometAPI console รับ API key สำหรับการเข้าถึง คลิก “Add Token” ที่ API token ในศูนย์ส่วนบุคคล รับ token key: sk-xxxxx และส่ง.

ขั้นตอนที่ 2: ส่งคำขอไปยัง GPT-5.2 API

เลือก endpoint “gpt-5.2” เพื่อส่งคำขอ API และตั้งค่า request body วิธีการและ request body ได้จากเอกสาร API บนเว็บไซต์ของเรา เว็บไซต์ของเรายังมีการทดสอบ Apifox เพื่อความสะดวกของคุณ แทนที่ <YOUR_API_KEY> ด้วย CometAPI key จริงจากบัญชีของคุณ นักพัฒนาจะเรียกใช้งานผ่าน Responses API / Chat endpoints

ใส่คำถามหรือคำขอของคุณลงในช่อง content — โมเดลจะตอบสนองต่อสิ่งนี้ จากนั้นประมวลผลการตอบกลับของ API เพื่อรับคำตอบที่สร้างขึ้น

ขั้นตอนที่ 3: ดึงและตรวจสอบผลลัพธ์

ประมวลผลการตอบกลับของ API เพื่อรับคำตอบที่สร้างขึ้น หลังจากประมวลผลแล้ว API จะตอบกลับด้วยสถานะงานและข้อมูลเอาต์พุต

ดูเพิ่มเติม Gemini 3 Pro Preview API