ข้อมูลจำเพาะทางเทคนิคของ GPT-5.4 Mini

| รายการ | GPT-5.4 Mini (ประมาณการจากข้อมูลทางการ + การตรวจสอบไขว้) |

|---|---|

| ตระกูลโมเดล | ซีรีส์ GPT-5.4 (รุ่น “mini” ที่คุ้มค่า) |

| ผู้ให้บริการ | OpenAI |

| ประเภทอินพุต | ข้อความ, รูปภาพ |

| ประเภทเอาต์พุต | ข้อความ |

| หน้าต่างบริบท | 400,000 โทเค็น |

| โทเค็นเอาต์พุตสูงสุด | 128,000 โทเค็น |

| ความรู้ตัด ณ | ~31 พ.ค. 2024 (สืบสายตระกูล mini) |

| รองรับการให้เหตุผล | มี (เบากว่าเวอร์ชันเต็มของ GPT-5.4) |

| รองรับเครื่องมือ | การเรียกใช้ฟังก์ชัน, การค้นเว็บ, การค้นไฟล์, เอเจนต์ (อนุมานจากตระกูล GPT-5) |

| การวางตำแหน่ง | โมเดลความเร็วสูง คุ้มต้นทุน ใกล้ระดับแนวหน้า |

GPT-5.4 Mini คืออะไร?

GPT-5.4 Mini เป็นรุ่นของ GPT-5.4 ที่คุ้มต้นทุนและความเร็วสูง ออกแบบมาสำหรับงานที่ไวต่อความหน่วงและปริมาณสูง นำความสามารถด้านการให้เหตุผล การเขียนโค้ด และมัลติโหมดส่วนสำคัญของ GPT-5.4 มาสู่โมเดลที่เล็กและเร็วกว่า ซึ่งปรับแต่งเพื่อระบบระดับการผลิต

เมื่อเทียบกับรุ่น “mini” ก่อนหน้า GPT-5.4 Mini ถูกวางตำแหน่งเป็นโมเดลขนาดเล็กที่ใกล้ระดับแนวหน้า หมายถึงให้ประสิทธิภาพใกล้เคียงรุ่นธง ในขณะที่ลดต้นทุนและเวลาในการตอบสนองอย่างมาก

คุณสมบัติหลักของ GPT-5.4 Mini

- การอนุมานความเร็วสูง: ปรับให้เหมาะกับแอปพลิเคชันความหน่วงต่ำ เช่น แชตบอต copilot และระบบเรียลไทม์

- หน้าต่างบริบทขนาดใหญ่ (400K): รองรับเอกสารยาว เวิร์กโฟลว์หลายขั้นตอน และหน่วยความจำของเอเจนต์

- รองรับการเขียนโค้ดและเอเจนต์อย่างแข็งแกร่ง: ออกแบบเพื่อการใช้เครื่องมือ การให้เหตุผลหลายขั้นตอน และงานย่อยที่มอบหมายให้ซับเอเจนต์

- อินพุตแบบมัลติโหมด: รองรับทั้งข้อความและรูปภาพเพื่อเวิร์กโฟลว์ที่หลากหลายยิ่งขึ้น

- การสเกลที่คุ้มต้นทุน: ถูกกว่ามากเมื่อเทียบกับ GPT-5.4 ขณะยังคงความสามารถในการให้เหตุผลที่แข็งแกร่ง

- การเพิ่มประสิทธิภาพสายงานของเอเจนต์: เหมาะกับสถาปัตยกรรมหลายโมเดลที่โมเดลใหญ่ทำหน้าที่วางแผนและโมเดล mini ดำเนินการ

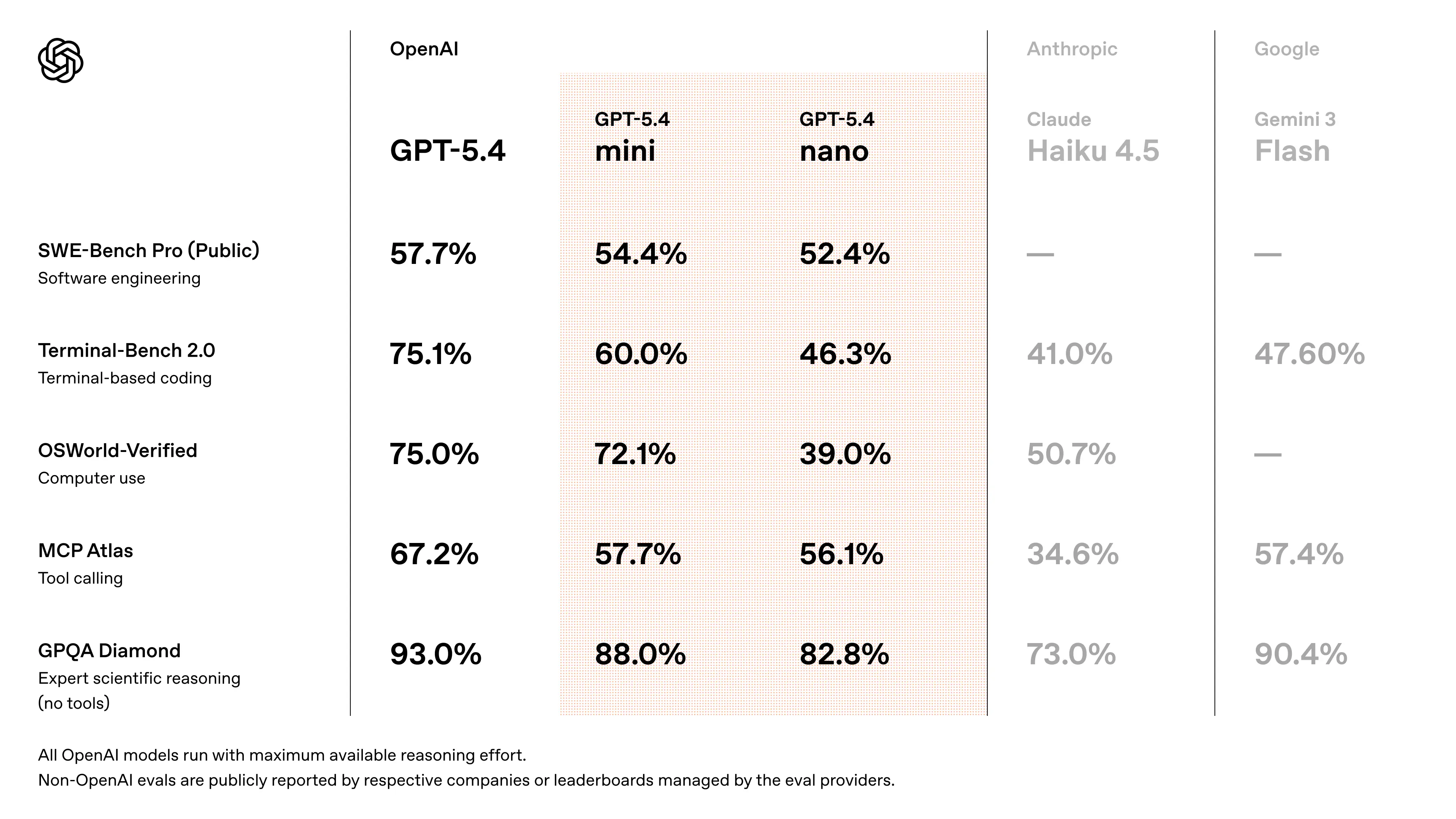

ผลการทดสอบมาตรฐานของ GPT-5.4 Mini

- เข้าใกล้ประสิทธิภาพของ GPT-5.4 ในงานโค้ดแบบ SWE-Bench (ประมาณ 94–95% ของประสิทธิภาพรุ่นธง) (ประมาณการจากการอภิปรายช่วงเปิดตัวแบบตรวจสอบไขว้)

- ปรับปรุงอย่างมีนัยสำคัญเมื่อเทียบกับ GPT-5 Mini ในด้าน:

- ความแม่นยำในการให้เหตุผล

- ความเชื่อถือได้ในการใช้เครื่องมือ

- ความเข้าใจมัลติโหมด

- ออกแบบมาให้เหนือกว่ารุ่น “mini” ก่อนหน้าในเวิร์กโฟลว์ของเอเจนต์และชุดทดสอบงานโค้ด

- การวัดความเร็ว: ผู้ทดสอบ API ระยะแรกระบุ ~180–190 tokens/sec บน GPT-5.4 Mini (เทียบกับ ~55–120 t/s สำหรับรุ่น GPT-5 mini เก่าขึ้นอยู่กับโหมดลำดับความสำคัญ)

👉 สรุปสำคัญ: GPT-5.4 Mini มอบประสิทธิภาพใกล้ระดับแนวหน้าที่ต้นทุนและความหน่วงเพียงเสี้ยวหนึ่ง เหมาะอย่างยิ่งสำหรับระบบที่ต้องการสเกล

กรณีการใช้งานที่เป็นตัวอย่าง

- ผู้ช่วยเขียนโค้ดและเครื่องมือแก้ไข (ปลั๊กอิน IDE, Copilot): การวิเคราะห์บริบทอย่างรวดเร็ว การสำรวจฐานโค้ด และการเติมคำที่ฉับไว ทำให้ GPT-5.4 Mini เหมาะสำหรับคำแนะนำในตัวแก้ไขที่เวลาถึงโทเค็นแรกมีความสำคัญ GitHub Copilot เป็นหนึ่งในการผสานรวมระยะแรก

- ซับเอเจนต์/ผู้ปฏิบัติงานที่ได้รับมอบหมาย: กรณีที่เอเจนต์หลักมอบหมายงานสั้นและเร็ว (การจัดรูปแบบ ขั้นตอนการให้เหตุผลเล็กๆ การค้นแบบ grep) ให้ผู้ปฏิบัติงานที่ราคาถูกและรวดเร็ว OpenAI จัดวาง mini/nano ให้เหมาะกับบทบาทเหล่านี้

- ระบบอัตโนมัติผ่าน API ปริมาณสูง: การสร้างโค้ดจำนวนมาก การคัดกรองทิคเก็ตอัตโนมัติ การสรุป log ในวงกว้าง โดยที่ต้นทุนต่อการเรียกและความหน่วงเป็นข้อจำกัดหลัก ตัวเลขอัตราผ่านของชุมชนบ่งชี้ข้อได้เปรียบด้านปฏิบัติการอย่างมีนัยสำคัญสำหรับรุ่น mini

- การห่อหุ้มเครื่องมือและสายโซ่เครื่องมือ: การเรียกใช้เครื่องมืออย่างรวดเร็วซึ่งโมเดลประสานการเรียกไปยังเครื่องมือภายนอก (search, grep, run tests) และส่งคืนผลลัพธ์ที่กะทัดรัดและนำไปปฏิบัติได้ ตระกูล GPT-5.4 รวมความสามารถ “computer use” ที่ได้รับการปรับปรุง

วิธีเข้าถึง GPT-5.4 Mini API

ขั้นตอนที่ 1: ลงทะเบียนเพื่อรับ API Key

เข้าสู่ระบบที่ cometapi.com หากคุณยังไม่เป็นผู้ใช้ของเรา โปรดลงทะเบียนก่อน ลงชื่อเข้าใช้ CometAPI console รับ API key เพื่อการเข้าถึงอินเทอร์เฟซ คลิก “Add Token” ที่ส่วน API token ในศูนย์ส่วนบุคคล รับ token key: sk-xxxxx แล้วส่ง

ขั้นตอนที่ 2: ส่งคำขอไปยัง GPT-5.4 Mini API

เลือก “gpt-5.4-mini” endpoint เพื่อส่งคำขอ API และกำหนด request body วิธีการเรียกและ request body สามารถดูได้จากเอกสาร API บนเว็บไซต์ของเรา เว็บไซต์ยังมีการทดสอบผ่าน Apifox เพื่อความสะดวกของคุณ แทนที่ <YOUR_API_KEY> ด้วย CometAPI key จริงจากบัญชีของคุณ base url คือ Chat Completions และ Responses.

ใส่คำถามหรือคำขอของคุณลงในช่อง content — ซึ่งเป็นสิ่งที่โมเดลจะตอบกลับ . ประมวลผลการตอบกลับจาก API เพื่อรับคำตอบที่สร้างขึ้น

ขั้นตอนที่ 3: เรียกดูและยืนยันผลลัพธ์

ประมวลผลการตอบกลับจาก API เพื่อรับคำตอบที่สร้างขึ้น หลังจากประมวลผลแล้ว API จะตอบกลับด้วยสถานะงานและข้อมูลผลลัพธ์

.png)