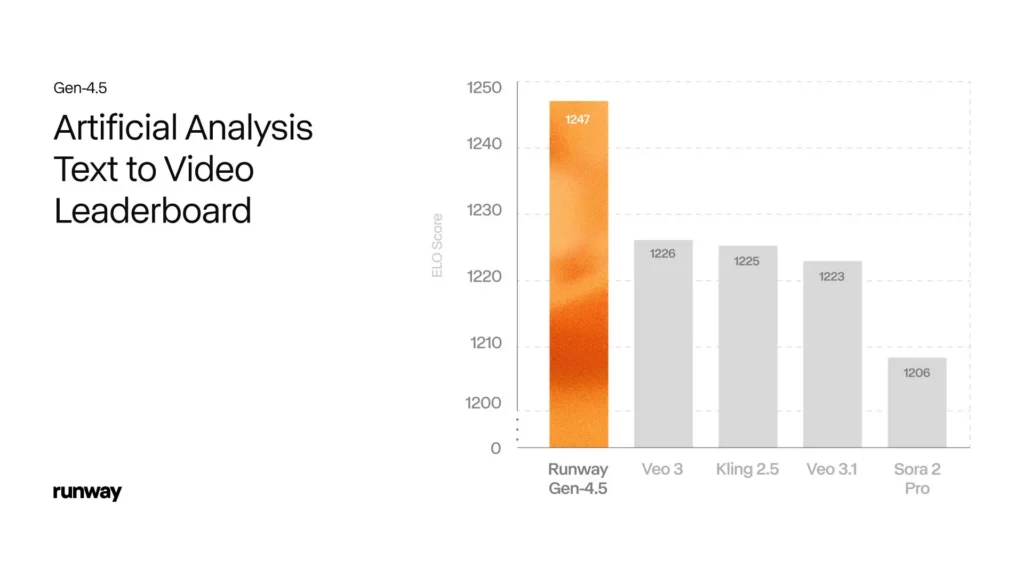

Runway Gen-4.5 คือโมเดลแปลงข้อความเป็นวิดีโอรุ่นเรือธงล่าสุดของบริษัท ซึ่งประกาศเปิดตัวเมื่อวันที่ 1 ธันวาคม 2025 โมเดลนี้ถูกวางตำแหน่งให้เป็นวิวัฒนาการที่ค่อยเป็นค่อยไปแต่มีความหมายเหนือกว่าตระกูล Gen-4 โดยมุ่งเน้นการพัฒนาคุณภาพการเคลื่อนไหว การยึดเกาะที่รวดเร็ว และความสมจริงเชิงเวลา/กายภาพ ซึ่งเป็นจุดที่เคยแยกวิดีโอ AI ที่ "ดี" ออกจากวิดีโอ AI ที่ "น่าเชื่อถือ" ในอดีต Runway Gen-4.5 เป็นผู้นำในตารางคะแนนการแปลงข้อความเป็นวิดีโอ Artificial Analysis ในปัจจุบัน (1,247 คะแนน Elo) และได้รับการปรับแต่งเพื่อให้ได้ผลลัพธ์ที่สมจริงราวกับภาพยนตร์ แต่ยังคงมาพร้อมกับข้อจำกัดทั่วไปของ generative-AI เช่น การแสดงผลรายละเอียดเล็กๆ น้อยๆ และข้อผิดพลาดเชิงสาเหตุที่เกิดขึ้นเป็นครั้งคราว

ด้านล่างนี้เป็นการดูเชิงลึก เชิงปฏิบัติ และมีหลักฐานสนับสนุน (หากเป็นไปได้) เกี่ยวกับว่า Gen-4.5 คืออะไร มีอะไรใหม่เมื่อเทียบกับ Gen-4 รวมถึงเปรียบเทียบกับคู่แข่งอย่าง Veo (3.1) ของ Google และ Sora 2 ของ OpenAI ได้อย่างไร รวมถึงสัญญาณประสิทธิภาพในโลกแห่งความเป็นจริงและการอ้างถึงเกณฑ์มาตรฐาน และการอภิปรายอย่างตรงไปตรงมาเกี่ยวกับข้อจำกัด ความเสี่ยง และแนวทางปฏิบัติที่ดีที่สุด

Runway Gen-4.5 คืออะไร?

Runway Gen-4.5 คือโมเดลสร้างวิดีโอจากข้อความล่าสุดจาก Runway ซึ่งเปิดตัวเป็นรุ่นอัปเกรดครั้งใหญ่ในไลน์ Gen-4 ของบริษัท Runway วางตำแหน่ง Gen-4.5 ให้เป็น “ขอบเขตใหม่” สำหรับการสร้างวิดีโอ โดยเน้นการปรับปรุงหลักสามประการจากรุ่นก่อนหน้า ได้แก่ ความแม่นยำทางกายภาพที่ดีขึ้นอย่างเห็นได้ชัด (วัตถุมีน้ำหนักและโมเมนตัมที่สมจริง) การยึดเกาะที่รวดเร็วขึ้น (สิ่งที่คุณขอคือสิ่งที่คุณได้รับอย่างน่าเชื่อถือยิ่งขึ้น) และความคมชัดของภาพที่สูงขึ้นในทุกการเคลื่อนไหวและช่วงเวลา (รายละเอียดต่างๆ เช่น เส้นผม การทอผ้า และแสงสะท้อนบนพื้นผิวยังคงสอดคล้องกันในทุกเฟรม) ปัจจุบัน Gen-4.5 อยู่ในอันดับต้นๆ ของตารางคะแนนที่ตัดสินโดยมนุษย์ ซึ่งใช้สำหรับการเปรียบเทียบประสิทธิภาพการแปลงข้อความเป็นวิดีโอ

Runway Gen-4.5 มาจากไหน และเหตุใดจึงสำคัญ?

โมเดลวิดีโอของ Runway พัฒนาอย่างรวดเร็วจาก Gen-1 ผ่าน Gen-3/Alpha สู่ Gen-4 โดย Gen-4.5 นำเสนอในรูปแบบการรวมและเพิ่มประสิทธิภาพของการอัปเกรดสถาปัตยกรรม กลยุทธ์ข้อมูลก่อนการฝึก และเทคนิคหลังการฝึก เพื่อเพิ่มพลวัต ความสอดคล้องตามเวลา และความสามารถในการควบคุมให้สูงสุด สำหรับผู้สร้างและทีมงานฝ่ายผลิต การปรับปรุงเหล่านี้มีเป้าหมายเพื่อให้คลิปที่สร้างโดย AI มีประโยชน์ในการใช้งานจริงในการแสดงภาพล่วงหน้า เนื้อหาโฆษณา/การตลาด และการผลิตเรื่องราวแบบสั้น โดยลดความรู้สึกเหมือน "ฉบับร่าง" ที่โมเดลการแปลงข้อความเป็นวิดีโอรุ่นก่อนๆ มักพบเห็น

4 ฟีเจอร์เด่นของ Runway Gen-4.5

1) ปรับปรุงความสมจริงทางกายภาพและการเคลื่อนไหวแบบไดนามิก

Runway Gen-4.5 เน้นการเคลื่อนไหวที่ราบรื่นและสมจริงทางกายภาพมากขึ้น Gen-4.5 มุ่งเน้นไปที่การเคลื่อนไหวของวัตถุที่สมจริง เช่น น้ำหนัก ความเฉื่อย ของเหลว ผ้า และการชนที่สมจริงทางกายภาพ ทำให้เกิดลำดับภาพที่ปฏิสัมพันธ์ดู "ลอย" น้อยลงและสมจริงมากขึ้น ในเดโมและการทดสอบของฉัน โมเดลแสดงให้เห็นถึงวิถีการเคลื่อนที่ของวัตถุที่ดีขึ้น ความสมจริงของการเคลื่อนไหวของกล้อง และสิ่งแปลกปลอม "ลอย" น้อยลง ซึ่งเป็นปัญหาที่พบได้ในโมเดลวิดีโอรุ่นก่อนๆ นี่เป็นหนึ่งในการอัปเกรดหลักเมื่อเทียบกับ Gen-4

2) การควบคุมความเที่ยงตรงของภาพและสไตล์

Runway Gen-4.5 ขยายโหมดควบคุมของ Runway (ข้อความเป็นวิดีโอ, ภาพเป็นวิดีโอ, วิดีโอเป็นวิดีโอ, คีย์เฟรม) และปรับปรุงการเรนเดอร์ภาพเสมือนจริง การจัดสไตล์ และการจัดองค์ประกอบภาพแบบภาพยนตร์ Runway อ้างว่า Gen-4.5 สามารถสร้างคลิปภาพที่เหมือนจริงซึ่งยากต่อการแยกแยะจากภาพจริงในลำดับสั้นๆ โดยเฉพาะอย่างยิ่งเมื่อใช้ร่วมกับภาพอ้างอิงหรือคีย์เฟรมที่ดี

3) การปฏิบัติตามและการรับรู้องค์ประกอบที่ดีขึ้นอย่างรวดเร็ว

โมเดลนี้แสดงให้เห็นถึงความเที่ยงตรงที่ได้รับการปรับปรุงเมื่อคำแนะนำรวมถึงนักแสดงหลายคน ทิศทางกล้อง หรือข้อจำกัดความต่อเนื่องของฉากต่างๆ โมเดลนี้จะยึดตามคำแนะนำได้อย่างน่าเชื่อถือมากกว่าเมื่อเทียบกับรุ่นก่อนหน้า มีความแม่นยำที่สูงขึ้นในการปฏิบัติตามคำแนะนำเชิงบรรยาย ส่งผลให้มีองค์ประกอบที่เกิดภาพหลอนหรือองค์ประกอบที่ไม่เกี่ยวข้องน้อยลงในคลิป

4) รายละเอียดภาพที่สูงขึ้นและความเสถียรของเวลา

พื้นผิว ความต่อเนื่องของเส้นผม/เส้นใย และแสงที่สม่ำเสมอในทุกเฟรมได้รับการปรับปรุงให้ดีขึ้นอย่างเห็นได้ชัด ตัวละครและวัตถุมีโอกาสน้อยลงที่จะเปลี่ยนแปลงรูปลักษณ์ระหว่างการถ่ายทำ Runway อ้างว่าการปรับปรุงเหล่านี้เกิดขึ้นในขณะที่ยังคงรักษาโปรไฟล์ความล่าช้าของ Gen-4 ไว้ หนึ่งในความก้าวหน้าที่มุ่งเน้นการผลิตมากขึ้นคือการจัดการที่ดีขึ้นของโมเดลในการแสดงออกทางสีหน้าของตัวละครและอารมณ์โดยนัยในทุกช็อต แม้ว่า Runway Gen-4.5 จะไม่สามารถใช้แทนนักแสดงที่ผ่านการฝึกฝนมา แต่ก็รักษาความต่อเนื่องทางอารมณ์ได้ดีกว่า (เช่น การแสดงออกของตัวละครยังคงอยู่แม้ในขณะที่กล้องเคลื่อน) และสามารถสร้างสัญญาณการแสดงที่น่าเชื่อถือจากคำสั่งที่กระชับ เช่น "รอยยิ้มกังวล เหลือบมองไปทางอื่น หายใจแรง"

Runway Gen-4.5 มีประสิทธิภาพแค่ไหนในการทดสอบประสิทธิภาพและการทดสอบจริง?

รันเวย์รายงานคะแนน Elo ของ 1,247 บนกระดานผู้นำการแปลงข้อความเป็นวิดีโอของการวิเคราะห์เชิงประดิษฐ์ (ณ เวลาที่มีการประกาศ) — โดย Gen-4.5 อยู่ในอันดับต้นๆ ของเกณฑ์มาตรฐานนั้นๆ ณ เวลาที่รายงานผล เกณฑ์มาตรฐานเช่นนี้ใช้การตัดสินความชอบแบบคู่กันโดยมนุษย์หรือแบบอัตโนมัติในผลลัพธ์ของโมเดลจำนวนมาก

ประสิทธิภาพการใช้งานจริง (สิ่งที่ผู้ใช้คาดหวังได้)

- ความยาวและความละเอียดของคลิป: ปัจจุบัน Gen-4.5 ได้รับการปรับให้เหมาะสมสำหรับคลิปภาพยนตร์สั้นๆ (โดยทั่วไปจะแสดงผลแบบช็อตเดียวที่ 4–20 วินาที ที่ HD/1080p) Runway เน้นการส่งมอบความเที่ยงตรงที่สูงขึ้นโดยไม่เพิ่มความหน่วงเมื่อเทียบกับ Gen-4

- เวลาและต้นทุนในการเรนเดอร์: ข้อความของ Runway คือ ค่าใช้จ่าย/เวลาแฝงนั้นเทียบได้กับ Gen-4 ในทุกระดับการสมัครสมาชิก โดยเวลาในโลกแห่งความเป็นจริงจะแตกต่างกันไปขึ้นอยู่กับความละเอียดที่เลือก การตั้งค่าคุณภาพ และโหลดของคิว

Runway Gen-4.5 แตกต่างจาก Gen-4 อย่างไร?

Gen-4 ได้วางรากฐานการผลิตของ Runway ไว้ นั่นคือ ตัวละครที่สอดคล้อง โหมดควบคุมภาพเป็นวิดีโอ (ภาพ→วิดีโอ การสร้างคีย์เฟรม วิดีโอ→วิดีโอ) และการเน้นที่เวิร์กโฟลว์ของผู้ใช้ Gen-4.5 ยังคงรักษารากฐานนั้นไว้ แต่ยังคงผลักดัน การสร้างแบบจำลองโลก (ฟิสิกส์ การเคลื่อนที่) และ การปฏิบัติตามอย่างรวดเร็ว โดยไม่ต้องเสียสละปริมาณงาน ในทางปฏิบัติ Gen-4 อาจยังคงยอดเยี่ยมสำหรับงานที่รวดเร็ว เน้นสไตล์ และงบประมาณที่เบากว่า ส่วน Gen-4.5 คือทางเลือกในการอัปเกรดเมื่อคุณต้องการไดนามิกที่น่าเชื่อถือยิ่งขึ้นและการควบคุมที่ละเอียดยิ่งขึ้น

สิ่งที่เปลี่ยนแปลงทางเทคนิค (ระดับสูง)

Runway Gen-4.5 ถูกนำเสนอว่าเป็นวิวัฒนาการมากกว่าการเขียนสถาปัตยกรรมใหม่ทั้งหมด เอกสารของ Runway ระบุว่าแบบจำลองนี้ได้รับประโยชน์จากประสิทธิภาพของข้อมูลก่อนการฝึกและเทคนิคหลังการฝึกที่ดีขึ้น (เช่น การปรับแต่งแบบเจาะจงเป้าหมายและการปรับเวลาให้เหมาะสม) ในทางปฏิบัติ สิ่งนี้จะนำไปสู่การสร้างแบบจำลองน้ำหนัก/การเคลื่อนไหวที่ดีขึ้น ฉากหลายองค์ประกอบมีความสอดคล้องกันมากขึ้น และการรักษารายละเอียดความถี่สูง (เส้นผม การทอผ้า) ที่ดีขึ้นในทุกเฟรม

ความแตกต่างในทางปฏิบัติที่ผู้สร้างจะสังเกตเห็น

- พฤติกรรมทางกายภาพที่ดีขึ้น: วัตถุจะเชื่อฟังมวลตามที่รับรู้ และของเหลว/ของไหลจะมีพฤติกรรมที่น่าเชื่อถือมากกว่า

- การทำลายเอกลักษณ์น้อยลง: ตัวละครและวัตถุมีโอกาสน้อยที่จะเปลี่ยนรูปลักษณ์ระหว่างคลิป

- ความเร็วเท่ากัน คุณภาพสูงกว่า: Runway ระบุว่าประสิทธิภาพ (ความหน่วง) เทียบเท่ากับ Gen-4 ขณะที่คุณภาพเพิ่มขึ้น ซึ่งทำให้ Gen-4.5 น่าสนใจสำหรับทีมผลิตที่ไม่สามารถยอมรับความล่าช้าในการเรนเดอร์ขนาดใหญ่ได้

เมื่อใดควรเลือก Gen-4 หรือ Gen-4.5

- ใช้ ม.ค.-4 เมื่อคุณต้องการการพิสูจน์แนวคิดที่รวดเร็วและราคาถูกกว่าหรือเมื่อท่อส่ง/ระบบควบคุมที่มีอยู่ได้รับการปรับแต่งให้เข้ากับเครื่องยนต์นั้นแล้ว

- ใช้ ม.ค.-4.5 เมื่อคุณต้องการความสมจริงที่ได้รับการปรับปรุง การโต้ตอบระหว่างวัตถุหลายชิ้นที่ซับซ้อน หรือเอาต์พุตระดับการผลิตที่ฟิสิกส์ของการเคลื่อนไหวและความแม่นยำที่รวดเร็วเป็นสิ่งสำคัญ (เช่น การแสดงภาพผลิตภัณฑ์ การแสดงภาพล่วงหน้าด้วยเอฟเฟกต์พิเศษ ภาพยนตร์สั้นที่เน้นตัวละคร)

ความเข้ากันได้กับการควบคุม Gen-4 โหมดแก้ไขทั้งหมดที่ Runway รองรับ (รูปภาพ→วิดีโอ คีย์เฟรม วิดีโอ→วิดีโอ อ้างอิงนักแสดง) กำลังถูกรวมไว้ใน Gen-4.5 เพื่อให้ผู้สร้างสามารถนำการควบคุมที่คุ้นเคยกลับมาใช้ใหม่พร้อมผลลัพธ์ที่ดีกว่า

Gen-4.5 เปรียบเทียบกับ Veo 3.1 และ Sora 2 ได้อย่างไร?

เมื่อเปรียบเทียบกับ Google Veo 3.1 เป็นยังไงบ้าง?

Veo 3.1 คือตระกูลการแปลงข้อความเป็นวิดีโอที่มีความเที่ยงตรงสูงของ Google (Veo 3 → อัปเดต 3.1) โมเดลนี้ได้รับการยกย่องในด้านพื้นผิวแบบภาพยนตร์ การเรนเดอร์สไตล์ที่แข็งแกร่ง และการควบคุมสี/แสงที่มีประสิทธิภาพสูง การเปรียบเทียบอิสระบ่งชี้ว่า Veo 3.1 โดดเด่นในด้านอารมณ์และฉากที่มีสไตล์ และพร้อมใช้งานอย่างแพร่หลายผ่าน API ของ Google แต่อาจมีปัญหาในด้านฟิสิกส์ของวัตถุหลายชิ้นและความสอดคล้องของเวลาในระยะไกลเมื่อเทียบกับคู่แข่งเฉพาะทางที่ดีที่สุด การทดสอบแบบปิดตาและรายงานจากผู้ใช้ในช่วงแรกชี้ให้เห็นว่า Runway Gen-4.5 เหนือกว่าในด้านความสมจริงของการเคลื่อนไหวและการยึดติดที่รวดเร็วสำหรับพรอมต์ที่เน้นฟิสิกส์ ในขณะที่ Veo มักจะชนะในการทดสอบฉากเดียวที่มีสไตล์ ภาพวาด หรือภาพยนตร์

ที่ Veo มีแนวโน้มที่จะนำ:ความเที่ยงตรงของเสียงและคุณสมบัติการบรรยายแบบมีโครงสร้าง (Flow/Veo Studio) และการบูรณาการอย่างใกล้ชิดกับระบบนิเวศของ Google (Gemini API/Vertex AI)

ที่ Gen-4.5 มีแนวโน้มที่จะนำไปสู่:การทดสอบความชอบของมนุษย์แบบปิดตาสำหรับความสมจริงของภาพ การยึดเกาะอย่างรวดเร็ว และพฤติกรรมการเคลื่อนไหวที่ซับซ้อน (ตามการจัดอันดับของ Video Arena ที่อ้างอิงโดย Runway) ในการเปรียบเทียบแบบปิดตาสาธารณะหลายครั้ง Gen-4.5 มีคะแนน Elo สูงกว่า Veo เพียงเล็กน้อย แม้ว่าระยะขอบและความหมายจะแตกต่างกันไปตามประเภทของเนื้อหาก็ตาม

มันเปรียบเทียบกับ Sora 2 ของ OpenAI ได้อย่างไร?

โซระ 2 (OpenAI) เน้นความแม่นยำทางกายภาพ เสียงที่ประสานกัน (รวมถึงบทสนทนาและเอฟเฟกต์เสียง) และการควบคุม Sora 2 มักจะทำได้ดีในการสร้างฉากแอนิเมชันที่เชื่อมโยงกันพร้อมการเล่าเรื่องระดับสูง และในเวิร์กโฟลว์ที่เสียงและบทสนทนาเป็นส่วนสำคัญของกระบวนการสร้าง

ทิศทางที่ Sora 2 มุ่งไป:การสร้างเสียงแบบบูรณาการและการซิงค์หลายโหมดในการตั้งค่าบางอย่าง มีแนวโน้มที่จะสร้างคลิปที่เน้นบรรยากาศและเรื่องราวเป็นอย่างมาก

ที่ Gen-4.5 มีแนวโน้มที่จะนำไปสู่:จากการเปรียบเทียบแบบปิดตาอิสระที่ Runway อ้างถึง พบว่าความสมจริงของภาพที่รับรู้ ความเที่ยงตรงของภาพ และความสม่ำเสมอของการเคลื่อนไหว อีกครั้ง การเลือกใช้งานจริงขึ้นอยู่กับค่าของคุณ: หากการสร้างเสียงแบบเนทีฟ + เครื่องมือที่ผสานรวมเป็นสิ่งสำคัญ Sora 2 หรือ Veo อาจเหมาะสมกว่า หากความเที่ยงตรงของภาพที่แท้จริงสำหรับฉากที่ซับซ้อนเป็นสิ่งสำคัญ ข้อได้เปรียบของการทดสอบแบบปิดตาของ Gen-4.5 ก็มีความสำคัญเช่นกัน

ตารางเปรียบเทียบการใช้งานจริง (สรุป)

| พื้นที่ | รันเวย์ Gen-4.5 | รันเวย์ Gen-4 (ก่อนหน้า) | กูเกิล วีโอ 3.1 | OpenAI โซระ 2 |

|---|---|---|---|---|

| การปล่อย / การวางตำแหน่ง | ธันวาคม 2025 — “Gen-4.5”: คุณภาพและความเที่ยงตรงเพิ่มขึ้น; คะแนนเกณฑ์มาตรฐานสูงสุด (1,247 Elo) | Gen-4 รุ่นก่อนหน้า: ก้าวสำคัญเพื่อความสม่ำเสมอและการควบคุม | Veo 3.1: เครื่องสร้างวิดีโอของ Google; เสียงดั้งเดิมและตัวเลือกคุณภาพรวดเร็ว/รวดเร็ว | Sora 2: โมเดลวิดีโอ+เสียงเรือธงของ OpenAI เน้นความแม่นยำทางกายภาพและเสียงที่ซิงโครไนซ์ |

| จุดแข็งหลัก | คุณภาพการเคลื่อนไหว ความเที่ยงตรงฉับไว ภาพระดับภาพยนตร์ การรวม API | ความต่อเนื่องของตัวละคร ความสม่ำเสมอของหลายช็อต ความสามารถในการควบคุม | เอาต์พุต 8 วินาทีที่รวดเร็ว การสร้างเสียง/บทสนทนาแบบเนทีฟ ปรับให้เหมาะสมสำหรับความเร็ว/UX | ฟิสิกส์และความสมจริง เสียง/บทสนทนาที่ประสานกัน การควบคุมได้ |

| ความยาวเอาต์พุต / รูปแบบ | คลิปภาพยนตร์สั้น รองรับ ภาพ→วิดีโอ, ข้อความ→วิดีโอ, คีย์เฟรม ฯลฯ | คลิปสั้น โหมดควบคุมที่คล้ายกัน | วิดีโอคุณภาพสูง 8 วินาที ตัวเลือก Veo 3.1 รวดเร็ว | เอาท์พุต 720p/1080p พร้อมเสียง เน้นความเที่ยงตรง |

| เสียงพื้นเมือง | ไม่ใช่หัวข้อหลัก (เน้นที่ความเที่ยงตรงของภาพ) แต่ Runway รองรับเวิร์กโฟลว์เสียงผ่านเครื่องมือ | การสร้างเสียงพื้นเมืองที่จำกัด | การสร้างเสียงพื้นเมือง (เอฟเฟกต์เสียง บทสนทนา) เน้นคุณภาพเสียง | เอฟเฟกต์เสียงและซิงโครไนซ์เป็นคุณสมบัติที่ชัดเจน |

| ข้อจำกัดโดยทั่วไป | สิ่งประดิษฐ์ที่มีรายละเอียดเล็ก ๆ (ใบหน้า/ฝูงชน) ข้อผิดพลาดเชิงสาเหตุ/เวลาที่เกิดขึ้นเป็นครั้งคราว | สิ่งประดิษฐ์ก่อนหน้านี้มีความไม่สอดคล้องกันมากกว่า 4.5 ในการเคลื่อนไหว | ระยะเวลาสั้นเป็นการแลกเปลี่ยนการออกแบบ คุณภาพเทียบกับความยาว | โหมดความล้มเหลวที่แคบในฉากที่ซับซ้อน ยังคงพัฒนาต่อไป |

- ความสมจริงทางภาพและการเคลื่อนไหว:Gen-4.5 > Veo 3.1 ≈ Sora 2 (แตกต่างกันไปตามฉาก)

- เสียงและเสียงดั้งเดิม:Veo 3.1 ≥ Sora 2 > Runway (Runway มีเครื่องมือเสียงเวิร์กโฟลว์ แต่ Veo และ Sora ได้นำการสร้างเสียงเนทีฟที่ลึกซึ้งกว่ามาใช้ในการผลิต)

- การควบคุมและการแก้ไข:Runway (คีย์เฟรม, รูปภาพ→วิดีโอ, ความต่อเนื่องของการอ้างอิง) และ Veo (Flow Studio) ทั้งคู่ให้การควบคุมที่แข็งแกร่ง ในขณะที่ Sora มุ่งเน้นไปที่การควบคุมแบบมัลติโหมดที่ซิงค์กัน

- โดยสรุป: Sora 2 มีความแข็งแกร่งในเรื่องความต่อเนื่องของการเล่าเรื่อง Veo 3.1 มีความแข็งแกร่งในเรื่องพื้นผิวของภาพยนตร์ Gen-4.5 มีความแข็งแกร่งในเรื่องความสมจริงของการเคลื่อนไหวและการควบคุม

ข้อจำกัดและความเสี่ยงที่เป็นรูปธรรมใดบ้างที่ยังคงอยู่กับ Gen-4.5?

ไม่มีโมเดลใดที่สมบูรณ์แบบ และ Gen-4.5 มีข้อจำกัดที่ทราบและความเสี่ยงในโลกแห่งความเป็นจริงที่ต้องพิจารณาก่อนนำไปใช้

ข้อจำกัดทางเทคนิค

- ฟิสิกส์กรณีขอบและข้อผิดพลาดเชิงสาเหตุ: แม้ว่าจะมีการปรับปรุงไปมากแล้ว แต่แบบจำลองนี้ยังคงสร้างลำดับเหตุการณ์ผิดพลาดแบบสาเหตุเป็นครั้งคราว (เช่น ผลที่เกิดขึ้นก่อนเหตุ) และความล้มเหลวเล็กน้อยในการคงอยู่ของวัตถุเมื่อฉากมีความซับซ้อนมากขึ้น ปัญหานี้เกิดขึ้นน้อยลงแต่ก็ยังคงเกิดขึ้นอยู่

- ความสอดคล้องในรูปแบบยาว: เช่นเดียวกับโมเดลการแปลงข้อความเป็นวิดีโอส่วนใหญ่ในปัจจุบัน Gen-4.5 ได้รับการปรับให้เหมาะสมสำหรับคลิปสั้นๆ (ความยาวไม่กี่วินาที) การสร้างฉากที่ขยายหรือลำดับภาพเต็มรูปแบบยังคงต้องใช้การต่อภาพ การแทรกแซงทางบรรณาธิการ หรือเวิร์กโฟลว์แบบผสมผสาน

- อัตลักษณ์และความสอดคล้องกันในระดับ: การสร้างภาพนับร้อยภาพด้วยตัวละครตัวเดียวกันที่แสดงอย่างสม่ำเสมอยังคงต้องใช้เวิร์กโฟลว์มาก Gen-4.5 ช่วยได้แต่ไม่ได้หลีกเลี่ยงระบบการออกแบบอ้างอิงหรือกระบวนการทรัพยากรส่วนกลาง

ความเสี่ยงด้านความปลอดภัย การใช้ในทางที่ผิด และจริยธรรม

- ความเสี่ยงจากการปลอมแปลง/ดีพเฟก: เครื่องสร้างวิดีโอคุณภาพสูงจะเพิ่มความเสี่ยงต่อสื่อที่สมจริงแต่หลอกลวง องค์กรต่างๆ ควรนำมาตรการป้องกัน (เช่น การใส่ลายน้ำ นโยบายเนื้อหา ขั้นตอนการยืนยันตัวตน) มาใช้ และติดตามความเสี่ยงจากการใช้งานในทางที่ผิด

- ลิขสิทธิ์และที่มาของชุดข้อมูล: แหล่งที่มาของข้อมูลการฝึกอบรมยังคงเป็นข้อกังวลในวงกว้างของอุตสาหกรรม ผู้สร้างและผู้ถือลิขสิทธิ์ควรตระหนักว่าผลลัพธ์อาจสะท้อนรูปแบบที่เรียนรู้จากเนื้อหาที่มีลิขสิทธิ์ ซึ่งก่อให้เกิดคำถามทางกฎหมายและจริยธรรมเกี่ยวกับการนำกลับมาใช้ซ้ำในบริบทเชิงพาณิชย์

- อคติและอันตรายจากการเป็นตัวแทน: แบบจำลองเชิงกำเนิดอาจสร้างอคติที่มีอยู่ในข้อมูลฝึกอบรมได้ (เช่น การนำเสนอเกิน/ต่ำกว่าความเป็นจริง การพรรณนาแบบเหมารวม) การทดสอบอย่างเข้มงวดและกลยุทธ์การบรรเทาผลกระทบระหว่างกระบวนการยังคงมีความจำเป็น

บทสรุป — Gen-4.5 เหมาะสมกับภูมิทัศน์วิดีโอ AI ที่กำลังพัฒนาอย่างไร

Runway Gen-4.5 ถือเป็นก้าวสำคัญในด้านความสมจริงและความสามารถในการควบคุมการแปลงข้อความเป็นวิดีโอ ปัจจุบันได้รับการจัดอันดับสูงในการจัดอันดับผู้พิการทางสายตาอิสระ และข้อความผลิตภัณฑ์และการรายงานผลเบื้องต้นของ Runway ถือเป็นการอัปเกรดที่ใช้งานได้จริงสำหรับผู้สร้างที่ต้องการการเคลื่อนไหวที่น่าเชื่อถือยิ่งขึ้น ความเที่ยงตรงฉับไวที่ดีขึ้น และความสอดคล้องของเวลาที่ดีขึ้น โดยไม่กระทบต่อความเร็วในการสร้าง ในขณะเดียวกัน ระบบคู่แข่งจาก Google (Veo 3.1) และ OpenAI (Sora 2) ยังคงผลักดันจุดแข็งที่เสริมกัน เช่น เสียงแบบบูรณาการ เครื่องมือสร้างเรื่องราว/การเล่าเรื่องที่ออกแบบขึ้นเอง และการผสานรวมระบบนิเวศที่ลึกซึ้งยิ่งขึ้น การเลือกแพลตฟอร์มที่เหมาะสมยังคงขึ้นอยู่กับโครงการ: ไม่ว่าคุณจะให้ความสำคัญกับความสมจริงของภาพ เสียงดั้งเดิม การผสานรวมแพลตฟอร์ม หรือการควบคุมการกำกับดูแล

Gen-4.5 กำลังเปิดตัวในแผนต่างๆ โดยมีราคาที่เทียบเท่ากับ Gen-4

นักพัฒนาสามารถเข้าถึงได้ วีโอ 3.1 , โซระ 2 และ รันเวย์/gen4_aleph ฯลฯ ผ่าน CometAPI รุ่นใหม่ล่าสุด ได้รับการอัปเดตอยู่เสมอจากเว็บไซต์อย่างเป็นทางการ เริ่มต้นด้วยการสำรวจความสามารถของโมเดลใน สนามเด็กเล่น และปรึกษา คู่มือ API สำหรับคำแนะนำโดยละเอียด ก่อนเข้าใช้งาน โปรดตรวจสอบให้แน่ใจว่าคุณได้เข้าสู่ระบบ CometAPI และได้รับรหัส API แล้ว โคเมทเอพีไอ เสนอราคาที่ต่ำกว่าราคาอย่างเป็นทางการมากเพื่อช่วยคุณบูรณาการ

พร้อมไปหรือยัง?→ ทดลองใช้ gen-4.5 ฟรี !

หากคุณต้องการทราบเคล็ดลับ คำแนะนำ และข่าวสารเกี่ยวกับ AI เพิ่มเติม โปรดติดตามเราที่ VK, X และ ไม่ลงรอยกัน!