Google DeepMind, 2 Nisan 2026'da Gemma 4'ü resmi olarak yayımlayarak açık kaynak yapay zekâda büyük bir dönüm noktasına imza attı. Bu model ailesi, Gemini 3'ü güçlendiren aynı araştırma ve teknolojiden yararlanarak parametre başına sınır düzeyinde zekâ sunuyor. Önceki Gemma sürümlerinin özel lisanslarının aksine, Gemma 4 tamamen izin verici Apache 2.0 lisansı altında sunuluyor ve kısıtlamasız ticari kullanım, değiştirme ve yeniden dağıtım olanağı sağlıyor.

Gemma 4; çoklu modalite (tüm boyutlarda metin + görsel girdi, ayrıca uç modellerde ses), gelişmiş akıl yürütme ve ajan tabanlı iş akışlarına yerel destek, 256K tokene kadar uzun bağlam pencereleri ve akıllı telefonlardan Raspberry Pi'ye, üst düzey GPU'lara kadar her şey için optimizasyon ile öne çıkıyor. 140'tan fazla dili destekliyor ve verimliliğe vurgu yaparak, güçlü yapay zekâyı bulut bağımlılığı olmadan tüketici ve uç donanımlarda erişilebilir kılıyor.

CometAPI hem açık kaynak hem de kapalı kaynak model API'leri sunar.

Gemma 4 Nedir?

Gemma 4, Google DeepMind’in gelişmiş akıl yürütme, ajan tabanlı yapay zekâ iş akışları ve verimli cihaz içi dağıtım için özel olarak tasarlanmış en yeni açık çoklu modal büyük dil modeli (LLM) ailesidir. Tamamen açık ağırlık ve açık kaynak kalırken, mülkiyetli Gemini 3 araştırmasından elde edilen içgörülerden yararlanarak “parametre başına zekâyı” en üst düzeye çıkarır.

Önceki Gemma modellerine göre başlıca ilerlemeler:

- Yerel çoklu modalite: Metin + görsel anlama (tüm modeller), küçük uç varyantlarda ses desteği.

- Yapılandırılabilir düşünme modu: Yapılandırılmış <|think|> çıktısıyla adım adım akıl yürütme.

- Yerel fonksiyon çağırma ve araç kullanımı: Otonom ajanlar için ideal.

- Genişletilmiş bağlam: Büyük modellerde 256K tokene kadar.

- Hibrit dikkat mimarisi: Verimlilik ve uzun bağlam performansı için yerel kayan pencere ve global dikkati birleştirir.

- Küçük modellerde Katman Başına Gömme (PLE) ve bellek tasarrufu için paylaşılan KV önbelleği.

- Geniş çokdilli destek: 140+ dili kapsayan veriyle önceden eğitildi; kültürel nüans farkındalığına sahip.

Apache 2.0 kapsamında yayımlanan Gemma 4, kurumsal benimsemeyi sınırlayan önceki lisans kısıtlamalarını ortadan kaldırır. Geliştiriciler artık ince ayar yapabilir, dağıtabilir ve ticarileştirebilir—onu Llama ve Qwen gibi tamamen açık ekosistemlere doğrudan bir rakip konumuna yerleştirir.

Gemma 4, çeşitli donanımları hedefler: düşük gecikmeli çevrimdışı yapay zekâ için uç cihazlar (telefonlar, IoT, Raspberry Pi, Jetson Nano) ve yüksek performanslı yerel sunucular için iş istasyonları/GPU’lar. Bu “yerel-öncelikli” tasarım gizliliği, maliyet tasarrufunu ve sıfır gecikmeli çıkarımı önceliklendirir.

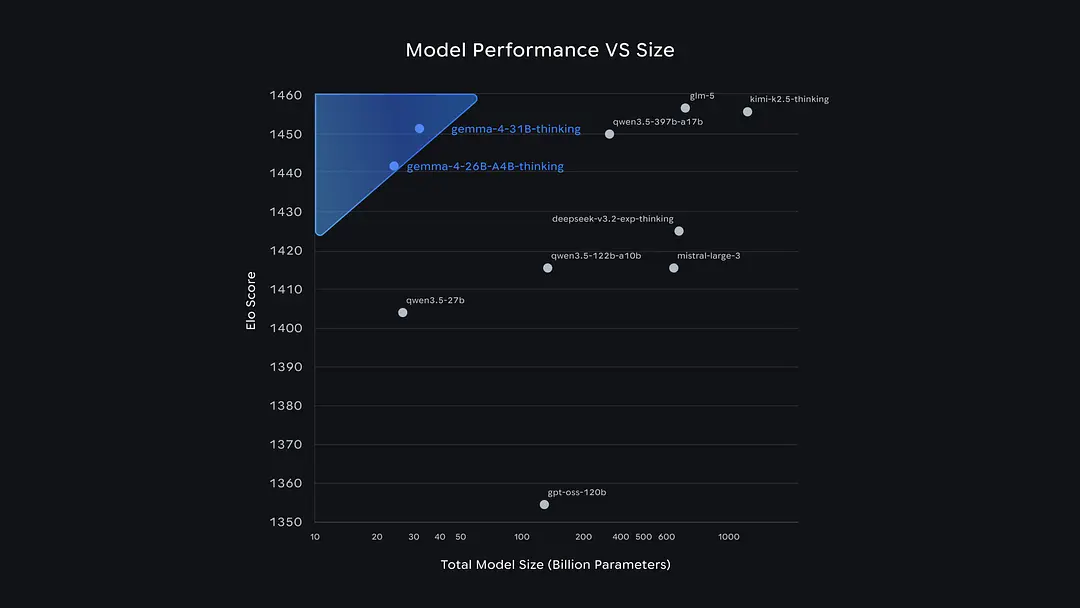

Arena liderlik tablosunda bunun önünde sıralanan açık kaynak modellerin çoğu Çinli ekiplerden. Gemma 4, Qwen 3.5 ve GLM-5’ten pek farklı değildir, ancak OpenAI’nin GPT-OSS-120B’sinden belirgin şekilde farklıdır.

Geliştiriciler artık CometAPI üzerinde GLM-5, Qwen 3.5 vb. bulabilirler.

Gemma 4’ün Dört Sürümü

Google, performans, verimlilik ve dağıtım senaryoları arasında denge kuran dört dikkatle optimize edilmiş boyutta Gemma 4’ü yayımladı. İkisinde uç verimliliği için yenilikçi Katman Başına Gömme (PLE) kullanan yoğun mimariler var; biri düşük etkin parametre maliyetiyle yüksek performans için Uzman Karışımı (MoE); biri de yoğun bir amiral gemisi.

| Model | Mimari | Toplam Parametre | Etkin Parametre (MoE) | Etkili Parametre | Bağlam Uzunluğu | Modaliteler | Hedef Donanım |

|---|---|---|---|---|---|---|---|

| Gemma 4 E2B | Yoğun + PLE | ~5.1B (gömmeler dahil) | N/A | 2.3B | 128K | Metin, Görsel, Ses | Akıllı telefonlar, Raspberry Pi, uç IoT |

| Gemma 4 E4B | Yoğun + PLE | ~8B (gömmeler dahil) | N/A | 4.5B | 128K | Metin, Görsel, Ses | Mobil cihazlar, hafif GPU’lar, Jetson |

| Gemma 4 26B A4B | MoE (8 etkin / 128 toplam + 1 paylaşılan) | 25.2B | 3.8B–4B | N/A | 256K | Metin, Görsel | İş istasyonları, tüketici GPU’ları, yerel sunucular |

| Gemma 4 31B | Yoğun | 30.7B | N/A | N/A | 256K | Metin, Görsel | Üst düzey GPU’lar (FP16’da tek bir H100/A100’e sığar) |

Gemma 4 E2B ve E4B (uç için optimize): PLE, katman başına özelleştirme ekleyerek minimum parametre ek yüküyle verimlilik sağlar. Pil ile çalışan veya bellek kısıtlı cihazlar için idealdir. Ses kodlayıcı (USM tarzı Conformer, ~300M parametre), konuşmadan metne ve çeviri sağlar.

Gemma 4 26B A4B (MoE): Toplamda 25B+ boyuta rağmen çıkarım sırasında yalnızca ~4B parametre etkinleşir. Hesaplama maliyeti dramatik biçimde düşükken neredeyse 31B performansı sunar—maliyet etkin ölçekleme için mükemmeldir.

Gemma 4 31B (Yoğun): Maksimum yetenek için amiral gemisi. Tam hassasiyette tek bir 80GB GPU’ya sığar ve liderlik tablolarındaki en üst açık modeller arasında yer alır.

Tüm modeller, sohbet, akıl yürütme ve araç kullanımı için optimize edilmiş talimatla ayarlanmış (“-it”) varyantları ile ince ayar için önceden eğitilmiş temel sürümleri içerir. İki büyük model farklı yaklaşımlar benimser: 31B Yoğun model en yüksek kaliteyi hedefler ve ince ayar için en iyi temel olarak hizmet eder; 26B MoE model ise hızı önceliklendirir, çıkarım sırasında yalnızca 3.8 milyar parametreyi etkinleştirerek çok daha hızlı kelime üretimi sağlar, ancak genel kalite biraz daha düşüktür.

İki küçük model, E2B ve E4B, özellikle cep telefonları ve IoT cihazları için tasarlanmıştır: tamamen çevrimdışı çalışabilir, bellek ve güç tasarrufu sağlar. Dahası, bu küçük modellerin büyük modellerde bulunmayan bir yeteneği vardır: yerel ses girişi, doğrudan konuşma tanımayı mümkün kılar.

Gemma 4’ün Temel Yetenekleri

Gemma 4, gerçek dünya yapay zekâ uygulamalarında en önemli alanlarda mükemmeldir:

1. Gelişmiş Akıl Yürütme ve Düşünme Modu

Sistem istemleriyle veya enable_thinking=True ayarıyla yapılandırılabilir adım adım akıl yürütme. Yapılandırılmış <|think|> etiketlerini ve ardından nihai yanıtları çıktılar. Ek ince ayar gerektirmeden karmaşık görevlerde performansı dramatik biçimde artırır.

2. Çoklu Modal Anlama

- Görsel: Nesne tespiti (JSON sınır kutuları), OCR (çok dilli), belge/PDF ayrıştırma, grafik anlama, UI anlama, el yazısı tanıma ve değişken çözünürlüklü görüntü işleme (token bütçeleri: 70–1120 token).

- Video: 60 saniyeye kadar (1 fps kare işleme).

- Ses (yalnızca E2B/E4B): Otomatik konuşma tanıma (ASR) ve konuşmadan metne çeviri (en fazla 30 sn).

- İç içe girdiler: Metin, görsel ve sesi herhangi bir sırada karıştırın.

3. Ajan Tabanlı İş Akışları ve Fonksiyon Çağırma

Yerel araç kullanımı desteği, çok adımlı planlama, API çağrıları, uygulama gezinimi ve görev tamamlama için otonom ajanları mümkün kılar. τ2-bench’te (ajan araç kullanımı) güçlüdür.

4. Kodlama ve Geliştirici Araçları

Üstün kod üretimi, tamamlama, hata ayıklama ve depo düzeyinde anlama. Sorunsuz tümleştirme için JSON yapılı çıktıları destekler. LiveCodeBench v6’da 80.0% (31B) skoruyla, çevrimdışı geliştirme senaryolarına uygun yerel-öncelikli bir yapay zekâ programlama asistanı konumlanır.

5. Uzun Bağlam ve Çokdillilik

128K–256K tokeni güvenilir şekilde işler (MRCR needle-in-haystack üzerinde test edildi). Ocak 2025 sınırına kadar çeşitli veriler üzerinde önceden eğitildi ve güçlü çapraz dilli performansa sahiptir. Bu sadece çokdilli çeviri değildir; yerel olarak eğitilmiş ve 140’tan fazla dili kapsar.

Karşılaştırma Verileri: Gemma 4 Performans Ayrımı

Gemma 4, açık modeller için yeni standartlar belirler. 31B ve 26B varyantları, bir zamanlar çok daha büyük mülkiyetli sistemlere ayrılan skorlar sunarken, uç modeller Gemma 3’ün daha büyük seleflerini geride bırakır.

Tam Karşılaştırma Sonuçları (Talimatla Ayarlanmış Modeller)

| Karşılaştırma | Kategori | Gemma 4 31B | Gemma 4 26B A4B | Gemma 4 E4B | Gemma 4 E2B | Gemma 3 27B (no think) |

|---|---|---|---|---|---|---|

| MMLU Pro | Akıl Yürütme ve Bilgi | 85.2% | 82.6% | 69.4% | 60.0% | 67.6% |

| AIME 2026 (no tools) | Matematik | 89.2% | 88.3% | 42.5% | 37.5% | 20.8% |

| GPQA Diamond | Lisansüstü Düzey Bilim | 84.3% | 82.3% | 58.6% | 43.4% | 42.4% |

| Tau2 (avg) | Ajan Tabanlı Araç Kullanımı | 76.9% | 68.2% | 42.2% | 24.5% | 16.2% |

| LiveCodeBench v6 | Kodlama | 80.0% | 77.1% | 52.0% | 44.0% | 29.1% |

| Codeforces ELO | Rekabetçi Kodlama | 2150 | 1718 | 940 | 633 | 110 |

| MMMU Pro | Çoklu Modal Akıl Yürütme | 76.9% | 73.8% | 52.6% | 44.2% | 49.7% |

| MATH-Vision | Matematik + Görsel | 85.6% | 82.4% | 59.5% | 52.4% | 46.0% |

| MRCR v2 (8-needle, 128K) | Uzun Bağlam | 66.4% | 44.1% | 25.4% | 19.1% | 13.5% |

Önemli Bulgular:

- Gemma 3’ten büyük sıçrama: 31B model, matematikte AIME skorunu %20.8’den %89.2’ye, LiveCodeBench skorunu %29.1’den %80.0’a çıkarıyor.

- MoE verimliliği: 26B A4B, çıkarım sırasında çok daha az hesaplama kullanırken 31B’ye neredeyse yetişiyor.

- Uç üstünlüğü: E4B ve E2B, 6–10 kat daha küçük olmalarına rağmen birçok metrikte Gemma 3 27B’yi aşıyor.

- Liderlik sıralamaları: 31B, Arena AI (text) üzerinde ~1452 puan; 26B A4B ~1441. 26B varyantının, kullanıcı tercihi ve kodlamada Qwen 3.5 397B gibi çok daha büyük modelleri geride bıraktığı rapor edilmiştir.

Görsel ve ses karşılaştırmaları, özel ince ayar olmadan kutudan çıktığı gibi güçlü çoklu modal performansı doğrular.

Ekosistem ve Araç Desteği

Gemma 4, anında geniş ekosistem entegrasyonuna sahiptir:

- Hugging Face:

transformers,pipeline("any-to-any"), GGUF, ONNX ve çoklu modal işlemcilerle ilk günden destek. - Yerel Çalışma Zamanları: Ollama, Llama.cpp (LM Studio, Jan), MLX (Apple Silicon with TurboQuant), Mistral.rs (Rust), Transformers.js (WebGPU tarayıcı çıkarımı).

- İnce Ayar: TRL, Unsloth, PEFT, Vertex AI ve tam çoklu modal veri kümesi desteği.

- Donanım Optimizasyonu: NVIDIA RTX/DGX Spark/Jetson (TensorRT-LLM ile), Google AI Edge araçları ve Android/iOS cihaz içi dağıtım.

- Ajan Çatılar: OpenClaw, Hermes, Pi ve CARLA simülasyon testleri.

- Bulut/Studio: Hızlı test için Google AI Studio; indirme için Kaggle Models.

Bu ekosistem, Gemma 4’ü dizüstü bilgisayarlarda, sunucularda veya uç cihazlarda dakikalar içinde dağıtılabilir kılar.

Sınırlamalar ve Güvenlik:

- Eğitim verisi sınırı: Ocak 2025 (araçlar olmadan gerçek zamanlı bilgi yok).

- Ses yalnızca konuşma ile sınırlı (müzik değil); video 60 saniye ile sınırlı.

- Halüsinasyon riski devam eder—düşünme modunu ve doğrulamayı kullanın.

- Güvenlik: Google AI İlkeleri uyarınca sıkı filtreleme ve değerlendirmeler; geliştiriciler uygulamaya özgü korumalar eklemelidir.

2026’da Gemma 4 Neden Önemli?

Gemma 4, sınır düzeyi yapay zekâyı demokratikleştiriyor. Çoklu modal zekâ, ajan yetenekleri ve Apache 2.0 özgürlüğünü donanım-bağımsız verimlilikle birleştirerek, geliştiriciler ve işletmelerin güvenli, özel, maliyet etkin yapay zekâ çözümlerini ölçekli biçimde inşa etmesini sağlıyor. Parametre başına zekâ atılımı—özellikle dünün amiral gemisi açık modellerini geride bırakan uç modellerde belirgin—gerçekten her yerde bulunan yapay zekâya doğru bir kaymayı işaret ediyor.

İster telefonda 2B bir modeli çalıştırın, ister yerelde 31B’lik bir güç merkezini, Gemma 4 açık kaynak yapay zekânın pratik faydada kapalı alternatiflere yetiştiğini (ve birçok durumda geçtiğini) kanıtlıyor.