OpenAI, bir araştırma önizlemesi yayınladı gpt-oss-güvenlik korumasıgeliştiricilerin uygulamalarına olanak sağlamak için tasarlanmış açık ağırlıklı bir çıkarım modeli ailesi Kendi Çıkarım anında güvenlik politikaları. Sabit bir sınıflandırıcı veya kara kutu denetim motoru göndermek yerine, yeni modeller ince ayarlıdır geliştirici tarafından sağlanan bir politikadan kaynaklanan sebep, akıl yürütmelerini açıklayan bir düşünce zinciri (CoT) oluşturur ve yapılandırılmış sınıflandırma çıktıları üretir. Bir araştırma önizlemesi olarak duyurulan gpt-oss-safeguard, bir çift akıl yürütme modeli olarak sunulur:gpt-oss-safeguard-120b ve gpt-oss-safeguard-20b—gpt-oss ailesinden hassas bir şekilde ayarlanmış ve çıkarım sırasında güvenlik sınıflandırması ve politika uygulama görevlerini gerçekleştirmek üzere açıkça tasarlanmıştır.

gpt-oss-safeguard nedir?

gpt-oss-safeguard, gpt-oss ailesinden sonradan eğitilmiş, açık ağırlıklı, yalnızca metin içeren bir akıl yürütme modeli çiftidir. doğal dilde yazılmış bir politikayı yorumlayın ve metni bu politikaya göre etiketleyinAyırt edici özellik, politikanın şu şekilde olmasıdır: çıkarım zamanında sağlandı (girdi olarak politika), statik sınıflandırıcı ağırlıklarına dahil edilmemiştir. Modeller öncelikle güvenlik sınıflandırma görevleri için tasarlanmıştır; örneğin, çoklu politika denetimi, birden fazla düzenleyici rejimde içerik sınıflandırması veya politika uyumluluk kontrolleri.

Neden bu konularda

Geleneksel moderasyon sistemleri genellikle (a) etiketli örnekler üzerinde eğitilmiş sınıflandırıcılara eşlenen sabit kural kümelerine veya (b) anahtar kelime tespiti için sezgisel yöntemlere/düzenli ifadelere dayanır. gpt-oss-safeguard paradigmayı değiştirmeye çalışır: Politika değiştiğinde sınıflandırıcıları yeniden eğitmek yerine, bir politika metni (örneğin, şirketinizin kabul edilebilir kullanım politikası, platform hizmet şartları veya bir düzenleyicinin kılavuzu) sağlarsınız ve model, belirli bir içeriğin bu politikayı ihlal edip etmediğini gerekçelendirir. Bu, çeviklik (yeniden eğitim olmadan politika değişiklikleri) ve yorumlanabilirlik (model kendi akıl yürütme zincirini çıktı olarak verir) vaat eder.

Temel felsefesi şudur: "Ezberlemeyi akıl yürütmeyle, tahmin etmeyi açıklamayla değiştirmek."

Bu, içerik güvenliğinde yeni bir aşamayı temsil ediyor ve "kuralları pasif olarak öğrenmekten" "kuralları aktif olarak anlamaya" geçişi temsil ediyor.

gpt-oss-safeguard, geliştiriciler tarafından tanımlanan güvenlik politikalarını doğrudan okuyabilir ve çıkarım sırasında yargılarda bulunmak için bu politikaları izleyebilir.

gpt-oss-safeguard nasıl çalışır?

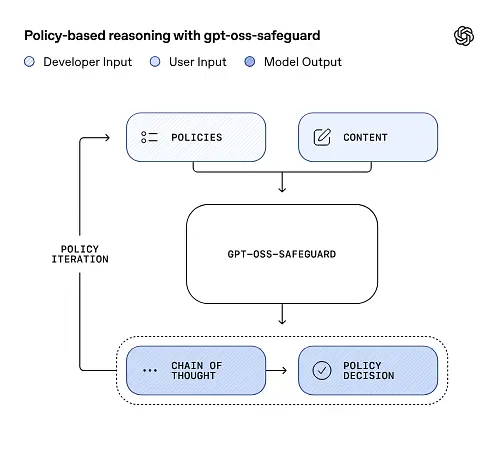

Giriş olarak politika muhakemesi

Çıkarım zamanında iki şey sağlarsınız: politika metni ve aday içeriği Etiketlenecek. Model, politikayı birincil talimat olarak ele alır ve ardından içeriğin izin verilip verilmediğini, izin verilmediğini veya ek denetim adımları gerektirdiğini belirlemek için adım adım akıl yürütme gerçekleştirir. Çıkarım sırasında model:

- bir sonuç (etiket, kategori, güven) ve bu sonuca neden varıldığını açıklayan insan tarafından okunabilir bir akıl yürütme izi içeren yapılandırılmış bir çıktı üretir.

- sınıflandırılacak politikayı ve içeriği alır,

- düşünce zinciri benzeri adımlar kullanarak politikanın maddelerini dahili olarak akıl yürütür ve

Örneğin:

Policy: Content that encourages violence, hate speech, pornography, or fraud is not allowed.

Content: This text describes a fighting game.

Cevap olarak şunu diyecektir:

Classification: Safe

Reasoning: The content only describes the game mechanics and does not encourage real violence.

Düşünce Zinciri (CoT) ve yapılandırılmış çıktılar

gpt-oss-safeguard, her çıkarımın bir parçası olarak tam bir CoT izi yayınlayabilir. CoT'nin denetlenebilir olması amaçlanmıştır; uyumluluk ekipleri modelin neden bir sonuca ulaştığını okuyabilir ve mühendisler bu izi politika belirsizliğini veya model hata modlarını teşhis etmek için kullanabilir. Model ayrıca şunları da destekler: yapılandırılmış çıktılar—örneğin, bir karar, ihlal edilen politika bölümleri, önem puanı ve önerilen düzeltme eylemlerini içeren bir JSON—bunun moderasyon kanallarına entegre edilmesini kolaylaştırır.

Ayarlanabilir "muhakeme çabası" seviyeleri

Gecikme, maliyet ve kapsamlılık arasında denge kurmak için modeller yapılandırılabilir akıl yürütme çabasını destekler: düşük / orta / yüksekDaha fazla çaba, düşünce zincirinin derinliğini artırır ve genellikle daha sağlam, ancak daha yavaş ve maliyetli çıkarımlar sağlar. Bu, geliştiricilerin iş yüklerini sınıflandırmasına olanak tanır; rutin içerik için düşük çaba, uç durumlar veya yüksek riskli içerik için ise yüksek çaba kullanırlar.

Model yapısı nasıldır ve hangi versiyonları mevcuttur?

Model aile ve soy

gpt-oss-safeguard eğitim sonrası OpenAI'nin önceki varyantları gpt-oss Açık modeller. Koruma ailesi şu anda iki farklı boyutta yayınlanmıştır:

- gpt-oss-safeguard-120b — optimize edilmiş çalışma zamanlarında bile tek bir 80 GB GPU üzerinde çalışan, yüksek doğruluklu muhakeme görevleri için tasarlanmış 120 milyar parametreli bir model.

- gpt-oss-safeguard-20b — Düşük maliyetli çıkarım ve uç veya şirket içi ortamlar için optimize edilmiş 20 milyar parametreli bir model (bazı yapılandırmalarda 16 GB VRAM aygıtlarında çalışabilir).

Mimari notları ve çalışma zamanı özellikleri (ne beklenmeli)

- Jeton başına etkin parametreler: Altta yatan gpt-oss mimarisi, belirteç başına etkinleştirilen parametre sayısını azaltan teknikler kullanır (ana gpt-oss'ta yoğun ve seyrek dikkat / uzmanların karışımı tarzı tasarım).

- Pratikte, 120B sınıfı tek büyük hızlandırıcılara uyar ve 20B sınıfı optimize edilmiş çalışma sürelerinde 16 GB VRAM kurulumlarında çalışacak şekilde tasarlanmıştır.

Koruma modelleri ek biyolojik veya siber güvenlik verileriyle eğitilmemişve gpt-oss sürümü için gerçekleştirilen en kötü durum kötüye kullanım senaryolarının analizlerinin kabaca koruma varyantlarına da uygulandığını belirtmektedir. Modeller, son kullanıcılar için içerik oluşturmaktan ziyade sınıflandırma amaçlıdır.

gpt-oss-safeguard'ın hedefleri nelerdir?

Hedefler

- Politika esnekliği: Geliştiricilerin herhangi bir politikayı doğal dilde tanımlamasına ve modelin özel etiket koleksiyonu olmadan bunu uygulamasına izin verin.

- Açıklanabilirlik: Kararların denetlenebilmesi ve politikaların yinelenebilmesi için akıl yürütmeyi ortaya koymak.

- Erişilebilirlik: kuruluşların yerel olarak güvenlik muhakemesini yürütebilmeleri ve modelin iç yapısını inceleyebilmeleri için açık bir alternatif sunmak.

Klasik sınıflandırıcılarla karşılaştırma

Artıları ve geleneksel sınıflandırıcılar

- Politika değişiklikleri için yeniden eğitim yok: Moderasyon politikanız değişirse, etiketleri toplayıp bir sınıflandırıcıyı yeniden eğitmek yerine politika belgesini güncelleyin.

- Daha zengin muhakeme: CoT çıktıları, ince politika etkileşimlerini ortaya çıkarabilir ve insan değerlendiriciler için yararlı anlatısal gerekçeler sağlayabilir.

- Özelleştirilebilirlik: Tek bir model, çıkarım sırasında aynı anda birçok farklı politikayı uygulayabilir.

Geleneksel sınıflandırıcılara karşı eksiler

- Bazı görevler için performans tavanları: OpenAI'nin değerlendirme notları şöyle: On binlerce etiketli örnek üzerinde eğitilen yüksek kaliteli sınıflandırıcılar gpt-oss-safeguard'ı geride bırakabilir Özel sınıflandırma görevlerinde. Amaç ham sınıflandırma doğruluğu olduğunda ve etiketlenmiş verileriniz olduğunda, bu dağılım üzerinde eğitilmiş özel bir sınıflandırıcı daha iyi olabilir.

- Gecikme ve maliyet: CoT ile akıl yürütme, hafif bir sınıflandırıcıya göre daha yoğun hesaplama gerektirir ve daha yavaştır; bu, tamamen korumaya dayalı boru hatlarının ölçekte pahalı olmasına neden olabilir.

Kısaca: gpt-oss-safeguard'ın en iyi kullanıldığı yer politika çevikliği ve denetlenebilirlik önceliklidir veya etiketli veriler kıt olduğunda — ve ölçek açısından optimize edilmiş bir sınıflandırıcı için anında bir yedek olarak değil, hibrit veri hatlarında tamamlayıcı bir bileşen olarak.

gpt-oss-safeguard OpenAI'nin değerlendirmelerinde nasıl bir performans gösterdi?

OpenAI, iç ve dış değerlendirmeleri özetleyen 10 sayfalık bir teknik raporda temel sonuçları yayınladı. Temel çıkarımlar (seçilmiş, yük taşıyan metrikler):

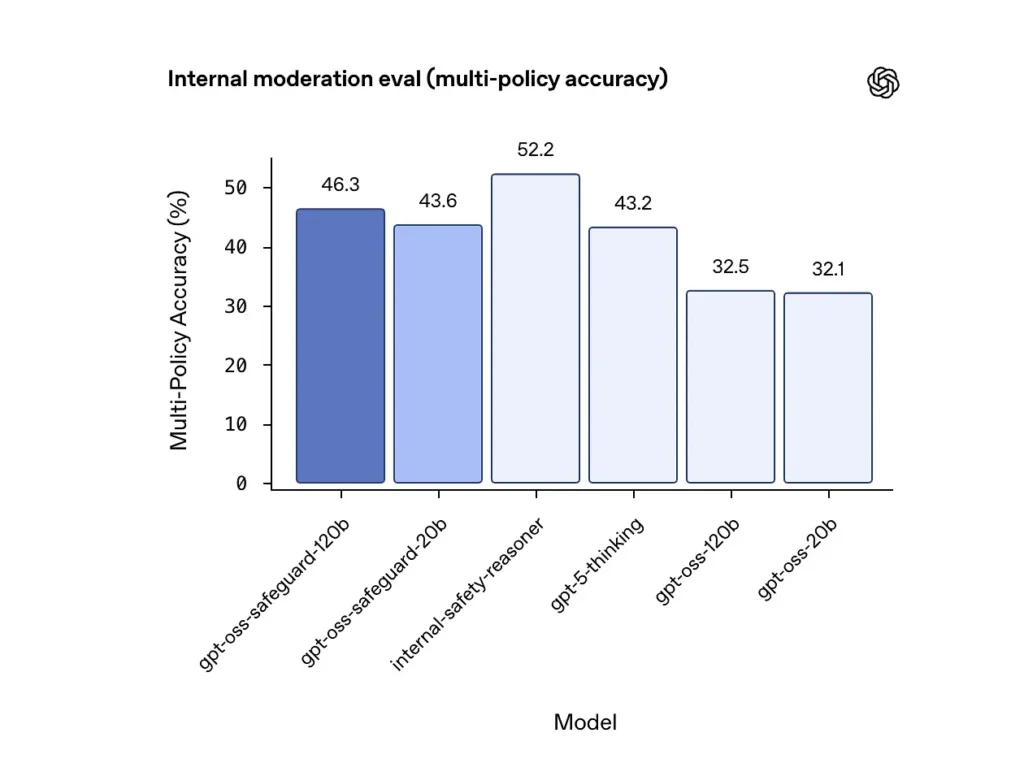

Çoklu politika doğruluğu (dahili değerlendirme)

OpenAI, modeli vererek çoklu politika doğruluğunu değerlendirdi çoklu politikaları aynı anda uygulamak ve bir tahmini yalnızca altın etiketlerle eşleşirse doğru olarak saymak herşey Politikalar. Sonuçlar:

- gpt-oss-safeguard-120b: 46.3% çoklu politika doğruluğu

- gpt-oss-safeguard-20b: 43.6%

- Karşılaştırma için: gpt-5-düşünme: 43.2%; gpt-oss-120b: 32.5%; gpt-oss-20b: 32.1%.

OpenAI'nin dahili "güvenlik muhakemesi" topluluğu aynı testte %52.2 puan aldı. Bu rakamlar, koruma modellerinin çoklu politika görevinde gpt-oss temel modellerinden önemli ölçüde daha iyi performans gösterdiğini ve dahili çoklu politika metriğinde daha büyük gpt-5 düşünme temel çizgisini bile aştığını gösteriyor.

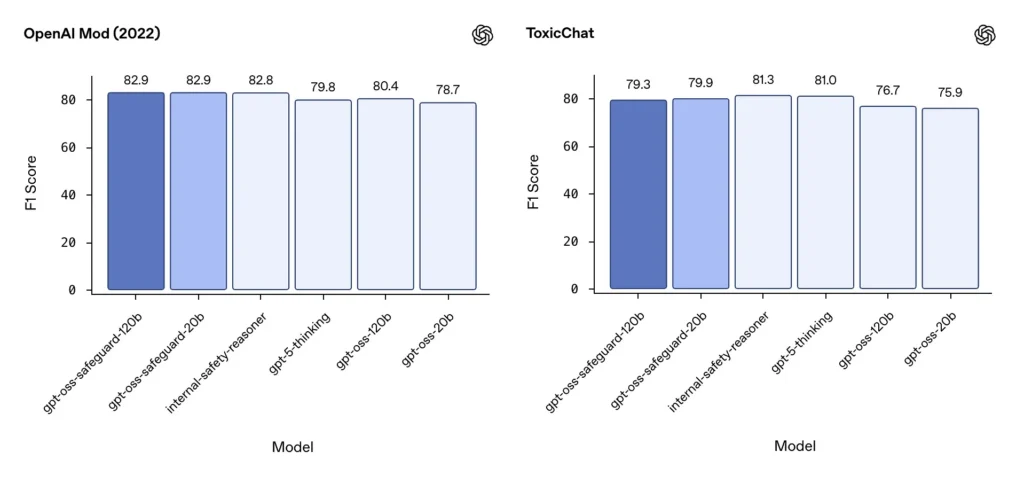

Moderasyon F1 (harici kıyaslamalar)

OpenAI'nin 2022 moderasyon veri setinde ve halka açık ToxicChat kıyaslamasında, gpt-oss-safeguard modelleri sağlam F1 puanları elde etti:

- OpenAI Modu (2022) F1: gpt-oss-güvenlik-120b = 82.9%, gpt-oss-güvenlik-20b = 82.9%

- ToxicChat F1: gpt-oss-güvenlik-120b = 79.3%, gpt-oss-güvenlik-20b = 79.9%

Bu puanlar gpt-oss-safeguard'ı bazı kıyaslamalarda uzmanlaşmış OpenAI dahili sistemlerinin hemen arkasında veya biraz gerisinde, genel olarak ise ince ayar yapılmamış gpt-oss muadillerinin önünde konumlandırıyor.

Gözlemlenen sınırlamalar

OpenAI iki pratik sınırlamaya işaret ediyor:

- Büyük, göreve özgü etiketli veri kümeleri üzerinde eğitilen sınıflandırıcılar, koruma modellerini hâlâ geride bırakabilir sınıflandırma doğruluğunun tek amaç olduğu durumlarda.

- Hesaplama ve gecikme maliyetleri: CoT akıl yürütmesi, çıkarım süresini ve hesaplama tüketimini artırır; bu da, sınıflandırma sınıflandırıcıları ve eşzamansız veri hatları ile eşleştirilmediği takdirde platform düzeyindeki trafiğe ölçeklemeyi zorlaştırır.

Çok dilli eşitlik

gpt-oss-safeguard, MMMLU tarzı testlerde birçok dilde temel gpt-oss modelleriyle aynı performansı gösteriyor ve bu da ince ayarlı koruma varyantlarının geniş muhakeme yeteneğini koruduğunu gösteriyor.

Ekipler gpt-oss-safeguard'a nasıl erişebilir ve onu nasıl dağıtabilir?

OpenAI, Apache 2.0 altında ağırlıkları sağlar ve modelleri indirmeye bağlar (Hugging Face). gpt-oss-safeguard açık ağırlıklı bir model olduğundan, yerel ve kendi kendine yönetilen dağıtım (gizlilik ve özelleştirme için önerilir).

- Model ağırlıklarını indirin (OpenAI / Hugging Face'den) ve bunları kendi sunucularınızda veya bulut sanal makinelerinizde barındırın. Apache 2.0, değişiklik yapılmasına ve ticari kullanıma izin verir.

- Süre: Büyük dönüştürücü modellerini (ONNX Runtime, Triton veya optimize edilmiş satıcı çalışma zamanları) destekleyen standart çıkarım çalışma zamanlarını kullanın. Ollama ve LM Studio gibi topluluk çalışma zamanları halihazırda gpt-oss aileleri için destek ekliyor.

- donanım: 120B genellikle yüksek bellekli GPU'lar (örneğin, 80GB A100 / H100 veya çoklu GPU parçalama) gerektirirken, 20B daha ucuza çalıştırılabilir ve 16GB VRAM kurulumları için optimize edilmiş seçeneklere sahiptir. Kapasiteyi, en yüksek verim ve çoklu politika değerlendirme maliyetleri için planlayın.

Yönetilen ve üçüncü taraf çalışma zamanları

Kendi donanımınızı çalıştırmak pratik değilse, Kuyrukluyıldız API'si gpt-oss modelleri için desteği hızla artırıyor. Bu platformlar daha kolay ölçeklendirme sağlayabilir, ancak üçüncü taraf veri ifşası dezavantajlarını yeniden gündeme getirir. Yönetilen çalışma zamanlarını seçmeden önce gizliliği, SLA'ları ve erişim kontrollerini değerlendirin.

gpt-oss-safeguard ile etkili moderasyon stratejileri

1) Hibrit bir boru hattı kullanın (triyaj → gerekçe → karara varma)

- Triyaj katmanı: Küçük ve hızlı sınıflandırıcılar (veya kurallar) önemsiz durumları filtreler. Bu, pahalı koruma modelinin yükünü azaltır.

- Koruma katmanı: Politika nüanslarının önemli olduğu belirsiz, yüksek riskli veya çoklu politika kontrolleri için gpt-oss-safeguard'ı çalıştırın.

- İnsan yargısı: Sınır vakaları ve itirazları yönetin ve CoT'yi şeffaflık kanıtı olarak saklayın. Bu hibrit tasarım, verimlilik ve hassasiyeti dengeler.

2) Politika mühendisliği (hızlı mühendislik değil)

- Politikaları yazılım ürünleri olarak ele alın: onları sürümlendirin, veri kümelerine karşı test edin ve açık ve hiyerarşik tutun.

- Politikaları örnekler ve karşı örneklerle yazın. Mümkün olduğunda, belirsizliği giderici talimatlar ekleyin (örneğin, "Kullanıcının amacı açıkça keşifsel ve tarihsel ise, X olarak etiketleyin; amaç operasyonel ve gerçek zamanlı ise, Y olarak etiketleyin").

3) Akıl yürütme çabasını dinamik olarak yapılandırın

- Kullanım düşük çaba toplu işleme için ve yüksek çaba işaretli içerik, itirazlar veya yüksek etkili dikeyler (hukuk, tıp, finans) için.

- Maliyet/kalite dengesini bulmak için insan incelemesi geri bildirimleriyle eşikleri ayarlayın.

4) CoT'yi doğrulayın ve halüsinasyonlu akıl yürütmeye dikkat edin

CoT değerlidir, ancak halüsinasyona yol açabilir: iz, temel gerçek değil, model tarafından oluşturulmuş bir gerekçedir. CoT çıktılarını düzenli olarak denetleyin; halüsinasyonlu alıntılar veya uyumsuz akıl yürütmeler için dedektörler kullanın. OpenAI, halüsinasyonlu düşünce zincirlerini gözlemlenen bir zorluk olarak belgelendirir ve hafifletme stratejileri önerir.

5) Sistem operasyonundan veri kümeleri oluşturun

Sınıflandırma sınıflandırıcılarını iyileştirebilecek veya politika değişikliklerine bilgi sağlayabilecek etiketli veri kümeleri oluşturmak için logaritmik model kararları ve insan düzeltmeleri. Zamanla, küçük ve yüksek kaliteli etiketli bir veri kümesi ve verimli bir sınıflandırıcı, rutin içerik için tam CoT çıkarımına olan bağımlılığı azaltır.

6) Hesaplama ve maliyetleri izleyin; eşzamansız akışları kullanın

Tüketiciye yönelik düşük gecikmeli uygulamalar için, yüksek çaba gerektiren CoT'yi eş zamanlı olarak gerçekleştirmek yerine, kısa vadeli, muhafazakar bir UX ile eşzamansız güvenlik kontrollerini (örneğin, inceleme bekleyen içeriği geçici olarak gizleme) göz önünde bulundurun. OpenAI, Safety Reasoner'ın üretim hizmetleri için gecikmeyi yönetmek amacıyla dahili olarak eşzamansız akışları kullandığını belirtiyor.

7) Gizliliği ve dağıtım konumunu göz önünde bulundurun

Ağırlıklar açık olduğundan, sıkı veri yönetimine uymak veya üçüncü taraf API'lerine maruz kalmayı azaltmak için çıkarımı tamamen şirket içinde çalıştırabilirsiniz; bu, düzenlenen sektörler için değerlidir.

Sonuç:

gpt-oss-safeguard, pratik, şeffaf ve esnek bir araçtır politika odaklı güvenlik gerekçesiİhtiyacınız olduğunda parlar açık politikalara bağlı denetlenebilir kararlar, politikalarınız sık sık değiştiğinde veya güvenlik kontrollerini şirket içinde tutmak istediğinizde. değil Özelleştirilmiş, yüksek hacimli sınıflandırıcıların yerini otomatik olarak alacak sihirli bir formül: OpenAI'nin kendi değerlendirmeleri, büyük etiketli korpuslar üzerinde eğitilmiş özel sınıflandırıcıların, dar görevler için ham doğrulukta bu modellerden daha iyi performans gösterebileceğini gösteriyor. Bunun yerine, gpt-oss-safeguard'ı stratejik bir bileşen olarak ele alın: katmanlı bir güvenlik mimarisinin (hızlı sınıflandırma → açıklanabilir akıl yürütme → insan gözetimi) merkezindeki açıklanabilir akıl yürütme motoru.

Başlamak

CometAPI, OpenAI'nin GPT serisi, Google'ın Gemini, Anthropic'in Claude, Midjourney, Suno ve daha fazlası gibi önde gelen sağlayıcılardan 500'den fazla AI modelini tek bir geliştirici dostu arayüzde toplayan birleşik bir API platformudur. Tutarlı kimlik doğrulama, istek biçimlendirme ve yanıt işleme sunarak CometAPI, AI yeteneklerinin uygulamalarınıza entegrasyonunu önemli ölçüde basitleştirir. İster sohbet robotları, görüntü oluşturucular, müzik bestecileri veya veri odaklı analiz hatları oluşturuyor olun, CometAPI daha hızlı yineleme yapmanızı, maliyetleri kontrol etmenizi ve satıcıdan bağımsız kalmanızı sağlar; tüm bunları yaparken AI ekosistemindeki en son atılımlardan yararlanırsınız.

En son gpt-oss-safeguard entegrasyonu yakında CometAPI'de görünecek, bu yüzden bizi izlemeye devam edin! gpt-oss-safeguard Model yüklemesini tamamlarken, geliştiriciler şuraya erişebilir: GPT-OSS-20B API ve GPT-OSS-120B API CometAPI aracılığıyla, en son model versiyonu Resmi web sitesi aracılığıyla sürekli güncellenmektedir. Başlamak için, modelin yeteneklerini keşfedin. Oyun Alanı ve danışın API kılavuzu Ayrıntılı talimatlar için. Erişimden önce, lütfen CometAPI'ye giriş yaptığınızdan ve API anahtarını edindiğinizden emin olun. Kuyrukluyıldız API'si Entegrasyonunuza yardımcı olmak için resmi fiyattan çok daha düşük bir fiyat teklif ediyoruz.

Gitmeye hazır mısınız?→ Bugün CometAPI'ye kaydolun !

Yapay zeka hakkında daha fazla ipucu, kılavuz ve haber öğrenmek istiyorsanız bizi takip edin VK, X ve Katılın!