19–20 Kasım 2025'te OpenAI, birbiriyle ilişkili ancak farklı iki yükseltme yayımladı: Codex için uzun vadeli kodlamayı, token verimliliğini ve çoklu pencere oturumlarını sürdürmek için “sıkıştırmayı” vurgulayan yeni bir etmen tabanlı kodlama modeli olan GPT-5.1-Codex-Max ve karmaşık, profesyonel çalışmalarda daha açık ve daha yetenekli yanıtlar için ayarlanmış güncellenmiş Pro katmanı ChatGPT modeli olan GPT-5.1 Pro.

GPT-5.1-Codex-Max nedir ve hangi sorunu çözmeye çalışır?

GPT-5.1-Codex-Max, OpenAI'nin sürdürülen, uzun vadeli muhakeme ve yürütme gerektiren kodlama iş akışları için ayarlanmış özel bir Codex modelidir. Sıradan modeller son derece uzun bağlamlarda — örneğin çok dosyalı yeniden düzenlemeler, karmaşık etmen döngüleri veya kalıcı CI/CD görevleri — zorlanabilirken, Codex-Max oturum durumunu birden fazla bağlam penceresi arasında otomatik olarak sıkıştırmak ve yönetmek üzere tasarlanmıştır; bu da tek bir proje binlerce (veya daha fazla) token'a yayıldığında tutarlı şekilde çalışmaya devam etmesini sağlar. OpenAI, Codex-Max'i kod yetenekli etmenleri uzun süreli mühendislik çalışmaları için gerçekten kullanışlı hale getirmenin bir sonraki adımı olarak konumlandırıyor.

GPT-5.1-Codex-Max nedir ve hangi sorunu çözmeye çalışır?

GPT-5.1-Codex-Max, OpenAI'nin sürdürülen, uzun vadeli muhakeme ve yürütme gerektiren kodlama iş akışları için ayarlanmış özel bir Codex modelidir. Sıradan modeller son derece uzun bağlamlarda — örneğin çok dosyalı yeniden düzenlemeler, karmaşık etmen döngüleri veya kalıcı CI/CD görevleri — zorlanabilirken, Codex-Max oturum durumunu birden fazla bağlam penceresi arasında otomatik olarak sıkıştırmak ve yönetmek üzere tasarlanmıştır; bu da tek bir proje binlerce (veya daha fazla) token'a yayıldığında tutarlı şekilde çalışmaya devam etmesini sağlar.

OpenAI tarafından “geliştirme döngüsünün her aşamasında daha hızlı, daha akıllı ve daha token verimli” olarak tanımlanır ve Codex yüzeylerinde varsayılan model olarak GPT-5.1-Codex'in yerini alması açıkça amaçlanmıştır.

Özellik özeti

- Çoklu pencere sürekliliği için sıkıştırma: milyonlarca token ve saatler boyunca tutarlı çalışmak için kritik bağlamı ayıklar ve korur. 0

- GPT-5.1-Codex ile karşılaştırıldığında geliştirilmiş token verimliliği: bazı kod kıyaslamalarında benzer muhakeme çabası için ~%30'a kadar daha az düşünme token'ı.

- Uzun vadeli etmen dayanıklılığı: dahili olarak çok saatli/çok günlük etmen döngülerini sürdürebildiği gözlemlenmiştir (OpenAI, >24 saatlik dahili çalışmaları belgeledi).

- Platform entegrasyonları: bugün Codex CLI, IDE uzantıları, bulut ve kod inceleme araçlarında kullanılabilir; API erişimi yakında gelecek.

- Windows ortamı desteği: OpenAI özellikle Windows'un Codex iş akışlarında ilk kez desteklendiğini belirtiyor; bu da gerçek dünyadaki geliştirici erişimini genişletiyor.

Rakip ürünlerle karşılaştırıldığında nasıl konumlanıyor (ör. GitHub Copilot, diğer kodlama yapay zekâları)?

GPT-5.1-Codex-Max, istek başına tamamlama araçlarına kıyasla daha otonom, uzun vadeli bir işbirlikçi olarak sunuluyor. Copilot ve benzeri yardımcılar editör içindeki kısa vadeli tamamlamalarda öne çıkarken, Codex-Max'in güçlü yönleri çok adımlı görevleri orkestre etmek, oturumlar arasında tutarlı durumu korumak ve planlama, test ve yineleme gerektiren iş akışlarını yönetmektir. Bununla birlikte, çoğu ekip için en iyi yaklaşım hibrit olacaktır: karmaşık otomasyon ve uzun süreli etmen görevleri için Codex-Max'i, satır düzeyindeki tamamlamalar için ise daha hafif yardımcıları kullanın.

GPT-5.1-Codex-Max nasıl çalışır?

“Sıkıştırma” nedir ve uzun süreli çalışmayı nasıl mümkün kılar?

Temel teknik ilerlemelerden biri sıkıştırmadır—oturum geçmişini ayıklarken bağlamın önemli parçalarını koruyan ve modelin birden fazla bağlam penceresi boyunca tutarlı çalışmayı sürdürmesini sağlayan dahili bir mekanizma. Pratikte bu, bağlam sınırına yaklaşan Codex oturumlarının sıkıştırılacağı (eski veya daha düşük değerli token'ların özetlenip/korunacağı) anlamına gelir; böylece etmen yeni bir pencereye sahip olur ve görev tamamlanana kadar tekrar tekrar yinelemeye devam edebilir. OpenAI, modelin görevler üzerinde 24 saatten daha uzun süre kesintisiz çalıştığı dahili çalışmaları bildiriyor.

Uyarlanabilir muhakeme ve token verimliliği

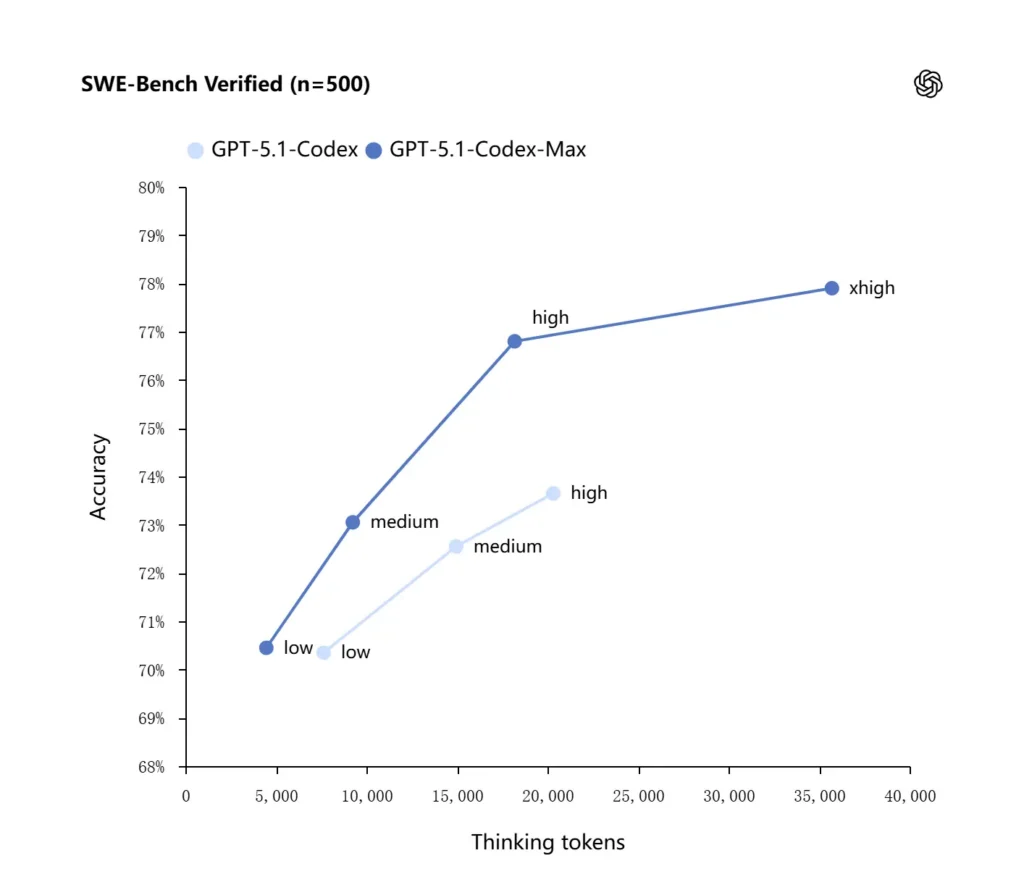

GPT-5.1-Codex-Max, onu daha token verimli hale getiren geliştirilmiş muhakeme stratejileri uygular: OpenAI'nin bildirdiği dahili kıyaslamalarda, Max modeli GPT-5.1-Codex ile benzer veya daha iyi performansı önemli ölçüde daha az “düşünme” token'ı kullanarak elde eder—OpenAI, eşit muhakeme çabasında SWE-bench Verified üzerinde yaklaşık %30 daha az düşünme token'ı kullanıldığını belirtir. Model ayrıca gecikmeye duyarlı olmayan görevler için, daha yüksek kaliteli çıktılar elde etmek amacıyla daha fazla dahili muhakeme harcamasına izin veren bir “Extra High (xhigh)” muhakeme çabası modu sunar.

Sistem entegrasyonları ve etmen tabanlı araçlar

Codex-Max, gerçek geliştirici araç zincirleriyle etkileşime girebilmesi için Codex iş akışları (CLI, IDE uzantıları, bulut ve kod inceleme yüzeyleri) içinde dağıtılıyor. İlk entegrasyonlar arasında Codex CLI ve IDE etmenleri (VS Code, JetBrains vb.) yer alıyor; API erişiminin daha sonra gelmesi planlanıyor. Tasarım hedefi yalnızca daha akıllı kod üretimi değil, aynı zamanda çok adımlı iş akışlarını yürütebilen bir yapay zekâdır: dosyaları açmak, testleri çalıştırmak, hataları düzeltmek, yeniden düzenlemek ve yeniden çalıştırmak.

GPT-5.1-Codex-Max kıyaslamalarda ve gerçek işlerde nasıl performans gösteriyor?

Sürdürülen muhakeme ve uzun vadeli görevler

Değerlendirmeler, sürdürülen muhakeme ve uzun vadeli görevlerde ölçülebilir iyileşmelere işaret ediyor:

- OpenAI dahili değerlendirmeleri: Codex-Max'in dahili deneylerde görevler üzerinde “24 saatten fazla” çalışabildiği ve Codex'in geliştirici araçlarıyla entegrasyonunun dahili mühendislik verimliliği metriklerini (ör. kullanım ve pull request verimi) artırdığı belirtiliyor. Bunlar OpenAI'nin dahili iddialarıdır ve gerçek dünyadaki üretkenlikte görev düzeyinde iyileşmelere işaret eder.

- Bağımsız değerlendirmeler (METR): METR'nin bağımsız raporu, GPT-5.1-Codex-Max için gözlemlenen %50 zaman ufkunu (modelin uzun bir görevi tutarlı biçimde sürdürebildiği medyan süreyi temsil eden bir istatistik) yaklaşık 2 saat 40 dakika olarak ölçtü (geniş bir güven aralığıyla); bu değer, karşılaştırılabilir ölçümlerde GPT-5'in 2 saat 17 dakikasından yüksektir — sürdürülen tutarlılıkta anlamlı ve eğilimle uyumlu bir iyileşme. METR'nin metodolojisi ve güven aralığı değişkenliği vurgulasa da sonuç, Codex-Max'in pratik uzun vadeli performansı iyileştirdiği anlatısını destekliyor.

Kod Kıyaslamaları

OpenAI, öncü kodlama değerlendirmelerinde daha iyi sonuçlar bildirmektedir; özellikle SWE-bench Verified'da GPT-5.1-Codex-Max, daha iyi token verimliliğiyle GPT-5.1-Codex'i geride bırakmaktadır. Şirket, aynı “medium” muhakeme çabasında Max modelinin yaklaşık %30 daha az düşünme token'ı kullanırken daha iyi sonuçlar ürettiğini vurguluyor; daha uzun dahili muhakemeye izin veren kullanıcılar için xhigh modu, gecikme pahasına yanıtları daha da geliştirebilir.

| GPT‑5.1-Codex (high) | GPT‑5.1-Codex-Max (xhigh) | |

| SWE-bench Verified (n=500) | 73.7% | 77.9% |

| SWE-Lancer IC SWE | 66.3% | 79.9% |

| Terminal-Bench 2.0 | 52.8% | 58.1% |

GPT-5.1-Codex-Max, GPT-5.1-Codex ile nasıl karşılaştırılır?

Performans ve amaç farkları

- Kapsam: GPT-5.1-Codex, GPT-5.1 ailesinin yüksek performanslı bir kodlama varyantıydı; Codex-Max ise açıkça Codex ve Codex benzeri ortamlar için önerilen varsayılan haline gelmesi amaçlanan, etmen tabanlı ve uzun vadeli bir haleftir.

- Token verimliliği: Codex-Max, SWE-bench üzerinde ve dahili kullanımda önemli token verimliliği kazanımları göstermektedir (OpenAI'nin ~%30 daha az düşünme token'ı iddiası).

- Bağlam yönetimi: Codex-Max, tek bir bağlam penceresini aşan görevleri sürdürebilmek için sıkıştırma ve yerel çoklu pencere işleme sunar; Codex aynı ölçekte bu yeteneği yerel olarak sağlamıyordu.

- Araç zinciri hazırlığı: Codex-Max, CLI, IDE ve kod inceleme yüzeylerinde varsayılan Codex modeli olarak sunulmaktadır; bu da üretim geliştirici iş akışları için bir geçişe işaret eder.

Hangi modeli ne zaman kullanmalısınız?

- GPT-5.1-Codex'i kullanın: etkileşimli kodlama yardımı, hızlı düzenlemeler, küçük yeniden düzenlemeler ve ilgili tüm bağlamın tek bir pencereye rahatça sığdığı daha düşük gecikmeli kullanım durumları için.

- GPT-5.1-Codex-Max'i kullanın: çok dosyalı yeniden düzenlemeler, çok sayıda yineleme döngüsü gerektiren otomatik etmen görevleri, CI/CD benzeri iş akışları veya modelin birçok etkileşim boyunca proje düzeyinde bir bakış açısını korumasına ihtiyaç duyduğunuz durumlar için.

En iyi sonuçlar için pratik istem kalıpları ve örnekler?

İyi çalışan istem kalıpları

- Hedefler ve kısıtlar konusunda açık olun: “X'i yeniden düzenle, genel API'yi koru, işlev adlarını sabit tut ve A,B,C testlerinin geçtiğinden emin ol.”

- Minimum yeniden üretilebilir bağlam sağlayın: tüm depoları dökmek yerine başarısız olan teste bağlantı verin, yığın izlerini ve ilgili dosya parçalarını ekleyin. Codex-Max gerektiğinde geçmişi sıkıştıracaktır.

- Karmaşık görevler için adım adım talimatlar kullanın: büyük işleri bir dizi alt göreve bölün ve Codex-Max'in bunlar üzerinde yineleme yapmasına izin verin (ör. “1) testleri çalıştır 2) ilk 3 başarısız testi düzelt 3) linter'ı çalıştır 4) değişiklikleri özetle”).

- Açıklamalar ve diff'ler isteyin: insan gözden geçirenlerin güvenlik ve amacı hızla değerlendirebilmesi için hem yamayı hem de kısa bir gerekçeyi isteyin.

Örnek istem şablonları

Yeniden düzenleme görevi

“

payment/modülünü, ödeme işleme mantığınıpayment/processor.pyiçine çıkaracak şekilde yeniden düzenle. Mevcut çağıranlar için genel işlev imzalarını sabit tut.process_payment()için başarı, ağ hatası ve geçersiz kart senaryolarını kapsayan birim testleri oluştur. Test paketini çalıştır ve başarısız testleri ile unified diff biçiminde bir yama döndür.”

Hata düzeltme + test

“

tests/test_user_auth.py::test_token_refreshtesti traceback ile başarısız oluyor. Kök nedeni araştır, minimum değişiklikle bir düzeltme öner ve regresyonu önlemek için birim testi ekle. Yamayı uygula ve testleri çalıştır.”

Yinelemeli PR oluşturma

“X özelliğini uygula: dışa aktarma sonuçlarını akış halinde veren ve kimlik doğrulamalı

POST /api/exportuç noktasını ekle. Uç noktayı oluştur, dokümantasyon ekle, testler oluştur ve özet ile manuel maddeler kontrol listesi içeren bir PR aç.”

Bunların çoğu için medium çabayla başlayın; modelin birçok dosya ve birden fazla test yinelemesi boyunca derin muhakeme yapmasına ihtiyaç duyduğunuzda xhigh'a geçin.

GPT-5.1-Codex-Max'e nasıl erişilir

Bugün nerede kullanılabilir?

OpenAI, GPT-5.1-Codex-Max'i bugün Codex araçlarına entegre etmiştir: Codex CLI, IDE uzantıları, bulut ve kod inceleme akışları varsayılan olarak Codex-Max kullanır (Codex-Mini'yi seçebilirsiniz). API kullanılabilirliği hazırlanmaktadır ; GitHub Copilot, GPT-5.1 ve Codex serisi modelleri içeren herkese açık önizlemelere sahiptir.

Geliştiriciler, CometAPI aracılığıyla GPT-5.1-Codex-Max ve GPT-5.1-Codex API erişebilir. Başlamak için, Playground içinde CometAPI model yeteneklerini inceleyin ve ayrıntılı talimatlar için API rehberine başvurun. Erişim sağlamadan önce, lütfen CometAPI'ye giriş yaptığınızdan ve API anahtarını aldığınızdan emin olun. CometAPI, entegrasyonunuza yardımcı olmak için resmî fiyattan çok daha düşük bir fiyat sunar.

Hazır mısınız?→ Bugün CometAPI'ye kaydolun !

Yapay zekâ hakkında daha fazla ipucu, rehber ve haber almak istiyorsanız bizi VK, X ve Discord! üzerinden takip edin

Hızlı başlangıç (pratik adım adım)

- Erişiminiz olduğundan emin olun: ChatGPT/Codex ürün planınızın (Plus, Pro, Business, Edu, Enterprise) veya geliştirici API planınızın GPT-5.1/Codex ailesi modellerini desteklediğini doğrulayın.

- Codex CLI veya IDE uzantısını yükleyin: kod görevlerini yerelde çalıştırmak istiyorsanız Codex CLI'ı veya VS Code / JetBrains / Xcode için Codex IDE uzantısını uygun olduğu şekilde yükleyin. Araçlar, desteklenen kurulumlarda varsayılan olarak GPT-5.1-Codex-Max'i kullanacaktır.

- Muhakeme çabasını seçin: çoğu görev için medium çabayla başlayın. Derin hata ayıklama, karmaşık yeniden düzenlemeler veya modelin daha çok düşünmesini isteyip yanıt gecikmesini önemsemediğiniz durumlarda high ya da xhigh modlarına geçin. Hızlı küçük düzeltmeler için low uygundur.

- Depo bağlamını sağlayın: modele net bir başlangıç noktası verin — bir depo URL'si veya bir dosya kümesi ve kısa bir talimat (ör. “ödeme modülünü async I/O kullanacak şekilde yeniden düzenle ve birim testleri ekle, işlev düzeyindeki sözleşmeleri koru”). Codex-Max bağlam sınırlarına yaklaştığında geçmişi sıkıştıracak ve işe devam edecektir.

- Testlerle yineleyin: model yamalar ürettikten sonra test paketlerini çalıştırın ve hataları devam eden oturumun bir parçası olarak geri besleyin. Sıkıştırma ve çoklu pencere sürekliliği, Codex-Max'in önemli başarısız test bağlamını korumasına ve yineleme yapmasına olanak tanır.

Sonuç:

GPT-5.1-Codex-Max, geliştirilmiş verimlilik ve muhakeme ile karmaşık, uzun süreli mühendislik görevlerini sürdürebilen etmen tabanlı kodlama yardımcılarına doğru önemli bir adımı temsil ediyor. Teknik ilerlemeler (sıkıştırma, muhakeme çabası modları, Windows ortamı eğitimi), onu modern mühendislik organizasyonları için son derece uygun hale getiriyor — tabii ekipler modeli ihtiyatlı operasyonel kontroller, net insan denetimli politikalar ve sağlam izleme ile eşleştirirse. Dikkatli şekilde benimseyen ekipler için Codex-Max, yazılımın nasıl tasarlandığını, test edildiğini ve sürdürüldüğünü değiştirme potansiyeline sahiptir — tekrarlayan mühendislik angaryasını insanlar ve modeller arasında daha yüksek değerli bir işbirliğine dönüştürerek.