DeepSeek نے باضابطہ طور پر V4 کو ایک اوپن سورسڈ ماڈل فیملی کے طور پر پیش کیا ہے، اور سرخی صرف “ایک اور ماڈل اپڈیٹ” نہیں ہے۔ کمپنی V4 کو ایک لمبے کانٹیکسٹ والا، ایجنٹ فرینڈلی سسٹم کے طور پر پوزیشن کر رہی ہے جو حقیقی ورک لوڈز کے لیے بنایا گیا ہے: دستاویزات پر مبنی اینالیسس، کوڈنگ اسسٹنٹس، سرچ ایجنٹس، اور ملٹی اسٹیپ آٹومیشن۔ ریلیز ویب، ایپ اور API پر لائیو ہے، اور V4 لائن اپنے آفیشل سروسز میں لاگت مؤثر 1M-ٹوکن کانٹیکسٹ ونڈو متعارف کراتی ہے۔

اس لانچ کو خاص طور پر قابلِ ذکر بنانے والی چیز اسکیل اور ایفیشنسی کا امتزاج ہے۔ DeepSeek کہتا ہے کہ V4-Pro کے پاس 1.6T کل پیرامیٹرز ہیں جن میں 49B ایکٹیو ہیں، جبکہ V4-Flash کے 284B کل پیرامیٹرز ہیں جن میں 13B ایکٹیو ہیں۔ تکنیکی رپورٹ میں، DeepSeek یہ بھی دعویٰ کرتا ہے کہ V4 آرکیٹیکچر ہائبرڈ اٹینشن، MoE راؤٹنگ، اور پوسٹ ٹریننگ استعمال کرتا ہے جو ایجنٹک بیہیوئر کو بہتر بنانے کے لیے ڈیزائن کی گئی ہے جبکہ الٹرا لانگ کانٹیکسٹ کی کمپیوٹ لاگت کو کم کرتی ہے۔

DeepSeek V4 کیا ہے؟

DeepSeek-V4 کمپنی کی تازہ ترین پری ویو فلیگ شپ فیملی ہے، اور ریلیز میں دو پبلک ویریئنٹس شامل ہیں: V4-Pro اور V4-Flash۔ DeepSeek کے مطابق V4-Pro دنیا کے علم، میتھ، STEM، کوڈنگ، اور ایجنٹک کوڈنگ کے لیے زیادہ مضبوط ماڈل ہے، جبکہ V4-Flash زیادہ ریسپانسِو، کم لاگت آپشن ہے جو پھر بھی کافی حد تک ریزننگ کوالٹی اور لمبے کانٹیکسٹ کی صلاحیت برقرار رکھتا ہے۔ V4-Pro ایجنٹک کوڈنگ اور عالمی معلومات میں موجودہ اوپن ماڈلز کی قیادت کرتا ہے، جبکہ V4-Flash رفتار اور معاشی ڈپلائمنٹ کے لیے ڈیزائن کیا گیا ہے۔

V4 ایک ہائبرڈ اٹینشن آرکیٹیکچر استعمال کرتا ہے جو Compressed Sparse Attention (CSA) اور Heavily Compressed Attention (HCA) کو ملاتا ہے، اس کے علاوہ Manifold-Constrained Hyper-Connections اور Muon optimizer بھی شامل ہیں۔ کمپنی یہ بھی کہتی ہے کہ ماڈلز کو 32T ٹوکنز سے زیادہ پر پری ٹرین کیا گیا، اور 1M کانٹیکسٹ پر V4-Pro کو DeepSeek-V3.2 کے مقابلے میں صرف سنگل-ٹوکن انفیرنس FLOPs کا 27% اور KV کیش کا 10% درکار ہوتا ہے۔ یہی ایفیشنسی کی کہانی اس ریلیز کے پیچھے اصل سرخی ہے۔

DeepSeek-V4-Pro بمقابلہ DeepSeek-V4-Flash

DeepSeek-V4-Pro

V4-Pro ان صارفین کے لیے فلیگ شپ ماڈل ہے جن کے لیے کوالٹی سب سے اہم ہے۔ DeepSeek-V4-Pro مضبوط ایجنٹک کوڈنگ کارکردگی، زیادہ بھرپور عالمی معلومات، اور عالمی معیار کی ریزننگ فراہم کرتا ہے، اور لانچ پیج کے مطابق یہ موجودہ اوپن ماڈلز کی قیادت کرتا ہے جبکہ عالمی معلومات میں صرف Gemini-3.1-Pro سے پیچھے ہے۔ تکنیکی رپورٹ میں، V4-Pro فیملی کا بڑا ماڈل ہے، اور DeepSeek-V4-Pro وہی OpenAI-compatible اور Anthropic-compatible انٹرفیسز کے ذریعے دستیاب ہے جو V4-Flash کے لیے ہیں۔

DeepSeek-V4-Flash

V4-Flash ایفیشنسی-فرسٹ ماڈل ہے؛ اس کی ریزننگ صلاحیتیں V4-Pro کے قریب پہنچتی ہیں، اور یہ سادہ ایجنٹ ٹاسکس پر V4-Pro کے ہم پلہ کارکردگی دکھاتا ہے، جبکہ کم پیرامیٹر فٹ پرنٹ اور تیز ریسپانس ٹائمز استعمال کرتا ہے۔ یہ thinking اور non-thinking دونوں موڈز کو سپورٹ کرتا ہے، اسی 1M کانٹیکسٹ لینتھ اور Pro جیسے بنیادی فیچرز کے ساتھ، مگر بہت کم لاگت پر۔

آپ کون سا منتخب کریں؟

جب ٹاسک ہائی-سٹیکس، نالج ہیوی، یا ویریفائی کرنا مشکل ہو — انٹرپرائز ریسرچ، پیچیدہ کوڈنگ، ملٹی اسٹیپ ڈسیژن سپورٹ، یا وہ کام جہاں آپ کو سب سے مضبوط جواب چاہیے — تو V4-Pro استعمال کریں۔ جب تھروپٹ، لیٹنسی، یا ٹوکن لاگت بینچ مارک کارکردگی کے آخری چند پوائنٹس سے زیادہ اہم ہو، تو V4-Flash استعمال کریں۔ یہ انتخاب آفیشل پوزیشننگ اور دونوں ماڈلز کے درمیان رپورٹڈ بینچ مارک گیپس کے مطابق ہے۔

| آئٹم | DeepSeek-V4-Flash | DeepSeek-V4-Pro |

|---|---|---|

| Total parameters | 284B | 1.6T |

| Active parameters | 13B | 49B |

| Context length | 1M | 1M |

| Reasoning modes | Non-think + think | Non-think + think |

| Best fit | Fast inference, high-throughput apps, cost-sensitive agents | Highest-capability reasoning, harder coding and knowledge tasks |

| Official API pricing | Cache hit $0.028 / cache miss $0.14 / output $0.28 per 1M tokens | Cache hit $0.145 / cache miss $1.74 / output $3.48 per 1M tokens |

| Max output | 384K | 384K |

CometAPI Deepseek v4 Pro اور V4 Flash تک رسائی فراہم کرتا ہے — سرکاری کے مقابلے میں 20% سستا — اور ایک ہی OpenAI-compatible یا Anthropic Messages اینڈپوائنٹ کے ذریعے 500+ ماڈلز (GPT-5.4، Gemini 3.1 وغیرہ) کے درمیان بے جوڑ سوئچنگ بھی دیتا ہے۔

کارکردگی بنچ مارک

DeepSeek-V3.2 بمقابلہ V4-Flash بمقابلہ V4-Pro

بیس-ماڈل تقابلی جدول میں، V4-Flash اور V4-Pro دونوں کور بینچ مارکس پر DeepSeek-V3.2 سے بہتر ہیں، اور عموماً V4-Pro سبقت لیتا ہے۔ مثال کے طور پر، رپورٹ میں درج اسکورز یہ ہیں: AGIEval 82.6 / 83.1 بمقابلہ V3.2 کا 80.1؛ MMLU 88.7 / 90.1 بمقابلہ 87.8؛ MMLU-Pro 68.3 / 73.5 بمقابلہ 65.5؛ HumanEval 69.5 / 76.8 بمقابلہ 62.8؛ اور LongBench-V2 44.7 / 51.5 بمقابلہ 40.2 V3.2 کے لیے، جہاں درمیانی عدد V4-Flash اور آخری V4-Pro ہے۔

| بینچ مارک | DeepSeek-V3.2-Base | DeepSeek-V4-Flash-Base | DeepSeek-V4-Pro-Base |

|---|---|---|---|

| AGIEval (EM) | 80.1 | 82.6 | 83.1 |

| MMLU (EM) | 87.8 | 88.7 | 90.1 |

| MMLU-Pro (EM) | 65.5 | 68.3 | 73.5 |

| HumanEval (Pass@1) | 62.8 | 69.5 | 76.8 |

| LongBench-V2 (EM) | 40.2 | 44.7 | 51.5 |

ماخذ: DeepSeek-V4 تکنیکی رپورٹ، جدول 1۔

پیٹرن سیدھا ہے: Flash نے Pro تک کا فرق کم کر دیا ہے، لیکن Pro اب بھی زیادہ مضبوط جنرل ماڈل ہے۔ اس سے V4-Flash بہت سے پروڈکشن سسٹمز کے لیے عملی ڈیفالٹ بنتا ہے، جبکہ V4-Pro وہ ماڈل ہے جسے آپ اس وقت منتخب کریں جب جواب کی کوالٹی لاگت یا لیٹنسی سے زیادہ اہم ہو۔

مغربی ماڈلز کے تقابلات: V4 کہاں فِٹ ہوتا ہے

چینی وائٹ کالر ٹاسکس پر ایک ہیومَن ایویلیوایشن میں، رپورٹ کہتی ہے کہ DeepSeek-V4-Pro-Max نے Claude Opus 4.6-Max کو 63% non-loss rate کے ساتھ پیچھے چھوڑا۔ DeepSeek-V4-Pro نے Claude Sonnet 4.5 پر “نمایاں برتری” دکھائی اور ایک R&D کوڈنگ بینچ مارک پر Claude Opus 4.5 کے قریب پہنچ گئی۔

| ایویلیوایشن ایریا | DeepSeek نتیجہ | مغربی ماڈل موازنہ | اس سے کیا ظاہر ہوتا ہے |

|---|---|---|---|

| Chinese white-collar tasks | V4-Pro-Max, 63% non-loss rate | vs Claude Opus 4.6-Max | عملی بزنس طرز کے کاموں میں مضبوط کارکردگی |

| R&D coding benchmark | V4-Pro-Max pass rate 67 | vs Claude Sonnet 4.5 at 47; Opus 4.5 at 70; Opus 4.6 Thinking at 80 | معروف فرنٹیئر ماڈلز کے مقابلے میں مسابقتی، خاص طور پر Sonnet درجے کے سسٹمز کے خلاف |

یہ “ہر پہلو میں نمبر ون” نہیں ہے، لیکن یہ پہلے ہی اس سطح پر ہے جسے “سنجیدگی سے جانچا جانا چاہیے”۔

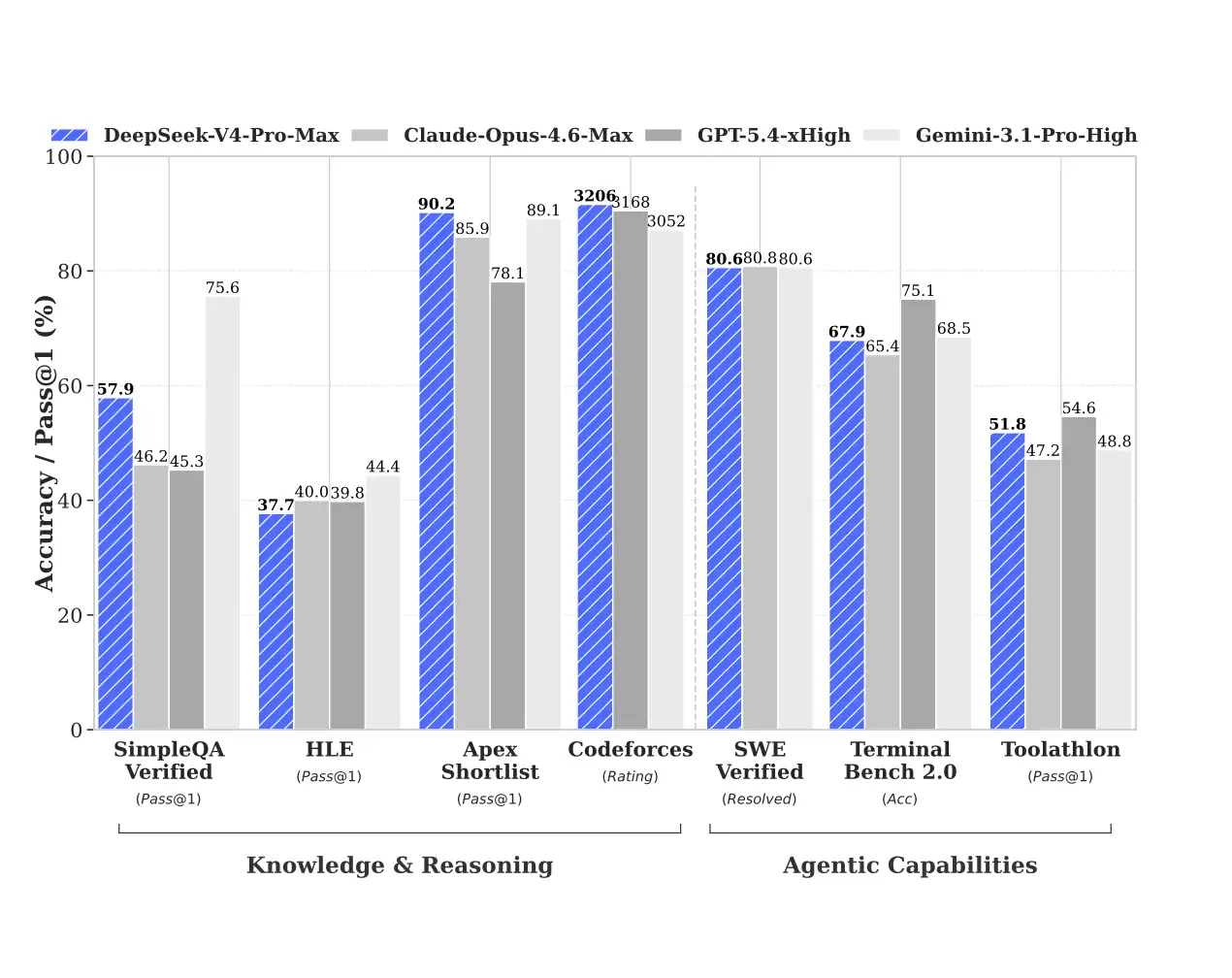

DeepSeek کی تکنیکی رپورٹ میں V4-Pro-Max کا موازنہ اسی جدول میں Claude Opus 4.6 Max، GPT-5.4 xHigh، اور Gemini 3.1 Pro High کے ساتھ کیا گیا ہے۔ نتائج سادہ نہیں ہیں: مغربی کلوژڈ-سورس ماڈلز کچھ علم اور استدلال کے پہلوؤں میں اب بھی مضبوط کارکردگی دکھاتے ہیں؛ تاہم، V4-Pro-Max کوڈ، لمبے کانٹیکسٹس، اور کچھ ایجنٹ ٹاسکس میں بہت مضبوط موجودگی رکھتا ہے۔ دوسرے لفظوں میں، یہ اب “لوکل متبادل” کی کم جہتی کہانی نہیں رہی، بلکہ اس مرحلے میں داخل ہو چکی ہے کہ “آپ کے منظرنامے کے لیے کون زیادہ موزوں ہے”۔

علم اور ریزننگ کی صلاحیت کے لحاظ سے، یہ Opus 4.6 Max، GPT-5.4 xHigh، اور Gemini 3.1 Pro High کے ہم پلہ ہے۔ تاہم، ایجنٹک کیپیبلٹیز میں یہ معمولی سا پیچھے رہتا ہے، اگرچہ فرق خاطر خواہ نہیں۔

DeepSeek-V4-Pro-Max کوڈ پر مبنی اور لمبے کانٹیکسٹ والے منظرناموں میں انتہائی مسابقتی ہے، جبکہ مغربی ماڈلز کئی خالص ریزننگ اور نالج بینچ مارکس میں اب بھی بے حد مضبوط نظر آتے ہیں۔ یہی اس ریلیز کو پڑھنے کا درست طریقہ ہے: DeepSeek V4 مضبوطی سے فرنٹیئر گفتگو کا حصہ ہے، مگر بینچ مارک لیڈر شپ ٹاسک پر منحصر رہتی ہے۔

DeepSeek V4 تک رسائی کیسے حاصل کریں

1) آفیشل ویب اور ایپ استعمال کریں

DeepSeek کہتا ہے کہ V4 Preview اس وقت web، app، اور API پر دستیاب ہے۔ عام صارفین کے لیے سب سے آسان راستہ اب بھی آفیشل چیٹ انٹرفیس ہے، جہاں ماڈل کو Expert Mode یا Instant Mode کے ذریعے ایکسیس کیا جا سکتا ہے۔

2) API استعمال کریں

میں DeepSeek V4 تک رسائی کے لیے CometAPI کی بھرپور سفارش کرتا ہوں، کیونکہ یہ بہترین قیمت اور ایگریگیشن کے فائدے فراہم کرتا ہے۔

ماڈل کے نام یہ ہیں:

deepseek-v4-flashdeepseek-v4-pro

DeepSeek یہ بھی کہتا ہے کہ لیگیسی نام

deepseek-chatاورdeepseek-reasonerکو ڈیپریکٹ کیا جائے گا اور اس وقت تک V4-Flash کے non-thinking اور thinking موڈز پر میپ کیے گئے ہیں، جب تک 2026-07-24۔ اگر آپ کی پروڈکشن میں پہلے سے پرانی انٹیگریشنز موجود ہیں تو یہ مائیگریشن پلاننگ کے لیے اہم ہے۔

- CometAPI پر سائن اپ کریں اور اپنا API key حاصل کریں۔

- اسٹینڈرڈ OpenAI Python SDK (یا کوئی بھی compatible کلائنٹ) ایک کسٹم base URL کے ساتھ استعمال کریں:

یہ آفیشل OpenAI-compatible فارمیٹ استعمال کرتے ہوئے ایک صاف مثال ہے:

import os

from openai import OpenAIclient = OpenAI(

api_key=os.environ["cometapi_API_KEY"],

base_url="https://api.cometapi.com"

)response = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Summarize the benefits of million-token context."}

],

extra_body={"thinking": {"type": "enabled"}},

reasoning_effort="high"

)print(response.choices[0].message.content)

یہ ریکویسٹ پیٹرن کوئیک-اسٹارٹ گائیڈنس کے مطابق ہے: base URL سیٹ کریں، deepseek-v4-pro یا deepseek-v4-flash منتخب کریں، اور جب آپ کو گہری ریزننگ چاہیے تو thinking کو فعال کریں۔

DeepSeek V4 کو مؤثر طریقے سے کیسے استعمال کریں

لانگ-ڈاکیومنٹ ورک فلو کے لیے، سب سے مضبوط پیٹرن یہ ہے کہ کانٹیکسٹ صاف اور ساختہ رکھا جائے۔ V4 کی 1M-ٹوکن ونڈو ایک بڑا فائدہ ہے، مگر ماڈل تب بھی بہترین کارکردگی دکھاتا ہے جب ان پٹ سیکشنز، سورس اقتباسات، ٹاسک ہدایات، اور واضح آؤٹ پٹ کنسٹرینٹس میں منظم ہو۔ یہی وہ قدرتی طریقہ ہے جس سے DeepSeek جس لانگ-کانٹیکسٹ صلاحیت کا دعویٰ کر رہا ہے، اس سے زیادہ سے زیادہ فائدہ اٹھایا جا سکتا ہے۔

کوڈ اور ایجنٹ ورک فلو کے لیے، تیز ایٹریشن کے لیے V4-Flash سے آغاز کریں، پھر آخری رن یا سب سے مشکل مراحل کے لیے V4-Pro پر جائیں۔ یہ اپروچ آفیشل پوزیشننگ سے میل کھاتی ہے: Flash مؤثر آپشن ہے، Pro زیادہ مضبوط ماڈل ہے، اور دونوں ایک ہی API سرفیس اور کانٹیکسٹ لینتھ شیئر کرتے ہیں۔

آخری بات

DeepSeek-V4 قابلِ ذکر ہے کیونکہ یہ چار چیزوں کو ایک ساتھ جوڑتا ہے جن کی مارکیٹ طویل عرصے سے مانگ کر رہی تھی: لمبا کانٹیکسٹ، مضبوط ریزننگ، اوپن دستیابی، اور جارحانہ قیمت۔ اصل کہانی صرف یہ نہیں کہ DeepSeek نے ایک اور ماڈل جاری کیا؛ بلکہ یہ کہ کمپنی فرنٹیئر طرز کی AI کو پروڈکشن میں اقتصادی طور پر قابلِ استعمال بنانے کی کوشش کر رہی ہے۔ وہ ٹیمیں جو اپنی اگلی AI سرمایہ کاری کا فیصلہ کر رہی ہیں، ان کے لیے یہ ایک ایسا اشارہ ہے جسے نظر انداز نہیں بلکہ آزمایا جانا چاہیے۔

جو ٹیمیں متعدد پرووائیڈرز کے ساتھ بناتی ہیں، ان کے لیے یہ بالکل وہی قسم کی ریلیز ہے جسے اپنے اسٹیک کے اندر بینچ مارک کرنا چاہیے۔ CometAPI ایک عملی لیئر ہو سکتی ہے تاکہ DeepSeek-V4 کا دوسرے فرنٹیئر ماڈلز کے ساتھ موازنہ کیا جا سکے، بغیر اس کے کہ ہر بار مارکیٹ کے بدلنے پر آپ کی پروڈکٹ ٹیم انٹیگریشن دوبارہ بنائے۔